Anderson의 관점

객체와 사람을 비디오에서 지우는 AI

아이들이 사진에 남아 있지 않습니다. AI가 그럴 수 있다면.

객체와 사람을 이미지와 비디오에서 제거하는 것은 VFX 중심의 AI 문헌에서 인기 있는 하위 연구 분야로, 점점 더 많은 전문 데이터셋과 프레임워크가 이 도전에 대해 다루고 있습니다. 중국 푸단 대학의 빅데이터 연구소에서 나온 최신 연구는 EffectErase라는 ‘효과 인식’ 비디오 객체 제거 시스템으로, 저자들은 이 시스템이 테스트에서 현狀을 크게 개선했다고 주장합니다.

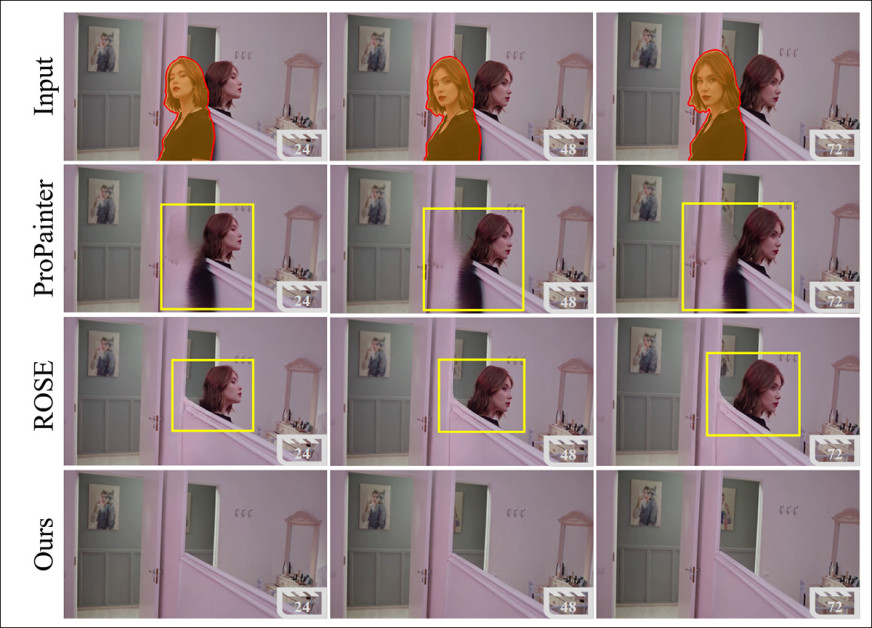

프로젝트 웹사이트의 자료에서 조립된 EffectErase 방법의 예시입니다(링크를 제공하지만, 원본 사이트에는 웹 브라우저의 안정성을影响할 수 있는 많은 고해상도 및 비최적화 자동 재생 비디오가 포함되어 있으므로 주의하세요. 동영상은 이 글의 끝에 첨부되어 있습니다). 원본

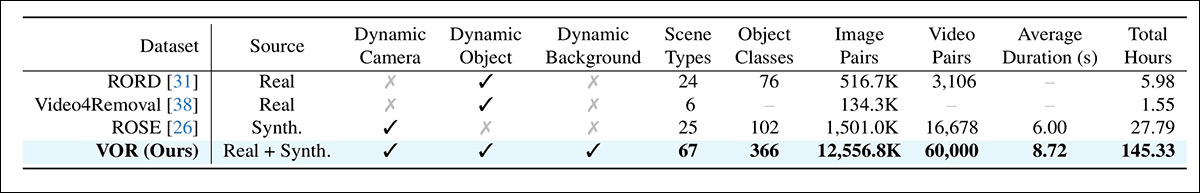

새로운 연구는 거의 350개의 원본 실제 장면과 합성 장면(공개 저장소* 사용)을 포함하는 반신종 데이터셋의 생성/큐레이션을 포함합니다. 이 데이터셋은 전용 장비로 캡처하거나 오픈 소스 Blender 3D 프레임워크를 중심으로 구축된 워크플로에 재사용됩니다.

하이브리드 Video Object Removal(VOR) 데이터셋은 EffectErase 애플리케이션의 기초를 형성하며, 이는 Wan2.1 비디오 생성 시스템 위에 구축됩니다. 이 시스템은 또한 두 개의 새로운 관련 벤치마크를 정의합니다. VOR Eval과 VOR Wild는 각각 그라운드 트루스*가 있는 샘플과 없는 샘플에 대해 사용됩니다.

(이 논문에는 동반 프로젝트 사이트가 있지만, 여러 고해상도 비디오로 과부화되어 로딩이 어려우므로, 프로젝트 사이트를 사용하기 어려울 경우 위에 첨부한 비디오에서 제가 큐레이션한 예시를 참조하세요)

비교 가능한 이전 데이터셋과 관련하여 새로운 제공에 대한 양적 비교. 출처

연구자들은 자신의 접근 방식이 양적 지표와 질적 결과 모두에서 최첨단 성능을 발휘한다고 주장합니다. 그들은 이전 연구가 객체의 부수적 효과(예: 그림자, 반사)를 제거하는 데 항상 성공하지 못했으며, 그들의 데이터셋이 이 결함을 수정하기 위해 신중하게 생성되었다고 말합니다.

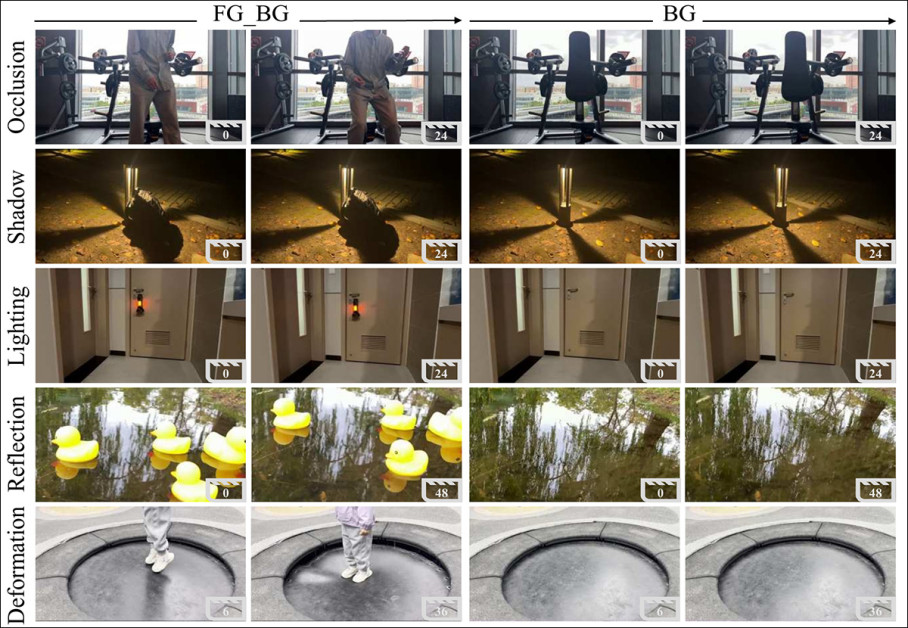

이전 접근 방식이 제거할 객체를 넘어 두차적 지시자(예: 반사, 그림자)까지 고려하지 못한 예시.

새로운 논문은 EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing라는 제목으로, 푸단 대학 컴퓨터 과학 및 인공 지능 대학의 4명의 연구자에 의해 작성되었습니다.

방법

하이브리드 VOR 데이터셋은 비디오에서 객체를 제거하려고 시도하는 모든 의미를 다루기 위해 충분히 다양한 시나리오를 포함하도록 설계되었습니다.

VOR 데이터셋의 페어 프레임은 객체 제거가 가시적 주제를 넘어 그 유도된 효과까지 확장되어야 함을 보여줍니다. 예시로는 오CLUSION, 그림자, 조명 시프트, 반사 및 물리적 변형이 표시됩니다. 자세한 예시는 이 글의 끝에 첨부된 비디오에서 참조하십시오.

다섯 가지 대표적인 ‘간섭’ 유형은 저자에 의해 오CLUSION으로 정의되며, 이는 다양한 유형의 글래스 및 스모크 오CLUSION을 포함합니다. 그림자; 조명(예: 제거할 객체가 빛의 경로를 생성하거나 변경할 때); 반사; 및 변형(예: 쿠션上的 사용자 인상, 이는 사용자의 제거 후에도 남아서는 안 됩니다).

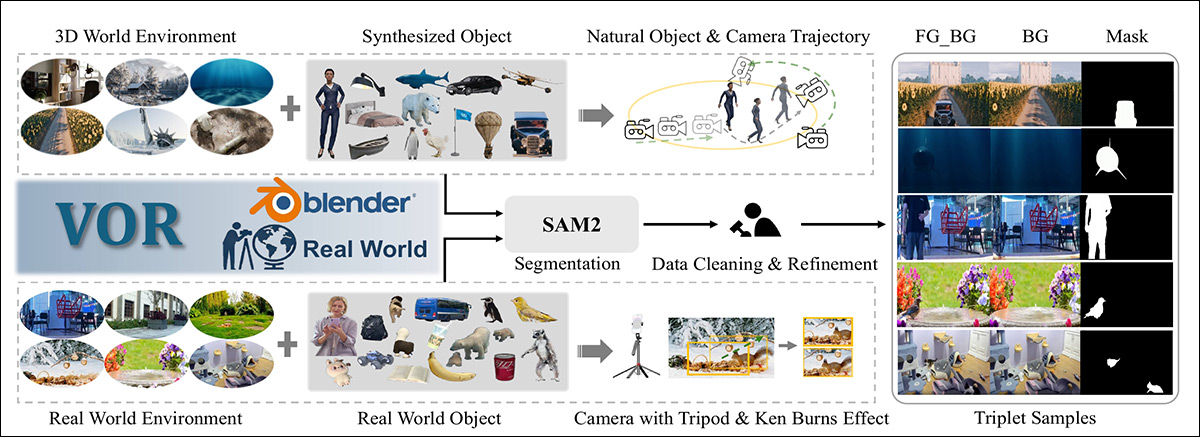

VOR 데이터셋 구축 파이프라인, Blender 생성 합성 장면과 실제 캡처를 결합하여, 합성 데이터는 큐레이션된 3D 환경, 객체 및 카메라 트라제토리에서 구축되고, 실제 영상은 다양한 장면에서 녹화되고 Ken Burns 모션으로 보강됩니다. SAM2 세그멘테이션 및 수동 리파인먼트는 일치된 전경 및 배경 비디오 트리플렛과 일치하는 마스크를 생성합니다.

실제 데이터의 경우, 연구자들은 다양한 환경, 일자 및 날씨 조건을 다루는 ‘있음’ 및 ‘없음’ 장면을 녹화하기 위해 고정 카메라를 사용했습니다.

합성 데이터의 경우, 여러 관점이 렌더링되었으며, 의도적으로 복잡하고 도전적인 유형의 카메라 이동(실제 영상에서 발생할 수 있는 것과 같은)을 특징으로 하는 다중 객체 시나리오가 생성되었습니다. 연구자들은 이 접근 방식이 다른 유사한 Remove Objects with Side Effects in Videos(ROSE) 데이터셋에 사용된 접근 방식보다 더 정교하고 노력적이라고 관찰합니다.

운동 다양성을 증가시키기 위해, Ken Burns 효과가 카메라 캡처된 쌍에 적용되어, 14개의 미리 정의된 규칙에 따라 제어된 팬, 줌 및 약간의 핸드 헬드 이동이 추가되었습니다. 5개의 모션 패턴이 각 쌍당 샘플링되었습니다.

규모와 다양성은 합성 객체와 여러 카메라 설정을 결합하여 확장되었습니다. 마스크는 주요 프레임에 수동 포인트 프롬프트를 배치하여 생성되었으며, Segment Anything 2(SAM2)로 세그멘테이션을 전파하고, 결과를 정리하고, 훈련을 위한 유효한 전경, 배경 및 마스크 트리플렛을 조립했습니다.

최종 컬렉션은 60,000개의 실제 및 합성 비디오 쌍을 포함하는 145시간의 비디오로 구성되며, 366개의 객체 클래스와 443개의 장면을 다룹니다.

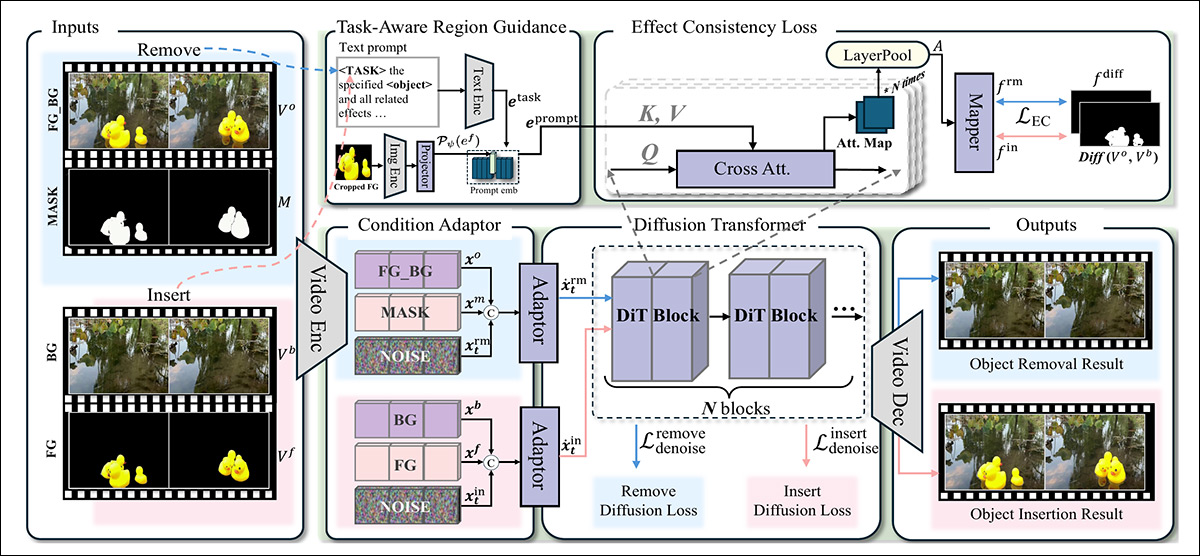

EffectErase 네트워크 자체는 VAE†를 통해 자료를摄入하며, 잠재 노이즈는 Wan2.1에 의해 처리됩니다. 이 백본 위에서 EffectErase는 제거-삽입 공동 학습을 운영하며, 두 작업을 모두 동일한 영역에서 함께 훈련합니다. 작업 인식 지역 가이드(TARG)는 객체 및 작업 토큰과 크로스 어텐션을 사용하여 객체와 그 효과 간의 시공간적 링크를 모델링하고 작업 전환을 허용합니다. 효과 일관성 손실은 제거 및 삽입 작업에서 효과 영역을 일치시킵니다.

EffectErase 프레임워크의 스키마. 훈련 중에 페어 비디오는 공유된 잠재 공간으로 인코딩되며, 노이즈와 함께 융합되고, 작업 인식 크로스 어텐션에 의해 안내되는 확산 트랜스포머로 처리되며, 효과 일관성 손실은 제거 및 삽입 영역을 일치시킵니다.

제거와 삽입 프로세스는 자체적으로 함께 훈련되며, 공유 확산 백본을 사용하므로 모델은 동일한 영향을 받는 영역과 구조적 단서에 집중하도록 학습합니다.

객체, 배경 전용 비디오 및 마스크는 먼저 잠재 공간으로 인코딩되며, 확산 훈련을 위해 노이즈가 추가됩니다. 모델은 작업별 가이드에 따라 깨끗한 표현을 회복하도록 학습합니다. 가벼운 어댑터는 노이즈 특징을 제거 또는 삽입 조건과 함께 융합하여, 두 작업이 모두 giám sát을 공유하면서 제어할 수 있도록 합니다.

작업 인식 지역 가이드는 언어 토큰과 전경 객체에서 추출된 시각적 특징을 결합하여 작업별 신호를 생성합니다. CLIP을 사용하여, 일반적인 객체 토큰을 실제 이미지 내용에서 파생된 임베딩으로 대체합니다. 이 융합된 표현은 크로스 어텐션을 통해 백본에 주입되어, 모델이 객체와 그 시각적 효과가 공간과 시간에서 어떻게 진화하는지 추적하도록 허용합니다.

효과 일관성 손실은 제거와 삽입 프로세스가 동일한 변경된 영역에 집중하도록 강제합니다. 각 가지의 어텐션 맵은 소프트 지역 맵으로 결합되고, 객체 및 배경 비디오에서 계산된 차이 맵과 일치시킵니다. 이는 조명 및 그림자와 같은 미묘한 변경 사항을 보존합니다. 이 추가적인 손실은 삽입이 제거를 안내하고, 두 작업을 일관되게 유지하는 데 도움이 됩니다.

데이터 및 테스트

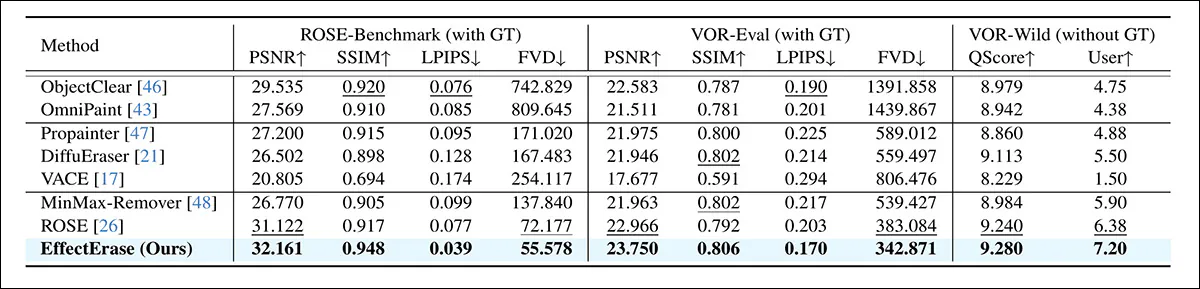

연구자들은 자신의 접근 방식을 다양한 inpainting, 비디오 inpainting 및 객체 제거 방법과 비교했습니다: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; 및 MiniMax-Remover.

Wan2.1은 LoRA††를 사용하여 VOR 데이터셋에서 832x480px의 해상도로 미세 조정되었습니다. 81개의 연속 프레임(이동 평균의 유효한 제한, 그 이상의 경우 오류가 발생하는 경향이 있음)이 훈련을 위해 무작위로 샘플링되었습니다. 훈련은 8개의 H100 GPU에서 129,000번의 반복으로 진행되었으며, 각 GPU에는 80GB의 VRAM이 있습니다. 학습률은 1×102로 설정되었으며, LoRA 랭크는 256으로 설정되었습니다.

ROSE-Benchmark 합성 컬렉션은 외부에서 테스트된 유일한 데이터셋이었습니다. 다른 두 개는 VOR-Eval이었으며, VOR 데이터셋 테스트 분할*이었으며, VOR-Wild는 195개의 실제 비디오로 구성된 테스트 세트였으며, ‘동적 객체’를 특징으로 하는 인터넷에서 스크랩된 비디오를 포함했습니다.

사용된 지표는 피크 신호 대 노이즈 비율(PSNR); 구조적 유사성 지수(SSIM); 학습된 지각적 이미지 패치 유사성(LPIPS); 및 프레シェ 비디오 거리(FVD)였습니다. VOR-Wild의 195개 생성된 비디오에 대한 사용자 연구도 고려되었습니다. 20명의 자원봉사자로부터 평균 평점을 고려했습니다.

추가적으로 저자들은 Qwen-VL 멀티모달 모델을 활용하여 객체 제거된 비디오 출력의 품질을 평가하기 위한 QScore 지표를 고안했습니다. 이는 제거된 환경의 잔여적인 아티팩트 또는 미제거된 환경적 제거(예: 그림자, 조명 효과)를 평가합니다.

ROSE 및 VOR 벤치마크에 대한 양적 비교, 최선과 차선의 결과가 굵은 글씨와 밑줄로 표시됨.

이러한 결과에 대해 저자들은 다음과 같이 말합니다:

‘이미지 inpainting 방법은 개별 프레임에서 2D 모델을 사용하여 작동하며, 따라서 비디오에서 시간적 일관성을 유지하지 못합니다.

최근의 비디오 inpainting 방법은 객체의 부수적 효과를 명시적으로 모델링하지 않아, 비자연스러운 제거 결과를 초래합니다. 기존의 비디오 객체 제거 방법은 객체와 그 부수적 효과 사이의 시공간적 상관관계 모델링이 부족하여, 종종 아티팩트와 제거된 객체의 잔여 흔적을 생성합니다.

‘전반적으로 EffectErase는 모든 데이터셋과 평가 지표에서 최첨단 성능을 달성합니다. 비디오 품질 지표인 FVD에서 최고의 점수를 얻으며, 생성된 비디오의 시간적 매끄러움과 일관성을 보여줍니다.

‘我们的 방법은 또한 최고의 QScore와 사용자 피드백 평점을 달성하여, 시각적으로 설득력 있는 제거 결과를 생성하는 데 효과적임을 추가로 보여줍니다.’

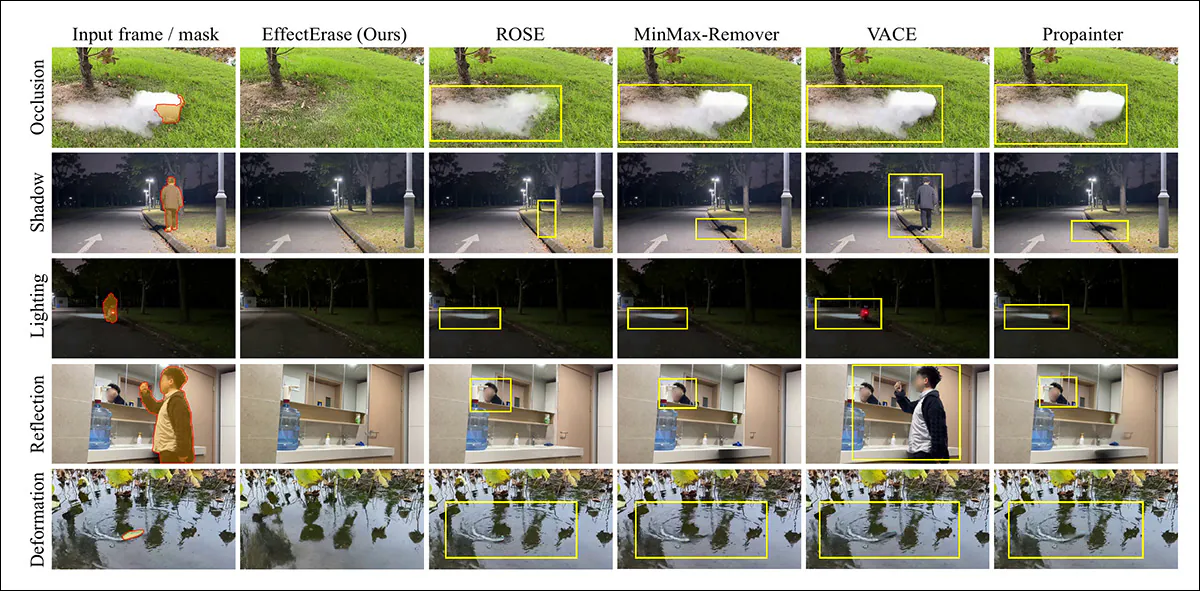

질적 평가를 위해 논문에는 정적 결과가 직접 표시되며, 동적 결과는 프로젝트 사이트와 첨부된 YouTube 비디오에서 사용할 수 있습니다.

VOR-Eval에 대한 질적 비교, 오CLUSION, 그림자, 조명, 반사 및 변형 사례를 다룹니다. Inpainting 방법은 마스크 외부의 효과를 제거하는 데 어려움을 겪으며, 제거 모델은 종종 가시적 아티팩트를 남깁니다. EffectErase는 대상 객체와 그 관련 효과를 더 깨끗이 제거합니다. 더 나은 해상도와 비디오 예시는 원본 논문과 프로젝트 사이트에서 참조하십시오.

저자들은 다음과 같이 말합니다:

‘비디오 inpainting 방법은 마스크된 영역에서 아티팩트를 생성하며, 제거된 객체의 부수적 효과를 완전히 제거하지 못합니다. 이전의 객체 제거 접근 방식, 예를 들어 [ROSE]와 [MinMax-Remover],는 대상 객체를 제거하는 데 잘 작동하지만, 특히 오CLUSION, 그림자, 조명, 반사 및 변형 시나리오에서 부수적 효과에 어려움을 겪습니다.

‘반면, EffectErase는 대상 객체와 그 관련 효과를 모두 효과적으로 제거하여, 깨끗하고 일관된 결과를 생성합니다.’

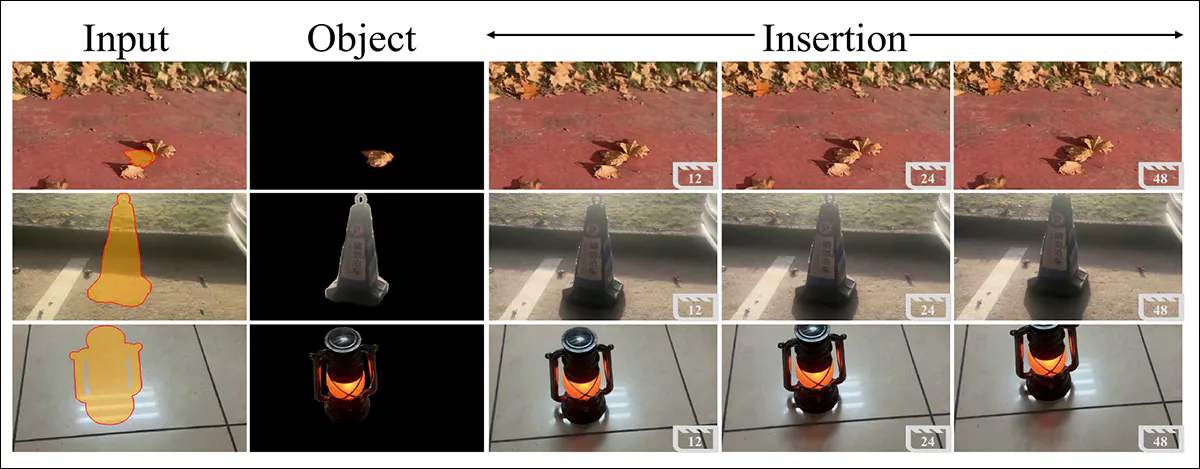

마지막으로, 연구자들은 자신의 방법이 추가 훈련 없이 삽입 작업으로도 적응할 수 있다고 관찰합니다.

비디오 객체 삽입 결과. EffectErase는 객체를 삽입하면서 배경 내용을 보존하고, 그림자 및 반사와 같은 객체 유도된 효과를 일관되게 생성합니다.

삽입 작업에 대한 비디오 결과는 (시간 지정) YouTube 비디오 예시에서 확인할 수 있습니다(또한 이 글의 끝에 시간 지정 없이 첨부됨).

결론

문헌을 통해 유사한 프로젝트를 살펴보면, 많은 프로젝트가 궁극적으로 이러한 기능을 일반적인 ‘도구킷’ 모델에 통합하여 다양한 효과를 위한 범용 VFX 모델이 되기를 희망하고 있음을 알 수 있습니다.

그러나 ‘잭 오브 올 트레이드’ 원칙에 따라, 전용 시스템인 EffectErase가 일반적인 접근 방식보다 우위를 점할 것으로 보입니다. 그러나 차이가 결국 너무 좁아져서 별도의 모델을 훈련하는 추가 노력이 가치가 없을 수 있습니다.

* IP 출처 문제에 대한 증가하는 우려와 함께, 이러한 모든 출처가 인용될 것으로 기대되지만, 새로운 연구에서 3D 모델의 출처를 나열했는지 확인할 수 없었습니다.

† 제공된 참조는 2013년의 일반 설명 텍스트입니다. 특정 VAE는 자세히 설명되지 않습니다.

†† 이 설명은 논문에서 가져온 것으로, 의미상으로 불분명합니다. 미세 조정과 LoRA는 매우 다른 프로세스이며 서로 다른 요구 사항이 있습니다.