Anderson의 관점

실제 비디오에 대화 추가하기

새로운 AI 프레임워크는 재 촬영 없이 비디오에서 한 사람의 단어를 다시 작성, 제거 또는 추가할 수 있는 단일 종단 간 시스템입니다.

3 년 전, 인터넷은 학술 포털에 매주 게시되는 20-30 개의 AI 비디오 변경 프레임워크 중 하나에 놀랐을 것입니다. 현재는이 인기 있는 연구 스트랜드가 거의 ‘AI 슬롭’의 또 다른 가지로 발전하여 이제는 거의 매주 게시되는 연구의 일부가 되었습니다. 그리고 나는 2-3 년 전보다 훨씬 적은这样的 릴리즈를 다루고 있습니다.

그러나 현재 릴리즈 중 하나가私の 눈에 띄었습니다. 실제 비디오 클립에 간섭하여 기존 비디오에 새로운 대화를 삽입할 수 있는 통합 시스템입니다 (얼굴이나 프레임에서 전체 생성 클립을 생성하는 것보다 훨씬 더 일반적입니다).

아래 예제에서, 릴리즈의 프로젝트 웹사이트에 있는 여러 샘플 비디오에서 편집한 내용을 볼 수 있습니다. 실제 소스 클립을 먼저看到하고, 그 아래에는 클립 중간에 강제로 삽입된 AI 대화가 있습니다. 음성 합성 및 입 동기화를 포함하여:

재생을 클릭하세요. 스치칭을 가진 로컬 편집 – FacEDiT에서 제공되는 여러 모달리티 중 하나입니다. 더 나은 해상도를 위해 원본 웹사이트를 참조하십시오. 소스 – https://facedit.github.io/

이 접근 방식은 새로운 방법으로 개발된 세 가지 중 하나입니다. 이것은 ‘스치칭을 가진 로컬 편집’이라고 불리며, 저자뿐만 아니라 저자도 가장 관심 있는 것입니다. 본질적으로 클립은 중간 프레임을 시작점으로 사용하여 새로운 AI 해석을 생성하고, 다음 실제 프레임을 목표로 설정하여 생성된 클립이 일치하도록 합니다. 위의 클립에서 이러한 ‘시드’ 및 ‘타겟’ 프레임은 상단 비디오의 일시 중지를 나타내고, 수정된 비디오는 생성된 내용을 제공합니다.

저자들은 얼굴 및 음성 합성 접근 방식을 이와 같은 종류의 AI 비디오 편집을 위한 최초의 완전히 통합된 종단 간 방법으로 프레임화하며, 완전히 개발된 이러한 프레임워크의 잠재력을 TV 및 영화 제작에 대해 관찰합니다:

‘영화 制作자 및 미디어 제작자는 종종 기록된 비디오의 특정 부분을 수정해야 합니다. 예를 들어, Titanic (1997)에서 로즈가 말하는 장면에서, “나는 절대 放弃하지 않을 것이다, 잭,” 감독은 나중에 그것이 “나는 절대 忘れない, 잭”이라고 결정할 수 있습니다.

‘전통적으로 이러한 변경 사항은 전체 장면을 다시 촬영해야 합니다. 이는 비용이 많이 들고 시간이 많이 걸리는 일입니다. 대화 얼굴 합성은 수정된 대화에 맞게 얼굴 동작을 자동으로 수정하여 재 촬영의 필요성을 제거하는 실용적인 대안을 제공합니다.’

이러한 종류의 AI 개입은 문화적 또는 산업적 저항에 직면할 수 있지만, 인간 주도 VFX 시스템 및 툴 스위트에서 새로운 유형의 기능을 구성할 수 있습니다. 어쨌든, 현재는 기술적인 도전만이 남아 있습니다.

클립을 확장하는 추가 AI 생성 대화 외에 새로운 시스템은 기존 음성을 변경할 수도 있습니다:

재생을 클릭하세요. 기존 대화의 일부를 변경하는 예입니다. 원본 웹사이트에서 더 나은 해상도를 참조하십시오.

최근 기술 동향

현재 이와 같은 합성 기능을 제공하는 종단 간 시스템은 없습니다. Google의 Veo 시리즈를 포함한 다양한 생성 AI 플랫폼은 오디오를 생성할 수 있으며, 다양한 다른 프레임워크는 딥페이크 오디오를 생성할 수 있지만, 현재는 이러한 프레임워크와 다양한 아키텍처 및 트릭의 복잡한 파이프라인을 생성하여 실제 영상을 이런 식으로 수정해야 합니다. – titled FacEDiT – 할 수 있습니다.

시스템은 확산 트랜스포머 (DiT)를 플로우 매칭과 결합하여 주변 (맥락) 동작 및 음성 오디오 콘텐츠에 조건부로 얼굴 동작을 생성합니다. 시스템은 얼굴 재구성을 처리하는 기존 인기 패키지, 즉 LivePortrait (最近에 Kling에 의해 인수됨)를 활용합니다.

이 방법 외에도 저자들은 이러한 도전을 단일 솔루션으로 통합한 최초의 접근 방식이므로, FacEDiTBench라는 새로운 벤치마크를 만들었으며, 이 작업에 매우 특정한 작업에 적합한 여러 새로운 평가 지표를 만들었습니다.

새로운 연구는 FacEDiT: 유니파이드 토킹 페이스 편집 및 생성을 통한 얼굴 동작 채우기라고 제목이 붙여졌으며, 한국의 포항 과학 기술 연구소 (POSTECH), 한국 고등 과학 기술 연구소 (KAIST), 및 텍사스 오스틴 대학교의 4 명의 연구자로부터 나왔습니다.

방법

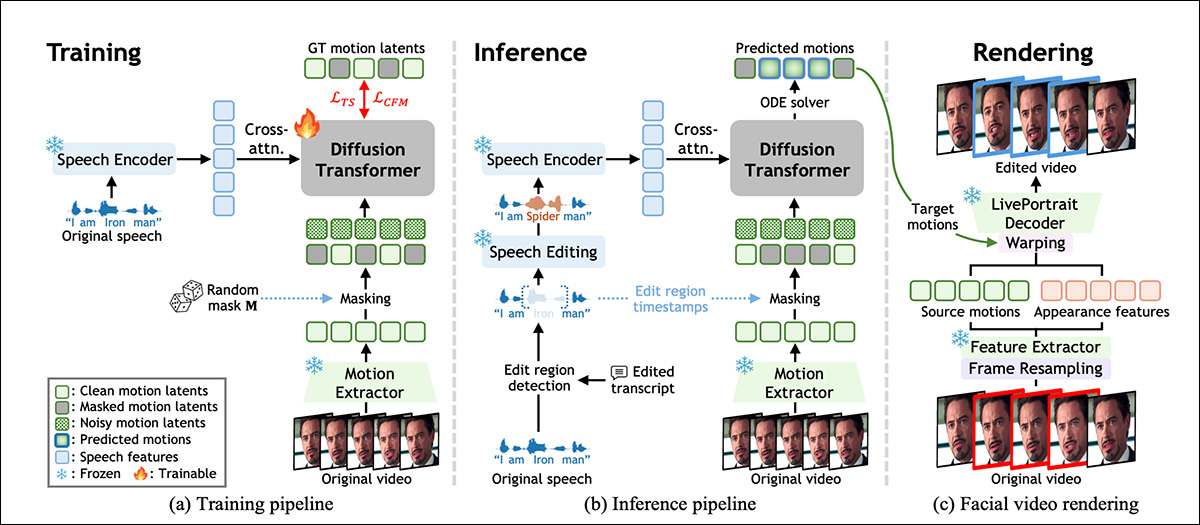

FacEDiT는 주변 동작과 음성 오디오를 학습하여 배우자의 원래 공연의 누락된 부분을 재구성함으로써 얼굴 동작을 재구성하도록 훈련됩니다. 아래의 스키마에서 볼 수 있듯이, 이 프로세스는 모델이 훈련 중에 갭 필러로 작동하도록 허용하여 음성과 일치하는 얼굴 동작을 예측하면서 원래 비디오와 일관성을 유지합니다:

FacEDiT 시스템의 개요, 얼굴 동작이 자체 감독된 채우기를 통해 학습되고, 추론 시 수정된 음성으로 안내되고, 최종적으로 원본 영상을 다시 렌더링하여 외모를 재사용하고 대상 동작만 교체합니다. 소스

추론 시간에, 동일한 아키텍처는 마스크된 비디오의 양에 따라 두 가지 다른 출력을 지원합니다. 부분 편집에서는 단어 또는 구가 변경되고 나머지는 수정되지 않습니다. 또는 전체 문장 생성에서 새로운 동작이 스크래치에서 완전히 생성됩니다.

모델은 플로우 매칭을 통해 훈련되며, 이는 비디오 편집을 두 가지 얼굴 동작 버전 사이의 경로로 간주합니다.

새로운 얼굴을 처음부터猜测하는 대신, 플로우 매칭은 노이즈 플레이스 홀더와 올바른 동작 사이를 점진적으로 및 부드럽게 이동하는 방법을 학습합니다. 이를 위해 시스템은 각 프레임에서 entangling을 하지 않고, 표현 및 헤드 포즈를 설명하는 컴팩트한 숫자 집합을 사용하여 얼굴 동작을 나타냅니다. 이는 음성 변경이 사람의 전체적인 외모에 영향을 미치지 않고 지역화될 수 있도록 설계되었습니다.

FacEDiT 훈련

FacEDiT를 훈련하기 위해, 각 비디오 클립은 일련의 얼굴 동작 스냅샷으로 분할되었으며, 각 프레임은 해당 오디오 청크와 쌍으로 묶입니다. 무작위로 동작 데이터의 일부가 숨겨지고, 모델은 음성과 주변에 숨겨지지 않은 동작을 사용하여 누락된 동작이 어떻게 보일지猜测하도록 요청받습니다.

마스킹된 범위와 해당 위치가 훈련 예제마다 다르기 때문에, 모델은渐渐적으로 내부 편집 및 전체 시퀀스 생성을 모두 처리하는 방법을 학습합니다.

시스템의 앞서 언급한 확산 트랜스포머는 음성과 동작을 한 번에 모두 모델에 공급하는 대신, 각 처리 블록을 통해 크로스 어텐션을 통해 오디오를 스레딩하여 시스템이 입 동작을 더 정확하게 오디오 음성과 일치시키도록 도와줍니다.

편집된 영역의 가장자리에서 깜박이거나 동작 점프를 방지하기 위해, 주변 프레임에 대한 어텐션이 바이어스되어 전체 타임라인이 아닌 로컬 연속성을 강조합니다. 위치 임베딩 (모델이 각 프레임이 시퀀스에서 나타나는 위치를 알려줌)은 모델이 자연스러운 시간 흐름과 컨텍스트를 유지하도록 도와줍니다.

훈련 중, 시스템은 음성과 근처에 숨겨지지 않은 동작을 기반으로 마스킹된 범위를 재구성하여 누락된 얼굴 동작을 예측하는 방법을 학습합니다. 추론 시간에, 동일한 설정이 재사용되지만, 마스크는 이제 편집된 음성으로 안내됩니다.

단어가 삽입되거나, 삭제되거나, 변경되면, 시스템은 영향을받는 영역을 찾고, 마스크를 생성하고, 새로운 오디오와 일치하는 동작을 생성합니다. 전체 시퀀스 생성은 특수한 경우로 처리되며, 여기서 전체 영역이 마스킹되고 스크래치에서 합성됩니다.

데이터 및 테스트

시스템의 백본은 Diffusion Transformer에 22 개의 레이어로 구성되며, 각 레이어에는 16 개의 어텐션 헤드와 피드 포워드 차원이 1024 및 2024px입니다. 동작 및 외모 특징은 프리즌된 LivePortrait 구성 요소를 사용하여 추출되며, 음성은 WavLM을 통해 인코딩되고 VoiceCraft를 사용하여 수정됩니다.

전용 프로젝션 레이어는 786 차원 음성 특징을 DiT의 잠재 공간으로 매핑하며, 오직 DiT 및 프로젝션 모듈만 스크래치에서 훈련됩니다.

훈련은 AdamW 옵티마이저를 사용하여 목표 학습률 1e-4에서 수행되었으며, 1 백만 단계에서 2 개의 A6000 GPU (각각 48GB의 VRAM)에서 총 배치 크기 8로 수행되었습니다.

FacEDiTBench

FacEDiTBench 데이터 세트에는 250 개의 예제가 포함되어 있으며, 각 예제에는 원본 및 편집된 음성의 비디오 클립과 두 가지 전사본이 포함되어 있습니다. 비디오는 3 개의 소스에서 나왔으며, 100 개의 클립은 HDTF에서, 100 개의 클립은 Hallo3에서, 50 개의 클립은 CelebV-Dub에서 나왔습니다. 각 예제는 모두 오디오와 비디오가 평가를 위해 충분히 명확한지 확인하기 위해 수동으로 확인되었습니다.

GPT-4o는 각 전사본을 수정하여 문법적으로 유효한 편집을 생성하기 위해 사용되었습니다. 이러한 수정된 전사본과 원래 음성은 모두 VoiceCraft에 전달되어 새로운 오디오를 생성했습니다. 각 단계에서 전사본과 생성된 음성은 모두 품질을 위해 수동으로 검토되었습니다.

각 샘플은 편집 유형, 변경의 타이밍 및 수정된 범위의 길이로 레이블이 지정되었습니다. 편집은 삽입, 삭제, 또는 대체로 분류되었습니다. 변경된 단어의 수는 1 ~ 3 단어의 짧은 편집, 4 ~ 6 단어의 중간 편집 및 7 ~ 10 단어의 더 긴 편집으로 범위가 다양했습니다.

편집 품질을 평가하기 위해 3 가지 사용자 정의 지표가 정의되었습니다. 광학적 연속성, 편집된 세그먼트가 주변 비디오와 잘 블렌딩되는지 측정하기 위해 픽셀 수준의 차이를 비교함으로써; 동작 연속성, 편집된 프레임과 수정되지 않은 프레임에서 광학적 흐름의 변경을 평가하여 얼굴 동작의 일관성을 평가합니다. 그리고 아이덴티티 보존, 편집 후에도 주체의 외모가 일관성을 유지하는지 추정하기 위해 원래 및 생성된 시퀀스에서 얼굴 임베딩을 비교하여 ArcFace 얼굴 인식 모델을 사용합니다.

테스트

테스트 모델은 약 200 시간의 비디오 콘텐츠로 훈련되었습니다. 이는 vlog 및 영화를 포함하여 다양한 소스에서 나왔습니다. 또한 높은 해상도의 YouTube 비디오도 포함되었습니다.

대화 얼굴 편집을 평가하기 위해 FacEDiTBench 외에도 HDTF 테스트 분할이 사용되었습니다. 이는 이러한 작업 세트에 대한 벤치마크 표준이 되었습니다.

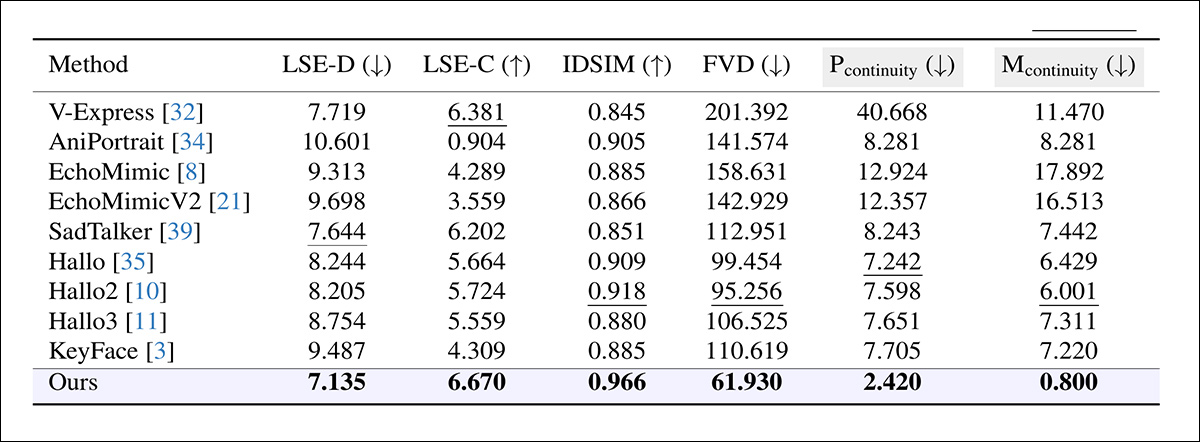

이와 같은 종단 간 기능성을 캡슐화할 수 있는 직접 비교 가능한 시스템이 없기 때문에, 저자들은 최소한 일부 타겟 기능성을 재현할 수 있는 다양한 프레임워크를 선택했습니다. 즉, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; 및 SadTalker.

또한 생성 및 편집 품질을 평가하기 위해 여러 확립된 지표가 사용되었습니다. 입 동기화 정확도는 SyncNet을 통해 평가되었습니다. 여기에는 입 동작과 오디오 사이의 절대 오차 (LSE-D) 및 신뢰도 점수 (LSE-C)가 포함되었습니다; Fréchet Video Distance (FVD)가 전체 비디오의 현실성을 정량화했습니다. 그리고 Learned Perceptual Similarity Metrics (LPIPS)가 생성된 프레임과 원래 프레임 사이의 지각적 유사성을 측정했습니다.

편집의 경우, LPIPS를 제외한 모든 지표는 수정된 세그먼트에만 적용되었습니다. 생성의 경우, 전체 비디오가 평가되었으며, 경계 연속성은 제외되었습니다.

각 모델은 일치하는 비디오 세그먼트를 합성하도록 요청받았습니다. 그런 다음 이 세그먼트는 원래 클립에 스플라이싱되었습니다 (연구자들은 이 방법이 종종 편집된 섹션과 주변 푸터에서 가시적인 불連續性를 도입한다고 주목합니다). 또 다른 접근 방식도 테스트되었습니다. 여기서 전체 비디오가 수정된 오디오에서 재생성되었습니다. 그러나 이것은 필연적으로 수정되지 않은 영역을 덮어쓰고 원래 성능을 유지하지 못했습니다:

대화 얼굴 생성을 위해 설계된 시스템 간의 편집 성능 비교, FacEDiT는 모든 기준에서 기준을 초과하고, 더 낮은 입 동기화 오류 (LSE-D), 더 높은 동기화 신뢰도 (LSE-C), 더 강한 아이덴티티 보존 (IDSIM), 더 큰 지각적 현실성 (FVD) 및 편집 경계에서 더 부드러운 전환 (Pcontinuity, Mcontinuity)을 달성합니다. 회색 음영된 열은 경계 품질을 평가하기 위한 주요 기준을 강조합니다. 볼드체 및 밑줄 친 값은 최고 및 차등 결과를 나타냅니다.

이러한 결과에 대해 저자들은 다음과 같이 말합니다:

‘[우리의] 모델은 기존 방법을 크게 초과합니다. 강한 경계 연속성과 높은 아이덴티티 보존을 달성하여 편집 중에 시간적 및 시각적 일관성을 유지하는 능력을 보여줍니다. 또한, 더 높은 입 동기화 정확도와 더 낮은 FVD는 합성된 비디오의 현실성을 반영합니다.’

재생을 클릭하세요. 결과, 원본 프로젝트 사이트의 게시된 비디오에서 편집한 것입니다. 더 나은 해상도를 위해 원본 웹사이트를 참조하십시오.

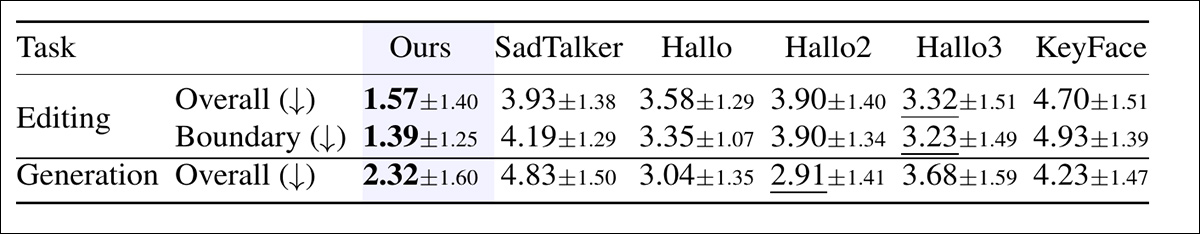

さらに, 편집 및 생성의 지각된 품질을 평가하기 위해 인간 연구가 수행되었습니다.

각 비교에서, 참가자들은 6 개의 비디오를 보고 전체 품질에 따라 순위를 매겼습니다. 입 동기화 정확도, 자연성 및 머리 동작의 현실성을 고려했습니다. 편집 테스트에서 참가자들은 또한 편집된 세그먼트와 수정되지 않은 세그먼트 사이의 전환의 부드러움을 평가했습니다:

인간 평가자가 할당한 평균 순위, 더 낮은 순위가 더 좋습니다. 편집 및 생성 모두에서 참가자들은 각 비디오가 얼마나 자연스럽고 잘 동기화되어 보이는지 판단했습니다. 편집의 경우, 편집된 음성과 수정되지 않은 음성 사이의 전환의 부드러움도 평가했습니다.

연구에서 FacEDiT는 편집 품질과 전환 무결성 모두에서 명백한 리드를 보이며 1 위를 차지했습니다. 또한 생성 설정에서 강한 점수를 받았습니다. 이는 측정된 장점이 지각된 출력으로 번역됨을 시사합니다.

공간이 부족하여, 추가 테스트 및 연구에서 수행된 추가 연구에 대한 자세한 내용은 원본 논문에서 참조하십시오. 실제로, 이러한 유형의 원형 연구 제안은 테스트 결과 섹션을 생성하는 데 어려움을 겪을 수 있습니다. 왜냐하면 핵심 제안 자체가 나중에 작업을 위한 잠재적인 기준이 될 수 있기 때문입니다.

결론

추론에 대해서도, 이러한 시스템은 추론 시간에 상당한 컴퓨팅 리소스가 필요할 수 있으므로, 다운스트림 사용자 (여기서는 VFX 상점)가 작업을 현지에서 유지하는 것이 어려울 수 있습니다. 따라서 현실적인 로컬 리소스에 적응할 수 있는 접근 방식은 제공업체에서 항상 선호됩니다. 제공업체는 클라이언트의 푸터와 일반 지적 재산을 보호할 의무가 있기 때문입니다.

그러나 새로운 제안을 비판하는 것이 아닙니다. 이는 최초의 종단 간 접근 방식이므로, 이는 매우 잘 작동할 수 있으며, 이는 꽤 오랜 시간 동안 이러한 연구 방향으로 나를 다시 끌어들이는 첫 번째 제안입니다.

최초로 2022년 12월 17일 수요일에 게시되었습니다. 같은 날 20:10 EET에 편집되었습니다. 본문 첫 번째 단락에 추가 공간을 위해.