Anderson의 관점

Vibe Coding Suffers When AI’s Role Expands

A new study finds vibe coding improves when humans give the instructions, but declines when AI does, with the best hybrid setup keeping humans foremost, with AI as an arbiter or judge.

뉴 연구에서 미국의 연구진은 AI 시스템이 vibe coding을 제어할 때, 즉 인간의 지시를 받는 것이 아니라 스스로 방향을 설정할 때 발생하는 현상을 조사하였다. 이 연구에서는 Large Language Models (LLMs)이 더 큰 방향 역할을 맡을 때 결과가 거의 항상 나빠진다는 것을 발견하였다.

연구진은 OpenAI의 GPT-5를 인간-인공지능 협업 실험의 프레임워크로 사용하였으며, 나중에 Anthropic의 Claude Opus 4.5와 Google Gemini 3 Pro도 책임이 증가함에 따라 동일한 성능 저하 곡선을 보인다는 것을 확인하였다. 연구진은 ‘제한된 인간 참여는 지속적으로 성능을 개선한다’고 말하였다.

‘인간은 반복적인 과정을 통해 고유하게 효과적인 고수준 지침을 제공한다. 반면에, AI 지침은 성능 붕괴를 일으킬 수 있다. 또한, 인간이 방향을 설정하는 동안 평가를 AI에 위임하는 신중한 역할 할당은 하이브리드 성능을 개선할 수 있다.’

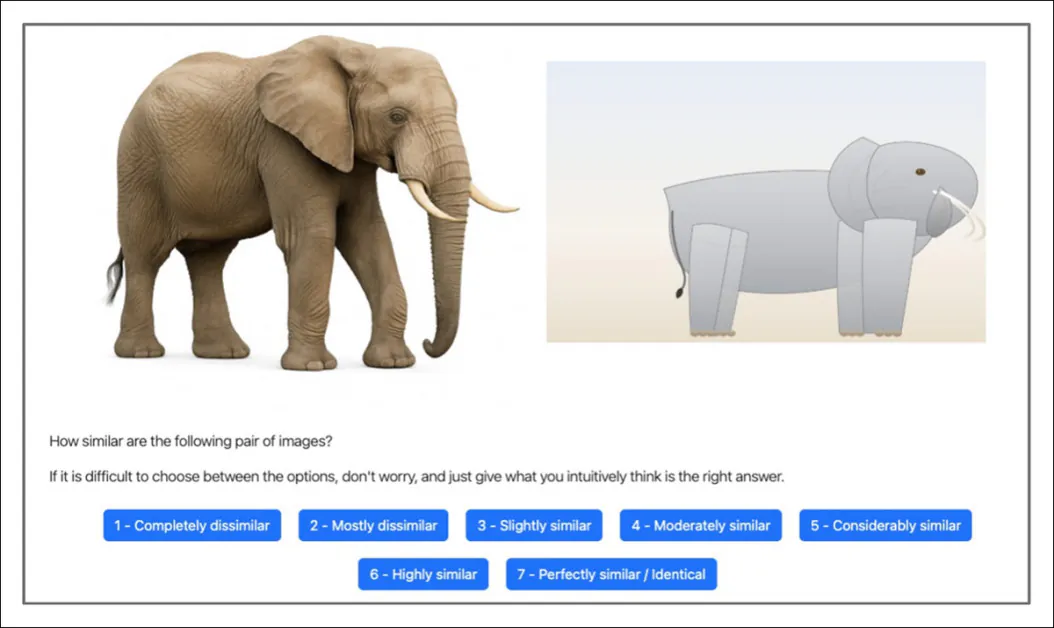

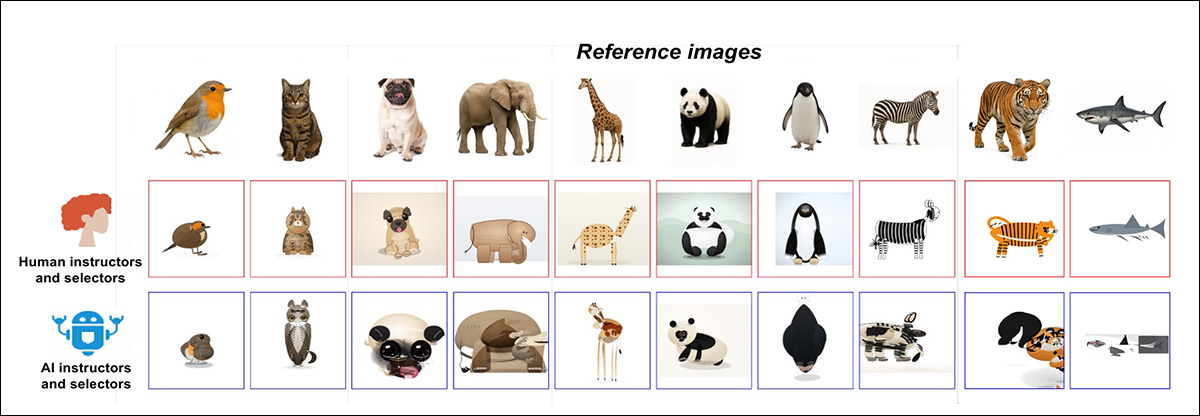

일관된 테스트를 제공하기 위해, 인간과 AI 모두가 평等하게 평가할 수 있는 제어된 실험 프레임워크가 구축되었다. 이 프레임워크는 반복적인 코딩 작업을 중심으로 하여, 참조 이미지(고양이, 개, 호랑이, 새, 코끼리, 펭귄, 상어, 얼룩말, 기린, 판다의 사진)를 스케일러블 벡터 그래픽스(SVG)를 사용하여 재생성하고, 재생성된 이미지를 원본 이미지와 비교하여 평가하는 작업이었다.

인간과 AI 참가자 모두 참조 이미지와 함께 AI 생성 SVG 재구성을 표시하고, 두 이미지가 얼마나 유사한지 7점 척도에서 평가하도록 요청받았다. 출처

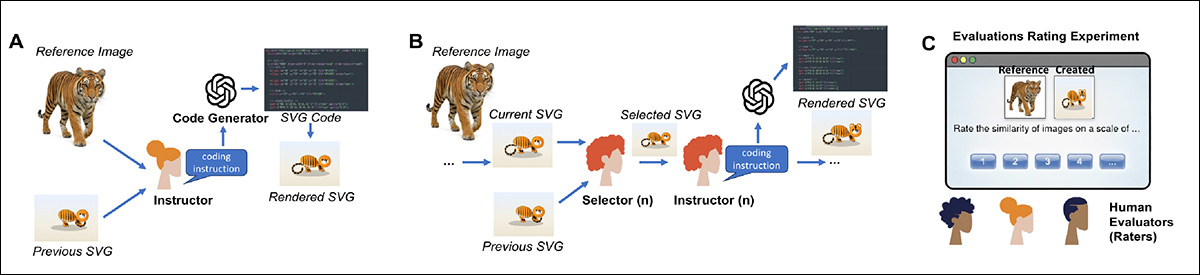

각 라운드에서, 한 에이전트는 코드 생성기를 안내하는 고수준 자연어 지침을 제공하고, 다른 에이전트는 새 버전을 유지하거나 이전 버전으로 돌아갈지 결정하였다. 이는 실제 협업 워크플로를 반영하는 구조화된 루프였다.

16개의 실험에서, 604명의 참가자와 수천 개의 API 호출이涉及되었다. 완전히 인간 주도 테스트 라운드는 완전히 AI 주도 라운드와 비교되었다.

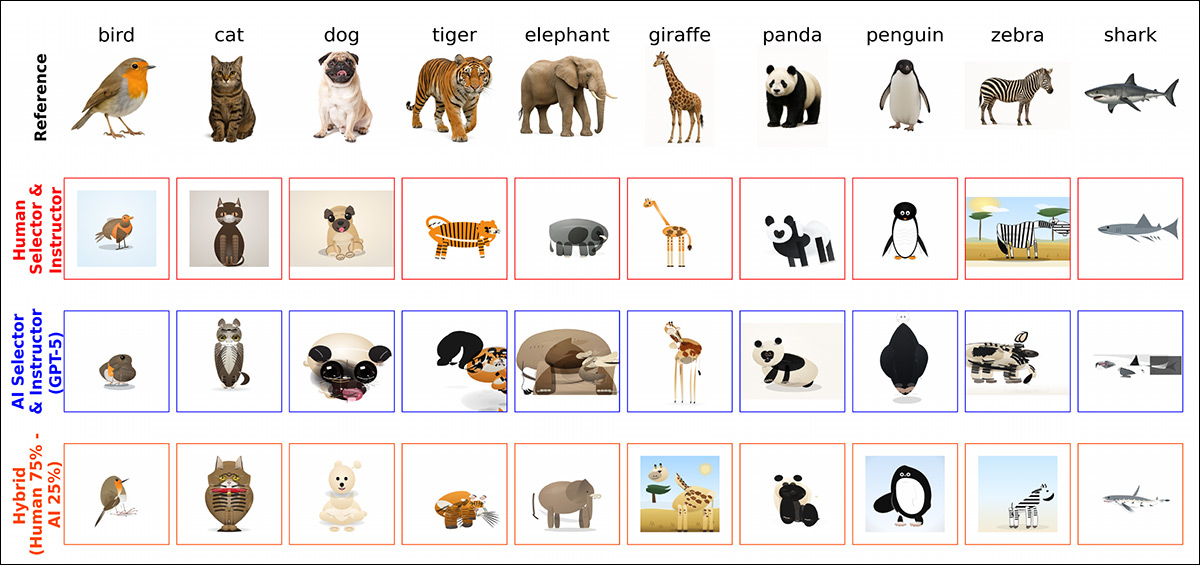

다양한 인간-인공지능 협업 百分比와 유형에 따른 해결책(원본 논문에 포함된 더 큰 일러스트레이션에서 가져옴)

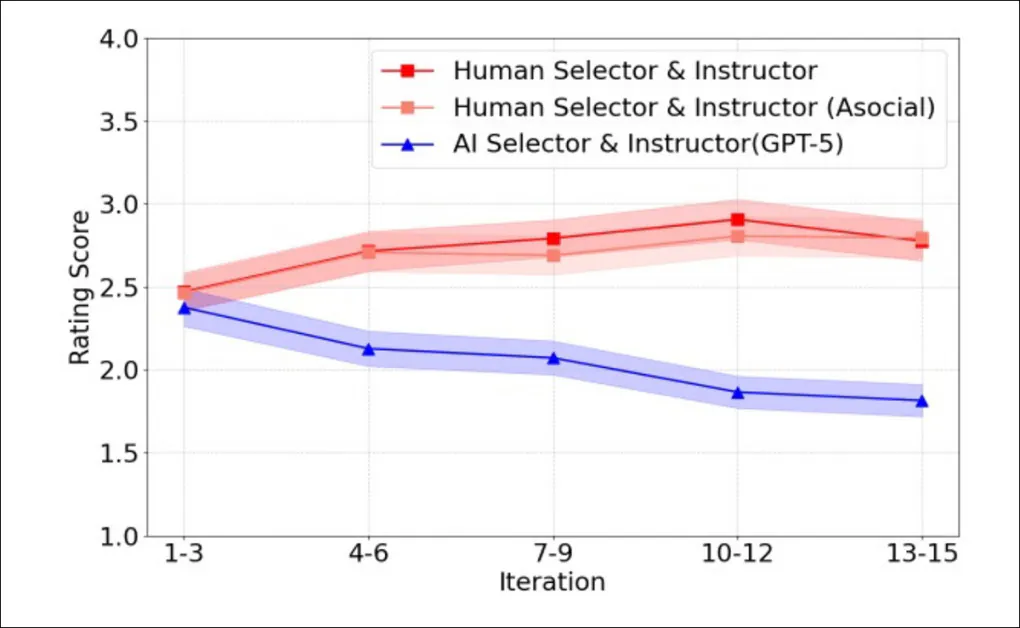

인간과 AI가 수행한 작업은 기준선 시작에서 유사한 수준이었지만, 시간이 지남에 따라 그 궤적은 달라졌다. 인간이 지시를 제공하고 선택 quyết정을 내렸을 때, 유사성 점수는 반복적인 과정을 통해 증가하였다. 그러나 AI 시스템이 두 역할을 모두 수행했을 때, 성능은 일관된 개선 없이 자주 저하되었다.

The Prolixity Effect

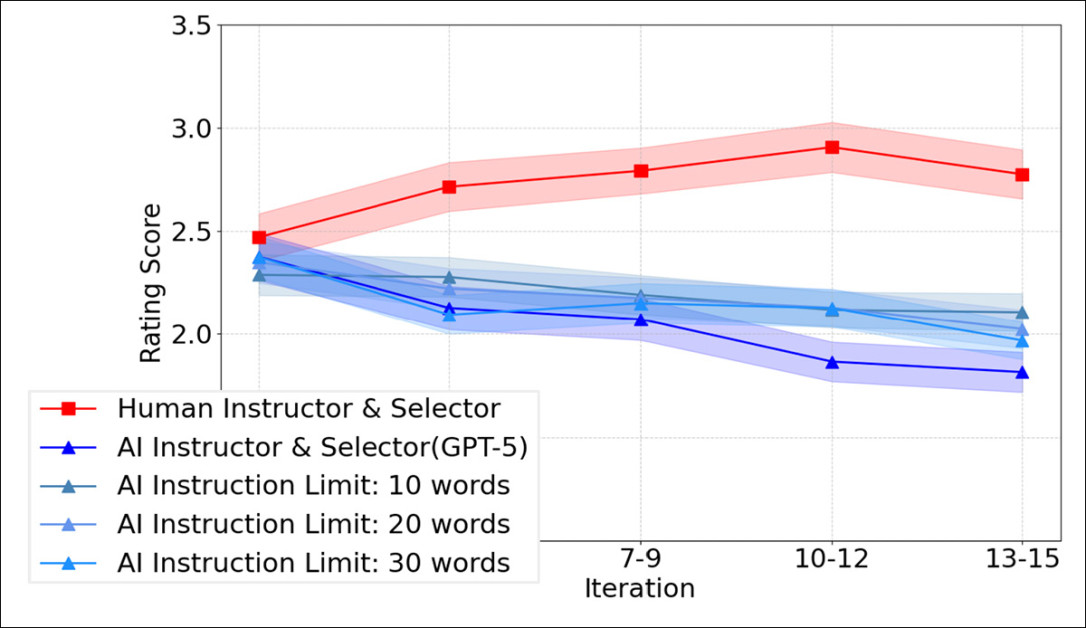

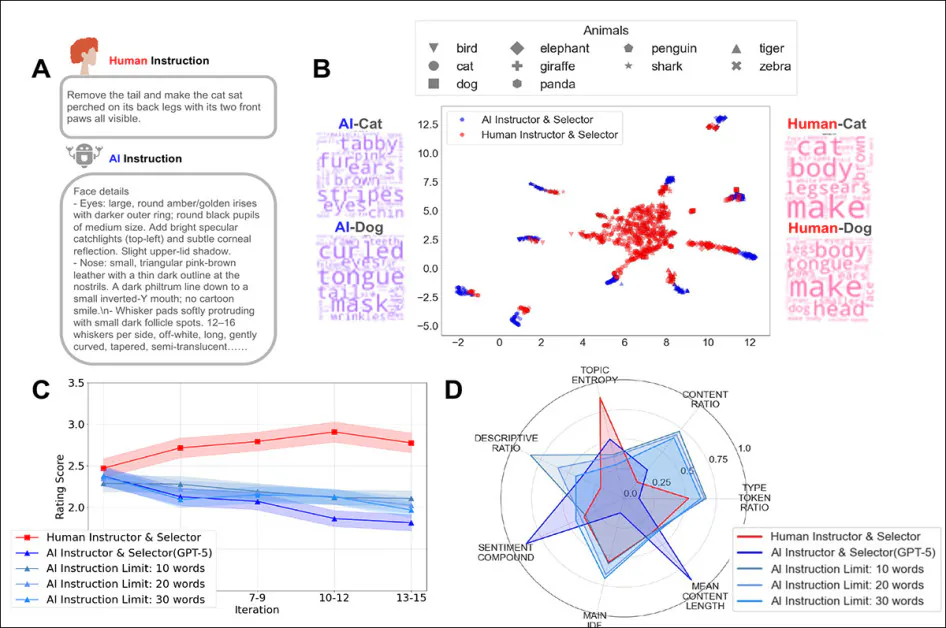

결과는 또한 인간의 지침이 일반적으로 짧고 행동 지향적이며, 현재 이미지에서 다음에 변경할 내용에 초점을 맞추고 있는 반면, AI 지침은 훨씬 길고 시각적 속성을 자세히 설명하는 것으로 나타났다(이 요인은 GPT-5에서 매개변수화되었다).

그러나, 그래프 아래에서 볼 수 있듯이, AI 지침에 엄격한 단어 제한을 부과하는 것은 패턴을 반전시키지 않았다. 10, 20 또는 30 단어로 제한된 AI 주도 체인은 여전히 시간이 지남에 따라 개선되지 않았다.

인간 주도 체인과 완전히 AI 주도 체인 및 10, 20 또는 30 단어로 제한된 AI 주도 체인의 반복적인 유사성 평가. 명확히, AI 프롬프트를 짧게 하는 것은 AI가 지시와 선택을 모두 처리할 때 관찰되는 성능 저하를 방지하지 않는다.

하이브리드 실험은 패턴을 더 명확하게 보여주었으며, 약간의 인간 참여를 추가하는 것이 완전히 AI 주도 설정보다 결과를 개선한다는 것을 보여주었다. 그러나 AI 지침의 비중이 증가할수록 성능은 일반적으로 저하되었다.

역할을 분리했을 때, 평가와 선택은 상대적으로 적은 품질 손실로 AI에 위임할 수 있었다. 그러나 인간의 고수준 지침을 AI 지침으로 대체하는 것은 성능의 명백한 저하를 초래하였다. 이는 코드를 생성하는 것이 아니라, 반복적인 과정을 통해 방향을 설정하고 유지하는 것이 가장 중요함을 시사한다.

연구진은 다음과 같이 결론을 내렸다.

‘다중 실험에서, 인간 주도 코딩은 반복적인 과정을 통해 일관적으로 개선되었지만, AI 주도 코딩은 동일한 정보와 유사한 실행 능력에도 불구하고 종종 붕괴되었다. ‘

‘이것은 오늘날의 AI 시스템이 성공적인 바이브 코딩에 필요한 반복적인 상호작용에서 일관된 고수준 방향을 유지하는 데 어려움을 겪고 있음을 시사한다.’

新的 논문은 Why Human Guidance Matters in Collaborative Vibe Coding이라는 제목으로, 코넬 대학교, 프린스턴 대학교, 매사추세츠 공과대학교, 뉴욕 대학교의 7명의 연구진이 참여하였다.

Method

실험을 위해, 인간 교사 하나가 GPT-5 생성 동물 참조 사진과 최신 관련 SVG 모방 시도를 함께 보았다. 그러면 코드 생성기를 더 가까운 일치로 안내하는 자연어 지침을 작성하였다.

생성기는 각 라운드에서 새로운 SVG를 생성하여 시간이 지남에 따라 효과가 누적되는 반복적인 루프를 제공하였다. 대상은 GPT-5 생성 동물 이미지 10개로, 다양한 모양과 질감을 커버하여 개선 또는 오류가 쉽게 감지될 수 있었다.

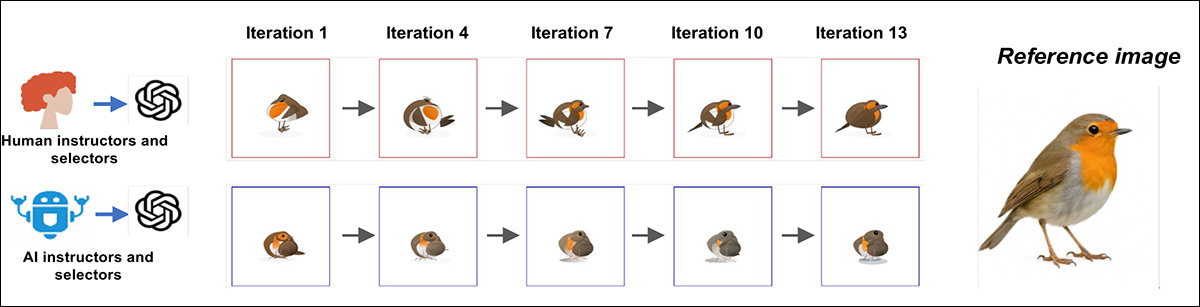

연구에서 사용된 바이브 코딩 워크플로우의 스키마

인간 선택자는 각 새로 생성된 SVG를 이전 버전과 비교하여 참조 이미지와 더 잘 일치하는 버전을 선택하였다. 이는 라운드 간에 프로세스를 일관되게 유지하였다.

Results

30개의 바이브 코딩 라운드를 실행하였으며, 각 라운드에는 15개의 코어 참조 이미지 편집이 포함되었다. 이를 위해 45명의 인간 참가자가 선택되어, 각 참가자는 10회 반복에 걸쳐 선택자와 교사로 활동하였다.

각 턴에서, 동일한 참가자가 현재와 이전 SVG를 선택한 후, 다음 라운드의 지침을 작성하였다. 두 번째 테스트 버전에서는 인간의 결정이 GPT 5를 사용한 API 호출로 대체되었으며, 나머지 설정은 변경되지 않았다.

인간과 AI 모두가 평등하게 평가할 수 있는 일관된 테스트를 제공하기 위해, 제어된 실험 프레임워크가 구축되었다. 이 프레임워크는 반복적인 코딩 작업을 중심으로 하여, 참조 이미지(고양이, 개, 호랑이, 새, 코끼리, 펭귄, 상어, 얼룩말, 기린, 판다의 사진)를 스케일러블 벡터 그래픽스(SVG)를 사용하여 재생성하고, 재생성된 이미지를 원본 이미지와 비교하여 평가하는 작업이었다.

한 참조 이미지에 대한 인간 주도와 AI 주도 바이브 코딩의 예시 진행

반면에, AI 주도 버전에서는 초기 라운드에서 때때로 주요 시각적 특징을 포착하였지만, 이후 시도에서는 그 이점을 구축하지 못하고, 어떤 경우에는 목표에서 멀어졌다.

최종 반복의 최종 출력, 인간 주도 턴(상단 행)과 AI 주도 체인(하단 행)의 비교. 인간 주도 결과는 원본 동물과 더 잘 일치하며, AI 주도 결과는 가시적인 왜곡 또는 주요 특징의 손실을 보여준다.

The Big Picture

그러나 GPT-5가 출력을 자체적으로 평가한다면, 인간 결과가 더 좋다고 인정할 수 있을까? 인간과 AI 평가 모두가 동일한 방향으로 이동하였지만, AI 모델은 일관적으로 AI 생성 이미지를 인간보다 더 높게 평가하였다.

‘특히, 우리는 AI 에이전트가 자신의 출력이 인간이 생성한 출력보다 열등하다는 것을 인정할지, 아니면 자신의 창조물을 선호하여 잠재적인 정렬 문제를 나타낼지 여부를 물었다.’

그것은 실제로 정렬 문제가 있다는 것을 나타냈다.

‘AI 평가자는 AI 생성 출력에 더 높은 평가를 부여하였다. 이러한 발견은 관찰된 성능 차이가 인간과 AI 사이의 표현에 대한 불일치에서 비롯될 수 있음을 시사한다.’

인간과 AI가 지시를 어떻게 제공하는지 조사하는 테스트에서, 불일치가 명백해졌다.

코딩 작업 중 인간과 AI가 지시를 제공하는 방식의 비교

인간의 지시는 일반적으로 짧고 명확했으며, 코드 생성기에 대한 일반적인 편집 지침을 제공하였다. 반면에, AI 지시는 자세한 설명으로 가득 차 있었으며, 때때로 음영, 질감, 조명 또는 해부학적 세부 사항에 대한 설명으로 인해 모델에 유용한 다음 단계를 제공하지 못하였다.

Joint Endeavors

인간과 AI가 제어를 공유할 때 발생하는 상황을 테스트하기 위해, 연구진은 인간과 AI의 입력이 다른 혼합으로 구성된 코딩 작업을 실행하였다.

모든 하이브리드 설정은 완전한 AI 제어를 초과하였으므로, 약간의 인간 지침도 결과를 개선하였다.

인간-인공지능 혼합 코딩 설정

AI가 프로세스의 더 큰 부분을 차지할수록 성능이 저하되었다. 가장 좋은 결과는 인간이 대부분의 라운드를 주도하고, 가장 약한 결과는 AI가 대부분의 라운드를 주도했을 때 나타났다. 이러한 혼합 설정 중 어느 것도 새로운 라운드에서 지속적으로 개선되지 못하였다. 이는 인간의 방향이 일관적이고 지속적인 것이 가장 효과적임을 시사한다.

Role Reversal

연구진은 또한 이러한 작업에서 누가 무엇을 하는지가 중요한지 테스트하였다.

인간과 AI의 역할을 바꾸었을 때, 인간이 지시를 제공하고 AI가 선택을 할 때, 결과는 약간 저하되었다.

바이브 코딩에서 역할 분리 테스트

인간이 지시를 제공하고 AI가 선택을 하는 경우, 결과는 거의 동일하였다. 그러나 AI가 지시를 제공하고 인간이 선택을 하는 경우, 결과는 약간 약해졌다.

연구진은 다음과 같이 결론을 내렸다.

‘고수준 아이디어 생성과 지시는 중요한 인간의 기여이며, 평가와 선택은 일반적으로 AI에 위임할 수 있다.’

‘이것은 하이브리드 시스템의 실제 설계 원칙을 시사한다. 인간이 방향을 설정해야 하고, AI는 평가와 실행을 지원해야 한다.’

Conclusion

LLM의 성능이 이러한 유형의 작업에서 어떻게 영향을 받을지 여부는まだ 확인되지 않았다. ‘LLM-기억력 상실’이 인간-인공지능 협업의 일상적인 문제가 아닌 날이 오면, 이는 인간을 위한 문제 해결을 목표로 하는 AI의 문제가 될 수도 있다.

연구진의 작업은 또한 AI와 인간 사이에 품질에 대한 본질적인 불일치가 있음을 보여주었다. 이는 소비자에 의해 궁극적으로 결정될 수 있는, 대체할 수 없는 인간 개념일 수 있다.

* 저자의 인라인 인용문을 하이퍼링크로 변환한 것입니다.

2026년 2월 13일 처음 게시되었습니다.