Anderson의 관점

체인-오브-사고 이유가 주요 언어 모델에서 ‘장식’으로 입증됨

새로운 연구는 현재 주요 언어 모델의 모든 다듬어진 단계별 설명, ChatGPT와 Claude를 포함하여, 단지 ‘장식’이라는 것을 쉽게 결정하는 방법을 제공합니다. 그리고 이러한 설명은 대부분 AI가 답을 결정한 후에 만들어진 것입니다.

작년, AI와 관련된 여러 회사에서 수행한 일련의 연구, Anthropic과 Apple을 포함하여, 소위 ‘이유를 가진 AI’가 단계별 설명을 생성하는 경우가 많지만, 이러한 설명은 실제로 답을 결정한 이유를 반영하지 않는다는 것을 나타냈습니다.

다양한 이유로 인해, 이 논쟁은 곧 반박과 다양한 해석으로 발전했습니다. 그리고 이러한 논쟁은 여전히 해결되지 않은 채로 남아 있습니다. 체인-오브-사고(CoT) 이유는 단지 사용자를 안심시키기 위한 장식적인 것인지, 아니면 실제 이유 과정의 증거인지 여전히 명확하지 않습니다.

ChatGPT ‘shows its work’ – but has it already decided what to answer?

보여주기와 말하기

이제, 인도에서 나온 새로운 논문은 ChatGPT와 다른 주요 언어 모델의 인터페이스에서 나타나는 인상적인 ‘추론 애니메이션’이 실제로 단계별로 이유를 결정하는지 여부를 평가하는 방법을 제공합니다.

새로운 연구는 인도 정보 기술 연구소(IIITA)와 델리 국립 전자 정보 기술 연구소(NIELIT)의 두 연구자에 의해 수행되었습니다.

저자들은 대부분의 경우, 사적 및 오픈 소스 언어 모델에서 체인-오브-사고 이유가 사용자에게 제시되는 것이 ‘장식’이라고 발견했습니다. 그리고 이러한 이유는 대부분 AI가 답을 결정한 후에 만들어진 것입니다.

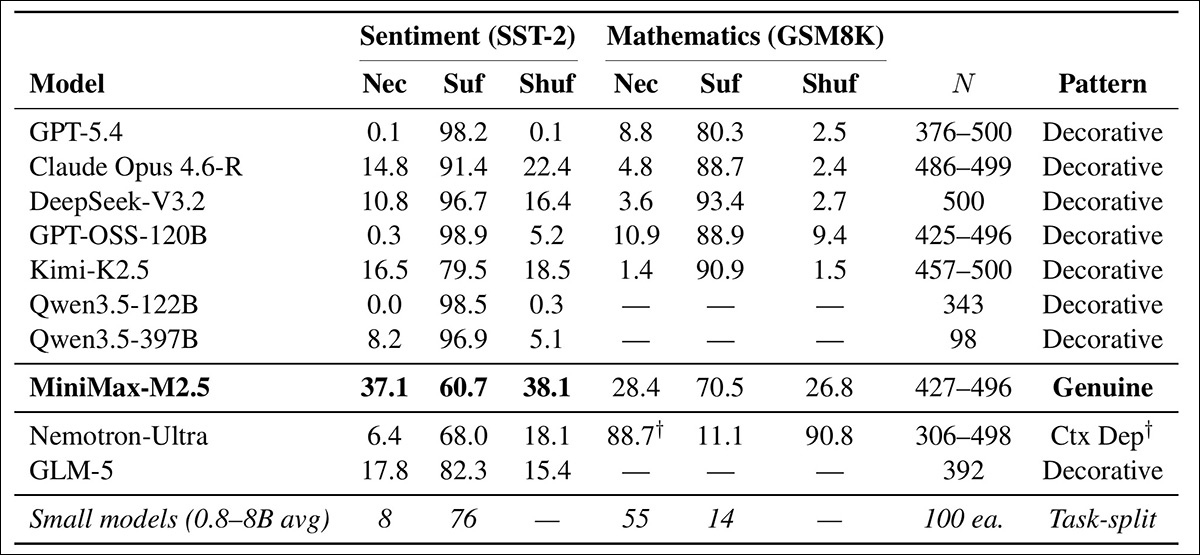

ChatGPT5.4, Claude Opus 4.6-R, DeepSeek-V3.2를 테스트한 결과, 체인-오브-사고 이유를 제거하면 답이 변경되는 경우가 17% 미만입니다. 그리고 단일 단계만으로도 올바른 답을 얻을 수 있습니다.

저자들은 다음과 같이 말합니다:

‘의료, 금융, 법률 분야에서 AI에 대한 규제 프레임워크는 점점 더 ‘설명 가능한’ 시스템을 요구합니다. 우리의 결과는 표준 접근 방식, 즉 모델이 작업을 보여주는 방식,이 투명성의 환상을 제공한다는 것을 시사합니다.

‘설명은 유창하고, 도메인에 적절하며, 잘못된 방식으로 서술됩니다. 모델이 수행하지 않은 이유를 서술합니다.

‘의료 AI가 “호중구증은 임신 과정의 일부”라고 쓰면, 호중구증을 고려하지 않았을 수 있습니다. 질문 줄기에서 답으로 패턴 매칭을 했을 수 있고, 이유를 뒤에서 만들어 낸 것입니다.

‘EU AI법(제13조)에 따르면, 고위험 AI 시스템은 ‘관련 논리’에 대한 ‘의미 있는 정보’를 제공해야 합니다. 우리의 결과는 체인-오브-사고 설명이 대부분의 모델에서 이 표준을 충족하지 않는다는 것을 시사합니다. ‘관련 논리’는 설명에서 서술된 논리가 아닙니다.’

저자들은 두 개의 작은 모델이 일반적인 패턴을 깨뜨린다는 것을 관찰했습니다. MiniMax-M25는 감정 분석에서 실제 단계 의존성을 보여주었고, Kimi-K25는 주제 분류에서 39%의 실제 단계 처리를 보여주었습니다.

작은 모델이 더 열심히 노력한다

10개의 API 모델을 테스트한 외에도, 저자들은 0.8에서 8억 개의 매개변수 사이의 여러 작은 오픈 웨이트 모델을 테스트했습니다. 이러한 작은 모델은 실제로 이유를 가지고 있으며, 보여지는 체인-오브-사고는 대부분 실제로 필요한 것입니다.

작은 모델은 55%의 단계별 이유가 필요했지만, 큰 모델은 평균 11%의 필요성만을 보여주었습니다. 큰 모델은 내부적으로 단계별 이유를 생략하고, 강한 훈련 데이터 분포에서 답을 얻는 것으로 보입니다.

저자들은 다음과 같이 주장합니다:

‘작은 모델은 수학에서 충실하게 이유를 가지고 있습니다. 그들은 매개변수 지식을 가지고 있지 않기 때문에, 단축할 수 없습니다.

‘전선 모델은 내부적으로 수학적 패턴을 내재화했기 때문에, 명시적인 체인 이유는 불필요합니다. 체인-오브-사고는 여전히 정확성을 향상시킵니다(생성 구조화). 그러나 개별 단계는 더 이상 고유한 정보를 가지고 있지 않습니다.’

방법

모델을 테스트하는 방법은 세 가지 기준에 기반합니다.

필요성은 각 체인-오브-사고 단계를 제거하고, 답이 변경되는지 여부를 확인합니다. 답이 변경되는 경우, 해당 단계는 ‘필요’로 간주됩니다. 충분성은 각 단계를 분리하고, 해당 단계만으로도 답을 얻을 수 있는지 여부를 확인합니다. 순서 민감성은 단계를 섞고, 답이 변경되는지 여부를 확인합니다(실제 이유는 순서에 따라 달라야 합니다).

이러한 기준을 함께 사용하면, 실제 단계별 이유를 나타내는 모델과, 설명을 제거, 재배열, 또는 축소할 수 있는 모델을 구분할 수 있습니다.

최소 비용

저자들은 실제 이유를 필요성과 충분성을 통해 정의합니다. 높은 필요성과 낮은 충분성은 각 단계가 고유한 가치를 가지고 있음을 나타냅니다. 반대로, 장식적인 이유는 낮은 필요성과 높은 충분성을 나타냅니다. 즉, 단계를 제거하거나 단일 단계만으로도 답을 얻을 수 있습니다.

필요성만으로는 이 점을 명확히 할 수 없으므로, 충분성을 사용하여 단일 단계가 이미 결과를 포함하는지 여부를 확인합니다. 순서 민감성은 모델이 순서에 따라 달라지는지 여부를 확인합니다.

이 접근 방식은 Intervention-Consistent Explanation(ICE) 프레임워크를 기반으로 하며, 텍스트 입력 및 출력 API 액세스만 필요로 합니다. 6단계 체인-오브-사고의 경우, 15개의 평가를 수행하며, 모델당 약 1~2달러의 비용이 듭니다.

ICE 프레임워크는 모델의 행동을 필요성과 충분성에 따라 세 가지 패턴으로 분류합니다: 장식은 낮은 필요성과 높은 충분성을 나타내며, 단계가冗長하고 답이 이미 결정되어 있습니다. 충실은 높은 필요성과 높은 충분성을 나타내며, 각 단계가 실제로 의미를 가지고 있습니다. 문맥 의존은 높은 필요성과 낮은 충분성을 나타내며, 단계가 순서에 따라 달라집니다.

테스트

저자들은 10개의 주요 API 모델을 테스트했습니다. 각 모델은 4つの 작업에 대해 테스트되었습니다: 감정 분류, 수학 단어 문제, 주제 분류, 의료 질문 응답.

각 모델은 필요성, 충분성, 순서 민감성에 따라 평가되었습니다. 대부분의 모델은 감정 분류와 수학 단어 문제에서 장식적인 이유를 보여주었습니다. 그러나 MiniMax-M2.5와 Kimi-K2.5는 주제 분류에서 실제 단계별 이유를 보여주었습니다.

10개의 주요 언어 모델에 대한 테스트 결과

저자들은 다음과 같이 말합니다:

‘대부분의 모델은 감정 분류와 수학 단어 문제에서 장식적인 이유를 보여줍니다. 그러나 MiniMax-M2.5와 Kimi-K2.5는 주제 분류에서 실제 단계별 이유를 보여줍니다.’

출력剛性

저자들은 모델의 출력剛性를 관찰했습니다. 일부 모델은 출력剛性를 보여주며, 특정 작업에서 이유를 출력하지 않습니다.

이러한剛性는 작업에 따라 다르며, Claude와 DeepSeek-V3.2는 대부분의 작업에서 이유를 출력하지만, Qwen3.5-397B는 거의 이유를 출력하지 않습니다.

저자들은 다음과 같이 말합니다:

‘모델은 작업에 따라 이유를 출력하는 빈도가 다르며, Claude와 DeepSeek-V3.2는 대부분의 작업에서 이유를 출력하지만, Qwen3.5-397B는 거의 이유를 출력하지 않습니다.’

결론

이 논문은 체인-오브-사고 이유가 실제로 필요한지 여부를 평가하는 방법을 제공합니다. 대부분의 모델은 장식적인 이유를 보여주며, 실제로 필요한 이유는 아닙니다.

저자들은 모델이 실제로 이유를 가지고 있는지 여부를 평가하는 것이 중요하다고 주장합니다. 이는 모델이 실제로 필요한 이유를 가지고 있는지 여부를 평가하는 것이 중요하다는 것을 의미합니다.

이 연구는 체인-오브-사고 이유가 실제로 필요한지 여부를 평가하는 방법을 제공하며, 이는 모델이 실제로 필요한 이유를 가지고 있는지 여부를 평가하는 데 중요합니다.

*저자의 인라인 인용을 하이퍼링크로 변환한 것입니다.

† 이 논문은 작은 모델의 목록을 공개하지 않으며, 하나의 모델의 추가 변형을 포함합니다. 따라서 목록을 추론하는 것이 필요합니다.

†† 저자의 강조입니다.

2026년 3월 25일 처음 게시되었습니다.