Anderson의 관점

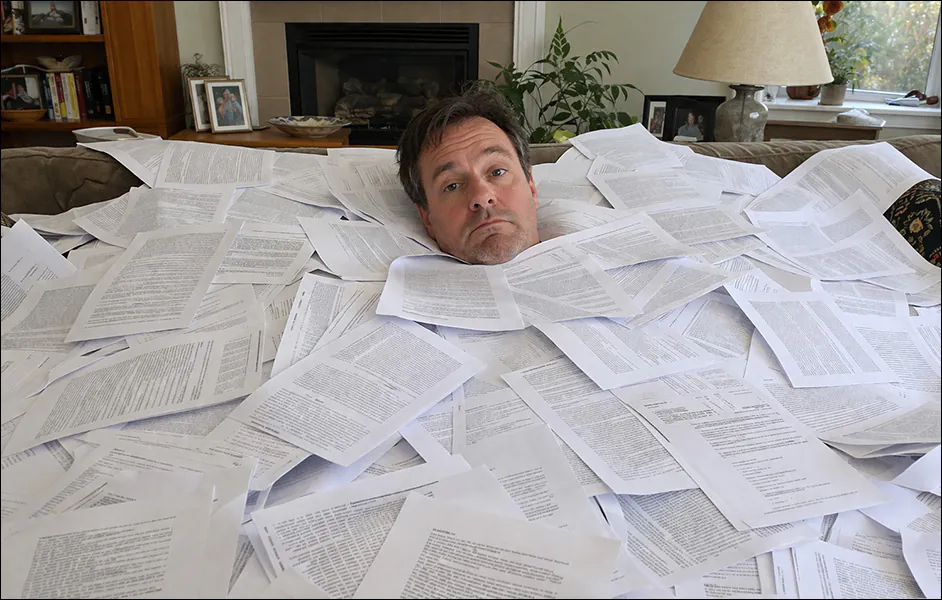

verbosity가 큰 언어 모델의 정확도를 낮춘다

새로운 연구에 따르면, 큰 언어 모델이 더 짧은 답변을 주도록 강제하면 답변의 정확도와 품질이 현저히 개선된다.

誰でも 채팅봇이 ‘말 많다’는 것을 경험해 본 사람이라면 새로운 연구의 결론을 쉽게 이해할 수 있을 것이다. 즉, AI에게 더 짧은 답변을 요구하면 더 정확해진다.

큰 AI 채팅봇이 작은 것보다 certains 경우(.inverse scaling 이라고 알려진 경우)에 더 나쁨을 수행하는 이유를 조사하면서, 연구진은 31개의 인기 있는 큰 언어 모델(LLM)을 더 짧은 답변을 주도록 강제하면 답변의 정확도가 최대 26.3%까지 개선된다는 것을 발견했다.

‘결과는 강한 인과적 증거를 제공한다. 즉, 간결성 제약이 큰 모델의 정확도를 26.3 퍼센트 포인트 개선하고, 역스케일링 격차를 67% 줄였다(44.2%에서 14.8%로, 페어드 t-테스트: t = 7.80, p < 0.0001).'

과도한 verbosity는 종종 최종 사용자들의 불만 사항 중 하나이며, 특히 ChatGPT와 같은 상업용 모델을 사용하는 사람들 사이에서 이러한 문제가 빈번히 발생한다. 이러한 모델의 지원 포럼에서는 이러한 주제가 자주 논의된다.

verbosity를 해결함으로써 가장 많이 영향을 받는 도메인은 수학이며, 여기서 테스트된 AI는 50단어 이내로 답변하도록 제한되었다. 읽기 이해와 같은 작업에서는 답변을 10단어 이내로 제한했다.

이 논문은 AI의 verbosity를 ‘과思考’으로 정의하며, 여기서 중심 메시지는 단순히 말 많음으로 인해 가려지지 않을 뿐만 아니라 때때로 부정적인 영향을 받기도 한다. 모델이 작을수록 이 해결책이 필요하지 않거나 효과가 없다는 것을 관찰했다.

연구진은 이 해결책을 체계적으로 적용하기 위해 모델의 아키텍처를 수정할 필요는 없다고 결론지었다. 그러나 사용자의 채팅 세션에서는 간결성을 지시하는 것을 반복해야 할 수 있지만, ChatGPT와 같은 플랫폼에서 기본으로 구현된 글로벌 시스템 프롬프트는 더 짧은 답변을 기본 동작으로 만들 수 있을 것이다.

강풍

이것은 큰 모델이 verbosity로 왜곡되는 정확한 이유를 설명하지 않는다. 왜냐하면 이것은 오픈 소스 모델에도 영향을 미치기 때문이다. 이 논문은 강화 학습에서 인간 피드백(RLHF) 기술의 프로토콜과 일반적인 관행이 설명을 제공할 수 있다고 제안한다:

‘합리적인 기원은 RLHF 정렬 훈련에서 찾을 수 있다. 여기서 인간 주석자가 더 큰 모델에 대한 길이-보상 신호에 대한 보상을 지나치게 제공한다. 이것은 verbosity 차이가 더 큰 모델에서 더 크고, 기본 모델 변형보다 지시-튜닝된 변형에서 더 크다는 사실과 일치한다.’

‘이전 연구는 보상 모델에서 시스템적인 길이 편향을 문서화했으며, 여기서 주석자가 길이와 품질을 혼동한다.’

‘더 큰 모델은 길이-보상 신호를 만족시키기 위한 더 큰 능력을 가지고 있으므로 더 작은 모델보다 더 많은 verbosity를 내부화할 수 있으며, 우리는 관찰한 스케일-의존적인 과思考을 생성할 수 있다.’

인간의 경우, verbosity는 침묵을 메우거나 어색함을 숨기기 위해 발생할 수 있다. 또는 정신 건강 문제로 인해 발생할 수 있다. AI의 경우 이러한 요인으로 인해 영향을 받을 수 있다. 즉, 이러한 특성을 прояв하는 훈련 데이터를 흡수함으로써 영향을 받을 수 있다.

데이터셋에 다른 동기가 존재한다. 예를 들어, SEO를 위해 더 긴 텍스트 콘텐츠를 생성하는 경우 길이가 권위와 관련이 있다고 생각할 수 있다.

방법

이 논문의 가설을 테스트하기 위해 31개의 언어 모델을 평가했다. 모델은 다섯 가지 벤치마크 컬렉션에 대해 평가되었다. 즉, 수학적 추론을 위한 GSM8K, 읽기 이해를 위한 BoolQ, 常識 추론을 위한 CommonsenseQA, 과학 질문을 위한 ARC-Easy, 과학 지식을 위한 MMLU-STEM.

결과

모델은 결정론적 출력을 보장하기 위해 탐욕적 디코딩을 사용하여 답변을 생성했다. 그런 다음 작업별 규칙을 사용하여 답변을 추출하고, 정확도를 측정했다.

데이터 및 테스트

개별 질문에 대한 테스트에서 벤치마크 작업의 상당수는 모델을 구별하지 못했다. 즉, 모든 시스템이 성공하거나 모든 시스템이 실패했다. 따라서 상대적 성능에 대한 실제 신호는 없었다.

역스케일링

모델이 구별되는 질문 중 대부분은 예상대로 작동했으며, 더 큰 시스템이 더 나은 성능을 보였다. 그러나 더 작은 모델이 더 나은 성능을 보이는 작은 그룹이 있었다. 모든 문제에 걸쳐 역스케일링은 7.7%의 경우에 발생했다.

과思考

분석은 큰 모델이 특정 도메인에서 왜 더 나쁨을 수행하는지 조사했다. 제안된 문제는 능력의 부족이 아니라, 너무 많은 설명인 경우이다. 즉, 더 긴 답변으로 인해 올바른 추론이 가려질 수 있다.

‘[간결성] 제약이 큰 모델을 극적으로 개선하고, 작은 모델에는 거의 영향을 미치지 않는다. verbosity가 부차적이지 않고 인과적이라는 것을 확인한다. 즉, 과思考은 스케일-특정 실패 모드이며, 작업 난이도 효과가 아니다.’

결론

이 연구의 결과는 큰 언어 모델에서 verbosity가 정확도를 낮출 수 있음을 보여준다. 이는 이러한 모델의 성능을 개선하기 위한 중요한 고려 사항이다.