인공지능

Hunyuan Video LoRA

이 기사는 Windows 기반 소프트웨어를 설치하고 사용하는 방법을 보여줍니다. 이 소프트웨어는 Hunyuan Video LoRA 모델을 훈련시킬 수 있으며 사용자는 Hunyuan Video 기본 모델에서 사용자 지정 개인성을 생성할 수 있습니다.

[비디오 너비=”1200″ 높이=”900″ mp4=”https://www.unite.ai/wp-content/uploads/2025/01/loras-hunyuan-AE2.mp4″][/비디오]

재생을 클릭하세요. civit.ai 커뮤니티에서 최근 Hunyuan LoRAs의 폭발에서 예제입니다.

현재 Hunyuan LoRA 모델을 로컬에서 생성하는 가장 인기 있는 두 가지 방법은:

1) diffusion-pipe-ui Docker 기반 프레임워크로, Windows Subsystem for Linux(WSL)를 사용하여 일부 프로세스를 처리합니다.

2) Musubi Tuner는 인기 있는 Kohya ss 확산 훈련 아키텍처의 새로운 추가입니다. Musubi Tuner는 Docker가 필요하지 않으며 WSL 또는 기타 Linux 기반 프록시에 의존하지 않습니다. 그러나 Windows에서 실행하기가 어려울 수 있습니다.

따라서 이 절차는 Musubi Tuner에 중점을 두고 API 주도 웹사이트 또는 Runpod와 같은 상업적 GPU 임대 프로세스를 사용하지 않고 Hunyuan LoRA 훈련 및 생성을 위한 완전히 로컬 솔루션을 제공합니다.

[비디오 너비=”1200″ 높이=”674″ mp4=”https://www.unite.ai/wp-content/uploads/2025/01/example-woman-hunyuan-loras.mp4″ 루프=”true”][/비디오]

재생을 클릭하세요. 이 기사에서 Musubi Tuner를 사용한 LoRA 훈련 샘플입니다. 기사에서 설명하는 목적을 위해 해당 인물로부터 모든 허가가 있음을 확인했습니다.

요구 사항

설치는 최소한 30+/40+ 시리즈 NVIDIA 카드가 있는 Windows 10 PC가 필요하며 최소 12GB의 VRAM이 필요합니다(16GB는 권장됨). 이 기사에서 사용된 설치는 64GB의 시스템 RAM과 24GB의 VRAM이 있는 NVIDIA 3090 그래픽 카드를 사용하여 테스트되었습니다. 이는 Windows 10 Professional의 새로 설치된 테스트 베드 시스템에서 600GB 이상의 여유 디스크 공간이 있는 파티션에서 테스트되었습니다.

경고

Musubi Tuner 및 그 전제 조건을 설치하는 것은 개발자 중심 소프트웨어 및 패키지를 Windows 10 설치의 메인 설치에 직접 설치하는 것을 포함합니다. ComfyUI의 최종 단계를 고려할 때 이 프로젝트는 약 400-500GB의 디스크 공간이 필요합니다.私は 여러 번 새로 설치된 Windows 10 환경에서 이 절차를 테스트했지만 나는나 Unite.AI는 이 지침을 따라 시스템에 발생하는 모든 손상에 대해 책임을 지지 않습니다. 중요한 데이터를 백업하기 전에 이러한 설치 절차를 시도하기 전에 주의하십시오.

고려 사항

이 방법은 여전히 유효한가?

생성적 AI 장면은 매우 빠르게 움직이고 있으며 올해 Hunyuan Video LoRA 프레임워크에 더 나은 및 더 정리된 방법을 기대할 수 있습니다.

…或者 이번 주에! 내가 이 기사를 작성하는 동안 Kohya/Musubi 개발자는 musubi-tuner-gui,를 생성했습니다. Musubi Tuner용 고급 Gradio GUI:

명백히 사용자 친화적인 GUI는 BAT 파일보다 선호되며 일단 musubi-tuner-gui가 작동하면 그렇습니다. 내가 작성하는 동안 5일 전에 온라인으로 올라왔으며 성공적으로 사용한 사람에 대한 언급을 찾을 수 없습니다.

저장소의 게시물에 따르면 새 GUI는 가능한 한 빨리 Musubi Tuner 프로젝트에 직접 통합될 예정입니다. 이는 현재 별도의 GitHub 저장소로서의 존재가 종료됩니다.

현재 설치 지침에 따르면 새 GUI는 기존 Musubi 가상 환경에 직접 클론되며 내가 시도한 대로 작동하도록 하는 것은 불가능합니다.

일단 GUI가 Musubi Tuner에 통합되면 이러한 종류의 문제는 분명히 해결될 것입니다. 저자는 프로젝트가 ‘정말 거친’ 것으로 인정하지만 개발 및 Musubi Tuner에 직접 통합에 대해 낙관적입니다.

이러한 문제들(기본 경로 및 UV Python 패키지의 사용과 관련된 문제들)로 인해 우리는 더 매끄러운 Hunyuan Video LoRA 훈련 경험을 위해 약간 더 기다려야 할 것입니다. 그렇지만 그것은 매우 유망해 보입니다!

그러나 만약 기다릴 수 없고 약간의 손을 굴リ하려면 Hunyuan 비디오 LoRA 훈련을 지금 바로 로컬에서 실행할 수 있습니다.

시작해 봅시다.

왜 Bare Metal에 무엇을 설치합니까?

(고급 사용자는 이 단락을 건너뛰세요)

고급 사용자는 왜 Bare Metal Windows 10 설치에 इतन 많은 소프트웨어를 설치했는지 궁금해할 것입니다. 이유는 Windows용 Linux 기반 Triton 패키지의 필수 포트가 가상 환경에서 작동하기가 훨씬 더 어려운 것입니다. 다른 모든 Bare-Metal 설치는 가상 환경에 설치될 수 없으며 로컬 하드웨어와 직접 상호 작용해야 하기 때문입니다.

프리레퀴사이트 패키지 및 프로그램 설치

초기 설치할 프로그램 및 패키지에 대해 설치 순서가 중요합니다. 시작해 봅시다.

1: Microsoft Redistributable 다운로드

https://aka.ms/vs/17/release/vc_redist.x64.exe에서 Microsoft Redistributable 패키지를 다운로드하고 설치합니다.

이것은 간단하고 신속한 설치입니다.

2: Visual Studio 2022 설치

Microsoft Visual Studio 2022 Community 버전을 https://visualstudio.microsoft.com/downloads/?cid=learn-onpage-download-install-visual-studio-page-cta에서 다운로드합니다.

다운로드된 설치 프로그램을 실행합니다:

모든 사용 가능한 패키지가 필요하지는 않습니다. 이는 무거운 설치이며 설치 시간이 길어질 것입니다. 초기 작업負荷 페이지가 열리면 데스크톱 개발 with C++을 체크합니다(이미지 참조).

이제 상단 왼쪽의 개별 구성 요소 탭을 클릭하고 검색 상자에서 ‘Windows SDK’를 찾습니다.

기본적으로 Windows 11 SDK만 체크되어 있습니다. Windows 10을 사용하는 경우(이 설치 절차는 Windows 11에서 테스트되지 않았음) 최신 Windows 10 버전을 체크합니다(이미지 참조).

C++ CMake를 검색하고 C++ CMake tools for Windows가 체크되어 있는지 확인합니다.

이 설치에는 최소 13GB의 공간이 필요합니다.

Visual Studio가 설치되면 컴퓨터에서 실행하려고 시도할 것입니다. 프로그램을 완전히 열면 닫습니다.

3: Visual Studio 2019 설치

일부 후속 패키지는 Musubi에서 더 오래된 버전의 Microsoft Visual Studio를 기대하고 일부는 더 최근 버전을 필요로 합니다.

따라서 Microsoft에서 무료 Community 버전의 Visual Studio 19를 다운로드하거나(https://visualstudio.microsoft.com/vs/older-downloads/ – 계정 필요) Techspot(https://www.techspot.com/downloads/7241-visual-studio-2019.html)에서 다운로드합니다.

위의 절차와 동일한 옵션으로 설치합니다(Visual Studio 2022 설치 절차 참조). Windows SDK는 이미 Visual Studio 2019 설치 프로그램에 체크되어 있습니다.

새로운 버전이 설치되는 것을 볼 수 있습니다.

설치가 완료되고 설치된 Visual Studio 2019 응용 프로그램을 열고 닫으면 Windows 명령 프롬프트를 열고 다음을 입력합니다:

where cl

결과는 두 개의 설치된 Visual Studio 에디션의 알려진 위치입니다.

대신 INFO: Could not find files for the given pattern(s)를 받는 경우 이 기사의 경로 확인 섹션으로 이동하고 Windows 환경에 관련 경로를 추가하는 지침을 따릅니다.

이 섹션 아래의 변경 사항을 저장하고 where cl 명령을 다시 시도합니다.

4: CUDA 11 + 12 툴킷 설치

Musubi에 설치된 다양한 패키지에는 NVIDIA CUDA의 다른 버전이 필요합니다. CUDA는 NVIDIA 그래픽 카드에서 훈련을 가속화하고 최적화합니다.

Visual Studio 버전을 먼저 설치한 이유는 NVIDIA CUDA 설치 프로그램이 기존 Visual Studio 설치를 검색하고 통합하기 때문입니다.

https://developer.nvidia.com/cuda-11-8-0-download-archive?target_os=Windows&target_arch=x86_64&target_version=11&target_type=exe_local에서 11+ 시리즈 CUDA 설치 패키지를 다운로드합니다(‘로컬 exe’ 다운로드).

https://developer.nvidia.com/cuda-downloads?target_os=Windows&target_arch=x86_64에서 12+ 시리즈 CUDA 툴킷 설치 패키지를 다운로드합니다.

두 설치 프로그램의 설치 프로세스는 동일합니다. Windows 환경 변수 경로에 대한 경고 메시지를 무시합니다. 우리는稍后 수동으로 이를 처리할 것입니다.

CUDA 11+ 설치

11+ 시리즈 CUDA 툴킷 설치 프로그램을 시작합니다.

설치 옵션에서 사용자 지정(고급)을 선택하고 계속 진행합니다.

NVIDIA GeForce Experience 옵션을 체크 해제하고 다음을 클릭합니다.

설치 위치 선택을 기본값으로 유지합니다(이것은 중요합니다).

다음을 클릭하고 설치를 완료합니다.

Nsight Visual Studio 통합과 관련된 설치 프로그램의 경고 또는 注意 메시지를 무시합니다. 이것은 우리의 사용 사례에 필요하지 않습니다.

CUDA 12+ 설치

12+ 시리즈 NVIDIA 툴킷 설치 프로그램을 위한 전체 프로세스를 반복합니다.

이 버전의 설치 프로세스는 위에 나열된 11+ 버전과 동일합니다. 환경 경로에 대한 경고만 무시합니다.

12+ CUDA 버전 설치가 완료되면 Windows 명령 프롬프트를 열고 다음을 입력합니다:

nvcc --version

이것은 설치된 드라이버 버전에 대한 정보를 확인해야 합니다.

카드를 인식하는지 확인하려면 다음을 입력합니다:

nvidia-smi

5: GIT 설치

GIT는 로컬 머신에 Musubi 저장소를 설치하는 것을 처리할 것입니다. GIT 설치 프로그램을 https://git-scm.com/downloads/win에서 다운로드합니다(’64비트 Git for Windows Setup’).

설치 프로그램을 실행합니다:

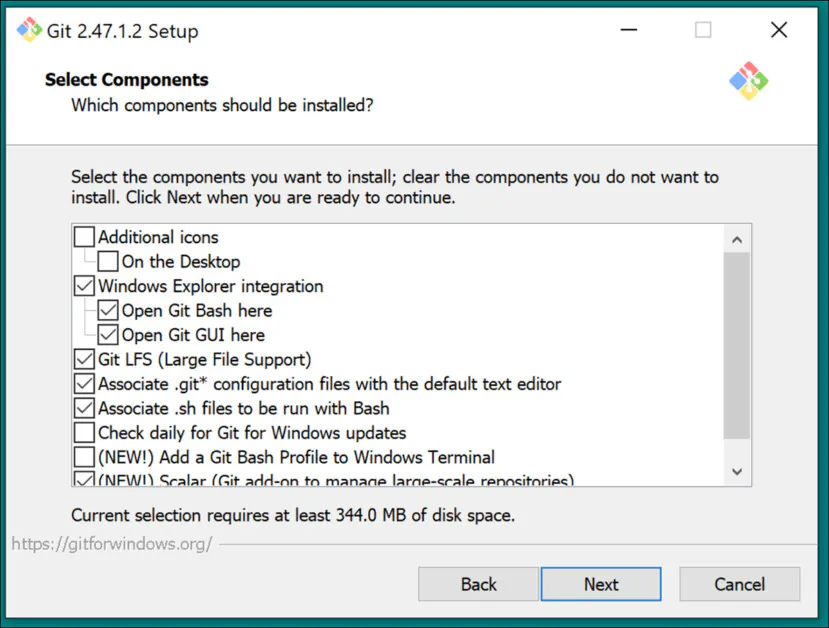

기본 설정을 구성 요소 선택에 사용합니다:

기본 편집기를 Vim으로 유지합니다:

GIT이 분기 이름에 대해 결정하도록 합니다:

경로 환경에 대한 추천 설정을 사용합니다:

SSH에 대한 추천 설정을 사용합니다:

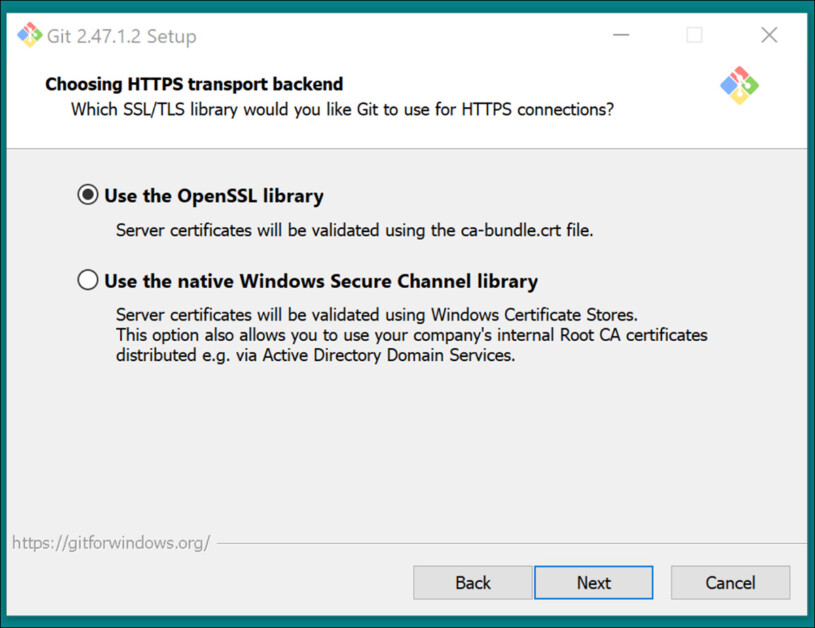

HTTPS 전송 백엔드에 대한 추천 설정을 사용합니다:

줄 종결 변환에 대한 추천 설정을 사용합니다:

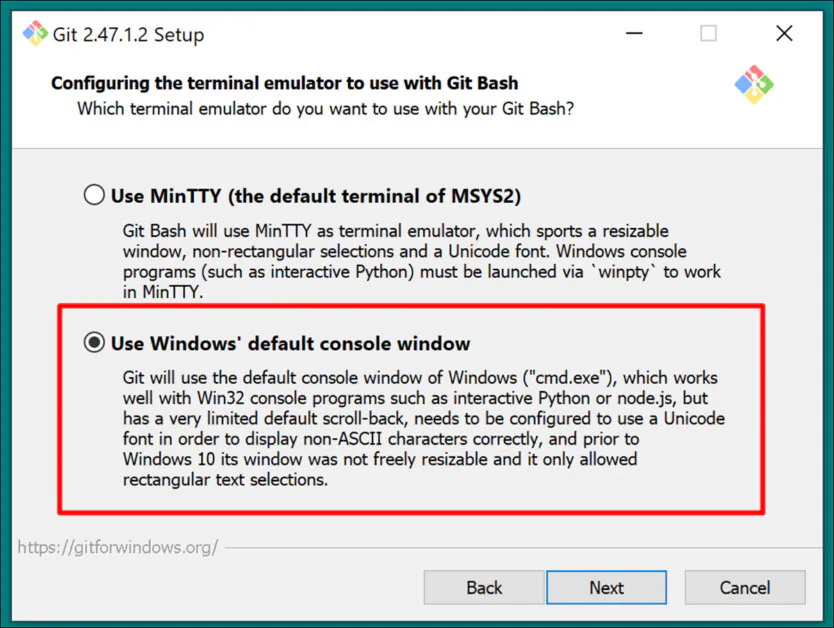

Windows 기본 콘솔을 터미널 에뮬레이터로 사용합니다:

GIT 풀에 대한 추천 설정을 사용합니다(FAST-FORWARD 또는 MERGE).

자격 증명 도우미에 대한 GIT 자격 증명 관리자(기본 설정)를 사용합니다:

추가 옵션 구성에서 파일 시스템 캐싱 사용을 체크하고 심볼릭 링크 사용을 체크 해제합니다(중급 사용자만이 중앙 모델 저장소에 대해 하드 링크를 사용하는 경우).

설치를 완료하고 GIT이 제대로 설치되었는지 테스트하려면 CMD 창을 열고 다음을 입력합니다:

git --version

GITHUB 로그인

나중에 GitHub 저장소를 클론하려고 할 때 GitHub 자격 증명을 요구할 수 있습니다. 이를 예상하여 Windows 시스템에 설치된 모든 브라우저에서 GitHub 계정에 로그인합니다(必要한 경우 계정을 생성합니다). 이로 인해 0Auth 인증 방법(팝업 창)이 가능한 한 짧은 시간이 걸릴 것입니다.

초기 챌린지 이후에는 자동으로 인증된 상태로 유지됩니다.

6: CMake 설치

CMake 3.21 이상이 Musubi 설치 프로세스의 일부에 필요합니다. CMake는 다양한 컴파일러를 오케스트레이션하고 소스 코드에서 소프트웨어를 컴파일하는 크로스 플랫폼 개발 아키텍처입니다.

https://cmake.org/download/에서 다운로드합니다 (‘Windows x64 Installer’).

설치 프로그램을 시작합니다:

PATH 환경 변수에 CMake 추가가 체크되어 있는지 확인합니다.

다음을 클릭합니다.

Windows 명령 프롬프트에서 다음 명령을 입력합니다:

cmake --version

CMake가 성공적으로 설치되면 다음과 같은 메시지가 표시됩니다:

cmake version 3.31.4

CMake suite maintained and supported by Kitware (kitware.com/cmake).

7: Python 3.10 설치

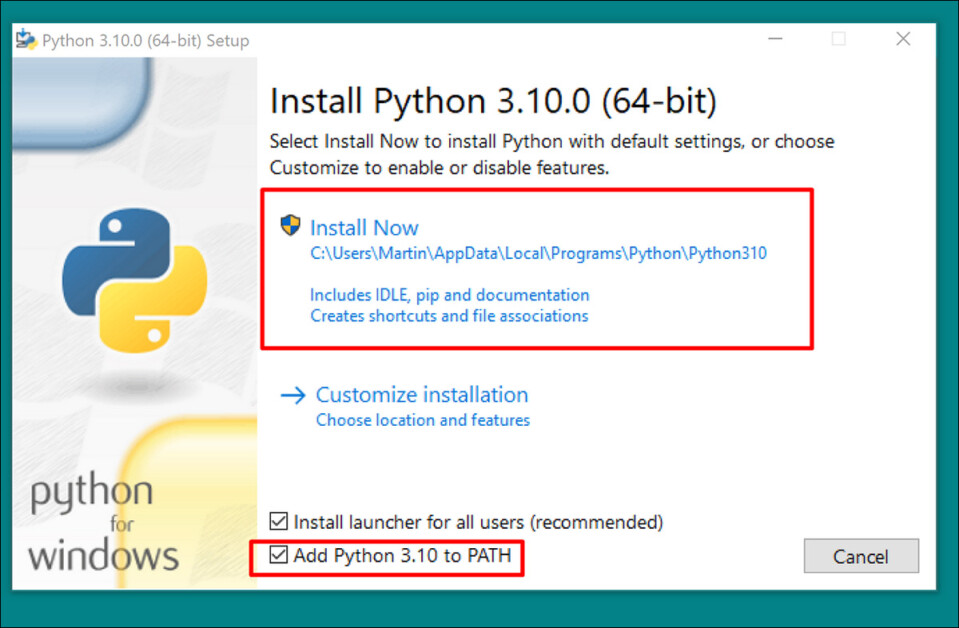

Python 인터프리터는 이 프로젝트의 핵심입니다. https://www.python.org/downloads/release/python-3100/에서 3.10 버전을 다운로드합니다(’64비트 Windows 설치 프로그램’).

다운로드된 설치 프로그램을 실행하고 기본 설정을 유지합니다:

설치 프로세스의 끝에서 경로 길이 제한 해제를 클릭합니다(관리자 확인 필요).

Windows 명령 프롬프트에서 다음을 입력합니다:

python --version

이것은 Python 3.10.0으로 결과를 나타낼 것입니다.

경로 확인

Musubi 프레임워크의 클론 및 설치 및 설치 후 정상 작동을 위해 Windows에서 여러 외부 구성 요소의 경로를 알고 있어야 합니다. 특히 CUDA의 경로입니다.

따라서 PATH 환경 변수를 열고 모든 필수 구성 요소가 포함되어 있는지 확인해야 합니다.

Windows 환경 변수를 편집하려면 Windows 검색 표시줄에 시스템 환경 변수 편집을 입력합니다.

이것을 클릭하면 시스템 속성 제어판이 열립니다. 시스템 속성의 하단 오른쪽에 환경 변수 버튼을 클릭하고 환경 변수 창이 열립니다. 이 창의 하단에 있는 시스템 변수 패널에서 PATH를 스크롤하고 두 번 클릭하여 환경 변수 편집 창을 엽니다. 이 창의 너비를 넓혀서 변수 경로를 모두 볼 수 있습니다.

중요한 항목은 다음과 같습니다:

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\libnvvp

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\libnvvp

C:\Program Files (x86)\Microsoft Visual Studio\2019\Community\VC\Tools\MSVC\14.29.30133\bin\Hostx64\x64

C:\Program Files\Microsoft Visual Studio\2022\Community\VC\Tools\MSVC\14.42.34433\bin\Hostx64\x64

C:\Program Files\Git\cmd

C:\Program Files\CMake\bin

대부분의 경우 올바른 경로 변수가 이미 존재해야 합니다.

새 항목을 클릭하여 누락된 경로를 추가하고 올바른 경로를 붙여넣습니다:

위에 나열된 경로를 단순히 복사하여 붙여넣지 마십시오. 자신의 Windows 설치에서 각 해당 경로가 존재하는지 확인합니다.

특히 Visual Studio 설치에서 경로 변형이 있는 경우(주로 x64 폴더 내의 x64) 위의 경로를 사용하여 대상 폴더를 찾습니다. 그런 다음 이러한 경로를 환경 변수 편집 창에 붙여넣습니다.

이후 컴퓨터를 재시작합니다.

Musubi 설치

PIP 업그레이드

최신 버전의 PIP 설치 프로그램을 사용하면 일부 설치 단계를 매끄럽게 할 수 있습니다. 관리자 권한이 있는 Windows 명령 프롬프트에서 다음을 입력합니다:

pip install --upgrade pip

승격

일부 명령은 승격된 권한(즉, 관리자로 실행)이 필요할 수 있습니다. 권한 오류 메시지를 받는 경우 명령 프롬프트 창을 닫고 Windows 검색 상자에 CMD를 입력하고 명령 프롬프트를右クリック하여 관리자로 실행을 선택합니다:

Torch 설치

PowerShell에서 다음을 입력합니다:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

수많은 패키지를 설치하는 동안 기다립니다.

완료되면 GPU를 사용하는 PyTorch 설치를 확인하려면 다음을 입력합니다:

python -c "import torch; print(torch.cuda.is_available())"

이것은 다음과 같은 결과를 나타낼 것입니다:

C:\WINDOWS\system32>python -c "import torch;

print(torch.cuda.is_available())"

True

Triton for Windows 설치

다음은 Triton for Windows 구성 요소의 설치입니다. 승격된 PowerShell에서 다음을 입력합니다(한 줄에):

pip install https://github.com/woct0rdho/triton-windows/releases/download/v3.1.0-windows.post8/triton-3.1.0-cp310-cp310-win_amd64.whl

(설치 프로그램 triton-3.1.0-cp310-cp310-win_amd64.whl은 Intel 및 AMD CPU 모두에서 작동하며 아키텍처가 64비트이고 환경이 Python 버전과 일치하는 경우에 작동합니다)

이후에 다음과 같은 결과가 나타날 것입니다:

Successfully installed triton-3.1.0

Triton이 작동하는지 확인하려면 Python에서 다음을 입력합니다:

python -c "import triton; print('Triton is working')"

이것은 다음과 같은 결과를 나타낼 것입니다:

Triton is working

Triton이 GPU를 사용하는지 확인하려면 다음을 입력합니다:

python -c "import torch; print(torch.cuda.is_available())"

이것은 True로 결과를 나타낼 것입니다:

Musubi를 위한 가상 환경 생성

이제부터 Musubi를 위한 가상 환경을 설치할 것입니다. Musubi 폴더를 데스크톱에 생성합니다. 이후 예제는 이 폴더가 존재한다고 가정합니다: C:\Users\[사용자 프로필 이름]\Desktop\Musubi\.

PowerShell에서 해당 폴더로 이동합니다:

cd C:\Users\[사용자 프로필 이름]\Desktop\Musubi

가상 환경이 이미 설치된 것을 사용할 것이므로 --system-site-packages 플래그를 사용합니다. 다음을 입력합니다:

python -m venv --system-site-packages musubi

환경이 생성될 때까지 기다리면 활성화할 수 있습니다:

.\musubi\Scripts\activate

이제부터 가상 환경이 활성화되었음을 (musubi)가 모든 프롬프트의 시작에 나타남으로써 알 수 있습니다.

저장소 클론

새로 생성된 musubi 폴더(데스크톱의 Musubi 폴더 내)로 이동합니다:

cd musubi

이제 올바른 위치에 있으므로 다음 명령을 입력합니다:

git clone https://github.com/kohya-ss/musubi-tuner.git

클론이 완료될 때까지 기다립니다(오래 걸리지 않습니다).

요구 사항 설치

설치 폴더로 이동합니다:

cd musubi-tuner

다음 명령을 입력합니다:

pip install -r requirements.txt

많은 설치가 완료될 때까지 기다립니다(이것은 더 오래 걸립니다).

자동 Hunyuan Video Venv 액세스

将来的 세션에서 venv를 쉽게 활성화하고 액세스하기 위해 다음 텍스트를 Notepad에 복사하여 activate.bat으로 저장합니다(예를 들어).

@echo off

call C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\Scripts\activate

cd C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner

cmd

(사용자 프로필 이름을 실제 Windows 사용자 프로필 폴더 이름으로 바꿉니다)

이 파일을 저장하는 위치는 중요하지 않습니다.

이제 activate.bat을 더블 클릭하여 즉시 작업을 시작할 수 있습니다.

Musubi Tuner 사용

모델 다운로드

Hunyuan Video LoRA 훈련 프로세스에는 최소 7개의 모델을 다운로드하여 모든 가능한 최적화 옵션을 지원해야 합니다. 이 모델들은 함께 60GB 이상의 용량을 차지합니다.

현재 다운로드 지침은 https://github.com/kohya-ss/musubi-tuner?tab=readme-ov-file#model-download에서 찾을 수 있습니다.

그러나 작성 당시의 다운로드 지침은 다음과 같습니다:

clip_l.safetensors

llava_llama3_fp16.safetensors 및

llava_llama3_fp8_scaled.safetensors

를 다음에서 다운로드할 수 있습니다:

https://huggingface.co/Comfy-Org/HunyuanVideo_repackaged/tree/main/split_files/text_encoders

mp_rank_00_model_states.pt

mp_rank_00_model_states_fp8.pt 및

mp_rank_00_model_states_fp8_map.pt

를 다음에서 다운로드할 수 있습니다:

https://huggingface.co/tencent/HunyuanVideo/tree/main/hunyuan-video-t2v-720p/transformers

pytorch_model.pt

를 다음에서 다운로드할 수 있습니다:

https://huggingface.co/tencent/HunyuanVideo/tree/main/hunyuan-video-t2v-720p/vae

이 모델을 원하는 디렉토리에 넣을 수 있지만 일관성을 위해 다음에 넣습니다:

C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\models\

이 디렉토리 구조는 이전까지와 동일합니다. 이후 지침은 모델이 여기에 있는 것으로 가정합니다. 사용자 프로필 이름을 실제 Windows 프로필 폴더 이름으로 바꿉니다.

데이터셋 준비

공동체 논쟁을 무시하고 Hunyuan LoRA를 위한 훈련 데이터셋에 10~100개의 사진이 필요하다고 말할 수 있습니다. 15개의 이미지로도 훌륭한 결과를 얻을 수 있습니다. 이미지의 품질이 좋고 균형이 잘 잡혀 있다면 말입니다.

Hunyuan LoRA는 이미지 또는 매우 짧고 저해상도의 비디오 클립, 또는 각기 다른 것의 혼합으로 훈련될 수 있습니다. 그러나 비디오 클립을 훈련 데이터로 사용하는 것은 24GB 카드에서도 도전적입니다.

그러나 비디오 클립은 해당 인물이 매우 특이한 방식으로 움직인다면 Hunyuan Video 기본 모델이 알지 못하거나 추측할 수 없는 경우에만 유용합니다.

예를 들어 로저 래빗, 크세노모프, 마스크, 스파이더맨 또는 고유한 특징적인 움직임을 가진 다른 인물들입니다.

Hunyuan Video는 이미 일반적인 남성과 여성의 움직임을 알고 있으므로 비디오 클립은 인물의 Hunyuan Video LoRA를 얻기 위해 필요하지 않습니다. 따라서 정적 이미지를 사용할 것입니다.

이미지 준비

버킷 목록

TLDR 버전:

이미지 크기가 모두 같거나 2개의 다른 크기(예: 512x768px와 768x512px)의 50/50 분할을 사용하는 것이 좋습니다.

훈련이 잘 될 수 있지만 Hunyuan Video LoRAs는 상당히 관대할 수 있습니다.

긴 버전:

Kohya-ss LoRAs와 마찬가지로 정적 생성 시스템(예: Stable Diffusion)에서 버킷팅을 사용하여 다양한 크기의 이미지에 대한 작업을 분산시킵니다. 이는 GPU가 처리할 수 있는 청크로 이미지를 나누어 훈련 시간에 메모리 오류를 방지합니다.

각 이미지 크기(예: 512x768px)에 대해 버킷 또는 하위 작업이 생성됩니다. 따라서 다음과 같은 이미지 분포가 있는 경우:

2x 512x768px 이미지

7x 768x512px 이미지

1x 1000x600px 이미지

3x 400x800px 이미지

버킷 주의가 불균형적으로 분산된 것을 볼 수 있습니다:

따라서 하나의 형식 크기를 사용하거나 다른 크기 분포를 상대적으로 균등하게 유지하려고 시도합니다.

단순성을 위해 데이터셋의 모든 사진은 512x768px로 사용했습니다.

免責聲明: 모델(인물)은 이 목적을 위해 사진을 사용하고 이 기사에서 해당 유사성을 나타내는 AI 기반 출력에 대한 승인을 모두 허락했습니다.

데이터셋은 40개의 이미지로 구성되며 PNG 형식입니다(JPG도 괜찮습니다). 이미지들은 C:\Users\Martin\Desktop\DATASETS_HUNYUAN\examplewoman에 저장되었습니다.

이미지 폴더 내에 캐시 폴더를 생성합니다:

이제 훈련을 구성할 특수 파일을 생성합니다.

TOML 파일

Hunyuan Video LoRA의 훈련 및 사전 캐싱 프로세스는 평면 텍스트 파일에서 파일 경로를 얻습니다. 이 파일에는 .toml 확장자가 있습니다.

테스트의 TOML 파일은 C:\Users\Martin\Desktop\DATASETS_HUNYUAN\training.toml에 있습니다.

TOML 파일의 내용은 다음과 같습니다:

[general]

resolution = [512, 768]

caption_extension = ".txt"

batch_size = 1

enable_bucket = true

bucket_no_upscale = false

[[datasets]]

image_directory = "C:\\Users\\Martin\\Desktop\\DATASETS_HUNYUAN\\examplewoman"

cache_directory = "C:\\Users\\Martin\\Desktop\\DATASETS_HUNYUAN\\examplewoman\\cache"

num_repeats = 1

(이중 백슬래시는 경로에 공백이 있는 경우 오류를 방지하는 데 도움이 될 수 있지만 .toml 파일에서 전진 및 후진 슬래시를 사용하여 훈련 모델을 성공적으로 훈련시켰습니다)

resolution 섹션에서 두 가지 해상도가 고려된다는 것을 볼 수 있습니다. 512px와 768px입니다. 또한 512px로만 유지하고 여전히 좋은 결과를 얻을 수 있습니다.

캡션

Hunyuan Video는 텍스트+비전 기본 모델이므로 이러한 이미지에 대한 설명 캡션이 필요합니다. 훈련 프로세스는 캡션 없이 실패합니다.

이 작업을 위해 사용할 수 있는 오픈 소스 캡션 시스템이 많습니다. 그러나 간단하게 유지하기 위해 taggui 시스템을 사용할 것입니다. GitHub에 저장되어 있지만 첫 번째 실행 시 매우 무거운 딥 러닝 모델을 다운로드하며 간단한 Windows 실행 파일과 직관적인 GUI를 제공합니다.

Taggui를 시작하고 파일 > 디렉토리 불러오기를 사용하여 이미지 데이터셋으로 이동합니다. 캡션에 추가할 토큰 식별자(이 경우 examplewoman)를 입력할 수도 있습니다:

(처음 Taggui를 열면 4비트 로드를 끄십시오. 캡션 중에 오류가 발생할 수 있습니다)

왼쪽 미리 보기 열에서 이미지를 선택하고 모든 이미지를 선택하기 위해 Ctrl+A를 누릅니다. 그런 다음 오른쪽의 자동 캡션 시작 버튼을 누릅니다:

캡션을 다운로드하는 Taggui를 볼 수 있습니다. 그렇지 않으면 캡션의 미리 보기를 볼 수 있습니다.

이제 각 사진에는 이미지 내용에 대한 설명이 포함된 해당하는 .txt 캡션이 있습니다:

Taggui의 고급 옵션을 클릭하여 캡션의 길이와 스타일을 늘릴 수 있지만 그것은 이 튜토리얼의 범위를 벗어납니다.

Taggui를 종료하고…으로 이동합니다.

잠재적 사전 캐싱

훈련 시간에 과도한 GPU 부하를 피하기 위해 두 가지 유형의 사전 캐시 파일을 생성해야 합니다. 하나는 이미지에서 파생된 잠재적 이미지를 나타내고 다른 하나는 캡션 내용과 관련된 텍스트 인코딩을 평가합니다.

세 가지 프로세스(2x 캐시 + 훈련)를 간소화하려면 사용자에게 질문을 하고 프로세스를 수행하는 대화형 .BAT 파일을 사용할 수 있습니다.

잠재적 사전 캐싱을 위해 다음 텍스트를 Notepad에 복사하여 .BAT 파일(예: latent-precaching.bat)로 저장합니다.

@echo off

REM 가상 환경 활성화

call C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\Scripts\activate.bat

REM 사용자 입력

set /p IMAGE_PATH=이미지 디렉토리의 경로를 입력하세요:

set /p CACHE_PATH=캐시 디렉토리의 경로를 입력하세요:

set /p TOML_PATH=TOML 파일의 경로를 입력하세요:

echo 입력한 내용:

echo 이미지 경로: %IMAGE_PATH%

echo 캐시 경로: %CACHE_PATH%

echo TOML 파일 경로: %TOML_PATH%

set /p CONFIRM=잠재적 사전 캐싱을 진행하시겠습니까? (y/n)

if /i "%CONFIRM%"=="y" (

REM 잠재적 사전 캐싱 스크립트 실행

python C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\cache_latents.py --dataset_config %TOML_PATH% --vae C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\models\pytorch_model.pt --vae_chunk_size 32 --vae_tiling

) else (

echo 작업 취소.

)

REM 창을 열어둡니다.

pause

(사용자 프로필 이름을 실제 Windows 사용자 프로필 폴더 이름으로 바꿉니다)

이제 .BAT 파일을 실행하여 자동 잠재적 사전 캐싱을 수행할 수 있습니다:

.BAT 파일에서 질문을 받으면 이미지 데이터셋, 캐시 폴더 및 TOML 파일의 경로를 입력합니다.

텍스트 사전 캐싱

텍스트 사전 캐싱을 위한 두 번째 .BAT 파일을 생성합니다.

@echo off

REM 가상 환경 활성화

call C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\Scripts\activate.bat

REM 사용자 입력

set /p IMAGE_PATH=이미지 디렉토리의 경로를 입력하세요:

set /p CACHE_PATH=캐시 디렉토리의 경로를 입력하세요:

set /p TOML_PATH=TOML 파일의 경로를 입력하세요:

echo 입력한 내용:

echo 이미지 경로: %IMAGE_PATH%

echo 캐시 경로: %CACHE_PATH%

echo TOML 파일 경로: %TOML_PATH%

set /p CONFIRM=텍스트 인코더 출력 사전 캐싱을 진행하시겠습니까? (y/n)

if /i "%CONFIRM%"=="y" (

REM 가상 환경의 python 실행 파일 사용

python C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\cache_text_encoder_outputs.py --dataset_config %TOML_PATH% --text_encoder1 C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\models\llava_llama3_fp16.safetensors --text_encoder2 C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\models\clip_l.safetensors --batch_size 16

) else (

echo 작업 취소.

)

REM 창을 열어둡니다.

pause

(사용자 프로필 이름을 실제 Windows 사용자 프로필 폴더 이름으로 바꿉니다)

이전의 .BAT 파일과 마찬가지로 Notepad에서 저장하고 text-cache.bat(또는 원하는 이름)으로 저장합니다.

.BAT 파일을 실행하고 지침을 따르면 캐시 폴더에 필요한 텍스트 인코딩 파일이 나타납니다:

Hunyuan Video LoRA 훈련

LoRA 자체의 훈련은 두 가지 준비 프로세스보다 훨씬 더 오래 걸립니다.

여러 변수가 있지만(배치 크기, 반복, 에포크, 전체 또는 양자화 모델 사용 여부 등) 지금은 이러한 고려를 다음으로 미루고 LoRA 생성의 세부 사항을 더 깊이 조사해 보겠습니다.

median 설정으로 LoRA를 훈련시켜 보겠습니다.

.BAT 파일을 생성하여 훈련을 시작합니다. Notepad에 다음을 입력하고 training.bat(또는 원하는 이름)으로 저장합니다.

@echo off

REM 가상 환경 활성화

call C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\Scripts\activate.bat

REM 사용자 입력

set /p DATASET_CONFIG=데이터셋 구성 파일의 경로를 입력하세요:

set /p EPOCHS=에포크 수를 입력하세요:

set /p OUTPUT_NAME=출력 모델 이름을 입력하세요(예: example0001):

set /p LEARNING_RATE=학습률을 선택하세요(1: 1e-3, 2: 5e-3, 기본값: 1e-3):

if "%LEARNING_RATE%"=="1" set LR=1e-3

if "%LEARNING_RATE%"=="2" set LR=5e-3

if "%LEARNING_RATE%"=="" set LR=1e-3

set /p SAVE_STEPS=미리 보기 이미지를 저장할 빈도(단계)를 입력하세요:

set /p SAMPLE_PROMPTS=훈련 미리 보기에 대한 텍스트 프롬프트 파일의 위치를 입력하세요:

echo 입력한 내용:

echo 데이터셋 구성 파일: %DATASET_CONFIG%

echo 에포크 수: %EPOCHS%

echo 출력 이름: %OUTPUT_NAME%

echo 학습률: %LR%

echo 미리 보기 이미지를 저장할 빈도: %SAVE_STEPS% 단계

echo 텍스트 프롬프트 파일: %SAMPLE_PROMPTS%

REM 명령 준비

set CMD=accelerate launch --num_cpu_threads_per_process 1 --mixed_precision bf16 ^

C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\hv_train_network.py ^

--dit C:\Users\[사용자 프로필 이름]\Desktop\Musubi\musubi\musubi-tuner\models\mp_rank_00_model_states.pt ^

--dataset_config %DATASET_CONFIG% ^

--sdpa ^

--mixed_precision bf16 ^

--fp8_base ^

--optimizer_type adamw8bit ^

--learning_rate %LR% ^

--gradient_checkpointing ^

--max_data_loader_n_workers 2 ^

--persistent_data_loader_workers ^

--network_module=networks.lora ^

--network_dim=32 ^

--timestep_sampling sigmoid ^

--discrete_flow_shift 1.0 ^

--max_train_epochs %EPOCHS% ^

--save_every_n_epochs=1 ^

--seed 42 ^

--output_dir "C:\Users\[사용자 프로필 이름]\Desktop\Musubi\Output Models" ^

--output_name %OUTPUT_NAME% ^

--vae C:/Users/[사용자 프로필 이름]/Desktop/Musubi/musubi/musubi-tuner/models/pytorch_model.pt ^

--vae_chunk_size 32 ^

--vae_spatial_tile_sample_min_size 128 ^

--text_encoder1 C:/Users/[사용자 프로필 이름]/Desktop/Musubi/musubi/musubi-tuner/models/llava_llama3_fp16.safetensors ^

--text_encoder2 C:/Users/[사용자 프로필 이름]/Desktop/Musubi/musubi/musubi-tuner/models/clip_l.safetensors ^

--sample_prompts %SAMPLE_PROMPTS% ^

--sample_every_n_steps %SAVE_STEPS% ^

--sample_at_first

echo 다음 명령이 실행됩니다:

echo %CMD%

set /p CONFIRM=훈련을 진행하시겠습니까? (y/n)

if /i "%CONFIRM%"=="y" (

%CMD%

) else (

echo 작업 취소.

)

REM 창을 열어둡니다.

cmd /k

(사용자 프로필 이름을 실제 Windows 사용자 프로필 이름으로 바꿉니다)

.BAT 파일을 저장하고 C:\Users\[사용자 프로필 이름]\Desktop\Musubi\Output Models\ 디렉토리가 존재하는지 확인합니다. 존재하지 않으면 생성합니다.

훈련 미리 보기

Musubi 트레이너에는 훈련 미리 보기가 최근에 활성화되었습니다. 이는 훈련 모델이 일시적으로 중지되고 프롬프트에 따라 이미지를 생성하도록 강제하는 기능입니다. 이러한 이미지는 훈련 모델이 저장되는 동일한 디렉토리에 자동으로 생성되는 샘플 폴더에 저장됩니다.

이를 활성화하려면 훈련 미리 보기를 위한 텍스트 파일에 최소한 하나의 프롬프트를 저장해야 합니다. 훈련 .BAT 파일은 이 파일의 위치를 입력하도록 요청할 것입니다. 따라서 프롬프트 파일을 원하는 이름으로 저장할 수 있습니다.

다음은 훈련 미리 보기를 위한 텍스트 파일의 예입니다.

위의 예에서 볼 수 있듯이 프롬프트에 플래그를 추가하여 이미지를 수정할 수 있습니다:

–w는 너비(기본값 256px)

–h는 높이(기본값 256px)

–f는 프레임 수(1이면 이미지 생성, 1보다 크면 비디오 생성)

–d는 시드(설정하지 않으면 무작위, 설정하면 한 프롬프트의 진행을 볼 수 있음)

–s는 생성 단계 수(기본값 20)

공식 문서에서 추가 플래그를 참조하십시오.

훈련 미리 보기는 훈련을 취소하고 데이터 또는 설정을 재고하는 데 시간을节約할 수 있지만 각 추가 프롬프트는 훈련을 조금 더 느리게 만듭니다.

또한 훈련 미리 보기 이미지의 너비와 높이가 클수록 훈련을 더 느리게 만듭니다.

.BAT 파일을 실행합니다.

질문 #1은 ‘데이터셋 구성 파일의 경로를 입력하세요.’입니다. TOML 파일의 경로를 입력합니다.

질문 #2는 ‘에포크 수를 입력하세요.’입니다. 이는 에포크 수와 관련된 변수이며 이미지 및 캡션의 양과 품질, 기타 요인에 의해 영향을 받습니다. 일반적으로 낮게 설정하는 것보다 높게 설정하는 것이 좋습니다. 훈련이 충분히 진행되었다고 느껴지면 훈련 창에서 Ctrl+C를 눌러 훈련을 중지할 수 있습니다. 처음에는 100으로 설정하고 진행情况을 확인합니다.

질문 #3은 ‘출력 모델 이름을 입력하세요.’입니다. 모델에 이름을 붙입니다! 이름을 간단하게 유지하는 것이 좋습니다.

질문 #4은 ‘학습률을 선택하세요.’입니다. 이는 1e-3(선택지 1)로 기본값입니다. 이는 좋은 출발점입니다.

질문 #5은 ‘미리 보기 이미지를 저장할 빈도를 입력하세요.’입니다. 이 값을 너무 낮게 설정하면 미리 보기 이미지 저장 사이의 진행 상황이 거의 없을 수 있으며 이는 훈련을 더 느리게 만듭니다.

질문 #6은 ‘훈련 미리 보기의 텍스트 프롬프트 파일의 위치를 입력하세요.’입니다. 텍스트 파일의 경로를 입력합니다.

.BAT 파일은 Hunyuan 모델에 보낼 명령을 표시하고 진행 여부를 묻습니다.

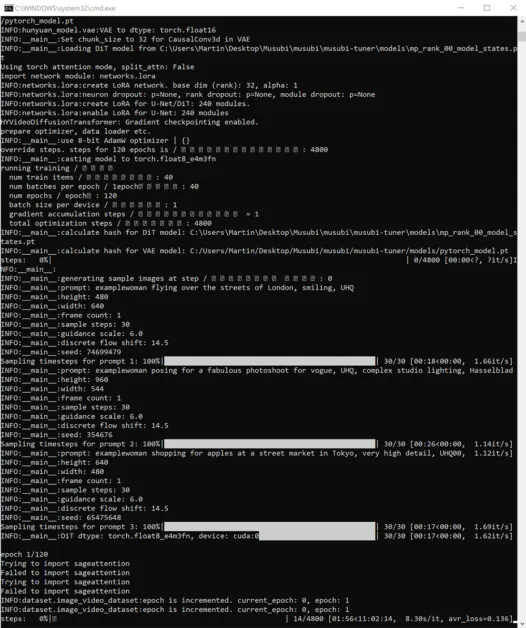

계속하여 훈련을 시작합니다:

이期间 Windows 작업 관리자의 성능 탭의 GPU 섹션을 확인하면 프로세스가 약 16GB의 VRAM을 사용하는 것을 볼 수 있습니다.

이 숫자는 임의의 숫자가 아닐 수 있으며 NVIDIA 그래픽 카드에서 상당히 많은 카드가 16GB의 VRAM을 갖고 있기 때문에 업스트림 코드가 이러한 작업을 16GB로 최적화했을 수 있습니다.

그러나 이 사용량을 쉽게 늘릴 수 있으며 훈련 명령에 더 과한 플래그를 보낼 수 있습니다.

훈련 중에 CMD 창의 하단 오른쪽에 훈련 시작 이후 경과 시간과 예상 총 훈련 시간(플래그 설정, 훈련 이미지 수, 훈련 미리 보기 이미지 수, 기타 요인에 따라 크게 다를 수 있음)이 표시됩니다.

일반적인 훈련 시간은 중간 설정에서 약 3-4시간입니다. 하드웨어, 이미지 수, 플래그 설정, 기타 요인에 따라 다를 수 있습니다.

Hunyuan Video에서 훈련된 LoRA 모델 사용

체크포인트 선택

훈련이 완료되면 각 훈련 에포크에 대한 모델 체크포인트가 생성됩니다.

이 저장 빈도는 사용자가 --save_every_n_epochs [N] 숫자를 수정하여 더 자주 또는 덜 자주 저장할 수 있습니다. 훈련을 설정할 때 steps-per-saves를 낮게 설정한 경우 많은 체크포인트 파일이 생성됩니다.

어떤 체크포인트를 선택해야 합니까?

훈련 초기 모델은 더 유연하지만 나중에 저장된 체크포인트는 더 많은 세부 정보를 제공할 수 있습니다. 이러한 요인에 대한 테스트는唯一한 방법입니다. 일부 LoRAs를 실행하고 몇 개의 비디오를 생성하여 어떤 체크포인트가 가장 생산적이고 신뢰성 및 충실도 사이에서 가장好的 균형을 제공하는지 확인합니다.

ComfyUI

현재 Hunyuan Video LoRAs를 사용하는 가장 인기 있는 환경은 ComfyUI입니다. 웹 브라우저에서 실행되는 노드 기반 편집기와 정교한 Gradio 인터페이스가 있습니다.

출처: https://github.com/comfyanonymous/ComfyUI

설치 지침은 간단하며 공식 GitHub 저장소에서 사용할 수 있습니다(추가 모델을 다운로드해야 할 수 있음).

ComfyUI용 모델 변환

훈련된 모델은 ComfyUI와 호환되지 않는(diffusers) 형식으로 저장됩니다. Musubi는 모델을 ComfyUI와 호환되는 형식으로 변환할 수 있습니다. 이를 위한 .BAT 파일을 설정해 보겠습니다.

.BAT 파일을 실행하기 전에 C:\Users\[사용자 프로필 이름]\Desktop\Musubi\CONVERTED\ 폴더를 생성합니다. 스크립트에서 이 폴더가 ож