Andersonの視点

‘保護’画像は、より容易に、むしろ困難に、AIで盗まれる

新しい研究によると、AI画像編集をブロックすることを目的としたウォーターマークツールは、逆効果をもたらす可能性がある。Stable Diffusionなどのモデルに対する変更を停止させるのではなく、一部の保護は実際にAIが編集プロンプトに従うのを助けるため、望ましくない操作がさらに容易になる。

コンピュータビジョンの分野には、著作権画像をAIモデルにトレーニングしたり、画像>画像AIプロセスで使用したりするのを防ぐための研究が存在する。こうしたシステムは一般的に、Latent Diffusion Models(LDMs)と呼ばれるものに対して機能し、Stable DiffusionやFluxなどのモデルが含まれる。これらのモデルは、ノイズベースの手法を使用して画像をエンコードおよびデコードする。

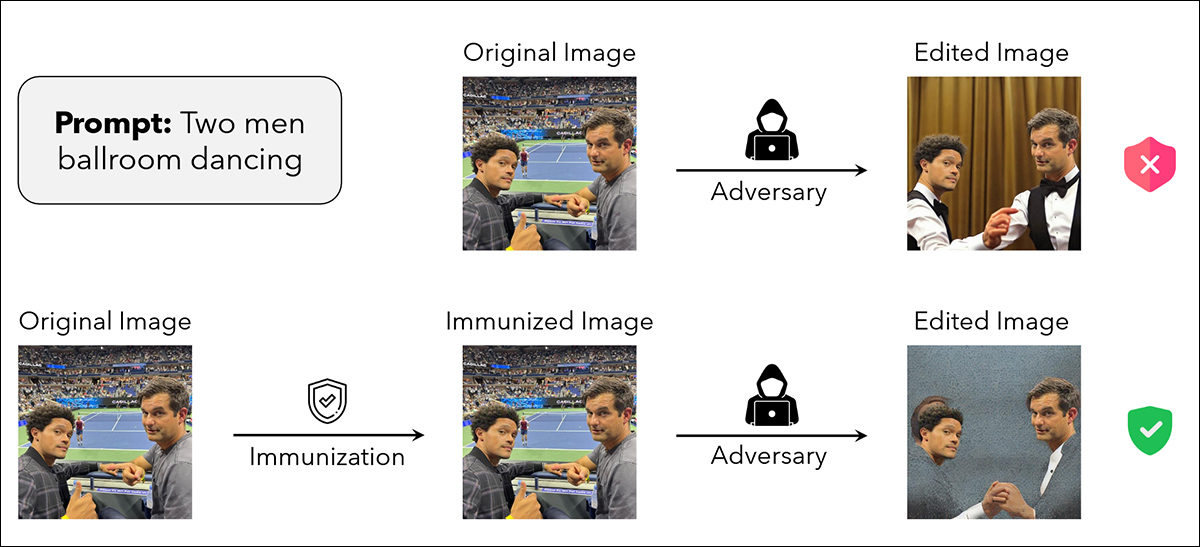

通常の画像にアドバーサリアルノイズを挿入することで、画像検出器が画像の内容を誤って推測したり、画像生成システムが著作権データを利用できないようにすることが可能になる。

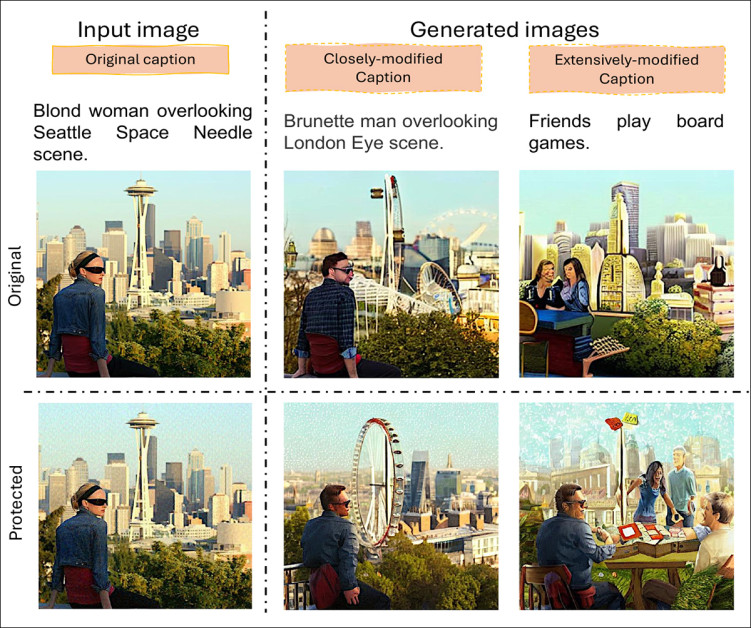

MITの論文『Raising the Cost of Malicious AI-Powered Image Editing』から、操作に対して「免疫」を付与されたソース画像の例(下行)。ソース:https://arxiv.org/pdf/2302.06588

2023年にStable Diffusionがウェブスクラップされた画像(著作権画像を含む)を自由に使用したことに対するアーティストの反発以来、研究シーンは同じテーマの多くのバリエーションを生み出してきた。つまり、画像をAIシステムにトレーニングしたり、生成的なAIパイプラインに吸い込まれたりするのを防ぐために、画像を目に見えないように「毒」付けることができるという考えである。

すべてのケースで、課せられたペルターブの強度と、画像が保護される程度、および画像が予想通り良く見えない程度との間には直接的な相関関係がある。

研究PDFの品質が完全には問題を示していないが、より多くのアドバーサリアルペルターブを犠牲にしてセキュリティを犠牲にする。ここでは、シカゴ大学が主導する2020年の『Fawkes』プロジェクトでの品質の乱れの範囲が見られる。ソース:https://arxiv.org/pdf/2002.08327

アーティストが自分のスタイルを無許可の転用から守ろうとする観点から、こうしたシステムがアイデンティティやその他の情報を隠蔽するだけでなく、AIトレーニングプロセスを欺くことができることは特に興味深い。つまり、保護されたトレーニングデータ(たとえば、『パウル・クレーのスタイルで』というプロンプト)について、セマンティックドメインと視覚ドメインの間で接続が形成されないようにすることができる。

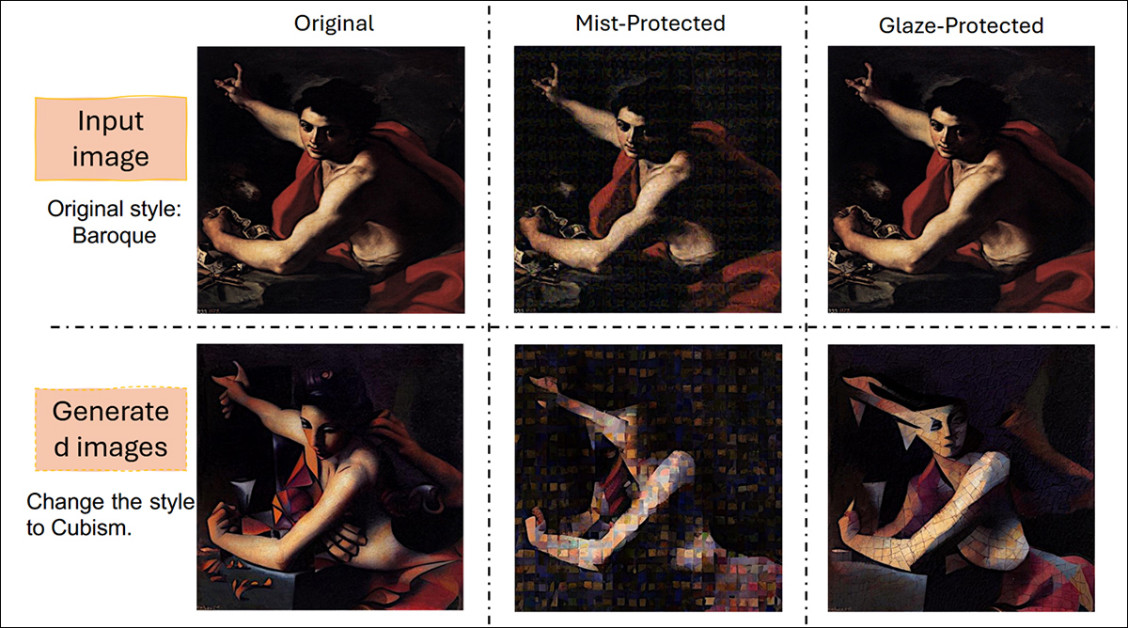

MistとGlazeは、AIワークフローとトレーニングルーチンで著作権スタイルを使用する試みを防止または大幅に妨げることができる2つの一般的なインジェクション方法。ソース:https://arxiv.org/pdf/2506.04394

オウンゴール

現在、アメリカからの新しい研究によって、ペルターブが画像を保護できないだけでなく、ペルターブを追加することで実際に画像の悪用可能性を向上させることができることが発覚した。

論文では次のように述べられている。

『私たちの実験では、さまざまなペルターブベースの画像保護方法が、複数のドメイン(自然シーン画像とアートワーク)と編集タスク(画像から画像への生成とスタイル編集)で機能しなかったことがわかった。』

『ほとんどのシナリオでは、保護された画像の拡散ベースの編集によって、ガイダンスプロンプトに厳密に従った望ましい出力画像が生成される。』

『私たちの調査結果は、画像にノイズを追加することで、生成プロセス中に与えられたテキストプロンプトとの関連性が逆に高まる可能性があることを示唆しており、より良い編集結果につながる。』

『したがって、私たちは、ペルターブベースの方法が拡散ベースの編集に対する画像保護に十分な解決策を提供しない可能性があると主張する。』

テストでは、保護された画像が2つの一般的なAI編集シナリオにさらされた。シンプルな画像から画像への生成とスタイル転送である。これらのプロセスは、AIモデルが保護されたコンテンツをどのように悪用するかを反映している。直接画像を変更するか、スタイル的特徴を別の場所で使用するかである。

保護された画像は、標準的な写真とアートワークのソースから抽出され、AIパイプラインを通過して、追加されたペルターブが編集をブロックまたは劣化させるかどうかを確認するために使用された。

代わりに、保護の存在はしばしばモデルのプロンプトとの一致を鋭敏にし、予想とは逆に、クリーンで正確な出力を生成した。

著者は、実質的に、この非常に人気のある保護方法が誤った安心感を提供している可能性があり、すべてのペルターブベースの免疫アプローチが著者の方法に対して徹底的にテストされるべきであるとアドバイスしている。

方法

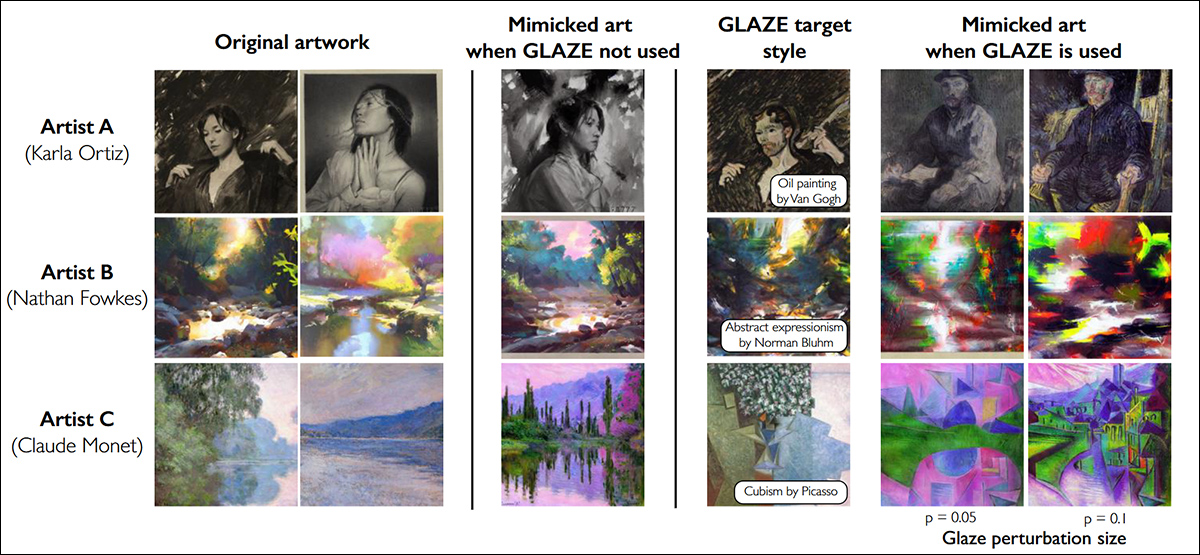

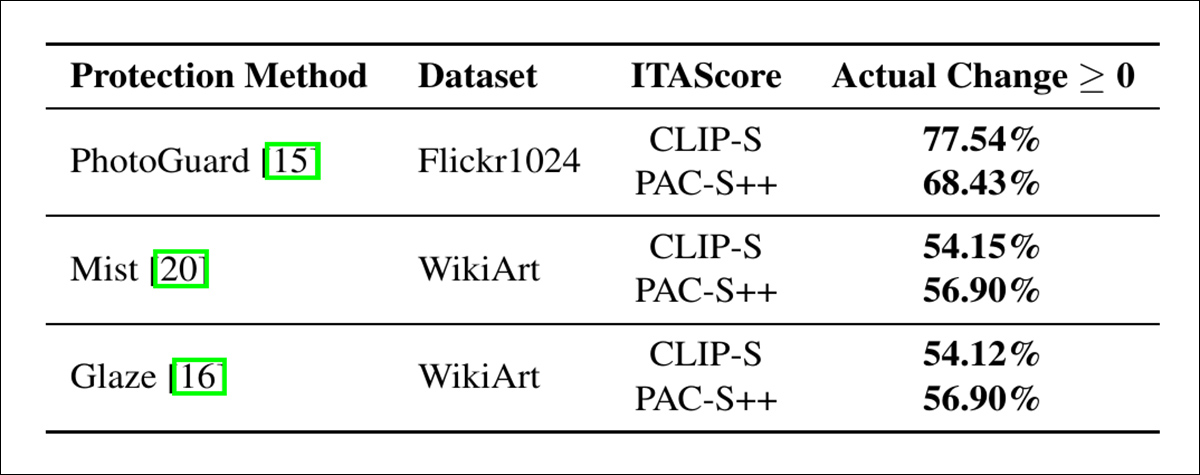

著者は、PhotoGuard;Mist;およびGlazeの3つの保護方法を使用して実験を行った。これらの方法は、慎重に設計されたアドバーサリアルペルターブを適用する。

著者によってテストされたフレームワークの1つであるGlaze。3人のアーティストのGlaze保護例。最初の2列はオリジナルのアートワークを示し、3列目は保護なしでのミミック結果を示し、4列目はクローク最適化に使用されたスタイル転送バージョンとターゲットスタイル名を示し、5列目と6列目はペルターブレベル p = 0.05および p = 0.1でクロークが適用されたミミック結果を示している。すべての結果はStable Diffusionモデルを使用している。https://arxiv.org/pdf/2302.04222

PhotoGuardは自然シーン画像に適用され、MistとGlazeはアートワーク(「アーティスティックスタイル」のドメイン)に使用された。

テストでは、各方法の有効性を評価するために、AIモデルが保護された画像で現実的な編集を生成できるかどうかを確認した。生成された画像が信頼性が高く、プロンプトに一致していた場合、保護は失敗したと判断された。

Stable Diffusion v1.5が、研究者の編集タスクの事前トレーニング済み画像ジェネレータとして使用された。再現性を確保するために、5つのシードが選択された:9222、999、123、66、42。生成の他のすべての設定(ガイダンススケール、強度、合計ステップ数など)は、PhotoGuardの実験で使用されるデフォルト値に従った。

PhotoGuardは、Flickr8kデータセットを使用して自然シーン画像でテストされた。このデータセットには、5つのキャプションが付与された8,000以上の画像が含まれている。

反対の考え

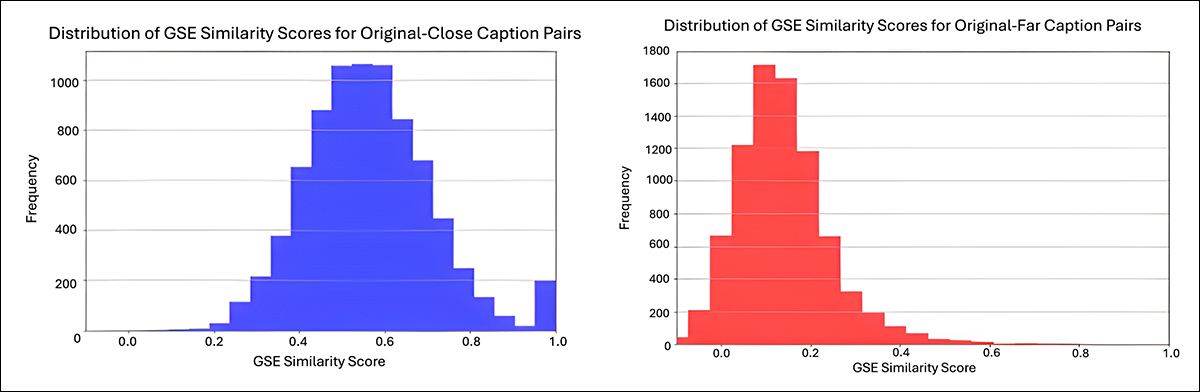

2つの修正キャプションセットが、各画像の最初のキャプションから、Claude Sonnet 3.5の助けを借りて作成された。1つのセットには、『文脈的に近い』プロンプトが含まれ、もう1つのセットには、『文脈的に遠い』プロンプトが含まれていた。

たとえば、オリジナルのキャプション『ピンクのドレスを着た若い女の子が木の小屋に入る』から、近いプロンプトは『青いシャツを着た若い男の子がレンガの家に入る』となり、対照的に、『遠い』プロンプトは『ソファーに寝ている2匹の猫』となる。

近いプロンプトは、名詞と形容詞を意味的に類似した用語に置き換えることで構築され、遠いプロンプトは、モデルに、文脈的に非常に異なるキャプションを生成するように指示することで生成された。

生成されたすべてのキャプションは、品質とセマンティック関連性のために手動で確認された。GoogleのUniversal Sentence Encoderを使用して、オリジナルと修正されたキャプションの間のセマンティック類似度スコアを計算した。

Flickr8kテストで使用された修正キャプションのセマンティック類似度分布。左側のグラフは、約0.6の平均で近似的に修正されたキャプションの類似度スコアを示している。右側のグラフは、約0.1の平均で、オリジナルのキャプションからより大きなセマンティック距離を反映している。値はGoogleのUniversal Sentence Encoderを使用して計算された。ソース:https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

各画像とその保護バージョンは、近いプロンプトと遠いプロンプトの両方で編集された。Blind/Referenceless Image Spatial Quality Evaluator(BRISQUE)を使用して画像の品質を評価した。

PhotoGuardで保護された自然写真の画像から画像への生成結果。ペルターブの存在にもかかわらず、Stable Diffusion v1.5は編集プロンプトの小さなおよび大きなセマンティック変更の両方に成功して、新しい指示に一致するリアルな出力を生成した。

メトリック

AI編集を妨げる保護の有効性を判断するために、研究者は、生成された画像が与えられた指示にどれだけ一致するかを測定するスコアリングシステムを使用した。画像のコンテンツとテキストプロンプトの類似性を比較して、一致性を確認した。

この目的のために、CLIP-Sメトリックは、画像とテキストの両方を理解できるモデルを使用して、どれだけ類似しているかを確認する。さらに、PAC-S++は、人間の推定に近い比較を可能にするために、AIによって生成された追加サンプルを使用する。

これらの画像テキストの整列(ITA)スコアは、保護された画像が編集されたときに、AIが指示にどれだけ従ったかを示す。保護された画像が依然として高く一致した出力を生成した場合、保護は編集をブロックすることに失敗したと判断される。

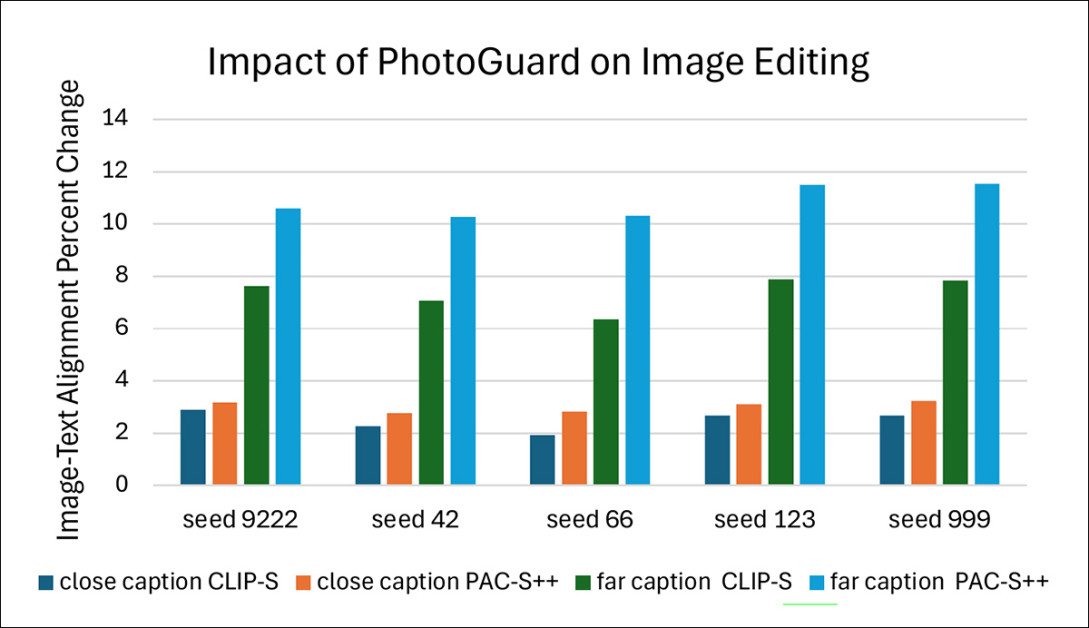

5つのシードと近いおよび遠いプロンプトを使用したFlickr8kデータセットへの保護の影響。画像テキストの整列はCLIP-SとPAC-S++スコアを使用して測定された。

研究者は、保護された画像と保護されていない画像を編集したときに、AIがプロンプトにどれだけ従ったかを比較検討した。最初に、2つの間の実際の変更を調べた。次に、差をスケール化してパーセンテージ変更を作成し、結果を比較しやすくした。

このプロセスは、保護がAIがプロンプトに従うのをより困難にしたか、より容易にしたかを明らかにした。テストは、近い変更と遠い変更の両方をカバーするために、5つの異なるランダムシードを使用して繰り返された。

アートアタック

自然写真のテストでは、Flickr1024データセットが使用された。このデータセットには、1,000以上の高品質画像が含まれている。各画像は、『スタイルを[V]に変更』というパターンのプロンプトで編集された。ここで、[V]は、キュビズム、後期印象派、印象派、シュルレアリスム、バロック、ファウヴ、ルネサンスの7つの有名なアートスタイルの1つを表した。

プロセスには、PhotoGuardをオリジナルの画像に適用して保護されたバージョンを生成し、保護された画像と保護されていない画像の両方を同じセットのスタイル転送編集を通すことが含まれた。

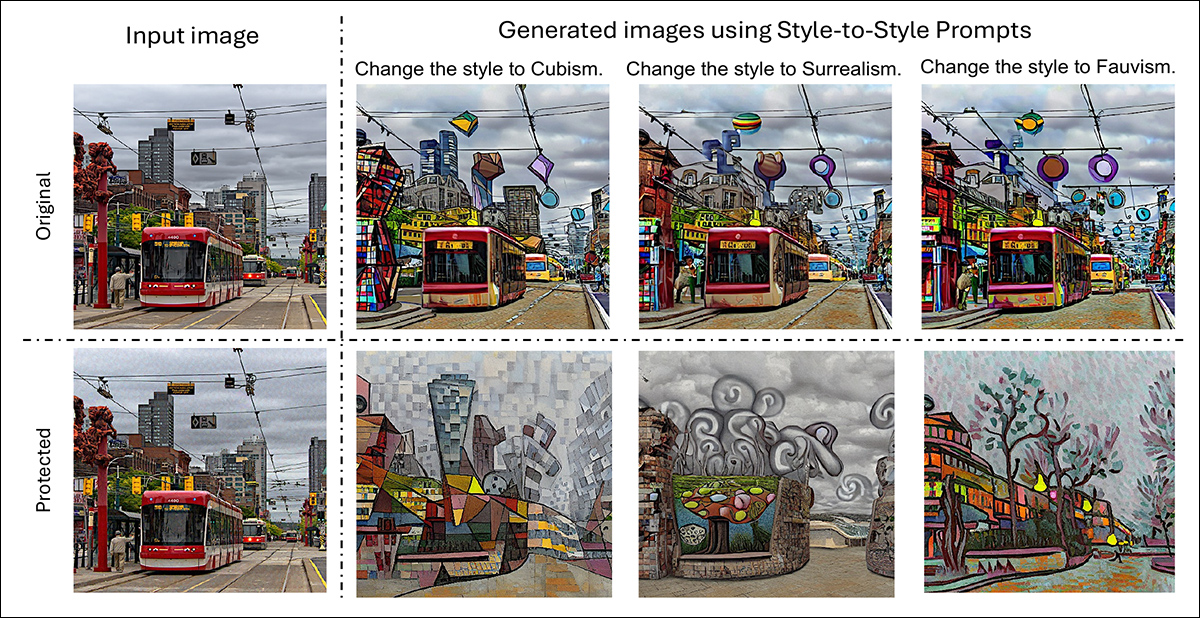

キュビズム、シュルレアリスム、ファウヴのスタイルを適用した、オリジナルの自然シーン画像と保護されたバージョン。

アートワークでの保護方法のテストには、幅広いアートスタイルのカタログであるWikiArtデータセットが使用された。編集プロンプトは、前にと同様の形式で、AIに、ランダムに選択された、無関係なスタイル(WikiArtのラベルから抽出)にスタイルを変更するように指示した。

MistとGlazeの両方の保護方法が画像に適用され、研究者は各防御がスタイル転送結果をどれだけ妨げるか、歪めるかを観察することができた。

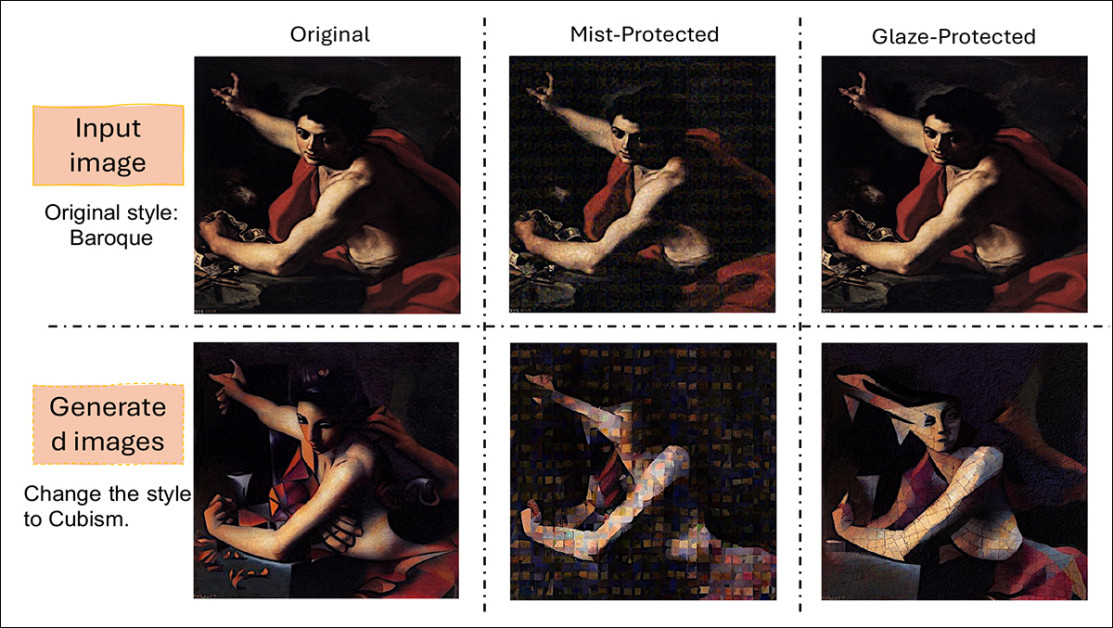

保護方法がアートワークでのスタイル転送に与える影響の例。オリジナルのバロック画像は、MistとGlazeで保護されたバージョンとともに表示される。キュビズムスタイル転送を適用した後、各保護が最終出力をどのように変更するかがわかる。

研究者は、比較を数量的にもテストした。

スタイル転送編集後の画像テキスト整列スコアの変更。

これらの結果について、著者は次のように述べている。

『結果は、対立的なペルターブの保護における重大な制限を強調している。対立的なペルターブは、生成モデルがプロンプトに反応するのを妨げるのではなく、実際には生成モデルがプロンプトに反応するのを助けることが多く、悪意のあるエージェントが無許可の素材をコピーして出力が生成されるのを防ぐことができない。』

『対立的なペルターブの使用の意図しない結果は、既存の方法の脆弱性を暴き、より効果的な保護技術の必要性を強調している。』

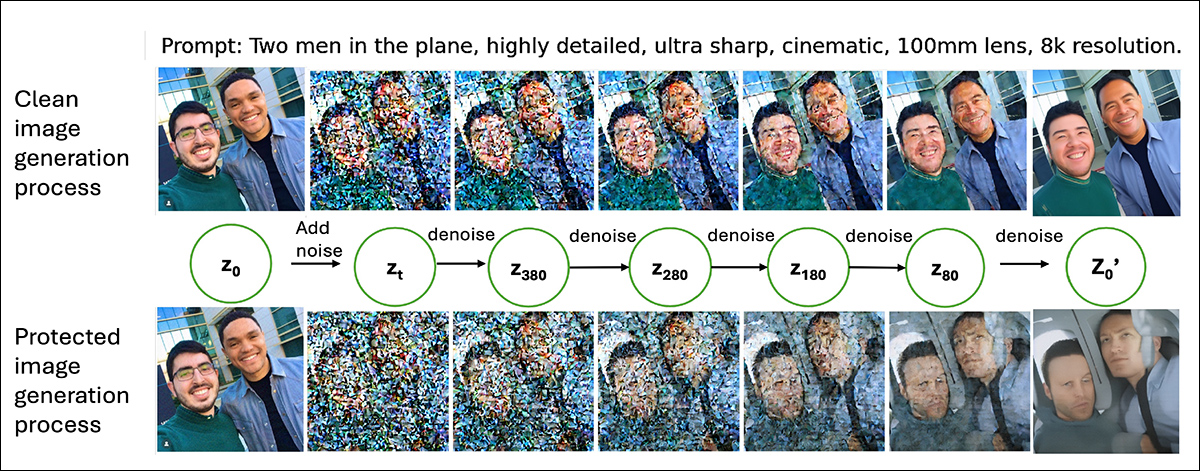

著者は、これらの予想外の結果は、拡散モデルがどのように機能するかによって説明できることを説明している。LDMは、画像を編集するために、まず画像を圧縮されたバージョンである潜在的なものに変換する。次に、多くのステップを経て、ノイズが追加され、データがほぼランダムになるまで続く。

モデルは、生成中にこのプロセスを逆に実行し、ノイズを段階的に除去する。各段階で、テキストプロンプトがノイズをどのようにクリーンアップするかを導くのに役立つ。

保護されていない画像とPhotoGuardで保護された画像からの生成の比較。中間の潜在的な状態を画像に戻して視覚化した。

保護方法は、プロセスに入る前に画像に少量の追加ノイズを加える。最初はこれらのペルターブは小さくても、モデルのレイヤーが追加されるにつれて蓄積される。

このビルドアップにより、モデルがノイズを除去を開始するときに、画像のより多くの部分が「不確実」になる。より多くの不確実性があると、モデルはプロンプトに頼ることが多くなり、プロンプトに通常よりもさらに多くの影響力を与える。

実質的に、保護はAIが画像をプロンプトに合わせて変更するのをより容易にし、より困難にしにくくする。

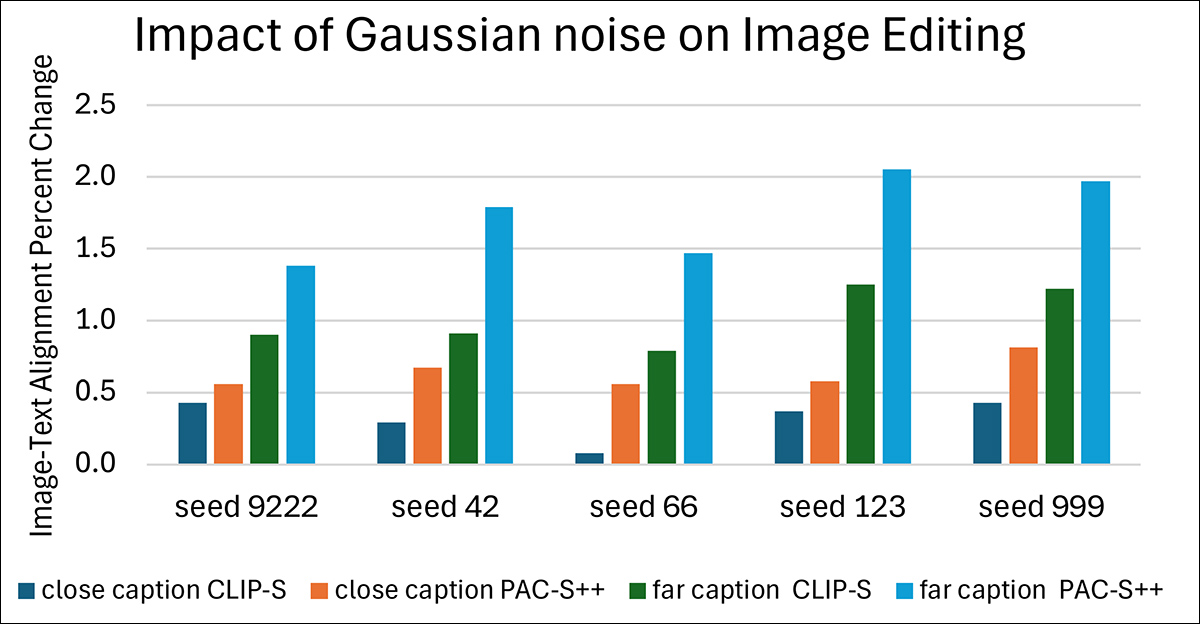

最後に、著者は、『悪意のあるAI駆動の画像編集のコストを上げる』論文から作成されたペルターブを、純粋なガウシアンノイズに置き換えるテストを実行した。

結果は以前と同じパターンに従った。すべてのテストで、パーセンテージ変更の値は正のままだった。ランダムで構造化されていないノイズさえも、生成された画像とプロンプトの間のより強い一致につながった。

Flickr8kデータセットでの保護のシミュレーションによるガウシアンノイズの影響。

これは、追加されたノイズが、生成中のモデルに不確実性を生み出し、テキストプロンプトが最終画像をさらにコントロールできるようにするという根本的な説明を裏付けた。

結論

LDMの著作権問題に対するアプローチとして、研究シーンはLDMが存在するほぼ同じ期間、対立的なペルターブを押し進けてきた。しかし、頑健な解決策は、発表された膨大な数の論文から現れていない。

課せられた乱れは、画像の品質を過度に低下させ、またはパターンが操作や変換プロセスに対して堅牢でない。

しかし、これは放棄するのが難しい夢である。なぜなら、代替案は、Adobeが主導するC2PAスキームのような、サードパーティの監視と出典フレームワークを必要とするからである。これは、カメラセンサーから画像の生成まで、画像の連鎖を維持することを目的としているが、画像の内容とは無関係である。

いずれにせよ、対立的なペルターブが実際に問題を悪化させることがあることが、新しい論文によって示唆されているのであれば、こうした手段によって著作権保護を探求することは「錬金術」に相当するのではないか。

初めて発行されたのは、2025年6月9日月曜日