人工知能

私たちの潜在的なディープフェイク検出スキルは、将来の自動化システムを支える可能性がある

オーストラリアからの新しい研究によると、私たちの脳は、複雑なディープフェイクを認識することにうまく、意識的に見ている画像が実際に本当のものであると信じている場合でもです。

この発見はさらに、ディープフェイク顔(ではなく、人の意見)に対する人の神経反応を使用して、自動化されたディープフェイク検出システムを訓練する可能性を示唆しています。そうしたシステムは、画像のディープフェイクの特徴から訓練されるでしょう。つまり、妥当性の混乱した推定ではなく、顔認識の直感的な認識メカニズムから訓練されるでしょう。

‘[A]lthough the brain can ‘recognise’ the difference between real and realistic faces, observers cannot consciously tell them apart. Our findings of the dissociation between brain response and behaviour have implications for how we study fake face perception, the questions we pose when asking about fake image identification, and the possible ways in which we can establish protective standards against fake image misuse.’

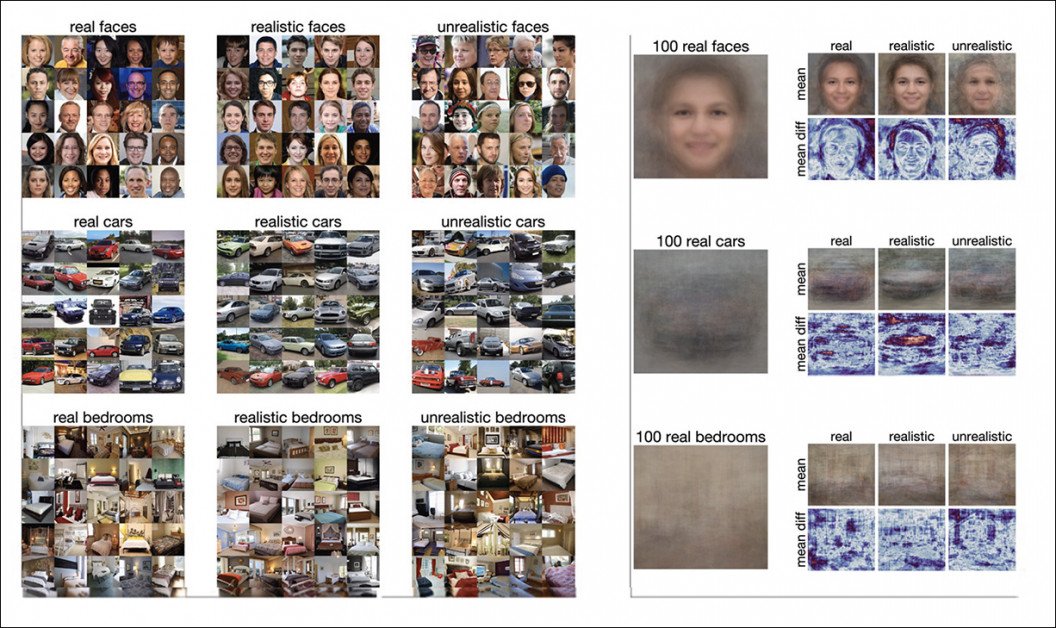

この結果は、明らかに偽の顔、車、インテリアスペース、逆さま(つまり上下逆)の顔などの偽の画像に対する人々の反応を評価するように設計されたテストのラウンドで出現しました。

さまざまなイテレーションとアプローチの実験、2つのテストサブジェクトのグループが、短時間表示された画像を「偽物」または「本物」として分類する必要がありました。最初のラウンドは、Amazon Mechanical Turkで200人のボランティアとともに実施され、2回目のラウンドでは、より小さなボランティアのグループが、EEGマシンに接続されたままテストに反応しました。 Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

論文は主張しています:

‘私たちの結果は、わずかな瞬間で、観察者は偽の顔を見つけることができることを示しています。ただし、偽の顔を本物の顔から区別することはより困難であり、場合によっては、偽の顔をより本物の顔として信じることがあります。

‘しかし、時間分解EEGと多変量パターン分類法を使用して、リアルな顔と偽の顔の両方を脳活動を使用してデコードすることが可能であることを発見しました。

‘この、行動と神経反応の乖離は、偽の顔認識について新たな証拠を提供し、また、GANによって生成された顔のリアルなクラスの増加についても意味のある影響を与えます。’

この論文は、新しい研究は「いくつかの意味での」サイバーセキュリティへの応用があることを示唆しており、ディープフェイク学習分類器の開発は、画像の真実性についての視聴者の意識的な推定ではなく、EEG読み取りによる潜在的な反応によって推進されるべきであると述べています。

著者はコメントしています:

‘これは、顔認識障害を持つ個人が、行動的に顔認識や認知をできないにもかかわらず、知覚できない顔に対してより強い自律神経反応を示すという発見と似ています。

‘同様に、私たちの研究で示したように、脳活動からリアルな顔とリアルな顔の違いを正確にデコードすることができたのに対し、行動的にはその違いは見られませんでした。代わりに、観察者は69%の本物の顔を偽物であると誤って識別しました。’

この新しい研究は、シドニー大学、マッコーリー大学、ウエスタンシドニー大学、クイーンズランド大学の4人の研究者によるもので、Are you for real? Decoding realistic AI-generated faces from neural activityというタイトルが付けられています。

データ

結果は、明らかに偽のもの、超リアルなもの(しかしまだ偽のもの)、そして実際の画像を区別する人間の能力を調べるより広範な調査から生まれました。

研究者は、NVIDIAによって共有された、GANsによって生成された画像を使用しました。

NVIDIAによって提供されたGAN生成の人間の顔画像。 Source: https://drive.google.com/drive/folders/1EDYEYYR3IB71-5BbTARQkhg73leVB9tam

データは、25の顔、車、ベッドルーム、レンダリングのレベルが「非リアル」から「リアル」までの範囲で構成されていました。顔の比較(つまり、適切な非偽造物質)については、著者はNVIDIAのFlickr-Faces-HQ(FFHQ)データセットのソースデータの選択を使用しました。他のシナリオの比較については、LSUNデータセットの素材を使用しました。

画像は最終的に、正しい向きまたは逆さまで、さまざまな周波数でテストサブジェクトに提示され、すべての画像は256×256ピクセルにリサイズされました。

すべての素材が集められると、テストのために450の刺激画像がキュレーションされました。

テスト

テスト自体は、jsPsychを使用して、pavlovia.orgでオンラインで実施され、200人の参加者がさまざまなサブセットのテストデータを評価しました。画像は200ミリ秒間表示され、その後、空の画面が表示されるまで、視聴者が「偽物」または「本物」として判断するまで続きました。各画像は1回だけ提示され、テスト全体は3〜5分で完了しました。

2回目のテストは、より明らかなもので、EEGモニターに接続された被験者を使用し、Psychopy2プラットフォームで提示されました。各20のシーケンスには40の画像が含まれ、テストデータ全体で18,000の画像が提示されました。

収集されたEEGデータは、MATLABとCoSMoMVPAツールボックスを使用して、leave-one-out cross-validationスキームの下でLinear Discriminant Analysis(LDA)を使用してデコードされました。

LDA分類器は、偽の刺激に対する脳の反応と、被験者の画像が偽物であるかどうかの意見を区別することができるコンポーネントでした。

結果

EEGテストの被験者が偽の顔と本物の顔を区別できるかどうかを調べるために、研究者は結果を集計して処理し、参加者は偽の顔とリアルな顔を容易に区別できることがわかりましたが、リアルなGAN生成の偽の顔は区別するのが難しいようです。画像が逆さまかどうかは、ほとんど違いはありませんでした。

2回目のラウンドでの、実際の顔と合成生成された顔の行動的区別。

しかし、EEGデータは別の話でした。

論文は述べています:

‘観察者は、実際の顔と偽の顔を区別するのに苦労し、偽の顔を過剰に分類する傾向がありましたが、EEGデータには、リアルな顔と非リアルな顔の違いを示す信号情報が含まれており、この信号は、処理の比較的短い段階に制限されていたようです。 ‘

ここでは、EEGの精度と被験者の意見(画像が偽物かどうか)の違いは同一ではなく、EEGキャプチャは被験者の認識よりも真実に近くなっています。

研究者は、観察者は偽の顔を暗黙的に識別できないかもしれませんが、偽の顔には「人間の視覚システムに独特の表現」があると結論付けています。

この乖離は、研究者に将来のセキュリティメカニズムへの彼らの発見の潜在的な応用について推測させました:

‘サイバーセキュリティやディープフェイクのような応用設定では、リアルな顔の検出能力を調べることが、行動的パフォーマンスを標的にするのではなく、神経イメージングデータに適用されたマシンラーニング分類器によって最もよく追求されるかもしれません。 ‘

彼らは結論付けます:

‘偽の顔検出のための脳と行動の乖離を理解することは、人工的に生成された情報の潜在的に有害で普遍的な拡散に対処する方法について、実用的意味をもたらすでしょう。 ‘

* 私のインライン引用のハイパーリンクへの変換。

初めて公開されたのは2022年7月11日です。