人工知能

NeRF: ニューラル・ラディアンス・フィールドを用いたドローンのトレーニング

スタンフォード大学の研究者は、Neural Radiance Fields (NeRF) に対する最近の関心の増大を利用して、ドローンを写真のようにリアルな環境でナビゲートさせる新しい方法を開発しました。

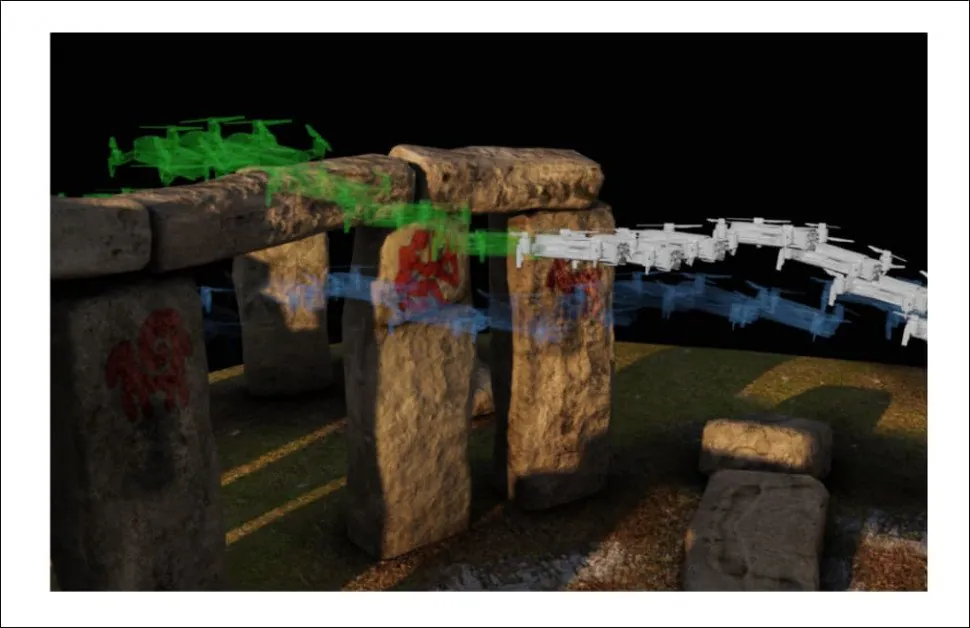

ドローンは、リアルなロケーションから直接マッピングされた仮想環境でトレーニングできます。専用の3Dシーン再構築は不要です。この画像では、風の乱れが潜在的な障害として追加されており、ドローンが一時的に軌道から外れ、最後の瞬間には潜在的な障害を避けるために補正しています。 ソース: https://mikh3x4.github.io/nerf-navigation/

この方法により、ドローン(または他のタイプのオブジェクト)は、ボリューム情報(衝突回避の計算)、写真から直接描画されたテクスチャ(ドローンの画像認識ネットワークをよりリアルにトレーニングするため)、リアルな照明(ネットワークにさまざまな照明シナリオをトレーニングするため、過学習や過剰最適化を避けるため)を含む仮想シナリオでインタラクティブにトレーニングできます。

コーチ・オブジェクトが、従来のAR/VRワークフローでは幾何学的キャプチャとリテクスチャリングでマッピングするのが非常に難しい複雑な仮想環境をナビゲートしています。ただし、NeRFから限られた数の写真から自動的に再現されました。 ソース: https://www.youtube.com/watch?v=5JjWpv9BaaE

典型的なNeRFの実装には、トラジェクトリ・メカニズムが含まれておらず、過去18ヶ月のNeRFプロジェクトの大部分は、シーンのリライティング、リフレクション・レンダリング、コンポジット、およびキャプチャされた要素の分離などの他の課題に集中しています。したがって、新しい論文の主な革新は、NeRF環境をナビゲーション可能な空間として実装することであり、3D環境としてモデル化するために必要な広範な装置と手間のかかる手順は不要です。

NeRF as VR/AR

新しい論文は、ビジョン・オンリー・ロボット・ナビゲーション・イン・ア・ニューラル・ラディアンス・ワールドというタイトルで、スタンフォード大学の3つの学部(航空宇宙工学、機械工学、コンピューター・サイエンス)による共同研究です。

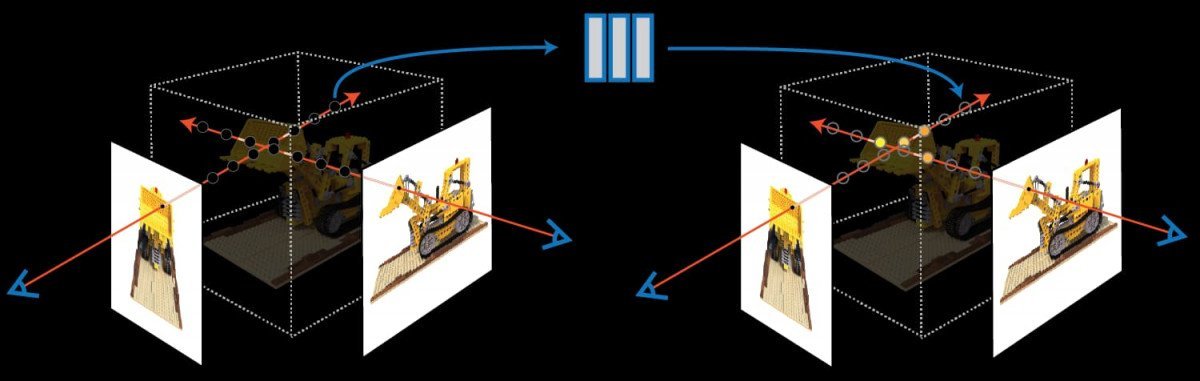

この研究では、ロボットに事前にトレーニングされたNeRF環境を提供するナビゲーション・フレームワークを提案しています。ボリューム密度はデバイスの可能なパスを定義し、ロボットのオンボードRGBカメラの画像認識に基づいてロボットが仮想環境内でどこにあるかを推定するフィルタも含まれています。こうして、ドローンまたはロボットは与えられた環境で何が見えるかをより正確に「妄想」できます。

プロジェクトのトラジェクトリ・オプティマイザーが、写真測量と画像解釈(この場合はメッシュ・モデル)を通じてニューラル・ラディアンス・環境に生成されたストーンヘンジのNeRFモデルをナビゲートしています。トラジェクトリ・プランナーは、アーチの上で最適なトラジェクトリを確立する前に、可能なパスを計算します。

NeRF環境には完全にモデル化されたオクルージョンが含まれているため、ドローンはオブストラクションをより簡単に計算できます。NeRFの背後にあるニューラル・ネットワークは、オクルージョンとドローンのオンボード・ビジョン・ベースのナビゲーション・システムが環境を認識する方法の関係をマッピングできます。自動NeRF生成パイプラインは、わずか数枚の写真でハイパー・リアルなトレーニング・スペースを作成する比較的容易な方法を提供します。

スタンフォード・プロジェクトで開発されたオンライン・リプランニング・フレームワークは、堅牢で完全にビジョン・ベースのナビゲーション・パイプラインを提供します。

スタンフォードのイニシアチブは、NeRF空間をナビゲーション可能で没入感のあるVRスタイルの環境の文脈で探索する可能性を検討する最初のものです。Neural Radiance Fieldsは、現時点で最先端の技術であり、高い計算リソース要件の最適化や、キャプチャされた要素の分離など、多くの学術的努力の対象となっています。

Nerf Is Not (Really) CGI

NeRF環境はナビゲーション可能な3Dシーンであるため、2020年の登場以来、CGIの自動化された作成方法ではなく、3D環境の代替手段として広く誤解されてきました。

NeRFは、幾何学的情報とテクスチャ情報を、限られた数の画像視点から抽出して、画像間の差を体積情報として計算します。 ソース: https://www.matthewtancik.com/nerf

実際、NeRF環境は「ライブ」レンダリング空間のように機能し、ピクセル情報と照明情報の集合が保持され、活性化されたニューラル・ネットワーク内でナビゲートされます。

NeRFの重要な点は、環境を再現するためにわずか数枚の画像が必要であり、生成された環境には、高忠実度の再構築に必要なすべての情報が含まれているため、モデラー、テクスチャ・アーティスト、照明スペシャリストなどの従来のCGIのサービスは不要です。

セマンティック・セグメンテーション

NeRFは、実質的に「コンピューター・ジェネレーテッド・イメージ」(CGI)を構成していますが、まったく異なる方法論と、高度に自動化されたパイプラインを提供します。さらに、NeRFはシーンの動く部分を分離して「カプセル化」できます。こうして、それらは仮想環境で追加、削除、速度変更、または個別の要素として操作できます。これは、現時点での「ハリウッド」におけるCGIの最先端を超えた能力です。

<img class="wp-image-175425 size-full" src="https://www.unite.ai/wp-content/uploads/2021/05/st-nerf-clip-2.gif" alt="上海科技大学からのコラボレーションは、2021年の夏にリリースされ、NeRF要素をシーンの「貼り付け可能」な要素に個別化する方法を提供します。” width=”600″ height=”342″ /> 上海科技大学からのコラボレーションは、2021年の夏にリリースされ、NeRF要素をシーンの「貼り付け可能」な要素に個別化する方法を提供します。 ソース: https://www.youtube.com/watch?v=Wp4HfOwFGP4

NeRFのアーキテクチャは「ブラックボックス」であるため、NeRF環境からオブジェクトを抽出して、従来のメッシュベースまたは画像ベースのツールで直接操作することは現在不可能ですが、NeRFのニューラル・ネットワークのライブ・レンダリング・環境のマトリックスを分解するためのいくつかの研究努力がブレークスルーを達成し始めています。

https://www.youtube.com/watch?v=5JjWpv9BaaE