Andersonの視点

広告主の視聴者の中で『フクロウとトカゲ』を探す

オンライン広告市場は2023年に740.3億ドルを費やしたと推定されており、広告会社がこの特定のコンピュータビジョン研究に多大なリソースを投入する理由は明らかである。

この業界は孤立し、保護的であるが、時折、顔認識や視線追跡の高度な独自技術に関する研究を公開している。これらの研究には、年齢認識が含まれており、これは人口統計分析の統計に重要である。

広告のインザワイルドコンテキストでの年齢推定は、特定の年齢人口統計をターゲットにする広告主にとって興味深い。 この自動顔年齢推定の実験的な例では、パフォーマーBob Dylanの年齢が年を通じて追跡される。 ソース: https://arxiv.org/pdf/1906.03625

これらの研究は、Arxivなどのパブリックリポジトリにほとんど出現しないが、AI駆動の分析の基礎となる正当に募集された参加者を使用し、視聴者が広告とどの程度、どのように関わっているかを決定しようとする。

Dlibの方向グラデーション(HoG)は、顔推定システムでよく使用される。 ソース: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

動物的本能

この点では、当然、広告業界は偽陽性(分析システムが視聴者の行動を誤って解釈する場合)を決定し、視聴者がコマーシャルに完全に関与していないときの明確な基準を確立することに興味がある。

スクリーンベースの広告に関しては、研究は2つの環境、つまり「デスクトップ」または「モバイル」に焦点を当てている。これらの環境は、それぞれに特定の特徴を持っており、カスタマイズされたトラッキングソリューションが必要である。問題は、広告主の視点から見ると、フクロウの行動とトカゲの行動、つまり視聴者が広告に完全に注意を払っていない傾向を表している。

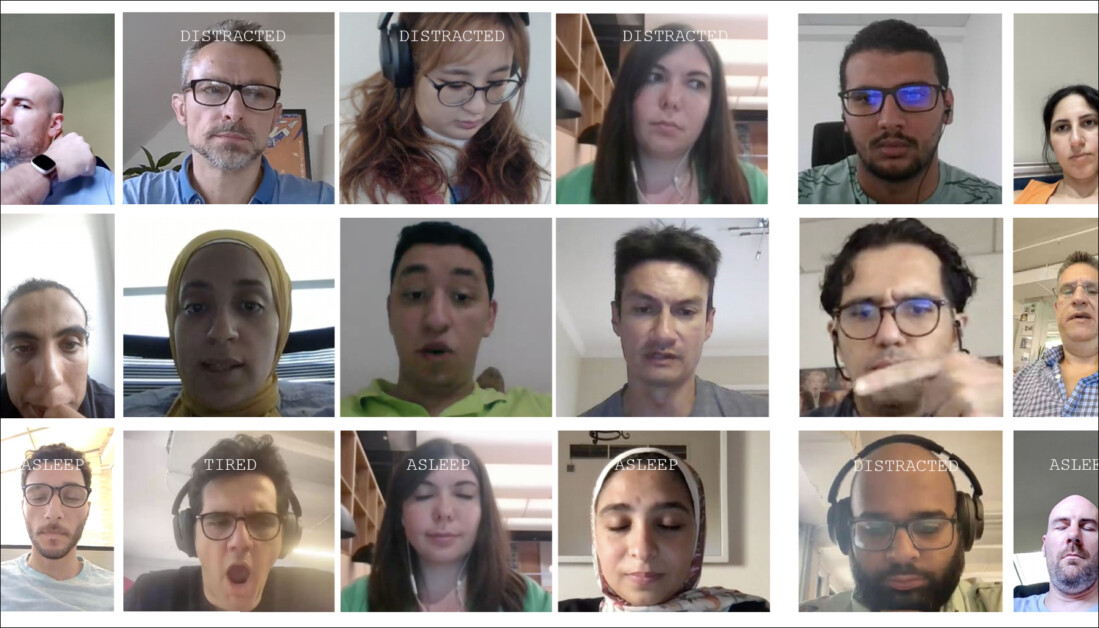

広告研究プロジェクトの被験者における『フクロウ』と『トカゲ』の行動の例。 ソース: https://arxiv.org/pdf/1508.04028

あなたが広告から見て離れている場合、これは『フクロウ』の行動である。頭のポーズが静止しているが、目が画面から離れている場合、これは『トカゲ』の行動である。分析と新しい広告のテストの観点から、これらはシステムが捉えるべき重要なアクションである。

SmartEyeのAffectivaの新しい論文は、これらの問題に対処し、すべての必要な条件と可能な反応に対して結合された特徴セットを提供するために、既存のいくつかのフレームワークを活用するアーキテクチャを提供している。

デスクトップとモバイルデバイスのさまざまな妨害シグナルに対する新しい注意システムによって検出された真陽性と偽陽性の例。 ソース: https://arxiv.org/pdf/2504.06237

著者は次のように述べている:

‘限られた研究がオンライン広告中の注意を監視することに関心を持っている。 これらの研究は、頭のポーズや視線の方向を推定して視線の逸脱を特定することに焦点を当てていたが、デバイスの種類(デスクトップまたはモバイル)、カメラの配置、画面のサイズなどの重要なパラメータを無視している。 これらの要因は、注意の検出に大きく影響する。 ‘

‘この論文では、さまざまな妨害要因、包括して検出するアーキテクチャを提案する。 これには、画面外の視線、話し、だるさ(あくびや長時間の目閉じ)、および画面の放棄が含まれる。 ‘

‘以前のアプローチとは異なり、私たちの方法は、デバイス固有の特徴、たとえばデバイスの種類、カメラの配置、画面のサイズ(デスクトップの場合)、およびカメラの向き(モバイルデバイスの場合)を生の視線推定と統合して、注意の検出精度を高める。 ‘

新しい研究は、オンライン広告中の視聴者の注意を監視するというタイトルで、Affectivaの4人の研究者によって行われた。

方法とデータ

主に、このようなシステムの秘密性とクローズドソース性のため、新しい論文は著者のアプローチを直接比較することはなく、代わりに独自の成果を提示する。一般的なコンピュータビジョン文献の通常の形式にも従っていない。したがって、研究を提示されているように見てみましょう。

著者は、注意の検出に特に焦点を当てた研究は限られていると強調している。AFFDEX SDKでは、実時間のマルチフェイス認識が提供され、注意は頭のポーズのみから推定され、参加者は頭の角度が定義されたしきい値を超えた場合、注意が欠けているとラベル付けされる。

AFFDEX SDKからの例、Affectivaシステムは注意の指標として頭のポーズに頼っている。 ソース: https://www.youtube.com/watch?v=c2CWb5jHmbY

2019年のコラボレーションビデオコンテンツへの視覚的注意の自動測定を使用したディープラーニングでは、約28,000人の参加者がさまざまな注意欠如行動(視線を外す、目を閉じる、または無関係な活動に従事する)に注釈が付けられ、CNN-LSTMモデルは顔の外見から注意を検出するためにトレーニングされた。

2019年の論文からの例、画面の視聴者に対する予測注意状態を示す。 ソース: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

しかし、著者は、これらの以前の努力は、デバイス固有の要因、たとえばデスクトップまたはモバイルデバイスの使用、画面のサイズ、またはカメラの配置を考慮していないことを観察している。さらに、AFFDEXシステムは、視線の逸脱のみを特定することに焦点を当てており、他の妨害源を省略しているが、2019年の研究はより広範な行動のセットを検出しようとしているが、その使用する単一の浅いCNNは、このタスクには不十分であると論文は述べている。

著者は、ドライビングや教育などのドメインとは異なり、カメラの配置と校正が通常事前に固定されているため、未校正の設定を操作し、デスクトップとモバイルデバイスの限定された視線範囲内で動作する最も人気のある研究は、広告テストに最適化されていないと観察している。

したがって、彼らは、2つの商用ツールキット、AFFDEX 2.0とSmartEye SDKを利用して、オンライン広告中の視聴者の注意を検出するためのアーキテクチャを考案した。

AFFDEX 2.0からの顔分析の例。 ソース: https://arxiv.org/pdf/2202.12059

これらの以前の研究は、低レベルの特徴、たとえば顔の表情、頭のポーズ、視線の方向を抽出する。これらの特徴は、画面上の視線の位置、あくび、話しなどの高いレベルの指標を生成するために処理される。

システムは、4つの妨害タイプを特定する:画面外の視線;だるさ;話し;および放棄された画面。また、視聴者がデスクトップまたはモバイルデバイスを使用しているかどうかに応じて、視線の分析を調整する。

データセット:視線

著者は、注意検出システムを動作させるために4つのデータセットを使用した:3つは個別に視線の行動、話し、そしてあくびに焦点を当てており、4つ目は実際の広告テストセッションから抽出されたもので、さまざまな妨害タイプの混合が含まれている。

この研究の特定の要件のため、各カテゴリにカスタムデータセットが作成された。すべての作成されたデータセットは、広告を視聴する参加者の数百万のレコーディングセッションを含む独自のリポジトリから取得された。ただし、同意書の制限のため、著者は新しい研究のデータセットを公開できないと述べている。

視線データセットを構築するために、参加者は画面のさまざまな点を移動するドットを追跡するように求められ、画面から外側(上、下、左、右)に4つの方向を見た。シーケンスは3回繰り返され、キャプチャとカバレッジの関係が確立された:

デスクトップ(a)とモバイルデバイス(b)での視線ビディオ刺激のスクリーンショット。 最初と3番目のフレームはドットを追跡するための指示を表示し、2番目と4番目のフレームは画面から外側を見るよう促している。

ドットを追跡するセグメントは、注意とラベル付けされ、画面外のセグメントは注意欠如とラベル付けされた。正と負の両方の例のラベル付けされたデータセットが生成された。

各ビデオは約160秒続き、デスクトップとモバイルプラットフォームの両方で、1920×1080と608×1080の解像度で個別のバージョンが作成された。

合計609本のビデオが収集され、322本のデスクトップと287本のモバイルレコーディングで構成されていた。ラベルはビデオコンテンツに基づいて自動的に適用され、データセットは158個のトレーニングサンプルと451個のテストサンプルに分割された。

データセット:話し

この文脈では、1つの基準は、1秒以上話ししている場合(これは一時的なコメント、または咳払いである可能性がある)である。

制御環境ではオーディオを記録または分析しないため、話しは推定された顔のランドマークの内部の動きを観察することによって推測される。したがって、オーディオなしで話しを検出するために、著者は視覚入力のみに基づいてデータセットを作成し、内部リポジトリから2つの部分に分割した。最初の部分には約5,500本のビデオが含まれ、3人のアノテーターによって話しまたは話していないというラベルが付けられていた(そのうち4,400本はトレーニングと検証に、1,100本はテストに使用された)。

2つ目は、セッションの種類に基づいて自動的にラベル付けされた16,000セッションで構成され、10,500セッションでは参加者が広告を黙って視聴し、5,500セッションでは参加者がブランドについて意見を述べていた。

データセット:あくび

あくびのデータセットがある(たとえば、YawDDと運転手の疲労)、著者は、これらのデータセットはあくびをシミュレートしているか、顔の歪みがあくびと混同される可能性があるため、広告テストシナリオに適していないと主張している。

したがって、著者は、735本のビデオを内部コレクションから使用し、あくびが1秒以上続くセッションを選択し、各ビデオは3人のアノテーターによってアクティブまたは非アクティブなあくびとして手動でラベル付けされた。フレームの2.6%のみがアクティブなあくびを含んでおり、クラスの不均衡を強調し、データセットは670本のトレーニングビデオと65本のテストビデオに分割された。

データセット:妨害

妨害データセットも著者の広告テストリポジトリから抽出され、参加者はタスクが割り当てられていない実際の広告を視聴していた。合計520セッション(モバイル環境で193、デスクトップ環境で327)がランダムに選択され、3人のアノテーターによって注意または注意欠如として手動でラベル付けされた。

注意欠如の行動には、画面外の視線、話し、だるさ、および放棄された画面が含まれた。セッションは世界中のさまざまな地域にわたっており、デスクトップのレコーディングがより一般的だったが、ウェブカメラの配置が柔軟であるためである。

注意モデル

提案された注意モデルは、低レベルの視覚特徴、つまり顔の表情、頭のポーズ、視線の方向を処理する。これらは、AFFDEX 2.0とSmartEye SDKを介して抽出される。

これらは、視線の位置、 あくび、話しなどの高いレベルの指標に変換される。各妨害要因は、独自のデータセットでトレーニングされた個別の二値分類器によって処理される。

提案された監視システムのスキーマ。

視線モデルは、正規化された視線座標を使用して、視聴者が画面を見ているかどうかを決定する。デスクトップとモバイルデバイスの両方で、視線の急激な変化を滑らかにするための線形サポートベクターマシン(SVM)がトレーニングされている。

話しを検出するために、システムは口の領域を切り出し、会話と会話以外のビデオセグメントの両方でトレーニングされた3D-CNNを使用した。ラベルはセッションの種類に基づいて割り当てられ、時間的スムージングによって、短時間の口の動きによって生じる偽陽性を軽減した。

あくびは、顔全体の画像を切り出し、広い顔の動きを捉えるために、手動でラベル付けされたフレームでトレーニングされた3D-CNNを使用して検出された。AFFDEX 2.0からのアクションユニットの予測と組み合わせることで、精度が向上した。

画面の放棄は、顔または極端な頭のポーズが存在しないことで特定され、決定ツリーによって予測された。

最終的な注意状態は、固定ルールを使用して決定された:モジュールのいずれかが注意欠如を検出した場合、視聴者は注意欠如とマークされた。デスクトップとモバイルのコンテキストで個別に調整された、感度を優先するアプローチである。

テスト

先ほど述べたように、テストは成分を削除し、結果に影響を与える方法で実行される。

研究で特定されたさまざまな注意欠如のカテゴリ。

視線モデルは、3つの重要なステップを通じて、画面外の行動を特定する:生の視線推定の正規化、出力の微調整、デスクトップデバイスの画面サイズの推定。

各コンポーネントの重要性を理解するために、著者はそれらを個別に削除し、2つのデータセットから抽出された226のデスクトップと225のモバイルビデオでパフォーマンスを評価した。結果は、G-meanとF1スコアによって測定され、以下に示されている。

フル視線モデルのパフォーマンスを示す結果、および個々の処理ステップを削除したバージョン。

すべての場合で、ステップを省略するとパフォーマンスが低下した。正規化は、カメラの配置がより変動するデスクトップで特に価値がありました。

研究はまた、視覚的特徴がモバイルカメラの向きをどのように予測するかを評価した。顔の位置、頭のポーズ、目線の方向はそれぞれ0.75、0.74、0.60をスコアし、組み合わせると0.91に達し、複数のヒントを統合する利点を強調した。

話しモデルは、手動でラベル付けされたテストセットで0.97のROC-AUCを達成し、大規模な自動ラベル付けされたデータセットでも0.96を達成し、両方のデータセットで一貫したパフォーマンスを示した。

あくびモデルは、口のアスペクト比のみを使用して96.6%のROC-AUCに達し、AFFDEX 2.0からのアクションユニット予測と組み合わせると97.5%に改善された。

画面の放棄モデルは、顔または極端な頭のポーズが存在しないときに予測し、正当性を評価するために、実際の妨害データセット内のすべての「顔なし」イベントを手動でアノテートした。明確なケース(たとえば、カメラの遮蔽やビデオの歪み)を除外すると、次の結果が得られた。

顔が見つからない理由の多様性。

論文では次のように述べられている。

‘顔が見つからないことが27%の場合にのみ、ユーザーが実際に画面を離れていることによるものであった。 ‘

‘しかし、顔が見つからないシグナルは、画面から外側を見ているときに頭を極端に傾けたり、過度の動きをしたり、顔に物や手を大きく重ねたりするなどの、注意が欠如していることを示唆する他の理由でも発生した。 ‘

最後の定量的テストでは、著者はさまざまな妨害シグナルを逐次的に追加することで、全体的な注意モデルへの影響を評価した。テストは、実際の妨害データセットと視線データセットのサブセットで実行された。パフォーマンスは、G-meanとF1スコアによって測定された。

アーキテクチャにさまざまな妨害シグナルを追加した影響。

結果から、著者は次のように結論付けた。

‘結果から、すべての妨害シグナルを統合することで注意の検出が向上することがわかる。

‘2つ目に、注意の検出の改善は、デスクトップとモバイルデバイスの両方で一貫している。 3つ目に、実データセットのモバイルセッションでは、画面から外側を見ているときに頭の動きが大きく、検出が容易となるため、モバイルデバイスではデスクトップよりもパフォーマンスが高い。 ‘

‘4つ目に、だるさのシグナルを追加することで相対的にわずかな改善が見られたが、あくびは通常はまれである。 5つ目に、放棄された画面のシグナルは、特にモバイルデバイスで大きな改善をもたらした。 ‘

著者はまた、頭のポーズに基づく現在のモデルのパフォーマンスを、AFFDEX 1.0と比較した。AFFDEX 1.0は、以前の広告テストシステムで使用されていた。

‘これは、AFFDEX 1.0と比較して、頭の動きを両方の方向(横と縦)で考慮し、頭のポーズを微調整することによる結果である。 強調された頭の動きは、実データセットのモバイルで、AFFDEX 1.0と同等のパフォーマンスをもたらした。 ‘

著者は、最後に、質的テストラウンドを実施した。

さまざまな妨害タイプの真陽性と偽陽性の例、デスクトップとモバイルデバイスで。

著者は次のように述べている。

‘結果は、モデルの有効性を示唆している。 ただし、まれに、真陽性と偽陽性の両方が発生する。 ‘

結論

結果は、以前の研究に対する計測されたが意味のある進歩を表しているが、この研究のより深い価値は、視聴者の内部状態へのアクセスを求める継続的な努力を示している。データは同意を得て収集されたが、方法論は、構造化された市場調査の設定を超えた将来のフレームワークを示唆している。

このやや偏執的な結論は、この特定の研究分野の孤立した、保護された、そして保護された性質によってさらに強化される。

* 著者のインライン引用をハイパーリンクに変換した私の変更。

2025年4月9日水曜日に最初に公開されました。