人工知能

少ない方が良い: ドキュメントを少なくしてAIの回答を改善する理由

Retrieval-Augmented Generation (RAG)は、言語モデルと外部の知識源を組み合わせてAIシステムを構築するアプローチです。簡単に言うと、AIはユーザーのクエリに関連するドキュメント(記事やWebページなど)を検索し、次にそれらのドキュメントを使用してより正確な回答を生成します。この方法は、大規模言語モデル(LLM)が事実に基づいた回答を生成し、ハルシネーションを減らすのに役立つため、称賛されてきました。

直感的には、AIが検索するドキュメントが多いほど、回答はより情報に基づいていると思われるかもしれません。しかし、最近の研究では、驚くべき転換が見られます。情報をAIに提供する場合、時には少ない方が良いということです。

少ないドキュメント、より良い回答

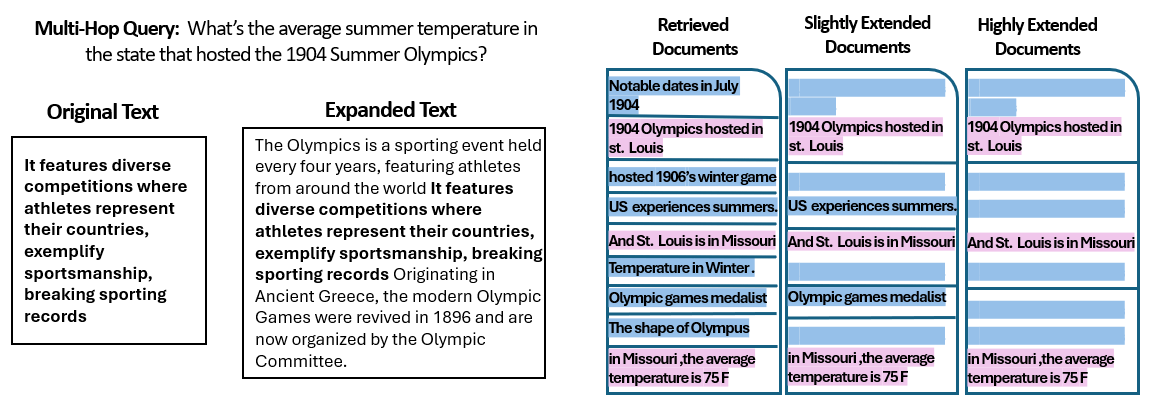

ヘブライ大学の研究者による新しい研究では、RAGシステムに提供されるドキュメントの数が、そのパフォーマンスにどのように影響するかを調べました。重要な点は、総テキスト量を一定に保ったことです。つまり、提供されるドキュメントが少ない場合、ドキュメント自体を少し拡張して、同じ長さを保つことができました。このようにして、パフォーマンスの違いはドキュメントの数によるものであり、単に入力が短いことによるものではありません。

研究者は、トリビアの質問で構成されるデータセット(MuSiQue)を使用しました。各質問は、もともと20のWikipediaの段落とペアになっていたのですが、そのうちの何個かは実際に回答を含んでいたものの、残りはディストラクターでした。ドキュメントの数を20から2〜4個の真正に関連するものに絞り込み、それらを少しパディングして長さを一定に保つことで、AIが扱うドキュメントの数を減らすシナリオを作成しました。

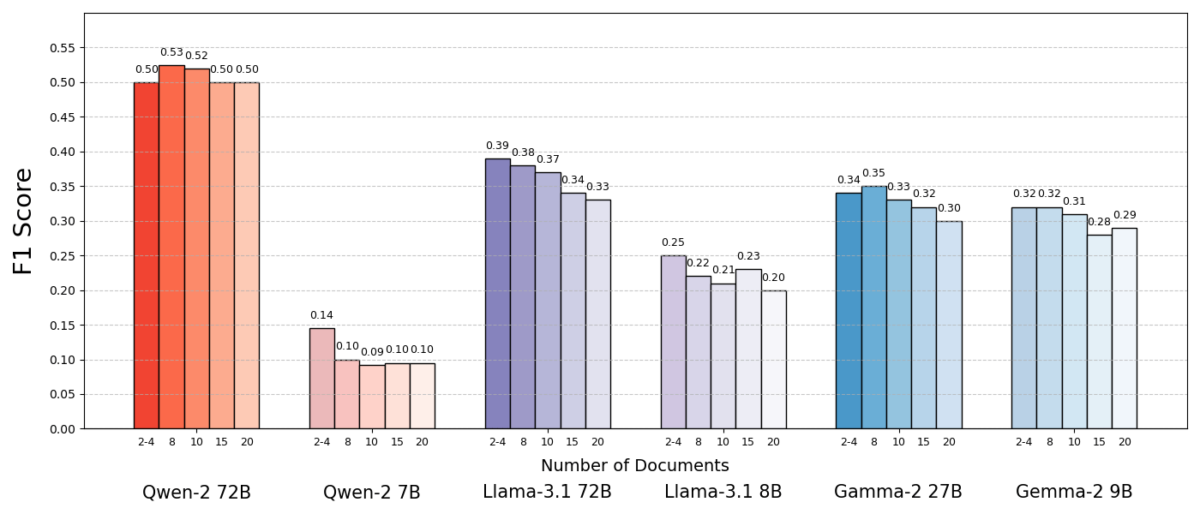

結果は驚くべきものでした。ほとんどの場合、AIモデルは、全ドキュメントセットではなく、より少ないドキュメントを提供されたときに、より正確に回答しました。パフォーマンスは、システムがわずか数個のサポートドキュメントを使用した場合、精度(F1スコア)で最大10%改善されました。この逆説的なブーストは、MetaのLlamaなどのバリエーションを含む複数のオープンソース言語モデルで観察され、現象が単一のAIモデルに限定されていないことを示しています。

1つのモデル(Qwen-2)は、スコアの低下なしに複数のドキュメントを処理することができたという特筆すべき例外でしたが、ほとんどのテスト済みモデルは、全体的に少ないドキュメントでより良いパフォーマンスを示しました。つまり、主要な関連ピースを超えて参照マテリアルを追加すると、パフォーマンスを低下させることが多く、改善させることが少なかったのです。

Source: Levy et al.

なぜこれはそんなに驚くべきことなのか。通常、RAGシステムは、より広範な情報を検索することはAIにのみ利益をもたらすという仮定の下で設計されています。答えが最初の数個のドキュメントにない場合、それは10番目または20番目のドキュメントにあるかもしれません。

この研究は、この脚本を逆転させ、無差別に追加のドキュメントを積み上げることは裏目に出る可能性があることを示しています。総テキストの長さが一定に保たれていたとしても、多くの異なるドキュメント(それぞれ独自のコンテキストと癖を持つ)の単なる存在が、質問回答タスクをAIにとってより困難にしました。明らかに、ある点を超えると、各追加ドキュメントはシグナルよりもノイズを導入し、モデルを混乱させ、正しい答えを抽出する能力を損なうようです。

RAGにおける「少ない方が良い」

この「少ない方が良い」結果は、AI言語モデルが情報を処理する方法を考慮すると、理解できます。AIが最も関連するドキュメントのみを提供された場合、見えるコンテキストは焦点を当てており、邪魔はありません。学生が正しいページを勉強するのと同じです。

研究では、モデルは、無関係な資料を削除したサポートドキュメントのみを提供された場合に、有意に優れています。残されたコンテキストは、短くなるだけでなく、クリーンでした。事実、直接答えを指し示すものであり、他には何もありませんでした。ドキュメントが少ない場合、モデルは、関連する情報に全ての注意を集中することができ、道に迷う可能性は低くなりました。

一方、多くのドキュメントが検索された場合、AIは関連するコンテンツと無関係なコンテンツの混合物を調べる必要がありました。多くの場合、これらの追加ドキュメントは「似ているが無関係」でした。質問と同じトピックやキーワードを共有しているかもしれませんが、実際には答えを含んでいません。そうしたコンテンツはモデルを欺く可能性があります。AIは、答えに到達しないドキュメント間のつながりを探すことに努力を費やしたり、最悪の場合、複数のソースから情報を誤って統合したりする可能性があります。これにより、ハルシネーションのリスクが増大します。ハルシネーションとは、AIがどのソースにも根ざさないながらも、ありそうに聞こえる答えを生成することです。

本質的に、モデルに多すぎるドキュメントを提供すると、有用な情報が薄まる可能性があり、矛盾する詳細が導入され、AIが何が真実であるかを判断することが困難になります。

興味深いことに、研究者は、追加ドキュメントが明らかに無関係な場合(例:無関係なランダムテキスト)、モデルはそれらを無視するのが上手かったことを発見しました。実際の問題は、関連しているように見えるが実際には無関係なデータから来ます。検索されたテキストがすべて似たトピックである場合、AIはそれらすべてを使用する必要があると想定し、どの詳細が実際に重要であるかを判断するのに苦労する可能性があります。これは、研究の観察と一致しています。つまり、ランダムなディストラクターは現実的なディストラクターよりも混乱を引き起こしにくいということです。AIは、明白な無意味さをフィルタリングできますが、微妙にトピックから外れた情報はスリックな罠であり、答えを妨げます。必要なものだけにドキュメントの数を絞ることで、最初からそのような罠を設けないことができます。

実際、実用的にも利点があります。必要なドキュメントのみを検索して処理することで、RAGシステムの計算オーバーヘッドを削減できます。検索される各ドキュメントは、分析(埋め込み、読み取り、モデルによる注目)が必要であり、これには時間と計算リソースが必要です。不要なドキュメントを除去することで、システムをより効率的にし、回答をより迅速に、かつ低コストで提供できます。精度が向上したシナリオでは、双方の勝利となります。より良い回答と、よりスリムで効率的なプロセスです。

Source: Levy et al.

RAGの再考: 将来の方向性

この新たな証拠、つまり、回収における質が量を上回ることが多いというものは、外部知識に依存するAIシステムの将来にとって重要な意味を持ちます。これは、RAGシステムの設計者が、ドキュメントの純粋な量よりも、スマートなフィルタリングとランキングを優先すべきであることを示唆しています。100個の可能なパスを取得し、どこかに答えがあることを期待するのではなく、最も関連性の高いトップの数個のものを取得する方が賢明かもしれません。

研究の著者は、モデルに供給される情報において、「関連性と多様性のバランス」をとる必要性を強調しています。つまり、質問に答えるのに十分なトピックのカバー範囲を提供したいが、同時に核心的な事実が余分なテキストの海に溺れることは避けたいということです。

今後、研究者は、AIモデルが複数のドキュメントをより優雅に処理する方法を探るでしょう。1つのアプローチは、どのドキュメントが真正に価値を加えるかを判断できる、より優れたリトリーバーシステムまたは再ランキングシステムを開発することです。別のアプローチは、言語モデル自体を改善することです。1つのモデル(Qwen-2のような)が多くのドキュメントを処理することに失敗しなかった場合、そのモデルがどのように訓練されたか、構造化されたかを調べることで、他のモデルをより堅牢にするヒントが得られるかもしれません。将来的には、言語モデルは、複数のソースが同じことを言っているか(または矛盾しているか)を認識し、そこに焦点を当てるメカニズムを組み込むことができます。目標は、豊富な情報源の幅と焦点の明晰さの両方を利用できるようにすることです。つまり、広さと明晰さの両方を兼ね備えたものを作ることです。

また、AIシステムがより大きなコンテキストウィンドウ(一度に読み取れるテキストの量)を獲得するにつれて、プロンプトに単純に多くのデータを投入することは銀の弾丸ではなくなります。より大きなコンテキストは、必ずしもより良い理解をもたらすわけではありません。この研究は、AIが技術的に50ページを一度に読むことができる場合でも、50ページの混合情報を提供することは良い結果にはならないことを示しています。モデルは、無差別にダンプされたデータではなく、キュレーションされた関連コンテンツで作業することから利益を得ます。実際、巨大なコンテキストウィンドウの時代になると、知識ではなくノイズを使用することを避けるために、賢い回収がさらに重要になる可能性があります。

「More Documents, Same Length」(適切に命名された論文)からの発見は、AI研究における私たちの仮定を再検討することを促しています。時には、AIに持っているすべてのデータを提供することは、思ったほど効果的ではないことがあります。最も関連性の高い情報に焦点を当てることで、AI生成の回答の精度を向上させるだけでなく、システムをより効率的で信頼性が高くすることもできます。これは逆説的な教訓ですが、興味深い意味を持ちます。将来的に、RAGシステムは、慎重に選択されたより少ない、より優れたドキュメントを回収することで、賢くてスリムになる可能性があります。