人工知能

ディセンタングルメントは次のディープフェイク革命である

CGIデータ増強は、ディープフェイク画像に対するより大きな制御を得るために、新しいプロジェクトで使用されている。まだ、CGIヘッドを使用してディープフェイク顔データセットのギャップを埋めることはできないが、アイデンティティとコンテキストの分離に関する新しい研究の波により、すぐに必要なくなりそうである。

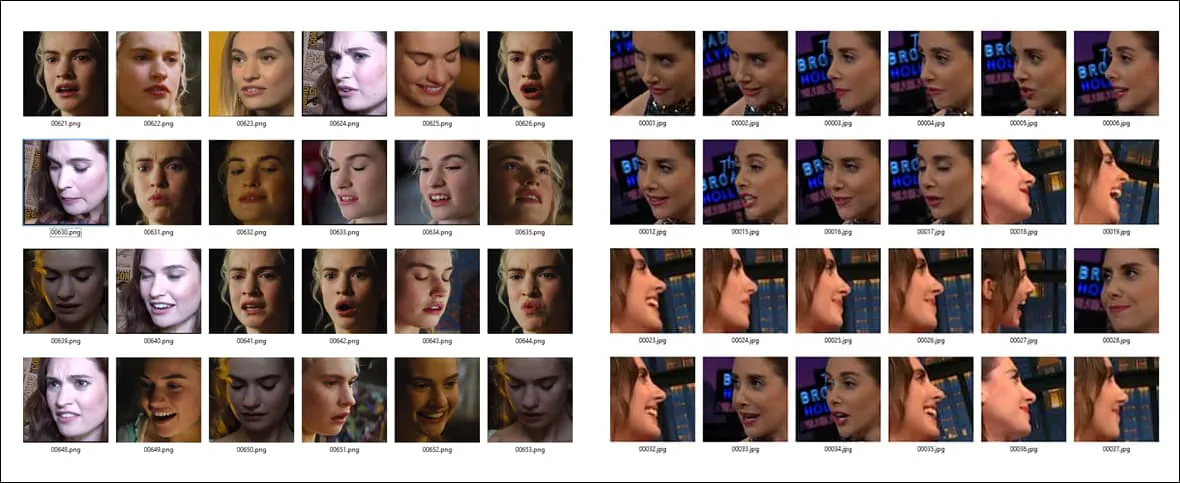

ディープフェイクビデオの作者は、過去数年間で最も成功したウイルス的なディープフェイクビデオのいくつかを制作しており、持続的なプロファイルショット(例えば、警察の逮捕手続きで普及したサイドオンマグショット)を避け、鋭い角度や不通常または誇張された表情を避けるようにソースビデオを慎重に選択している。最近、ウイルス的なディープフェイカーによって生成されたデモビデオは、編集されたコンピレーションであり、ディープフェイク化するための「最も簡単な」角度と表情を選択している。

実際、ディープフェイク化するための最も適切なターゲットビデオは、オリジナルの人物(ディープフェイクによって消去されるアイデンティティ)がカメラを見つめ、最小限の表情の範囲を持つビデオである。

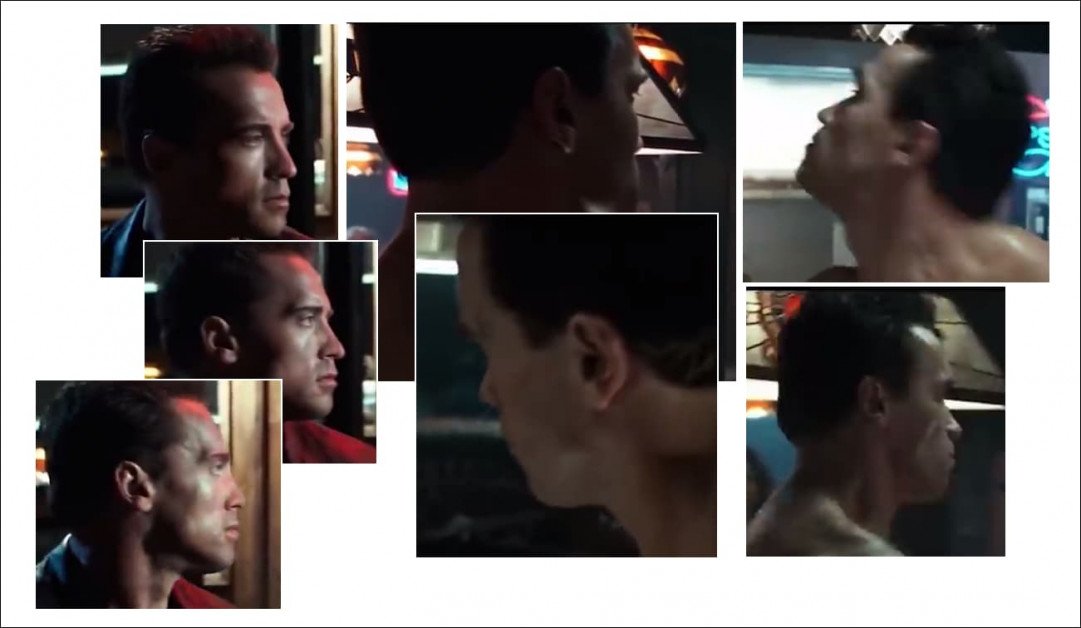

最近のディープフェイクのほとんどは、サブジェクトがカメラを見つめ、人気の表情(例えば、笑顔)しか持たない、または(2019年のシルベスター・スタローンのターミネーターとしての偽物のように)可能な限り表情がないことを示している。

ディープフェイク技術、例えばDeepFaceLabやFaceSwapは、これらの簡単なスワップを非常にうまく行うので、達成したことに十分に感銘を受けて、達成できないことを気にしないし、しばしば試みることもない。

アーノルド・シュワルツェネッガーがシルベスター・スタローンに変換されたとされるディープフェイクビデオからのグラブ – 角度が非常にトリッキーな場合を除く。プロファイルは現在のディープフェイクアプローチの持続的な問題である。部分的に、ディープフェイクフレームワークで顔のポーズを定義するために使用されるオープンソースソフトウェアはサイドビューに最適化されていないが、主に必要なデータセットのいずれか、または両方に適切なソースマテリアルが不足しているためである。 ソース: https://www.youtube.com/watch?v=AQvCmQFScMA

新しい研究は、シンセティックデータ、例えばCGIヘッドを使用して、ディープフェイクを2020年代に持ち込むための新しい方法を提案している。つまり、顔のアイデンティティ(例えば、トム・クルーズの基本的な顔の特徴)をコンテキスト(例えば、上を見ている、横を見ている、しかめっ面、暗い中でしかめっ面、眉をひそめる、目を閉じるなど)から真正に分離する。

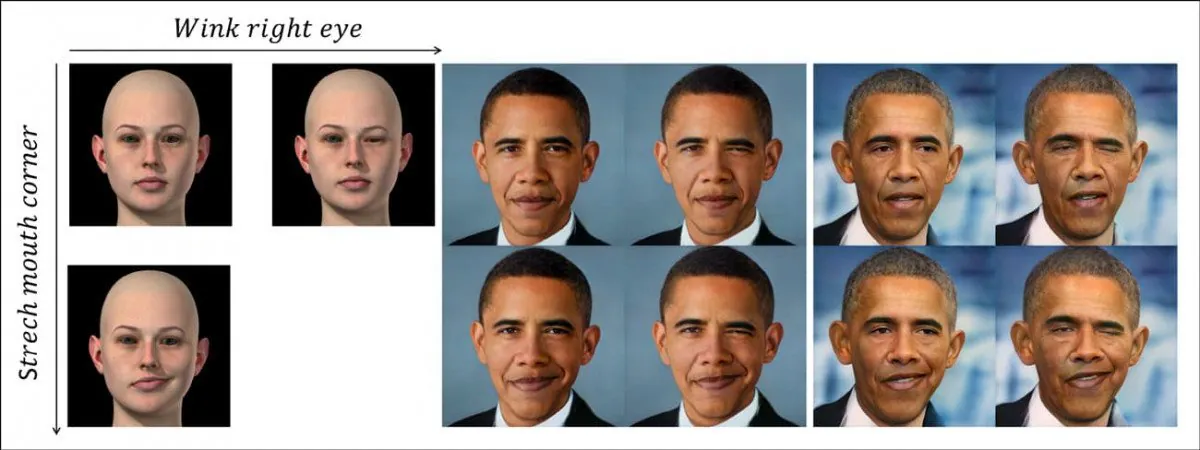

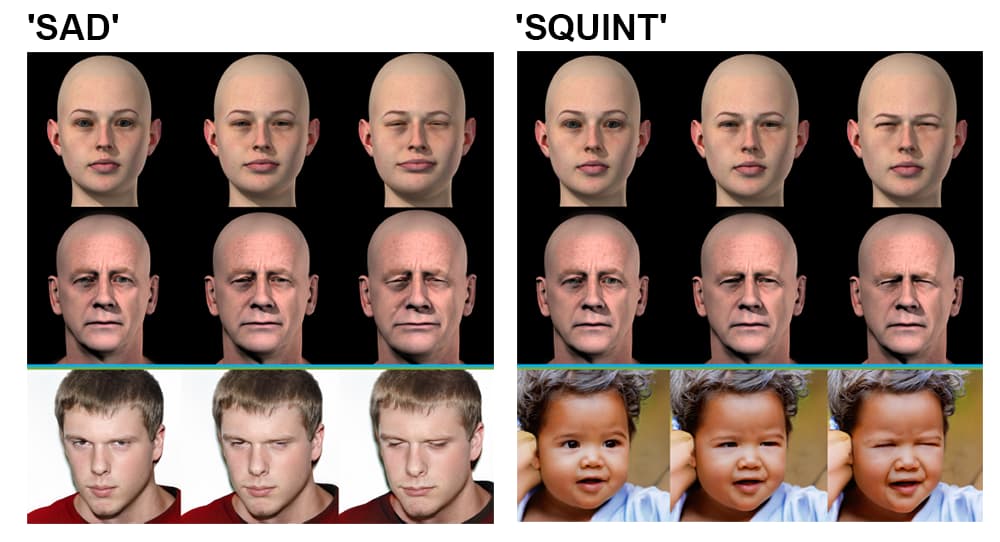

新しいシステムは、ポーズとコンテキスト(例えば、目をつぶる)を、個人のアイデンティティのエンコードから離れて分離する。無関係なシンセティック顔データ(左に描かれている)を使用する。上の行では、バラク・オバマのアイデンティティに「目をつぶる」が転送されている。下の行では、元大統領の口角が伸ばされた。右下では、両方の特徴が同時に適用されている。 ソース: https://arxiv.org/pdf/2111.08419.pdf

これは、ディープフェイクの頭の操り人形のようなものではなく、アバターと部分的な顔の唇の動きに適した技術であり、完全なディープフェイクビデオ変換の潜在能力は限られている。

むしろ、これは、基本的なアイデンティティとコンテキストの分離の方法を表し、より高度なイメージ合成ベースのディープフェイクフレームワークへの道を開く。

新しい論文は、Delta-GAN-Encoder: Encoding Semantic Changes for Explicit Image Editing, using Few Synthetic Samplesと題され、Technion – Israel Institute of Technologyの研究者によって提出された。

この研究の意味を理解するために、ディープフェイクが現在どのように生成されているかを見てみましょう。ディープフェイクポルノサイトからIndustrial Light and Magicまで、ディープフェイスラボのオープンソースリポジトリは現在、プロフェッショナルなディープフェイクとアマチュアの両方で支配的である。

現在のディープフェイク技術が何を妨げているか

現在のディープフェイクは、2つの顔画像のフォルダを使用して、エンコーダ/デコーダ機械学習モデルを訓練することによって生成される。1つは「ペイントオーバー」する人物(先ほどの例では、アーノルド・シュワルツェネッガー)であり、もう1つはビデオに重ねる人物(シルベスター・スタローン)である。

エンコーダ/デコーダシステムは、各フォルダ内の各画像を比較して、 hundreds of thousands of iterations(しばしば1週間)を繰り返し、両方のアイデンティティの基本的な特徴を十分に理解するまで繰り返す。

各アイデンティティについて、ディープフェイクアーキテクチャが学習するアイデンティティに関する情報は、コンテキストと絡み合っている。汎用的ポーズの原則を「全てのために」学習して適用することはできない。各アイデンティティが関与するすべてのポーズについて、トレーニングデータセットに豊富な例が必要である。

したがって、ただ笑ったりカメラを見つめたりする以外のことをしているアイデンティティをスワップしたい場合、特定のポーズ/アイデンティティの多くの例が必要になる。

顔のIDとポーズの特徴は現在まだ密接に結びついているため、ディープフェイスラボのようなシステムで有効なディープフェイクモデルを訓練するには、2つの顔データセットの間で表情、頭のポーズ、ある程度の照明の広範な対称性が必要である。特定の構成(例えば「横顔/笑顔/日光」)が両方の顔セットに表示される頻度が低いほど、ディープフェイクビデオで必要な場合、正確にレンダリングされる可能性は低い。

もしセットAに不通常のポーズが含まれているが、セットBに含まれない場合、あなたはほぼ運が無い。どれほど長くモデルを訓練しても、ポーズをよく再現することはできない。なぜなら、訓練時に必要な情報の半分しかなかったからである。

もしもマッチング画像があるとしても、それだけでは十分ではない。セットAにマッチングポーズが含まれているが、セットBの同等のポーズはハードなサイドライトになっている場合、スワップの品質は同じである。

データが不足している理由

あなたが頻繁に逮捕される場合を除き、あなた自身のサイドプロファイルショットはほとんどないはずである。発生したものはあなたが処分したはずである。写真機関も同様に処分する。したがって、プロファイル顔のショットは入手困難である。

ディープフェイカーは、プロファイルデータが不足しているアイデンティティのために、データセットにプロファイルデータの複数のコピーを含めることが多い。そうすることで、トレーニング中にそのポーズが「少し」注目される。

しかし、データセットに含めることが可能なサイドビューフェイス画像の種類は、実際に利用可能なものよりも多く存在する。例えば、笑顔、しかめっ面、叫び、泣き、暗い、軽蔑、退屈、陽気、フラッシュ、上を見ている、下を見ている、目を開けている、目を閉じているなど。これらのポーズのいずれか、または複数の組み合わせが、ターゲットディープフェイクビデオで必要になる可能性がある。

そして、これはプロファイルだけの話である。自分が真っ直ぐ上を見ている姿の写真は何枚ある?自分がその正確なポーズとカメラ角度で、10,000の可能な表情を示している写真が何枚ある?少なくとも100万の可能な照明環境をカバーしている?

あなたはそういう写真を1枚も持っていない可能性が高い。2つの角度だけなのに、必要なのは100以上のカバレッジである。

もしも完全なカバレッジを生成できたとしても、必要な画像の数は数十万枚となり、トレーニングするには大きすぎる。さらに、現在のディープフェイクフレームワークのトレーニングプロセスは、多くの特徴を削減して、少数の派生特徴だけを保持する。

シンセティック代替

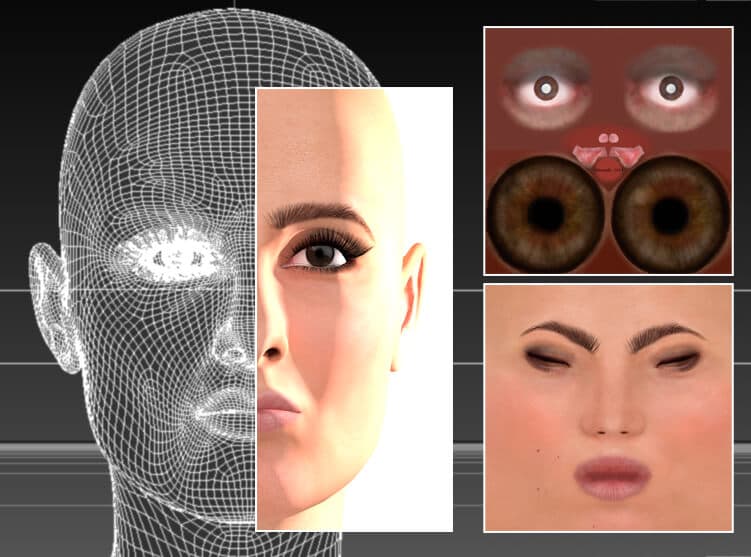

ディープフェイクの黎明期から、ディープフェイカーは「欠落している」ポーズや表情を生成するために、CGIスタイルの画像、Cinema4DやMayaのような3Dアプリケーションで作成されたヘッドを使用して実験してきた。

AIは不要;女優は伝統的なCGIプログラム、Cinema 4Dで再現される。1960年代から存在する技術だが、1990年代から広く使用されるようになった。理論的には、この顔モデルは、不通常のポーズ、照明スタイル、顔の表情のディープフェイクソースデータを生成するために使用できる。実際には、ディープフェイクビデオでスワップされる際に、レンダリングの「偽物」な外観が「bleed through」するため、ディープフェイクにはほとんど役に立たない。 ソース: この記事著者の画像 https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

この方法は、一般的に新しいディープフェイク実践者によって早期に放棄される。なぜなら、不通常のポーズや表情を提供できるが、シンセティックな外観がスワップに「bleed through」するからである。

これにより、ディープフェイクビデオの中で、突然「不気味の谷」の顔が現れることがある。アルゴリズムは、不通常のポーズや表情のために、利用可能な唯一のデータである明らかに偽の顔を使用するからである。

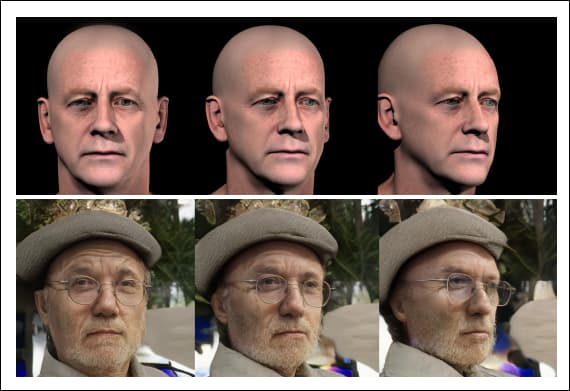

ディープフェイカーの最も人気のあるサブジェクトの1人、オーストラリアの女優マーゴット・ロビーの3Dディープフェイクアルゴリズムは、ディープフェイスライブのデフォルトインストールに含まれている。ディープフェイスライブは、ウェブカメラセッションのようなライブストリームでディープフェイクを実行できるディープフェイスラボのバージョンである。CGIバージョン(上の画像)を使用して、ディープフェイクデータセットの「欠落している」角度を取得することができる。 ソース: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI顔としての概念的なガイドライン

代わりに、イスラエルの研究者による新しいDelta-GANエンコーダ(DGE)方法は、より効果的である。なぜなら、CGI画像からのポーズとコンテキスト情報がターゲットの「アイデンティティ」情報から完全に分離されているからである。

この原理は、以下の画像で見ることができる。さまざまな頭の向きが、CGI画像をガイドラインとして使用することによって取得された。

新しい方法では、複数の角度からディープフェイクを実行するために、3つの個別のリアルライフソース画像を見つける必要はない。CGIヘッドを回転させるだけで済む。抽象的な特徴は、アイデンティティ情報を漏らさずに適用される。

Delta-GAN-Encoder。上左グループ:ソース画像の角度を1秒で変更して新しいソース画像をレンダリングする。上右グループ:照明もアイデンティティから分離され、照明スタイルの重ね合わせが可能になる。下左グループ:複数の顔の詳細を変更して「悲しい」表情を作成する。下右グループ:1つの顔の表情の詳細を変更して、目を細める。

このアイデンティティとコンテキストの分離は、訓練段階で達成される。新しいディープフェイクアーキテクチャのパイプラインは、変換する画像に一致する、事前に訓練された生成対抗ネットワーク(GAN)の潜在的なベクトルを探索する。Sim2Real方法は、2018年のIBMのAI研究部門のプロジェクトに基づいている。

研究者は観察する:

‘わずか数サンプルで、特定の属性で異なることができる、事前トレーニングされたエントanglされた生成モデルの分離された動作を学習することができる。実世界のサンプルを正確に取得する必要はない。 ‘

‘非現実的なデータサンプルを使用することで、同じ目標を達成することができる。エンコードされた潜在的なベクトルのセマンティクスを活用することで、明示的な潜在的な空間の動作の探索は必要ない。 ‘

研究者は、プロジェクトで探求された分離の基本原理が、インテリアアーキテクチャシミュレーションなどの他のドメインに転送できる可能性があると予想している。Sim2Real方法は、最終的にスケッチだけでなく、CGIスタイルの入力に基づいてディープフェイクの操作性を可能にする。

新しいシステムがディープフェイクビデオを合成できるかどうかは、重要ではない。ディープフェイクの潜在的な空間に対するより大きな制御を獲得し、GANの潜在的な空間からアイデンティティとコンテキストを分離することによって、研究が進歩したことが重要である。

分離は、イメージシンセシスの活発な研究分野である。2021年1月、Amazonが主導する研究ペーパーは、同様のポーズ制御と分離を実証し、2018年に、深圳先進技術研究所の中国科学院のペーパーは、GAN内で任意の視点を生成することに進展を遂げた。