Andersonの視点

AIのアナログ時計を読むための苦労は、より深い意味を持つ可能性がある

中国とスペインの研究者による新しい論文によると、GPT-4.1のような高度な多モーダルAIモデルでも、アナログ時計の画像から時間を読むことが苦労していることがわかった。時計の小さな視覚的な変化は、大きな解釈エラーを引き起こし、ファインチューニングは既知の例でのみ役立つ。結果は、未知の画像に直面したときに、これらのモデルの信頼性について懸念を引き起こす。

人間は、重力や他の基本的な物理法則などのドメインについて十分な理解を得たとき、特定の例を超えて、根底にある抽象概念を把握する。そうすることで、知識を創造的に適用し、新しいインスタンス、たとえそれを見たことがないとしても、原理を認識することができる。

ドメインが重要である場合、パレイドリアのように、存在しない場所でもそれを認識するようになる。パレイドリアは、パレイドリアによって、失敗のコストが高いため、生存メカニズムが強く作用する。

私たちが子供の頃に最初に、そして繰り返し教えられる視覚的なデータセットの1つは、時計を教えるための教材であり、印刷物やインタラクティブなアナログ時計が使用される。

時間を教えるための教材。 ソース: https://www.youtube.com/watch?v=IBBQXBhSNUs

時計のデザインの変化が私たちを時々挑戦させるかもしれないが、早期のドメインマスターの強さは印象的で、複雑または「エキセントリック」なデザイン選択に直面しても、アナログ時計の面を識別することができる。

時計の顔が読みにくい例。 ソース: https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

人間は、時計のしくみを理解するために、数千の例は必要としない。基本的な概念が理解できれば、ほぼどのような形式でもそれを認識することができる。

一方で、AIモデルはこのタスクに苦労している。これは、モデルが理解ではなく、高容量の露出に依存していることを示唆している。

模倣ゲームを超えて

表面的なパフォーマンスと真正の「理解」の間の緊張は、最近の大規模モデルの調査で繰り返し浮き彫りになっている。先月、浙江大学とウェストレイク大学は、論文でこの問題を取り上げた。

‘ベンチマークでは印象的な結果を出すものの、モデルはパターンマッチングに頼りすぎており、真正の理解には至っていない。シンボリックな表現や基本的な特性の違反に対する失敗がその証拠である。’

‘明示的なルールの提供がパフォーマンスを損なうことは、固有のアーキテクチャ上の制約を示唆している。これらの洞察は、評価のギャップを明らかにし、真正の数学的推論を可能にするアーキテクチャの必要性を強調する。’

今週、この質問は再び提起され、今回は中国の南京航空航天大学とスペインのマドリード工科大学の共同研究で、多モーダル大規模言語モデル(MLLMs)が本当にアナログ時計で時間を読むことを学んだのかというタイトルの新しい論文で取り上げられている。

研究の進捗は論文で詳細に説明されているが、研究者たちの初期のテストでは、OpenAIのGPT-4.1多モーダル言語モデルが、多様な時計画像から時間を読むことに苦労していることがわかった。

これは、モデルのトレーニングデータにギャップがあることを示唆しており、モデルの学習能力をテストするために、よりバランスの取れたデータセットが必要である。

研究者による合成アナログ時計データセットの例。 ソース: https://huggingface.co/datasets/migonsa/analog_watches_finetune

ファインチューニング前のGPT-4.1はこれらの時計を読むことに一貫して失敗していたが、新しいデータセットへの露出後、パフォーマンスは改善した。しかし、改善は新しい画像が既に見たものに似ている場合に限られた。

時計の形状や針のスタイルが変わると、精度は急激に低下した。さらに、GPT-4.1はダリ風の「メルティングクロック」を解釈するのに苦労した。

標準デザインの時計、歪んだ形状、変更された針の時計画像と、GPT-4.1による時間の推定。 ソース: https://arxiv.org/pdf/2505.10862

著者は、モデルの学習が主に視覚的なパターンマッチングによって行われていると結論付けた。

‘[GPT 4.1]は、時計が歪んだり、針が細くなったり、矢印の形状になったりすると、失敗する。150個のランダムな時間に対する平均絶対誤差(MAE)は、初期の時計では232.48秒、形状が歪んだ時計では1380.69秒、針が変更された時計では3726.93秒であった。’

‘これらの結果は、MLLMが時間を読むことを学んだのではなく、パターンを記憶したに過ぎないことを示唆している。’

十分な時間

ほとんどのトレーニングデータセットは、インターネットからスクラップした画像に依存しており、これらの画像は特定の時間、特に時計広告で人気の10:10を繰り返し表示する。

アナログ時計画像における「10:10」の時間の普遍性の例。

時計の画像が限られた時間範囲しかカバーしていないため、モデルは可能な時計構成の狭い範囲しか見ることができず、繰り返しのパターンを超えて一般化する能力が制限される。

ファインチューニングテスト

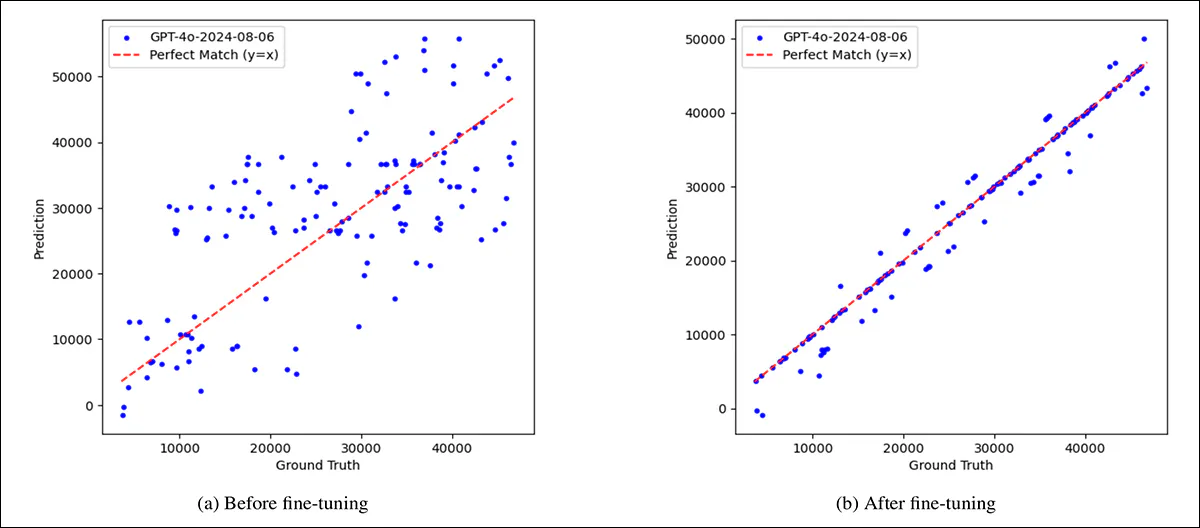

モデルの失敗が露出によって克服できるかどうかをテストするために、GPT-4.1は上記の合成データセットでファインチューンされた。ファインチューニング前のモデルの予測は、標準時計と歪んだ時計の両方で、広く散らばっており、重大なエラーが存在した。

しかし、ファインチューニング後、標準時計の精度は急激に改善されたが、歪んだ時計や変更された手の時計での改善は限られた。

2つの異なる失敗モードが現れた。標準時計と歪んだ時計では、モデルは通常、手の方向を誤判断した。変更された手の時計では、モデルはしばしば手の機能を混同し、時間の推定が大きく外れた。

モデルの初期的な弱さと、バランスの取れた合成データセットでファインチューニングした後の部分的な改善を示す比較。

手のサイン

モデルの予測を、手の役割を正しく識別した場合とそうでない場合の2つのグループに分けた。予測は、平均絶対誤差(MAE)で評価され、標準時計との結果と比較された。

変更された手のデータセットにおける手の役割の混同の有無によるエラーの比較。

手の役割の混同は、最大のエラーを引き起こした。GPT-4.1が時間を読むことを学んだのではなく、パターンを記憶したに過ぎないことを示唆している。

結論

この論文の焦点は、初見では些細なように思えるかもしれないが、より深い意味を持つ。モデルの学習が理解ではなく、高容量の露出に依存していることを示唆している。

この問題は、モデルの学習能力を超えて、より広範な意味を持つ。モデルの学習が、単にパターンマッチングに頼るのではなく、真正の理解を可能にするアーキテクチャの必要性を強調している。

最初に公開されたのは、2025年5月19日月曜日