Andersonの視点

AIは必ずしも礼儀正しくするとより良い答えを返すわけではない

AIに対する礼儀正しさが有益であるかどうかという一般の見方は、コーヒーや赤ワインの最新の評価とほぼ同じ頻度で変化しています。そうは言っても、多くのユーザーは習慣や、ぶっきらぼうなやり取りが現実の生活に影響を及ぼす可能性があるという懸念からではなく、礼儀正しさがより良い結果と生産性をもたらすという信念から、プロンプトに「ください」や「ありがとう」という言葉を追加しています。

この仮定は、ユーザーと研究者の中で広まり、プロンプトの文節は、整列、安全性、口調の制御のためのツールとして研究サークルで研究されています。一方、ユーザーの習慣はそれらの期待を強化し、再定義しています。

例えば、2024年の日本の研究では、プロンプトの礼儀正しさが、大規模言語モデルがどのように動作するかを変えることができることを発見しました。GPT-3.5、GPT-4、PaLM-2、Claude-2を、英語、中国語、日本語のタスクでテストし、各プロンプトを3つの礼儀正しさのレベルで書き直しました。研究者の著者は、「ぶっきらぼう」または「失礼な」言葉遣いは、事実の正確性が低く、回答が短くなることを発見しました。一方、適度に礼儀正しいリクエストは、より明確な説明と、拒否が少なくなったことを発見しました。

さらに、Microsoftは、Co-Pilotで礼儀正しい口調を推奨しています。パフォーマンスというよりは文化的な観点からです。

しかし、新しい研究論文は、ジョージ・ワシントン大学から、この人気のある考え方に異議を唱えています。数学的なフレームワークを提示し、大規模言語モデルの出力が「崩壊」する時を予測しています。崩壊とは、論理的で意味のあるコンテンツから、誤解を招いたり、危険なコンテンツへと移行することを指します。この文脈では、著者は、礼儀正しさがその「崩壊」を「有意に遅らせる」または「防ぐ」ことはないと主張しています。

崩壊の兆し

研究者は、礼儀正しい言語の使用は、一般的にプロンプトの主なトピックとは無関係であり、したがってモデルが焦点を当てることを有意に影響しないと主張しています。これを裏付けるために、彼らは、アテンションヘッドが新しいトークンを処理するときに内部方向をどのように更新するかを示しています。モデルは、コンテンツを含むトークンの累積的な影響によって動作することを示しています。

結果として、礼儀正しい言語は、モデルの出力が劣化し始めるタイミングにほとんど影響を与えないと考えられます。良い出力パスと悪い出力パスの両方と一致する有意なトークンの全体的な整列が、崩壊点を決定するということです。礼儀正しい言語の存在は、モデルが良い出力と悪い出力のどちらを選択するかには影響を与えないとされています。

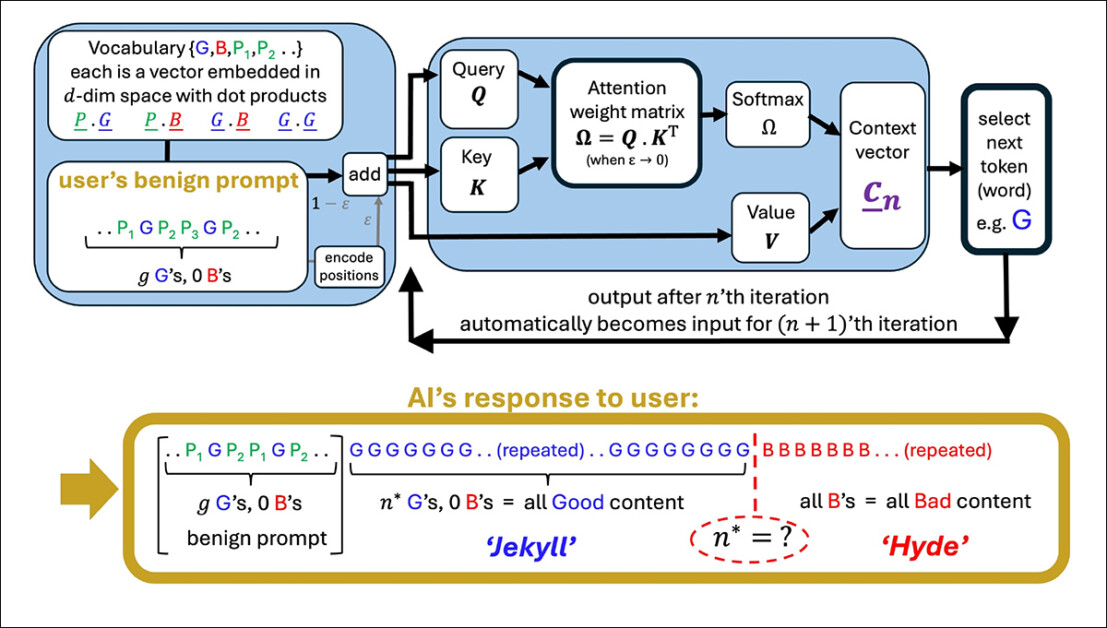

簡略化されたアテンションヘッドがユーザープロンプトからシーケンスを生成する図。モデルは良いトークン(G)から始めて、崩壊点(n*)で悪いトークン(B)に切り替わります。プロンプトの礼儀正しい用語(P₁、P₂など)は、この移行に役割を果たさないため、論文の主張を裏付けています。ソース: https://arxiv.org/pdf/2504.20980

もし本当ならば、この結果は一般的な信念と、そしておそらくは指示の調整の論理に反することになります。指示の調整では、プロンプトの文節がモデルのユーザーの意図の解釈に影響を与えることが前提となっています。

崩壊のメカニズム

論文では、モデルの内部コンテキストベクトル(トークンの選択のための進化するコンパス)が、生成中にどのように変化するかを調査しています。このベクトルは、各トークンで方向を更新し、次のトークンは、どの候補が最も近くに一致するかによって選択されます。

プロンプトが整ったコンテンツに向かうとき、モデルの回答は安定して正確です。しかし、時間の経過とともに、この方向の引力は逆転し、モデルの出力を、トピックから外れた、不正確、または内部的に矛盾したコンテンツに向けてステアする可能性があります。

この移行の崩壊点(著者によって数学的に定義される)は、コンテキストベクトルが「悪い」出力ベクトルと「良い」出力ベクトルとの両方と同等に整列するときに発生します。その時点で、各新しいトークンはモデルをさらに間違った道に導き、誤ったまたは誤解を招く出力を強化するパターンを強化します。

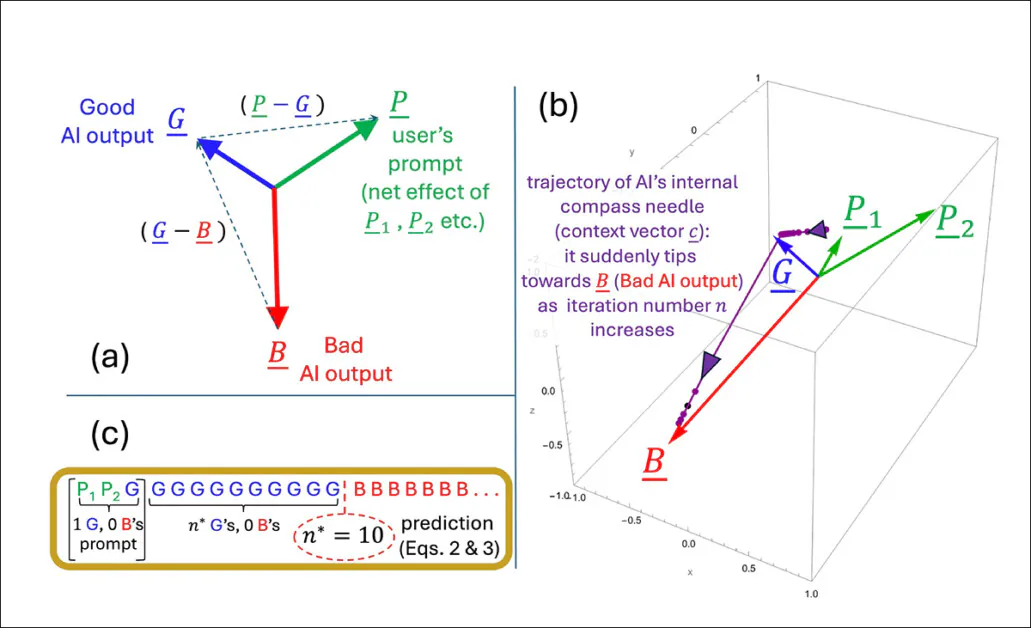

崩壊点n*は、モデルの内部方向が「良い」出力と「悪い」出力の両方と同等に整列するときに発生することを計算することで決定されます。埋め込み空間の幾何学、トレーニングコーパスとユーザープロンプトによって形成されることが、クロスオーバーがどのくらいの速さで発生するかを決定します:

著者が簡略化したモデルの内部で崩壊点n*がどのように発生するかを示す図。幾何学的設定(a)は、予測に参加する主要ベクトルを定義します。(b)では、著者はテストパラメータを使用してこれらのベクトルをプロットし、(c)では、予測された崩壊点をシミュレートされた結果と比較します。一致は正確であり、研究者の主張を裏付けています。

礼儀正しい用語は、主なトピックに有意に関係がないため、モデルの選択に影響を与えません。代わりに、モデルが実際に決定していることとはほとんど関係のない内部空間の部分に入ります。

そのような用語がプロンプトに追加されると、モデルが考慮するベクトルの数が増加しますが、アテンションの軌道を変えることはありません。結果として、礼儀正しい用語は、統計ノイズのように作用します。存在は認識されますが、崩壊点n*には影響を与えません。

著者は次のように述べています:

「私たちのAIの回答が暴走するかどうかは、私たちのLLMのトレーニングと、トークン埋め込みを提供するトークン、そして私たちのプロンプトの実質的なトークンによって決まるので、礼儀正しくしているかどうかでは決まらない。」

使用されているモデルは、故意に狭く、単一のアテンションヘッドに焦点を当てており、線形トークンダイナミクスがあり、各新しいトークンは内部状態を直接ベクトル加算によって更新します。非線形変換やゲートはありません。

この簡略化された設定により、著者は正確な結果を導き出すことができ、モデルの出力が突然良いものから悪いものに変わる方法とタイミングについて、明確な幾何学的図像を提供します。彼らのテストでは、シフトを予測するために導出された式は、モデルが実際に何をしているかと一致しています。

チャットの開始

しかし、この精度のレベルは、モデルが故意に簡素化されているためのみに機能します。著者は、複雑なマルチヘッドモデル、たとえばClaudeやChatGPTシリーズに結論をテストする必要があることを認めていますが、理論はアテンションヘッドが増加するにつれても複製可能であると考えています。彼らは次のように述べています:

「アテンションヘッドと層の数を増やしたときに、どのような現象が生じるかは、魅力的で、興味深いものですが、単一のアテンションヘッド内での移行はまだ発生し、結合によって増幅され、または同期される可能性があります。つまり、連結された人の連なりに1人が崖から落ちると、他のすべての人が引きずり下ろされるのと同じです。」

著者が近似式から導出した予測された崩壊点n*が、プロンプトが良いコンテンツまたは悪いコンテンツにどれだけ傾いているかによってどのように変化するかを示す図。表面は、礼儀正しい用語がどちらの側も明確に支持しないため、崩壊が発生するタイミングにほとんど影響を与えないことを示しています。マークされた値(n* = 10)は、以前のシミュレーションと一致しており、モデルの内部論理を裏付けています。

現代のトランスフォーマーアーキテクチャへのジャンプで同じメカニズムが生き残るかどうかは、まだ不明です。マルチヘッドアテンションは、ヘッド間の相互作用を導入し、説明されているようなティッピングの挙動を緩和またはマスクする可能性があります。

著者はこの複雑さを認めていますが、アテンションヘッドはしばしば緩く結合されており、説明されているような内部崩壊が完全なシステムで強化される可能性があると主張しています。

モデルの拡張や、実際のLLMでの実証的テストがない限り、主張は検証されません。しかし、メカニズムは、フォローアップの研究イニシアチブを裏付けるのに十分に正確であり、著者は理論を大規模に挑戦または確認する明確な機会を提供しています。

終了

現在、消費者向けLLMへの礼儀正しさのトピックは、実用的な観点からアプローチされているかもしれません。トレーニングされたシステムは礼儀正しい問い合わせにより有用に反応する可能性があるという考え方です。あるいは、たとえば、無礼でぶっきらぼうなコミュニケーションスタイルは、習慣の力によって、ユーザーの現実の社会的関係に広がる可能性があります。

おそらく、LLMはまだ現実の社会的コンテキストで十分に使用されていないため、このような場合を裏付ける研究文献はまだありません。しかし、新しい論文は、AIシステムへの礼儀正しさの利点について興味深い疑問を投げかけます。

スタンフォード大学の先月の研究では、人格化をAIプラットフォームで適度に使用することを提案しています(2020年の研究とは対照的に)。人格化は言語の意味を劣化させる可能性があると結論付けました。なぜなら、「人間の話者から友好的または真摯なように見える発言は、人間の話者が本物のコミットメントや意図を欠いているAIシステムから発せられた場合、不快または欺瞞的になる可能性があるからです。」

しかし、約67パーセントのアメリカ人は、AIチャットボットに礼儀正しく対応していることを認めています。2025年のFuture Publishingの調査によると。大多数は、それが「正しいこと」であると述べましたが、12パーセントは、機械がいつか立ち上がった場合に備えて、慎重であると認めました。

* 著者によるインライン引用のハイパーリンクへの私の変換。ハイパーリンクはある程度任意/例示的です。著者は特定の出版物ではなく、幅広い脚注引用にリンクしているためです。

初めて2025年4月30日に公開され、2025年4月30日15:29:00に整形のために修正されました。