Angolo di Anderson

Verso il Controllo Totale nella Generazione di Video AI

I modelli di base per la generazione di video come Hunyuan e Wan 2.1, sebbene potenti, non offrono agli utenti il tipo di controllo granulare che la produzione di film e TV (in particolare la produzione di effetti visivi) richiede.

In studi professionali di effetti visivi, modelli open-source come questi, insieme a modelli basati su immagini (piuttosto che su video) come Stable Diffusion, Kandinsky e Flux, vengono solitamente utilizzati insieme a una serie di strumenti di supporto che adattano la loro uscita grezza per soddisfare esigenze creative specifiche. Quando un regista dice: “Sembra grande, ma possiamo renderlo un po’ più [n]?” non puoi rispondere dicendo che il modello non è abbastanza preciso per gestire tali richieste.

Invece, un team di AI VFX utilizzerà una serie di tecniche di CGI e composizione tradizionali, alleate con procedure e flussi di lavoro personalizzati sviluppati nel tempo, al fine di cercare di spingere i limiti della sintesi video un po’ più in là.

Quindi, per analogia, un modello di base video è molto simile a un’installazione predefinita di un browser web come Chrome; fa molto fuori dalla scatola, ma se vuoi che si adatti alle tue esigenze, piuttosto che viceversa, avrai bisogno di alcuni plugin.

Control Freaks

Nel mondo della sintesi di immagini basata sulla diffusione, il sistema di terze parti più importante è ControlNet.

ControlNet è una tecnica per aggiungere un controllo strutturato ai modelli generativi basati sulla diffusione, che consente agli utenti di guidare la generazione di immagini o video con input aggiuntivi come mappe di bordo, mappe di profondità o informazioni sulla posa.

I vari metodi di ControlNet consentono di generare immagini con profondità (riga superiore), segmentazione semantica (in basso a sinistra) e generazione di immagini di esseri umani e animali guidata dalla posa (in basso a sinistra).

Invece di affidarsi esclusivamente a prompt di testo, ControlNet introduce rami di reti neurali separati, o adattatori, che elaborano questi segnali di condizionamento mentre preservano le capacità generative del modello di base.

Ciò consente output raffinati che aderiscono più da vicino alle specifiche dell’utente, rendendolo particolarmente utile in applicazioni in cui è richiesto un controllo preciso della composizione, della struttura o del movimento:

Con una posa guidata, è possibile ottenere una varietà di tipi di output precisi tramite ControlNet. Fonte: https://arxiv.org/pdf/2302.05543

Tuttavia, le strutture basate su adattatori di questo tipo operano esternamente su un insieme di processi neurali che sono molto focalizzati internamente. Questi approcci hanno diversi svantaggi.

Innanzitutto, gli adattatori vengono addestrati in modo indipendente, portando a conflitti di ramo quando vengono combinati più adattatori, il che può comportare una qualità di generazione degradata.

In secondo luogo, introducono ridondanza dei parametri, richiedendo ulteriore calcolo e memoria per ogni adattatore, rendendo inefficiente la scalabilità.

In terzo luogo, nonostante la loro flessibilità, gli adattatori spesso producono risultati subottimali rispetto ai modelli che sono completamente ottimizzati per la generazione multi-condizionale. Questi problemi rendono i metodi basati su adattatori meno efficaci per le attività che richiedono un’integrazione senza soluzione di continuità di più segnali di controllo.

Idealmente, le capacità di ControlNet sarebbero state addestrate nativamente nel modello, in un modo modulare che potrebbe accogliere innovazioni successive come la generazione di video/audio simultanea o la sincronizzazione labiale nativa (per l’audio esterno).

Come stanno le cose, ogni pezzo aggiuntivo di funzionalità rappresenta o un compito di post-produzione o una procedura non nativa che deve navigare i pesi strettamente legati e sensibili di qualsiasi modello di base su cui sta operando.

FullDiT

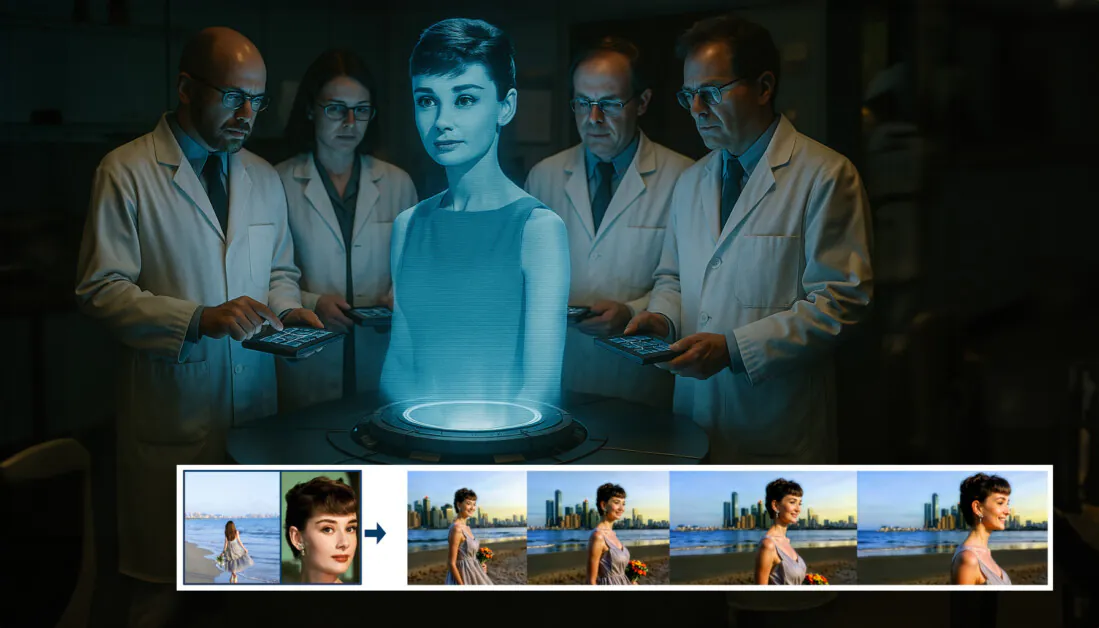

In questo stallo arriva una nuova offerta dalla Cina, che propone un sistema in cui le misure di ControlNet-style vengono incorporate direttamente in un modello generativo di video durante l’addestramento, invece di essere relegato a un ripensamento.

Dal nuovo documento: l’approccio FullDiT può incorporare l’imposizione di identità, profondità e movimento della telecamera in una generazione nativa e può evocare qualsiasi combinazione di essi contemporaneamente. Fonte: https://arxiv.org/pdf/2503.19907

Intitolato FullDiT, il nuovo approccio fonde condizioni multi-task come trasferimento di identità, mappatura della profondità e movimento della telecamera in una parte integrata di un modello generativo di video addestrato, per il quale gli autori hanno prodotto un modello prototipo addestrato e clip video accompagnatori in un sito del progetto.

Nell’esempio seguente, vediamo generazioni che incorporano movimento della telecamera, informazioni di identità e testo (cioè, prompt di testo guidati dall’utente):

Clicca per riprodurre. Esempi di imposizione dell’utente di ControlNet-style con un solo modello di base addestrato in modo nativo. Fonte: https://fulldit.github.io/

È importante notare che gli autori non propongono il loro modello sperimentale addestrato come un modello di base funzionale, ma piuttosto come una prova del concetto per modelli di video nativi (T2V) e immagine-video (I2V) che offrono agli utenti più controllo di un prompt di immagine o di testo.

Dal momento che non ci sono modelli di questo tipo, i ricercatori hanno creato un nuovo benchmark intitolato FullBench, per la valutazione della generazione di video multi-task, e affermano di avere prestazioni di stato dell’arte nei test come-per-like che hanno progettato contro approcci precedenti. Tuttavia, poiché FullBench è stato progettato dagli stessi autori, la sua obiettività non è testata, e il suo set di dati di 1.400 casi potrebbe essere troppo limitato per conclusioni più ampie.

Forse l’aspetto più interessante dell’architettura del documento è la sua potenziale capacità di incorporare nuovi tipi di controllo. Gli autori affermano:

‘In questo lavoro, esploriamo solo condizioni di controllo della telecamera, delle identità e delle informazioni di profondità. Non abbiamo ulteriormente indagato altre condizioni e modalità come audio, discorso, nuvole di punti, caselle di delimitazione di oggetti, flusso ottico, ecc. Sebbene il design di FullDiT possa integrare senza sforzo altre modalità con una minima modifica dell’architettura, come adattare rapidamente e in modo efficiente in termini di costo i modelli esistenti a nuove condizioni e modalità è ancora una questione importante che merita ulteriore esplorazione.’

Sebbene i ricercatori presentino FullDiT come un passo avanti nella generazione di video multi-task, dovrebbe essere considerato che questo nuovo lavoro si basa su architetture esistenti piuttosto che introdurre un paradigma fondamentalmente nuovo.

Tuttavia, FullDiT si trova attualmente da solo (per quanto ne so) come un modello di base video con strutture di ControlNet-style “hard coded” – ed è bello vedere che l’architettura proposta può accogliere innovazioni successive anche.

Clicca per riprodurre. Esempi di movimenti della telecamera controllati dall’utente, dal sito del progetto.

Il nuovo documento è intitolato FullDiT: modello generativo di video multi-task con attenzione completa, e proviene da nove ricercatori attraverso Kuaishou Technology e The Chinese University of Hong Kong. La pagina del progetto è qui e il nuovo benchmark dei dati è su Hugging Face.

Metodo

Gli autori sostengono che il meccanismo di attenzione unificato di FullDiT consente un’apprendimento di rappresentazione cross-modale più forte, catturando sia le relazioni spaziali che quelle temporali tra le condizioni:

Secondo il nuovo documento, FullDiT integra più condizioni di input attraverso un’attenzione completa, convertendole in una sequenza unificata. Al contrario, i modelli basati su adattatori (a sinistra) utilizzano moduli separati per ogni input, portando a ridondanza, conflitti e prestazioni più deboli.

A differenza delle configurazioni basate su adattatori che elaborano ogni flusso di input separatamente, questa struttura di attenzione condivisa evita conflitti di ramo e riduce l’onere dei parametri. Affermano inoltre che l’architettura può essere scalata a nuovi tipi di input senza una significativa riprogettazione – e che lo schema del modello mostra segni di generalizzazione a combinazioni di condizioni non viste durante l’addestramento, come collegare il movimento della telecamera con l’identità del personaggio.

Clicca per riprodurre. Esempi di generazione di identità dal sito del progetto.

Nell’architettura di FullDiT, tutti gli input di condizionamento – come testo, movimento della telecamera, identità e profondità – vengono convertiti in un formato di token unificato. Questi token vengono quindi concatenati in una singola sequenza lunga, che viene elaborata attraverso uno stack di strati di trasformatori utilizzando un’attenzione completa. Questo approccio segue lavori precedenti come Open-Sora Plan e Movie Gen.

Questo design consente al modello di apprendere relazioni temporali e spaziali congiuntamente attraverso tutte le condizioni. Ogni blocco di trasformatore opera sull’intera sequenza, consentendo interazioni dinamiche tra modalità senza fare affidamento su moduli separati per ogni input – e, come abbiamo notato, l’architettura è progettata per essere estensibile, rendendolo molto più facile incorporare segnali di controllo aggiuntivi in futuro, senza modifiche strutturali significative.

Il Potere di Tre

FullDiT converte ogni segnale di controllo in un formato di token standardizzato in modo che tutte le condizioni possano essere elaborate insieme in un framework di attenzione unificato. Per il movimento della telecamera, il modello codifica una sequenza di parametri estrinseci – come posizione e orientamento – per ogni frame. Questi parametri sono marcati con timestamp e proiettati in vettori di incorporamento che riflettono la natura temporale del segnale.

Le informazioni di identità vengono trattate in modo diverso, poiché sono intrinsecamente spaziali piuttosto che temporali. Il modello utilizza mappe di identità che indicano quali personaggi sono presenti in quali parti di ogni frame. Queste mappe vengono divise in patch, con ogni patch proiettata in un incorporamento che cattura i suggerimenti spaziali di identità, consentendo al modello di associare regioni specifiche del frame con entità specifiche.

La profondità è un segnale spaziotemporale e il modello la gestisce dividendo i video di profondità in patch 3D che coprono sia lo spazio che il tempo. Queste patch vengono quindi incorporate in un modo che preserva la loro struttura tra i frame.

Una volta incorporati, tutti questi token di condizione (telecamera, identità e profondità) vengono concatenati in una singola sequenza lunga, consentendo a FullDiT di elaborarli insieme utilizzando un’attenzione completa. Questa rappresentazione condivisa consente al modello di apprendere interazioni tra modalità e nel tempo senza fare affidamento su flussi di elaborazione isolati.

Dati e Test

L’approccio di addestramento di FullDiT si è basato su set di dati selettivamente annotati adattati a ogni tipo di condizionamento.

Per le condizioni testuali, l’iniziativa segue l’approccio di captioning strutturato delineato nel progetto MiraData.

Pipeline di raccolta e annotazione di video dal progetto MiraData. Fonte: https://arxiv.org/pdf/2407.06358

Per il movimento della telecamera, il set di dati RealEstate10K è stato la principale fonte di dati, a causa delle sue annotazioni di parametri della telecamera di alta qualità.

Tuttavia, gli autori hanno osservato che l’addestramento esclusivamente su set di dati di scene statiche della telecamera come RealEstate10K tendeva a ridurre i movimenti di oggetti e persone dinamici nei video generati. Per contrastare ciò, hanno condotto un ulteriore addestramento utilizzando set di dati interni che includevano movimenti della telecamera più dinamici.

Le annotazioni di identità sono state generate utilizzando la pipeline sviluppata per il progetto ConceptMaster, che ha consentito un filtro e un’estrazione efficienti di informazioni di identità fine-granulari.

La struttura di ConceptMaster è progettata per affrontare problemi di decoupling di identità mantenendo la fedeltà del concetto in video personalizzati. Fonte: https://arxiv.org/pdf/2501.04698

Le annotazioni di profondità sono state ottenute dal set di dati Panda-70M utilizzando Depth Anything.

Ottimizzazione attraverso l’Ordinamento dei Dati

Gli autori hanno anche implementato un programma di addestramento progressivo, introducendo condizioni più impegnative all’inizio dell’addestramento per assicurarsi che il modello acquisisse rappresentazioni robuste prima che venissero aggiunti compiti più semplici.

L’ordine di addestramento è proceduto da testo a condizioni della telecamera, poi identità, e infine profondità, con compiti più facili generalmente introdotti più tardi e con meno esempi.

Gli autori sottolineano il valore dell’ordinamento del carico di lavoro in questo modo:

‘Durante la fase di pre-addestramento, abbiamo notato che i compiti più impegnativi richiedono un tempo di addestramento esteso e dovrebbero essere introdotti all’inizio del processo di apprendimento. Questi compiti impegnativi coinvolgono distribuzioni di dati complesse che differiscono notevolmente dall’output del video, richiedendo al modello di possedere una capacità sufficiente per catturare e rappresentare con precisione.

‘Al contrario, l’introduzione di compiti più facili troppo presto può portare il modello a imparare prima di loro, poiché forniscono un feedback di ottimizzazione più immediato, che ostacola la convergenza di compiti più impegnativi.’

Un’illustrazione dell’ordine di addestramento dei dati adottato dai ricercatori, con il rosso che indica un volume di dati maggiore.

Dopo il pre-addestramento iniziale, una fase di addestramento finale ha ulteriormente raffinato il modello per migliorare la qualità visiva e la dinamica del movimento. Successivamente, l’addestramento ha seguito quello di un framework di diffusione standard*: rumore aggiunto ai latenti del video, e il modello imparando a prevedere e rimuoverlo, utilizzando i token di condizione incorporati come guida.

Per valutare efficacemente FullDiT e fornire un confronto equo con metodi esistenti, e in assenza della disponibilità di qualsiasi altro benchmark appropriato, gli autori hanno introdotto FullBench, una suite di benchmark curata composta da 1.400 casi di test distinti.

Un’istanza di esploratore di dati per il nuovo benchmark FullBench. Fonte: https://huggingface.co/datasets/KwaiVGI/FullBench

Ogni punto di dati ha fornito annotazioni di verità di base per vari segnali di condizionamento, tra cui movimento della telecamera, identità e profondità.