Angolo di Anderson

Ripristinare e modificare le immagini umane con l’AI

Una nuova collaborazione tra l’Università della California Merced e Adobe offre un avanzamento nello stato dell’arte della completamento di immagini umane – il compito molto studiato di “de-oscurare” parti occluse o nascoste delle immagini di persone, per scopi come prova virtuale, animazione e modifica foto.

Oltre a riparare immagini danneggiate o cambiarle a piacimento dell’utente, i sistemi di completamento di immagini umane come CompleteMe possono imporre abbigliamento nuovo (tramite un’immagine di riferimento aggiuntiva, come nella colonna centrale di questi due esempi) in immagini esistenti. Questi esempi sono tratti dal PDF supplementare estensivo per il nuovo articolo. Source: https://liagm.github.io/CompleteMe/pdf/supp.pdf

Il nuovo approccio, intitolato CompleteMe: Completamento di immagini umane basato su riferimenti, utilizza immagini di input supplementari per “suggerire” al sistema quale contenuto dovrebbe sostituire la sezione nascosta o mancante della rappresentazione umana (e quindi l’applicabilità a framework di prova basati sulla moda):

Il sistema CompleteMe può conformare il contenuto di riferimento alla parte oscurata o occlusa di un’immagine umana.

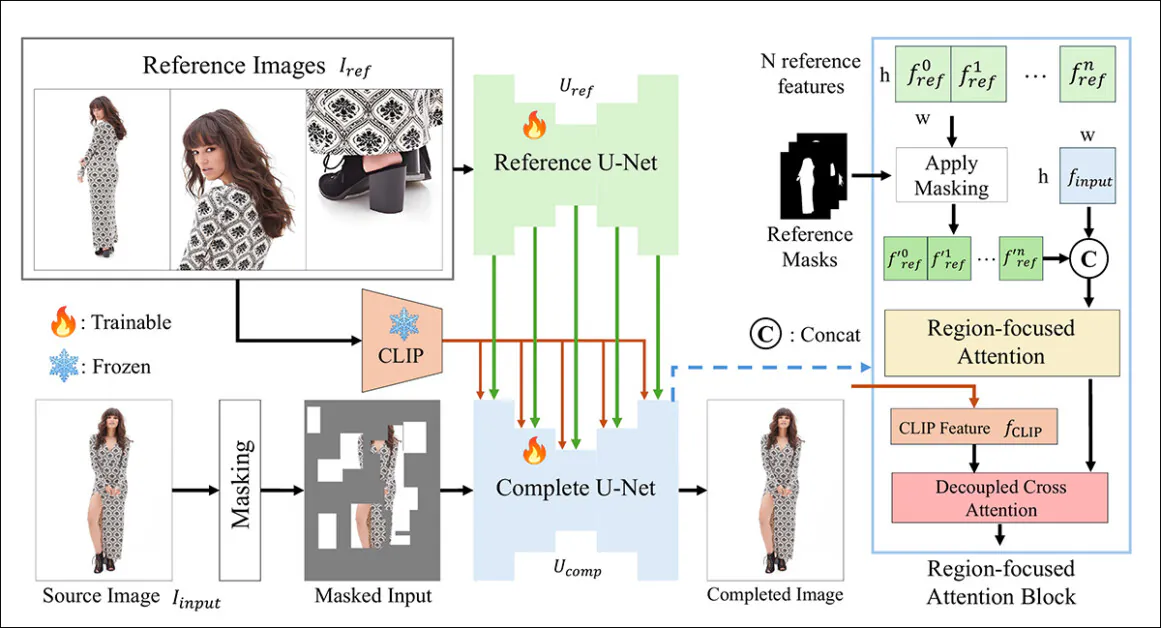

Il nuovo sistema utilizza un’architettura U-Net duale e un blocco di attenzione focalizzato sulla regione (RFA) che mobilita le risorse nella parte pertinente dell’istanza di ripristino dell’immagine.

I ricercatori offrono anche un nuovo e impegnativo sistema di benchmark progettato per valutare le attività di completamento basate su riferimenti (poiché CompleteMe fa parte di una linea di ricerca esistente e in corso nella visione computerizzata, sebbene non abbia avuto uno schema di benchmark fino ad ora).

Nei test e in uno studio utente ben scalato, il nuovo metodo è risultato migliore nella maggior parte delle metriche e nel complesso. In alcuni casi, i metodi rivali sono stati completamente fuorviati dall’approccio basato su riferimenti:

Dal materiale supplementare: il metodo AnyDoor ha particolare difficoltà a decidere come interpretare un’immagine di riferimento.

L’articolo afferma:

‘Esperienze estensive sul nostro benchmark dimostrano che CompleteMe supera i metodi attuali, sia basati su riferimenti che non, in termini di metriche quantitative, risultati qualitativi e studi utente.

‘In particolare in scenari impegnativi che coinvolgono pose complesse, modelli di abbigliamento intricati e accessori distintivi, il nostro modello raggiunge costantemente una fedeltà visiva e una coerenza semantica superiori.’

Purtroppo, la presenza del progetto su GitHub non contiene codice, né promette di averne, e l’iniziativa, che ha anche una modesta pagina del progetto, sembra essere inquadrata come un’architettura proprietaria.

Ulteriore esempio delle prestazioni soggettive del nuovo sistema rispetto ai metodi precedenti. Ulteriori dettagli più avanti nell’articolo.

Metodo

La struttura CompleteMe è sostenuta da un U-Net di riferimento, che gestisce l’integrazione del materiale ausiliario nel processo, e un U-Net coeso, che accoglie una gamma più ampia di processi per ottenere il risultato finale, come illustrato nello schema concettuale seguente:

Lo schema concettuale per CompleteMe. Source: https://arxiv.org/pdf/2504.20042

Il sistema codifica prima l’immagine di input mascherata in una rappresentazione latente. Allo stesso tempo, il U-Net di riferimento elabora più immagini di riferimento – ciascuna mostrante diverse regioni del corpo – per estrarre caratteristiche spaziali dettagliate.

Queste caratteristiche passano attraverso un blocco di attenzione focalizzato sulla regione (RFA) incorporato nel ‘completo’ U-Net, dove vengono mascherate selettivamente utilizzando maschere di regione corrispondenti, assicurando che il modello si concentri solo su aree rilevanti nelle immagini di riferimento.

Le caratteristiche mascherate vengono quindi integrate con caratteristiche semantiche globali derivate da CLIP attraverso un’attenzione incrociata decoupled, consentendo al modello di ricostruire il contenuto mancante con sia dettagli fini che coerenza semantica.

Per migliorare la realismo e la robustezza, il processo di mascheramento dell’input combina occlusioni a griglia casuali con maschere di forma del corpo umano, ciascuna applicata con probabilità uguale, aumentando la complessità delle aree mancanti che il modello deve completare.

Solo per riferimento

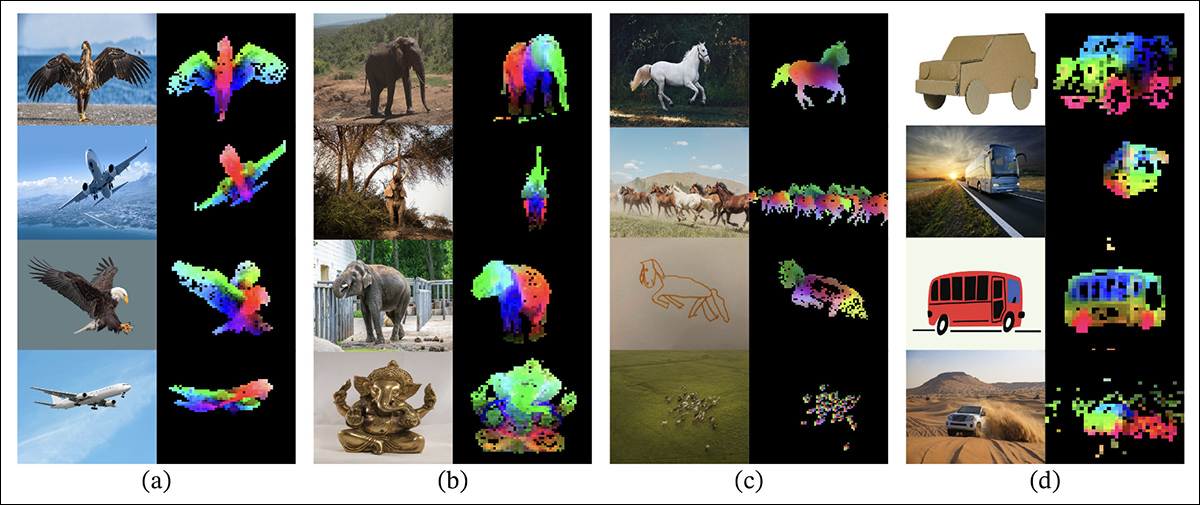

I metodi precedenti per la pittura di immagini basate su riferimenti si sono normalmente basati su encoder a livello semantico. Progetti di questo tipo includono CLIP stesso e DINOv2, entrambi estrarre caratteristiche globali dalle immagini di riferimento, ma spesso perdono i dettagli spaziali fini necessari per la conservazione accurata dell’identità.

Dall’articolo di rilascio per l’approccio più vecchio DINOV2, che è incluso nei test di confronto nel nuovo studio: le sovrapposizioni colorate mostrano i primi tre componenti principali dell’analisi dei componenti principali (PCA), applicata a patch di immagini all’interno di ogni colonna, evidenziando come DINOv2 raggruppi parti di oggetti simili insieme attraverso immagini variate. Nonostante le differenze di posa, stile o rendering, le regioni corrispondenti (come ali, arti o ruote) sono costantemente abbinate, illustrando la capacità del modello di apprendere la struttura a livello di parti senza supervisione. Source: https://arxiv.org/pdf/2304.07193

CompleteMe affronta questo aspetto attraverso un U-Net di riferimento specializzato inizializzato da Stable Diffusion 1.5, ma operante senza il rumore di diffusione*.

Ogni immagine di riferimento, che copre diverse regioni del corpo, viene codificata in caratteristiche latenti dettagliate attraverso questo U-Net. Le caratteristiche semantiche globali vengono estratte separatamente utilizzando CLIP e entrambi i set di caratteristiche vengono memorizzati per un uso efficiente durante l’integrazione basata sull’attenzione. Quindi, il sistema può accogliere flessibilmente più input di riferimento, conservando al contempo le informazioni di aspetto a grana fine.

Orchestrazione

Il U-Net coeso gestisce le fasi finali del processo di completamento. Adattato dalla variante di inpainting di Stable Diffusion 1.5, accetta come input l’immagine di input mascherata in forma latente, insieme a caratteristiche spaziali dettagliate tratte dalle immagini di riferimento e caratteristiche semantiche globali estratte dal codificatore CLIP.

Questi vari input vengono riuniti attraverso il blocco RFA, che svolge un ruolo critico nel dirigere l’attenzione del modello verso le aree più rilevanti del materiale di riferimento.

Prima di entrare nel meccanismo di attenzione, le caratteristiche di riferimento vengono mascherate esplicitamente per rimuovere le aree non correlate e quindi concatenate con la rappresentazione latente dell’immagine di input, assicurando che l’attenzione sia diretta il più precisamente possibile.

Per migliorare questa integrazione, CompleteMe incorpora un meccanismo di attenzione incrociata decoupled adattato dal framework IP-Adapter:

IP-Adapter, parte del quale è incorporata in CompleteMe, è uno dei progetti più di successo e più utilizzato degli ultimi tre anni di sviluppo nelle architetture di modelli di diffusione latente. Source: https://ip-adapter.github.io/

Ciò consente al modello di elaborare caratteristiche visive spazialmente dettagliate e un contesto semantico più ampio attraverso flussi di attenzione separati, che vengono successivamente combinati, risultando in una ricostruzione coerente che, gli autori sostengono, conserva sia l’identità che i dettagli a grana fine.

Valutazione

In assenza di un set di dati appropriato per il completamento di immagini umane basate su riferimenti, i ricercatori hanno proposto il proprio. Il benchmark (senza nome) è stato costruito curando selezionate coppie di immagini dal set di dati WPose progettato per il progetto UniHuman di Adobe Research del 2023.

Esempi di pose dal progetto UniHuman di Adobe Research del 2023. Source: https://github.com/adobe-research/UniHuman?tab=readme-ov-file#data-prep

I ricercatori hanno disegnato manualmente maschere di input per indicare le aree di inpainting, ottenendo alla fine 417 gruppi di immagini tripartite costituiti da un’immagine di input, una maschera e un’immagine di riferimento.

Due esempi di gruppi derivati inizialmente dal set di dati di riferimento WPose, e curati estensivamente dai ricercatori del nuovo articolo.

Gli autori hanno utilizzato il modello di linguaggio LLaVA per generare promemoria di testo che descrivono le immagini di input.

Le metriche utilizzate sono state più estese del solito; oltre al solito Rapporto di segnale a rumore di picco (PSNR), Indice di similarità strutturale (SSIM) e Similarità di patch di immagine percepita appresa (LPIPS, in questo caso per la valutazione delle aree mascherate), i ricercatori hanno utilizzato DINO per punteggi di similarità; DreamSim per la valutazione dei risultati di generazione; e CLIP.

Dati e test

Per testare il lavoro, gli autori hanno utilizzato sia il modello predefinito Stable Diffusion V1.5 che il modello di inpainting 1.5. L’encoder di immagine del sistema ha utilizzato il modello Vision di CLIP, insieme a layer di proiezione – reti neurali modeste che ridisegnano o allineano le uscite di CLIP per farle corrispondere alle dimensioni delle caratteristiche interne utilizzate dal modello.

L’addestramento ha avuto luogo per 30.000 iterazioni su otto GPU NVIDIA A100†, supervisionato da errore quadratico medio (MSE), con una dimensione del batch di 64 e una velocità di apprendimento di 2×10-5. Vari elementi sono stati rilasciati casualmente durante l’addestramento, per evitare che il sistema sovrapprenda i dati.

Il set di dati è stato modificato dal set di dati Parts to Whole, a sua volta basato sul set di dati DeepFashion-MultiModal.

Esempi dal set di dati Parts to Whole, utilizzato nello sviluppo dei dati curati per CompleteMe. Source: https://huanngzh.github.io/Parts2Whole/

Gli autori affermano:

‘Per soddisfare le nostre esigenze, abbiamo ricostruito le coppie di addestramento utilizzando immagini oscurate con più immagini di riferimento che catturano vari aspetti dell’aspetto umano insieme ai loro brevi etichette testuali.

‘Ogni campione nei nostri dati di addestramento include sei tipi di aspetto: abbigliamento superiore, abbigliamento inferiore, abbigliamento completo, capelli o copricapo, viso e scarpe. Per la strategia di mascheramento, applichiamo il 50% di mascheramento a griglia casuale tra 1 e 30 volte, mentre per l’altro 50%, utilizziamo una maschera di forma del corpo umano per aumentare la complessità del mascheramento.

‘Dopo il pipeline di costruzione, abbiamo ottenuto 40.000 coppie di immagini per l’addestramento.’

I metodi rivali precedenti non basati su riferimenti testati sono stati Large occluded human image completion (LOHC) e il modello di inpainting di immagini plug-and-play BrushNet; i modelli basati su riferimenti testati sono stati Paint-by-Example; AnyDoor; LeftRefill; e MimicBrush.

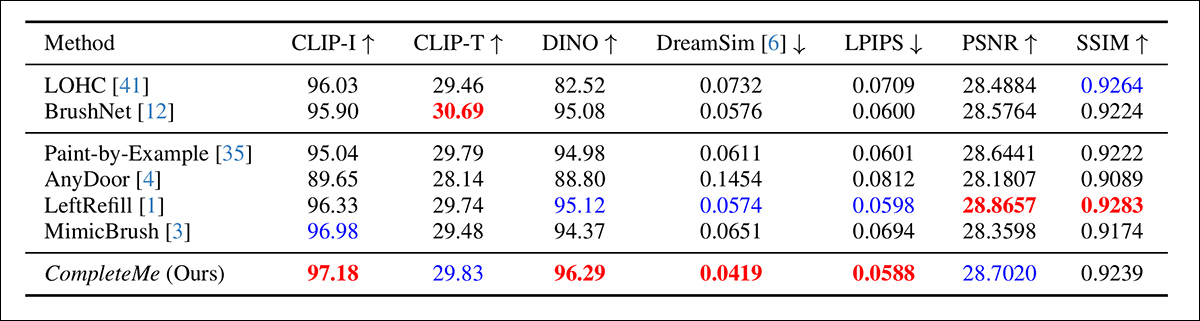

Gli autori hanno iniziato con un confronto quantitativo sulle metriche precedentemente menzionate:

Risultati del confronto quantitativo iniziale.

Per quanto riguarda la valutazione quantitativa, gli autori notano che CompleteMe raggiunge i punteggi più alti nella maggior parte delle metriche percettive, tra cui CLIP-I, DINO, DreamSim e LPIPS, che sono intese a catturare l’allineamento semantico e la fedeltà dell’aspetto tra l’output e l’immagine di riferimento.

Tuttavia, il modello non supera tutti i metodi di base in tutti gli aspetti. In particolare, BrushNet ottiene il punteggio più alto su CLIP-T, LeftRefill guida in SSIM e PSNR, e MimicBrush supera leggermente su CLIP-I.

Sebbene CompleteMe mostri risultati costantemente forti nel complesso, le differenze di prestazioni sono modeste in alcuni casi, e alcune metriche rimangono guidate da metodi rivali precedenti. Forse non ingiustamente, gli autori inquadrano questi risultati come prova della forza equilibrata di CompleteMe sia nelle dimensioni strutturali che percettive.

Le illustrazioni per i test qualitativi intrapresi per lo studio sono troppo numerose per essere riprodotte qui, e ci riferiamo al lettore non solo all’articolo originale, ma anche al PDF supplementare estensivo, che contiene molti esempi qualitativi aggiuntivi.

Evidenziamo gli esempi qualitativi principali presentati nel paper principale, insieme a una selezione di casi aggiuntivi tratti dal pool di immagini supplementari introdotto all’inizio di questo articolo:

Risultati qualitativi iniziali presentati nel paper principale. Si prega di fare riferimento all’articolo originale per una risoluzione migliore.

Dei risultati qualitativi visualizzati sopra, gli autori commentano:

‘Date immagini di input mascherate, questi metodi non basati su riferimenti generano contenuti plausibili per le aree mascherate utilizzando priori di immagine o prompt di testo.

‘Tuttavia, come indicato nella casella rossa, non possono riprodurre dettagli specifici come tatuaggi o modelli di abbigliamento unici, poiché mancano di immagini di riferimento per guidare la ricostruzione di informazioni identiche.’

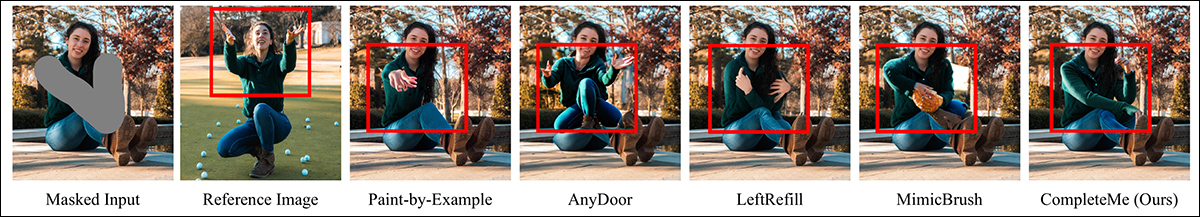

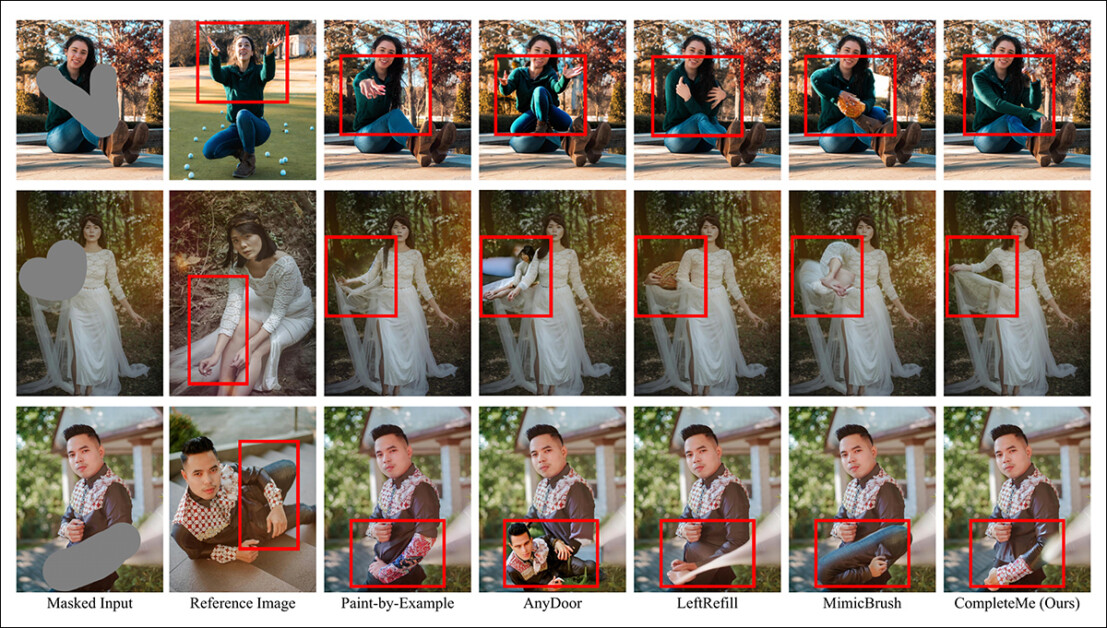

Un secondo confronto, parte del quale è mostrato di seguito, si concentra sui quattro metodi basati su riferimenti Paint-by-Example, AnyDoor, LeftRefill e MimicBrush. Qui è stata fornita solo un’immagine di riferimento e un prompt di testo.

Confronto qualitativo con metodi basati su riferimenti. CompleteMe produce completamenti più realistici e conserva meglio i dettagli specifici dall’immagine di riferimento. Le caselle rosse evidenziano aree di particolare interesse.

Gli autori affermano:

‘Date un’immagine umana mascherata e un’immagine di riferimento, altri metodi possono generare contenuti plausibili ma spesso falliscono nel conservare informazioni contestuali dall’immagine di riferimento in modo accurato.

‘In alcuni casi, generano contenuti non pertinenti o mappano in modo errato parti corrispondenti dall’immagine di riferimento. Al contrario, CompleteMe completa efficacemente l’area mascherata conservando accuratamente informazioni identiche e mappando correttamente parti corrispondenti del corpo umano dall’immagine di riferimento.’

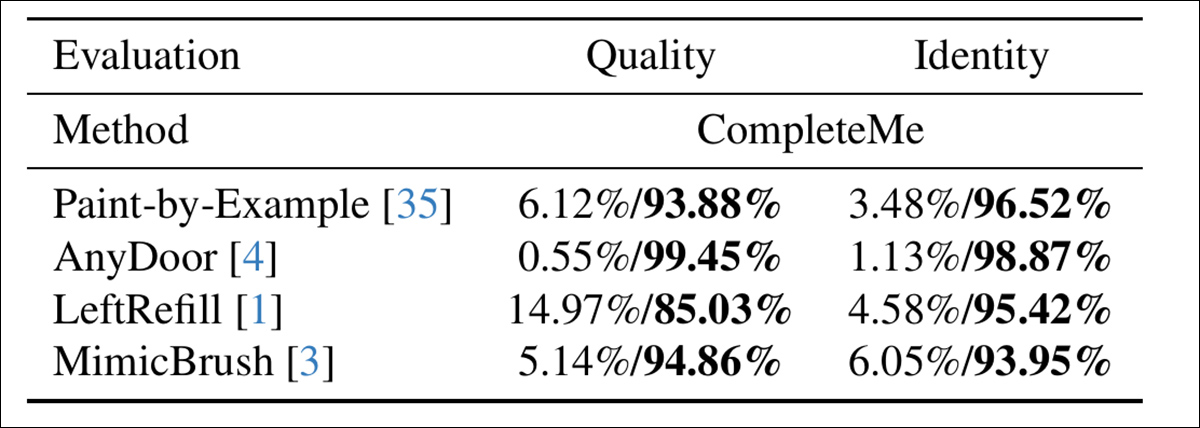

Per valutare quanto bene i modelli si allineano con la percezione umana, gli autori hanno condotto uno studio utente che ha coinvolto 15 annotatori e 2.895 coppie di campioni. Ogni coppia ha confrontato l’output di CompleteMe con uno dei quattro metodi basati su riferimenti: Paint-by-Example, AnyDoor, LeftRefill o MimicBrush.

Gli annotatori hanno valutato ogni risultato in base alla qualità visiva dell’area completata e alla misura in cui conserva le caratteristiche di identità dall’immagine di riferimento – e qui, valutando la qualità complessiva e l’identità, CompleteMe ha ottenuto un risultato più definitivo:

Risultati dello studio utente.

Conclusione

Se qualcosa, i risultati qualitativi in questo studio sono compromessi dalla loro stessa quantità, poiché un esame attento indica che il nuovo sistema è un’entrata molto efficace in questo settore relativamente di nicchia ma molto ambito di editing di immagini neurali.

Tuttavia, richiede un po’ di cura e zoom in per apprezzare quanto bene il sistema adatti il materiale di riferimento all’area oscurata in confronto (in quasi tutti i casi) ai metodi precedenti.

Consigliamo vivamente al lettore di esaminare attentamente i risultati presentati nel materiale supplementare.