Intelligenza Artificiale

MINT-1T: scalabilità dei dati multimodali open source di 10 volte

L'addestramento dei modelli multimodali di grandi dimensioni (LMM) di frontiera richiede set di dati su larga scala con sequenze interlacciate di immagini e testo in formato libero. Sebbene gli LMM open source si siano evoluti rapidamente, esiste ancora una grave mancanza di set di dati interleaved multimodali su larga scala che siano open source. L’importanza di questi set di dati non può essere sopravvalutata, poiché costituiscono la base per la creazione di sistemi di intelligenza artificiale avanzati in grado di comprendere e generare contenuti attraverso diverse modalità. Senza una fornitura sufficiente di set di dati completi e interlacciati, il potenziale per lo sviluppo di LMM più sofisticati e capaci è notevolmente ostacolato. Questi set di dati consentono ai modelli di apprendere da una vasta gamma di input, rendendoli più versatili ed efficaci in varie applicazioni. Inoltre, la scarsità di tali set di dati rappresenta una sfida per la comunità open source, che fa affidamento su risorse condivise per promuovere l’innovazione e la collaborazione.

Gli LMM open source hanno compiuto passi da gigante negli ultimi anni, ma la loro crescita è ostacolata dalla limitata disponibilità di set di dati interlacciati su larga scala. Per superare questo ostacolo, sono necessari sforzi concertati per curare, annotare e rilasciare set di dati più completi che possano supportare lo sviluppo e il perfezionamento continui dei modelli multimodali. Inoltre, la creazione e la diffusione di questi set di dati comportano il superamento di diversi ostacoli tecnici e logistici. La raccolta dati deve essere ampia e rappresentativa dei diversi contesti in cui verranno impiegati gli LMM. L'annotazione richiede un'attenta valutazione per garantire che le sequenze interlacciate di immagini e testo siano allineate in modo da migliorare le capacità di apprendimento del modello. Inoltre, garantire che i set di dati siano open source implica affrontare considerazioni legali ed etiche relative alla privacy dei dati e ai diritti di utilizzo. Ampliare la disponibilità di set di dati interlacciati multimodali di alta qualità su larga scala è essenziale per il futuro della ricerca e dello sviluppo dell'intelligenza artificiale. Affrontando l'attuale scarsità, la comunità dell'intelligenza artificiale può promuovere una maggiore innovazione e collaborazione, portando alla creazione di LMM più potenti e versatili, in grado di affrontare problemi complessi del mondo reale.

Basandosi su questa nota, MINT-1T, il set di dati open source interleaved multimodale più grande e diversificato fino ad oggi. MINT-1T: una scala 10 volte più grande, inclusi un trilione di token di testo e 3.4 miliardi di immagini rispetto ai set di dati open source esistenti. Il set di dati MINT-1T introduce anche fonti mai esposte come file PDF e documenti ArXiv. Poiché i set di dati interleaved multimodali non si adattano facilmente, è importante che il set di dati MINT-1T condivida il processo di data curation in modo che anche altri possano eseguire esperimenti su tali varianti ricche di informazioni. Il set di dati MINT-1T dimostra che il suo metodo; I modelli LM addestrati su MINT-1T sono competitivi (anche se in qualche modo) rispetto ai precedenti OBELIC all'avanguardia.

MINT-1T: un set di dati multimodale con un trilione di token

Grandi set di dati pre-formazione open source sono stati fondamentali per la comunità di ricerca nell'esplorazione dell'ingegneria dei dati e nella formazione di modelli trasparenti e open source. Nel dominio del testo, i primi lavori come C4 e The Pile hanno svolto un ruolo cruciale nel consentire alla comunità di addestrare la prima serie di modelli linguistici di grandi dimensioni open source come GPT-J, GPT-Neo e altri. Questi sforzi fondamentali hanno anche aperto la strada a successivi miglioramenti nei metodi di filtraggio e nella scalabilità dei dati. Allo stesso modo, nello spazio immagine-testo, set di dati open source su larga scala hanno stimolato innovazioni in metodi migliori di data curation, come le reti di filtraggio dei dati e T-MARS. Si registra un notevole spostamento dai laboratori di frontiera alla formazione modelli multimodali di grandi dimensioni (LMM) che richiedono estesi set di dati interleaved multimodali comprendenti sequenze in formato libero di immagini e testo. Man mano che le capacità dei modelli di frontiera avanzano rapidamente, sta emergendo un divario significativo nei dati di addestramento multimodale tra modelli chiusi e open source. Gli attuali set di dati interleaved multimodali open source sono più piccoli e meno diversificati rispetto alle loro controparti di solo testo, poiché provengono principalmente da documenti HTML, il che limita l'ampiezza e la varietà dei dati. Questa limitazione impedisce lo sviluppo di robusti LMM open source e crea una disparità tra le capacità dei modelli open source e closed source.

Per colmare questa lacuna, MINT-1T è stato creato come il set di dati interleaved multimodale open source più grande e diversificato fino ad oggi. MINT-1T contiene un totale di un trilione di token di testo e tre miliardi di immagini, provenienti da origini diverse come HTML, PDF e ArXiv. Prima di MINT-1T, il più grande set di dati open source in quest’area era OBELICS, che comprendeva 115 miliardi di token di testo e 353 milioni di immagini, tutti provenienti da HTML.

I contributi di MINT-1T sono i seguenti:

- Ingegneria dei dati: Il ridimensionamento di questi dati interlacciati multimodali rappresenta una sfida ingegneristica maggiore rispetto alla creazione di set di dati di solo testo o di coppie immagine-testo. Gestire documenti di dimensioni molto più grandi e preservare l'ordine originale di immagini e testo è fondamentale.

- Diversità: MINT-1T è il primo nello spazio interleaved multimodale a raccogliere documenti multimodali di alta qualità su larga scala da fonti come CommonCrawl PDFs e ArXiv.

- Esperimenti modello: Gli esperimenti mostrano che gli LMM addestrati su MINT-1T non solo eguagliano, ma potenzialmente superano, le prestazioni dei modelli addestrati sul miglior set di dati open source esistente, OBELICS, offrendo allo stesso tempo un aumento di scala di dieci volte.

MINT-1T: costruzione del set di dati

MINT-1T gestisce un dataset open source su larga scala che utilizza fonti più diversificate di documenti interlacciati, come PDF e articoli ArXiv. Questa sezione descrive in dettaglio i metodi di MINT-1T per l'approvvigionamento di documenti multimodali, il filtraggio di contenuti di bassa qualità, la deduplicazione dei dati e la rimozione di materiale non sicuro per il lavoro o NSFW e indesiderato. Il dataset finale comprende 922 miliardi (B) di token HTML, 106 miliardi di token PDF e 9 miliardi di token ArXiv.

Approvvigionamento di grandi quantità di documenti multimodali

Pipeline HTML

MINT-1T segue il metodo OBELICS per estrarre documenti multimodali interleaved dai file WARC CommonCrawl analizzando l'albero DOM di ciascuna voce WARC. Mentre OBELICS ha elaborato solo i documenti da febbraio 2020 a febbraio 2023 CommonCrawl dump, MINT-1T ha ampliato il pool di documenti per includere documenti HTML da maggio 2017 ad aprile 2024 (con dump completi da ottobre 2018 ad aprile 2024 e dump parziali degli anni precedenti). Similmente a OBELICS, MINT-1T filtra i documenti che non contengono immagini, più di trenta immagini o qualsiasi immagine con URL che includono sottostringhe inappropriate come logo, avatar, porno e xxx.

Conduttura PDF

MINT-1T genera documenti PDF dai file WAT CommonCrawl dai dump da febbraio 2023 ad aprile 2024. Inizialmente, tutti i collegamenti PDF vengono estratti da questi dump. MINT-1T tenta quindi di scaricare e leggere i PDF utilizzando PyMuPDF, scartando i PDF superiori a 50 MB (probabilmente contenenti immagini di grandi dimensioni) e quelli lunghi più di 50 pagine. Sono escluse le pagine senza testo e per le restanti pagine viene stabilito un ordine di lettura. L'ordine di lettura viene determinato trovando il riquadro di delimitazione di tutti i blocchi di testo su una pagina, raggruppando i blocchi in base alle colonne e ordinandoli dall'alto a sinistra all'angolo in basso a destra. Le immagini vengono integrate nella sequenza in base alla loro vicinanza ai blocchi di testo sulla stessa pagina.

Gasdotto ArXiv

MINT-1T crea documenti interfogliati ArXiv dal codice sorgente LaTeX utilizzando TexSoup per trovare tag di figure e intercalare immagini con il testo cartaceo. Per documenti multifile, MINT-1T identifica il file Tex principale e sostituisce i tag di input con il contenuto dei suoi file. Il codice LaTeX viene ripulito rimuovendo importazioni, bibliografia, tabelle e tag di citazione. Poiché ArXiv è già un'origine dati altamente curata, non vengono eseguiti ulteriori filtri e deduplicazioni.

Filtraggio della qualità del testo

MINT-1T evita di utilizzare euristiche basate su modelli per il filtraggio del testo, seguendo le pratiche stabilite da RefinedWeb, Dolma e FineWeb. Inizialmente, i documenti non inglesi vengono eliminati utilizzando il modello di identificazione della lingua di Fasttext (con una soglia di confidenza di 0.65). Vengono rimossi anche i documenti con URL contenenti sottostringhe NSFW per escludere contenuti pornografici e indesiderati. Vengono applicati i metodi di filtraggio del testo di RefinedWeb, rimuovendo in particolare i documenti con un numero eccessivo di n-grammi duplicati o quelli identificati come di bassa qualità utilizzando le regole MassiveText.

Filtro immagine

Dopo aver curato PDF e file HTML, MINT-1T tenta di scaricare tutti gli URL di immagine nel set di dati HTML, scartando collegamenti non recuperabili e rimuovendo documenti senza collegamenti immagine validi. Le immagini inferiori a 150 pixel vengono scartate per evitare immagini rumorose come loghi e icone e vengono rimosse anche le immagini più grandi di 20,000 pixel poiché di solito corrispondono a immagini fuori tema. Per i documenti HTML, le immagini con proporzioni maggiori di due vengono rimosse per filtrare le immagini di bassa qualità come i banner pubblicitari. Per i PDF, la soglia viene portata a tre per preservare figure e tabelle scientifiche.

La figura sopra rappresenta come MINT-1T includa in modo univoco dati da PDF e documenti ArXiv oltre le origini HTML.

Filtraggio di sicurezza

- Filtraggio immagini NSFW: MINT-1T applica un rilevatore di immagini NSFW a tutte le immagini nel set di dati. Se un documento contiene una singola immagine NSFW, l'intero documento viene scartato.

- Rimozione delle informazioni di identificazione personale: per mitigare il rischio di fuga di dati personali, gli indirizzi e-mail e gli indirizzi IP nei dati di testo vengono resi anonimi. Le email vengono sostituite con modelli come "[email protected]" e IP con IP non funzionali generati casualmente.

Deduplica

MINT-1T esegue la deduplicazione del testo di paragrafi e documenti all'interno di ogni snapshot CommonCrawl e la deduplicazione delle immagini per rimuovere immagini ripetitive e non informative come icone e loghi. Tutti i passaggi di deduplicazione vengono condotti separatamente per ciascuna origine dati.

Deduplicazione di paragrafi e documenti

Seguendo la metodologia di Dolma, MINT-1T utilizza un filtro Bloom per un'efficiente deduplicazione del testo, impostando il tasso di falsi positivi su 0.01 e deduplicando paragrafi da 13 grammi (indicati tramite doppi delimitatori di nuova riga) da ciascun documento. Se più dell'80% dei paragrafi di un documento sono duplicati, l'intero documento viene scartato.

Rimozione del testo standard comune

Dopo la deduplicazione dei paragrafi, MINT-1T rimuove le brevi frasi standard comuni nei documenti HTML, come "Salta al contenuto" o "Archivio blog". Ciò viene fatto eseguendo la deduplicazione esatta dei paragrafi sul 2% di ogni snapshot CommonCrawl, in linea con le pratiche CCNet, garantendo principalmente la rimozione del testo standard comune.

La figura sopra mostra il processo di filtraggio per MINT-1T e mostra come i token vengono rimossi attraverso la pipeline di dati per documenti HTML, PDF e ArXiv.

Deduplicazione delle immagini

All'interno di ogni snapshot CommonCrawl, MINT-1T rimuove le immagini ricorrenti in base agli hash SHA256. Invece di una deduplica rigorosa, vengono rimosse solo le immagini che appaiono più di dieci volte all'interno di uno snapshot, seguendo le pratiche Multimodal-C4. Coerentemente con OBELICS, le immagini ripetute all'interno di un singolo documento vengono rimosse, mantenendo solo la prima occorrenza.

Infrastruttura

Durante l'elaborazione dei dati, MINT-1T ha avuto accesso a una media di 2,350 core CPU da un mix di nodi da 190 e 90 processori. In totale, per creare questo set di dati sono state utilizzate circa 4.2 milioni di ore CPU.

Confronto della composizione del documento in MINT-1T con OBELICS

Nel valutare la composizione dei set di dati interfogliati, vengono esaminate due caratteristiche chiave: la distribuzione dei token di testo per documento e il numero di immagini per documento. Per questa analisi, 50,000 documenti sono stati campionati casualmente sia da OBELICS che da ciascuna fonte dati in MINT-1T. GPT-2 tokenizer è stato utilizzato per calcolare il numero di token di testo. I valori anomali sono stati rimossi escludendo i documenti che non rientravano nell'intervallo interquartile di 1.5 per il numero di token di testo e immagini. Come mostrato nella figura seguente, il sottoinsieme HTML di MINT-1T si allinea strettamente con la distribuzione dei token vista in OBELICS. Tuttavia, i documenti provenienti da PDF e ArXiv tendono ad essere in media più lunghi dei documenti HTML, evidenziando i vantaggi di reperire dati da fonti diverse. La Figura 5 esamina la densità delle immagini in tutti i documenti, rivelando che i documenti PDF e ArXiv contengono più immagini rispetto ai documenti HTML, con i campioni ArXiv che sono quelli più densi di immagini.

In che modo le diverse origini dati migliorano la diversità dei documenti?

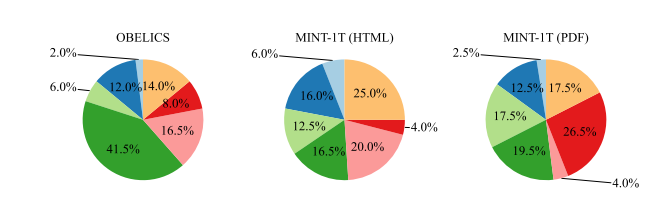

Una motivazione importante per espandere il pool di documenti multimodali oltre l'HTML è il miglioramento della copertura del dominio. Per quantificare la diversità e la profondità di questa copertura, è stato addestrato un modello Latent Dirichlet Allocation (LDA) su 100,000 documenti campionati dal set di dati OBELICS, dal sottoinsieme HTML di MINT-1T e dal sottoinsieme PDF (escluso ArXiv) da MINT-1T a ottieni 200 argomenti. GPT-4 è stato quindi utilizzato per classificare l’insieme di parole per identificare i domini dominanti – come Salute e Medicina, Scienza, Affari, Studi umanistici, Storia, ecc. – in base ai domini MMMU. L’analisi rivela tendenze distinte nella distribuzione dei domini:

- OBELICI: Questo set di dati mostra una marcata concentrazione nelle “Scienze umanistiche e sociali”. Ciò può essere attribuito al suo processo di costruzione dei dati, che comporta il filtraggio di documenti che non assomigliano agli articoli di Wikipedia, alterando così potenzialmente la distribuzione verso contenuti di conoscenza più generale e incentrati sulle discipline umanistiche.

- Sottoinsieme HTML di MINT-1T: A differenza di OBELICS, il sottoinsieme HTML di MINT-1T non è fortemente sbilanciato verso alcun dominio specifico, suggerendo una rappresentazione del dominio più ampia e più equilibrata.

- Sottoinsieme PDF di MINT-1T: C'è una percentuale maggiore di documenti "Scienza e tecnologia" all'interno dei documenti PDF di MINT-1T. Questa tendenza è probabilmente dovuta alla natura della comunicazione scientifica, dove i PDF sono il formato preferito per condividere documenti di ricerca dettagliati e rapporti tecnici.

MINT-1T: Risultati ed esperimenti

Per tutti gli esperimenti, MINT-1T addestra il modello su batch di sottotitoli immagine-testo al 50% e batch interleaved multimodali al 50%. Viene campionato un massimo di 2048 token multimodali da ciascun documento interfogliato e 340 token da ciascun campione di immagine-testo. Similmente a Flamingo, viene aggiunto un token “fine” per indicare la fine di una sequenza immagine-testo adiacente. Durante l'addestramento, il 50% dei documenti interfogliati a immagine singola vengono rilasciati in modo casuale per sovracampionare documenti a più immagini. Il set di dati immagine-testo è composto da una miscela di set di dati di didascalie curati internamente. La capacità del modello di ragionare su sequenze interlacciate multimodali viene valutata attraverso le sue capacità di apprendimento nel contesto e le prestazioni di ragionamento su più immagini.

La figura sopra illustra la percentuale di documenti di ciascun dominio in MMMU per OBELICS e sottoinsiemi di MINT-1T.

Apprendimento in contesto: I modelli vengono valutati sulle prestazioni di apprendimento in contesto a quattro e otto riprese su vari benchmark di sottotitoli (COCO (test di Karpathy) e TextCaps (convalida)) e set di dati di risposta visiva alle domande (VQAv2 (convalida), OK-VQA (convalida) , TextVQA (convalida) e VizWiz (convalida)). Le dimostrazioni vengono campionate casualmente dal set di addestramento. Viene calcolata la media dei punteggi su più esecuzioni di valutazione, con dimostrazioni randomizzate per tenere conto della sensibilità ai suggerimenti scelti. Vengono cancellati diversi prompt per ciascuna attività per selezionare quelli con le migliori prestazioni.

Ragionamento su più immagini: I modelli vengono valutati su MMMU (contenente domande sia a immagine singola che a più immagini) e Mantis-Eval (tutte le domande a più immagini) per sondare le capacità di ragionamento su più immagini oltre le valutazioni di apprendimento nel contesto.

Formazione sui documenti HTML

Inizialmente, la porzione HTML di MINT-1T viene confrontata con OBELICS, poiché OBELICS è il precedente set di dati interleaved principale, anch'esso curato da documenti HTML. Due modelli vengono addestrati sulle porzioni HTML di MINT-1T e OBELICS per un totale di token multimodali da 10 miliardi. Viene valutata la loro prestazione di apprendimento nel contesto. La tabella seguente presenta le prestazioni a 4 e 8 colpi rispetto ai benchmark comuni; il modello addestrato su documenti HTML MINT-1T funziona meglio di OBELICS sulle attività VQA ma peggio sui benchmark dei sottotitoli. In media, OBELICS ha prestazioni leggermente migliori di MINT-1T (HTML).

Aggiunta di documenti PDF e ArXiv

Successivamente, la formazione viene condotta sulle origini dati complete di MINT-1T, con una combinazione di documenti HTML, PDF e ArXiv. I documenti interfogliati sono campionati per il 50% da HTML, per il 45% da PDF e per il 5% da ArXiv. Il modello è addestrato per un totale di token multimodali da 10 miliardi. Come visto nella tabella sopra, il modello addestrato sulla combinazione completa di dati MINT-1T supera OBELICS e MINT-1T (HTML) sulla maggior parte dei benchmark di apprendimento in contesto. Su parametri di ragionamento multimodale più complessi, il modello MINT-1T supera OBELICS su MMMU ma ha prestazioni peggiori su Mantis-Eval.

Tendenze a grana fine

In che modo le prestazioni dell'apprendimento in contesto si adattano alle dimostrazioni?

Le prestazioni di apprendimento nel contesto vengono valutate quando richiesto con da una a otto dimostrazioni. Viene eseguita una singola prova per conteggio degli scatti per ciascun benchmark di valutazione. Come mostrato nella figura seguente, il modello addestrato su MINT-1T supera il modello addestrato sul sottoinsieme HTML di MINT-1T e OBELICS in tutti gli scatti. Il modello MINT-1T (HTML) ha prestazioni leggermente peggiori di OBELICS.

Prestazioni relative ai sottotitoli e alle attività di risposta visiva alle domande

La figura seguente presenta le prestazioni medie di apprendimento in contesto sui benchmark di sottotitoli e risposte visive alle domande (VQA). OBELICS supera tutte le varianti MINT-1T sui benchmark dei sottotitoli a quattro riprese e ha prestazioni leggermente peggiori rispetto a MINT-1T sui sottotitoli a otto riprese. Tuttavia, MINT-1T supera significativamente entrambe le linee di base sui benchmark VQA. MINT-1T (HTML) supera OBELICS anche nei compiti VQA.

Prestazioni su domini diversi

L'inclusione di diversi domini in MINT-1T ha lo scopo di migliorare la generalizzazione del modello. La figura precedente suddivide le prestazioni su MMMU per ciascun dominio. Fatta eccezione per il dominio Business, MINT-1T supera OBELICS e MINT-1T (HTML). L'aumento delle prestazioni nei domini scientifici e tecnologici per MINT-1T è attribuito alla prevalenza di questi domini nei documenti ArXiv e PDF.

Considerazioni finali

In questo articolo abbiamo parlato di MINT-1T, il dataset open source interleaved multimodale più grande e diversificato mai realizzato fino ad oggi. MINT-1T: una scala 10 volte più grande, inclusi un trilione di token di testo e 3.4 miliardi di immagini rispetto ai set di dati open source esistenti. Il set di dati MINT-1T introduce anche fonti mai esposte come file PDF e documenti ArXiv. Poiché i set di dati interleaved multimodali non si adattano facilmente, è importante che il set di dati MINT-1T condivida il processo di data curation in modo che anche altri possano eseguire esperimenti su tali varianti ricche di informazioni. Il set di dati MINT-1T dimostra che il suo metodo; I modelli LM addestrati su MINT-1T sono competitivi (anche se in qualche modo) rispetto ai precedenti OBELIC all'avanguardia.