Intelligenza artificiale

Router di modello e la trappola del feedback: come l’AI impara da se stessa

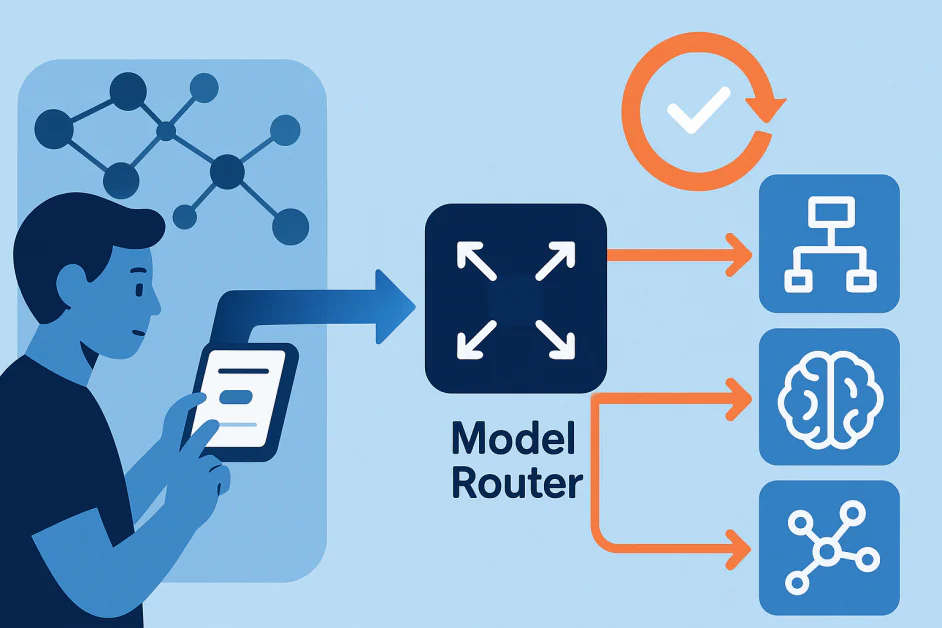

I moderni sistemi di intelligenza artificiale non sono più costruiti attorno a un singolo modello che gestisce ogni attività. Invece, si affidano a raccolte di modelli, ciascuno progettato per scopi specifici. Al centro di questa configurazione c’è il router di modello, un componente che interpreta una richiesta dell’utente e decide quale modello gestirla. Ad esempio, in sistemi come OpenAI’s GPT-5, un router potrebbe inviare una query semplice a un modello leggero per velocità mentre indirizza attività di ragionamento complesse a un modello più avanzato.

I router non sono solo gestori di traffico. Imparano dal comportamento degli utenti, come quando le persone passano da un modello all’altro o preferiscono certe risposte. Ciò crea un ciclo: il router assegna la query, il modello produce una risposta, le reazioni degli utenti forniscono feedback e il router aggiorna le sue decisioni. Quando questi cicli operano silenziosamente in background, possono formare anelli di feedback nascosti. Tali anelli possono amplificare i pregiudizi, rafforzare modelli difettosi o ridurre gradualmente le prestazioni in modi difficili da rilevare.

Questo articolo esamina come funzionano i router di modello, come emergono gli anelli di feedback e quali rischi pongono mentre i sistemi di intelligenza artificiale continuano a evolversi.

Comprendere i router di modello nell’AI

Un router di modello è lo strato di decision-making in un sistema di intelligenza artificiale multi-modello. Il suo ruolo è determinare quale modello si adatti meglio a un’attività. La scelta dipende da fattori come la complessità della query, l’intento dell’utente, il contesto e i compromessi tra costo, precisione e velocità.

A differenza dei sistemi che seguono regole fisse, la maggior parte dei router di modello sono sistemi di apprendimento automatico essi stessi. Sono addestrati su segnali del mondo reale e si adattano nel tempo. Possono imparare dal comportamento degli utenti come passare da un modello all’altro, valutare le risposte o riformulare le richieste, nonché da valutazioni automatiche che misurano la qualità dell’output.

Questa adattabilità rende i router potenti ma anche rischiosi. Migliorano l’efficienza e forniscono una migliore esperienza utente, ma gli stessi processi di feedback che raffinano le loro decisioni possono anche creare anelli di rinforzo. Nel tempo, questi anelli possono influenzare non solo le strategie di routing ma anche il comportamento del più ampio sistema di intelligenza artificiale.

Come si formano gli anelli di feedback

Un anello di feedback si verifica quando l’output di un sistema influenza i dati che apprenderà in seguito. Un esempio semplice è un sistema di raccomandazione: se fai clic su un video sportivo, il sistema ti mostra più contenuti sportivi, che a sua volta influenza cosa guardi dopo. Nel tempo, il sistema rafforza i propri modelli. Un altro esempio per comprendere l’anello di feedback è la polizia predittiva. Un algoritmo può prevedere una maggiore criminalità in certi quartieri, il che potrebbe portare a più pattuglie. Le pattuglie aumentate scoprono più incidenti, che a loro volta confermano la previsione dell’algoritmo. Il sistema sembra preciso, ma i dati sono distorti dalla sua stessa influenza. Gli anelli di feedback possono essere diretti o nascosti. Gli anelli diretti sono facili da riconoscere, come un sistema di raccomandazione che si riaddestra sulle proprie suggerimenti. Gli anelli nascosti sono più sottili perché sorgono quando diverse parti di un sistema influenzano indirettamente l’una sull’altra.

I router di modello possono creare anelli simili. Una decisione del router forma quale modello produce la risposta. Quella risposta forma il comportamento dell’utente, che diventa feedback per il router. Nel tempo, il router potrebbe iniziare a rafforzare modelli che hanno funzionato in passato piuttosto che scegliere costantemente il modello migliore. Questi anelli sono difficili da rilevare e possono spingere silenziosamente i sistemi di intelligenza artificiale in direzioni non intenzionali.

Perché gli anelli di feedback nei router sono rischiosi

Mentre gli anelli di feedback aiutano i router a migliorare l’abbinamento delle attività, portano anche rischi che possono distorcere il comportamento del sistema. Un rischio è il rafforzamento dei pregiudizi iniziali. Se un router invia ripetutamente una certa tipologia di query al Modello A, la maggior parte del feedback proviene dagli output del Modello A. Il router potrebbe quindi supporre che il Modello A sia sempre il migliore, mettendo da parte il Modello B, anche se potrebbe talvolta performare meglio. Questo utilizzo diseguale può diventare auto-rinforzante. I modelli che performano bene sulle attività indirizzate attirano più richieste, che rafforzano le loro forze. I modelli poco utilizzati ricevono meno possibilità di migliorare, creando squilibrio e riducendo la diversità.

I pregiudizi possono anche provenire dai modelli di valutazione utilizzati per giudicare la correttezza. Se il modello “giudice” ha punti ciechi, i suoi pregiudizi vengono passati direttamente al router, che ottimizza quindi per i valori del giudice piuttosto che per i reali bisogni degli utenti. Il comportamento degli utenti aggiunge un altro livello di complessità. Se un router tende a restituire certi stili di risposte, gli utenti potrebbero adattare le loro query per corrispondere a quei modelli, rafforzandoli ulteriormente. Nel tempo, ciò può restringere sia il comportamento degli utenti che le risposte del sistema. I router possono anche imparare ad associare certi modelli di query o demografici a modelli specifici. Ciò può portare a esperienze sistematicamente diverse tra gruppi, potenzialmente rafforzando e amplificando pregiudizi societali esistenti.

Un’altra preoccupazione chiave è la deriva a lungo termine. Le decisioni che un router prende oggi influenzano i dati di addestramento utilizzati domani. Se i modelli vengono riaddestrati sugli output influenzati dal routing, potrebbero imparare le preferenze del router piuttosto che approcci indipendenti. Ciò può rendere le risposte tra i modelli più uniformi e incorporare pregiudizi che persistono nel tempo.

Strategie per rompere il ciclo

Ridurre i rischi degli anelli nascosti richiede una progettazione attiva e una supervisione. L’addestramento dovrebbe utilizzare fonti di dati diverse, non solo i clic degli utenti o gli switch. L’indirizzamento casuale occasionale può anche prevenire che un modello monopolizzi un tipo di attività. La sorveglianza è essenziale. Audit regolari possono rivelare se un router sta derivando verso certi modelli o se si sta affidando eccessivamente a un singolo modello. La trasparenza nelle decisioni del router aiuta i ricercatori a rilevare i pregiudizi precocemente.

I router dovrebbero anche essere riaddestrati periodicamente con dati freschi e bilanciati in modo che i vecchi pregiudizi non si blocchino. L’incorporazione della supervisione umana, specialmente in domini sensibili, aggiunge un altro livello di responsabilità. Gli esseri umani possono identificare quando un router favorisce sistematicamente un modello o classifica erroneamente certe query.

La chiave è trattare il router come un modello soggetto a feedback, non come un componente fisso o neutrale. Riconoscendo come i router stessi sono plasmati dai dati che creano, i ricercatori e gli sviluppatori possono progettare sistemi che rimangono equi, adattivi e affidabili nel tempo.

Il punto fondamentale

I router di modello offrono benefici evidenti in termini di efficienza e adattabilità, ma portano anche rischi nascosti. Gli anelli di feedback all’interno di questi sistemi possono silenziosamente amplificare i pregiudizi, limitare la diversità delle risposte e bloccare i modelli in modelli di comportamento ristretti. Mentre queste architetture diventano più comuni, riconoscere e affrontare questi rischi precocemente sarà fondamentale per costruire sistemi di intelligenza artificiale che rimangono equi, affidabili e genuinamente adattivi.