Angolo di Anderson

L’intelligenza artificiale sta dividendo la ricerca web in tre realtà diverse

Una nuova ricerca ha scoperto che Google utilizza tre diversi sistemi di informazione all’interno del suo stesso impero di ricerca, con la ricerca tradizionale, le panoramiche di intelligenza artificiale e Gemini che favoriscono fonti, classifiche e contenuti diversi.

Il riduzionismo regna sovrano. Negli ultimi dodici mesi, il ‘Lascia che Google lo cerchi per te’ meme è stato superato da una nuova ‘Lascia che ti riassuma la ricerca di Google’ tendenza, in cui le panoramiche di intelligenza artificiale nei risultati di ricerca risparmiano sempre più ai lettori la fatica di cliccare sui collegamenti di ricerca (argomentando la defondazione dei siti di origine nel processo), condensando interi risultati di ricerca in poche righe generate.

Si potrebbe pensare che le conoscenze di base emerse e la scelta dei siti da cui trarre quelle conoscenze sarebbero relativamente simili in tutti e tre i metodi più popolari per cercare informazioni su Internet: nella ricerca web tradizionale; nelle panoramiche di intelligenza artificiale (AIO) che ora guidano la maggior parte dei risultati di ricerca web; e attraverso l’utilizzo crescente di LLM come ChatGPT come oracoli web (con o senza chiamate RAG esterne).

Tuttavia, una recente ricerca negli Stati Uniti indica che questo è, sorprendentemente, lontano dal caso; e che anche all’interno della trinità di oracoli di Google – SERPS*, riassunti di intelligenza artificiale e interazione diretta con la serie LLM Gemini – ci sono significative e interessanti discrepanze, per ogni percorso.

Diviso in tre

In un nuovo documento lucido ed esteso, intitolato How Generative AI Disrupts Search: An Empirical Study of Google Search, Gemini, and AI Overviews, sei ricercatori del New Jersey Institute of Technology delineano i modi in cui i tre metodi di ricerca stanno divergendo e offrono alcune possibili teorie per queste fratture nell’approccio.

Il documento afferma:

‘[Prima, abbiamo] scoperto che per il 51,5% delle query rappresentative e reali degli utenti, le AIO sono generate e visualizzate sopra i risultati di ricerca organici. Le domande controverse producono frequentemente un’AIO.

‘In secondo luogo, mostriamo che le fonti recuperate sono sostanzialmente diverse per ogni motore di ricerca (<0,2 media di similarità di Jaccard). La ricerca tradizionale di Google è significativamente più probabile che recuperi informazioni da siti web popolari o istituzionali nel governo o nell’istruzione, mentre i motori di ricerca generativi sono significativamente più probabili che recuperino contenuti di proprietà di Google.

‘In terzo luogo, osserviamo che i siti web che bloccano il crawler di intelligenza artificiale di Google sono significativamente meno probabili che vengano recuperati dalle AIO, nonostante abbiano accesso al contenuto.’

Poiché il documento è un insieme di insight affascinanti, piuttosto che conformarsi al solito flusso di lavoro lineare e guidato, daremo uno sguardo più da vicino a questi e ad alcuni altri dei suoi insight più sorprendenti e illuminanti.

Il vecchio ‘Due-Uno’

Una delle scoperte più interessanti nello studio indica che le panoramiche di intelligenza artificiale di Google tendono a essere soppressi per eventi di notizie che si verificano improvvisamente, poiché le fonti più precoci e disponibili potrebbero non essere le più accurate.

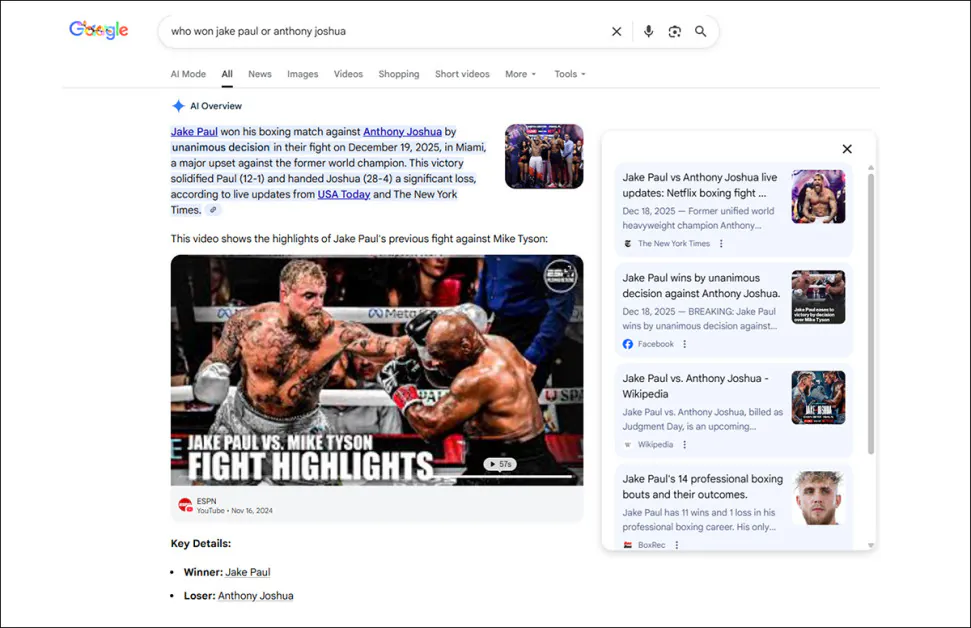

Questo sistema non funziona sempre: nell’esempio riportato di seguito, notato dai ricercatori, una panoramica di intelligenza artificiale di Google relativa al risultato di un incontro di boxe attribuiva la vittoria al pugile sbagliato, anche se l’unica fonte che affermava questo risultato (errato) era un feed satirico di sport su Facebook:

Una delle ragioni per cui le panoramiche di intelligenza artificiale di Google evitano le sintesi critiche è che le informazioni precoci possono essere incomplete o completamente inaccurate. In questo caso, il pugile Jake Paul ha effettivamente perso l’incontro. Fonte

I ricercatori notano che le AIO tendono ad apparire quando un evento è almeno di cinque giorni fa, il che lo qualifica come un’anomalia – ma comunque, una che i ricercatori sono stati in grado di evocare facilmente.

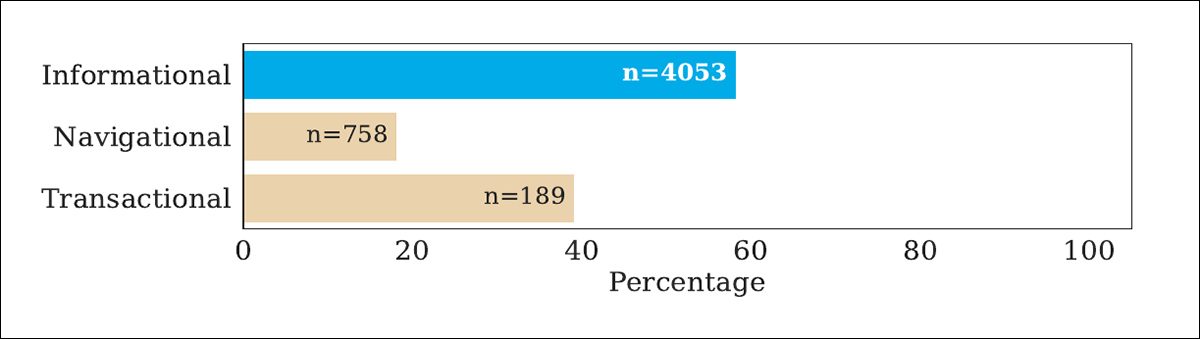

Le AIO sono state trovate più probabili di essere generate quando la query era chiusa con un punto interrogativo e che l’intento della query era un fattore nel determinare se un’AIO sarebbe stata presentata:

Percentuale di incidenti in cui è stata prodotta una panoramica di ricerca di intelligenza artificiale in uno dei test dei ricercatori. Qui ‘informativo’ indica domande dirette, che tendono a produrre AIO più di qualsiasi altro tipo di interazione.

Inoltre, il documento sostiene, le query più lunghe tendono a essere più probabili di produrre un riassunto di intelligenza artificiale invece di semplici risultati di ricerca, anche se gli autori non forniscono ancora una teoria per spiegare questo.

Un regno diviso

Forse il risultato più sorprendente del nuovo lavoro è la piccola sovrapposizione nei risultati di qualità/tipo tra i tre piattaforme di ricerca di Google.

Il documento ripete che la ricerca tradizionale di Google, le panoramiche di intelligenza artificiale e Gemini (LLM) recuperano fonti sorprendentemente diverse per la stessa query, con punteggi di sovrapposizione sufficientemente bassi da implicare tre logiche di recupero in competizione all’interno di una società, mentre gli utenti potrebbero supporre che Google abbia un indice autorevole e una filosofia di classificazione unica:

Anche all’interno dell’ecosistema di Google, la sovrapposizione tra la ricerca tradizionale, le panoramiche di intelligenza artificiale e Gemini si è rivelata sorprendentemente piccola, con la stessa query che produce spesso elenchi di fonti sostanzialmente diversi a seconda del sistema Google che ha gestito la richiesta. In questo confronto, vediamo quanto strettamente i tre sistemi si sono adattati l’uno all’altro su migliaia di query di ricerca, da argomenti di shopping e dibattiti a ricerche locali e domande di conoscenza generale, con punteggi più bassi che indicano meno accordo tra le fonti selezionate.

Riguardo a questa sezione della loro analisi, gli autori affermano†:

‘[La tabella sopra] presenta la media di similarità tra l’elenco di fonti restituite dalle AIO, Gemini e la ricerca tradizionale SERP per ogni query nel set di dati di riferimento.

‘Il punto principale è che a prescindere dalla query e dalla coppia di motori di ricerca confrontati, gli elenchi recuperati sono dissimili, nonostante tutti e tre siano stati sviluppati da Google.’

I ricercatori affermano inoltre che nessun metodo di ricerca testato ha dimostrato di avere un sovrapposizione di classificazione (RBO) superiore a 0,27, che è un punteggio molto basso. Notano inoltre che Amazon Retail e le query localizzate (ad esempio, ‘negozi vicino a me’) hanno avuto la minore similarità tra i metodi di ricerca.

Attribuiscono la bassa concordanza a ‘incoerenza fondamentale tra i motori di ricerca’, notando che né la casualità né altri fattori ovvi possono essere fatti per conto di questa dis-sincronizzazione.

Una spiegazione intuitiva, argomentabile, è che i punti di dati di formazione sono assegnati un rango in un modo molto diverso dai metodi che Google ha sviluppato per PageRank e i suoi successori negli ultimi due decenni. Inoltre, nel caso che l’algoritmo di ricerca di Google abbia un’agenda segreta, quel tipo di interferenza o ‘gioco’ è molto più difficile da implementare coerentemente in intelligenza artificiale basata sulla diffusione come Gemini (anche tramite il filtraggio, i prompt del sistema e i vari altri metodi di canalizzazione che vengono imposti sui modelli commerciali).

Auto-servizio..?

Alcuni siti web, o categorie di siti web, sembrano essere stati influenzati dall’avvento delle panoramiche di intelligenza artificiale e dall’intrusione della ricerca basata su LLM nello spazio di ricerca tradizionale – sia in modo negativo che positivo, a seconda del caso:

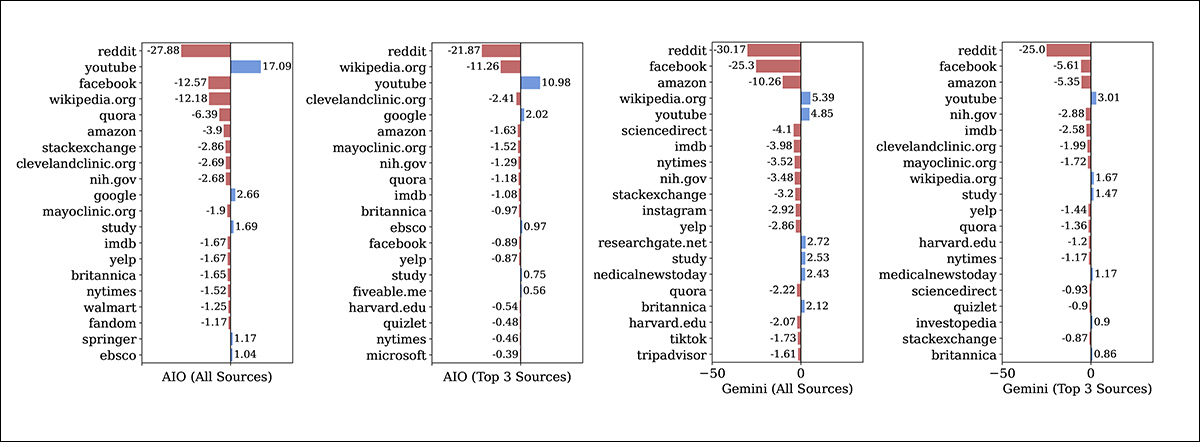

In confronto alla ricerca di Google tradizionale, le panoramiche di intelligenza artificiale e Gemini hanno ridotto le citazioni da molti siti web importanti, aumentando la visibilità per un numero più piccolo di domini preferiti. YouTube si è rivelato uno dei maggiori beneficiari in entrambi i sistemi, mentre Reddit, Wikipedia, Facebook e molte fonti istituzionali sono apparse meno frequentemente nel recupero generato da intelligenza artificiale.

Gli autori notano che alcune preferenze inaspettate emergono tra i tre metodi, durante i test:

‘Abbiamo tre principali conclusioni da [i grafici sopra]. In primo luogo, i siti web grandi e noti sono i più colpiti (sia positivamente che negativamente). Ciò è intuitivo poiché i siti web grandi hanno la reputazione e la diversità di contenuti per essere rilevanti per molte diverse query.

‘In secondo luogo, la stragrande maggioranza di questi siti web riceve meno citazioni totali e meno citazioni nei primi tre con i motori di ricerca generativi (indicati da barre rosse e numeri negativi in [grafici sopra]). Ciò suggerisce che la ricerca generativa tende a recuperare informazioni da fonti più nicchie rispetto ai motori di ricerca tradizionali.

‘In terzo luogo, le panoramiche di intelligenza artificiale di Google favoriscono i siti web di Google (ad esempio, domini google.com e youtube.com).

‘Gemini favorisce anche YouTube rispetto alla ricerca di Google tradizionale, ma la differenza assoluta è più piccola.’

Qualsiasi ‘blocco’..?

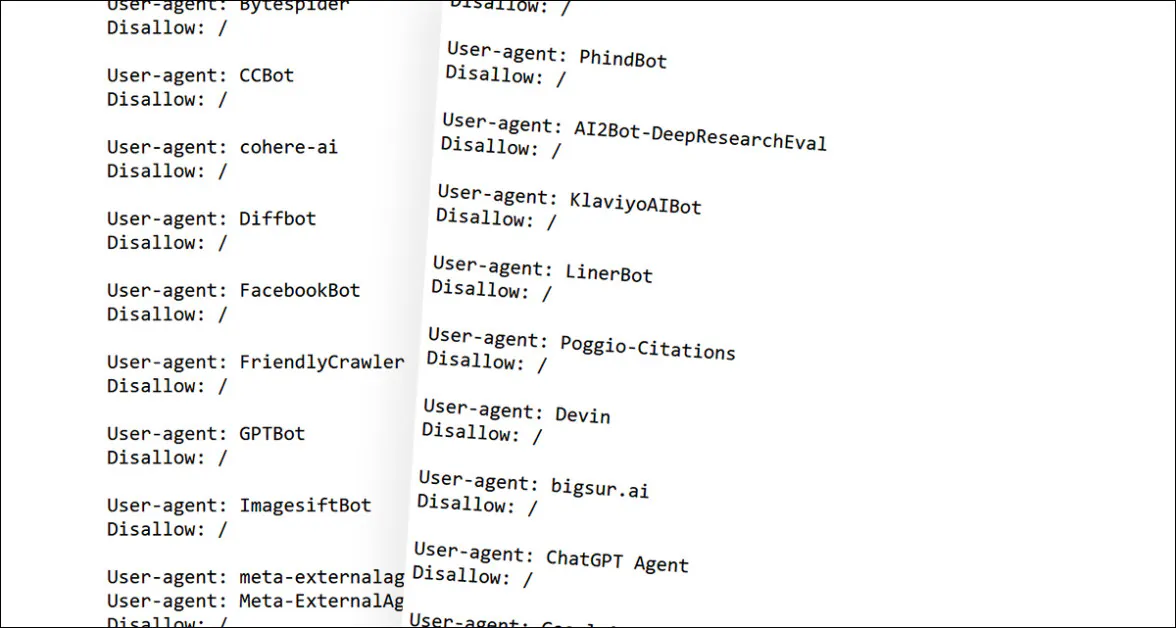

Lo studio ha scoperto che i publisher che bloccano il crawler di intelligenza artificiale di Google – il web-bot automatizzato che raschia dati dal tuo sito a meno che non glielo dica di non farlo con un file robots.txt – tendono a non apparire nelle panoramiche di intelligenza artificiale.

Ciò potrebbe sembrare un’autovittoria ovvia, ma in realtà Google ha dichiarato pubblicamente che il contenuto dei siti che bloccano i crawler di intelligenza artificiale non sarà impedito di apparire nelle panoramiche di intelligenza artificiale; piuttosto, i publisher non avranno i loro dati raschiati, curati in una raccolta e passati attraverso il prossimo round di formazione per Gemini e altri progetti di intelligenza artificiale di Google.

Tuttavia, ciò non è stato il risultato a cui sono arrivati i ricercatori del nuovo documento, che hanno scoperto invece che i publisher di AI-banning popolari erano molto raramente citati da Gemini, sia nella versione LLM che nella versione di risultati di ricerca più agile. I publisher ‘effettivamente bloccati’ sono stati segnalati nel documento come NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports e STAT.

Alcuni dei divieti di raschiatura di intelligenza artificiale effettuati dai publisher elencati sopra. Ma ha portato a una più ampia censura da parte di Google?

Gli autori affermano:

‘Nelle nostre analisi dei domini più colpiti, abbiamo scoperto che 21 publisher popolari (che vengono recuperati per almeno 20 query uniche da entrambi Google Search e AIO) non sono stati citati da Gemini.

‘Vari siti web di social media (Facebook, Instagram, Tiktok) e recensioni (IMDb, Yelp, Tripadvisor) hanno anche ricevuto zero citazioni da Gemini. Ulteriori indagini hanno rivelato che tutti questi siti web bloccano il bot Google-Extended nei loro file robots.txt.’

Se questo risultato si verifica e si verifica altrove, si potrebbe speculare che queste società siano potenzialmente sotto pressione da Google per cooperare con le loro operazioni di intelligenza artificiale attraverso una parziale de-listing. A prima vista, i risultati sembrano punitivi – ma poi, i risultati del nuovo lavoro sono più indicativi di caos che di premeditazione; quindi l’unico commento ragionevole che si può fare è che questi risultati sembrano superficialmente ‘astiosi’, qualunque cosa li stia causando.

Conclusione

Opinione Questo è un documento chiaro e conciso, il cui unico contenuto di dieci pagine si apre in una cascata quasi schiacciante di ulteriori scoperte. Dal momento che abbiamo avuto il tempo di coprire solo una piccola sezione di queste, consiglio il PDF di origine anche al lettore occasionale (un evento raro).

Sebbene un atteggiamento ‘giallo’ possa gettare molte interpretazioni negative sulle scoperte degli autori, il lavoro è forse meglio trattato come indicativo di un leader tecnologico globale che tenta di ottenere e mantenere un vantaggio globale nella ricerca basata sull’intelligenza artificiale, utilizzando piattaforme altamente contrastanti che si sono sviluppate in circostanze e epoche molto diverse.

Mentre tre metodi di ricerca vengono esaminati nel documento, la vera controversia è tra i risultati tradizionali del motore di ricerca, classificati con metodi proprietari, e i metodi di selezione basati sulla distribuzione che dominano la cura dei dati e la formazione dell’intelligenza artificiale.

Intelligenza artificiale come nel 1999

Prima dell’avvento di Google, era possibile ‘giocare’ i risultati di ricerca attraverso il semplice volume, e in questo modo, si poteva spesso raggiungere la posizione di primo piano SERPS con uno sforzo minimo (spesso automatizzato). Questo ‘gioco dei numeri’ è stato efficacemente terminato intorno al 2002 dall’algoritmo di classificazione della ricerca più sofisticato e segreto di Google. Ma poiché le poste in gioco erano significative, i contenuti di alta quantità e bassa qualità non sono mai scomparsi in alcun senso significativo.

Pertanto, quando le raccolte iperscalari come Common Crawl hanno gettato le basi della rivoluzione dell’intelligenza artificiale moderna, la prominenza dei dati è stata destinata a essere dominata dall’estensione in cui i processi automatizzati potevano filtrare e classificare la qualità dei dati in entrata, e (molto meno probabile), l’estensione in cui era disponibile denaro per pagare le persone per classificare quei dati.

C’era un molti dati cattivi o di bassa qualità in quelle grandi e indiscriminate raccolte; dati che potrebbero non aver incluso nudità o bestemmie o tropi razzisti, o qualsiasi altra cosa che sia relativamente facile da filtrare dai set di dati di formazione – ma che erano comunque auto-serventi e voluminosi, proprio come i risultati della ricerca internet intorno al 1999-2001.

Perché quei processi di induzione dei dati non sono ancora grandi, è molto difficile anche per Google far sì che l’intelligenza artificiale agisca in modo professionale, poiché le decisioni di Gemini nello stile di PageRank sono dettate non dagli ingegneri di politica di Google, ma da una comprensione imperfetta di come i dati iperscalari si trasformano in distribuzioni di dati e incorporazioni latenti durante la formazione di un modello di intelligenza artificiale.

* Pagine dei risultati di ricerca.

† Enfasi degli autori, non mia. Tuttavia, ho sostituito il grassetto con il corsivo, poiché l’enfasi corsiva non funziona bene nelle citazioni che sono già principalmente in corsivo.

Pubblicato per la prima volta mercoledì, 13 maggio 2026