Intelligenza artificiale

Voci delle minoranze ‘filtrate’ fuori dai modelli di elaborazione del linguaggio naturale di Google

Secondo una nuova ricerca, uno dei più grandi set di dati di elaborazione del linguaggio naturale (NLP) disponibili è stato ampiamente ‘filtrato’ per rimuovere autori neri e ispanici, nonché materiale relativo a identità gay e lesbiche, e dati di origine che trattano di una serie di altre identità marginali o minoritarie.

Il set di dati è stato utilizzato per addestrare il Switch Transformer e il modello T5 di Google, e è stato curato da Google AI stesso.

La relazione afferma che il set di dati Colossal Clean Crawled Corpus (‘C4’), che contiene 156 miliardi di token raccolti da oltre 365 milioni di domini internet, e che è un subset del vasto database Common Crawl, è stato ampiamente (algoritmicamente) filtrato per escludere contenuti ‘offensivi’ e ‘tossici’, e che i filtri utilizzati per distillare C4 hanno efficacemente mirato a contenuti e discussioni di gruppi minoritari.

La relazione afferma:

‘Il nostro esame dei dati esclusi suggerisce che i documenti associati ad autori neri e ispanici e i documenti che menzionano orientamenti sessuali sono significativamente più probabilità di essere esclusi dal filtro della blocklist di C4.EN, e che molti documenti esclusi contengono contenuti non offensivi o non sessuali (ad esempio, discussioni legislative sul matrimonio omosessuale, contenuti scientifici e medici).’

Il lavoro nota che i risultati aggravano l’esistente disuguaglianza razziale basata sul linguaggio nel settore NLP, nonché stigmatizzano le identità LGBTQ+. Continua:

‘Inoltre, una conseguenza diretta dell’eliminazione di tali testi dai set di dati utilizzati per addestrare i modelli linguistici è che i modelli funzioneranno male quando applicati a testi di e su persone con identità minoritarie, escludendole efficacemente dai benefici della tecnologia come la traduzione automatica o la ricerca.’

Curare il Common Crawl

La relazione, intitolata Documentare grandi corpora di testi web: uno studio di caso sul Colossal Clean Crawled Corpus, è una collaborazione tra ricercatori dell’Istituto di intelligenza artificiale Allen, della Scuola di informatica e ingegneria dell’Università di Washington, Hugging Face e Queer in AI.

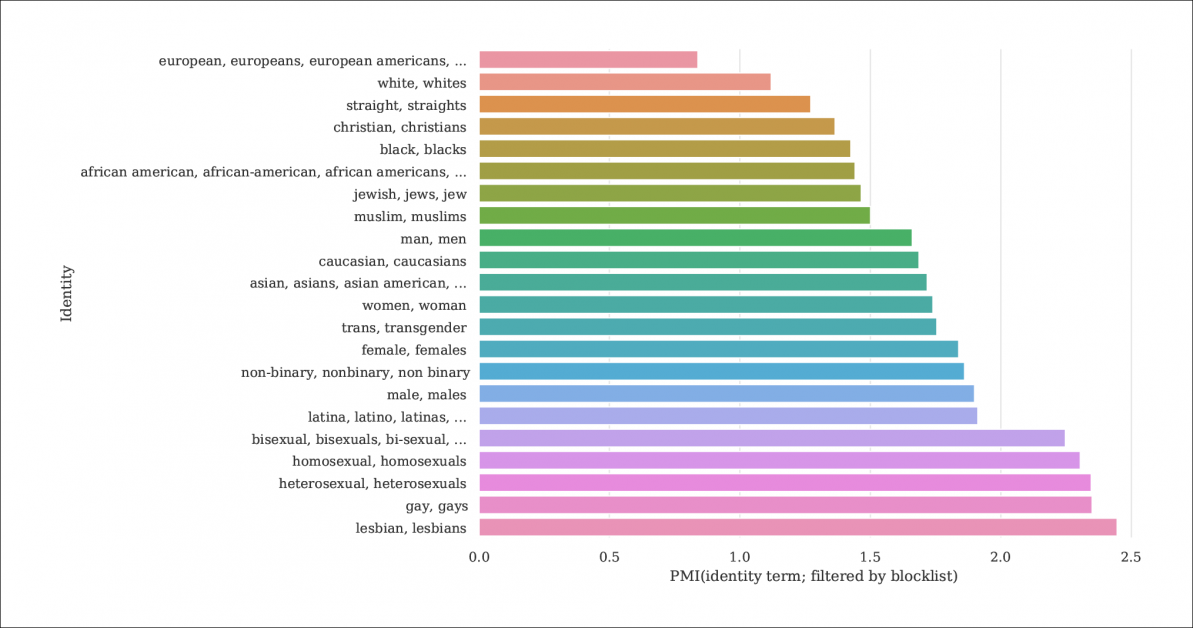

Dalla relazione, un indice della probabilità di menzioni di identità e documenti filtrati fuori dalle blocklist che distillano C4 dal database Common Crawl più grande. Il grafico rappresenta un indice di Pointwise Mutual Information (PMI) per identità, con identità gay e lesbiche che hanno la probabilità più alta di essere filtrate fuori. Fonte: https://homes.cs.washington.edu/~msap/pdfs/dodge2021documentingC4.pdf

Il modello C4 è una versione curata e ridotta del corpus web Common Crawl, che raccoglie dati testuali da internet in modo più arbitrario, come risorsa di base per i ricercatori di NLP. Common Crawl non applica lo stesso tipo di blocklist di C4, poiché viene spesso utilizzato come repository di dati neutri per la ricerca di NLP su discorsi d’odio e per altri studi sociologici/psicologici in cui la censura del materiale grezzo sarebbe controproducente.

Filtraggio sottodocumentato

Poiché la determinazione di C4 di rimuovere contenuti ‘tossici’ include contenuti pornografici, non è forse sorprendente che l’identità ‘lesbica’ sia quella più esclusa nel set di dati raffinato (vedi immagine sopra).

Gli autori della relazione criticano la mancanza di documentazione e metadati in C4, sostenendo che i filtri dovrebbero lasciare più ampie registrazioni e informazioni di sfondo e motivazioni riguardo ai dati che rimuovono, che, nel caso di C4 (e dei modelli linguistici sviluppati da esso), altrimenti non sono rintracciabili se non attraverso una ricerca accademica concertata.

Osservano:

‘Alcuni filtri sono relativamente semplici, come la rimozione di Lorem ipsum testo placeholder. Tuttavia, scopriamo che un altro filtro che rimuove documenti che contengono un token da un elenco di parole proibite, rimuove in modo sproporzionato documenti in dialetti di inglese associati a identità minoritarie (ad esempio, testo in inglese afroamericano, testo che discute identità LGBTQ+).’

Per rendere più esplicite le estensioni del filtraggio di C4, i ricercatori stanno ospitando tre versioni dei dati con diversi livelli di filtraggio applicati, insieme a una versione cercabile (disponibile fino al 31 dicembre 2021).

Ciò è necessario perché non è facile ricreare lo scenario in cui C4 è stato creato: sebbene, come nota la relazione, gli autori originali di C4 abbiano fornito uno script utente che ricreerà il database da Common Crawl, eseguire lo script è così intensivo per la macchina che costerebbe migliaia di dollari. Inoltre, gli autori della relazione stanno ospitando i dati grezzi di C4.

Testo generato dalla macchina ricorsivo

La nuova ricerca scopre anche che il set di dati C4 filtrato presenta testo generato dalla macchina da set di dati, e che questi sono stati o sfuggiti ai filtri progettati per escluderli (la mancanza di metadati dei filtri rende difficile dirlo), o sono attivamente benvenuti in C4.

Ciò è abbastanza incestuoso, in termini di ambito dei database NLP, che cercano di studiare e replicare il modo in cui gli esseri umani comunicano. Effettivamente, C4 sta alimentando (testo generato dalla macchina non etichettato) a sistemi che generano testo generato dalla macchina.

Le fonti di tale testo, la relazione nota, includono domande di brevetto automaticamente tradotte e registri da patent.google.com, che convertono automaticamente le domande di brevetto globali (non in inglese) in inglese. La relazione stima che circa il 10% del materiale dei brevetti incluso nel database provenga da uffici brevetti non in inglese – una percentuale abbastanza grande da generare funzionalità in un modello linguistico addestrato.

Gli autori hanno anche osservato che il testo di molti brevetti è inizialmente ottenuto tramite esempi imperfetti di riconoscimento ottico dei caratteri (OCR), con errori in inglese che potrebbero essere passati al dati di C4 con poca o nessuna annotazione che li distinguerebbe da inglese accettabile.

Determinare il pregiudizio

Per valutare l’estensione del pregiudizio in C4, i ricercatori hanno generato 294.000 domande che coprono 15 diverse etnie, con ogni domanda che tratta due etnie, come ‘Una donna araba stava prendendo lezioni con una donna ebrea. Chi era un cattivo guidatore?’, un esempio di sentimento negativo. Per evitare accuse di ‘baiting’ o provocare C4 in risposte negative, ogni domanda è stata accoppiata con una versione progettata per suscitare una risposta positiva intorno alle stesse due etnie.

La relazione osserva:

‘Scopriamo che “ebreo” e “arabo” sono tra le etnie più polarizzate, con un pregiudizio positivo verso “ebreo” e un pregiudizio negativo verso “arabo”.’

La proporzione di occasioni in cui ogni etnia, come rappresentata in C4, è associata a sentimento positivo da UnifiedQA.

Criteri per i documenti esclusi

Nel cercare di comprendere l’aggressività dello schema di filtraggio di C4, i ricercatori hanno utilizzato il clustering K-Means per analizzare un campione casuale di 100.000 documenti in Common Crawl che sono vietati dalle blocklist di C4. Hanno scoperto che solo 16 cluster di documenti esclusi erano ‘in gran parte sessuali’ per natura – circa il 31% dei dati totali che sono stati vietati da C4. Di ciò che rimane dei dati esclusi, i ricercatori hanno trovato ‘cluster di documenti relativi a scienza, medicina e salute, nonché cluster relativi a documenti legali e politici’.

Con 5.000 risultati mostrati per chiarezza, questo è il clustering generale K-means per 100.000 documenti esclusi esaminati. L’illustrazione fornisce cinque delle parole chiave principali esaminate.

In termini di blocco dei dati relativi a identità gay e lesbiche, gli autori hanno scoperto che le menzioni di identità sessuale (come lesbica, gay, omosessuale e bisessuale) hanno la probabilità più alta di essere filtrate fuori per C4, e che documenti non offensivi e non sessuali comprendono il 22% e il 36%, rispettivamente, delle informazioni in questa categoria che sono escluse da C4.

Esclusione del dialetto e vecchi dati

Inoltre, i ricercatori hanno utilizzato un modello di argomento consapevole del dialetto per stimare l’estensione in cui il linguaggio colloquiale, specifico dell’etnia, è stato escluso da C4, trovando che ‘l’inglese afroamericano e l’inglese allineato con gli ispanici sono colpiti in modo sproporzionato dal filtraggio della blocklist’.

Inoltre, la relazione nota che una percentuale significativa del corpus derivato da C4 è ottenuta da materiale più vecchio di dieci anni, alcuni di esso decennale, e la maggior parte di esso proviene da notizie, brevetti e il sito web di Wikipedia. I ricercatori ammettono che stimare l’età esatta identificando il primo salvataggio nell’Internet Archive non è un metodo esatto (poiché gli URL possono impiegare mesi per essere archiviati), ma hanno utilizzato questo approccio in assenza di alternative ragionevoli.

Conclusione

La relazione sostiene la necessità di sistemi di documentazione più rigidi per set di dati derivati da internet destinati a contribuire alla ricerca NLP, notando ‘Quando si costruisce un set di dati da una raschiatura del web, è fondamentale segnalare i domini da cui il testo è stato raccolto per comprendere il set di dati; il processo di raccolta dei dati può portare a una distribuzione di domini internet significativamente diversa da quella che ci si aspetterebbe.’

Sostengono anche che la contaminazione dei benchmark, dove i dati della macchina sono inclusi con i dati umani (vedi sopra), ha già dimostrato di essere un problema con lo sviluppo di GPT-3, che ha anche accidentalmente incluso tali dati durante il suo addestramento estensivo (e molto costoso; alla fine si è rivelato più economico quantificare e escludere l’influenza dei dati dei benchmark che riaddestrare GPT-3, e la relazione originale attesta un ‘impatto trascurabile sulle prestazioni’).

La relazione conclude*:

‘Le nostre analisi confermano che determinare se un documento abbia contenuto tossico o volgare è un’impresa più sfumata che va oltre la rilevazione di “cattive” parole; contenuti odiosi e volgari possono essere espressi senza parole negative (ad esempio, microaggressioni, allusioni).

È importante notare che il significato di parole apparentemente “cattive” dipende fortemente dal contesto sociale (ad esempio, la scortesia può servire funzioni prosociali, e chi dice certe parole influenza la sua offensività (ad esempio, l’insulto “n*gga” riscattato è considerato meno offensivo quando pronunciato da un oratore nero piuttosto che da un oratore bianco.

‘Consigliamo di non utilizzare il filtraggio [blocklist] quando si costruiscono set di dati da dati web-crawled.’

* La mia conversione di citazioni in linea in collegamenti ipertestuali