Kecerdasan buatan

Masalah Kotak Hitam dalam LLM: Tantangan dan Solusi yang Muncul

Pembelajaran mesin, sebuah subset dari AI, melibatkan tiga komponen: algoritma, data pelatihan, dan model yang dihasilkan. Sebuah algoritma, pada dasarnya sebuah set prosedur, belajar untuk mengidentifikasi pola dari sejumlah besar contoh (data pelatihan). Puncak dari pelatihan ini adalah model pembelajaran mesin. Sebagai contoh, sebuah algoritma yang dilatih dengan gambar anjing akan menghasilkan model yang dapat mengidentifikasi anjing dalam gambar.

Kotak Hitam dalam Pembelajaran Mesin

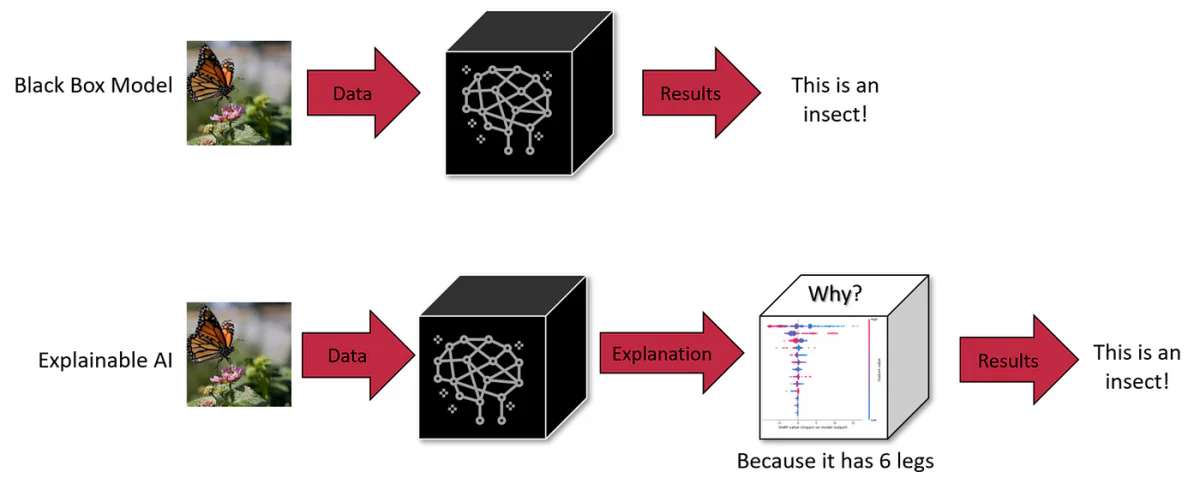

Dalam pembelajaran mesin, salah satu dari tiga komponen—algoritma, data pelatihan, atau model—dapat menjadi kotak hitam. Sementara algoritma seringkali diketahui secara publik, pengembang mungkin memilih untuk menjaga model atau data pelatihan secara rahasia untuk melindungi kekayaan intelektual. Kekaburan ini membuatnya sulit untuk memahami proses pengambilan keputusan AI.

Kotak hitam AI adalah sistem yang internalnya tetap tidak transparan atau tidak terlihat oleh pengguna. Pengguna dapat memasukkan data dan menerima output, tetapi logika atau kode yang menghasilkan output tetap tersembunyi. Ini adalah karakteristik umum dalam banyak sistem AI, termasuk model generatif canggih seperti ChatGPT dan DALL-E 3.

LLM seperti GPT-4 menyajikan tantangan signifikan: internalnya sebagian besar tidak transparan, membuatnya “kotak hitam”. Kekaburan ini bukan hanya teka-teki teknis; itu menimbulkan kekhawatiran keamanan dan etika dunia nyata. Sebagai contoh, jika kita tidak dapat memahami bagaimana sistem ini mencapai kesimpulan, dapatkah kita mempercayainya dalam area kritis seperti diagnosis medis atau penilaian keuangan?

Menggali Teknik LIME dan SHAP

Interpretasi dalam model pembelajaran mesin (ML) dan pembelajaran dalam (DL) membantu kita melihat ke dalam internal yang tidak transparan dari model canggih ini. Penjelasan Model Lokal yang Dapat Diinterpretasikan (LIME) dan Penjelasan Additif Shapley (SHAP) adalah dua teknik interpretasi yang umum.

LIME, misalnya, memecahkan kompleksitas dengan membuat model surrogat yang lebih sederhana, lokal yang mendekati perilaku model asli di sekitar input tertentu. Dengan melakukan ini, LIME membantu dalam memahami bagaimana fitur individual mempengaruhi prediksi model yang kompleks, pada dasarnya memberikan ‘penjelasan lokal’ untuk mengapa model membuat keputusan tertentu. Ini sangat berguna untuk pengguna non-teknis, karena menerjemahkan proses pengambilan keputusan model yang rumit menjadi istilah yang lebih dapat dipahami.

SHAP, di sisi lain, mengambil inspirasi dari teori permainan, khususnya konsep nilai Shapley. Ini memberikan nilai ‘kepentingan’ pada setiap fitur, menunjukkan seberapa banyak setiap fitur menyumbang pada perbedaan antara prediksi aktual dan prediksi baseline (prediksi rata-rata di seluruh input). Kekuatan SHAP terletak pada konsistensinya dan kemampuan untuk memberikan perspektif global – tidak hanya menjelaskan prediksi individual tetapi juga memberikan wawasan ke model secara keseluruhan. Ini sangat berharga dalam model pembelajaran dalam, di mana lapisan yang terhubung dan banyak parameter sering membuat proses prediksi tampak seperti perjalanan melalui labirin. SHAP mendemistifikasi ini dengan mengkuantifikasi kontribusi setiap fitur, menawarkan peta yang lebih jelas dari jalur pengambilan keputusan model.

SHAP (Source)

Kedua LIME dan SHAP telah muncul sebagai alat penting dalam ranah AI dan ML, menangani kebutuhan kritis untuk transparansi dan kepercayaan. Ketika kita terus mengintegrasikan AI lebih dalam ke berbagai sektor, kemampuan untuk menafsirkan dan memahami model ini menjadi tidak hanya kebutuhan teknis tetapi persyaratan fundamental untuk pengembangan AI yang etis dan bertanggung jawab. Teknik-teknik ini mewakili langkah penting dalam membongkar kompleksitas model ML dan DL, mengubahnya dari ‘kotak hitam’ yang tidak dapat dipahami menjadi sistem yang dapat dipahami, keputusan, dan perilakunya dapat dipercaya dan digunakan secara efektif.

Skala dan Kompleksitas LLM

Skala model ini menambah kompleksitasnya. Ambil GPT-3, misalnya, dengan 175 miliar parameter, dan model yang lebih baru memiliki triliunan. Setiap parameter berinteraksi dalam cara yang rumit dalam jaringan saraf, menyumbang kemampuan yang muncul yang tidak dapat diprediksi dengan memeriksa komponen individual saja. Skala dan kompleksitas ini membuatnya hampir mustahil untuk sepenuhnya memahami logika internalnya, memposisikan hambatan dalam mendiagnosis bias atau perilaku yang tidak diinginkan dalam model ini.

Perdagangan: Skala vs. Interpretasi

Mengurangi skala LLM dapat meningkatkan interpretasi tetapi dengan biaya kemampuan canggihnya. Skala adalah yang memungkinkan perilaku yang model yang lebih kecil tidak dapat mencapai. Ini mempresentasikan perdagangan yang inheren antara skala, kemampuan, dan interpretasi.

Dampak Masalah Kotak Hitam LLM

1. Pengambilan Keputusan yang Rusak

Kekaburan dalam proses pengambilan keputusan LLM seperti GPT-3 atau BERT dapat menyebabkan bias dan kesalahan yang tidak terdeteksi. Dalam bidang seperti perawatan kesehatan atau keadilan pidana, di mana keputusan memiliki konsekuensi yang jauh, ketidakmampuan untuk memeriksa LLM untuk kebenaran etika dan logika adalah kekhawatiran besar. Sebagai contoh, diagnosis medis LLM yang mengandalkan data yang sudah ketinggalan zaman atau bias dapat membuat rekomendasi yang berbahaya. Demikian pula, LLM dalam proses perekrutan mungkin tidak sengaja mempertahankan bias gender. Sifat kotak hitam ini tidak hanya menyembunyikan kelemahan tetapi juga dapat memperkuatnya, membutuhkan pendekatan proaktif untuk meningkatkan transparansi.

2. Keterbatasan Adaptasi dalam Konteks yang Beragam

Kurangnya wawasan ke internal LLM membatasi adaptabilitasnya. Sebagai contoh, LLM perekrutan mungkin tidak efisien dalam mengevaluasi kandidat untuk peran yang menghargai keterampilan praktis daripada kualifikasi akademis, karena ketidakmampuannya untuk menyesuaikan kriteria evaluasinya. Demikian pula, LLM medis mungkin bergumul dengan diagnosis penyakit langka karena ketidakseimbangan data. Keterbatasan ini menyoroti kebutuhan akan transparansi untuk mengkalibrasi ulang LLM untuk tugas dan konteks tertentu.

3. Bias dan Kesenjangan Pengetahuan

Pengolahan LLM dari data pelatihan besar tunduk pada keterbatasan yang diberlakukan oleh algoritma dan arsitektur modelnya. Sebagai contoh, LLM medis mungkin menunjukkan bias demografis jika dilatih pada dataset yang tidak seimbang. Juga, keahlian LLM dalam topik khusus bisa menyesatkan, mengarah pada output yang salah dengan kepercayaan diri yang berlebihan. Mengatasi bias dan kesenjangan pengetahuan ini membutuhkan lebih dari sekedar data tambahan; itu membutuhkan pemeriksaan mekanika pengolahan model.

4. Akuntabilitas Hukum dan Etika

Sifat tidak transparan LLM menciptakan area abu-abu hukum mengenai tanggung jawab untuk kerusakan yang disebabkan oleh keputusannya. Jika LLM dalam pengaturan medis memberikan saran yang salah yang mengarah pada cedera pasien, menentukan akuntabilitas menjadi sulit karena kekaburan model. Ketidakpastian hukum ini menimbulkan risiko bagi entitas yang menggelar LLM dalam area sensitif, menekankan kebutuhan akan tata kelola dan transparansi yang jelas.

5. Masalah Kepercayaan dalam Aplikasi yang Sensitif

Untuk LLM yang digunakan dalam area kritis seperti perawatan kesehatan dan keuangan, kurangnya transparansi melemahkan kepercayaan diri mereka. Pengguna dan regulator perlu memastikan bahwa model ini tidak memiliki bias atau membuat keputusan berdasarkan kriteria yang tidak adil. Memverifikasi ketiadaan bias dalam LLM membutuhkan pemahaman tentang proses pengambilan keputusan mereka, menekankan pentingnya penjelasan untuk penerapan etis.

6. Risiko dengan Data Pribadi

LLM membutuhkan data pelatihan yang luas, yang mungkin termasuk informasi pribadi yang sensitif. Sifat kotak hitam model ini menimbulkan kekhawatiran tentang bagaimana data ini diproses dan digunakan. Sebagai contoh, LLM medis yang dilatih pada catatan pasien menimbulkan pertanyaan tentang privasi data dan penggunaan. Memastikan bahwa data pribadi tidak disalahgunakan atau dieksploitasi membutuhkan proses penanganan data yang transparan dalam model ini.

Solusi yang Muncul untuk Interpretasi

Untuk mengatasi tantangan ini, teknik baru sedang dikembangkan. Ini termasuk metode aproksimasi kontrafaktual (CF). Metode pertama melibatkan meminta LLM untuk mengubah konsep teks tertentu sambil menjaga konsep lain tetap konstan. Pendekatan ini, meskipun efektif, intensif sumber daya pada waktu inferensi.

Pendekatan kedua melibatkan membuat ruang embedding khusus yang dipandu oleh LLM selama pelatihan. Ruang ini sejalan dengan grafik kausal dan membantu mengidentifikasi kecocokan yang mendekati CF. Metode ini membutuhkan lebih sedikit sumber daya pada waktu uji dan telah terbukti efektif dalam menjelaskan prediksi model, bahkan dalam LLM dengan miliaran parameter.

Pendekatan ini menyoroti pentingnya penjelasan kausal dalam sistem NLP untuk memastikan keamanan dan membangun kepercayaan. Aproksimasi kontrafaktual memberikan cara untuk membayangkan bagaimana teks yang diberikan akan berubah jika konsep tertentu dalam proses generatifnya berbeda, membantu dalam estimasi efek kausal praktis dari konsep tingkat tinggi pada model NLP.

Penelitan Mendalam: Metode Penjelasan dan Kausalitas dalam LLM

Alat Probing dan Fitur Keimportanan

Probing adalah teknik yang digunakan untuk memecahkan apa yang direpresentasikan internal dalam model. Ini dapat bersifat terawasi atau tidak terawasi dan bertujuan untuk menentukan apakah konsep tertentu dikodekan di tempat tertentu dalam jaringan. Sementara efektif sampai batas tertentu, probe kurang dalam memberikan penjelasan kausal, seperti yang ditekankan oleh Geiger et al. (2021).

Alat keimportanan fitur, bentuk lain dari metode penjelasan, seringkali fokus pada fitur input, meskipun beberapa metode berbasis gradien memperluas ini ke status tersembunyi. Contoh adalah metode Gradien Terintegrasi, yang menawarkan interpretasi kausal dengan mengeksplorasi input baseline (kontrafaktual, CF). Meskipun utilitasnya, metode ini masih bergumul untuk menghubungkan analisis mereka dengan konsep dunia nyata di luar sifat input sederhana.

Metode Berbasis Intervensi

Metode berbasis intervensi melibatkan modifikasi input atau representasi internal untuk mempelajari efek pada perilaku model. Metode ini dapat membuat keadaan CF untuk mengestimasi efek kausal, tetapi mereka sering menghasilkan input atau keadaan jaringan yang tidak masuk akal kecuali jika dikontrol dengan hati-hati. Model Proksi Kausal (CPM), terinspirasi oleh konsep S-learner, adalah pendekatan baru dalam ranah ini, meniru perilaku model yang dijelaskan di bawah input CF. Namun, kebutuhan akan penjelas yang berbeda untuk setiap model adalah keterbatasan besar.

Mengaproksimasi Kontrafaktual

Kontrafaktual secara luas digunakan dalam pembelajaran mesin untuk augmentasi data, melibatkan gangguan pada faktor atau label yang beragam. Ini dapat dibuat melalui penyuntingan manual, penggantian kata kunci heuristik, atau penulisan teks otomatis. Sementara penyuntingan manual akurat, itu juga intensif sumber daya. Metode berbasis kata kunci memiliki keterbatasan, dan pendekatan generatif menawarkan keseimbangan antara kelancaran dan cakupan.

Penjelasan yang Setia

Kesetiaan dalam penjelasan merujuk pada menggambarkan dengan akurat alasan internal model. Tidak ada definisi kesetiaan yang diterima secara universal, mengarah ke karakterisasi melalui berbagai metrik seperti Sensitivitas, Konsistensi, Kesepakatan Keimportanan Fitur, Ketahanan, dan Simulabilitas. Sebagian besar metode ini fokus pada penjelasan tingkat fitur dan sering mengacaukan korelasi dengan kausalitas. Tujuan kami adalah memberikan penjelasan konsep tingkat tinggi, memanfaatkan literatur kausalitas untuk mengusulkan kriteria yang intuitif: Order-Kesetiaan.

Kami telah memasuki kompleksitas inheren LLM, memahami sifat ‘kotak hitam’ mereka dan tantangan signifikan yang ditimbulkannya. Dari risiko pengambilan keputusan yang rusak dalam area sensitif seperti perawatan kesehatan dan keuangan hingga dilema etika yang mengelilingi bias dan keadilan, kebutuhan akan transparansi dalam LLM telah menjadi lebih jelas.

Masa depan LLM dan integrasi mereka ke dalam kehidupan sehari-hari dan proses pengambilan keputusan kritis bergantung pada kemampuan kita untuk membuat model ini tidak hanya lebih maju tetapi juga lebih dapat dipahami dan akuntabel. Pengejaran interpretasi dan penjelasan bukan hanya upaya teknis tetapi aspek fundamental dalam membangun kepercayaan pada sistem AI. Ketika LLM menjadi lebih terintegrasi ke dalam masyarakat, tuntutan akan transparansi akan tumbuh, tidak hanya dari praktisi AI tetapi dari setiap pengguna yang berinteraksi dengan sistem ini.