कृत्रिम बुद्धिमत्ता

जनरेटिव वीडियो सिस्टम पूरी फिल्में क्यों नहीं बना सकते?

जनरेटिव एआई वीडियो के आगमन और प्रगति ने कई आकस्मिक पर्यवेक्षकों को यह भविष्यवाणी करने के लिए प्रेरित किया है कि मशीन लर्निंग मूवी उद्योग को जैसा हम जानते हैं उसकी मृत्यु का कारण साबित होगी – इसके बजाय, एकल रचनाकार स्थानीय या क्लाउड-आधारित जीपीयू सिस्टम पर हॉलीवुड-शैली की ब्लॉकबस्टर बनाने में सक्षम होंगे।

क्या यह संभव है? यदि यह संभव है, तो क्या यह संभव है, जैसा कि इतने सारे लोग मानते हैं?

यह विश्वास करना कि व्यक्तियों को अंततः हम जैसे फिल्में बनाने में सक्षम होंगे, जिसमें सुसंगत पात्र, कथा निरंतरता और कुल फोटोरियलिज्म होगा, यह बहुत संभव है – और शायद यह अनिवार्य भी है।

हालांकि, जनरेटिव वीडियो सिस्टम के साथ यह नहीं होने के कई मौलिक कारण हैं जो लेटेंट डिफ्यूजन मॉडल पर आधारित हैं।

यह तथ्य महत्वपूर्ण है क्योंकि वर्तमान में, यह श्रेणी में शामिल है हर लोकप्रिय टेक्स्ट-टू-वीडियो (टी2) और इमेज-टू-वीडियो (आई2वी) सिस्टम, जिसमें मिनिमैक्स, क्लिंग, सोरा, इमेजन, लुमा, अमेज़ॅन वीडियो जेनरेटर, रनवे एमएल, काइबर (और, जितना हम बता सकते हैं, एडोब फायरफ्लाई की आगामी वीडियो कार्यक्षमता) शामिल हैं; कई अन्य के बीच।

यहां, हम वास्तविक ऑटेर फुल-लेंथ जेन-एआई उत्पादन की संभावना पर विचार कर रहे हैं, जो व्यक्तियों द्वारा बनाए गए हैं, जिसमें सुसंगत पात्र, सिनेमैटोग्राफी और दृश्य प्रभाव शामिल हैं जो कम से कम हॉलीवुड में वर्तमान राज्य के साथ तुलनीय हैं।

आइए कुछ बड़े व्यावहारिक रोडब्लॉक्स पर एक नज़र डालें जो चुनौतियों से जुड़े हुए हैं।

1: आप एक सटीक अनुवर्ती शॉट नहीं प्राप्त कर सकते

कथा असंगति इनमें से सबसे बड़ी है। तथ्य यह है कि कोई भी वर्तमान में उपलब्ध वीडियो जनरेशन सिस्टम एक वास्तविक ‘अनुवर्ती शॉट’ नहीं बना सकता है।

इसका कारण यह है कि इन सिस्टम के केंद्र में मौजूद डिनोइज़िंग डिफ्यूजन मॉडल यादृच्छिक शोर पर निर्भर करता है, और यह मूल सिद्धांत एक ही सामग्री को दो बार व्याख्या करने के लिए उपयुक्त नहीं है (अर्थात, विभिन्न कोणों से या पिछले शॉट को विकसित करके एक अनुवर्ती शॉट में जो पिछले शॉट के साथ संगति बनाए रखता है)।

जहां टेक्स्ट प्रॉम्प्ट का उपयोग किया जाता है, अकेले या अपलोड किए गए ‘बीज’ छवियों के साथ (बहुस्तरीय इनपुट), प्रॉम्प्ट से प्राप्त टोकन सेमेंटिकALLY-उपयुक्त सामग्री को प्रशिक्षित लेटेंट स्पेस से प्राप्त करेंगे।

हालांकि, ‘यादृच्छिक शोर’ कारक से और अधिक बाधित, यह कभी भी एक ही तरह से नहीं करेगा।

इसका मतलब है कि वीडियो में लोगों की पहचान बदलने की प्रवृत्ति होगी, और वस्तुएं और पर्यावरण प्रारंभिक शॉट से मेल नहीं खाएंगी।

यही कारण है कि असाधारण दृश्यों और हॉलीवुड-स्तर के आउटपुट को दर्शाने वाले वायरल क्लिप अक्सर एकल शॉट होते हैं, या सिस्टम की क्षमताओं का एक ‘शोकेस मॉन्टेज’, जहां प्रत्येक शॉट में विभिन्न पात्र और पर्यावरण होते हैं।

[वीडियो चौड़ाई=”800″ ऊंचाई=”500″ mp4=”https://www.unite.ai/wp-content/uploads/2024/09/Marco-van-Hylckama-Vlieg-AE2.mp4″][/वीडियो]

मार्को वैन हिल्कमा व्लीग – स्रोत: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/ से एक जेनरेटिव एआई मॉन्टेज के अंश

इन वीडियो जनरेशन (जो व्यावसायिक प्रणालियों के मामले में भ्रामक हो सकती हैं) के इस संग्रह में यह धारणा है कि अंतर्निहित प्रणाली सुसंगत और सुसंगत कथाएं बना सकती है।

यहां उपयोग की जाने वाली तुलना एक मूवी ट्रेलर है, जिसमें केवल एक या दो मिनट का फुटेज होता है, लेकिन दर्शकों को यह विश्वास दिलाने का कारण है कि पूरी फिल्म मौजूद है।

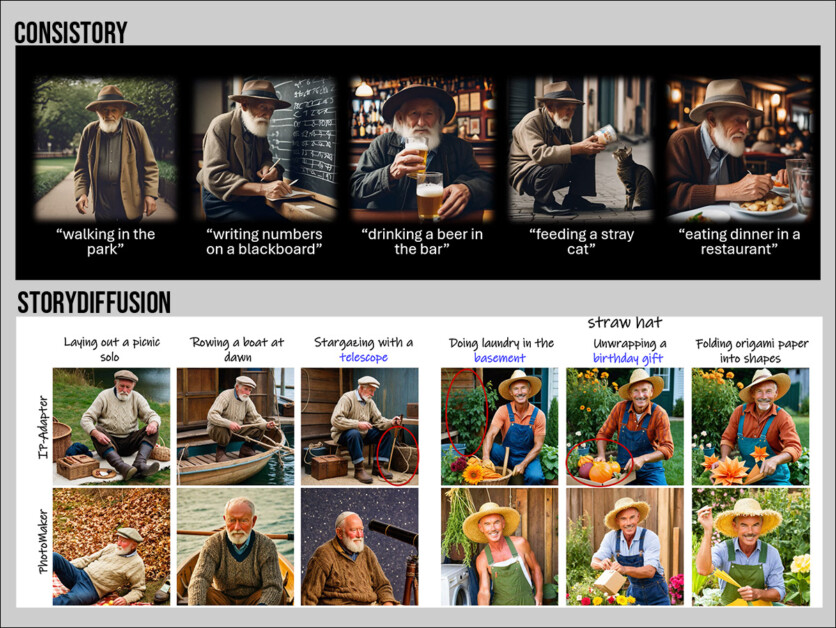

वर्तमान में जो प्रणालियां कथा निरंतरता प्रदान करती हैं वे वे हैं जो स्थिर छवियां उत्पन्न करती हैं। इनमें एनवीडिया का कॉन्सिस्टोरी शामिल है, और वैज्ञानिक साहित्य में विविध परियोजनाएं, जैसे कि थिएटरजेन, ड्रीमस्टोरी और स्टोरीडिफ्यूजन।

[कैप्शन आईडी=”अटैचमेंट_206309″ संरेखित=”संरेखित-नहीं” चौड़ाई=”836″]

सिद्धांत रूप में, आप एक श्रृंखला बनाने के लिए ऐसी प्रणालियों के बेहतर संस्करण का उपयोग कर सकते हैं जो छवि-से-वीडियो शॉट्स बनाते हैं, जिन्हें एक क्रम में जोड़ा जा सकता है।

वर्तमान राज्य में, यह दृष्टिकोण संभव अनुवर्ती शॉट्स का उत्पादन नहीं करता है; और, किसी भी मामले में, हम पहले से ही एक ऑटेर ड्रीम से जटिलता की एक परत जोड़कर विचलित हो गए हैं।

हम लो रैंक एडैप्टेशन (लोरा) मॉडल का भी उपयोग कर सकते हैं, जो विशेष रूप से पात्रों, चीजों या पर्यावरणों पर प्रशिक्षित होते हैं, ताकि शॉट्स में बेहतर निरंतरता बनाई जा सके।

हालांकि, यदि एक पात्र को एक नए पोशाक में दिखाना चाहता है, तो आमतौर पर एक नए लोरा को प्रशिक्षित करने की आवश्यकता होगी जो उस पोशाक में पात्र को दर्शाता है (हालांकि उप-概念 जैसे ‘लाल पोशाक’ को व्यक्तिगत लोरास में प्रशिक्षित किया जा सकता है, साथ ही उपयुक्त छवियों के साथ, वे हमेशा काम करने में आसान नहीं होते हैं)।

यह जटिलता जोड़ता है, यहां तक कि एक फिल्म के उद्घाटन दृश्य में, जहां एक व्यक्ति बिस्तर से बाहर निकलता है, एक ड्रेसिंग गाउन पहनता है, ज़ोर से हंसता है, बेडरूम की खिड़की से बाहर देखता है, और अपने दांतों को ब्रश करने के लिए बाथरूम में जाता है।

एक ऐसा दृश्य, जिसमें लगभग 4-8 शॉट्स होते हैं, को पारंपरिक फिल्म निर्माण प्रक्रियाओं द्वारा एक सुबह में फिल्माया जा सकता है; वर्तमान राज्य में जेनरेटिव एआई में, यह संभावित रूप से कई सप्ताह का काम, कई प्रशिक्षित लोरास (या अन्य सहायक प्रणालियों), और बहुत सारे पोस्ट-प्रोसेसिंग का प्रतिनिधित्व कर सकता है।

वैकल्पिक रूप से, वीडियो-से-वीडियो का उपयोग किया जा सकता है, जहां सामान्य या सीजीआई फुटेज को टेक्स्ट-प्रॉम्प्ट के माध्यम से वैकल्पिक व्याख्याओं में परिवर्तित किया जाता है। रनवे ऐसी प्रणाली प्रदान करता है, उदाहरण के लिए।

[वीडियो चौड़ाई=”720″ ऊंचाई=”404″ mp4=”https://www.unite.ai/wp-content/uploads/2024/09/CG1-example-transfer.mp4″][/वीडियो]

ब्लेंडर से सीजीआई (बाएं), मैथ्यू विसनजेवेक द्वारा एक टेक्स्ट-एडेड रनवे वीडियो-से-वीडियो प्रयोग में व्याख्या की गई – स्रोत: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

यहां दो समस्याएं हैं: आप पहले से ही मूल फुटेज बना रहे हैं, इसलिए आप पहले से ही फिल्म बना रहे हैं दो बार, भले ही आप एक सिंथेटिक सिस्टम जैसे कि अनरियल के मेटाह्यूमन का उपयोग कर रहे हों।

यदि आप सीजीआई मॉडल (जैसे कि ऊपर क्लिप में) बनाते हैं और उन्हें एक वीडियो-से-इमेज ट्रांसफॉर्मेशन में उपयोग करते हैं, तो उनकी निरंतरता शॉट्स में भरोसा नहीं किया जा सकता है।

इसका कारण यह है कि वीडियो डिफ्यूजन मॉडल ‘बड़ी तस्वीर’ को नहीं देखते हैं – बल्कि, वे पिछले फ्रेम/फ्रेम्स के आधार पर एक नया फ्रेम बनाते हैं, और कुछ मामलों में, एक निकट भविष्य के फ्रेम पर विचार करते हैं; लेकिन, एक शतरंज खेल की तुलना में, वे ‘दस कदम आगे’ नहीं सोच सकते हैं और दस कदम पीछे नहीं याद रख सकते हैं।

दूसरा, एक डिफ्यूजन मॉडल अभी भी शॉट्स में सुसंगत रूप बनाए रखने के लिए संघर्ष करेगा, भले ही आप पात्र, पर्यावरण और प्रकाश शैली के लिए कई लोरास शामिल करें, ऊपर उल्लिखित कारणों से।

2: आप एक शॉट को आसानी से संपादित नहीं कर सकते

यदि आप पुराने तरीके की सीजीआई विधियों का उपयोग करके एक पात्र को सड़क पर चलते हुए दिखाते हैं, और आप शॉट में कुछ पहलू बदलना चाहते हैं, तो आप मॉडल को समायोजित कर सकते हैं और इसे फिर से रेंडर कर सकते हैं।

यदि यह एक वास्तविक जीवन की शूटिंग है, तो आप बस रीसेट और परिवर्तनों के साथ फिर से शूट करते हैं।

हालांकि, यदि आप एक जेन-एआई वीडियो शॉट उत्पन्न करते हैं जिसे आप प्यार करते हैं, लेकिन आप इसे एक पहलू बदलना चाहते हैं, तो आप केवल 30-40 वर्षों से विकसित दर्दनाक पोस्ट-प्रोडक्शन विधियों द्वारा ऐसा कर सकते हैं: सीजीआई, रोटोस्कोपिंग, मॉडलिंग और मैटिंग – सभी श्रमसाध्य और महंगे, समय लेने वाली प्रक्रियाएं।

डिफ्यूजन मॉडल के काम करने के तरीके से, एक टेक्स्ट-प्रॉम्प्ट (यहां तक कि एक बहुस्तरीय प्रॉम्प्ट में भी, जहां आप एक पूर्ण स्रोत बीज छवि प्रदान करते हैं) के एक पहलू को बदलने से उत्पन्न आउटपुट के कई पहलू बदल जाएंगे, जिससे प्रॉम्प्ट ‘व्हैक-ए-मोल’ का खेल होगा।

3: आप भौतिकी के नियमों पर भरोसा नहीं कर सकते

पारंपरिक सीजीआई विधियों में तरल गतिविधि, गैसीय गति, इनवर्स किनेमेटिक्स (मानव गति का सटीक मॉडलिंग), कपड़े की गति, विस्फोट, और विभिन्न वास्तविक दुनिया की घटनाओं का अनुकरण करने में सक्षम कई अल्गोरिदमिक भौतिकी आधारित मॉडल होते हैं।

हालांकि, डिफ्यूजन-आधारित विधियों, जैसा कि हमने देखा है, में एक छोटी सी स्मृति है, और एक सीमित श्रृंखला की गति पूर्ववर्ती (प्रशिक्षण डेटासेट में शामिल क्रियाओं के उदाहरण) है जिस पर वे आकर्षित कर सकते हैं।

ओपनएआई के सोरा जेनरेटिव सिस्टम के लैंडिंग पेज के एक पिछले संस्करण में, कंपनी ने स्वीकार किया कि सोरा में इस संबंध में सीमाएं हैं (हालांकि यह पाठ बाद में हटा दिया गया था):

‘[सोरा] जटिल दृश्य के भौतिकी को अनुकरण करने में संघर्ष कर सकता है, और विशिष्ट कारण और प्रभाव की घटनाओं (जैसे: एक पात्र द्वारा काटने के बाद एक कुकी पर एक निशान नहीं दिखा सकता है) को समझने में असमर्थ हो सकता है।

‘मॉडल प्रॉम्प्ट में शामिल स्थानिक विवरण को भी भ्रमित कर सकता है, जैसे कि बाएं और दाएं के बीच अंतर करना, या समय के साथ विकसित होने वाली घटनाओं के सटीक विवरण के साथ संघर्ष कर सकता है, जैसे कि विशिष्ट कैमरा ट्रेजेक्टरी।’

विभिन्न एपीआई-आधारित जेनरेटिव वीडियो सिस्टम का व्यावहारिक उपयोग सटीक भौतिकी को चित्रित करने में समान सीमाओं को प्रकट करता है। हालांकि, कुछ सामान्य भौतिक घटनाएं, जैसे कि विस्फोट, उनके प्रशिक्षण डेटासेट में बेहतर ढंग से प्रतिनिधित्व की जाती हैं।

कुछ मोशन प्रायर एम्बेडिंग, जो या तो जेनरेटिव मॉडल में प्रशिक्षित होते हैं या एक स्रोत वीडियो से फीड किए जाते हैं, पूरा होने में कुछ समय लेते हैं (जैसे कि एक जटिल और गैर-पुनरावृत्ति नृत्य क्रम एक विस्तृत पोशाक में एक व्यक्ति द्वारा प्रदर्शन किया जाता है) और, एक बार फिर, डिफ्यूजन मॉडल की मायोपिक विंडो का ध्यान इस सामग्री (चेहरे की पहचान, पोशाक विवरण, आदि) को बदल देगा जब तक कि गति समाप्त नहीं हो जाती। हालांकि, लोरास इसे कुछ हद तक कम कर सकते हैं।

इसे पोस्ट में ठीक करना

जनरेटिव वीडियो के ‘एकल उपयोगकर्ता’ के लिए अन्य कमियां हैं, जैसे कि तेजी से गति को चित्रित करने में उनकी कठिनाई, और आउटपुट वीडियो में समयिक निरंतरता प्राप्त करने की सामान्य और अधिक दबाव वाली समस्या।

इसके अलावा, विशिष्ट चेहरे के प्रदर्शन को बनाना जेनरेटिव वीडियो में लगभग भाग्य की बात है, जैसा कि संवाद के लिए लिप-सिंक है।

दोनों मामलों में, लाइवपोर्ट्रेट और एनिमेटेडिफ जैसी सहायक प्रणालियों का उपयोग करना वीएफएक्स समुदाय में बहुत लोकप्रिय हो रहा है, क्योंकि यह कम से कम व्यापक चेहरे के भाव और लिप-सिंक को मौजूदा जेनरेटेड आउटपुट में स्थानांतरित करने की अनुमति देता है।

[वीडियो चौड़ाई=”720″ ऊंचाई=”404″ mp4=”https://www.unite.ai/wp-content/uploads/2024/09/Generative-Z-Tunisia-Generative-Liveportrait.mp4″][/वीडियो]

एक्सप्रेशन ट्रांसफर (निचले बाएं में ड्राइविंग वीडियो) को जेनरेटिव जेड ट्यूनीशिया जेनरेटिव द्वारा एक लक्ष्य वीडियो पर लाइवपोर्ट्रेट के साथ आरोपित किया गया है। वीडियो https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/? पर बेहतर गुणवत्ता में पूर्ण लंबाई देखें

इसके अलावा, स्टेबल डिफ्यूजन जीयूआई कॉम्फ्यूआई और पेशेवर कंपोजिटिंग और मैनिपुलेशन एप्लिकेशन न्यूक जैसे उपकरणों के साथ-साथ लेटेंट स्पेस मैनिपुलेशन को शामिल करने वाले जटिल समाधान, एआई वीएफएक्स प्रैक्टिशनर्स को चेहरे के भाव और विन्यास पर अधिक नियंत्रण प्राप्त करने की अनुमति देते हैं।

हालांकि वह कॉम्फ्यूआई में चेहरे की एनिमेशन की प्रक्रिया का वर्णन ‘यातना’ के रूप में करता है, वीएफएक्स पेशेवर फ्रांसिस्को कंट्रेरास ने एक ऐसी प्रक्रिया विकसित की है जो लिप फोनीम्स और चेहरे/सिर के अन्य पहलुओं को आरोपित करने की अनुमति देती है।

[वीडियो चौड़ाई=”720″ ऊंचाई=”404″ mp4=”https://www.unite.ai/wp-content/uploads/2024/09/confyuUI-nuke-woman-Francisco-Contreras.mp4″][/वीडियो]

स्टेबल डिफ्यूजन, कॉम्फ्यूआई वर्कफ्लो द्वारा संचालित न्यूक की मदद से, वीएफएक्स प्रो फ्रांसिस्को कंट्रेरास को चेहरे के पहलुओं पर असामान्य नियंत्रण प्राप्त करने की अनुमति दी। पूरे वीडियो के लिए, बेहतर रिज़ॉल्यूशन पर, https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/ पर जाएं

निष्कर्ष

इनमें से कोई भी एकल उपयोगकर्ता द्वारा सुसंगत और फोटोरियलिस्टिक ब्लॉकबस्टर-शैली की पूर्ण लंबाई वाली फिल्में बनाने की संभावना के लिए आशाजनक नहीं है, जिसमें वास्तविक संवाद, लिप-सिंक, प्रदर्शन, पर्यावरण और निरंतरता हो।

इसके अलावा, इस खंड में वर्णित बाधाएं, कम से कम डिफ्यूजन-आधारित जेनरेटिव वीडियो मॉडल के संबंध में, आवश्यक रूप से हल होने वाली नहीं हैं, इसके बावजूद कि मंचों की टिप्पणियों और मीडिया ध्यान ने इस मामले को बनाया है। इन सीमाओं को लगता है कि वास्तुकला में निहित है।

एआई सिंथेसिस अनुसंधान में, जैसा कि सभी वैज्ञानिक अनुसंधान में, उत्कृष्ट विचार समय-समय पर हमें उनकी संभावना से चकित करते हैं, केवल यह पता लगाने के लिए कि आगे के शोध ने उनकी मौलिक सीमाओं को उजागर किया है।

जेनरेटिव/सिंथेसिस स्पेस में, यह पहले से ही जेनरेटिव एडवर्सेरियल नेटवर्क (जीएएन) और न्यूरल रेडिएंस फील्ड (नेर्फ) के साथ हो चुका है, जो अंततः व्यावसायिक प्रणालियों में कार्यान्वित होने के लिए बहुत कठिन साबित हुए,尽管 उन्हें उस लक्ष्य की ओर कई वर्षों तक शोध किया गया था। ये प्रौद्योगिकियां अब वैकल्पिक वास्तुकला में सहायक घटक के रूप में सबसे अधिक दिखाई देती हैं।

जैसा कि फिल्म स्टूडियो आशा करते हैं कि लाइसेंस प्राप्त फिल्म कैटलॉग पर प्रशिक्षण वीएफएक्स कलाकारों और सीजीआई कर्मियों को समाप्त कर सकता है, एआई वास्तव में वर्तमान में कार्यबल में भूमिकाएं जोड़ रहा है।

चाहे डिफ्यूजन-आधारित वीडियो सिस्टम वास्तव में कथा संगत और फोटोरियलिस्टिक मूवी जनरेटर में परिवर्तित हो सकते हैं, या चाहे पूरा व्यवसाय केवल एक अल्केमिक पीछा है, यह अगले 12 महीनों में स्पष्ट हो जाना चाहिए।

यह संभव है कि हमें एक पूरी तरह से नए दृष्टिकोण की आवश्यकता है; या यह हो सकता है कि गॉसियन स्प्लैटिंग (जीएसप्लैट), जिसे 1990 के दशक की शुरुआत में विकसित किया गया था और हाल ही में छवि सिंथेसिस स्पेस में लोकप्रिय हो गया है, डिफ्यूजन-आधारित वीडियो जनरेशन के लिए एक वैकल्पिक प्रतिनिधित्व कर सकता है।

चूंकि जीएसप्लैट को आगे आने में 34 साल लगे, इसलिए यह भी संभव है कि पुराने प्रतियोगी जैसे नेर्फ और जीएएन – और यहां तक कि लेटेंट डिफ्यूजन मॉडल भी – अभी तक अपने दिन की प्रतीक्षा कर रहे हैं।

* हालांकि काइबर की एआई स्टोरीबोर्ड सुविधा इस तरह की कार्यक्षमता प्रदान करती है, मैंने जो परिणाम देखे हैं वे उत्पादन गुणवत्ता के नहीं हैं。

मार्टिन एंडरसन मेटाफिजिक.एआई में वैज्ञानिक अनुसंधान सामग्री के पूर्व प्रमुख हैं।

सोमवार, 23 सितंबर, 2024 को पहली बार प्रकाशित