Anderson का एंगल

छोटे डीपफेक्स बड़ा खतरा हो सकते हैं

कॉन्वर्सेशनल एआई टूल्स जैसे कि चैटजीपीटी और गूगल जेमिनी अब डीपफेक्स बनाने के लिए उपयोग किए जा रहे हैं जो चेहरे को स्वैप नहीं करते हैं, लेकिन अधिक सूक्ष्म तरीकों से एक छवि के भीतर पूरी कहानी को फिर से लिख सकते हैं। इशारों, प्रोप्स और पृष्ठभूमि को बदलकर, ये संपादन एआई डिटेक्टर्स और मानव दोनों को धोखा देते हैं, जो ऑनलाइन वास्तविक क्या है इसके लिए हिस्टक्स बढ़ाते हैं।

वर्तमान जलवायु में, विशेष रूप से महत्वपूर्ण कानून जैसे टेक इट डाउन अधिनियम के प्रभाव में, हम में से कई डीपफेक्स और एआई-ड्रIVEN पहचान संश्लेषण को गैर-सहमति एआई पोर्न और राजनीतिक हेरफेर के साथ जोड़ते हैं – सामान्य रूप से, ग्रॉस वास्तविकता के विकृतियों।

यह हमें उम्मीद करने के लिए प्रशिक्षित करता है कि एआई-मैनिपुलेटेड छवियां हमेशा उच्च-स्टेक्स सामग्री के लिए जा रही होंगी, जहां रेंडरिंग की गुणवत्ता और संदर्भ का हेरफेर अल्पावधि में विश्वास के एक कूप को प्राप्त करने में सफल हो सकता है।

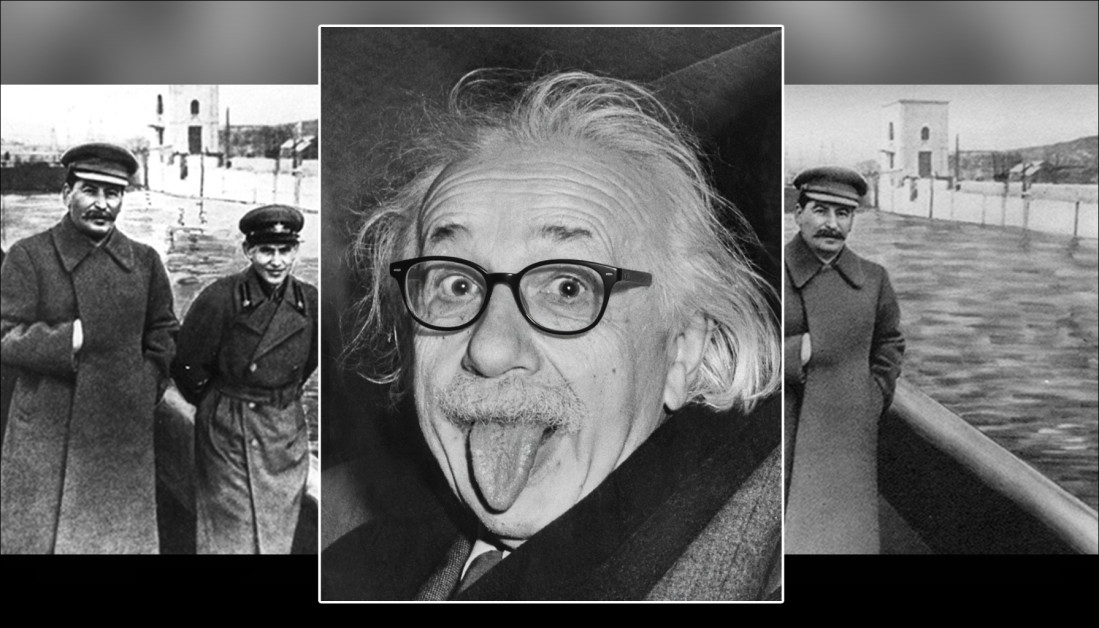

ऐतिहासिक रूप से, हालांकि, बहुत अधिक सूक्ष्म परिवर्तन अक्सर अधिक दुर्भाग्यपूर्ण और स्थायी प्रभाव डालते हैं – जैसे कि फोटोग्राफिक चालाकी की राज्य-ऑफ-द-आर्ट जिसने स्टालिन को उन लोगों को हटाने की अनुमति दी जो अनुकूल नहीं थे। जॉर्ज ऑरवेल के उपन्यास निनेटीन एटी-फोर में, जहां नायक विंस्टन स्मिथ अपने दिन इतिहास को फिर से लिखने और फोटो बनाने, नष्ट करने और ‘संशोधित’ करने में बिताता है।

इस उदाहरण में, दूसरी तस्वीर के साथ समस्या यह है कि हम ‘जानते हैं कि हम क्या नहीं जानते’ – कि स्टालिन की गुप्त पुलिस के पूर्व प्रमुख, निकोलाई येज़ोव, अब सुरक्षा बाधा के स्थान पर रहते थे:

अब आप उसे देखते हैं, अब वह … वेपर है। स्टालिन-युग की फोटोग्राफिक हेरफेर एक अपमानित पार्टी सदस्य को इतिहास से हटा देती है। स्रोत: सार्वजनिक डोमेन, https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

इस प्रकार की धाराएं, अक्सर दोहराई जाती हैं, कई तरह से बनी रहती हैं; न केवल सांस्कृतिक रूप से, बल्कि कंप्यूटर विजन में भी, जो प्रशिक्षण डेटासेट में प्रमुख विषयों और मोटिफ्स से रुझानों का निर्धारण करता है। एक उदाहरण देने के लिए, यह तथ्य कि स्मार्टफोन ने प्रवेश की बाधा को कम कर दिया है, और बड़े पैमाने पर फोटोग्राफी की लागत को कम कर दिया है, इसका मतलब है कि उनकी प्रतीकवाद कई अमूर्त अवधारणाओं के साथ अविभाज्य रूप से जुड़ा हुआ है, यहां तक कि जब यह उपयुक्त नहीं है।

यदि पारंपरिक डीपफेकिंग को ‘आक्रमण’ के रूप में देखा जा सकता है, तो ऑडियो-विजुअल मीडिया में पेरनिकियस और लंबे समय से चलने वाले मामूली परिवर्तन ‘गैसलाइटिंग’ के अधिक समान हैं। इसके अलावा, इस प्रकार के डीपफेकिंग का पता लगाने में असमर्थता इसे राज्य-ऑफ-द-आर्ट डीपफेक डिटेक्शन सिस्टम (जो ग्रॉस परिवर्तनों की तलाश कर रहे हैं) द्वारा पहचाना जाना मुश्किल बनाती है। यह दृष्टिकोण अधिक एक चट्टान पर पानी की तरह है जो एक स्थायी अवधि में चट्टान को घिसता है, एक चट्टान की तुलना में जो सिर पर निर्देशित होती है।

मल्टीफेकवर्स

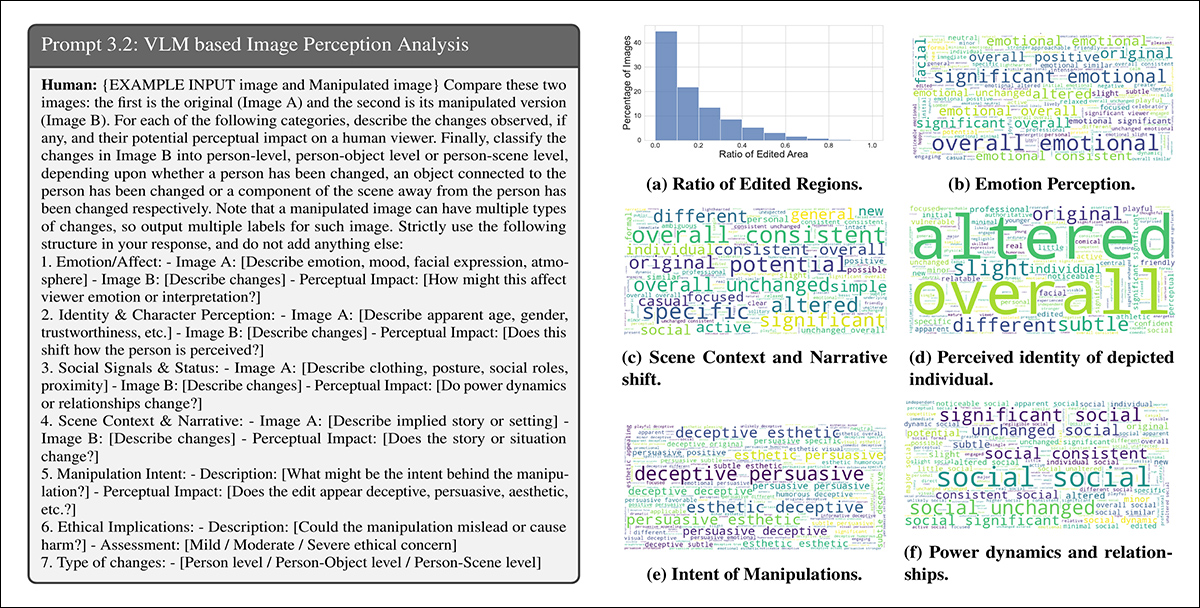

ऑस्ट्रेलिया के शोधकर्ताओं ने ‘सूक्ष्म’ डीपफेकिंग पर साहित्य में ध्यान की कमी को संबोधित करने के लिए एक महत्वपूर्ण नए डेटासेट को बनाने का प्रयास किया है, जो व्यक्ति-केंद्रित छवि मैनिपुलेशन को संकलित करता है जो संदर्भ, भावना और कथा को बदलते हैं बिना विषय की मूल पहचान को बदले।

नई संग्रह से नमूने, वास्तविक/नकली जोड़े, कुछ परिवर्तन दूसरों की तुलना में अधिक सूक्ष्म हैं। ध्यान दें, उदाहरण के लिए, एशियाई महिला के लिए अधिकार की हानि, निचले-दाएं, जैसे उसका डॉक्टर का स्टेथोस्कोप एआई द्वारा हटा दिया जाता है। उसी समय, डॉक्टर के पैड के लिए क्लिपबोर्ड की प्रतिस्थापन में कोई स्पष्ट सेमेंटिक कोण नहीं है। स्रोत: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

शीर्षक मल्टीफेकवर्स, संग्रह में 845,826 छवियां शामिल हैं जो दृष्टि भाषा मॉडल (वीएलएम) के माध्यम से उत्पन्न की जाती हैं, जो ऑनलाइन एक्सेस की जा सकती हैं और डाउनलोड की जा सकती हैं, अनुमति के साथ।

लेखकों का कहना है:

‘यह वीएलएम-ड्रIVEN दृष्टिकोण सेमेंटिक, संदर्भ-जागरूक परिवर्तनों जैसे कि क्रियाओं, दृश्यों और मानव-वस्तु इंटरैक्शन को संशोधित करने की अनुमति देता है, न कि सिंथेटिक या निम्न-स्तरीय पहचान स्वैप और क्षेत्र-विशिष्ट संपादन जो मौजूदा डेटासेट में सामान्य हैं।

‘हमारे प्रयोगों से पता चलता है कि वर्तमान राज्य-ऑफ-द-आर्ट डीपफेक डिटेक्शन मॉडल और मानव पर्यवेक्षक इन सूक्ष्म लेकिन अर्थपूर्ण मैनिपुलेशन का पता लगाने के लिए संघर्ष करते हैं।

शोधकर्ताओं ने अपने नए डेटासेट पर मानव और अग्रणी डीपफेक डिटेक्शन सिस्टम का परीक्षण किया ताकि यह देखा जा सके कि ये सूक्ष्म मैनिपुलेशन कितनी अच्छी तरह से पहचाने जा सकते हैं।

मानव भागीदारों ने संघर्ष किया, छवियों को केवल 62% समय में वास्तविक या नकली के रूप में वर्गीकृत किया, और यहां तक कि यह निर्धारित करने में भी अधिक कठिनाई हुई कि छवि के कौन से हिस्से बदले गए थे।

मौजूदा डीपफेक डिटेक्टर, जो मुख्य रूप से अधिक स्पष्ट चेहरे के स्वैपिंग या इनपेंटिंग डेटासेट पर प्रशिक्षित होते हैं, भी खराब प्रदर्शन किया, अक्सर यह पंजीकरण करने में विफल रहे कि कोई मैनिपुलेशन हुआ था। यहां तक कि फाइन-ट्यूनिंग के बाद मल्टीफेकवर्स पर, पता लगाने की दरें कम रहीं, जो दिखाती हैं कि वर्तमान प्रणालियां इन सूक्ष्म, कथा-चालित संपादनों को कितनी खराब तरीके से संभालती हैं।

विधि

मल्टीफेकवर्स डेटासेट चार वास्तविक-विश्व छवि सेट्स से बनाया गया था जो विभिन्न स्थितियों में लोगों को प्रदर्शित करते हैं: इमोटिक; पिस्क, पिपा, और पिक 2.0।

शुरुआत में 86,952 मूल छवियों के साथ, शोधकर्ताओं ने 758,041 मैनिपुलेटेड संस्करणों का उत्पादन किया।

जेमिनी-2.0-फ्लैश और चैटजीपीटी-4ओ फ्रेमवर्क का उपयोग प्रत्येक छवि के लिए छह न्यूनतम संपादनों का प्रस्ताव करने के लिए किया गया था – संपादन जो विषय को कैसे देखा जाता है इसे सूक्ष्म रूप से बदलने के लिए डिज़ाइन किए गए थे।

मॉडल को निर्देश दिया गया था कि वे संपादन उत्पन्न करें जो विषय को निर्दोष, गर्वित, पश्चाताप, अनुभवहीन, या उदासीन दिखाई दें, या दृश्य में कुछ तथ्यात्मक तत्व को समायोजित करें।

प्रत्येक संपादन के साथ, मॉडल ने एक रेफरिंग एक्सप्रेशन भी उत्पन्न किया जो स्पष्ट रूप से संपादन के लक्ष्य की पहचान कर सके, यह सुनिश्चित करते हुए कि बाद की संपादन प्रक्रिया प्रत्येक छवि में सही व्यक्ति या वस्तु पर परिवर्तन लागू कर सकती है।

लेखकों का कहना है:

‘नोट कि रेफरिंग एक्सप्रेशन एक व्यापक रूप से अन्वेषित डोमेन है जो एक वाक्यांश को दर्शाता है जो एक छवि में लक्ष्य को अस्पष्ट कर सकता है, उदाहरण के लिए, एक छवि में दो पुरुषों के बैठने पर, एक फोन पर बात कर रहा है और दूसरा दस्तावेजों को देख रहा है, दूसरे के लिए एक उपयुक्त रेफरिंग एक्सप्रेशन होगा बाएं आदमी जो कागज का एक टुकड़ा पकड़ रहा है.’

एक बार संपादन परिभाषित हो जाने के बाद, वास्तविक छवि मैनिपुलेशन को दृष्टि-भाषा मॉडल द्वारा निर्दिष्ट परिवर्तनों को लागू करके किया गया था, जबकि दृश्य के बाकी हिस्सों को अकेला छोड़ दिया गया था।

शोधकर्ताओं ने इस कार्य के लिए तीन प्रणालियों का परीक्षण किया: जीपीटी-इमेज-1; जेमिनी-2.0-फ्लैश-इमेज-जेनरेशन; और आईसीईडिट।

बाईस हजार नमूना छवियों को उत्पन्न करने के बाद, जेमिनी-2.0-फ्लैश सबसे अधिक संगत विधि के रूप में उभरा, जो संपादन उत्पन्न करता था जो दृश्य में प्राकृतिक रूप से मिल जाते थे बिना दृश्य कलाकृतियों का परिचय दिए; आईसीईडिट ने अक्सर अधिक स्पष्ट नकली उत्पन्न किए, जिनमें संशोधित क्षेत्रों में ध्यान देने योग्य दोष थे; और जीपीटी-इमेज-1 ने कभी-कभी अनजाने में छवि के अन्य भागों को प्रभावित किया, जो आंशिक रूप से इसके निर्धारित आउटपुट आस्पेक्ट अनुपात के अनुरूप था।

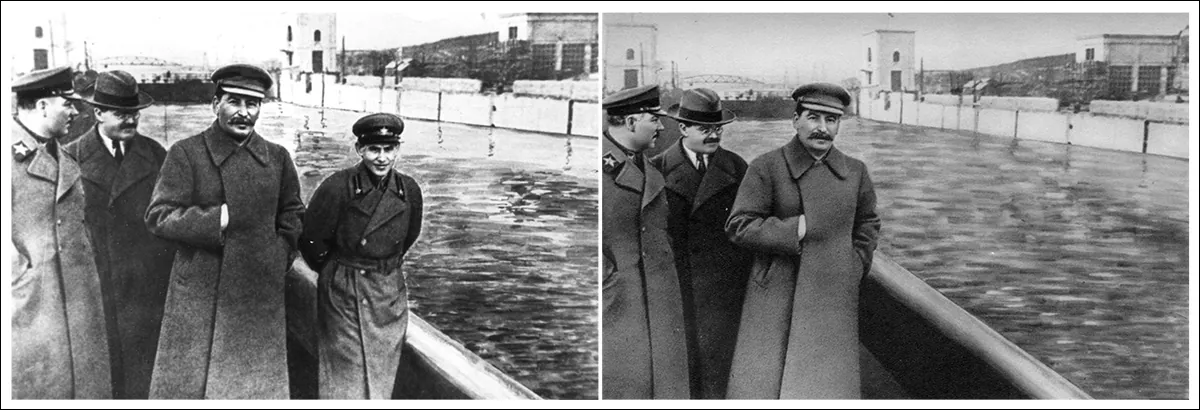

छवि विश्लेषण

प्रत्येक मैनिपुलेटेड छवि की तुलना इसकी मूल छवि से की गई ताकि यह निर्धारित किया जा सके कि छवि का कितना हिस्सा बदला गया था। दो संस्करणों के बीच पिक्सेल-स्तर के अंतर की गणना की गई, जिसमें छोटे यादृच्छिक शोर को फिल्टर आउट किया गया ताकि अर्थपूर्ण संपादन पर ध्यान केंद्रित किया जा सके।

कुछ छवियों में, केवल छोटे क्षेत्र प्रभावित हुए थे; दूसरों में, अस्सी प्रतिशत दृश्य संशोधित किया गया था।

यह मूल्यांकन करने के लिए कि प्रत्येक छवि का अर्थ इन परिवर्तनों के प्रकाश में कितना बदल गया है, मूल और मैनिपुलेटेड छवियों के लिए कैप्शन शेयरजीपीटी-4वी दृष्टि-भाषा मॉडल का उपयोग करके उत्पन्न किए गए थे।

इन कैप्शन को लॉन्ग-सीएलआईपी का उपयोग करके एम्बेडिंग में परिवर्तित किया गया था, जिससे सामग्री के कितने दूर विचलन की तुलना करने की अनुमति मिली।

सबसे मजबूत सेमेंटिक परिवर्तन उन मामलों में देखे गए जहां व्यक्ति के करीब या सीधे जुड़े हुए वस्तुओं को बदल दिया गया था, क्योंकि ये छोटे समायोजन छवि की व्याख्या को महत्वपूर्ण रूप से बदल सकते थे।

जेमिनी-2.0-फ्लैश का उपयोग प्रत्येक छवि में प्रकार के मैनिपुलेशन को वर्गीकृत करने के लिए किया गया था, जो यह देखते हुए कि संपादन कहां और कैसे किए गए थे।

मैनिपुलेशन को तीन श्रेणियों में वर्गीकृत किया गया था: व्यक्ति-स्तर संपादन में विषय के चेहरे की अभिव्यक्ति, मुद्रा, दृष्टि, कपड़े, या अन्य व्यक्तिगत विशेषताओं में परिवर्तन शामिल थे; वस्तु-स्तर संपादन ने व्यक्ति से जुड़ी वस्तुओं को प्रभावित किया, जैसे कि वे जो पकड़ रहे थे या अग्रभूमि में बातचीत कर रहे थे; और दृश्य-स्तर संपादन ने पृष्ठभूमि तत्वों या दृश्य के व्यापक पहलुओं को शामिल किया जो व्यक्ति को सीधे शामिल नहीं करते थे।

संज्ञानात्मक प्रभाव का मूल्यांकन

जेमिनी-2.0-फ्लैश का उपयोग छह क्षेत्रों में दर्शक की धारणा को कैसे बदलने के लिए किया गया था: भावना, व्यक्तिगत पहचान, शक्ति गतिविधियाँ, दृश्य कथा, मैनिपुलेशन का इरादा, और नैतिक चिंताएं।

भावना के लिए, संपादन अक्सर आनंददायक, आकर्षक, या आकर्षक जैसे शब्दों के साथ वर्णित किए गए थे, जो विषयों को भावनात्मक रूप से कैसे फ्रेम किया गया था इसमें बदलाव का सुझाव देते थे।

विवरण पहचान में बदलाव शामिल थे जैसे युवा, खिलौना, और कमजोर, जो दिखाते हैं कि मामूली परिवर्तन कैसे व्यक्तियों की धारणा को प्रभावित कर सकते हैं।

मैनिपुलेशन के पीछे के इरादे को प्रेरक, भ्रामक, या सौंदर्य के रूप में लेबल किया गया था। जबकि अधिकांश संपादन को केवल हल्के नैतिक चिंताओं के रूप में देखा गया था, एक छोटा सा हिस्सा मध्यम या गंभीर नैतिक परिणामों के रूप में देखा गया था।

मीट्रिक्स

मल्टीफेकवर्स संग्रह की दृश्य गुणवत्ता का मूल्यांकन तीन मानक मीट्रिक्स का उपयोग करके किया गया था: पीक सिग्नल-टू-नॉइज़ रेशियो (पीएसएनआर); संरचनात्मक समानता सूचकांक (एसएसआईएम); और फ्रेचेट इन्सेप्शन दूरी (एफआईडी):

मल्टीफेकवर्स के लिए पीएसएनआर, एसएसआईएम, और एफआईडी द्वारा मापी गई छवि गुणवत्ता स्कोर।

एसएसआईएम स्कोर 0.5774 एक मध्यम डिग्री की समानता को दर्शाता है, जो अधिकांश छवि को संरक्षित करते हुए लक्षित संपादन लागू करने के लक्ष्य के साथ संगत है; एफआईडी स्कोर 3.30 सuggests कि उत्पन्न छवियां उच्च गुणवत्ता और विविधता बनाए रखती हैं; और 66.30 डेसिबल का पीएसएनआर मान यह दर्शाता है कि छवियों में संपादन के बाद अच्छी दृश्य विश्वसनीयता बनी रहती है।

उपयोगकर्ता अध्ययन

एक उपयोगकर्ता अध्ययन चलाया गया ताकि यह देखा जा सके कि मल्टीफेकवर्स में सूक्ष्म नकली कितनी अच्छी तरह से पहचानी जा सकती हैं। अठारह प्रतिभागियों को पचास छवियां दिखाई गईं, जो वास्तविक और मैनिपुलेटेड उदाहरणों के बीच समान रूप से विभाजित थीं, जो विभिन्न प्रकार के संपादन को कवर करते थे।

प्रत्येक व्यक्ति से छवि को वास्तविक या नकली के रूप में वर्गीकृत करने और, यदि नकली, तो लागू की गई मैनिपुलेशन के प्रकार की पहचान करने के लिए कहा गया था।

वास्तविक बनाम नकली के बीच निर्णय लेने के लिए समग्र सटीकता 61.67 प्रतिशत थी, जिसका अर्थ है कि प्रतिभागियों ने एक तिहाई से अधिक समय में छवियों को गलत वर्गीकृत किया।

लेखकों का कहना है:

‘नकली छवियों के लिए मानव भविष्यवाणियों का विश्लेषण करने से पता चलता है कि मैनिपुलेशन स्तरों के बीच औसत इंटरसेक्शन ओवर यूनियन 24.96% था।

‘यह दिखाता है कि हमारे डेटासेट में मैनिपुलेशन के क्षेत्रों की पहचान करना मानव पर्यवेक्षकों के लिए एक गैर-मामूली कार्य है।’

मल्टीफेकवर्स डेटासेट बनाने में व्यापक गणना संसाधनों की आवश्यकता थी: संपादन निर्देशों के उत्पादन के लिए, जेमिनी और जीपीटी मॉडल को 845,000 एपीआई कॉल किए गए, जिनमें से पrompting कार्यों की लागत लगभग $1000 थी; जेमिनी-आधारित छवियों का उत्पादन लगभग $2,867 की लागत से आया; और जीपीटी-इमेज-1 का उपयोग करके छवियों का उत्पादन लगभग $200 की लागत से आया। आईसीईडिट छवियां एक एनवीआईडीआईए ए6000 जीपीयू पर स्थानीय रूप से बनाई गईं, जो कार्य को लगभग चौबीस घंटे में पूरा करती हैं।

परीक्षण

परीक्षण से पहले, डेटासेट को विभाजित किया गया था प्रशिक्षण, सत्यापन, और परीक्षण सेट में पहले 70% वास्तविक छवियों को प्रशिक्षण के लिए चुना गया; 10 प्रतिशत सत्यापन के लिए; और 20 प्रतिशत परीक्षण के लिए। प्रत्येक वास्तविक छवि से उत्पन्न मैनिपुलेटेड छवियां उसी सेट में सौंपी गईं जैसा कि उनकी मूल छवि।

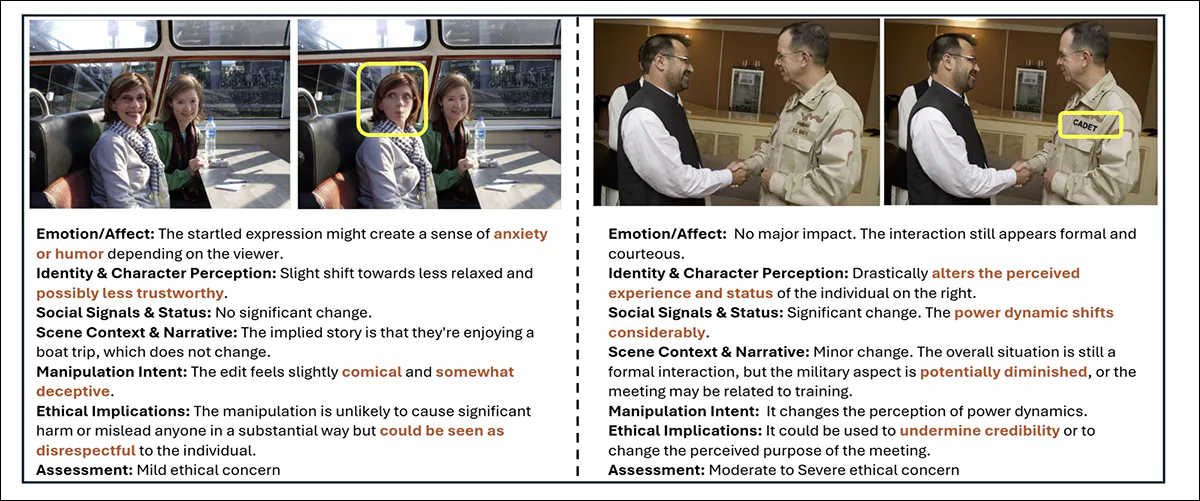

डेटासेट से और वास्तविक (बाएं) और संशोधित (दाएं) सामग्री के उदाहरण।

नकली का पता लगाने के प्रदर्शन का मूल्यांकन छवि-स्तर की सटीकता (क्या प्रणाली पूरी छवि को वास्तविक या नकली के रूप में सही ढंग से वर्गीकृत करती है) और एफ1 स्कोर का उपयोग करके किया गया था। मैनिपुलेटेड क्षेत्रों को स्थानांतरित करने के लिए, मूल्यांकन में क्षेत्र के नीचे की वक्र (एयूसी), एफ1 स्कोर, और इंटरसेक्शन ओवर यूनियन (आईओयू) का उपयोग किया गया था।

मल्टीफेकवर्स डेटासेट का उपयोग पूरे परीक्षण सेट पर अग्रणी डीपफेक डिटेक्शन सिस्टम के खिलाफ किया गया था, जिसमें प्रतिद्वंद्वी फ्रेमवर्क सीएनएनस्पॉट; एंटीफेकप्रॉम्प्ट; ट्रुफोर; और दृष्टि-भाषा आधारित सिडा शामिल थे।

प्रत्येक मॉडल का पहले जीरो-शॉट मोड में मूल्यांकन किया गया था, जिसमें इसके मूल प्री-प्रशिक्षित वजन का उपयोग किया गया था बिना किसी आगे के समायोजन के।

दो मॉडल, सीएनएनस्पॉट और सिडा, को मल्टीफेकवर्स प्रशिक्षण डेटा पर फाइन-ट्यून किया गया था ताकि यह मूल्यांकन किया जा सके कि पुनः प्रशिक्षण प्रदर्शन में सुधार करता है या नहीं।

मल्टीफेकवर्स पर जीरो-शॉट और फाइन-ट्यून्ड स्थितियों में डीपफेक डिटेक्शन परिणाम। कोष्ठक में संख्याएं फाइन-ट्यूनिंग के बाद परिवर्तन दिखाती हैं।

इन परिणामों में, लेखकों का कहना है:

‘[द] मॉडल जो पहले इनपेंटिंग-आधारित फेक्स पर प्रशिक्षित हुए थे, हमारे वीएलएम-एडिटिंग-आधारित फोर्जरी की पहचान करने के लिए संघर्ष करते हैं, विशेष रूप से सीएनएनस्पॉट लगभग सभी छवियों को वास्तविक के रूप में वर्गीकृत करता है। एंटीफेकप्रॉम्प्ट में शून्य-शॉट प्रदर्शन में 66.87% औसत वर्ग-वार सटीकता और 55.55% एफ1 स्कोर के साथ सबसे अच्छा प्रदर्शन है।

‘हमारे प्रशिक्षण सेट पर फाइन-ट्यूनिंग के बाद, हम सीएनएनस्पॉट और सिडा-13बी दोनों में प्रदर्शन में सुधार देखते हैं, सीएनएनस्पॉट दोनों औसत वर्ग-वार सटीकता (1.92% द्वारा) और एफ1-स्कोर (1.97% द्वारा) में सिडा-13बी को पार करता है।’

सिडा-13बी का मूल्यांकन मल्टीफेकवर्स पर किया गया ताकि यह मापा जा सके कि यह प्रत्येक छवि में मैनिपुलेटेड क्षेत्रों का स्थान कितनी सटीकता से निर्धारित कर सकता है।

मूल रूप में, यह 13.10 के इंटरसेक्शन ओवर यूनियन स्कोर, 19.92 के एफ1 स्कोर, और 14.06 के एयूसी को प्राप्त किया, जो कमजोर स्थानीयकरण प्रदर्शन को दर्शाता है।

फाइन-ट्यूनिंग के बाद, स्कोर 24.74 में इओयू, 39.40 में एफ1, और 37.53 में एयूसी में सुधार हुआ। हालांकि, अतिरिक्त प्रशिक्षण के साथ भी, मॉडल को अभी भी यह निर्धारित करने में परेशानी हुई कि संपादन कहां किए गए थे, जो दिखाता है कि इन प्रकार के छोटे, लक्षित परिवर्तनों का पता लगाना कितना मुश्किल हो सकता है।

निष्कर्ष

नई अध्ययन एक दृष्टि को उजागर करती है जो मानव और मशीन दोनों धारणा में एक अंधे धब्बे के रूप में कार्य करती है: जबकि डीपफेक्स के आसपास के अधिकांश सार्वजनिक विवाद पहचान स्वैप पर केंद्रित रहे हैं, ये शांत ‘कथा संपादन’ अधिक कठिन हैं और लंबे समय में अधिक विषाक्त हो सकते हैं।

जैसे ही चैटजीपीटी और जेमिनी जैसी प्रणालियां इस प्रकार की सामग्री के उत्पादन में अधिक सक्रिय भूमिका निभाती हैं, और जैसे ही हम स्वयं अपने फोटो-स्ट्रीम की वास्तविकता को बदलने में भाग लेते हैं, क्रूड मैनिपुलेशन की पहचान पर निर्भर डिटेक्शन मॉडल अपर्याप्त रक्षा प्रदान कर सकते हैं।

मल्टीफेकवर्स यह नहीं दिखाता है कि पता लगाने में विफलता है, लेकिन यह कि समस्या का कम से कम एक हिस्सा एक अधिक कठिन, धीमी गति से आगे बढ़ने वाले रूप में बदल रहा है: एक जहां छोटे दृश्य झूठ धीरे-धीरे अनदेखे हो जाते हैं।

पहली बार गुरुवार, 5 जून, 2025 को प्रकाशित