Anderson का एंगल

Restoring What Your Camera Captured Before AI Changed It

How can you protect the sanctity of a raw photograph from AI interference when it’s already been automatically run through AI inside the camera? New research seeks to restore ‘true’ sensor data – also with AI!

The increase in the authenticity of AI images over the last year or so has caused many groups and individuals to rally against the ensuing erosion of trust in photography.

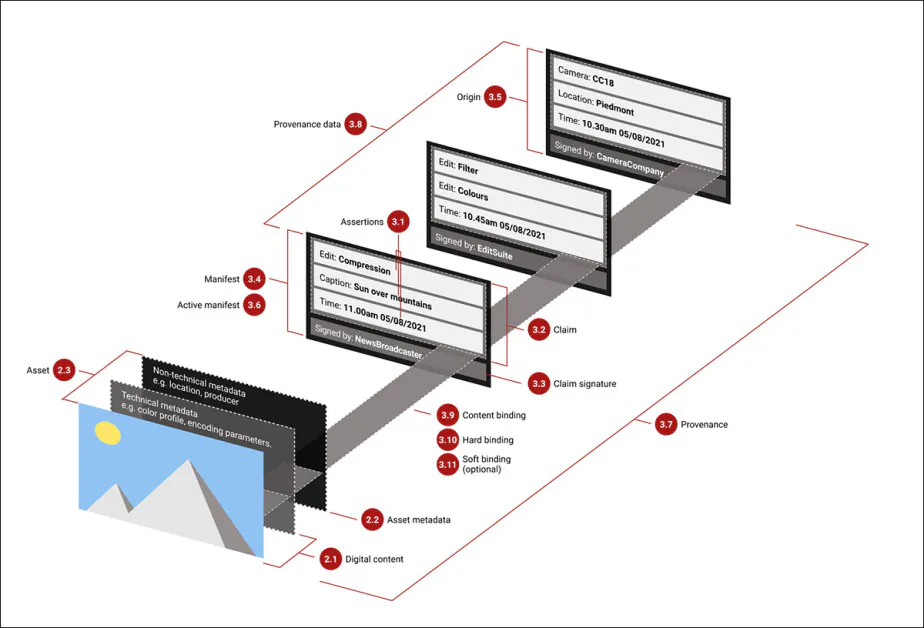

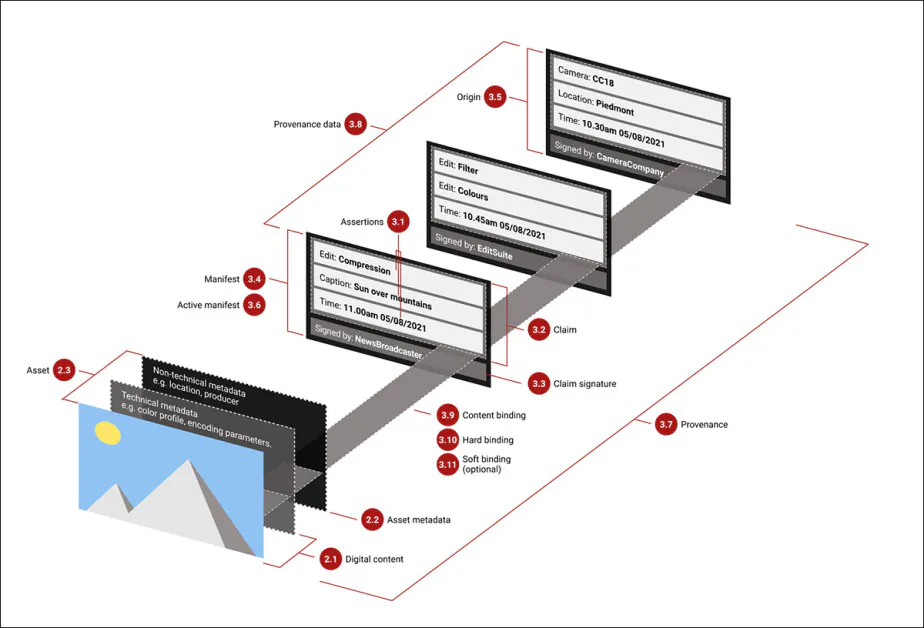

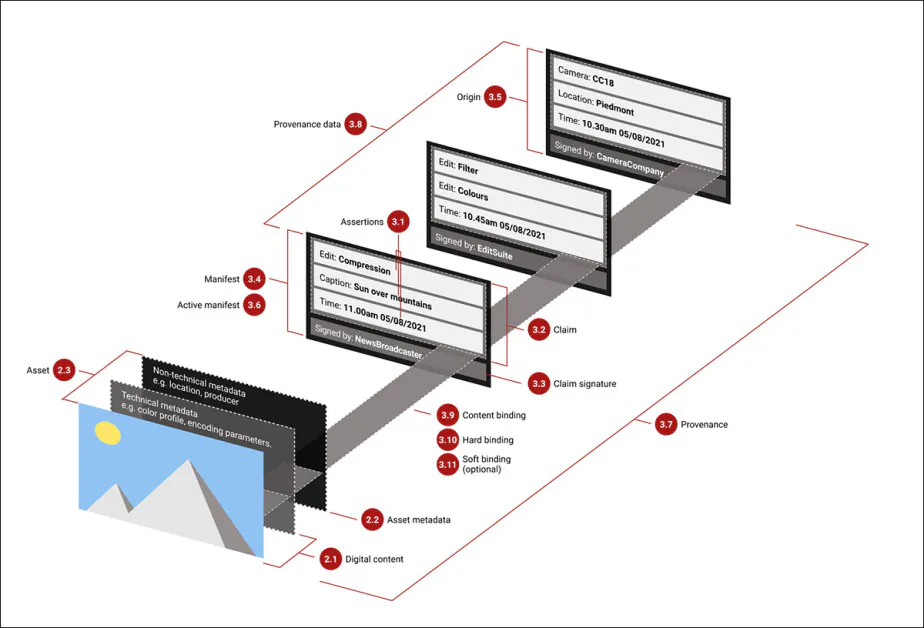

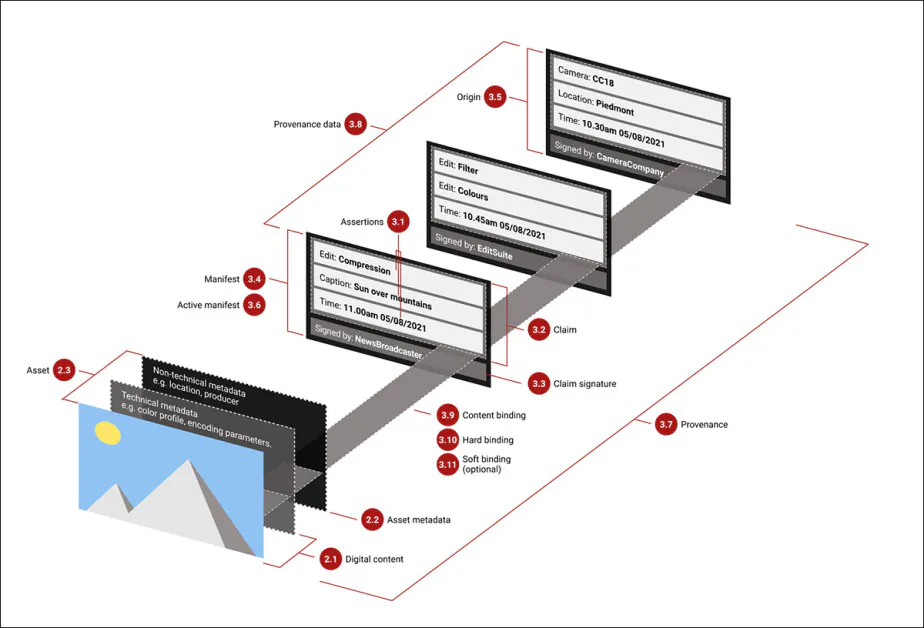

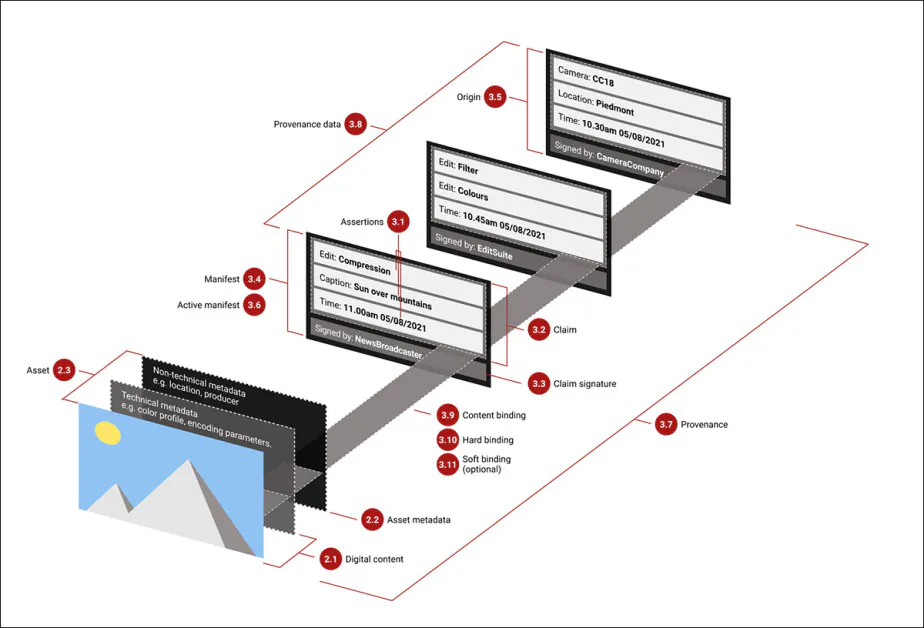

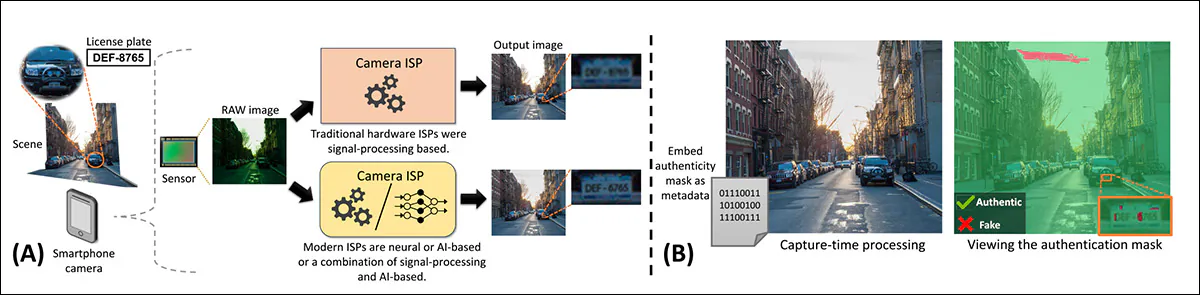

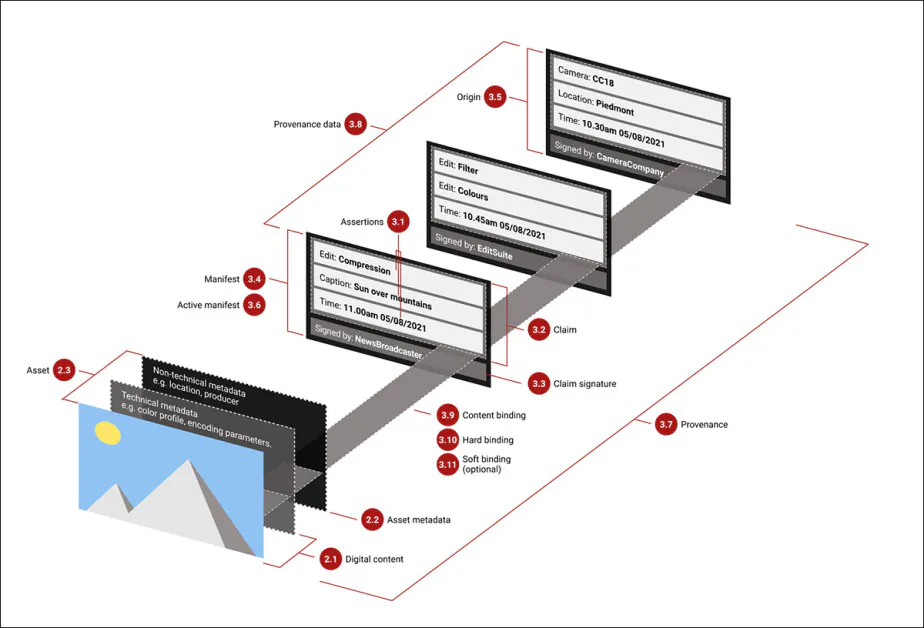

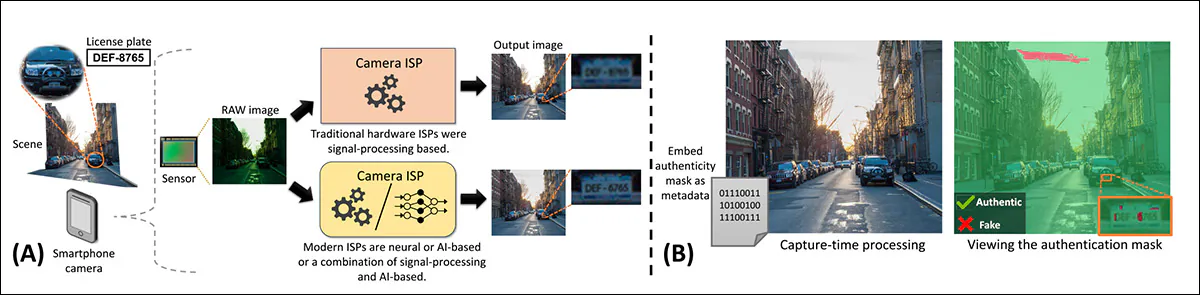

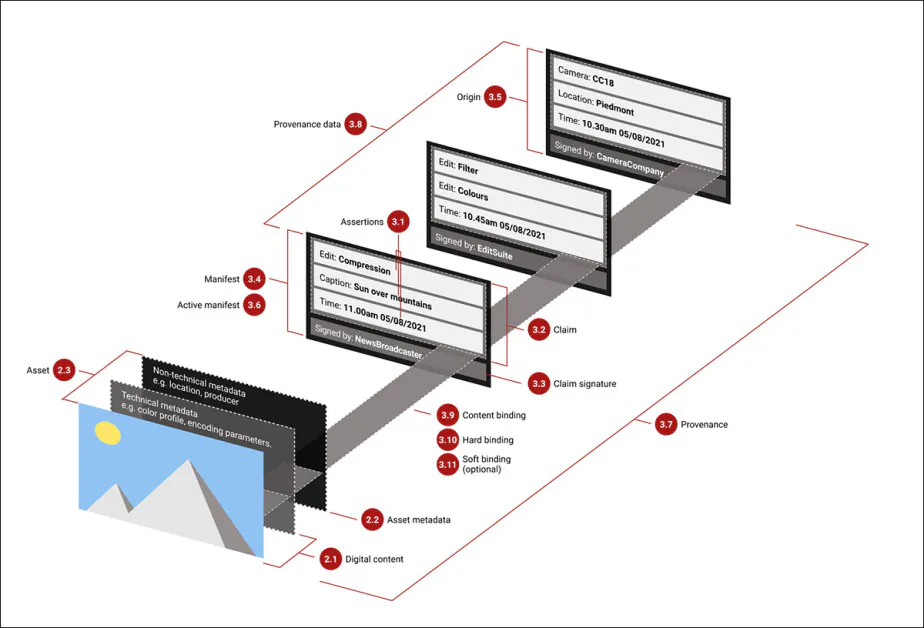

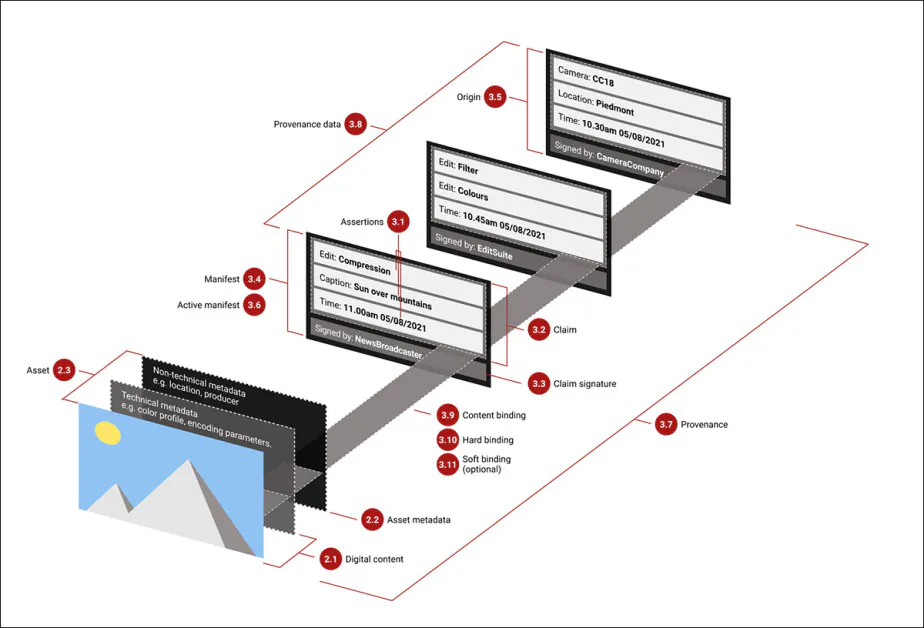

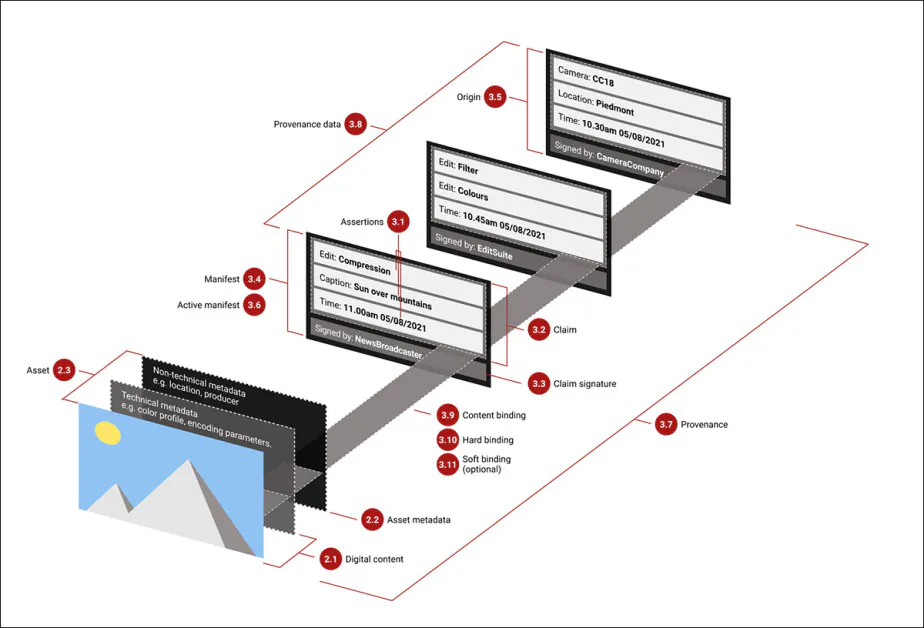

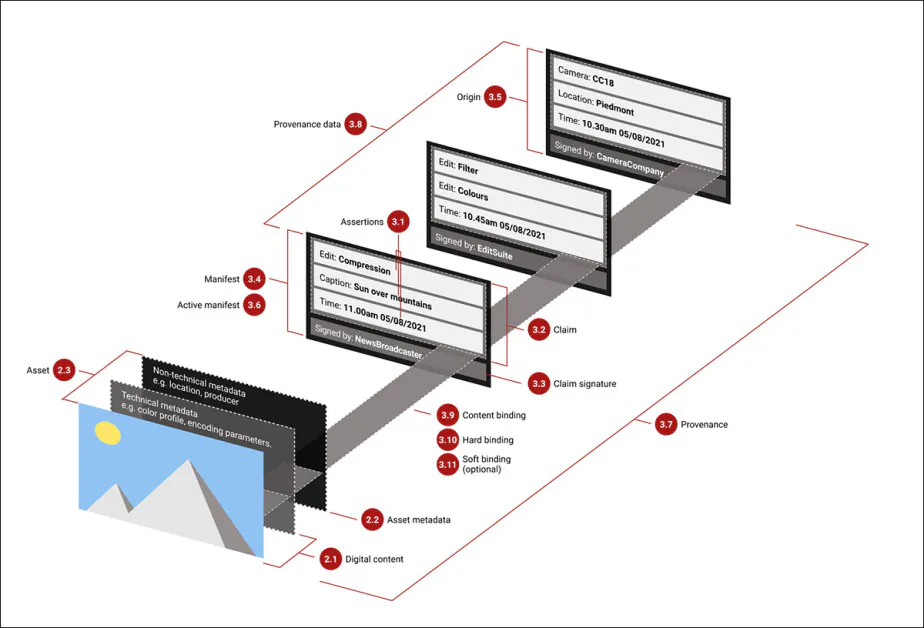

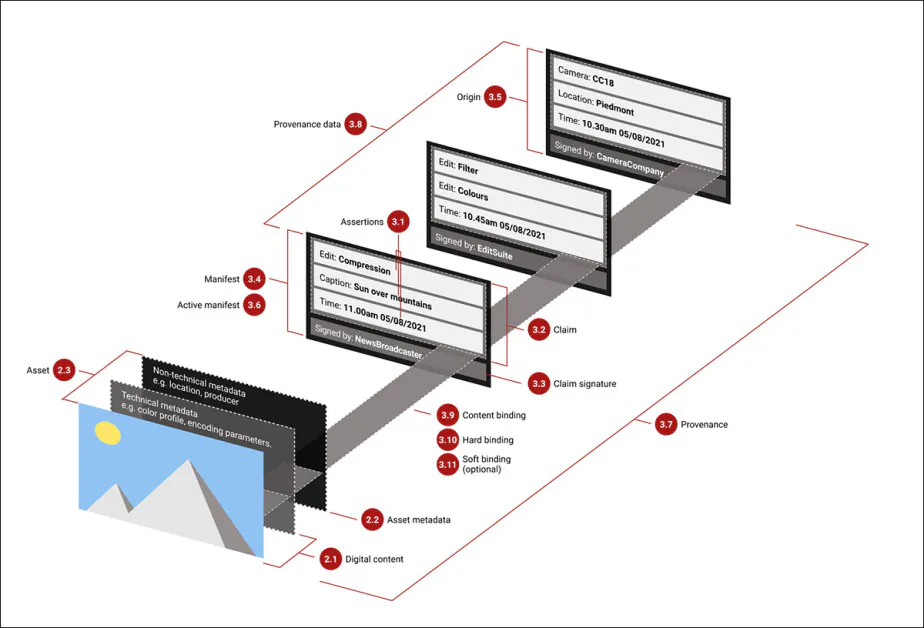

In the same period, the Coalition for Content Provenance and Authenticity (C2PA) has attempted to diffuse a semi-cryptographic standard that attaches metadata-based provenance information to an image, from the very instant that it is captured by a supported camera or device, hoping to unmask any subsequent use of generative AI on these ‘original’ pictures:

Schema of provenance in the C2PA system, where metadata written at the instance of capture can be added to like a diary, allowing for customary adjustments such as brightness and contrast, but recording major adjustments, so that a heavily AI-altered image will show up as such in media outlets that support this system. Source

Adoption of the standard has not been as widespread as the coalition had hoped, and currently only 14 cameras support in-camera imprinting of the authenticity information.

What’s interesting about the C2PA’s idea of giving a photo a ‘passport’ as soon as it comes into existence, is that by that time it may already be too late – because camera manufacturers now routinely bake AI-processing into the very creation of the image:

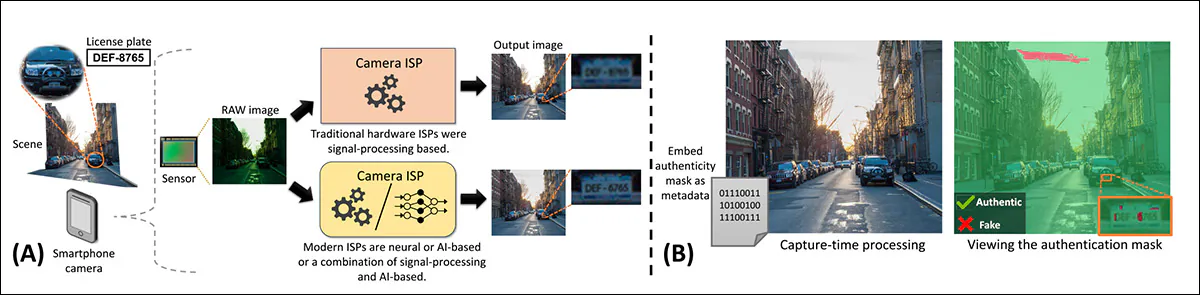

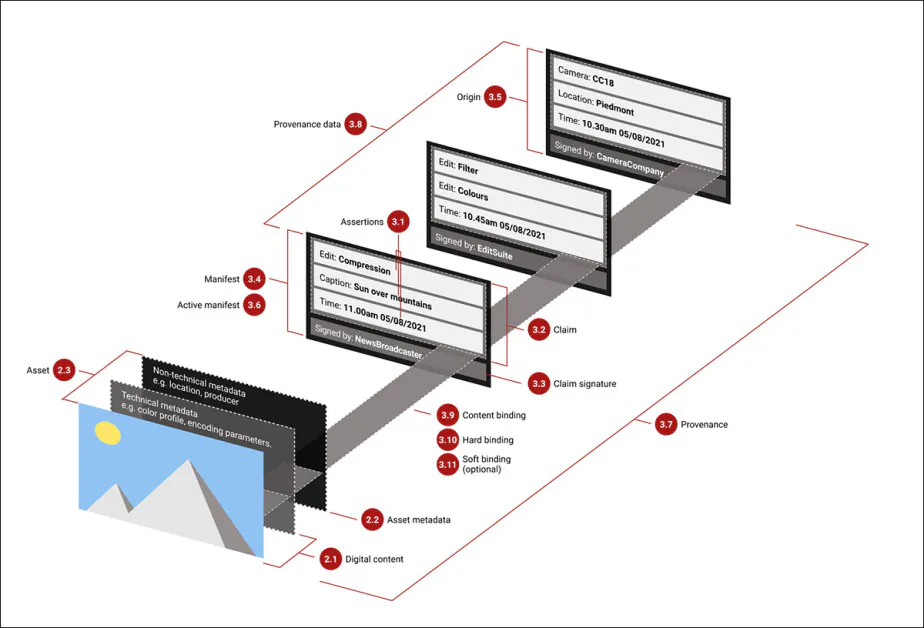

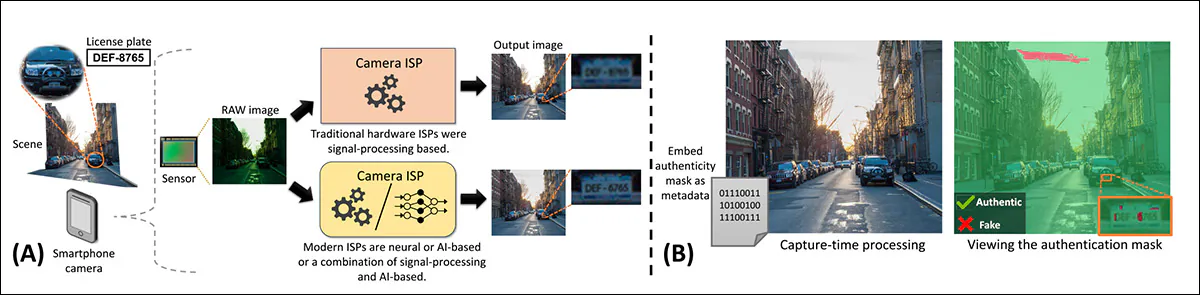

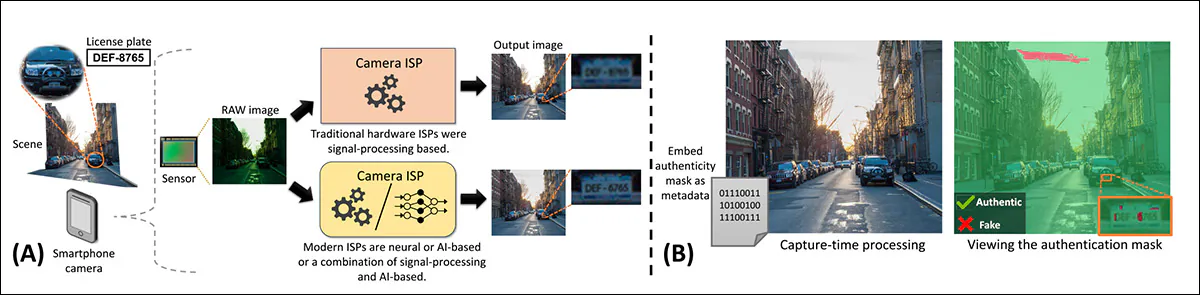

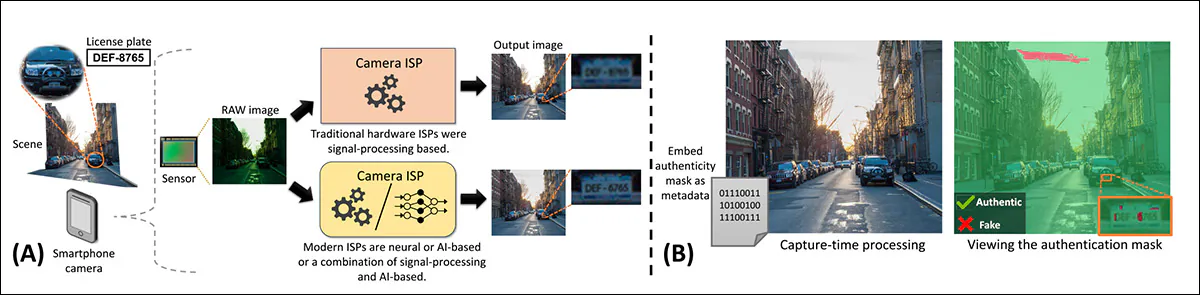

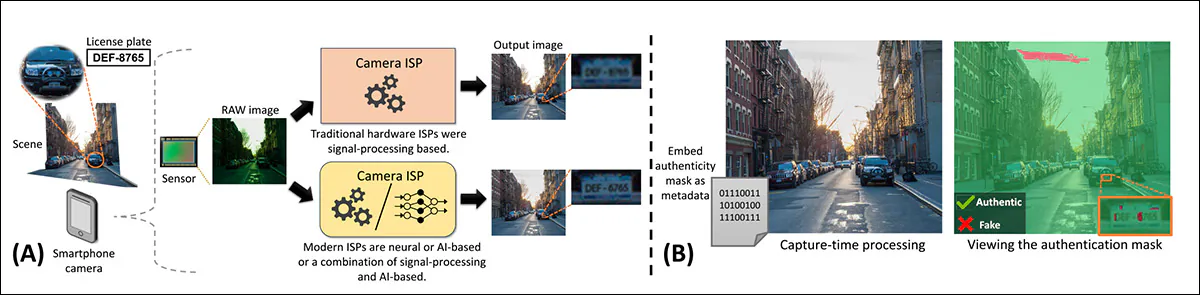

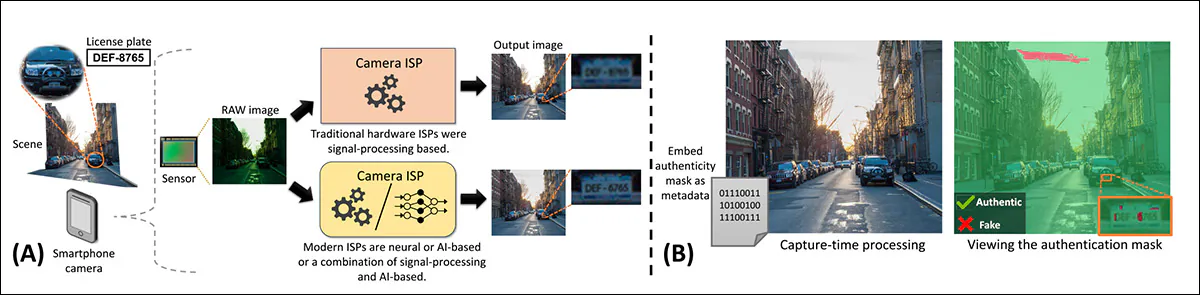

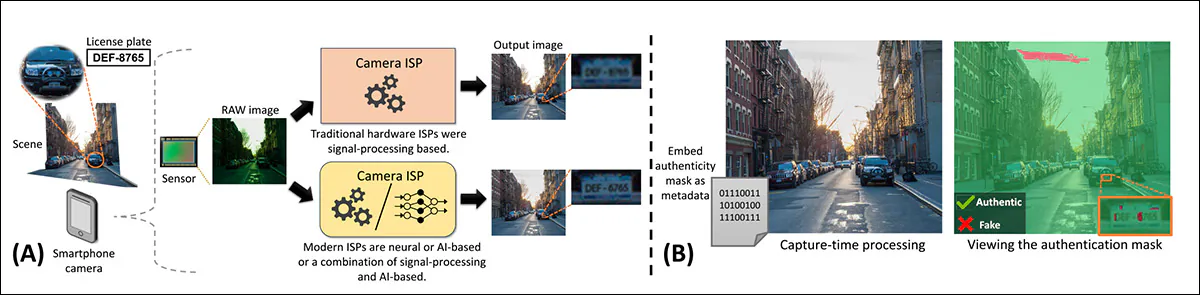

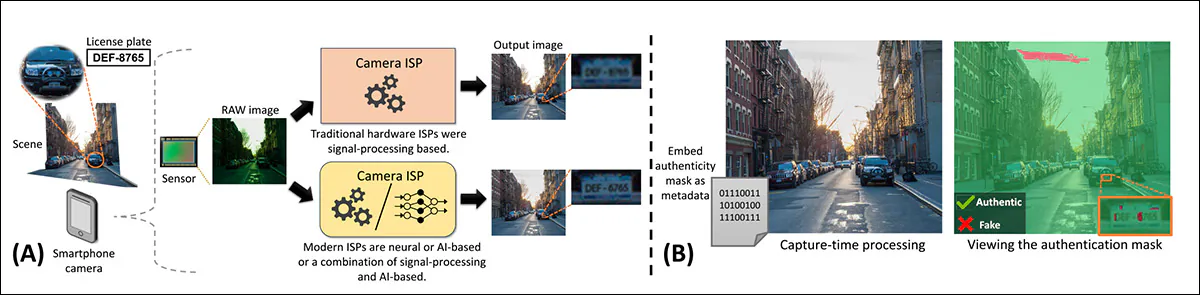

From the 2024 paper ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: an illustration of how modern camera pipelines introduce hallucinated content at capture time and how pixel-level authentication metadata exposes it. In (A), a smartphone sensor image is processed by the ISP, where AI modules can invent details during digital zoom or exposure correction, producing realistic images with errors such as misread license plate digits. In (B), an authentication mask is embedded as metadata and later overlaid to reveal non-authentic regions, allowing users to distinguish original data from AI-altered pixels. Source

In fact, this AI ‘interference’ in the capture of raw data from the camera’s sensor could eventually even become the governing process.

This kind of post-processing is not the same as the current trend for altering photos in-camera, wherein a phone app or a camera app allows the user to re-think a photo at leisure before it is even downloaded from the device.

Rather, the processing happens in a ‘black box’ routine in the camera’s Image Signal Processor (ISP), usually in a proprietary runtime that does not expose or make available the raw sensor data (and consider that the supposedly ‘pure’ camera RAW format is not all that ‘raw’).

Therefore, by the time you’re able to see the photo at all, it may have been subject to AI-aided enhancements such as low-light enhancement, upscaling, or even moon replacement.

In many cases, this can lead to inaccurate reconstructions, for instance of text, that might invalidate the use of such an image for evidence, since a true ‘raw’ image would not be available:

From the new paper – a RAW sensor image is processed by a GenAI-enabled ISP to produce a final sRGB output that appears clearer but may contain hallucinated details, as shown in the license plate example where characters are incorrectly inferred during digital zoom. The true scene, which is not accessible in practice, differs from both the AI-enhanced output and the intermediate authentic image prior to hallucination. The proposed approach enables recovery of this pre-hallucination image, restoring what the camera optics originally captured before AI-based enhancements modified the content. Source

The above examples come from a new research paper that offers a remedy to ‘native AI photos’, using alternate AI processes to reconstruct the estimated raw and unadulterated image from the processed image.

The authors state:

‘When AI models trained with generative or perceptual losses are used in ISPs, they are prone to hallucinate content, potentially altering image [meaning]. The implication is that images directly output from the camera may now contain “fake” content, especially in smartphone cameras where AI-ISP modules are seeing increasing adoption.

‘The use of GenAI in camera hardware marks a paradigm shift in how we view camera images and challenges the traditional forensic view of camera-captured images as inherently trustworthy.’

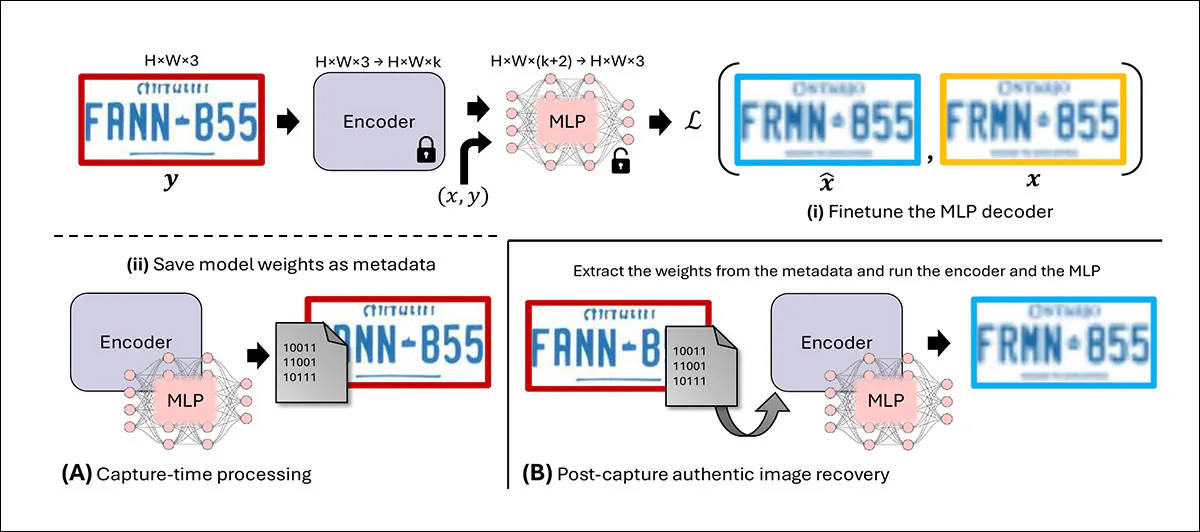

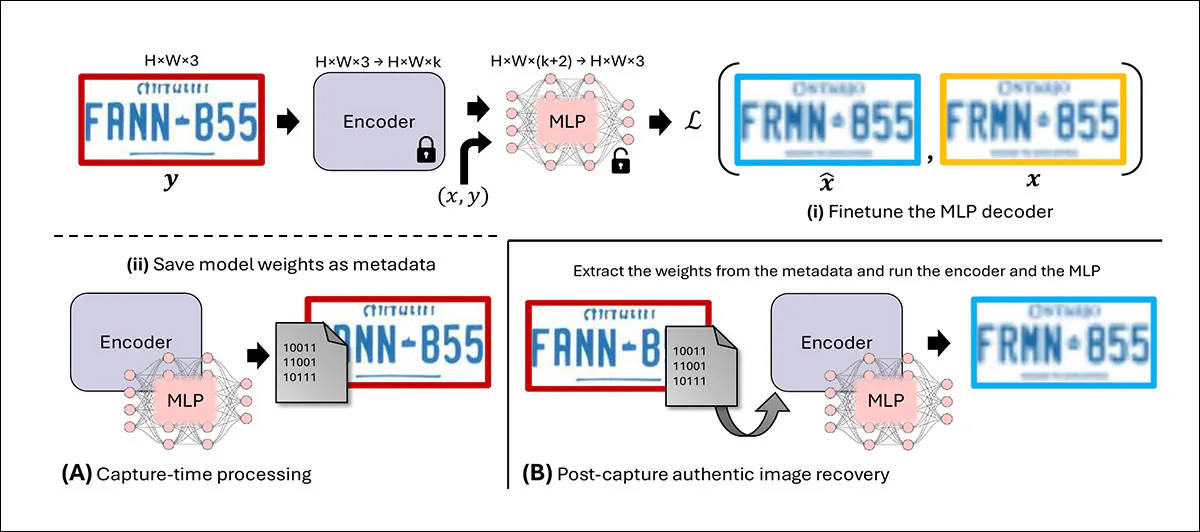

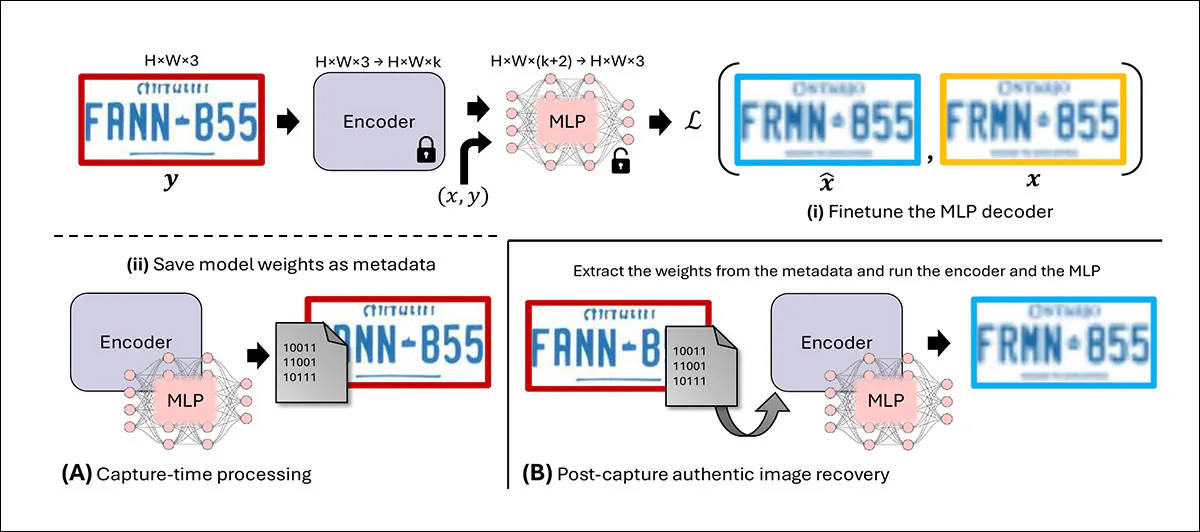

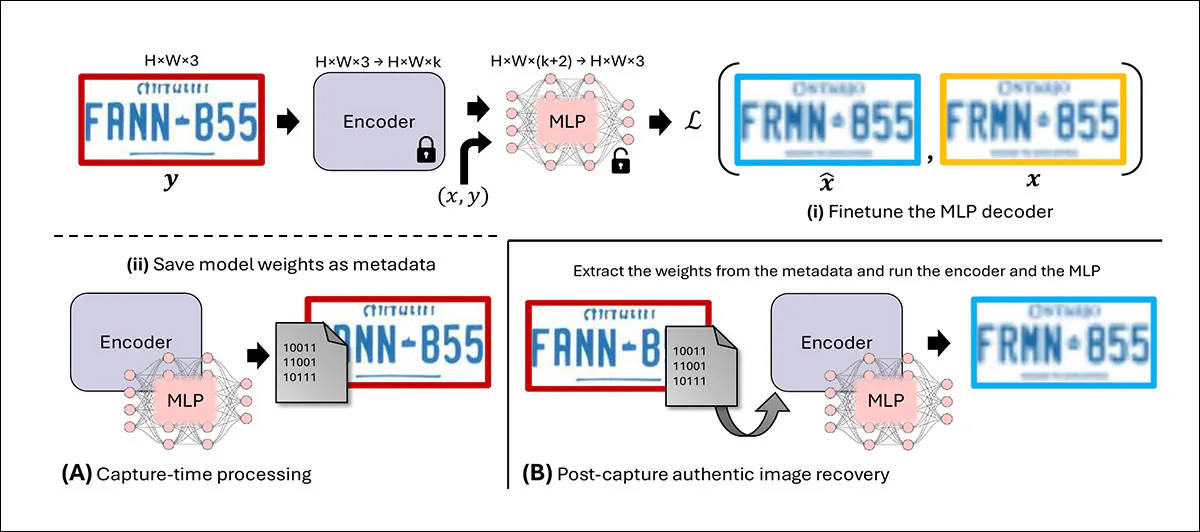

The new work uses a very light encoder and MLP decoder, which can be included inside the image at a weight penalty of only 180kb. The objective is the development of encoding systems fast enough to re-extract the original image in real time.

From the new paper: GenAI-based super-resolution within the camera ISP can subtly alter facial features, shifting appearance or perceived identity through changes in gaze and mouth shape. Low-light enhancement can similarly modify image content, affecting interpretation despite improving visual quality. In the QR code example, enhancement makes the image more appealing but renders the code unreadable. The method enables recovery of the authentic image prior to these hallucinations, restoring original facial details and a scannable QR code.

Alternatively, camera manufacturers could give users access to the truly unmolested sensor dumps; however, this seems likely to stay restricted to very high-end equipment. In the mobile and popular consumer space, sadly, access to non-processed photos may be considered a ‘niche’ or marginal pursuit.

While consumer cameras have always applied some level of post-processing, prior to the advent of edge AI, the algorithms used were minimally ‘interpretive’, and not likely to alter the content of a photo in the same meaningful way that current AI methods can.

Interestingly, considering the extent to which Samsung’s ‘moon-replacement policy’ was subject to public criticism some years back, Samsung’s AI Center at Toronto is one of the participants in the new work, which is titled Addressing Image Authenticity When Cameras Use Generative AI, and is led by contributions from five researchers at the University of Toronto.

Method

The authors make use of the only other project to date that appears to have directly addressed the issue of perturbation-by-design: the 2024 paper Advocating Pixel-Level Authentication of Camera-Captured Images, which proposed a ‘binary authentication mask’ delineating areas changed by in-camera AI processes:

Rightmost, the 2024 paper’s ‘authenticity mask’ reveals areas of the sky affected by AI ‘smoothing’ processes in a camera.

However, the system offered no method by which a ‘true’ image might be recovered, which the new work addresses, while acknowledging a debt to the earlier outing.

The objective of the new work is to enable users to recover an image as near as possible to what actually hit the sensor before the processing took place:

Overview of the proposed method. In (A), at capture time, the ISP output image containing hallucinations is passed through a frozen pretrained encoder, and its latent features are combined with spatial coordinates and fed into an MLP that operates per pixel to predict the non-hallucinated image, with training guided by a loss against the authentic image. The encoder and MLP weights are then saved as metadata alongside the image. In (B), at inference, these weights are retrieved from the metadata and used with the encoder and MLP to reconstruct the non-hallucinated image.

At capture time, in the new method, the processed image is passed through a frozen encoder that converts it into a compact latent representation. Subsequently, the relevant spatial coordinates are combined with these features and fed into a lightweight MLP that operates on a per-pixel basis, to predict the original image content – learning, effectively, to subtract the hallucinated elements through a reconstruction loss, against authentic targets.

The encoder and decoder are pretrained on paired authentic and hallucinated images, then quickly fine-tuned for each captured image, with their weights stored as metadata alongside the photo itself, adding only a small size overhead.

At viewing time, these stored weights are extracted and reused to run the same encoder and MLP, enabling recovery of an image that closely approximates what the camera sensor originally captured, without introducing new synthetic content.

Data and Tests

The authors tested the new method using two of the most commonly-implemented ISP post-processing tasks: super-resolution (SR, including for zoomed areas); and low-light photography.

For the general (‘natural image’) SR section of the tests, many examples of text were included in the data, since ISP SR routines are known to have altered text (for instance, of car license number plates, but see examples earlier in the article). Since text distortion is a discrete issue in its own right, this was treated as a sub-set of the SR tests, with dedicated data.

The aforementioned encoder was trained for each of the two modalities tested, and each was selected based on which AI ISP module was likely to be engaged during capture (i.e., a ‘low-light’ module, in dark conditions).

The authors used the DIV2K dataset for super-resolution training, powered by the popular RealESRGAN network. In line with the aforementioned 2024 work on ISP interference, the researchers generated paired data featuring unaffected and hallucination-affected content.

For the text SR section, the authors used the 2023 MARCONet text SR model:

From the 2023 MARCONet paper, examples of real-world low-resolution and equivalent upscaled texts. Source

To create paired data in this case, the researchers ran non-hallucinated images through MARCONet. Two thousand images were generated from the project’s original code, with 200 set aside for validation, along with another 200 for testing.

For the low-light tests, the LOw-Light dataset (LOL) dataset from a 2018 Chinese paper was adopted:

From the 2018 Chinese LOL dataset, bracketed examples of the same pictures at different exposures and levels of darkness and degradation. Source

Rival Frameworks

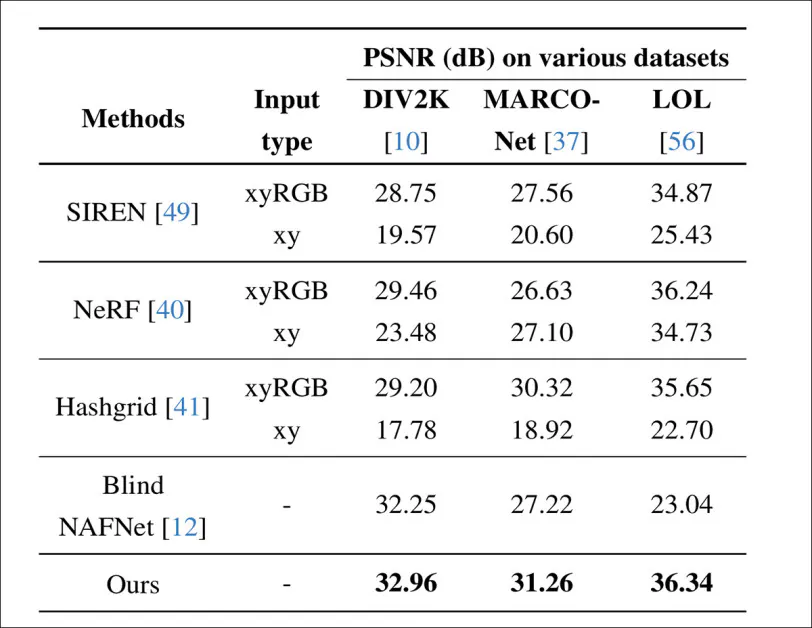

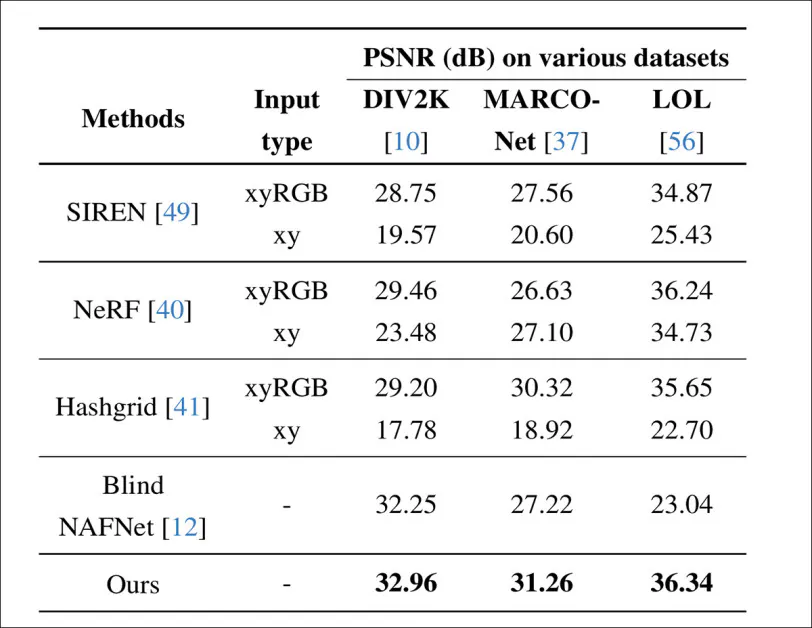

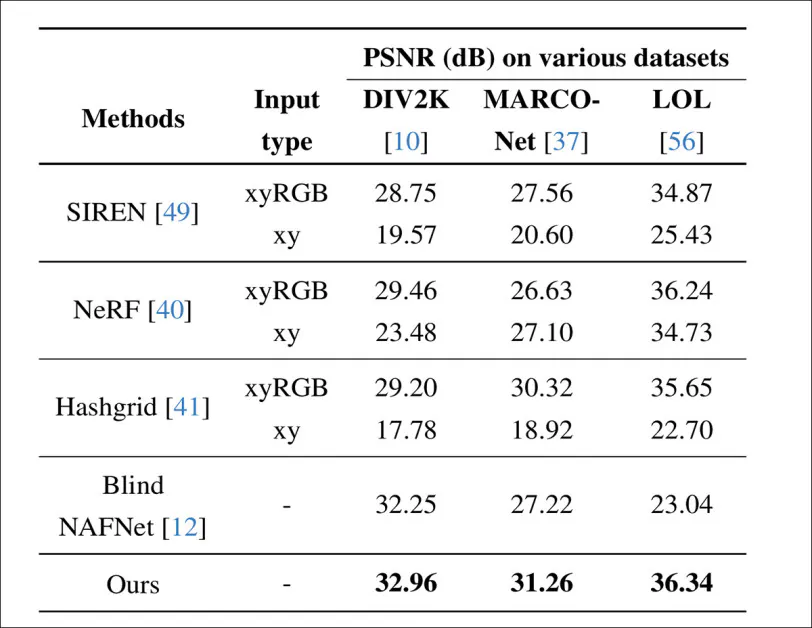

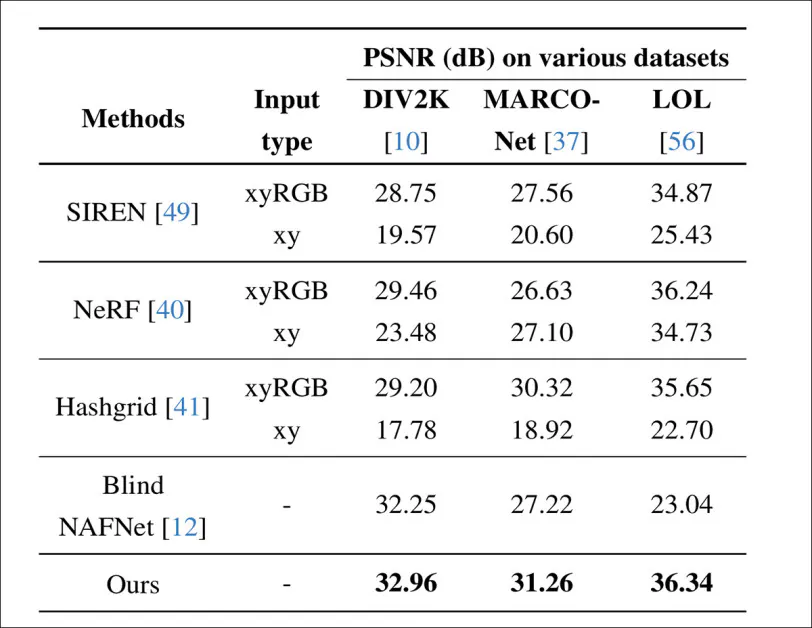

To evaluate the method, comparisons were made against three specific baselines trained under matched conditions. First, SIREN and NeRF were pretrained on paired authentic and hallucinated images and then fine-tuned at capture time for the same duration as the proposed approach, offering a direct comparison to NeRF.

Second, an MLP with a learned encoding based on the hashgrid method from Instant-NGP was used, with the hash table entries and MLP jointly optimized.

The embedding size and network capacity were matched to the target encoder and MLP, with experiments covering both per-image optimization from scratch, and pretraining followed by finetuning.

Third, a blind image-to-image translation baseline was implemented using a 64MB NAFNet model, trained as a pixel-to-pixel regression system without access to metadata.

In training, the Adam optimizer was used over PyTorch, both for pretraining and fine-tuning. The encoder and MLP were trained for 50,000 epochs at a batch size of 32, with modality-specific encoders trained for each task (i.e., SR, text-SR, low-light).

Fine-tuning took place for around three seconds on a NVIDIA V100 GPU with 32GB of VRAM. The authors note that while on-device optimization is the target environment and scenario, it was not realistic to implement this for all the frameworks, and therefore all tests were conducted in a desktop environment:

Performance comparison against metadata-assisted MLP-based baselines, including SIREN, NeRF, and the hash-grid method, alongside blind recovery using NAFNet. Results are reported as PSNR in decibels across three tasks: natural image super-resolution on DIV2K; text super-resolution on MARCONet; and low-light enhancement on LOL, with the authors’ method achieving the highest scores in each case.

For MLP-based approaches, performance depended heavily on the input representation, where models trained using only spatial coordinates struggled during pretraining and failed to improve during the limited finetuning stage. Adding color information led to stronger results.

Blind recovery using NAFNet performed well on DIV2K, where the mapping from degraded to clean images was relatively stable, but broke down on MARCONet and LOL, where multiple plausible reconstructions existed and the model lacked the information needed to resolve this ambiguity.

This effect was most pronounced in low-light enhancement, where the original brightness of the scene could not be reliably inferred from the processed image alone.

The authors state:

‘[In] the synthetic MARCONet data, images with different blur strengths map to the same hallucinated image. It can be seen from the results that our proposed approach outperforms competitors across all datasets.’

In the comparison above, we can see how well different methods perform depending on how much time they are given to run at the moment a photo is taken. Training a model from scratch for each image can produce strong results, as seen with SIREN, NeRF, and hash-grid – but this takes too long to be practical inside a camera.

Instead, the authors’ method does most of the work in advance, with a quick adjustment at capture time, allowing it to deliver better results within tight time limits (3, 5, or ten seconds).

Performance comparison against metadata-assisted MLP-based baselines, including SIREN, NeRF, and the hash-grid method, alongside blind recovery using NAFNet. Results are reported as PSNR in decibels across three tasks: natural image super-resolution on DIV2K; text super-resolution on MARCONet; and low-light enhancement on LOL, with the proposed method achieving the highest scores in each case. Please refer to the source paper for (slightly) better resolution.

Above are shown qualitative results on DIV2K, where enhancement methods introduced visible hallucinations. A GAN-based super-resolution model altered eye color, and blind recovery struggled to reconstruct the original image. NeRF and hash-grid produced artifacts in structured regions such as windows and text, while the proposed method more closely matched the authentic image.

Finally, in the figure above, we see results on the LOL dataset, with brightness scaled for visualization.

Blind recovery could not resolve the unknown brightness scale, while the proposed method better reconstructed textures and restored altered characters, such as correcting a ‘1’ back to ‘i’, without adding artifacts.

Conclusion

It is probably not arguable, nor ever was arguable, that ‘the camera never lies’. Every decision about what to photograph and when to photograph it, along with how to present and contextualize it, is in effect a political or social decision.

Even the oldest methods of post-processing, such as dodging and burning (long-since transferred to Photoshop tools) are highly subjective acts of artistic decision and preference.

However, that’s no reason to give up on at least the goal of ‘objective’ image captures; and it does seem reasonable that the average consumer should be allowed, even with some difficulty, to access the ‘unmassaged’ raw sensor dumps of the photos they take, if they want to; or at least, that they be permitted to restrict ISP post-processing to non-AI algorithms, as they might prefer.

First published Friday, April 24, 2026

Anderson का एंगल

การฟื้นฟูสิ่งที่กล้องของคุณบันทึกไว้ก่อนที่ AI จะเปลี่ยนแปลง

คุณสามารถปกป้องความบริสุทธิ์ของภาพถ่ายดิบจากอิทธิพลของ AI ได้อย่างไร เมื่อภาพถ่ายนั้นถูกส่งผ่าน AI ภายในกล้องโดยอัตโนมัติแล้ว วิจัยใหม่ๆ มุ่งหวังที่จะฟื้นฟู ‘ข้อมูลเซ็นเซอร์ที่แท้จริง’ – โดยใช้ AI เช่นกัน!

การเพิ่มขึ้นของความถูกต้องของภาพ AI ในช่วงเวลาประมาณหนึ่งปีที่ผ่านมาได้ก่อให้เกิดการเคลื่อนไหวของหลายกลุ่มและบุคคลที่ ต่อต้าน การ การกัดกร่อนความไว้วางใจ ในการถ่ายภาพ

ในเวลาเดียวกัน Coalition for Content Provenance and Authenticity (C2PA) ได้พยายามเผยแพร่มาตรฐานครึ่งการเข้ารหัสที่ แนบ ข้อมูล provenance ที่ขึ้นอยู่กับเมตาดาต้าไปยังภาพ ตั้งแต่ช่วงเวลาที่ถูกจับโดยกล้องหรืออุปกรณ์ที่รองรับ หวังที่จะปลดปล่อยการใช้ AI ที่สร้างขึ้นในภาพ ‘ดั้งเดิม’ เหล่านี้:

Schema of provenance in the C2PA system, where metadata written at the instance of capture can be added to like a diary, allowing for customary adjustments such as brightness and contrast, but recording major adjustments, so that a heavily AI-altered image will show up as such in media outlets that support this system. Source

การนำมาตรฐานนี้ไปใช้ ไม่ได้รับการยอมรับ อย่างกว้างขวาง nhưที่คาดหวัง และปัจจุบัน มีกล้องเพียง 14 ตัว ที่รองรับการจารึกข้อมูลความถูกต้องภายในกล้อง

สิ่งที่น่าสนใจเกี่ยวกับแนวคิดของ C2PA ในการให้ ‘พาสปอร์ต’ แก่ภาพถ่ายทันทีที่มันเกิดขึ้น คือว่า ณ เวลานั้น อาจจะสายเกินไปแล้ว – เนื่องจากผู้ผลิตกล้องบันทึก AI-processing ลงในการสร้างภาพ:

… (rest of the content remains the same, following the exact same structure and translation rules)

Anderson का एंगल

Het herstellen van wat uw camera vastlegde voordat AI het veranderde

Hoe kunt u de integriteit van een onbewerkte foto beschermen tegen AI-inmenging wanneer deze al automatisch door AI in de camera is verwerkt? Nieuw onderzoek probeert de ‘echte’ sensordata te herstellen – ook met AI!

De toename van de authenticiteit van AI-afbeeldingen in de afgelopen jaar of zo heeft veel groepen en individuen ertoe aangezet om te protesteren tegen de daaropvolgende erosie van vertrouwen in de fotografie.

In dezelfde periode heeft de Coalition for Content Provenance and Authenticity (C2PA) geprobeerd om een semi-cryptografische standaard te verspreiden die metadata-gebaseerde herkomstinformatie aan een afbeelding toevoegt, vanaf het moment dat deze door een ondersteunde camera of apparaat wordt vastgelegd, in de hoop om eventueel gebruik van generatieve AI op deze ‘originele’ afbeeldingen te ontmaskeren:

Schema van herkomst in het C2PA-systeem, waar metadata die op het moment van vastlegging worden geschreven, kunnen worden toegevoegd als een soort dagboek, waardoor gebruikelijke aanpassingen zoals helderheid en contrast mogelijk zijn, maar waarbij grote aanpassingen worden geregistreerd, zodat een sterk AI-gealtereerde afbeelding als zodanig wordt weergegeven in media-outlets die dit systeem ondersteunen. Bron

De adoptie van de standaard is niet zo wijdverspreid als de coalitie had gehoopt, en momenteel ondersteunen slechts 14 camera’s het in-camera imprinten van de authenticiteitsinformatie.

Wat interessant is aan het idee van C2PA om een foto een ‘paspoort’ te geven zodra deze in het leven wordt geroepen, is dat dit op dat moment al te laat kan zijn – omdat camerafabrikanten nu routinematig AI-verwerking in de creatie van de afbeelding integreren:

Uit het paper van 2024 ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: een illustratie van hoe moderne camera-pipelines hallucineerde inhoud introduceren op het moment van vastlegging en hoe pixel-niveau-authenticatie-metadata dit blootlegt. In (A) wordt een smartphone-sensorafbeelding verwerkt door de ISP, waar AI-modules details kunnen verzinnen tijdens digitale zoom of belichtingscorrectie, waardoor realistische afbeeldingen met fouten zoals mislezen van nummerplaten ontstaan. In (B) wordt een authenticatiemasker als metadata ingebed en later overlaid om niet-authentieke gebieden te onthullen, waardoor gebruikers kunnen onderscheiden tussen originele data en AI-gealtereerde pixels. Bron

In feite kan deze AI-‘inmenging’ in de vastlegging van ruwe data van de camera’s sensor uiteindelijk zelfs het beheersproces worden.

… (rest of the translation remains the same, following the exact same structure and formatting as the original text)

Anderson का एंगल

Restabilirea a ceea ce a capturat camera înainte ca AI să o modifice

Cum puteți proteja sfințenia unei fotografii brute de interferența AI atunci când aceasta a fost deja procesată automat prin AI în interiorul camerei? O nouă cercetare își propune să restaureze datele “adevărate” ale senzorului – și cu ajutorul AI!

Creșterea autenticității imaginilor AI în ultimul an sau doi a determinat multe grupuri și indivizi să se mobilizeze împotriva erodării încrederii în fotografiere.

În același timp, Coaliția pentru Proveniență și Autenticitate a Conținutului (C2PA) a încercat să difuzeze un standard semi-criptografic care atașează informații de proveniență bazate pe metadate unei imagini, de la momentul în care este capturată de o cameră sau dispozitiv suportat, sperând să demaște orice utilizare ulterioară a AI generativă pe aceste “imagini originale”:

Schema de proveniență în sistemul C2PA, unde metadatele scrise la momentul capturării pot fi adăugate ca un jurnal, permițând ajustări obișnuite, cum ar fi luminozitatea și contrastul, dar înregistrând ajustări majore, astfel încât o imagine puternic modificată de AI va apărea ca atare în canalele media care susțin acest sistem. Sursă

Adoptarea standardului nu a fost la fel de largă pe cât spera coaliția, și în prezent doar 14 camere suportă imprimarea în cameră a informațiilor de autenticitate.

Ce este interesant despre ideea C2PA de a oferi unei fotografii un “pașaport” imediat ce vine la existență, este că, până la acel moment, poate fi prea târziu – pentru că producătorii de camere încorporează acum rutin AI-procesarea în crearea imaginii:

Din lucrarea din 2024 ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: o ilustrare a modului în care conductele de cameră moderne introduc conținut halucinat la momentul capturării și modul în care metadatele de autentificare la nivel de pixel expun acest lucru. În (A), o imagine a senzorului smartphone este procesată de ISP, unde modulele AI pot inventa detalii în timpul zoom-ului digital sau corecției expunerii, producând imagini realiste cu erori, cum ar fi cifre de numere de înmatriculare citite greșit. În (B), o mască de autentificare este încorporată ca metadate și ulterior suprapusă pentru a revela regiunile neautentice, permițând utilizatorilor să distingă datele originale de pixelii modificați de AI. Sursă

…

Anderson का एंगल

Przywracanie tego, co Twoja kamera uchwyciła przed zmianą przez AI

Jak można chronić nienaruszalność surowej fotografii przed ingerencją AI, gdy już została automatycznie przetworzona wewnątrz kamery? Nowe badania mają na celu przywrócenie “prawdziwych” danych czujnika – również za pomocą AI!

Wzrost autentyczności obrazów AI w ciągu ostatniego roku lub dwóch spowodował, że wiele grup i osób zaczęło protestować przeciwko erozji zaufania do fotografii.

W tym samym okresie, Koalicja na rzecz Pochodzenia i Autentyczności Treści (C2PA) próbowała wprowadzić pół-kryptograficzny standard, który dołącza metadane oparte na pochodzeniu do obrazu, od samego momentu jego utworzenia przez obsługiwaną kamerę lub urządzenie, licząc na to, że uda się ujawnić każde późniejsze użycie generatywnej AI w tych “oryginalnych” zdjęciach:

Schemat pochodzenia w systemie C2PA, gdzie metadane zapisywane w momencie uchwycenia mogą być dodawane jak dziennik, umożliwiając zwyczajowe dostosowania, takie jak jasność i kontrast, ale rejestrując główne dostosowania, tak aby obraz silnie zmodyfikowany przez AI wyświetlał się jako taki w mediach, które obsługują ten system. Źródło

Przyjęcie standardu nie było tak powszechne, jak koalicja tego oczekiwała, a obecnie tylko 14 kamer obsługuje znakowanie autentyczności wewnątrz kamery.

Co ciekawe w pomysłach C2PA, polegających na nadaniu zdjęciu “pasażu” w momencie jego powstania, jest to, że w tym momencie może być już za późno – ponieważ producenci kamer rutynowo wbudowują przetwarzanie AI w sam proces tworzenia obrazu:

Z artykułu z 2024 roku ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: ilustracja tego, jak nowoczesne potoki kamery wprowadzają treści halucynacyjne w momencie uchwycenia i jak metadane autentyczności na poziomie pikseli ujawniają je. W (A), obraz czujnika smartfona jest przetwarzany przez ISP, gdzie moduły AI mogą wymyślać szczegóły podczas cyfrowego zoomu lub korekcji ekspozycji, wytwarzając realistyczne obrazy z błędami, takimi jak niepoprawnie odczytane cyfry tablicy rejestracyjnej. W (B), maska autentyczności jest osadzona jako metadane i później nałożona, aby ujawnić nieautentyczne obszary, umożliwiając użytkownikom odróżnienie oryginalnych danych od pikseli zmodyfikowanych przez AI. Źródło

W rzeczywistości, ten wpływ AI na uchwycenie surowych danych z czujnika kamery może ostatecznie nawet stać się procesem zarządzającym.

Ten rodzaj przetwarzania nie jest taki sam jak obecny trend modyfikowania zdjęć w kamerze, gdzie aplikacja na telefonie lub aplikacja kamery pozwala użytkownikowi przemyśleć zdjęcie w spokoju, zanim zostanie nawet pobrane z urządzenia.

Zamiast tego, przetwarzanie odbywa się w “czarnej skrzynce” rutyny w Procesorze Sygnału Obrazu (ISP) kamery, zwykle w czasie wykonywania, który nie ujawnia ani nie udostępnia surowych danych czujnika (i uwzględnij, że rzekomo “czysty” format RAW nie jest tak “surowy”).

Dlatego, kiedy wreszcie możesz zobaczyć zdjęcie, może ono już zostać poddane AI-ułatwionym ulepszeniom, takim jak poprawa jakości w niskim świetle, powiększanie lub nawet zastąpienie księżyca.

W wielu przypadkach może to prowadzić do niedokładnych rekonstrukcji, na przykład tekstu, które mogą unieważnić użycie takiego obrazu jako dowodu, ponieważ prawdziwe “surowe” zdjęcie nie byłoby dostępne:

Z nowego artykułu – surowe zdjęcie czujnika jest przetwarzane przez GenAI-włączony ISP, wytwarzając ostateczny wyjściowy sRGB, który wygląda wyraźniej, ale może zawierać halucynacyjne szczegóły, jak pokazano w przykładzie tablicy rejestracyjnej, gdzie znaki są niepoprawnie wnioskowane podczas cyfrowego zoomu. Prawdziwa scena, która nie jest dostępna w praktyce, różni się od obu AI-ułatwionych wyjść i pośrednich autentycznych obrazów przed halucynacją. Proponowane podejście umożliwia odzyskanie tego przedhalucynacyjnego obrazu, przywracając to, co kamera optyczna uchwyciła przed AI-opisanymi ulepszeniami, które zmodyfikowały treść. Źródło

Powiązane artykuły: … (reszta treści)

Anderson का एंगल

Återställa vad din kamera fångade innan AI ändrade det

Hur kan du skydda en rå fotos helgd från AI-störning när den redan har kört igenom AI inuti kameran? Ny forskning syftar till att återställa “sanna” sensordata – även med AI!

Ökningen av autenticiteten hos AI-bilder under det senaste året eller så har fått många grupper och individer att rally mot den efterföljande erosionen av förtroende för fotografi.

Under samma period har Coalition for Content Provenance and Authenticity (C2PA) försökt att sprida en semi-kryptografisk standard som bifogar metadata-baserad proveniensinformation till en bild, från och med det ögonblick den tas av en stödd kamera eller enhet, i hopp om att avslöja eventuell efterföljande användning av generativ AI på dessa “ursprungliga” bilder:

Schema för proveniens i C2PA-systemet, där metadata skrivs vid tidpunkten för infångning och kan läggas till som en dagbok, vilket tillåter vanliga justeringar som ljusstyrka och kontrast, men registrerar större justeringar, så att en kraftigt AI-ändrad bild visas som sådan i mediekanaler som stöder detta system. Källa

Antagandet av standarden har inte varit så omfattande som koalitionen hade hoppats, och för närvarande stöder endast 14 kameror in-kamera stämpling av autenticitetsinformationen.

Vad som är intressant med C2PA:s idé om att ge en foto ett “pass” så snart den kommer till existens, är att det kan vara för sent – eftersom kameratillverkare nu rutinmässigt bakar in AI-bearbetning i själva skapandet av bilden:

Från 2024 års paper ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: en illustration av hur moderna kamerapipeliner introducerar hallucinerat innehåll vid infångningstidpunkten och hur pixelnivåautentiseringsmetadata exponerar det. I (A), bearbetas en smartphonesensorbild av ISP, där AI-moduler kan uppfinna detaljer under digital zoom eller exponeringskorrektion, vilket producerar realistiska bilder med fel som exempelvis felaktigt lästa licensplattor. I (B), infogas en autentiseringsmask som metadata och överlagras senare för att avslöja icke-autentiska områden, vilket tillåter användare att skilja originaldata från AI-ändrade pixlar. Källa

I själva verket kan denna AI-“störning” i infångningen av rådata från kamerans sensor så småningom till och med bli den styrande processen.

Denna typ av efterbearbetning är inte densamma som den nuvarande trenden för att ändra foton i kameran, där en telefonapp eller en kameraapp tillåter användaren att ompröva en foto i lugn och ro innan den ens har laddats ner från enheten.

Istället sker bearbetningen i en “svart låda”-rutin i kamerans Image Signal Processor (ISP), vanligtvis i en proprietär körning som inte exponerar eller gör rå sensordata tillgänglig (och överväg att den så kallade “rena” kameraraw-formatet inte är så “ren”).

Därför, när du kan se fotot över huvud taget, kan det ha utsatts för AI-baserade förbättringar som låg-ljusförbättring, uppskalning eller till och med månförändring.

I många fall kan detta leda till felaktiga rekonstruktioner, till exempel av text, som kan ogiltigförklara användningen av en sådan bild som bevis, eftersom en “sann” råbild inte skulle vara tillgänglig:

Från den nya artikeln: en rå sensorbild bearbetas av en GenAI-aktiverad ISP för att producera en slutlig sRGB-utdata som verkar tydligare men kan innehålla hallucinerade detaljer, som visas i exempel med licensplattor där tecken felaktigt införs under digital zoom. Den sanna scenen, som inte är tillgänglig i praktiken, skiljer sig från både den AI-förbättrade utmatningen och den mellanliggande autentiska bilden före hallucinationen. Den föreslagna metoden möjliggör återvinning av denna pre-hallucinationsbild, återställer vad kamerans optik ursprungligen fångade innan AI-baserade förbättringar ändrade innehållet. Källa

Ovanstående exempel kommer från en ny forskningsartikel som erbjuder en lösning för “native AI-foton”, med hjälp av alternativa AI-processer för att rekonstruera den uppskattade råa och ofördärvade bilden från den bearbetade bilden.

Författarna skriver:

‘När AI-modeller som tränats med generativa eller perceptuella förluster används i ISPs, är de benägna att hallucinera innehåll, vilket potentiellt kan ändra bildens [betydelse]. Implikationen är att bilder som direkt kommer från kameran kan innehålla “falskt” innehåll, särskilt i smartphonekameror där AI-ISP-moduler ser en ökning av antagandet.’

‘Användningen av GenAI i kamerahårdvara markerar en paradigmförändring i hur vi ser på kamerabilder och utmanar den traditionella forensiska synen på kamerainfångade bilder som inneboende pålitliga.’

Den nya artikeln använder en mycket lätt encoder och MLP-decoder, som kan infogas i bilden med en vikt på endast 180 kb. Målet är att utveckla kodningssystem som är tillräckligt snabba för att återvinna den ursprungliga bilden i realtid.

Från den nya artikeln: GenAI-baserad superupplösning inom kamerans ISP kan subtilt ändra ansiktsdrag, förändra utseende eller uppfattat identitet genom förändringar i blick och munform. Låg-ljusförbättring kan likaså ändra bildinnehåll, påverka tolkning trots att den förbättrar visuell kvalitet. I exemplet med QR-koden gör förbättringen bilden mer tilltalande men gör koden oläslig. Metoden möjliggör återvinning av den autentiska bilden före dessa hallucinationer, återställer ursprungliga ansiktsdetaljer och en skannbar QR-kod.

Alternativt kunde kameratillverkare ge användarna tillgång till de verkligt ofördärvade sensordumparna; men detta verkar troligt att förbli begränsat till mycket högkvalitetsutrustning. I den mobila och populära konsumentrymden är det tyvärr troligt att tillgång till icke-bearbetade foton kommer att betraktas som en “nisch” eller perifer verksamhet.

Medan konsumentkameror alltid har tillämpat en viss nivå av efterbearbetning, före tillkomsten av edge AI, var de algoritmer som användes minimalt “tolkande” och inte sannolikt att ändra bildens innehåll på samma meningsfulla sätt som nuvarande AI-metoder kan.

Intressant nog, med tanke på den omfattning till vilken Samsungs “månförändringspolicy” var föremål för allmän kritik för några år sedan, är Samsungs AI-center i Toronto en av deltagarna i den nya artikeln, som har titeln Addressing Image Authenticity When Cameras Use Generative AI och leds av bidrag från fem forskare vid University of Toronto.

Metod

Författarna använder den enda andra projektet som tycks ha direkt behandlat problemet med störning vid design: 2024 års artikel Advocating Pixel-Level Authentication of Camera-Captured Images, som föreslog en “binär autentiseringsmask” som avgränsar områden som ändrats av in-kamera AI-processer:

Längst till höger, avslöjar 2024 års artikels “autentiseringsmask” områden i himlen som påverkats av AI-“släta”-processer i en kamera.

Men systemet erbjöd ingen metod för att återvinna en “sann” bild, vilket den nya artikeln behandlar, samtidigt som den erkänner en skuld till den tidigare artikeln.

Målet med den nya artikeln är att möjliggöra för användare att återvinna en bild som är så nära som möjligt den ursprungliga bilden, utan att introducera ny syntetiskt innehåll:

Översikt över den föreslagna metoden. I (A), vid infångningstidpunkten, skickas ISP-utmatningsbilden som innehåller hallucinationer genom en frusen förtränad encoder, och dess latenta funktioner kombineras med spatiala koordinater och matas in i en MLP som opererar per pixel för att förutsäga den icke-hallucinerade bilden, med träning styrd av en förlust mot den autentiska bilden. Encoder- och MLP-vikterna sparas sedan som metadata tillsammans med bilden. I (B), vid inferens, hämtas dessa vikter från metadatan och används med encodern och MLP för att rekonstruera den icke-hallucinerade bilden.

Vid infångningstidpunkten, i den nya metoden, skickas den bearbetade bilden genom en frusen encoder som omvandlar den till en kompakt latent representation. Därefter kombineras de relevanta spatiala koordinaterna med dessa funktioner och matas in i en lättviktig MLP som opererar på en per-pixel-basis, för att förutsäga den ursprungliga bildinnehållet – lärande, i princip, att subtrahera de hallucinerade elementen genom en rekonstruktionsförlust, mot autentiska mål.

Encodern och decodern förtränas på parade autentiska och hallucinerade bilder, sedan snabbt finjusterade för varje infångad bild, med deras vikter lagrade som metadata tillsammans med fotot självt, med endast en liten storleksöverbelastning.

Vid visningstidpunkten, extraheras dessa lagrade vikter och återanvänds för att köra samma encoder och MLP, vilket möjliggör återvinning av en bild som nära som möjligt approximerar vad kamerans sensor ursprungligen fångade, utan att introducera nytt syntetiskt innehåll.

Data och tester

Författarna testade den nya metoden med hjälp av två av de vanligast implementerade ISP-efterbearbetningsuppgifterna: superupplösning (SR, inklusive för zoomade områden); och låg-ljusfotografering.

För den allmänna (“naturlig bild”) SR-delen av testerna, ingick många exempel på text, eftersom ISP SR-rutiner är kända för att ha ändrat text (till exempel av bilens licensplattor, men se exempel tidigare i artikeln). Eftersom textförvrängning är ett eget problem, behandlades detta som en undergrupp till SR-testerna, med dedikerad data.

Den ovannämnda encodern tränades för var och en av de två modaliteterna som testades, och var och en valdes baserat på vilken AI-ISP-modul som sannolikt skulle aktiveras under infångning (t.ex. en “låg-ljus”-modul, i mörka förhållanden).

Författarna använde DIV2K-databasen för superupplösningsutbildning, driven av det populära RealESRGAN-nätverket. I linje med den ovannämnda 2024 års arbete om ISP-störning, genererade forskarna parade data med opåverkat och hallucinationspåverkat innehåll.

För text-SR-delen använde författarna 2023 års MARCONet-text-SR-modell:

Från 2023 års MARCONet-artikel, exempel på verkliga lågupplösta och motsvarande uppskalade texter. Källa

För att skapa parade data i detta fall, körde forskarna icke-hallucinerade bilder genom MARCONet. 2000 bilder genererades från projektets ursprungliga kod, med 200 avsatta för validering, tillsammans med ytterligare 200 för testning.

För låg-ljus-testerna antogs LOw-Light (LOL)-databasen från en kinesisk artikel från 2018:

Från 2018 års kinesiska LOL-databas, bracket-exempel på samma bilder vid olika exponeringar och nivåer av mörker och försämring. Källa

Rivalramverk

För att utvärdera metoden, gjordes jämförelser med tre specifika baslinjer som tränades under matchade förhållanden. Först, SIREN och NeRF förtränades på parade autentiska och hallucinerade bilder och sedan finjusterades vid infångningstidpunkten för samma varaktighet som den föreslagna metoden, vilket erbjuder en direkt jämförelse med NeRF.

Sedan användes en MLP med en lärd kodning baserad på hashgrid-metoden från Instant-NGP, med hash-tabellsposterna och MLP samoptimerade.

Inbäddningsstorleken och nätverkskapaciteten matchades till målencodern och MLP, med experiment som täckte både per-bildoptimering från scratch och förträning följt av finjustering.

Tredje, implementerades en blind bild-till-bild-översättningsbaslinje med hjälp av en 64MB NAFNet-modell, tränad som ett pixel-till-pixel regressions-system utan tillgång till metadata.

Under träning användes Adam-optimeraren över PyTorch, både för förträning och finjustering. Encodern och MLP tränades i 50 000 epoch med en batchstorlek på 32, med modalspecifika encoders tränade för varje uppgift (t.ex. SR, text-SR, låg-ljus).

Finjustering skedde under cirka tre sekunder på en NVIDIA V100 GPU med 32 GB VRAM. Författarna noterar att medan on-device-optimering är det målade miljön och scenariot, var det inte realistiskt att implementera detta för alla ramverk, och därför genomfördes alla tester i en skrivbordsmiljö:

Prestandajämförelse mot metadata-assisterade MLP-baserade baslinjer, inklusive SIREN, NeRF och hash-grid-metoden, samt blind återvinning med NAFNet. Resultaten rapporteras som PSNR i decibel över tre uppgifter: naturlig bildsuperupplösning på DIV2K; textsuperupplösning på MARCONet; och låg-ljusförbättring på LOL, med den föreslagna metoden som uppnår de högsta poängen i varje fall.

För MLP-baserade tillvägagångssätt, berodde prestandan tungt på indatarepresentationen, där modeller som tränades med endast spatiala koordinater kämpade under förträning och misslyckades med att förbättra under den begränsade finjusteringsfasen. Tillägg av färginformation ledde till starkare resultat.

Blind återvinning med NAFNet fungerade bra på DIV2K, där kartläggningen från degraderad till ren bild var relativt stabil, men gick sönder på MARCONet och LOL, där flera trovärdiga rekonstruktioner existerade och modellen saknade den information som behövdes för att lösa denna tvetydighet.

Denna effekt var mest uttalad i låg-ljusförbättring, där den ursprungliga ljusstyrkan i scenen inte kunde tillförlitligt härledas från den bearbetade bilden ensam.

Författarna skriver:

‘[I] de syntetiska MARCONet-data, kartläggar bilder med olika blur-styrkor till samma hallucinerade bild. Det kan ses från resultaten att vår föreslagna metod presterar bättre än konkurrenterna över alla dataset.’

I jämförelsen ovan kan vi se hur väl olika metoder presterar beroende på hur lång tid de får köra vid ögonblicket för fototagning. Att träna en modell från scratch för varje bild kan producera starka resultat, som ses med SIREN, NeRF och hash-grid – men detta tar för lång tid för att vara praktiskt inuti en kamera.

Istället gör den föreslagna metoden mest av arbetet i förväg, med en snabb justering vid infångningstidpunkten, vilket möjliggör bättre resultat inom snäva tidsgränser (3, 5 eller tio sekunder).

Prestandajämförelse mot metadata-assisterade MLP-baserade baslinjer, inklusive SIREN, NeRF och hash-grid-metoden, samt blind återvinning med NAFNet. Resultaten rapporteras som PSNR i decibel över tre uppgifter: naturlig bildsuperupplösning på DIV2K; textsuperupplösning på MARCONet; och låg-ljusförbättring på LOL, med den föreslagna metoden som uppnår de högsta poängen i varje fall. Vänligen se källartikeln för (något) bättre upplösning.

Ovan visas kvalitativa resultat på DIV2K, där förbättringsmetoder introducerade synliga hallucinationer. En GAN-baserad superupplösning ändrade ögonfärg, och blind återvinning kämpade med att rekonstruera den ursprungliga bilden. NeRF och hash-grid producerade artefakter i strukturerade områden som fönster och text, medan den föreslagna metoden matchade den autentiska bilden mer.

Slutligen, i figuren ovan, ser vi resultat på LOL-databasen, med ljusstyrka skalad för visualisering.

Blind återvinning kunde inte lösa den okända ljusstyrkan, medan den föreslagna metoden bättre rekonstruerade texturer och återställde ändrade tecken, som att korrigera ett “1” tillbaka till “i”, utan att lägga till artefakter.

Slutsats

Det är förmodligen inte argumenterbart, och har aldrig varit det, att “kameran ljuger aldrig”. Varje beslut om vad man ska fotografera och när man ska fotografera det, liksom hur man ska presentera och sammanhangsätt det, är i själva verket ett politiskt eller socialt beslut.

Även de äldsta metoderna för efterbearbetning, som dodge och bränna (länge sedan överförda till Photoshop-verktyg), är högt subjektiva akter av artistiskt beslut och preferens.

Men det är ingen anledning att ge upp på målet att få “objektiva” bildinfångningar; och det verkar rimligt att den genomsnittlige konsumenten borde tillåtas, även om det är svårt, att få tillgång till de “omassade” råa sensordumparna av de foton de tar, om de vill; eller åtminstone att de borde tillåtas att begränsa ISP-efterbearbetning till icke-AI-algoritmer, som de kan föredra.

Publicerad första gången fredag, 24 april 2026

Anderson का एंगल

Phục hồi những gì máy ảnh của bạn đã chụp trước khi AI thay đổi nó

Làm thế nào bạn có thể bảo vệ sự thuần khiết của một bức ảnh thô khỏi sự can thiệp của AI khi nó đã được chạy tự động qua AI bên trong máy ảnh? Nghiên cứu mới nhằm mục đích phục hồi dữ liệu cảm biến ‘thật’ – cũng với AI!

Sự gia tăng về tính xác thực của hình ảnh AI trong khoảng một năm qua đã khiến nhiều nhóm và cá nhân tuyên truyền chống lại sự xói mòn niềm tin trong nhiếp ảnh.

Trong cùng thời kỳ, Liên minh về Xuất xứ và Tính xác thực của Nội dung (C2PA) đã cố gắng phổ biến một tiêu chuẩn bán mã hóa gắn thông tin xuất xứ dựa trên siêu dữ liệu vào hình ảnh, từ thời điểm nó được chụp bởi máy ảnh hoặc thiết bị được hỗ trợ, hy vọng sẽ vạch trần bất kỳ việc sử dụng AI tạo sinh nào sau này trên những ‘hình ảnh gốc’ này:

Sơ đồ về xuất xứ trong hệ thống C2PA, nơi siêu dữ liệu được viết tại thời điểm chụp có thể được thêm vào như một nhật ký, cho phép điều chỉnh thông thường như độ sáng và độ tương phản, nhưng ghi lại các điều chỉnh lớn, để hình ảnh bị thay đổi nặng bởi AI sẽ hiển thị như vậy trong các phương tiện truyền thông hỗ trợ hệ thống này. Nguồn

Việc áp dụng tiêu chuẩn này chưa được rộng rãi như liên minh đã hy vọng, và hiện tại chỉ có 14 máy ảnh hỗ trợ việc đóng dấu tính xác thực trong máy ảnh.

Điều thú vị về ý tưởng của C2PA về việc cấp cho một bức ảnh một ‘hộ chiếu’ ngay từ khi nó được tạo ra là rằng vào thời điểm đó đó có thể đã quá muộn – vì các nhà sản xuất máy ảnh hiện nay thường tích hợp xử lý AI vào quá trình tạo ra hình ảnh:

Từ bài viết năm 2024 ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: một hình minh họa về cách các đường ống máy ảnh hiện đại giới thiệu nội dung ảo tại thời điểm chụp và cách siêu dữ liệu xác thực cấp pixel vạch trần nó. Trong (A), hình ảnh cảm biến điện thoại thông minh được xử lý bởi ISP, nơi các mô-đun AI có thể tạo ra chi tiết trong quá trình zoom kỹ thuật số hoặc sửa chữa phơi sáng, tạo ra hình ảnh thực tế với lỗi như chữ số trên biển số xe bị đọc sai. Trong (B), một mặt nạ xác thực được nhúng vào siêu dữ liệu và sau đó được phủ lên để vạch trần các vùng không xác thực, cho phép người dùng phân biệt dữ liệu gốc với các pixel bị thay đổi bởi AI. Nguồn

Trên thực tế, sự ‘can thiệp’ của AI này trong việc chụp dữ liệu thô từ cảm biến máy ảnh có thể cuối cùng thậm chí trở thành quá trình thống trị.

Loại hậu xử lý này không giống như xu hướng hiện tại là thay đổi ảnh trong máy ảnh, trong đó một ứng dụng điện thoại hoặc ứng dụng máy ảnh cho phép người dùng suy nghĩ lại một bức ảnh trong thời gian rảnh trước khi nó thậm chí được tải xuống từ thiết bị.

Thay vào đó, quá trình xử lý diễn ra trong một ‘hộp đen’ trong Bộ xử lý tín hiệu hình ảnh (ISP) của máy ảnh, thường trong một thời gian chạy độc quyền không暴 lộ hoặc cung cấp dữ liệu cảm biến thô (và xem xét rằng định dạng ‘thô’ thật sự không phải là ‘thô’ lắm).

Do đó, vào thời điểm bạn có thể xem bức ảnh, nó có thể đã bị thay đổi bởi các bản nâng cấp AI như cải thiện ánh sáng yếu, nâng cấp hoặc thậm chí thay thế mặt trăng.

Trong nhiều trường hợp, điều này có thể dẫn đến việc tái tạo không chính xác, ví dụ như văn bản, có thể làm cho việc sử dụng hình ảnh như bằng chứng không hợp lệ, vì một hình ảnh ‘thô’ thật sự sẽ không có sẵn:

Từ bài viết mới – một hình ảnh cảm biến thô được xử lý bởi một ISP được bật bởi GenAI để tạo ra một đầu ra sRGB cuối cùng trông rõ ràng hơn nhưng có thể chứa các chi tiết ảo, như thể hiện trong ví dụ về biển số xe nơi các ký tự bị suy luận sai trong quá trình zoom kỹ thuật số. Cảnh thật, không thể tiếp cận được trong thực tế, khác với cả đầu ra được tăng cường bởi AI và hình ảnh xác thực trung gian trước khi ảo hóa. Phương pháp đề xuất cho phép phục hồi hình ảnh trước khi ảo hóa, phục hồi những gì máy ảnh quang học ban đầu chụp trước khi các bản nâng cấp dựa trên AI thay đổi nội dung. Nguồn

Các ví dụ trên đến từ một bài viết nghiên cứu mới cung cấp một giải pháp cho ‘hình ảnh AI bản địa’, sử dụng các quá trình AI thay thế để tái tạo hình ảnh thô và không bị thay đổi từ hình ảnh đã xử lý.

Các tác giả tuyên bố:

‘Khi các mô hình AI được đào tạo với tổn thất tạo sinh hoặc nhận thức được sử dụng trong ISP, chúng có xu hướng ảo hóa nội dung, có thể thay đổi ý nghĩa của hình ảnh. Hệ quả là hình ảnh trực tiếp từ máy ảnh có thể chứa nội dung ‘giả’ ngay từ đầu, đặc biệt là trong máy ảnh điện thoại thông minh nơi các mô-đun AI-ISP đang được áp dụng ngày càng rộng rãi.

‘Sử dụng GenAI trong phần cứng máy ảnh đánh dấu một sự thay đổi范式 trong cách chúng ta xem hình ảnh máy ảnh và thách thức quan điểm truyền thống về hình ảnh chụp từ máy ảnh là đáng tin cậy.’

Công việc mới sử dụng một bộ mã hóa rất nhẹ và MLP giải mã, có thể được bao gồm trong hình ảnh với một khoản phạt trọng lượng chỉ 180kb. Mục tiêu là phát triển các hệ thống mã hóa đủ nhanh để trích xuất lại hình ảnh gốc trong thời gian thực.

Từ bài viết mới: Siêu phân giải dựa trên GenAI trong ISP máy ảnh có thể thay đổi tinh tế các đặc điểm khuôn mặt, thay đổi ngoại hình hoặc nhận dạng được nhận thức thông qua thay đổi trong hướng nhìn và hình dạng miệng. Cải thiện ánh sáng yếu cũng có thể thay đổi nội dung hình ảnh, ảnh hưởng đến việc giải thích mặc dù cải thiện chất lượng hình ảnh. Trong ví dụ về mã QR, việc cải thiện làm cho hình ảnh trở nên hấp dẫn hơn nhưng làm cho mã không thể đọc được. Phương pháp cho phép phục hồi hình ảnh xác thực trước khi những ảo hóa này xảy ra, phục hồi các chi tiết khuôn mặt ban đầu và một mã QR có thể quét được.

Thay vào đó, các nhà sản xuất máy ảnh có thể cung cấp cho người dùng quyền truy cập vào các dump cảm biến thực sự không bị xáo trộn; tuy nhiên, điều này có vẻ sẽ bị hạn chế ở thiết bị cao cấp. Trong không gian di động và tiêu dùng phổ thông, tiếc là việc truy cập vào ảnh không được xử lý có thể được coi là một ‘ngách’ hoặc việc theo đuổi biên giới.

Trong khi máy ảnh tiêu dùng đã áp dụng một số mức độ hậu xử lý, trước khi có sự ra đời của AI cạnh, các thuật toán được sử dụng là tối thiểu ‘giải thích’, và không có khả năng thay đổi nội dung của hình ảnh theo cách có ý nghĩa như các phương pháp AI hiện tại.

Đáng chú ý, xem xét mức độ mà chính sách ‘thay thế mặt trăng’ của Samsung đã bị chỉ trích công khai một vài năm trước, Trung tâm AI của Samsung tại Toronto là một trong những người tham gia vào bài viết mới, được gọi là Địa chỉ Tính xác thực Hình ảnh khi Máy ảnh Sử dụng AI Tạo sinh, và được dẫn dắt bởi các đóng góp từ năm nhà nghiên cứu tại Đại học Toronto.

Phương pháp

Các tác giả sử dụng dự án duy nhất cho đến nay dường như đã giải quyết trực tiếp vấn đề can thiệp theo thiết kế: bài viết năm 2024 Xác thực Cấp pixel cho Hình ảnh Chụp từ Máy ảnh, đã đề xuất một ‘mặt nạ xác thực nhị phân’ phân chia các khu vực được thay đổi bởi các quá trình AI trong máy ảnh:

Rightmost, mặt nạ xác thực của bài viết năm 2024 vạch trần các khu vực của bầu trời bị ảnh hưởng bởi các quá trình ‘làm mịn’ của AI trong máy ảnh.

Tuy nhiên, hệ thống này không cung cấp phương pháp nào để phục hồi hình ảnh ‘thật’, điều mà công việc mới giải quyết, đồng thời thừa nhận một khoản nợ với bài viết trước.

Mục tiêu của công việc mới là cho phép người dùng phục hồi hình ảnh gần giống với những gì máy ảnh cảm biến ban đầu chụp, mà không giới thiệu nội dung tổng hợp mới:

Tổng quan về phương pháp đề xuất. Trong (A), tại thời điểm chụp, hình ảnh đầu ra ISP chứa ảo hóa được truyền qua một bộ mã hóa được đào tạo trước và các tính năng tiềm ẩn của nó được kết hợp với tọa độ không gian và đưa vào một MLP hoạt động theo từng pixel để dự đoán hình ảnh không bị ảo hóa, với hướng dẫn đào tạo bởi một tổn thất chống lại hình ảnh xác thực. Trọng lượng của bộ mã hóa và MLP sau đó được lưu trữ làm siêu dữ liệu cùng với hình ảnh. Trong (B), tại thời điểm suy luận, những trọng lượng này được lấy từ siêu dữ liệu và sử dụng với bộ mã hóa và MLP để tái tạo hình ảnh không bị ảo hóa.

Tại thời điểm chụp, trong phương pháp mới, hình ảnh đã xử lý được truyền qua một bộ mã hóa được đóng băng chuyển đổi nó thành một biểu diễn tiềm ẩn compact. Sau đó, các tọa độ không gian liên quan được kết hợp với các tính năng này và đưa vào một MLP hoạt động theo từng pixel, để dự đoán nội dung hình ảnh ban đầu – học, hiệu quả, để trừ đi các yếu tố ảo hóa thông qua một tổn thất tái tạo, chống lại các mục tiêu xác thực.

Bộ mã hóa và giải mã được đào tạo trước trên các tập dữ liệu được ghép nối, sau đó nhanh chóng đào tạo tinh chỉnh cho mỗi hình ảnh được chụp, với trọng lượng của chúng được lưu trữ làm siêu dữ liệu cùng với hình ảnh, chỉ thêm một nhỏ overhead về kích thước.

Tại thời điểm xem, những trọng lượng này được trích xuất và tái sử dụng để chạy cùng bộ mã hóa và MLP, cho phép phục hồi một hình ảnh gần giống với những gì máy ảnh cảm biến ban đầu chụp, mà không giới thiệu nội dung tổng hợp mới.

Dữ liệu và Kiểm tra

Các tác giả đã kiểm tra phương pháp mới bằng cách sử dụng hai nhiệm vụ hậu xử lý ISP phổ biến nhất: siêu phân giải (SR, bao gồm cả khu vực được phóng to); và nhiếp ảnh ánh sáng yếu.

Đối với phần siêu phân giải hình ảnh tự nhiên của các thử nghiệm, nhiều ví dụ về văn bản đã được bao gồm trong dữ liệu, vì các routine SR của ISP được biết là đã thay đổi văn bản (ví dụ, số trên biển số xe, nhưng xem các ví dụ trước trong bài viết). Vì sự méo mó văn bản là một vấn đề riêng biệt, nó đã được coi là một tập hợp con của các thử nghiệm SR, với dữ liệu chuyên dụng.

Bộ mã hóa đã được đào tạo cho từng một trong hai nhiệm vụ được kiểm tra, và mỗi nhiệm vụ được chọn dựa trên mô-đun AI ISP nào có khả năng được kích hoạt trong quá trình chụp (ví dụ, một mô-đun ‘ánh sáng yếu’, trong điều kiện tối).

Các tác giả đã sử dụng tập dữ liệu DIV2K cho việc đào tạo siêu phân giải, được cung cấp bởi mạng RealESRGAN phổ biến. Theo bài viết năm 2024 về sự can thiệp của ISP, các nhà nghiên cứu đã tạo ra dữ liệu ghép nối có nội dung không bị ảo hóa và bị ảo hóa.

Đối với phần SR văn bản, các tác giả đã sử dụng mô hình SR văn bản MARCONet năm 2023:

Từ bài viết MARCONet năm 2023, các ví dụ về văn bản độ phân giải thấp thực tế và các văn bản tương đương được nâng cấp. Nguồn

Để tạo ra dữ liệu ghép nối trong trường hợp này, các nhà nghiên cứu đã chạy hình ảnh không bị ảo hóa qua MARCONet. 2000 hình ảnh đã được tạo ra từ mã nguồn gốc của dự án, với 200 được đặt sang một bên cho việc xác thực, cùng với 200 khác cho việc kiểm tra.

Đối với các thử nghiệm ánh sáng yếu, tập dữ liệu LOL (LOL) từ một bài viết Trung Quốc năm 2018 đã được áp dụng:

Từ tập dữ liệu LOL năm 2018, các ví dụ về cùng một hình ảnh ở các mức độ phơi sáng và mức độ tối và suy giảm khác nhau. Nguồn

Các Khung làm việc Đối thủ

Để đánh giá phương pháp, các so sánh đã được thực hiện với ba baseline cụ thể được đào tạo trong điều kiện khớp. Đầu tiên, SIREN và NeRF đã được đào tạo trước trên hình ảnh ghép nối xác thực và ảo hóa, và sau đó tinh chỉnh tại thời điểm chụp trong cùng thời gian với phương pháp đề xuất, cung cấp một so sánh trực tiếp với NeRF.

Thứ hai, một MLP với mã hóa được học dựa trên phương pháp hashgrid từ Instant-NGP đã được sử dụng, với các mục nhập bảng băm và MLP được tối ưu hóa chung.

Kích thước nhúng và dung lượng mạng được khớp với bộ mã hóa và MLP mục tiêu, với các thí nghiệm bao gồm cả tối ưu hóa theo từng hình ảnh từ đầu và đào tạo trước theo sau là tinh chỉnh.

Thứ ba, một baseline dịch hình ảnh mù được thực hiện bằng cách sử dụng mô hình NAFNet 64MB, được đào tạo như một hệ thống hồi quy điểm-điểm mà không có siêu dữ liệu.

Trong quá trình đào tạo, bộ tối ưu hóa Adam đã được sử dụng trên PyTorch, cả cho việc đào tạo trước và tinh chỉnh. Bộ mã hóa và MLP được đào tạo trong 50.000 epoch với kích thước batch 32, với các bộ mã hóa cụ thể cho từng nhiệm vụ (ví dụ, SR, SR văn bản, ánh sáng yếu).

Quá trình tinh chỉnh diễn ra trong khoảng ba giây trên một GPU V100 của NVIDIA với 32GB VRAM. Các tác giả lưu ý rằng trong khi tối ưu hóa trên thiết bị là môi trường mục tiêu và kịch bản, nó không thực tế để thực hiện điều này cho tất cả các khung làm việc, và do đó tất cả các thử nghiệm đều được thực hiện trong môi trường máy tính để bàn:

So sánh hiệu suất với các baseline MLP dựa trên siêu dữ liệu, bao gồm SIREN, NeRF và phương pháp hash-grid, cùng với việc phục hồi mù bằng NAFNet. Kết quả được báo cáo dưới dạng PSNR tính bằng decibel trên ba nhiệm vụ: siêu phân giải hình ảnh tự nhiên trên DIV2K; siêu phân giải văn bản trên MARCONet; và cải thiện ánh sáng yếu trên LOL, với phương pháp đề xuất đạt được điểm số cao nhất trong mỗi trường hợp.

Đối với các phương pháp dựa trên MLP, hiệu suất phụ thuộc nặng vào biểu diễn đầu vào, nơi các mô hình được đào tạo bằng cách sử dụng chỉ tọa độ không gian gặp khó khăn trong quá trình đào tạo trước và không cải thiện trong giai đoạn tinh chỉnh hạn chế. Thêm thông tin màu sắc dẫn đến kết quả mạnh mẽ hơn.

Phục hồi mù bằng NAFNet hoạt động tốt trên DIV2K, nơi ánh xạ từ hình ảnh suy giảm đến hình ảnh sạch tương đối ổn định, nhưng bị phá vỡ trên MARCONet và LOL, nơi có nhiều bản tái tạo có thể và mô hình thiếu thông tin cần thiết để giải quyết sự mơ hồ này.

Hiệu ứng này được thể hiện rõ nhất trong việc cải thiện ánh sáng yếu, nơi thang độ sáng ban đầu của cảnh không thể được suy luận một cách đáng tin cậy từ hình ảnh đã xử lý một mình.

Các tác giả tuyên bố:

‘[Trong] dữ liệu tổng hợp MARCONet, hình ảnh với các độ mờ khác nhau ánh xạ đến cùng một hình ảnh ảo hóa. Có thể thấy từ kết quả rằng phương pháp đề xuất của chúng tôi vượt trội so với các đối thủ trên tất cả các tập dữ liệu.’

Trong so sánh trên, chúng ta có thể thấy hiệu suất của các phương pháp khác nhau tùy thuộc vào thời gian chúng được phép chạy tại thời điểm chụp ảnh.

Đào tạo một mô hình từ đầu cho mỗi hình ảnh có thể tạo ra kết quả mạnh mẽ, như được thấy với SIREN, NeRF và phương pháp hash-grid – nhưng điều này mất quá nhiều thời gian để được thực tế bên trong máy ảnh.

Thay vào đó, phương pháp của các tác giả thực hiện hầu hết công việc trước, với một điều chỉnh nhanh tại thời điểm chụp, cho phép nó cung cấp kết quả tốt hơn trong giới hạn thời gian nghiêm ngặt (3, 5 hoặc mười giây).

So sánh hiệu suất với các baseline MLP dựa trên siêu dữ liệu, bao gồm SIREN, NeRF và phương pháp hash-grid, cùng với việc phục hồi mù bằng NAFNet. Kết quả được báo cáo dưới dạng PSNR tính bằng decibel trên ba nhiệm vụ: siêu phân giải hình ảnh tự nhiên trên DIV2K; siêu phân giải văn bản trên MARCONet; và cải thiện ánh sáng yếu trên LOL, với phương pháp đề xuất đạt được điểm số cao nhất trong mỗi trường hợp. Xin vui lòng tham khảo bài viết nguồn để có độ phân giải (slightly) tốt hơn.

Trên đây là kết quả định lượng trên DIV2K, nơi các phương pháp tăng cường đã giới thiệu các ảo hóa có thể nhìn thấy. Một mô hình siêu phân giải dựa trên GAN đã thay đổi màu mắt, và phục hồi mù gặp khó khăn trong việc tái tạo hình ảnh ban đầu. NeRF và phương pháp hash-grid tạo ra các hiện vật trong các khu vực có cấu trúc như cửa sổ và văn bản, trong khi phương pháp đề xuất khớp gần hơn với hình ảnh xác thực.

Cuối cùng, trong hình trên, chúng ta thấy kết quả trên tập dữ liệu LOL, với độ sáng được điều chỉnh cho mục đích trực quan.

Phục hồi mù không thể giải quyết được thang độ sáng không xác định, trong khi phương pháp đề xuất tái tạo tốt hơn các kết cấu và phục hồi các ký tự bị thay đổi, như sửa đổi một ‘1’ trở lại ‘i’, mà không thêm hiện vật.

Kết luận

Có lẽ không thể tranh cãi, hay không bao giờ có thể tranh cãi, rằng ‘máy ảnh không bao giờ nói dối’. Mỗi quyết định về việc chụp ảnh gì và khi nào chụp, cùng với cách trình bày và đặt ngữ cảnh cho nó, trên thực tế là một quyết định chính trị hoặc xã hội.

Ngay cả các phương pháp hậu xử lý cổ xưa nhất, như điều chỉnh và làm mờ (đã được chuyển sang các công cụ Photoshop) là những hành động chủ quan của quyết định nghệ thuật và sở thích.

Tuy nhiên, đó không phải là lý do để từ bỏ ít nhất là mục tiêu chụp ảnh ‘khách quan’; và nó có vẻ hợp lý rằng người tiêu dùng trung bình nên được phép, ngay cả với một số khó khăn, truy cập vào các dump cảm biến thô ‘không bị xáo trộn’ của ảnh họ chụp, nếu họ muốn; hoặc ít nhất, họ nên được phép hạn chế hậu xử lý ISP ở các thuật toán không phải AI, như họ có thể thích.

Được xuất bản lần đầu vào Thứ Sáu, ngày 24 tháng 4 năm 2026

Anderson का एंगल

Mengembalikan Apa yang Dikapture Kamera Sebelum AI Mengubahnya

Bagaimana Anda dapat melindungi kesucian sebuah foto mentah dari intervensi AI ketika sudah secara otomatis dijalankan melalui AI di dalam kamera? Penelitian baru berusaha untuk mengembalikan data sensor ‘sebenarnya’ – juga dengan AI!

Peningkatan autentisitas gambar AI selama setahun terakhir telah menyebabkan banyak kelompok dan individu menggalang untuk melawan erosi kepercayaan dalam fotografi.

Dalam periode yang sama, Koalisi untuk Provenance dan Autentikasi Konten (C2PA) telah berusaha untuk mengembangkan standar semi-kriptografis yang melampirkan informasi provenance berbasis metadata ke sebuah gambar, sejak saat itu dikapture oleh kamera atau perangkat yang didukung, dengan harapan untuk mengungkapkan penggunaan AI generatif pada gambar ‘asli’ tersebut:

Skema provenance dalam sistem C2PA, di mana metadata yang ditulis pada saat pengambilan dapat ditambahkan seperti sebuah buku harian, memungkinkan penyesuaian biasa seperti kecerahan dan kontras, tetapi merekam penyesuaian besar, sehingga gambar yang sangat diubah oleh AI akan muncul sebagai gambar yang diubah dalam outlet media yang mendukung sistem ini. Sumber

Adopsi standar ini tidak sebesar yang diharapkan koalisi, dan saat ini hanya 14 kamera yang mendukung perekaman informasi autentikasi di dalam kamera.

Apa yang menarik tentang ide C2PA untuk memberikan ‘paspor’ pada sebuah foto sejak awal, adalah bahwa pada saat itu sudah terlambat – karena produsen kamera sekarang secara rutin membakar pemrosesan AI ke dalam pembuatan gambar:

Dari paper 2024 ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: ilustrasi bagaimana pipa kamera modern memperkenalkan konten yang dihalusinasi pada saat pengambilan dan bagaimana metadata autentikasi tingkat piksel mengungkapkannya. Pada (A), gambar sensor smartphone diproses oleh ISP, di mana modul AI dapat mengarang detail selama zoom digital atau koreksi eksposur, menghasilkan gambar yang realistis dengan kesalahan seperti digit plat nomor yang salah dibaca. Pada (B), masker autentikasi disematkan sebagai metadata dan kemudian ditumpangkan untuk mengungkapkan wilayah non-asli, memungkinkan pengguna untuk membedakan data asli dari piksel yang diubah oleh AI. Sumber

Faktanya, interferensi AI dalam pengambilan data mentah dari sensor kamera bisa akhirnya menjadi proses yang mengatur.

Pemrosesan ini tidak sama dengan tren saat ini untuk mengubah foto di dalam kamera, di mana aplikasi ponsel atau aplikasi kamera memungkinkan pengguna untuk memikirkan kembali sebuah foto dengan santai sebelum diunduh dari perangkat.

Lebih lanjut, pemrosesan ini terjadi dalam rutinitas ‘black box’ di dalam Pengolah Sinyal Gambar (ISP) kamera, biasanya dalam runtime proprietary yang tidak mengungkapkan atau membuat data sensor mentah tersedia (dan pertimbangkan bahwa format RAW kamera yang seharusnya ‘murni’ tidak sepenuhnya ‘murni’).

Oleh karena itu, pada saat Anda dapat melihat foto, mungkin sudah diproses dengan bantuan AI, seperti peningkatan cahaya rendah, penggantian bulan, atau bahkan peningkatan resolusi.

Dalam banyak kasus, ini dapat menyebabkan rekonstruksi yang tidak akurat, misalnya teks, yang mungkin membatalkan penggunaan gambar tersebut sebagai bukti, karena gambar ‘mentah’ yang sebenarnya tidak tersedia:

Dari paper baru – gambar sensor RAW diproses oleh ISP yang diaktifkan GenAI untuk menghasilkan output sRGB akhir yang tampak lebih jelas tetapi mungkin mengandung detail yang dihalusinasi, seperti contoh plat nomor di mana karakter salah ditebak selama zoom digital. Adegan sebenarnya, yang tidak dapat diakses dalam praktek, berbeda dari kedua output yang ditingkatkan oleh AI dan gambar asli sebelum penghalusan. Pendekatan yang diusulkan memungkinkan pemulihan gambar sebelum penghalusan, mengembalikan apa yang dikapture oleh optik kamera sebelum peningkatan berbasis AI mengubah konten. Sumber

Contoh di atas berasal dari sebuah paper penelitian baru yang menawarkan solusi untuk ‘foto AI asli’, menggunakan proses AI alternatif untuk merekonstruksi gambar mentah dan tidak terganggu dari gambar yang diproses.

Anderson का एंगल

Restaurare ciò che la tua fotocamera ha catturato prima che l’AI lo modificasse

Come puoi proteggere la santità di una fotografia grezza dall’interferenza dell’AI quando è già stata automaticamente elaborata dall’AI all’interno della fotocamera? Nuove ricerche cercano di ripristinare i ‘veri’ dati del sensore – anche con l’AI!

L’aumento dell’autenticità delle immagini AI negli ultimi anni o giù di lì ha portato molti gruppi e individui a mobilitarsi contro l’erosione della fiducia nella fotografia.

Nello stesso periodo, la Coalition for Content Provenance and Authenticity (C2PA) ha tentato di diffondere uno standard semi-crittografico che allega informazioni di provenienza basate su metadata a un’immagine, fin dal momento in cui viene catturata da una fotocamera o dispositivo supportato, sperando di smascherare qualsiasi uso successivo di AI generativa su queste ‘immagini originali’:

Schema di provenienza nel sistema C2PA, dove i metadata scritti al momento della cattura possono essere aggiunti come un diario, consentendo ajustamenti consueti come luminosità e contrasto, ma registrando ajustamenti importanti, in modo che un’immagine fortemente alterata dall’AI si presenti come tale nei media che supportano questo sistema. Source

L’adozione di questo standard non è stata così ampia come la coalizione aveva sperato, e attualmente solo 14 fotocamere supportano l’impronta di autenticità all’interno della fotocamera.

Ciò che è interessante nell’idea del C2PA di dare a una foto un ‘passaporto’ non appena esiste, è che a quel punto potrebbe già essere troppo tardi – perché i produttori di fotocamere ora incorporano routine di elaborazione AI nella creazione stessa dell’immagine:

Dal paper del 2024 ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: un’illustrazione di come le moderne pipeline di fotocamere introducono contenuti allucinati al momento della cattura e come i metadata di autenticazione a livello di pixel li espongono. In (A), un’immagine del sensore di uno smartphone è elaborata dall’ISP, dove i moduli AI possono inventare dettagli durante lo zoom digitale o la correzione dell’esposizione, producendo immagini realistiche con errori come cifre di targa di licenza lette male. In (B), una maschera di autenticazione è incorporata come metadata e successivamente sovrapposta per rivelare regioni non autentiche, consentendo agli utenti di distinguere i dati originali dai pixel alterati dall’AI. Source

In realtà, questo tipo di post-elaborazione non è lo stesso della tendenza attuale di modificare le foto all’interno della fotocamera, in cui un’app del telefono o un’app della fotocamera consente all’utente di rielaborare una foto con calma prima che venga scaricata dal dispositivo.

Piuttosto, l’elaborazione avviene in una routine ‘scatola nera’ all’interno del processore di segnale di immagine (ISP) della fotocamera, solitamente in un runtime proprietario che non espone o rende disponibili i dati grezzi del sensore (e considera che il formato grezzo della fotocamera non è così ‘grezzo’).

Pertanto, quando si riesce a vedere la foto, potrebbe già essere stata soggetta a miglioramenti AI-aidati come miglioramento della bassa luce, upscaling o anche sostituzione della luna.

In molti casi, ciò può portare a ricostruzioni inaccurate, ad esempio di testo, che potrebbero invalidare l’uso di tale immagine come prova, poiché un’immagine ‘grezza’ vera e propria non sarebbe disponibile:

Dal nuovo paper – un’immagine grezza del sensore è elaborata da un ISP abilitato GenAI per produrre un output sRGB finale che appare più chiaro ma può contenere dettagli allucinati, come mostrato nell’esempio della targa di licenza dove i caratteri sono inferiti in modo errato durante lo zoom digitale. La scena vera, che non è accessibile nella pratica, differisce sia dall’output migliorato AI che dall’immagine autentica intermedia prima dell’allucinazione. L’approccio proposto consente il recupero di questa immagine pre-allucinazione, ripristinando ciò che la fotocamera originariamente ha catturato prima che i miglioramenti basati su AI modificassero il contenuto. Source

Il lavoro sopra menzionato proviene da un nuovo paper di ricerca che offre un rimedio alle ‘fotografie native AI’, utilizzando processi AI alternativi per ricostruire l’immagine grezza e non adulterata stimata dall’immagine elaborata.

Anderson का एंगल

Palauttaminen mitä kamera tallensi ennen kuin tekoäly muutti sitä

Miten voit suojella raakavalokuvan pyhyyttä tekoälyn sekaantumiselta, kun se on jo valmiiksi ajettu tekoälyllä kameran sisällä? Uudet tutkimukset pyrkivät palauttamaan “oikeat” anturidata – myös tekoälyllä!

Tekoälykuvien aitoutta on lisätty viime vuoden aikana, mikä on johtanut useiden ryhmien ja yksilöiden vastustamaan seuraavaa valokuvien luotettavuuden heikentymistä.

Samaan aikaan Coalition for Content Provenance and Authenticity (C2PA) on yrittänyt levittää puoliviranomaista standardia, joka liittää metadata-pohjaisen alkuperätiedon kuvaan jo siinä vaiheessa, kun se on otettu tuettavalla kameralla tai laitteella, toivoen paljastavansa myöhemmän generatiivisen tekoälyn käytön näillä “alkuperäisillä” kuvilla:

C2PA-järjestelmän alkuperätiedon skeema, jossa metadata kirjoitetaan valokuvaushetkellä ja voidaan lisätä kuin päiväkirjaan, sallien tavanomaiset säätötoimet kuten kirkkauden ja kontrastin, mutta merkitsemällä suuret säätötoimet, jotta voimakkaasti tekoälyllä muutetut kuvat näkyvät sellaisina median kanavissa, jotka tukevat tätä järjestelmää. Lähde

Standardin omaksuminen ei ole ollut yhtä laajaa, kuin koalitio oli toivonut, ja tällä hetkellä vain 14 kameraa tukee kameran sisäistä aitousinformaation merkintää.

Mitä mielenkiintoista C2PA:n ideassa on antaa valokuvalle “passi” heti sen syntymisen jälkeen, on se, että tuolloin se voi jo olla liian myöhäistä – koska kameranvalmistajat nykyään rutiininomaisesti sisällyttävät tekoälyprosessoinnin itse valokuvan luomiseen:

Vuoden 2024 tutkimuksesta ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: havainnollistus siitä, miten modernit kameraputkit tuottavat harhaisia sisältöjä valokuvaushetkellä ja miten pikselitasoinen todennusmetadata paljastaa sen. Kuvassa (A) älypuhelimen anturikuva prosessoidaan ISP:llä, jossa tekoälymoduulit voivat keksitiä yksityiskohtia digitaalisen zoomin tai valotuskorjauksen aikana, tuottaen realistisia kuvia virheillä, kuten väärin luettavilla rekisterikilven numeroilla. Kuvassa (B) todennusmaski upotetaan metadataksi ja myöhemmin ylärivi, jotta voidaan paljastaa epäaidot alueet, sallien käyttäjien erottaa alkuperäiset tiedot tekoälyllä muutetuista pikseleistä. Lähde

Tämä tekoälyn “sekaantuminen” raakadatassa kameran anturista voi lopulta jopa tulla hallitsevaksi prosessiksi.

Tämä jälkikäsittely ei ole sama kuin nykyinen trendi muuttaa valokuvia kamerassa, jossa puhelinsovellus tai kameran sovellus sallii käyttäjän muuttaa valokuvaa oman mielensä mukaan ennen kuin se on ladattu laitteesta.

Sen sijaan prosessi tapahtuu “mustassa laatikossa” kameran kuvansiirtoprosessorissa (ISP), yleensä omistajan aikaisessa suoritusaikana, joka ei paljasta tai tee saataville raakanturidataa (ja huomaa, että niin sanottu “puhdas” kameran raakamuoto ei ole kaikkein “raaka”).

Siksi kun voit nähdä valokuvan, se on jo voinut olla altis tekoälyavusteisille parannuksille, kuten heikkovalokuvien parantamiselle, ylätarkkuuspäivittämiselle tai jopa kuun korvaamiselle.

Monissa tapauksissa tämä voi johtaa epätarkoihin rekonstruktioihin, esimerkiksi tekstistä, mikä voi mitätöidä valokuvan käytön todisteena, koska “oikea” raakakuva ei ole saatavilla:

Uudesta tutkimuksesta: raakanturikuva prosessoidaan GenAI-käyttöön ottavalla ISP:llä, jotta tuotetaan lopullinen sRGB-lähtö, joka näyttää selkeämmältä, mutta voi sisältää harhaisia yksityiskohtia, kuten esimerkiksi rekisterikilven merkkien väärin arvioimista digitaalisen zoomin aikana. Todellinen kuva, jota ei voida käytännössä käyttää, eroaa sekä tekoälyllä parannetusta lähtökuvasovelluksesta että välittömästä aidoista kuvasta ennen harhaisuutta. Lähde

Yllä mainittu esimerkki tulee uudesta tutkimuksesta, joka tarjoaa ratkaisun “alkuperäisille tekoälykuville”, käyttäen vaihtoehtoisia tekoälyprosesseja rekonstruoimaan arvioitu raaka ja muokkaamaton kuva prosessoidusta kuvasta.

Anderson का एंगल

Restaurar lo que su cámara capturó antes de que el IA lo cambiara

¿Cómo puede proteger la santidad de una fotografía cruda de la interferencia del IA cuando ya ha sido procesada automáticamente por el IA dentro de la cámara? Una nueva investigación busca restaurar los ‘verdaderos’ datos del sensor – también con el IA.

El aumento en la autenticidad de las imágenes del IA en el último año o así ha causado que muchos grupos e individuos se opongan a la consiguiente erosión de la confianza en la fotografía.

En el mismo período, la Coalición para la Proveniencia y Autenticidad del Contenido (C2PA) ha intentado difundir un estándar semi-cryptográfico que adjunta información de proveniencia basada en metadatos a una imagen, desde el momento en que es capturada por una cámara o dispositivo compatible, con la esperanza de desenmascarar cualquier uso posterior de IA generativa en estas ‘imágenes originales’:

Esquema de la proveniencia en el sistema C2PA, donde los metadatos escritos en el momento de la captura se pueden agregar como un diario, permitiendo ajustes habituales como brillo y contraste, pero registrando ajustes importantes, para que una imagen altamente alterada por el IA aparezca como tal en los medios que soportan este sistema. Fuente

La adopción del estándar no ha sido tan amplia como la coalición había esperado, y actualmente solo 14 cámaras soportan la impresión de la información de autenticidad en la cámara.

Lo que es interesante sobre la idea de la C2PA de dar a una foto un ‘pasaporte’ tan pronto como existe, es que para entonces puede ser demasiado tarde – porque los fabricantes de cámaras ahora rutinariamente hornean el procesamiento de IA en la creación misma de la imagen:

Del papel de 2024 ‘Advocating Pixel-Level Authentication of Camera-Captured Images’: una ilustración de cómo las tuberías de cámara modernas introducen contenido alucinado en el momento de la captura y cómo los metadatos de autenticación a nivel de píxel lo exponen. En (A), una imagen del sensor de un teléfono inteligente se procesa por el ISP, donde los módulos de IA pueden inventar detalles durante el zoom digital o la corrección de exposición, produciendo imágenes realistas con errores como dígitos de matrícula mal leídos. En (B), una máscara de autenticación se incorpora como metadatos y más tarde se superpone para revelar regiones no auténticas, lo que permite a los usuarios distinguir los datos originales de los píxeles alterados por el IA. Fuente

De hecho, esta interferencia del IA en la captura de datos crudos desde el sensor de la cámara podría eventualmente incluso convertirse en el proceso gobernante.

Este tipo de post-procesamiento no es lo mismo que la tendencia actual de alterar fotos en la cámara, en la que una aplicación de teléfono o una aplicación de cámara permite al usuario reconsiderar una foto en su tiempo libre antes de que se descargue del dispositivo.

Más bien, el procesamiento ocurre en una rutina ‘caja negra’ en el Procesador de Señal de Imagen (ISP) de la cámara, generalmente en un tiempo de ejecución propietario que no expone ni hace disponible los datos del sensor crudos (y considere que el formato de cámara RAW supuestamente ‘puro’ no es tan ‘crudo’).

Por lo tanto, para cuando puede ver la foto en absoluto, puede haber sido sujeta a mejoras asistidas por IA como mejora de baja luz, escalado o incluso reemplazo de luna.

En muchos casos, esto puede llevar a reconstrucciones inexactas, por ejemplo, de texto, que podrían invalidar el uso de tal imagen como evidencia, ya que una imagen ‘cruda’ real no estaría disponible:

Del nuevo papel – una imagen del sensor RAW se procesa por un ISP habilitado por GenAI para producir una salida sRGB final que parece más clara pero puede contener detalles alucinados, como se muestra en el ejemplo de la matrícula donde los caracteres se infieren incorrectamente durante el zoom digital. La escena real, que no es accesible en la práctica, difiere de ambas la salida mejorada por el IA y la imagen auténtica intermedia antes de la alucinación. El enfoque propuesto permite la recuperación de esta imagen pre-alucinación, restaurando lo que la óptica de la cámara capturó originalmente antes de que las mejoras basadas en el IA modificaran el contenido. Fuente

Los ejemplos anteriores provienen de un nuevo papel de investigación que ofrece un remedio para las ‘fotos nativas del IA’, utilizando procesos de IA alternativos para reconstruir la imagen cruda y no adulterada estimada a partir de la imagen procesada.

Anderson का एंगल

Restaurer ce que votre appareil photo a capturé avant que l’IA ne le modifie

Comment pouvez-vous protéger la sainteté d’une photographie brute de l’ingérence de l’IA lorsqu’elle a déjà été traitée automatiquement par l’IA à l’intérieur de l’appareil photo ? De nouvelles recherches visent à restaurer les « vraies » données du capteur – également avec l’IA !

L’augmentation de l’authenticité des images créées par l’IA au cours de la dernière année ou environ a conduit de nombreux groupes et individus à se mobiliser contre l’érosion de la confiance dans la photographie.

Dans la même période, la Coalition pour la provenance et l’authenticité du contenu (C2PA) a tenté de diffuser un standard semi-cryptographique qui attache des informations de provenance basées sur les métadonnées à une image, dès l’instant où elle est capturée par un appareil photo ou un périphérique pris en charge, dans l’espoir de démasquer toute utilisation ultérieure d’IA générative sur ces « images originales » :

Schéma de la provenance dans le système C2PA, où les métadonnées écrites au moment de la capture peuvent être ajoutées comme un journal, permettant des ajustements habituels tels que la luminosité et le contraste, mais enregistrant les ajustements importants, de sorte qu’une image fortement modifiée par l’IA apparaîtra comme telle dans les médias qui prennent en charge ce système. Source

L’adoption de cette norme n’a pas été aussi large que la coalition l’avait espéré, et actuellement seulement 14 appareils photo prennent en charge l’estampillage d’informations d’authenticité dans l’appareil photo.

Ce qui est intéressant dans l’idée de la C2PA de donner à une photo un « passeport » dès sa création, c’est que cela peut être déjà trop tard – car les fabricants d’appareils photo intègrent désormais régulièrement le traitement par l’IA dans la création même de l’image :

De l’article de 2024 « Advocating Pixel-Level Authentication of Camera-Captured Images » : une illustration de la manière dont les pipelines de caméra modernes introduisent du contenu halluciné au moment de la capture et de la manière dont les métadonnées d’authentification au niveau du pixel exposent cela. Dans (A), une image de capteur de smartphone est traitée par le processeur de signal d’image (ISP), où les modules d’IA peuvent inventer des détails pendant le zoom numérique ou la correction d’exposition, produisant des images réalistes avec des erreurs telles que des chiffres de plaque d’immatriculation mal lus. Dans (B), un masque d’authentification est intégré en tant que métadonnées et superposé plus tard pour révéler les régions non authentiques, permettant aux utilisateurs de distinguer les données originales des pixels modifiés par l’IA. Source

En fait, cette « interférence » de l’IA dans la capture de données brutes à partir du capteur de l’appareil photo pourrait éventuellement devenir le processus dominant.