Anderson का एंगल

एआई का उपयोग करके वास्तविक फोटो को लेने से पहले उन्हें बेहतर बनाना

जेनएआई का उपयोग फोटो को शूट करने के बाद उन्हें ठीक करने के बजाय, शोधकर्ताओं ने एक प्रणाली को प्रशिक्षित किया है जो आपको बताती है कि पहले से कैसे चलना है, मुद्रा बनानी है और शॉट को फ्रेम करना है, जो चित्रों को यादगार बनाने वाले ज्ञान के अध्ययन के आधार पर है।

फोटो को事実 के बाद ठीक करना काफी समय से आसान होता जा रहा है, क्योंकि निर्माता और तकनीकी प्लेटफ़ॉर्म बढ़ती तरह से कैमरे में संपादन प्रदान करते हैं जो उपयोगकर्ताओं को छवियों को बदलने की अनुमति देते हैं जैसे ही उन्हें लिया जाता है। इस तरह की लोकप्रिय प्रणालियों में गूगल का कॉन्वर्सेशनल एडिटिंग, और सैमसंग का जेनरेटिव एडिट शामिल हैं, अन्य लोगों के अलावा।

हालांकि, एक नवजात रुझान जो ‘प्रामाणिकता’ को एआई-‘सुधार’ परिणामों पर पसंद करता है, इसका मतलब यह हो सकता है कि कई उपभोक्ता जिनके लिए ऐसी प्रणालियां हैं, उन्हें ‘संशोधित’ फोटो को एआई स्लोप के रूप में देखना शुरू कर देंगे।

शायद यही कारण है कि गूगल ने जेमिनी से सूचित एक एआई-प्रशिक्षित ‘कैमरा कोच’ बनाने के लिए प्रेरित किया है, जो फोटो लेने की प्रक्रिया के दौरान सीधे निर्देश देने में सक्षम है:

<img class=" wp-image-286015" src="https://www.unite.ai/wp-content/uploads/2026/02/google-camera-coach.jpg" alt="गूगल का कैमरा कोच उपयोगकर्ता को बताता है कि फोटो को कैसे रीफ्रेम करना है, साथ ही अन्य बुनियादी सलाह। स्रोत: https://store.google.com/intl/en_uk/ideas/articles/camera-coach/” width=”532″ height=”468″ /> गूगल का कैमरा कोच उपयोगकर्ता को बताता है कि फोटो को कैसे रीफ्रेम करना है, साथ ही अन्य बुनियादी सलाह。 स्रोत

एक प्रोप्राइटरी सिस्टम के रूप में, और लगभग शून्य जानकारी ऑनलाइन उपलब्ध होने के साथ, कैमरा कोच जेमिनी का लाभ उठाता है ताकि उपयोगकर्ता फ्रेमिंग में सुधार कर सकें (ऊपर देखें) या मुद्रा में छोटे बदलाव कर सकें (जैसे कि एक दूसरे के करीब जाना या कैमरे की ओर देखना)।

इस प्रकार, जैसा कि कोई भी बता सकता है, उत्पाद मेडियन की ओर संरचना को धक्का देता है, संभवतः जेमिनी के प्रशिक्षण डेटा में योगदान देने वाले लाखों अपलोड किए गए सामग्री डेटा बिंदुओं के आधार पर। इस अर्थ में, अपलोड करने वाले उपयोगकर्ताओं ने असंतोषजनक शॉट्स को अस्वीकार करके और जो उन्हें पसंद है उसे अपलोड करके एआई के कैलिब्रेशन का निर्माण किया है – एक प्रभावी (और मुफ्त) रूप से डेटासेट क्यूरेशन!

उस कहा, फोटो जो संरचना के मामले में ‘औसत’ होते हैं, उनमें आवश्यक रूप से एक ही सौंदर्य मूल्य या दर्शक-प्रभाव नहीं होता है जो फोटो में होता है जो यादगार होते हैं।

बeyond ‘चीज़!’ और तीसरे नियम

इस उद्देश्य के लिए, और एक प्रणाली की ओर जो अधिक सुलभ है जो प्लेटफ़ॉर्म के पार है, इटली से नए शोध में एक कोच-शैली की प्रणाली है जो फोटो को याद रखने वाले के पूर्व ज्ञान पर आधारित है:

<img class="size-full wp-image-286017" src="https://www.unite.ai/wp-content/uploads/2026/02/details-from-figure-7.jpg" alt="लेखकों की नई प्रणाली से सलाह के विभिन्न उदाहरण। स्रोत – https://arxiv.org/pdf/2602.21877” width=”1200″ height=”448″ /> लेखकों की नई प्रणाली से सलाह के विभिन्न उदाहरण。 स्रोत

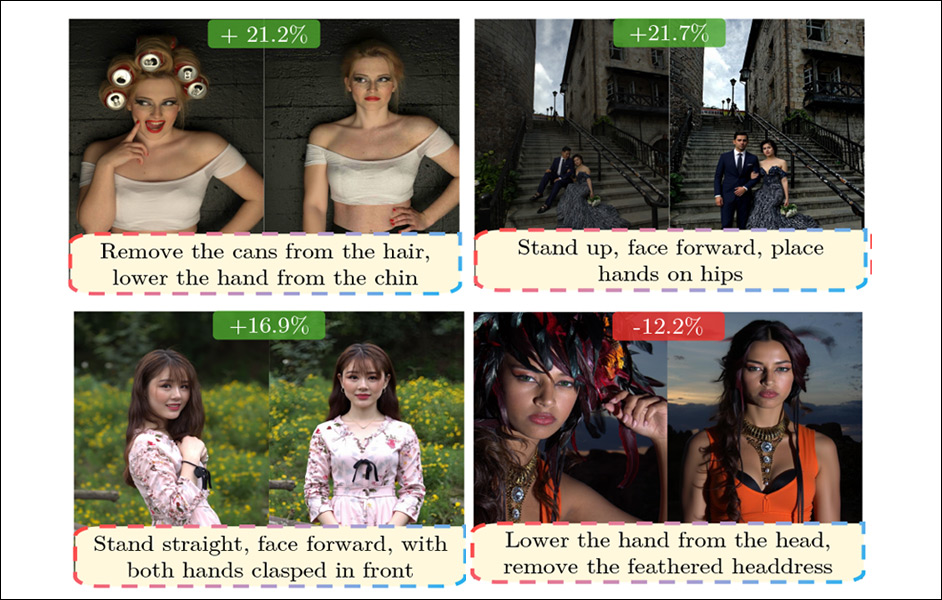

ऊपर दिए गए उदाहरणों में, हम लेखकों की नई प्रणाली – जिसे मेमकोच कहा जाता है – द्वारा दी गई सलाह देखते हैं, जो कि कैमरा कोच जैसे संरचना-केंद्रित एआई द्वारा प्रदान की जाने वाली सलाह की कल्पना करना मुश्किल है। पहले (बाएं) मामले में, हेडड्रेस को हटाने की सलाह विशेष रूप से संदेहास्पद है; दूसरी तस्वीर में, यह कल्पना करना मुश्किल है कि एक सामान्य संदर्भ में एक संरचना-केंद्रित एआई क्या निकाल सकता है (अर्थात, एक ‘कलात्मक’ तस्वीर एक युवा महिला को फर्श पर लेटे हुए अपनी आँखें बंद करके)।

फोटोग्राफी में यादगारपन के बारे में मूल समझ, मेमकोच विकसित करने के लिए विभिन्न पूर्व कार्यों से ली गई है, जिनमें 2015 आउटिंग क्या एक वस्तु को यादगार बनाता है?, और 2013 पेपर एक फोटो को यादगार बनाता है? शामिल हैं।

<img class="size-full wp-image-286022" src="https://www.unite.ai/wp-content/uploads/2026/02/What-makes-a-photograph-memorable.jpg" alt="2013 के पेपर से एक फोटो को यादगार बनाता है?, यादगारपन के मामले में अच्छे, मध्यम और खराब फोटो के प्रतिनिधि उदाहरण। स्रोत – https://people.csail.mit.edu/torralba/publications/Isola_memorabilityPhotos_PAMI2014.pdf” width=”1200″ height=”240″ /> 2013 के पेपर से एक फोटो को यादगार बनाता है?, यादगारपन के मामले में अच्छे, मध्यम और खराब फोटो के प्रतिनिधि उदाहरण。 स्रोत

कोई भी, जैसे मैं, जिनका यूनिक्स जन्मदिन नकारात्मक है, शायद ‘सबसे कम यादगार छवियों’ (ऊपर दिए गए चित्र के ऊपरी दाएं) के लिए टेम्पलेट को पहचानेंगे, जो हमारे बचपन को शापित करने वाली अनगिनत स्लाइड रात से है। जैसा कि लेखक कहते हैं*:

‘इन कार्यों ने लोगों की उपस्थिति, इनडोर दृश्य, या भावनात्मक अभिव्यक्तियों जैसे अंतर्निहित कारकों की पहचान की, वस्तुओं और पैनोरमिक दृश्य के बजाय, साथ ही साथ संदर्भ और पर्यवेक्षक जैसे बाहरी कारक। ‘

परियोजना ‘यादगारपन प्रतिक्रिया’ (मेमफीड) पर केंद्रित है, जो मेमकोच ट्यूटर एप्लिकेशन में व्यक्त की जाती है, और एक बेंचमार्क (शीर्षक मेमबेंच) जो पीपीआर10के डेटासेट पर आधारित है।

<img class="size-full wp-image-286025" src="https://www.unite.ai/wp-content/uploads/2026/02/PPR10K-figure-1.jpg" alt="पेपर पीपीआर10के: एक लार्ज-स्केल पोर्ट्रेट फोटो रीटचिंग डेटासेट के साथ मानव-क्षेत्र मास्क और समूह-स्तर की स्थिरता से विविध नमूने, शीर्ष पंक्ति में मूल छवियां दिखाई गई हैं, नीचे की पंक्ति में विशेषज्ञ-रीटच्ड संस्करण और संबंधित मानव-क्षेत्र मास्क दिखाए गए हैं। मूल फोटो दृष्टिकोण, पृष्ठभूमि, प्रकाश और कैमरा सेटिंग्स में व्यापक रूप से भिन्न होते हैं, जबकि रीटच्ड परिणाम बेहतर दृश्य गुणवत्ता और प्रत्येक समूह के भीतर मजबूत स्थिरता प्रदर्शित करते हैं। स्रोत – https://arxiv.org/pdf/2105.09180” width=”1200″ height=”494″ /> पेपर पीपीआर10के: एक लार्ज-स्केल पोर्ट्रेट फोटो रीटचिंग डेटासेट के साथ मानव-क्षेत्र मास्क और समूह-स्तर की स्थिरता से विविध नमूने, शीर्ष पंक्ति में मूल छवियां दिखाई गई हैं, नीचे की पंक्ति में विशेषज्ञ-रीटच्ड संस्करण और संबंधित मानव-क्षेत्र मास्क दिखाए गए हैं। मूल फोटो दृष्टिकोण, पृष्ठभूमि, प्रकाश और कैमरा सेटिंग्स में व्यापक रूप से भिन्न होते हैं, जबकि रीटच्ड परिणाम बेहतर दृश्य गुणवत्ता और प्रत्येक समूह के भीतर मजबूत स्थिरता प्रदर्शित करते हैं। स्रोत

लेख में कहा गया है कि यादगारपन फोटो में मात्रात्मक है, न कि व्यक्तिपरक निर्णयों का पंजीकरण, और लेखक आगे ध्यान देते हैं कि यह संपत्ति फोटो (विभिन्न कार्यों में) और वीडियो (विभिन्न कार्यों में) दोनों के लिए पहचानी गई है।

नई पेपर का शीर्षक एक यादगार तस्वीर कैसे लें? उपयोगकर्ताओं को क्रियाशील प्रतिक्रिया प्रदान करना है, और यह चार शोधकर्ताओं से आता है जो ट्रेंटो विश्वविद्यालय, पिसा विश्वविद्यालय, और फोंडाज़ियोने ब्रूनो केसलर में हैं। सहयोगी परियोजना पृष्ठ सुझाव देता है कि गिटहब कोड और हगिंग फेस-होस्टेड डेटा अगले महीने (मार्च 2026) उपलब्ध होगा।

विधि

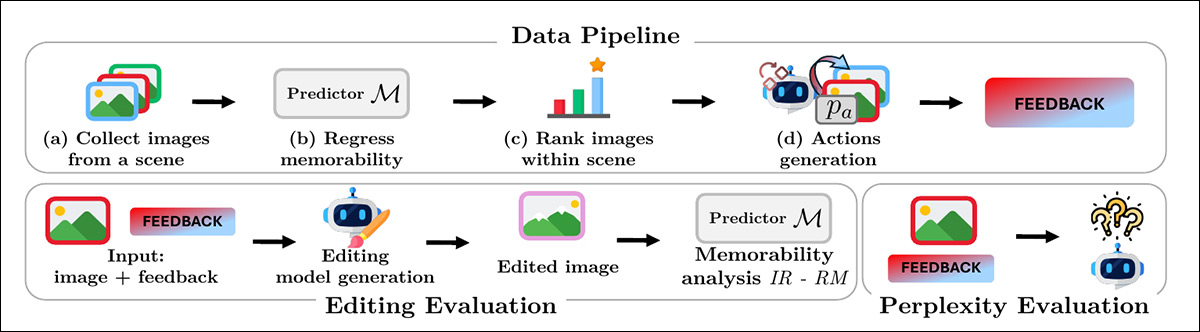

मेमबेंच डेटासेट को स्रोत पीपीआर10के पोर्ट्रेट डेटासेट से बनाने के लिए, शोधकर्ताओं ने फोटो को एक ही दृश्य से समूहित किया और प्रत्येक छवि को यादगारपन के लिए एक प्रशिक्षित पूर्वानुमानकर्ता का उपयोग करके स्कोर किया, जो सीएलआईपी विशेषताओं पर आधारित है। उन्होंने तब प्रत्येक दृश्य के भीतर फोटो को कम से अधिक यादगार तक रैंक किया और उन्हें तदनुसार जोड़ा:

मेमबेंच निर्माण और मूल्यांकन का अवलोकन। शीर्ष पंक्ति डेटा पाइपलाइन को दर्शाती है, जो छवियों को दृश्य द्वारा समूहित करने और यादगारपन का पूर्वानुमान लगाने से लेकर फोटो को रैंक करने और यादगारपन-जागरूक क्रिया प्रतिक्रिया उत्पन्न करने तक है। नीचे की पंक्ति मूल्यांकन को दर्शाती है, जो संपादन-आधारित यादगारपन लाभ और परेशानी स्कोरिंग के माध्यम से प्रतिक्रिया की गुणवत्ता को मापती है।

प्रत्येक जोड़ी के लिए, दृश्य रूप से दिखाई देने वाले अंतरों को समझाने के लिए प्राकृतिक भाषा विवरण इंटरनवीएल3.5 मॉडल के साथ उत्पन्न किए गए थे; और ये विवरण यादगारपन प्रतिक्रिया प्रणाली के लिए प्रशिक्षण संकेत का गठन करेंगे।

गूगल के कैमरा कोच के अंतर्गत आने वाले तर्क के विपरीत, शोधकर्ताओं ने एक अधिक सूक्ष्म सेट की व्याख्या की मांग की†:

‘गणनात्मक फोटोग्राफी समायोजन पर ध्यान केंद्रित करने के विपरीत जो पोस्ट-हॉक सुधार पर केंद्रित हैं (जैसे “छवि को उज्जवल बनाएं”), हम उन सेमेंटिक क्रियाओं पर ध्यान केंद्रित करते हैं जो एक उपयोगकर्ता बेहतर शॉट के लिए तत्काल ले सकता है, जैसे “एक-दूसरे का सामना करें। ‘

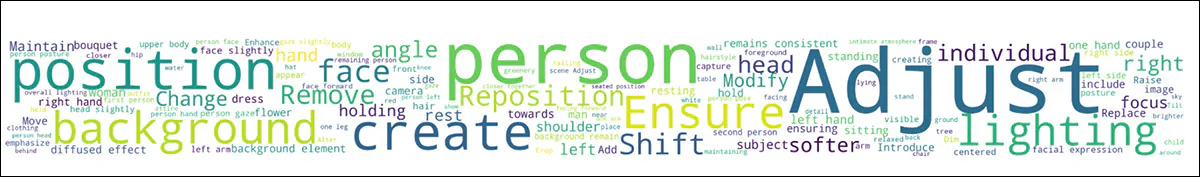

मेमबेंच संग्रह में लगभग 10,000 छवियां शामिल हैं जो 1,570 दृश्यों में समूहित हैं, जिनमें प्रति दृश्य औसतन 6.5 छवियां हैं। लेखकों द्वारा उत्पन्न शब्द-वृक्ष (नीचे दिए गए चित्र में देखें) सुझाव देता है कि डेटासेट में व्यापक सेमेंटिक श्रेणियां हैं:

मेमबेंच में सबसे अधिक बार आने वाले शब्दों का एक शब्द-वृक्ष。

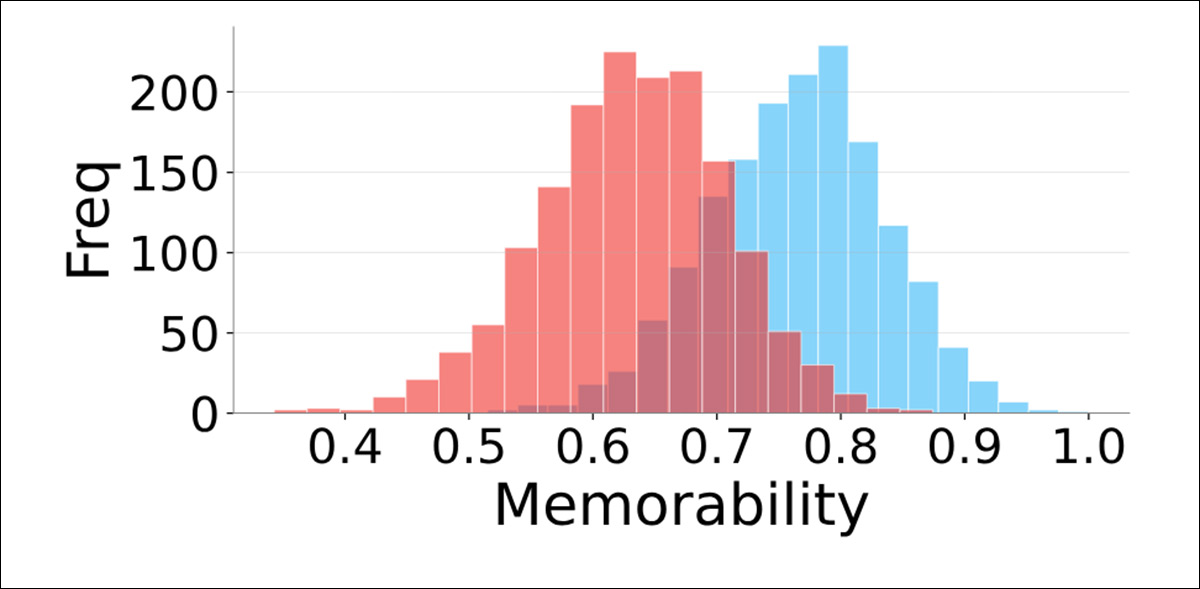

स्रोत फोटो ने 0.63 का यादगारपन स्कोर का औसत किया, जबकि एक ही दृश्य से सबसे यादगार शॉट 0.51 से लेकर 1.0 तक फैले थे, दोनों समूहों के बीच ध्यान देने योग्य ओवरलैप के साथ:

प्रत्येक दृश्य के भीतर कम से अधिक यादगार छवियों की यादगारपन स्कोर वितरण की तुलना।

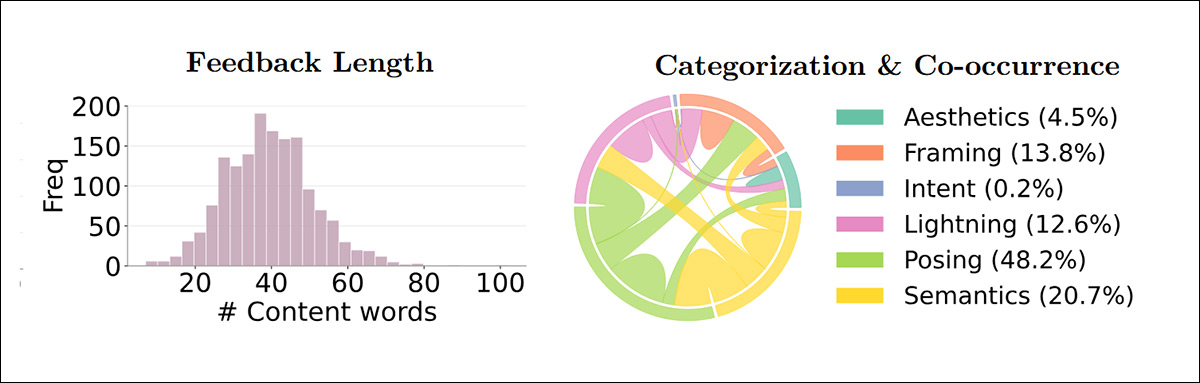

प्रतिक्रिया छोटे सात-शब्द नोट्स से लेकर उल्लेखनीय रूप से लंबे निर्देशों (बाएं, नीचे दिए गए चित्र में) तक भिन्न होती है। प्रत्येक सलाह को जीपीटी-5 मिनी का उपयोग करके छोटे क्रिया प्रकारों में तोड़ दिया गया था (दाएं, नीचे दिए गए चित्र में):

सामग्री शब्दों में प्रतिक्रिया लंबाई वितरण, और कॉर्ड की चौड़ाई के साथ सह-आवृत्ति की आवृत्ति को दर्शाते हुए परमाणु उप-क्रियाओं का वर्गीकरण。

लेखकों का उल्लेख है कि अधिकांश सुझाव विषय की मुद्रा पर केंद्रित थे, उसके बाद दृश्य या सामग्री में परिवर्तन, अक्सर फ्रेमिंग को मुद्रा से जोड़ा गया, और प्रकाश समायोजन अक्सर सेमेंटिक परिवर्तनों से जुड़े हुए थे।

फ्लक्स कैपेसिटर

यादगारपन में वृद्धि का मूल्यांकन करने के लिए कि क्या प्रतिक्रिया द्वारा यह बढ़ाया गया था, उपयोगकर्ता अनुपालन को फ्लक्स.1 कॉन्टेक्स्ट जेनरेटिव मॉडल का उपयोग करके अनुकरण किया गया था, जो एक फोटोग्राफर के लिए एक प्रॉक्सी के रूप में कार्य करता है। एक स्रोत छवि और एक पाठ प्रतिक्रिया दिए जाने पर, फ्लक्स ने सुझाए गए परिवर्तनों का अनुकरण करके एक संपादित संस्करण उत्पन्न किया:

बाएं छवियां वास्तविक हैं, डेटासेट से, और प्रत्येक मामले में दाईं छवियां (नीचे पीले रंग में प्रॉम्प्ट के साथ) फ्लक्स द्वारा बनाई गई हैं। इस प्रकार, प्रॉम्प्ट की प्रभावशीलता का मूल्यांकन किया जा सकता है बिना व्यापक मानव जुड़ाव के। यह ज्ञान अंततः मेमकोच फ्रेमवर्क में वापस आ जाएगा, और वास्तव में एक ऐसी प्रणाली को बेहतर बनाने के लिए एक कार्य प्रवाह का प्रतिनिधित्व करता है जो वास्तविक दुनिया के उदाहरणों (न कि फ्लक्स उदाहरणों) के साथ अंततः बेहतर हो सकता है।

मूल और संपादित छवियों दोनों को एक यादगारपन पूर्वानुमानकर्ता के माध्यम से पारित किया गया, जो माप करने की अनुमति देता है कि कितनी बार संपादित संस्करण ने एक उच्च स्कोर प्राप्त किया – सुधार अनुपात नामक – और प्रारंभिक छवि के सापेक्ष लाभ कितना बड़ा था – सापेक्ष यादगारपन नामक।

यादगारपन-केंद्रित संदर्भ सलाह के लिए समानता को परेशानी की गणना करके मापा गया था, और दृश्य स्तर पर 80-20 विभाजन लागू किया गया था ताकि परीक्षण केवल उन दृश्यों पर किया जा सके जिनका उपयोग प्रशिक्षण के दौरान नहीं किया गया था।

राज्य की कला

वर्तमान बहुमोडल बड़े भाषा मॉडल की यादगारपन जागरूकता का परीक्षण किया गया था। लामेम डेटासेट की छवियों को कई अग्रणी मॉडलों को दिखाया गया था, जिनसे पूछा गया था कि क्या छवि यादगार है; मॉडल का आत्मविश्वास अनुमान तब मानव दर्शकों द्वारा मूल अध्ययन में सौंपे गए स्कोर के साथ तुलना किया गया था:

<img class=" wp-image-286044" src="https://www.unite.ai/wp-content/uploads/2026/02/table-1-and-figure-4.jpg" alt="बेसलाइन बहुमोडल मॉडल यादगारपन को पकड़ते नहीं हैं। बाएं, मॉडल पूर्वानुमान और लामेम ग्राउंड-ट्रुथ स्कोर के बीच स्पीयरमैन रैंक संबंध, लामेम से अंतर-annotator समझौते के साथ संदर्भ के लिए दिखाया गया है। दाएं, शून्य-शॉट प्रतिक्रिया द्वारा प्राप्त सुधार अनुपात, संपादन बेसलाइन के सापेक्ष केवल सीमित लाभ दिखा रहा है।” width=”727″ height=”275″ /> बेसलाइन बहुमोडल मॉडल यादगारपन को पकड़ते नहीं हैं। बाएं, मॉडल पूर्वानुमान और लामेम ग्राउंड-ट्रुथ स्कोर के बीच स्पीयरमैन रैंक संबंध, लामेम से अंतर-annotator समझौते के साथ संदर्भ के लिए दिखाया गया है। दाएं, शून्य-शॉट प्रतिक्रिया द्वारा प्राप्त सुधार अनुपात, संपादन बेसलाइन के सापेक्ष केवल सीमित लाभ दिखा रहा है।

मानव निर्णयों के साथ लगभग कोई अर्थपूर्ण संबंध नहीं पाया गया, और बड़े पैमाने पर प्री-प्रशिक्षण के बावजूद, लेखकों का दावा है कि मॉडल ने लोगों द्वारा लगातार याद की जाने वाली चीजों का अनुसरण नहीं किया।

<img class="size-full wp-image-286049" src="https://www.unite.ai/wp-content/uploads/2026/02/lamem-dataset-samples.jpg" alt="लामेम डेटासेट के उदाहरण। ऊपरी-बाएं, हम उस छवि के लिए एक हीटमैप भी देखते हैं। स्रोत – http://memorability.csail.mit.edu/explore.html” width=”1200″ height=”490″ /> लामेम डेटासेट के उदाहरण। ऊपरी-बाएं, हम उस छवि के लिए एक हीटमैप भी देखते हैं। स्रोत

मेमकोच

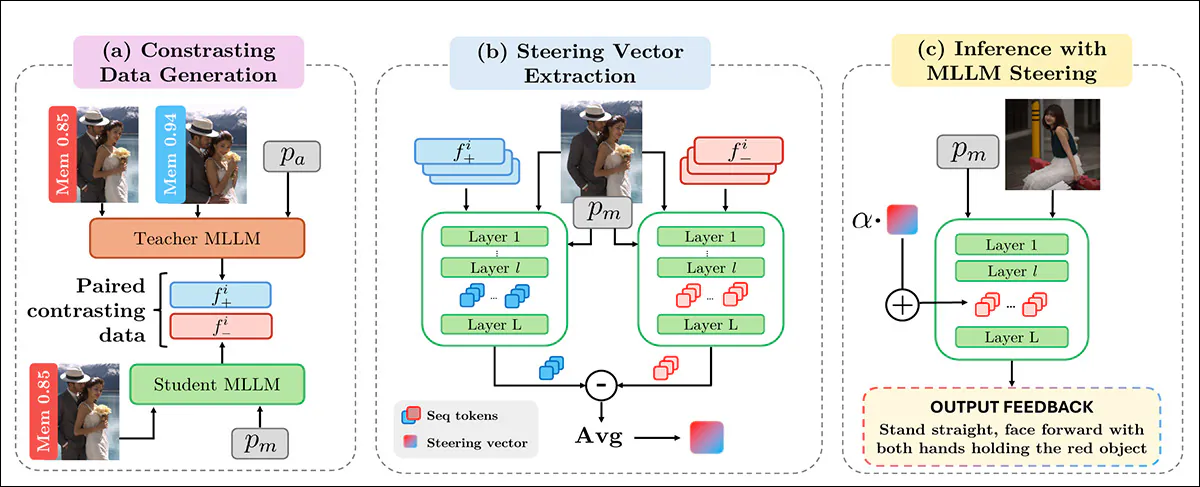

मेमकोच फोटो लेने से पहले की जा सकने वाली सेमेंटिक, ऑन-द-फ्लाई निर्देशों पर केंद्रित है – जैसे कि मुद्रा को समायोजित करना, विषयों के बीच परस्पर क्रिया को बदलना, या दृश्य तत्वों को संशोधित करना। मेमकोच द्वारा प्रदान की जाने वाली प्रतिक्रिया 7-102 सामग्री शब्दों के बीच भिन्न होती है। यादगारपन, पेपर का तर्क है, विषय कॉन्फ़िगरेशन और कथा संकेतों द्वारा अधिक संचालित प्रतीत होता है, न कि साधारण संरचनात्मक ट्वीक्स द्वारा:

मेमकोच पाइपलाइन का अवलोकन, जिसमें एक शिक्षक एमएलएलएम से यादगारपन-जागरूक मार्गदर्शन को एक छात्र की तटस्थ प्रतिक्रियाओं के साथ जोड़ा जाता है; परतों भर में सक्रियण अंतर को औसत किया जाता है ताकि यादगारपन को निर्देशित करने वाला एक वेक्टर प्राप्त किया जा सके; और उस वेक्टर को अनुमान में इंजेक्ट किया जाता है ताकि छात्र की सक्रियता को बिना किसी अतिरिक्त प्रशिक्षण के यादगारपन-उन्मुख प्रतिक्रिया का उत्पादन करने के लिए स्थानांतरित किया जा सके।

परीक्षण

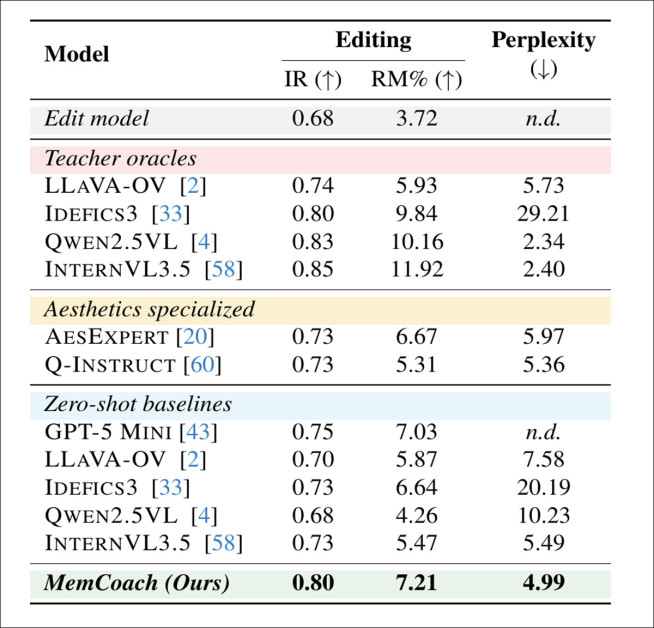

मेमकोच प्रणाली के लिए परीक्षण चरण में सात बहुमोडल बड़े भाषा मॉडल (एमएलएलएम) का उपयोग किया गया था: क्वेन2.5वीएल; इंटरनवीएल3_5-8बी; आईडेफिक्स3-8बी; और एलएलएवी-वनविजन-1.5. इसके अलावा जीपीटी-5 मिनी को एक प्रतिनिधि के रूप में शामिल किया गया था। स्वामित्व वाले मॉडल, साथ ही साथ क्यू-इन्सट्रक्ट और एएसएक्सपर्ट मॉडल जैसे सौंदर्य विशेषज्ञता वाले मॉडल। एमएलएलएम ने शून्य-शॉट और शिक्षक ऑरेकल के रूप में विभिन्न रूप से संचालित किया।

इंटरनवीएल3.5 का उपयोग शिक्षक और छात्र मॉडल दोनों के लिए किया गया था, मेमबेंच प्रशिक्षण विभाजन का उपयोग करके विरोधाभासी उदाहरण बनाने के लिए:

मेमकोच का प्रदर्शन राज्य-ऑफ-द-आर्ट एमएलएलएम के साथ तुलना में शिक्षक ऑरेकल, सौंदर्य विशेषज्ञता वाले मॉडल, और शून्य-शॉट बेसलाइन के साथ, उच्च सुधार अनुपात और प्रतिस्पर्धी सापेक्ष यादगारपन के साथ-साथ निम्न परेशानी दिखा रहा है, जो अधिक संगत और यादगारपन-उन्मुख प्रतिक्रिया का संकेत देता है।

तालिका में (ऊपर दिखाया गया है), हम देखते हैं कि मेमकोच तुलना मॉडल की तुलना में अधिक प्रभावी यादगारपन सलाह प्रदान करता है – और स्टीयर्ड इंटरनवीएल3.5 मॉडल यादगारपन को अधिक बार और एक बड़े पैमाने पर बढ़ाता है, जीपीटी-5 मिनी पर 5% सुधार अनुपात और अपने अनस्टीयर्ड संस्करण पर 31.81% की रिलेटिव मेमोरेबिलिटी में छलांग के साथ।

यह सौंदर्य-केंद्रित प्रणालियों को भी पार करता है, जिसके लिए किसी अतिरिक्त प्रशिक्षण की आवश्यकता नहीं होती है। कम परेशानी का दावा किया जाता है कि इसकी प्रतिक्रिया मानव यादगारपन निर्णयों को पुरस्कृत करने वाली भाषाई पैटर्न का अनुसरण करती है:

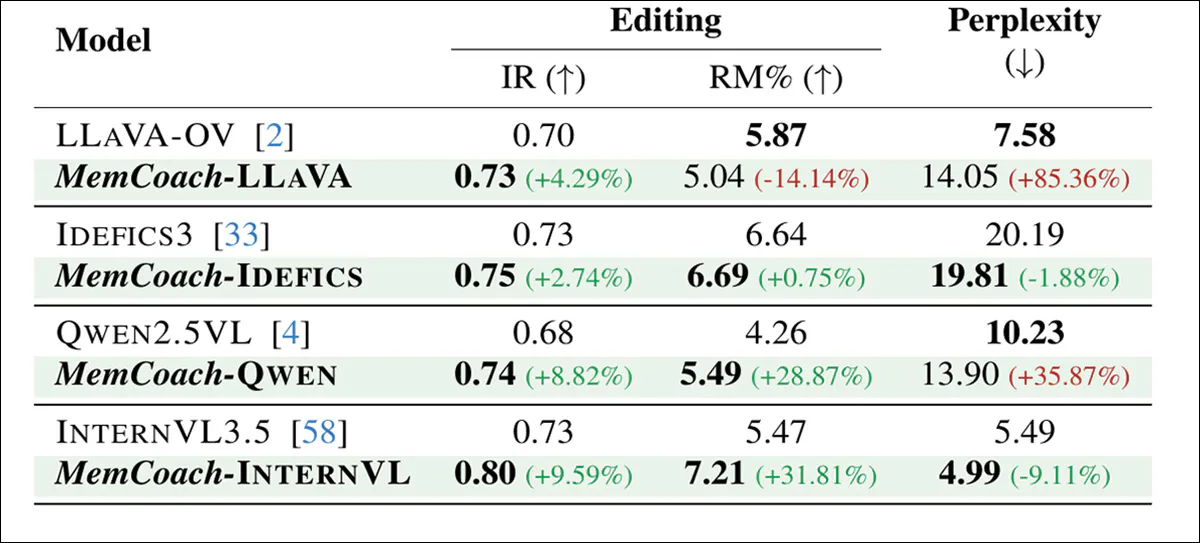

सामान्यीकरण परिणाम जो दिखाते हैं कि मेमकोच विभिन्न बहुमोडल बैकबोन के पार यादगारपन-उन्मुख प्रतिक्रिया में सुधार करता है, लगातार सुधार अनुपात और सापेक्ष यादगारपन को बढ़ाता है, साथ ही अधिकांश मॉडलों के लिए परेशानी को कम करता है।

एक आगे का परीक्षण (ऊपर दिखाया गया है) संकेत देता है कि मेमकोच जोड़ने से यादगारपन-जागरूक प्रतिक्रिया में वृद्धि हुई है, जिसमें क्यूवेन2.5वीएल और एलएलएवी-ओवी के लिए सबसे बड़े लाभ दिखाई दे रहे हैं।

एक गुणात्मक मूल्यांकन तब आयोजित किया गया था, जिसमें मेमकोच प्रतिक्रिया के उदाहरणों का विश्लेषण किया गया था, जिसमें स्रोत छवि, प्राकृतिक भाषा सुझाव, और परिणामी संपादित छवि को एक साथ देखा गया था:

मेमकोच द्वारा उत्पन्न यादगारपन-उन्मुख प्रतिक्रिया के गुणात्मक उदाहरण। प्रत्येक त्रिपदी स्रोत छवि, प्राकृतिक भाषा निर्देश, और परिणामी संपादित छवि को दिखाती है, सापेक्ष यादगारपन (आरएम) माप के साथ मापा गया परिवर्तन। मार्गदर्शन मुद्रा और गेज समायोजन से लेकर सेमेंटिक हस्तक्षेप जैसे वस्तु हटाने तक होता है, जो सफल लाभ और यादगारपन को कम करने वाले असामान्य तत्वों को हटाने के मामलों को दर्शाता है।

इन परिणामों से, लेखक कहते हैं:

‘उदाहरणों में दिखाया गया है कि मॉडल कितनी विविधता से सुझाव देता है, जो मुद्रा को बदलने, दृष्टि को बदलने, या हाथ की स्थिति को बदलने जैसे सूक्ष्म संरचनात्मक समायोजन से लेकर वस्तु हटाने या चेहरे की अभिव्यक्ति को बदलने जैसे सेमेंटिक हस्तक्षेप तक होता है। ‘

‘प्रतिक्रिया स्वाभाविक रूप से व्याख्यात्मक और क्रियाशील है, संक्षिप्त पाठ निर्देशों में व्यक्त की जाती है (ज्यादातर क्रियाओं “लाओ”, ” खड़े हो जाओ”, “हटाओ” शामिल हैं) जो सीधे लागू की जा सकती हैं, वास्तव में यह बताते हुए कि एक यादगार तस्वीर कैसे लें। ‘

निष्कर्ष

यह जानना सबसे दिलचस्प होगा कि गूगल के बंद-बॉक्स दृष्टिकोण की विधि की तुलना मेमबेंच परियोजना से की जाए – न कि केवल यह जानने के लिए कि गूगल ने प्रणाली के सौंदर्य मानकों को परिभाषित करने के लिए किन केंद्रीय मानकों, संदर्भों और डेटाबेस का उपयोग किया है।

इस तरह की प्रणालियों का नकारात्मक पहलू यह है कि वे पैमाने पर एक समान मानक लागू करने का जोखिम रखते हैं जो अंततः मीम और क्लिच के रूप में समाप्त हो जाते हैं – एक तरह का दृश्य समकक्ष, एआई एम-डैश विवाद, जहां ‘सही’ प्रक्रिया कुछ हद तक शापित हो गई है अनौपचारिक उपयोग में।

* मैंने लेखकों के इनलाइन उद्धरणों को हाइपरलिंक में परिवर्तित किया है, यदि लिंक को लेख में कहीं और प्रस्तुत नहीं किया गया है।

† लेख यहाँ, जैसे कई अन्य स्थानों पर, ‘पूरक सामग्री’ का उल्लेख करता है जिसे मैं न तो लेख से, न ही मूल अर्काइव लिस्टिंग से, और न ही परियोजना साइट से प्राप्त कर सकता हूं।

पहली बार गुरुवार, 26 फरवरी, 2026 को प्रकाशित