Inteligencia Artificial

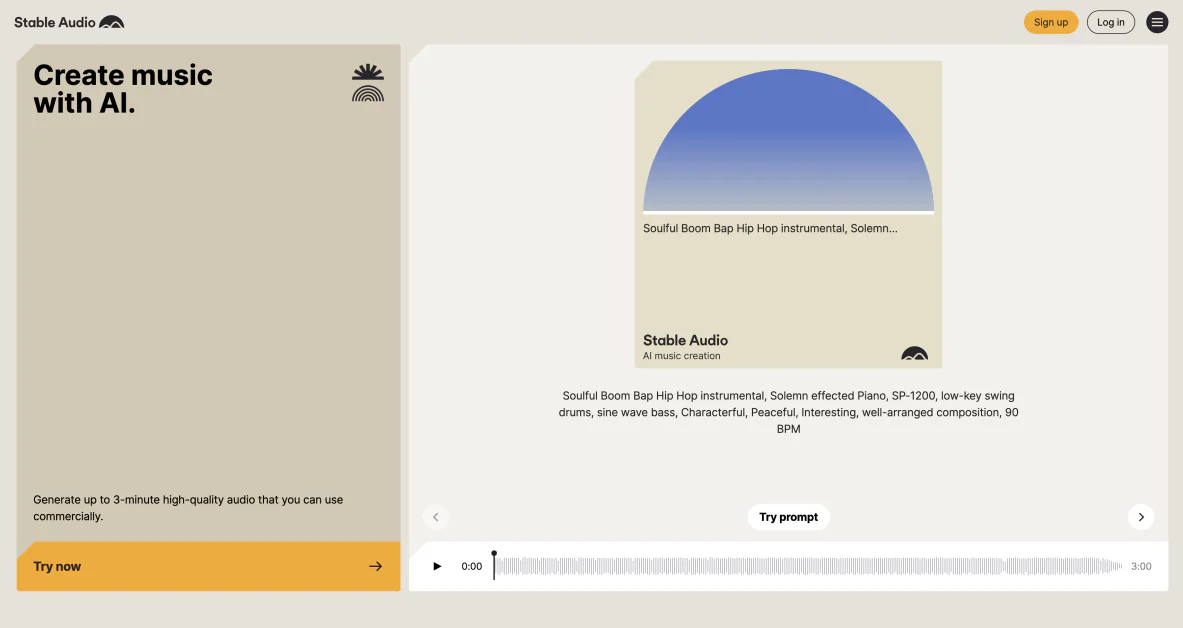

Stability AI presenta Stable Audio 2.0: empoderando a los creadores con audio avanzado generado por IA

La IA de estabilidad ha vuelto a traspasar los límites de la innovación con el lanzamiento de Audio estable 2.0. Este modelo de vanguardia se basa en el éxito de su predecesor e introduce una serie de características innovadoras que prometen revolucionar la forma en que los artistas y músicos crean y manipulan contenido de audio.

Stable Audio 2.0 representa un hito importante en la evolución del audio generado por IA, estableciendo un nuevo estándar de calidad, versatilidad y potencial creativo. Con su capacidad para generar pistas completas, transformar muestras de audio utilizando indicaciones de lenguaje natural y producir una amplia gama de efectos de sonido, este modelo abre un mundo de posibilidades para los creadores de contenido de diversas industrias.

Ante el continuo crecimiento de la demanda de soluciones de audio innovadoras, la última propuesta de Stability AI se perfila como una herramienta indispensable para los profesionales que buscan optimizar su producción creativa y su flujo de trabajo. Al aprovechar el poder de la tecnología avanzada de IA, Stable Audio 2.0 permite a los usuarios explorar nuevos horizontes en la composición musical, el diseño de sonido y la postproducción de audio.

¿Cuáles son las características clave de Stable Audio 2.0?

Stable Audio 2.0 cuenta con una impresionante variedad de características que podrían redefinir el panorama del audio generado por IA. Desde la generación de pistas completas hasta la transformación de audio a audio, la producción mejorada de efectos de sonido y la transferencia de estilos, este modelo proporciona a los creadores un completo conjunto de herramientas para dar vida a sus visiones auditivas.

Generación de pistas completas

Stable Audio 2.0 se distingue de otros modelos de audio generados por IA por su capacidad de crear pistas completas de hasta tres minutos de duración. Estas composiciones no son simplemente fragmentos extendidos, sino más bien piezas estructuradas que incluyen secciones distintas, como una introducción, un desarrollo y una salida. Esta característica permite a los usuarios generar obras musicales completas con una narrativa y progresión coherentes, elevando el potencial de la creación musical asistida por IA.

Además, el modelo incorpora efectos de sonido estéreo, añadiendo profundidad y dimensión al audio generado. Esta inclusión de elementos espaciales mejora aún más el realismo y la calidad inmersiva de las pistas, haciéndolas adecuadas para una amplia gama de aplicaciones, desde música de fondo en vídeos hasta composiciones musicales independientes.

Generación de audio a audio

Una de las adiciones más interesantes a Stable Audio 2.0 es la capacidad de generación de audio a audio. Los usuarios ahora pueden cargar sus propias muestras de audio y transformarlas mediante indicaciones en lenguaje natural. Esta característica abre un mundo de posibilidades creativas, permitiendo a artistas y músicos experimentar con la manipulación y regeneración del sonido de formas que antes eran inimaginables.

Al aprovechar el poder de la IA, los usuarios pueden modificar fácilmente los recursos de audio existentes para adaptarlos a sus necesidades específicas o a su visión artística. Ya sea cambiando el timbre de un instrumento, alterando la atmósfera de una pieza o creando sonidos completamente nuevos a partir de muestras existentes, Stable Audio 2.0 ofrece una forma intuitiva de explorar la transformación del audio.

Producción de efectos de sonido mejorada

Además de sus capacidades de generación de música, Stable Audio 2.0 sobresale en la creación de diversos efectos de sonido. Desde ruidos de fondo sutiles como el susurro de las hojas o el zumbido de la maquinaria hasta paisajes sonoros más inmersivos y complejos como las bulliciosas calles de la ciudad o entornos naturales, el modelo puede generar una amplia gama de elementos de audio.

Esta función mejorada de producción de efectos de sonido es particularmente valiosa para los creadores de contenido que trabajan en cine, televisión, videojuegos y proyectos multimedia. Con Stable Audio 2.0, los usuarios pueden generar rápida y fácilmente efectos de sonido de alta calidad que de otro modo requerirían un extenso trabajo de foley o costosos recursos con licencia.

Transferencia de estilo

Stable Audio 2.0 introduce una función de transferencia de estilo que permite a los usuarios modificar sin problemas las cualidades estéticas y tonales del audio generado o cargado. Esta capacidad permite a los creadores adaptar la salida de audio para que coincida con los temas, géneros o matices emocionales específicos de sus proyectos.

Al aplicar la transferencia de estilo, los usuarios pueden experimentar con diferentes estilos musicales, combinar géneros o crear paletas sonoras completamente nuevas. Esta característica es particularmente útil para crear bandas sonoras coherentes, adaptar la música para que se ajuste a contenido visual específico o explorar combinaciones y remezclas creativas.

Avances tecnológicos del audio estable 2.0

En el interior, Stable Audio 2.0 está impulsado por tecnología de IA de vanguardia que le permite un rendimiento impresionante y una salida de alta calidad. La arquitectura del modelo ha sido cuidadosamente diseñada para afrontar los desafíos únicos de generar composiciones de audio coherentes y completas, manteniendo un control preciso de los detalles.

Arquitectura del modelo de difusión latente.

En el núcleo de Stable Audio 2.0 se encuentra una arquitectura de modelo de difusión latente que ha sido optimizada para la generación de audio. Esta arquitectura consta de dos componentes clave: un sistema altamente comprimido codificador automático del transformador de difusión (DiT).

El codificador automático es responsable de comprimir de manera eficiente las formas de onda de audio sin procesar en representaciones compactas. Esta compresión permite que el modelo capture las características esenciales del audio mientras filtra los detalles menos importantes, lo que da como resultado una salida generada más coherente y estructurada.

El transformador de difusión, similar al empleado en el innovador modelo Stable Diffusion 3 de Stability AI, reemplaza la arquitectura U-Net tradicional de versiones anteriores. El DiT es especialmente eficaz en el manejo de largas secuencias de datos, lo que lo hace ideal para procesar y generar composiciones de audio extensas.

Rendimiento y calidad mejorados

La combinación del codificador automático altamente comprimido y el transformador de difusión permite a Stable Audio 2.0 lograr mejoras notables tanto en rendimiento como en calidad de salida en comparación con su predecesor.

La eficiente compresión del autocodificador permite que el modelo procese y genere audio a mayor velocidad, lo que reduce los recursos computacionales requeridos y lo hace más accesible para un mayor número de usuarios. Al mismo tiempo, la capacidad del transformador de difusión para reconocer y reproducir estructuras a gran escala garantiza que el audio generado mantenga un alto nivel de coherencia e integridad musical.

Estos avances tecnológicos culminan en un modelo capaz de generar audio increíblemente realista y con una resonancia emocional impresionante, ya sea una composición musical completa, un paisaje sonoro complejo o un sutil efecto de sonido. La arquitectura de Stable Audio 2.0 sienta las bases para futuras innovaciones en audio generado por IA, allanando el camino para herramientas aún más sofisticadas y expresivas para los creadores.

Derechos del creador con Stable Audio 2.0

A medida que el audio generado por IA continúa avanzando y volviéndose más accesible, es crucial abordar las implicaciones éticas y garantizar que los derechos de los creadores estén protegidos. Stability AI ha tomado medidas proactivas para priorizar el desarrollo ético y una compensación justa para los artistas cuyo trabajo contribuye a la formación de Stable Audio 2.0.

Stable Audio 2.0 se entrenó exclusivamente en un conjunto de datos con licencia de AudioSparx, una fuente confiable de contenido de audio de alta calidad. Este conjunto de datos consta de más de 800,000 archivos de audio, que incluyen música, efectos de sonido y plicas de un solo instrumento, junto con los metadatos de texto correspondientes. Al utilizar un conjunto de datos con licencia, Stability AI garantiza que el modelo se construya sobre una base de datos de audio obtenidos legalmente y atribuidos adecuadamente.

Al reconocer la importancia de la autonomía del creador, Stability AI brindó a todos los artistas cuyo trabajo está incluido en el conjunto de datos de AudioSparx la oportunidad de optar por no utilizar su audio en la capacitación de Stable Audio 2.0. Este mecanismo de exclusión voluntaria permite a los creadores mantener el control sobre cómo se utiliza su trabajo y garantiza que solo se incluyan en el conjunto de datos aquellos que se sientan cómodos con el uso de su audio para el entrenamiento de IA.

Stability AI se compromete a garantizar que los creadores cuyo trabajo contribuya al desarrollo de Stable Audio 2.0 reciban una compensación justa por sus esfuerzos. Al otorgar la licencia del conjunto de datos AudioSparx y brindar opciones de exclusión voluntaria, la compañía demuestra su dedicación a establecer un ecosistema sostenible y equitativo para el audio generado por IA, donde los creadores sean respetados y recompensados por sus contribuciones.

Para proteger aún más los derechos de los creadores y prevenir la infracción de derechos de autor, Stability AI se ha asociado con Audible Magic, proveedor líder de tecnología de reconocimiento de contenido. Al integrar el sistema de reconocimiento avanzado de contenido (ACR) de Audible Magic en el proceso de subida de audio, Stable Audio 2.0 puede identificar y marcar cualquier contenido potencialmente infractor, garantizando que solo se utilice audio original o con la licencia correspondiente en la plataforma.

A través de estas consideraciones éticas e iniciativas centradas en los creadores, Stability AI sienta un sólido precedente para el desarrollo responsable de la IA en el ámbito del audio. Al priorizar los derechos de los creadores y establecer pautas claras para el uso y la compensación de datos, la empresa fomenta un entorno colaborativo y sostenible donde la IA y la creatividad humana pueden coexistir y prosperar.

Dando forma al futuro de la creación de audio con estabilidad AI

Stable Audio 2.0 marca un hito importante en el audio generado por IA, brindando a los creadores un conjunto completo de herramientas para explorar nuevas fronteras en la música, el diseño de sonido y la producción de audio. Con su arquitectura de modelo de difusión latente de vanguardia, su rendimiento impresionante y su compromiso con las consideraciones éticas y los derechos de los creadores, Stability AI está a la vanguardia de la configuración del futuro de la creación de audio. A medida que esta tecnología continúa evolucionando, está claro que el audio generado por IA desempeñará un papel cada vez más fundamental en el panorama creativo, brindando a los artistas y músicos las herramientas que necesitan para ampliar los límites de su oficio y redefinir lo que es posible en el mundo. de sonido.