Andersons Blickwinkel

Aus den Augen, aus dem Sinn: Die größte Herausforderung im Bereich KI-Videos

Das größte Problem selbst der besten KI-Videogeneratoren ist ihre chronische Amnesie – eine Herausforderung, der sich neue Forschungen aus China nun widmen.

Das größte Problem selbst der besten und modernsten KI-Videogenerierungssysteme ist, dass sie alle chronische AmnesieWenn die Kamera von dem, worauf sie fokussiert ist, wegschwenkt und dann wieder zurückschwenkt, wird sie niemals das finden, was am Anfang da war – die Figuren werden verschwunden sein, ihr Aussehen und/oder ihre Bewegungsart verändert haben, und der Hintergrund wird sich wahrscheinlich auch verändert haben.

Dies liegt daran, dass das auf Diffusion basierende Erzeugungssystem eine begrenzte Rollfähigkeit aufweist. Aufmerksamkeitsfensterund weil es sich immer mit was es in diesem Moment sehen kann; in einer wahren Verabschiedung von Solipsismus, was ist aussen Für generative KI gibt es keinen Rahmen – er wird buchstäblich aus dem Speicher gelöscht.

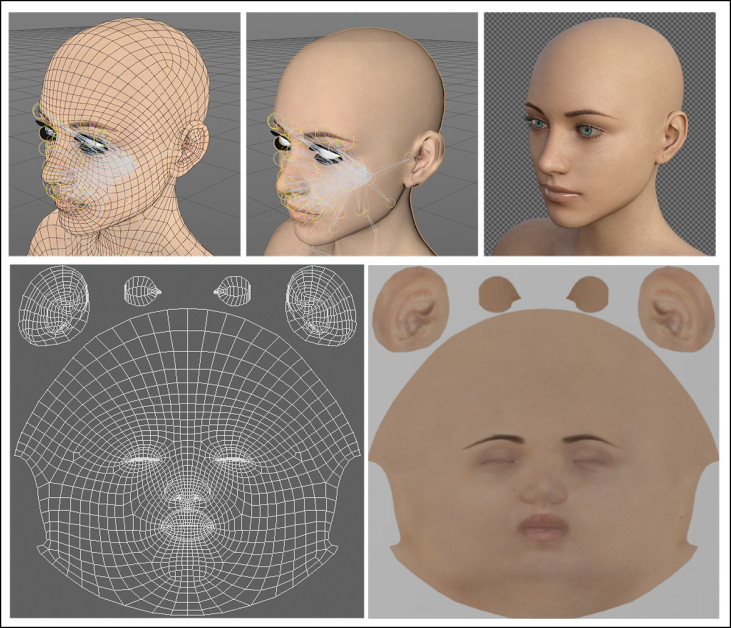

Das hat Das war bei traditionellen CGI-Anwendungen nie ein Problem., die jederzeit auf ein Objekt verweisen und es, einschließlich seines Aussehens und seiner Bewegung, an jeder beliebigen Stelle in einem gerenderten Video, an der es erneut benötigt wird, präzise wiedergeben können:

Traditionelle CGI-Meshes und Bitmap-Texturen können immer wieder in ein Rendering zurückgezeichnet werden, wodurch ein konsistentes Erscheinungsbild gewährleistet wird – ein Trick, der bei KI-Ansätzen viel schwieriger zu erreichen ist, da es keine entsprechende „flache Referenzdatei“ oder Sammlung verwandter Dateien gibt.

Dies liegt daran, dass die Komponentenelemente von CGI, wie etwa das Mesh und die Texturen (siehe Abbildung oben), sowie Bewegungsdateien und andere dynamische Verhaltensweisen, diskret auf der Festplatte gespeichert und jederzeit in eine Komposition eingebunden werden können.

In der generativen Video-KI gibt es kein solches „flaches Repository“; die Funktionalität, die diesem Konzept am nächsten kommt, ist LoRAs – speziell trainierte Zusatzdateien, die auf Endgeräten trainiert werden können und so neuartige Charaktere und spezifische Kleidung ermöglichen. in das Video "gezwungen" zu werden:

Anklicken um abzuspielen. Das Solipsismusproblem von KI-Videos kann durch die Verwendung von LoRAs bis zu einem gewissen Grad gemildert werden – die Ergebnisse können jedoch überwältigend sein.

Dies ist jedoch keine ideale Lösung. Zum einen sind LoRA-Verbindungen an eine bestimmte Version eines Basismodells gebunden (wie z. B. WAN2+ oder …). Hunyuan-Video), Und müssen neu geschaffen werden jedes Mal, wenn sich das Basismodell ändert. Zum Beispiel LoRAs. neigen dazu, die Gewichte zu verzerren des Basismodells, sodass die trainierte Identität von LoRA allen Charakteren in einer Szene aufgezwungen wird. Zusätzlich Feintuning Methoden dieser Art sind sehr empfindlich zu schlecht aufbereiteten Datensätzen.

Genaue Zugaben

Eine neue Kooperation zwischen Wissenschaft und Industrie in China bietet nun die erste bedeutende Lösung, die mir in über drei Jahren Berichterstattung zu diesem Thema bekannt geworden ist. Die Methode nutzt etwas, das die Forscher als … bezeichnen. Hybridspeicher um die außerhalb des Bildschirms stehenden Charaktere und ihre direkte Umgebung aktiv und präzise darzustellen latenter Raum des Modells, so dass der Effekt konsistent ist, wenn unser Blickwinkel wieder auf sie zurückkehrt:

Anklicken um abzuspielen. Auf der Projektseite für die neue Veröffentlichung finden sich zwei Beispiele für KI-generierte (WAN) Zeichen, die den Bildausschnitt verlassen und korrekt wieder eintreten. Quelle

Es sollte betont werden, dass dies nicht dasselbe ist wie das Erreichen von Zeichenkonsistenz über verschiedene Aufnahmen hinweg – etwas, das angeblich erreicht wurde vor einem Jahr in der Gen 4-Version von Runway, die weiterhin an laufend Verfolgung in der Forschungsliteratur.

Vielmehr wird hier etwas gelöst, was keinem mir bekannten kommerziellen oder experimentellen Rahmenwerk gelungen ist – die visuell konsistentes Wiedererscheinen das frühere Aussehen, die Bewegungen und die Umgebung einer Figur, die nicht im Bild zu sehen ist:

Anklicken um abzuspielen. Die beiden anderen Hauptbeispiele werden auf der Projektseite der neuen Initiative genannt.

Die hier angewandten Prinzipien lassen sich selbstverständlich gleichermaßen auf andere Bereiche übertragen, wie etwa Stadterkundung, POV-Fahrten oder andere Arten von nicht-charakterbasierten Darstellungen.

Es sollte außerdem betont werden, dass dieser neue Ansatz das Problem, das Runway Gen4 und andere proprietäre Plattformen angeblich durch die Nachbildung von Charakteren gelöst haben, weder löst noch angeht. über verschiedene Aufnahmen hinwegStattdessen vollbringt es das, was keinem von ihnen bisher gelungen ist – die dauerhafte Speicherung einer Figur und ihrer Umgebung im Gedächtnis. ohne dass sie für den Betrachter jederzeit sichtbar bleiben müssen..

Die neue Arbeit umfasst einen eigens dafür erstellten Datensatz, der durch Unreal Enginesowie benutzerdefinierte Metriken für das Solipsismusproblem* und ein maßgeschneidertes generatives Framework, das über WAN aufgebaut ist. In Tests mit den wenigen verfügbaren vergleichbaren Systemen erzielen die Autoren nach eigenen Angaben Ergebnisse auf dem neuesten Stand der Technik und kommentieren dies wie folgt:

„[Gedächtnis-]Mechanismen haben sich als entscheidende Grenze bei der Weiterentwicklung von Weltmodellen herauskristallisiert, da die Speicherkapazität die räumliche und zeitliche Konsistenz der generierten Inhalte bestimmt.“

„Konkret ist es der kognitive Anker, der es dem Modell ermöglicht, den historischen Kontext bei Perspektivwechseln oder langfristigen Extrapolationen beizubehalten.“

„Ohne einen robusten Speicher zerfällt eine simulierte Welt schnell in unzusammenhängende, chaotische Einzelbilder.“

Die neues Papier ist betitelt Aus den Augen, aber nicht aus dem Sinn: Hybridspeicher für dynamische Videoweltmodelleund stammt von sieben Forschern der Huazhong University of Science and Technology sowie dem Kling-Team von Kuaishou Technology.

Methodik

Das zentrale Element des neuen Werks ist HybridspeicherDies ermöglicht die „Extrapolation außerhalb des Sichtfelds“ – die Beibehaltung von Figuren und ihrem Kontext, während der Betrachter wegschaut (oder die Figur selbst aus dem Sichtfeld verschwindet). In diesem Szenario muss das Framework folgende Funktionen erfüllen: räumlich-zeitliche Entkopplung, wobei der Fokus gleichzeitig auf der für den Zuschauer sichtbaren Generation und der Existenz der nun außerhalb des Bildausschnitts befindlichen Figur liegt.

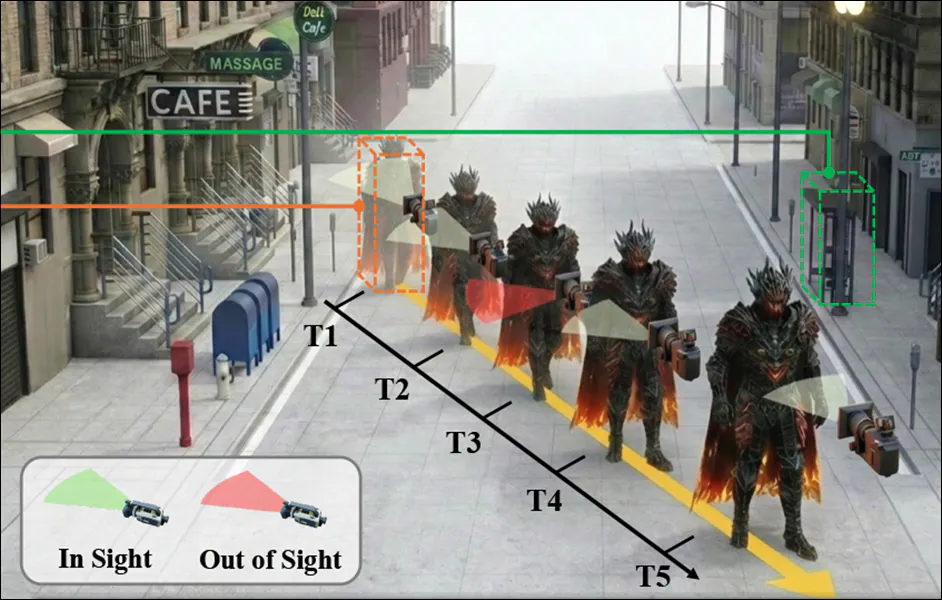

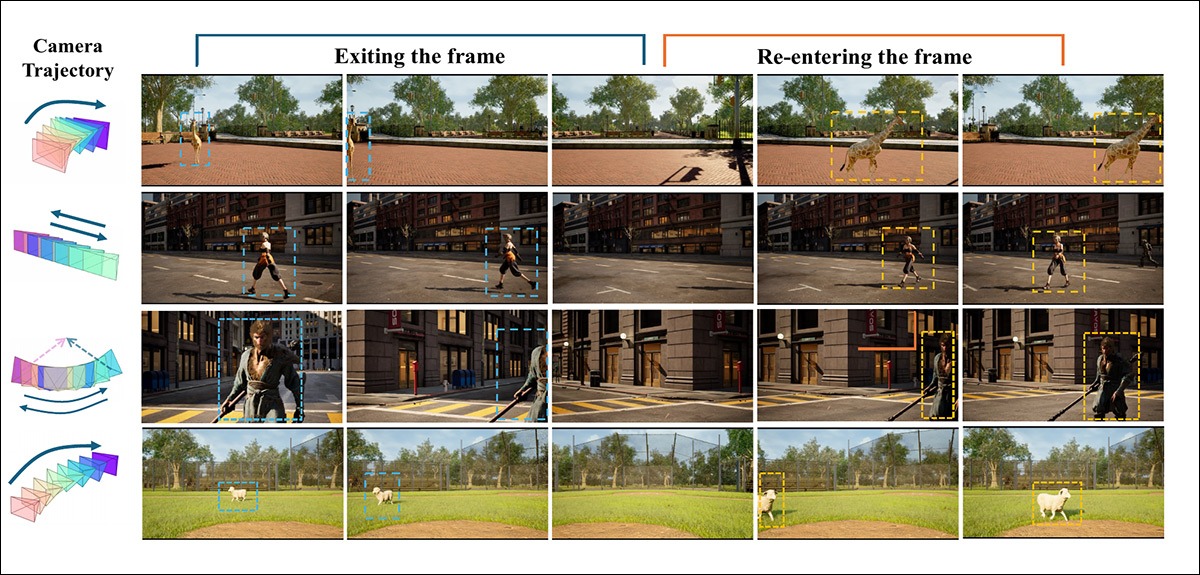

Beispiele für Kamerabewegungen beim Betreten und Verlassen des Bildausschnitts. In diesen Fällen ist es die Kamerabewegung, die bewirkt, dass die Figur den Bildausschnitt verlässt, aber in verschiedenen Beispielen können wir auch beobachten, wie sich die Figur selbst vorübergehend aus dem Bild bewegt. Quelle

Die Autoren weisen darauf hin, dass bei der Diffusion latent EinbettungenDie zu extrahierenden und zu verwendenden Merkmale sind stark verwickelt mit anderen Merkmalen und Eigenschaften; und der Versuch, diese zu extrahieren, führt oft dazu, dass das Motiv im Hintergrund „einfriert“. Daher entwickelten und kuratierten sie die HM-Welt Datensatz**, speziell für das Training von Hybridspeichern:

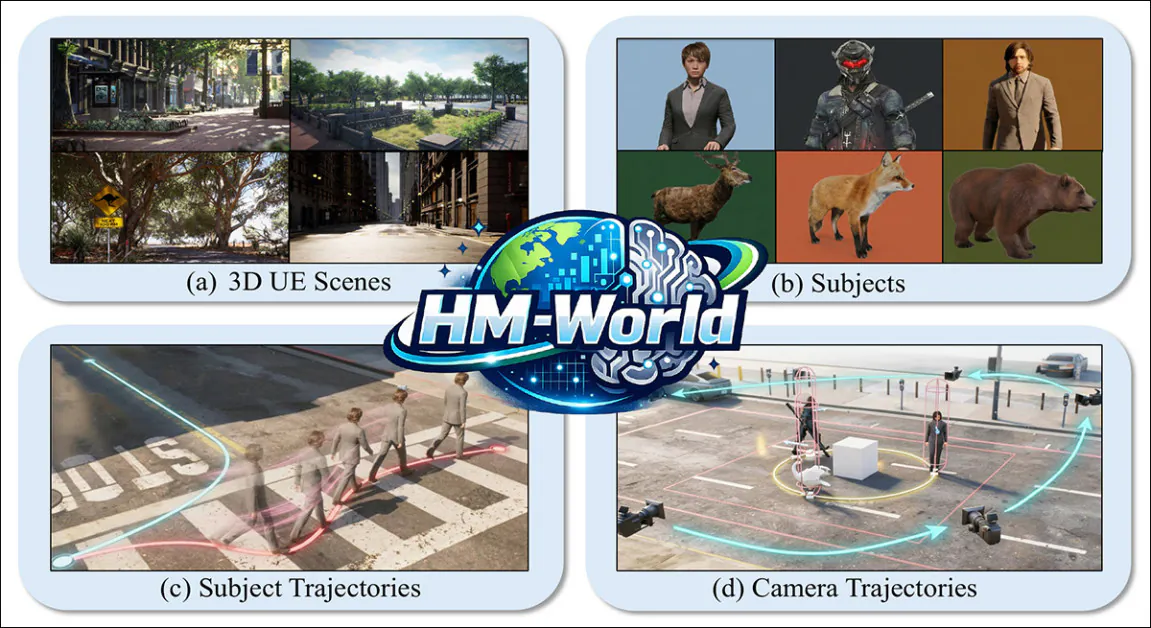

Aus dem Artikel stammen Beispiele aus den vier Kategorien des HM-World-Datensatzes.

Die Kollektion ist entlang vier Dimensionen aufgebaut: Subjekttrajektorien, Kamerabahnen, Szenenund Themen.

Die synthetische Daten HM-World umfasst 17 Szenen und 49 Objekte, darunter Menschen unterschiedlichen Aussehens sowie Tiere verschiedener Arten. Diese werden mithilfe der Unreal Engine prozedural in einer Szene platziert, jedes mit einer individuellen Bewegungsanimation, und anschließend auf eine zufällig ausgewählte Bahn gesetzt.

Die Autoren geben an, dass eine vielfältige Gruppe von Ausgang-Eingang Im Datensatz sind die Ereignisse dargestellt, wobei 28 verschiedene Kameratrajektorien enthalten sind, von denen jede mehrere Startpunkte aufweist.

Die endgültige Sammlung umfasst 59,225 Videoclips, die jeweils mit Anmerkungen versehen sind. MiniCPM-V Multimodales großes Sprachmodell (MLLM).

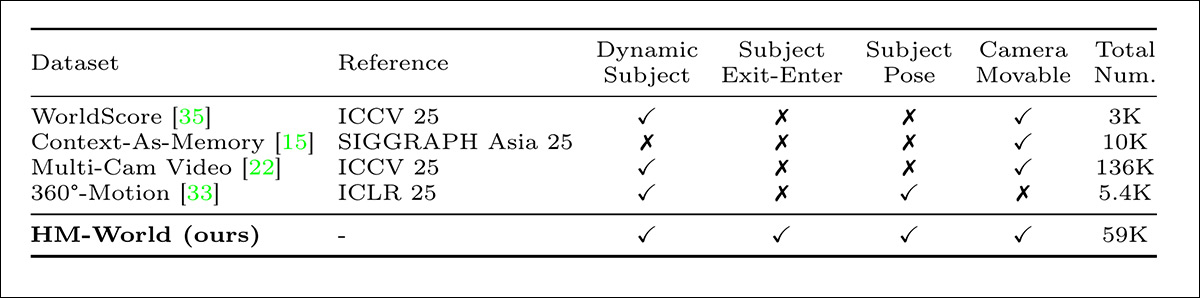

Die Forscher weisen auf die statistischen Vorteile ihrer Datensammlung gegenüber früheren Datensätzen hin. Weltscore; Kontext als Gedächtnis; Multi-Cam-Videoeschriebenen Art und Weise; und 360°-Bewegung:

Vergleich zwischen bestehenden Datensätzen und dem HM-World-Datensatz, wobei „Dynamic Subject“ das Vorhandensein von sich bewegenden Objekten anzeigt, „Subject Exit-Enter“ Clips bezeichnet, in denen Subjekte den Bildausschnitt verlassen und wieder betreten, und „Subject Pose“ sich auf die Einbeziehung annotierter 3D-Posen bezieht.

Der weniger begangene Weg

Ausgehend von mehreren vorherigen Einzelbildern und einem bekannten Kamerapfad besteht die Aufgabe darin, zukünftige Ansichten bei Perspektivwechsel des Betrachters vorherzusagen und dabei Objekte zu berücksichtigen, die sich unabhängig bewegen und den Bildausschnitt verlassen können, bevor sie wieder erscheinen. Dies erfordert mehr als nur einen stabilen Hintergrund, da das Modell auch eine konsistente interne Aufzeichnung des Aussehens und Verhaltens jedes sich bewegenden Objekts speichern muss, selbst wenn es nicht sichtbar ist.

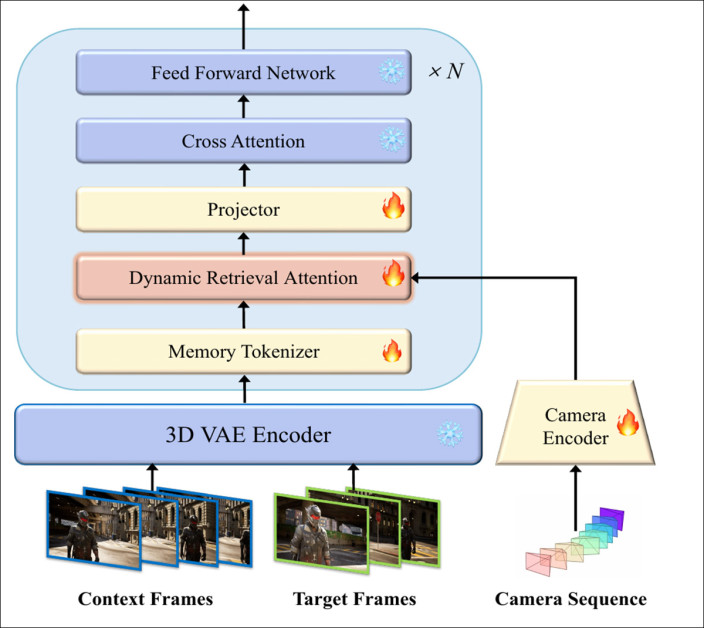

Die Autoren Hybride dynamische Abrufaufmerksamkeit Die (HyDRA)-Methode begegnet diesem Problem durch die Einführung eines dedizierten Speicherpfads, der dynamische Subjekte von der statischen Szenendarstellung trennt, sodass diese über die Zeit hinweg bestehen bleiben und mit konsistentem Erscheinungsbild und Bewegung wiederkehren können:

Konzeptionelles Schema für das HyDRA-Modell.

HyDRA ist aufgebaut auf Wan2.1-T2V-1.3B, wobei die zentrale Diffusionspipeline weitgehend intakt blieb, während eine modifizierte Transformator Ein Block, der dynamische Aufmerksamkeitsabrufe integriert. Dadurch kann das Modell Bewegungs- und Erscheinungsmerkmale aus früheren Frames selektiv abrufen, anstatt sich auf einen festen oder lokalen Kontext zu verlassen.

Dieser Prozess nutzt eine angepasste Flussanpassung Ausbildungsziel anstelle des Standards Diffusionsverlust.

Um die Szenen mit der Kamerabewegung in Einklang zu bringen, werden Kameratrajektorien als explizites Konditionierungssignal eingespeist, wobei die Pose jedes Einzelbildes durch Rotation und Translation definiert und anschließend in eine kompakte Darstellung umgewandelt wird, die erfasst, wie sich der Blickwinkel im Laufe der Zeit entwickelt.

In Übereinstimmung mit dem vorherigen (Kling) ReCamMaster Initiative, das Ergebnis wird dann vom Kamera-Encoder analysiert, der als implementiert ist Mehrschichtiges Perzeptrondann ausgestrahlt und hinzugefügt Diffusionstransformator Funktionen, die es dem Modell ermöglichen, die Objektplatzierung beizubehalten, während sich die Kamera bewegt.

Tokenisierung

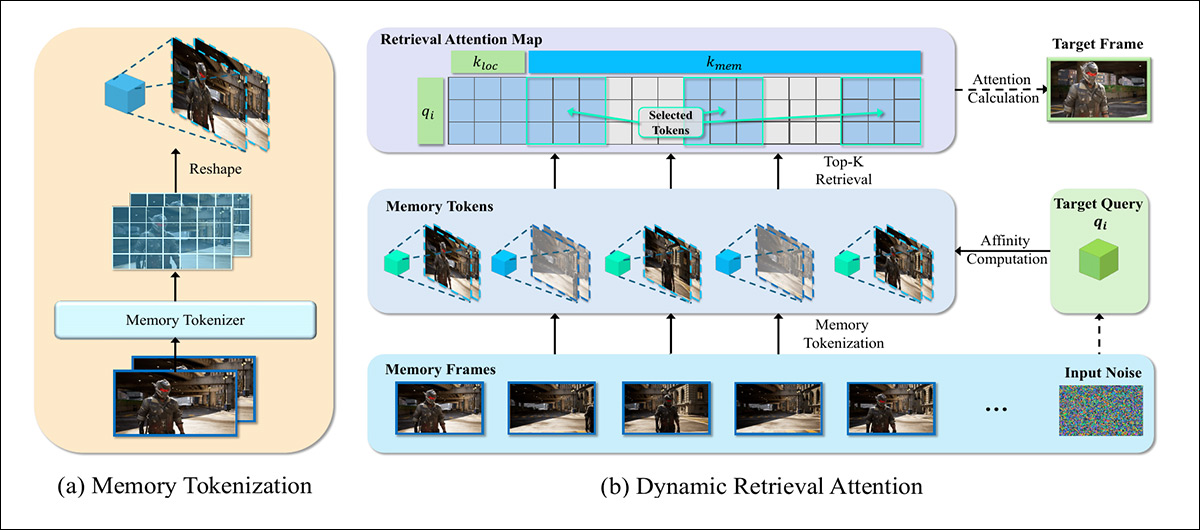

Rohe Diffusionslatenzen vermischen die Bewegung des Subjekts, sein Erscheinungsbild und den Hintergrund zu einer einzigen verschränkten Repräsentation. Der Versuch, direkt aus diesem Raum abzurufen, birgt die Gefahr, irrelevanten Kontext einzuführen oder dazu zu führen, dass sich bewegende Subjekte mit der Szenerie verschmelzen.

HyDRA begegnet diesem Problem mit einem auf 3D-Faltung basierenden Memory Tokenizer, der Raum und Zeit gemeinsam verarbeitet – anstatt vollständige latente Verläufe weiterzuleiten, komprimiert er sie zu kompakten, bewegungssensitiven Memory Tokens, die das Aussehen und die Bewegungen der Probanden bewahren:

Überblick über HyDRA. Links: Der Memory Tokenizer wandelt vergangene Frames in kompakte, bewegungssensitive Memory Tokens um; rechts: Dynamic Retrieval Attention wertet die aktuelle Anfrage anhand dieser Tokens aus, ruft die relevantesten ab und verwendet sie, um ein konsistentes Erscheinungsbild und eine konsistente Bewegung im generierten Frame wiederherzustellen.

Diese Token bilden einen strukturierten Hybridspeicher, der Störungen filtert und gleichzeitig die Dynamik über längere Zeiträume erhält. An das Modul „Dynamische Abrufaufmerksamkeit“ weitergeleitet, ermöglichen sie dem Modell, Objekte, die nicht im Bild zu sehen sind, selektiv abzurufen, sodass diese mit konsistentem Erscheinungsbild, Bewegung und Kontext wieder erscheinen.

Dynamische Abrufaufmerksamkeit

Der Dual-Memory-Mechanismus von HyDRA nutzt ebenfalls dynamische Abrufaufmerksamkeit in einer eigenständigen, aber komplementären Rolle innerhalb des Rahmens.

Die Tokenisierung des Speichers komprimiert latente Repräsentationen in strukturierte, bewegungssensitive Token, die dynamische Objekte von statischen Szeneninhalten trennen und so die Vermischung von Objekten mit dem Hintergrund reduzieren. Diese Token bilden einen persistenten Speicher anstelle einer vollständigen Bildhistorie.

Die dynamische Aufmerksamkeitsabfrage greift während der Generierung auf diesen Tokenpool zu, vergleicht die aktuelle Anfrage mit gespeicherten Token und ruft selektiv diejenigen ab, die für das sich entwickelnde Bild am relevantesten sind. Dadurch können sich Objekte außerhalb des Bildausschnitts weiterhin latent bewegen (z. B. weitergehen oder laufen, auch wenn sie nicht sichtbar sind) und mit konsistentem Erscheinungsbild und konsistenter Bewegung wieder erscheinen, wenn sie in den Bildausschnitt zurückkehren, anstatt zurückgesetzt oder beeinträchtigt zu werden.

Daten und Tests

In Tests kodierte und reduzierte das WAN-basierte HyDRA-System 77 Kontext-Frames, bevor es diese mit einem 3D Variational Autoencoder analysierte (VAE), während der zuvor erwähnte Speichertokenisierer verwendet wurde 3D-Faltung zu einem Kernelgröße aus 2x4x4.

Das Modell wurde auf HW-World über 10,000 Iterationen auf 32 (nicht näher spezifizierten) GPUs trainiert. Losgröße von 32.

In den Tests wurde eine ungewöhnlich hohe Anzahl von Metriken verwendet: neben dem üblichen Peak Signal-to-Noise Ratio (PSNR), Strukturähnlichkeitsindex (SSIM), und gelernte Metriken der wahrnehmungsbezogenen Ähnlichkeit (LIPS), verwendeten die Autoren auch Subjektkonsistenz und Hintergrundkonsistenz von der VBench Suite zur Bewertung der Kohärenz auf Frame-Ebene.

Darüber hinaus entwickelten sie eine benutzerdefinierte Kennzahl mit dem Titel Dynamische Subjektkonsistenz (DSC), das Begrenzungsrahmen von YOLO V11, um beschnittene Bereiche mit sich bewegenden Objekten zu erstellen, aus denen semantische Merkmale extrahiert und anschließend deren Ähnlichkeiten berechnet wurden.

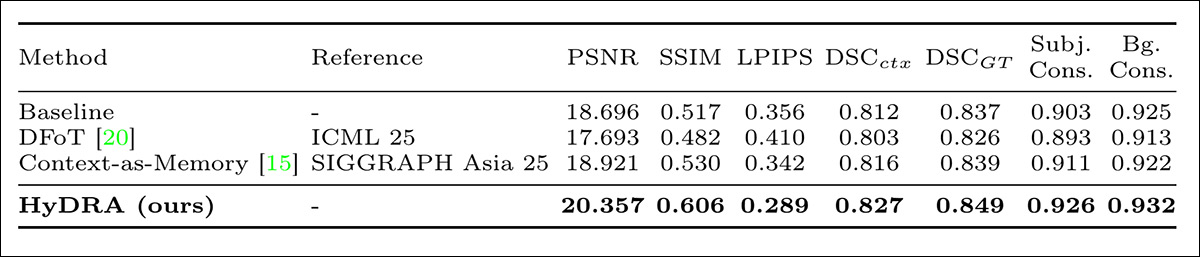

HyDRA wurde gegen Diffusionskrafttransformator (DFoT) und Kontext als Gedächtnis, gegenüber einem Basismodell vom Typ Wan2.1-T2V-1.3B, das mit einem Kamera-Encoder ausgestattet war (um die allen Clips gemeinsame subjektive Perspektive abzubilden). Alle Modelle wurden mit HW-World trainiert. WorldPlay wurde auch als Zero-Shot-Sammlung für sekundäre Tests verwendet:

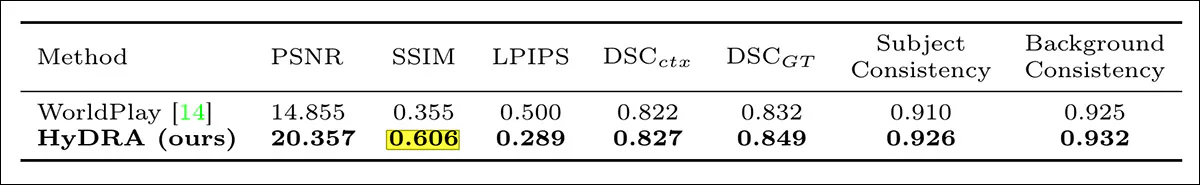

In ersten quantitativen Vergleichen übertraf HyDRA alle Vergleichsmodelle und steigerte den PSNR-Wert von 18.696 auf 20.357 sowie den SSIM-Wert von 0.517 auf 0.606. Es erzielte außerdem die höchsten Dice-Koeffizienten für Kontext und Ground Truth (0.827 bzw. 0.849), wobei die Konsistenz zwischen Subjekt und Hintergrund 0.926 bzw. 0.932 erreichte.

Ergebnisse des ersten quantitativen Vergleichs mit bisherigen Ansätzen.

DFoT erreichte einen PSNR-Wert von 17.693 und Context as Memory einen Wert von 18.921, wobei die Verbesserungen auf die Kombination von Memory-Tokenisierung und dynamischer Abrufaufmerksamkeit zurückzuführen sind:

Quantitativer Vergleich von HyDRA mit dem aktuellen Stand der Technik.

Bezüglich der Tests gegen WorldPlay erklären die Autoren:

„Unsere Methode übertrifft WorldPlay in allen Metriken, mit einem bemerkenswerten PSNR-Unterschied von 5.502. Obwohl WorldPlay bei GT-bezogenen Metriken (z. B. PSNR von 14.855, DSCGT von 0.832) aufgrund von Unterschieden in der Domänenverteilung und fehlender spezifischer Feinabstimmung eine geringere Leistung aufweist, zeigt es bei kontextbezogenen Metriken eine bemerkenswerte Robustheit, indem es einen DSCctx-Wert von 0.822 erreicht.“

„Diese Beobachtung bestätigt nicht nur, dass umfassend trainierte Modelle eine angemessene hybride Konsistenz aufweisen, sondern validiert indirekt auch die Rationalität unserer vorgeschlagenen DSC-Metriken hinsichtlich der Abbildung dynamischer Subjektkonsistenz.“

„Letztendlich unterstreichen diese beeindruckenden Ergebnisse die außergewöhnlichen Fähigkeiten unseres Modells und beweisen seine Überlegenheit selbst gegenüber etablierten kommerziellen Modellen.“

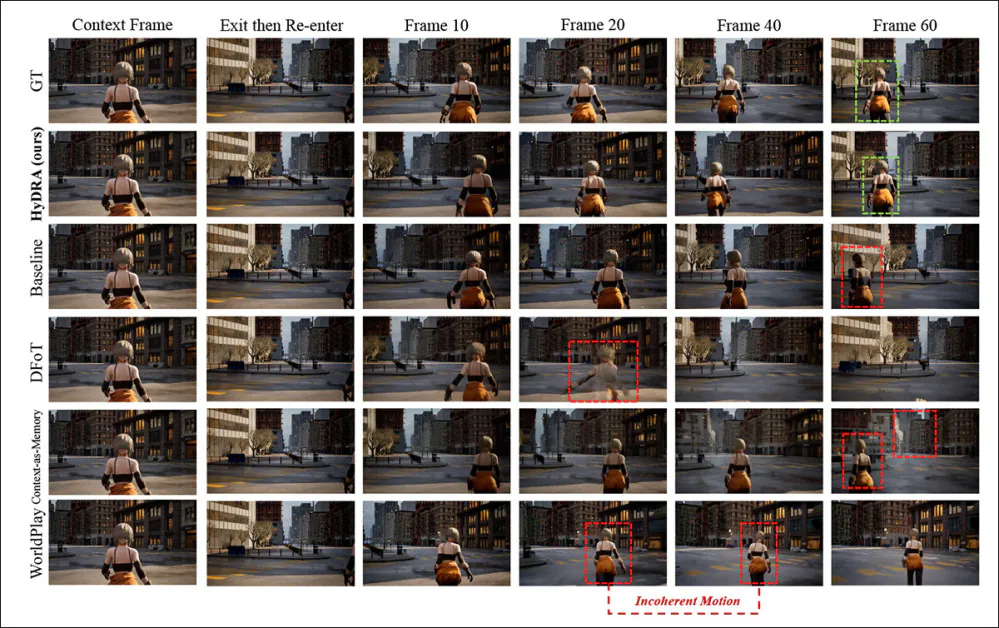

Die Arbeit bietet eine statische Darstellung der für die Tests durchgeführten qualitativen Vergleiche:

Qualitativer Vergleich von Verlassen und Wiedereintritt unter Kamerabewegung. Die Autoren argumentieren, dass HyDRA die Identität, Pose und Bewegungskontinuität der Person nach Verlassen und Wiedereintritt in den Bildausschnitt bewahrt und die tatsächliche Darstellung genau wiedergibt, während konkurrierende Methoden Drift, inkohärente Bewegungen oder eine Verschlechterung der Personendarstellung aufweisen, die rot hervorgehoben sind (konsistente Wiederherstellungen sind grün markiert).

Zu diesen Ergebnissen kommentieren die Autoren:

Bei komplexen Ein- und Austrittsvorgängen zeigen die Basislinien- und Kontext-als-Speicher-Modelle starke Verzerrungen des Subjekts und Bewegungsinkohärenzen. DFoT kann die Integrität des Subjekts nicht aufrechterhalten, was zu dessen vollständigem Verschwinden führt. WorldPlay bewahrt zwar die Konsistenz des Erscheinungsbilds des Subjekts, leidet aber unter ruckartigen Bewegungen und unnatürlichen Aktionen.

„Im Gegensatz dazu gewährleistet unsere Methode erfolgreich die hybride Konsistenz und bewahrt sowohl die Identität des Subjekts als auch die Bewegungskohärenz, nachdem das Subjekt wieder ins Bildfeld eintritt.“

Weitere Ergebnisse können im Videoformat angesehen werden unter die ergänzende WebsiteDie ersten vier Beispiele wurden (von uns) im folgenden Video zusammengestellt:

Anklicken um abzuspielen. Vier der sechs Testergebnisse wurden auf der Projektseite präsentiert. Quelle

Fazit

Obwohl jeder Versuch, eines der größten Probleme der KI-Videogenerierung anzugehen, begrüßenswert ist, scheint es mir unausweichlich, dass die optimale Lösung für Ausstiegs-/Wiedereintrittsprobleme dieser Art, wie es bei CGI der Fall war, in Form von separaten Referenzmaterialien liegen wird, die diskret bearbeitet und in einen Kompositionsbereich eingebracht werden können.

Dieses Unterfangen, eine Einbettung in einem System am Leben zu erhalten ad hoc Diese spontane Vorgehensweise wirkt anstrengend und bietet zudem keinen klaren Weg zu der Konsistenz innerhalb einer Aufnahme, die derzeit von verschiedenen Black-Box-Portalen wie Runway erreicht wird. Falls eine Folgeaufnahme Zugriff auf den latenten Speicher der vorherigen Aufnahme benötigt, warum platzieren dann nicht beide Instanzen eine separate und diskrete Zeicheneinbettung?

* Niemand sonst hat es benannt, und ohne gemeinsame Begriffe gestaltet sich die Diskussion schwierig.

** Derzeit wird auf der Projektseite angegeben, dass es "demnächst verfügbar" sein wird.

Erstveröffentlichung: Freitag, 27. März 2026