Kunstig intelligens

Hvorfor kan generative videosystemer ikke lave komplette film?

Fremkomsten og fremskridtet i generativ AI-video har ført til, at mange tilfældige iagttagere har forudsagt, at maskinlæringsalgoritmer vil vise sig at være døden for filmindustrien, som vi kender den – i stedet vil enkeltstående skabere kunne lave Hollywood-inspirerede blockbusterfilm hjemme, enten på lokale eller cloud-baserede GPU-systemer.

Er dette muligt? Selv hvis det er muligt, er det forestående, som så mange tror?

At enkeltpersoner til sidst vil kunne lave film, i den form, vi kender dem, med konsekvente karakterer, narrativ kontinuitet og total fotorealisme, er ret muligt – og måske endda uundgåeligt.

Der er dog flere grundlæggende årsager til, hvorfor dette ikke er sandsynligt at ske med videosystemer baseret på Latent Diffusionsmodeller.

Dette sidste faktum er vigtigt, fordi det på nuværende tidspunkt omfatter hver populær tekst-til-video (T2) og billed-til-video (I2V) system, herunder Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (og så vidt vi kan se, Adobe Fireflys forestående videofunktion); blandt mange andre.

Her overvejer vi muligheden for sande auteur fuldlængde gen-AI-produktioner, skabt af enkeltpersoner, med konsekvente karakterer, fotografering og visuelle effekter på mindst samme niveau som den nuværende tilstand i Hollywood.

Lad os kaste et blik på nogle af de største praktiske hindringer for udfordringerne.

1: Du kan ikke få en præcis efterfølgende optagelse

Narrativ inkonsistens er den største af disse hindringer. Kendsgerningen er, at ingen af de nu tilgængelige video-genererings-systemer kan lave en virkelig præcis ‘efterfølgende optagelse’*.

Dette skyldes, at denoising diffusion model i hjertet af disse systemer afhænger af tilfældigt støj, og denne kerneprincip er ikke egnet til at genfortolke præcis det samme indhold to gange (dvs. fra forskellige vinkler eller ved at udvikle den foregående optagelse til en efterfølgende optagelse, der opretholder konsistens med den foregående optagelse).

Hvor tekstpromptere bruges, alene eller sammen med uploadede ‘seed’-billeder (multimodal input), vil tokenene, der er afledt fra prompten, fremkalde semantisk passende indhold fra den trænede latente rum i modellen.

Men yderligere hindret af ’tilfældigt støj’-faktoren, vil det aldrig gøre det på samme måde to gange.

Dette betyder, at identiteterne af personer i videoen vil have tilbøjelighed til at skifte, og objekter og miljøer vil ikke matche den første optagelse.

Dette er hvorfor virale klip, der afbilder ekstraordinære visuelle effekter og Hollywood-niveau output, tenderer til at være enten enkelt optagelser eller en ‘showcase-montage’ af systemets evner, hvor hver optagelse viser forskellige karakterer og miljøer.

Uddrag fra en generativ AI-montage af Marco van Hylckama Vlieg – kilde: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Implikationen i disse samlinger af ad hoc video-genereringer (der kan være uærlig i tilfælde af kommercielle systemer) er, at det underliggende system kan skabe kontinuerte og konsekvente narrativer.

Analogien, der udnyttes her, er en film-trailer, der kun viser et minut eller to af filmen, men giver publikum grund til at tro, at hele filmen findes.

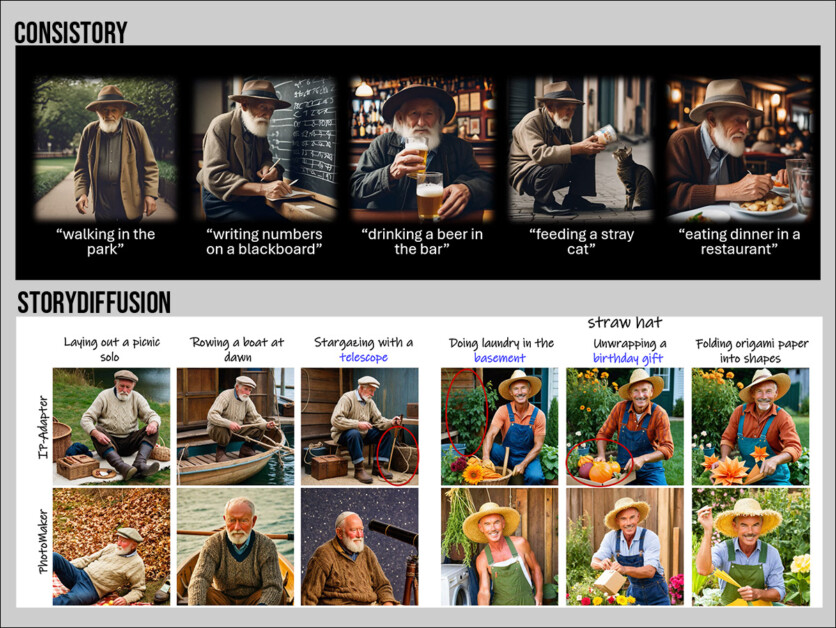

De eneste systemer, der i øjeblikket tilbyder narrativ konsistens i en diffusionsmodel, er dem, der producerer stille billeder. Disse inkluderer NVIDIA’s ConsiStory, og diverse projekter i den videnskabelige litteratur, såsom TheaterGen, DreamStory, og StoryDiffusion.

To eksempler på ‘statisk’ narrativ konsistens, fra nyere modeller:: Kilder: https://research.nvidia.com/labs/par/consistory/ og https://arxiv.org/pdf/2405.01434

I teorien kunne man bruge en bedre version af sådanne systemer (ingen af dem er virkelig konsistente) til at skabe en række billed-til-video-optagelser, der kunne sættes sammen til en sekvens.

Ved nuværende tilstand af kunsten producerer denne tilgang ikke plausiblen efterfølgende optagelser; og i hvert fald har vi allerede afviet fra auteur drømmen ved at tilføje et lag af kompleksitet.

Vi kan desuden bruge Low Rank Adaptation (LoRA) modeller, specifikt trænet på karakterer, ting eller miljøer, for at opretholde bedre konsistens på tværs af optagelser.

Men hvis en karakter ønsker at optræde i en ny dragt, skal en helt ny LoRA som regel trænes, der inkorporerer karakteren iført den pågældende dragt (selv om underbegreber som ‘rød kjole’ kan trænes ind i enkeltstående LoRAs, sammen med passende billeder, er de ikke altid lette at arbejde med).

Dette tilføjer betydelig kompleksitet, selv til en åbningscene i en film, hvor en person står op af sengen, tager en morgenkåbe på, gaber, kigger ud ad soveværelsesvinduet og går på badeværelset for at børste tænderne.

En sådan scene, der indeholder cirka 4-8 optagelser, kan filmes på en morgen ved konventionelle filmprocedurer; ved nuværende tilstand af kunsten i generativ AI, repræsenterer det potentielt uger af arbejde, multiple trænede LoRAs (eller andre hjælpe-systemer) og en betydelig mængde efterbehandling

Alternativt kan video-til-video bruges, hvor almindelig eller CGI-optagelser omdannes gennem tekst-promptere til alternative fortolkninger. Runway tilbyder sådant et system, for eksempel.

CGI (venstre) fra Blender, fortolket i en tekst-baseret Runway video-til-video-eksperiment af Mathieu Visnjevec – Kilde: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Der er to problemer her: du er allerede nødt til at skabe den primære optagelse, så du laver allerede filmen to gange, selv hvis du bruger et syntetisk system som UnReals MetaHuman.

Hvis du skaber CGI-modeller (som i klippet ovenfor) og bruger dem i en video-til-billede-transformation, kan deres konsistens på tværs af optagelser ikke regnes med.

Dette skyldes, at video-diffusionsmodeller ikke ser det ‘store billede’ – snarere skaber de en ny ramme baseret på tidligere rammer, og i nogle tilfælde, overvejer de en nærliggende fremtidig ramme; men, for at sammenligne processen med et skakspil, kan de ikke tænke ‘ti træk frem’ og kan ikke huske ti træk tilbage.

For det andet vil en diffusionsmodel stadig have svært ved at opretholde et konsekvent udseende på tværs af optagelserne, selv hvis du inkluderer multiple LoRAs for karakter, miljø og lysstil, af grundene nævnt i starten af dette afsnit.

Fixing It in Post

Der er andre mangler ved ren ‘enkel bruger’ AI-video-generering, såsom svigt de har i at afbilde hurtige bevægelser, og det generelle og langt mere presserende problem med at opnå temporal konsistens i output-videoen.

Desuden er det at skabe specifikke ansigtsudtryk næsten udelukkende et spørgsmål om held i generativ video, ligesom lip-sync til dialog.

I begge tilfælde er brugen af hjælpe-systemer som LivePortrait og AnimateDiff blevet meget populær i VFX-fællesskabet, da dette tillader overførslen af i hvert fald bredt ansigtsudtryk og lip-sync til eksisterende genereret output.

Et eksempel på udtryks-overførsel (drivende video i nederste venstre hjørne) påført en mål-video med LivePortrait. Videoen er fra Generative Z TunisiaGenerative. Se den fuldlængde-version i bedre kvalitet på https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Yderligere er der en myriade af komplekse løsninger, der inkorporerer værktøjer som Stable Diffusion GUI ComfyUI og det professionelle komponerings- og manipulationsprogram Nuke, samt latent rum-manipulation, der giver AI-VFX-praktikerne større kontrol over ansigtsudtryk og disposition.

Selv om han beskriver processen med ansigtsanimation i ComfyUI som ‘pinlig’, har VFX-professionel Francisco Contreras udviklet en sådan procedure, der tillader påførslen af lip-fonemer og andre aspekter af ansigts-/hoved-afbildning

Stable Diffusion, hjulpet af en Nuke-drevet ComfyUI-arbejdsgang, tillod VFX-pro Francisco Contreras at opnå usædvanlig kontrol over ansigts-aspekter. For den fulde video, i bedre opløsning, gå til https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Konklusion

Ingenting af dette er lovende for udsigten til, at en enkelt bruger kan generere kohærent og fotorealistisk blockbuster-lignende fuldlængde-film med realistisk dialog, lip-sync, præstationer, miljøer og konsistens.

Desuden er de hindringer, der er beskrevet her, i hvert fald i forhold til diffusions-baserede generative video-modeller, ikke nødvendigvis løselige ‘lige om et øjeblik’ nu, på trods af forum-kommentarer og medie-opmærksomhed, der gør dette tilfælde. De begrænsninger, der er beskrevet her, synes at være intrinsic til arkitekturen.

I AI-syntese-forskning, ligesom i al videnskabelig forskning, skinner brillante ideer periodisk os med deres potentiale, kun for yderligere forskning at afsløre deres fundamentale begrænsninger.

I generativ/syntese-rummet er dette allerede sket med Generative Adversarial Networks (GANs) og Neural Radiance Fields (NeRF), der begge ultimately viste sig at være meget svære at instrumentaliserer til performante kommercielle systemer, på trods af års akademisk forskning i den retning. Disse teknologier viser nu mest op som hjælpe-komponenter i alternative arkitekturer.

Ligesom filmstudier måske håber, at træning på lovligt licenserede filmkataloget kunne eliminere VFX-kunstnere, tilføjer AI faktisk roller til arbejdsstyrken på nuværende tidspunkt.

Om diffusions-baserede video-systemer virkelig kan forvandles til narrativt-konsistente og fotorealistiske film-genererings-systemer, eller om hele sagen blot er endnu et alkymistisk forsøg, burde blive tydeligt inden for de næste 12 måneder.

Det kan være, at vi har brug for en helt ny tilgang; eller det kan være, at Gaussian Splatting (GSplat), der blev udviklet i starten af 1990’erne og for nylig er taget af i billed-syntese-rummet, repræsenterer en potentiel alternativ til diffusions-baseret video-generering.

Da GSplat tog 34 år at komme til fremme, er det muligt, at ældre konkurrenter som NeRF og GANs – og selv latent diffusionsmodeller – endnu ikke har haft deres dag.

* Kaibers AI Storyboard-funktion tilbyder denne type funktionalitet, men resultaterne, jeg har set, er ikke produktionsekvalitet.

Martin Anderson er tidligere chef for videnskabelig forskningsindhold hos metaphysic.ai

Først udgivet mandag, 23. september 2024