Andersons vinkel

AI-video perfekterer katte-selvfoto

AI-video-genereringsværktøjer giver ofte resultater, der er tæt på, men ikke helt, hvad der ønskes i forhold til at levere, hvad tekst-prompten ønskede. Men en ny højniveaufix gør alle forskellen.

Generative videosystemer har ofte svært ved at lave videoer, der er virkelig kreative eller vilde, og ofte leverer de ikke op til brugernes tekst-prompt-forventninger.

En del af årsagen til dette er entanglement – det faktum, at vision/sprog-modeller må gå på kompromis med, hvor længe de træner på deres kilde-data. For lidt træning, og koncepterne er fleksible, men ikke fuldt udformede – for meget, og koncepterne er nøjagtige, men ikke længere fleksible nok til at inkorporere i nye kombinationer.

Du kan få ideen fra videoen nedenfor. Til venstre er den slags kompromis, som mange AI-systemer leverer i svaret på en krævende prompt (prompten er øverst i videoen i alle fire eksempler), der beder om en sammenstilling af elementer, der er for fantastisk til at have været et rigtigt trænings eksempel. Til højre er en AI-udgang, der holder bedre fast i prompten:

Klik for at afspille (ingen lyd). Til højre ser vi ‘factorized’ WAN 2.2, der virkelig leverer på prompterne, i sammenligning med de vagt fortolkninger af ‘vanilla’ Wan 2.2, til venstre. Se venligst kildevideo-filerne for bedre opløsning og mange flere eksempler, selvom de kuraterede versioner, der ses her, ikke findes på projektets website, og er samlet til denne artikel. Kilde

Det er tydeligt, at eksemplerne til højre holder bedre fast i den oprindelige tekst-prompt end dem til venstre.

Interessant nok er begge arkitekturer grundlæggende den samme arkitektur – den populære og meget kapable Wan 2.2, en kinesisk udgave, der har vundet betydelig ground i det åbne kilde- og hobbyist-miljø i år.

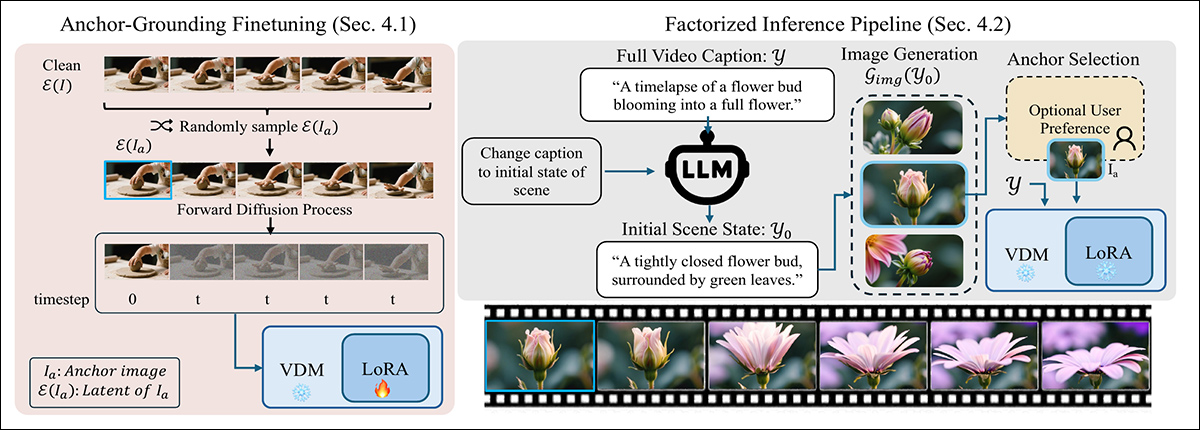

Forskellen er, at den anden generative pipeline er factorized, hvilket i dette tilfælde betyder, at et stort sprogmodel (LLM) er blevet brugt til at genfortolke den første (seed) ramme af videoen, så det vil være meget lettere for systemet at levere, hvad brugeren beder om.

Dette ‘visuelle ankering’ indebærer at indsprøjte et billede, der er fremstillet fra dette LLM-forbedrede prompt, i den generative pipeline som en ‘start-ramme’, og bruge en LoRA-fortolkende model til at hjælpe med at integrere ‘indtrængende’ rammen i video-opsætningsprocessen.

Resultaterne, i forhold til prompt-trofasthed, er ret bemærkelsesværdige, især for en løsning, der synes ret elegant:

Klik for at afspille (ingen lyd). Yderligere eksempler på ‘factorized’ video-genereringer, der virkelig holder fast i manuskriptet. Se venligst kildevideo-filerne for bedre opløsning og mange flere eksempler, selvom de kuraterede versioner, der ses her, ikke findes på projektets website, og er samlet til denne artikel.

Denne løsning kommer i form af den nye artikel Factorized Video Generation: Decoupling Scene Construction and Temporal Synthesis in Text-to-Video Diffusion Models, og dens video-ladende ledsagende projekt-website.

Mens mange nuværende systemer forsøger at forbedre prompt-nøjagtighed ved at bruge sprogmodeller til at omskrive vagt eller underbestemt tekst, argumenterer den nye artikel for, at denne strategi stadig fører til fejl, når modellens interne scene-repræsentation er fejl.

Selv med en detaljeret omskrevet prompt, tekst-til-video-modeller ofte miscomposer nøgle-elementer eller genererer inkompatible initiale tilstande, der bryder logikken i animationen. Så længe den første ramme ikke afspejler, hvad prompten beskriver, kan den resulterende video ikke genoprettes, uanset hvor god motion-modellen er.

Artiklen siger*:

‘[Tekst-til-video]-modeller producerer ofte distributionelt forskudt rammer, men opnår alligevel [evaluerings-score] sammenlignelige med I2V-modeller, hvilket indikerer, at deres motion-modellering forbliver rimeligt naturlig, selv når scene-trofasthed er relativt dårlig.

‘[Billede-til-video]-modeller viser det komplementære adfærd, stærke [evaluerings-score] fra nøjagtige initiale scener og svagere temporal koherens, mens I2V+tekst balancerer begge aspekter.

‘Denne kontrast antyder en struktural mismatch i nuværende T2V-modeller: scene-grounding og temporal syntese fordelene fra distinkte inductive bias, men eksisterende arkitekturer forsøger at lære begge samtidigt inden for en enkelt model.’

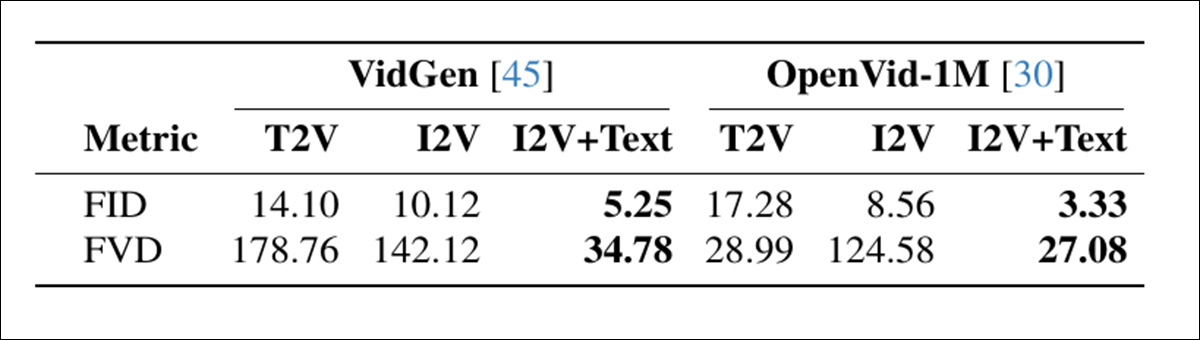

En diagnostisk sammenligning af generations-tilstande fandt, at modeller uden eksplizit scene-ankring scorede godt på motion, men ofte kompromitterede på scene-layout, mens billed-konditionerings-tilgange viste det modsatte mønster:

Sammenligning af video-generations-tilstande på to datasæt, der viser, at I2V+tekst opnår den bedste ramme-kvalitet (FID) og temporal koherens (FVD), og fremhæver fordelene ved at adskille scene-konstruktion fra motion. Kilde

Disse fund peger på en struktural fejl, hvor nuværende modeller forsøger at lære både scene-layout og animation på én gang, selv om de to opgaver kræver forskellige typer induktiv bias, og håndteres bedre separat.

Måske er det mest interessante, at denne ‘trick’ potentielt kan anvendes på lokale installationer af modeller som Wan 2.1 og 2.2, og lignende video-diffusions-modeller som Hunyuan Video. Anekdotisk set ligner kvaliteten af hobbyist-udgang meget den kommercielle generative portals som Kling og Runway, og de fleste af de større API-udbydere synes at forbedre åbne kilde-tilbud som WAN med LoRAs, og – det ser ud til – med tricks af samme type som set i den nye artikel.

Test af metoden indikerer, at denne simple og modulære tilgang tilbyder en ny state-of-the-art på T2V-CompBench-benchmarket, og forbedrer alle testede modeller betydeligt. Forfatterne bemærker i konklusion, at selv om deres system radikalt forbedrer trofasthed, adresse det ikke (og er ikke designet til at adresse) identitets-drift, der i øjeblikket er generativ AI-forsknings største udfordring.

Den nye artikel kommer fra fire forskere ved Ecole Polytechnique Fédérale de Lausanne (EPFL) i Schweiz.

Metode og Data

Den centrale proposition i den nye teknik er, at tekst-til-video (T2V)-diffusions-modeller skal ‘ankres’ til start-rammer, der virkelig passer til den ønskede tekst-prompt.

For at sikre, at modellen respekterer start-rammen, forstyrer den nye metode den standard diffusion-proces ved at indsprøjte en ren latent fra anchor-billedet ved tidsrum nul, og erstatter en af de sædvanlige støj-input. Denne ukendte input forvirrer modellen til at starte med, men med minimal LoRA finjustering, lærer den at behandle den indsprøjtede ramme som en fast visuel anchor snarere end en del af støj-trafikken:

To-trins metode til at grundlægge tekst-til-video-generering med en visuel anchor: Venstre, modellen er finjusteret ved hjælp af en letvægts LoRA til at behandle en indsprøjet ren latent som en fast scene-begrænsning. Højre, prompten er delt op i en første-ramme-underskrift, der bruges til at generere anchor-billedet, der guider videoen.

Ved inferens, omskriver metoden prompten til kun at beskrive kun den første ramme, ved hjælp af et LLM til at trække en plausibel initial scene-tilstand, der fokuserer på layout og udseende.

Denne omskrevne prompt overføres til en billed-generator til at producere en kandidat-anchor-ramme (der kan valgfrit være forbedret af brugeren). Den valgte ramme er kodet ind i en latent og indsprøjet i diffusions-processen ved at erstatte den første tidsrum, og giver modellen mulighed for at generere resten af videoen mens den forbliver ankret til den initiale scene – en proces, der fungerer uden at kræve ændringer i den underliggende arkitektur.

Processen blev testet ved at oprette LoRAs for Wan2.2-14B, Wan2.1-1B, og CogVideo1.5-5B. LoRA-træningen blev udført med en rang på 256, på 5000 tilfældigt-valgte klip fra UltraVideo-samlingen.

Træningen varede 6000 trin, og krævede 48 GPU-timer† for Wan-1B og CogVideo-5B, og 96 GPU-timer for Wan-14B. Forfatterne bemærker, at Wan-5B naturligt understøtter tekst-kun og tekst-billede-betingelser (der i dette tilfælde påføres til de ældre rammer), og derfor ikke krævede nogen fuld finjustering.

Test

I de eksperimenter, der blev kørt for processen, blev hver tekst-prompt først forbedret ved hjælp af Qwen2.5-7B-Instruct, der brugte resultatet til at generere en detaljeret ‘seed-billede’-underskrift, der indeholdt en beskrivelse af hele scenen. Dette blev derefter overført til QwenImage, der blev bedt om at generere ‘magi-rammen’ til at blive indsprøjet i diffusions-processen.

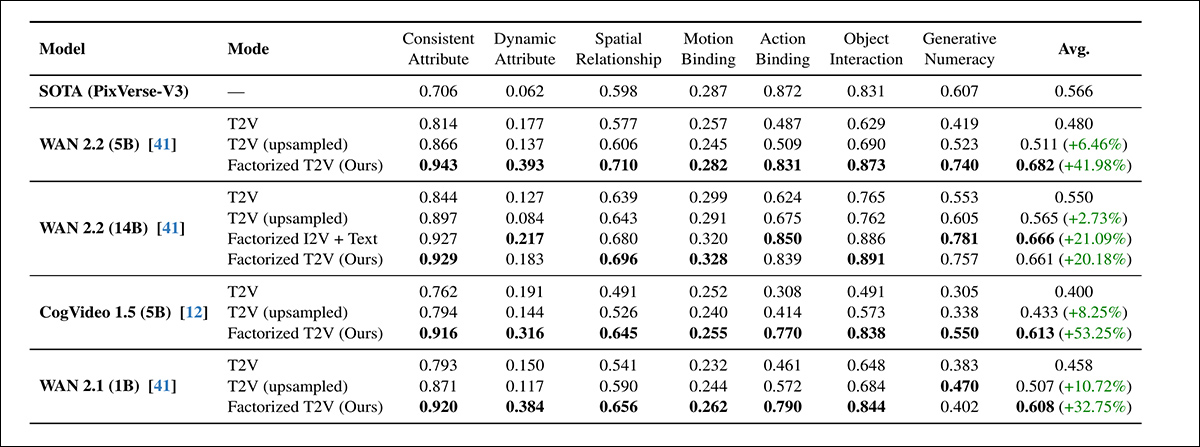

Benchmarkene, der blev brugt til at evaluere systemet, omfattede den ovennævnte T2V-CompBench, til test af kompositionel forståelse ved at score, hvor godt modellerne bevarede objekter, attributter og handlinger inden for en koherent scene; og VBench 2.0, til at evaluere bredere fornuft og konsistens på tværs af 18 metrikker, grupperet i kreativitet, almindelig fornuft, kontrollabilitet, menneskelig trofasthed, og fysik:

På tværs af alle syv evaluering-kategorier i T2V-CompBench, overgik den factorizede T2V-metode både standard- og opskalerede T2V-baselines for hver testet model, med gevinster op til 53,25%. De højest scorende varianter matchede eller overgik ofte den proprietære PixVerse-V3-benchmark.

Med hensyn til denne første runde af test, siger forfatterne*:

‘[Over] alle modeller, tilføjer en anchor-billede konsekvent forbedrer kompositionelle præstationer. Alle mindre factorizede modeller (CogVideo 5B, Wan 5B og Wan 1B) overgår den større Wan 14B T2V-model.

‘Vores factorizede Wan 5B overgår også den kommercielle PixVerse-V3-baseline, der er den bedste rapporterede model på benchmarket. Dette demonstrerer, at visuel grundlæggelse væsentligt forbedrer scene- og handling-forståelse, selv i mindre kapacitets-modeller.

‘Inden for hver model-familie, overgår den factorizede version den oprindelige model. Bemærkelsesværdigt, vores letvægts-ankret LoRA på WAN 14B når en præstation, der er sammenlignelig med dens forudtrænede I2V 14B-variant (0,661 vs. 0,666), uden at kræve nogen fuld gen-træning.’

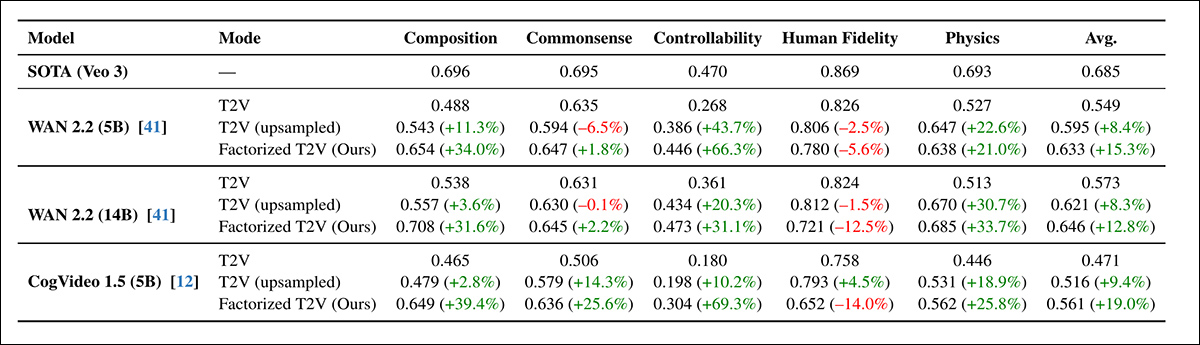

Derefter fulgte VBench2.0-runden:

Den factorizede T2V-tilgang forbedrer konsekvent VBench 2.0-præstation på tværs af komposition, almindelig fornuft, kontrollabilitet og fysik, med nogle gevinster, der overstiger 60% – selv om menneskelig trofasthed forblev under den proprietære Veo 3-baseline.

På tværs af alle arkitekturer, forbedrede den factorizede tilgang score i hver VBench-kategori undtagen menneskelig trofasthed, der let faldt, selv med prompt-opskalerings. WAN 5B overgik den større WAN 14B, og forstærkede tidligere T2V-CompBench-resultater, der viste, at visuel grundlæggelse bidrog mere end skala.

Gevinsterne på VBench var konsekvente, men mindre end dem, der blev set på T2V-CompBench, og forfatterne tilskriver dette til VBench’s strengere binære score-regime.

For de kvalitative test, leverer artiklen statiske billeder, men vi henviser læseren til de sammensatte videoer, der er indlejret i denne artikel, for en klarere idé, med den betingelse, at kilde-video-filerne er mere talrige og diverse, såvel som havende større opløsning og detaljer. Find dem her. Med hensyn til kvalitative resultater, siger artiklen:

‘Ankrede videoer viser konsekvent mere præcis scene-komposition, stærkere objekt-attribute-binding og klarere temporal progression.’

Den factorizede metode forblev stabil, selv når antallet af diffusions-trin blev reduceret fra 50 til 15, og viste næsten ingen præstations-tab på T2V-CompBench. Til gengæld degraderede både tekst-kun og opskalerede baselines skarpt under de samme betingelser.

Selv om reduktion af trin teoretisk kunne tredoble hastigheden, blev den fulde generations-pipeline kun 2,1 gange hurtigere i praksis, på grund af faste omkostninger fra anchor-billede-generering. Alligevel viste resultaterne, at ankering ikke kun forbedrede præstations-kvalitet, men også hjalp med at stabilisere diffusions-processen, og understøttede hurtigere og mere effektiv generering uden tab i nøjagtighed.

Projektets website tilbyder eksempler på opskalerede vs. nye metode-genereringer, af hvilke vi tilbyder et par (lavere opløsning) redigerede eksempler her:

Klik for at afspille (ingen lyd). Opskalerede start-kilder vs. forfatternes factorizede tilgang.

Forfatterne konkluderer:

‘Vore resultater antyder, at forbedret grundlæggelse, snarere end øget kapacitet alene, kan være lige så vigtigt. Seneste fremskridt i T2V-diffusion har været afhængige af at øge model-størrelse og trænings-data, men selv store modeller kæmper ofte for at slutte en koherent initial scene fra tekst alene.

‘Dette kontrasterer med billed-diffusion, hvor skalaering er relativt ligetil; i video-modeller må hver arkitektonisk forbedring operere over en ekstra temporal dimension, hvilket gør skalaering væsentligt mere ressource-intensiv.

‘Vore fund antyder, at forbedret grundlæggelse kan supplere skala ved at adresse en anden flaskehals: etablering af den korrekte scene, før motion-syntese begynder.

‘Ved at factorisere video-generering i scene-konstruktion og temporal modellering, formindsker vi flere almindelige fejl-tilfælde uden at kræve væsentligt større modeller. Vi ser på dette som en komplementær design-princippet, der kan guide fremtidige arkitekturer mod mere pålidelig og struktureret video-syntese.’

Konklusion

Selv om problemerne med entanglement er meget reelle, og kan kræve dedikeret løsninger (såsom forbedret curation og distributions-evaluering før træning), har det været en øjenåbner at se, hvordan factorisering ‘unglue’ flere stubberne og ‘fastlåste’ koncept-prompt-orkestreringer til langt mere nøjagtige gengivelser – med kun en moderat lag af LoRA-betingelse, og intervention af en bemærkelsesværdigt forbedret start-/seed-billede.

Kløften i ressourcer mellem lokale hobbyist-inferens og kommercielle løsninger kan ikke være så enorm, som antaget, da næsten alle udbydere søger at rationalisere deres betydelige GPU-resurse-udlæg til forbrugerne.

Anekdotisk set ligner en meget stor del af den nuværende krop af generative video-udbydere at bruge brandede og generelt ‘forbedrede’ versioner af kinesiske FOSS-modeller. Den primære ‘moat’, som disse ‘mellemlænd’-systemer synes at have, er, at de har taget sig tid til at træne LoRAs, eller også – til en større omkostning, og en større belønning – faktisk har gennemført en fuld finjustering af model-vægtene††.

Indsigter af denne type kan hjælpe med at lukke denne kløft yderligere, i konteksten af en udgivelsesscene, hvor kineserne synes at være fast besluttede (ikke nødvendigvis af altruistiske eller idealistiske årsager) på at demokratisere gen AI, hvorimod vestlige forretningsinteresser måske hellere ser, at øget model-størrelse og reguleringer til sidst lukker alle virkelig gode modeller bag API’er og multiple lag af indhold-filtre.

* Forfatterens betoning, ikke min.

† Artiklen specificerer ikke, hvilken GPU der blev valgt, eller hvor mange der blev brugt.

†† Selv om LoRA-ruten er mere sandsynlig, både på grund af økonomisk letbrug og fordi de fulde vægte, snarere end kvantificerede vægte, ikke altid er tilgængelige.

Først udgivet fredag, den 19. december 2025