Andersons vinkel

Tilføjelse af dialog til rigtige videoer med AI

En ny AI-ramme kan omskrive, fjerne eller tilføje en persons ord i en video uden omoptagelse, i et enkelt slut-/slut-system.

For tre år siden ville internettet have været chokeret over enhver af de 20-30 AI-video-ændringsrammer, der offentliggøres på akademiske portaler hver uge; som det er, er denne populære forskningsstrøm nu blevet så produktiv, at den næsten udgør en ny gren af ‘AI-Slop’, og jeg dækker langt færre af disse udgivelser end jeg ville have for to eller tre år siden.

Men en aktuel udgivelse i denne linje fik min opmærksomhed: Et integreret system, der kan gribe ind i rigtige videooptagelser og indsætte ny tale i den eksisterende video (i stedet for at oprette en hel genereret klip fra et ansigt eller en ramme, hvilket er langt mere almindeligt).

I eksemplerne nedenfor, som jeg har redigeret sammen fra en mængde af samplevideoer, der er tilgængelige på udgivelsens projektwebsite, ser vi først den rigtige kildeklip, og derefter, under den, den påtvungne AI-tale i midten af klippet, herunder talesyntese og læbestemning:

Klik for at afspille. Lokal redigering med syning – en af flere modaliteter, der tilbydes af FacEDiT. Se venligst kildewebsite for bedre opløsning. Kilde – https://facedit.github.io/

Denne tilgang er en af tre, der er udviklet til den nye metode, denne med titlen ‘lokal redigering med syning’, og den, der interesserer forfatterne (såvel som mig) mest. Essentielt set udvides klippet ved at bruge en af de midterste rammer som udgangspunkt for ny AI-tolkning, og dens efterfølgende (rigtige) ramme som et mål, som den genererede indsættede klip skal sigte mod at matche op til. I de ovennævnte klip er disse ‘frø’- og ‘mål’-rammer repræsenteret af den øverste video, der standser, mens den ændrede video nedenfor giver genereret infill.

Forfatterne rammer denne ansigts- og vokalsyntese-tilgang som den første fuldt integrerede slut-/slut-metode til AI-video-redigering af denne art, og observerer potentialet for en fuldt udviklet ramme som denne for TV- og filmproduktion:

‘Filminstruktører og medieproducenter har ofte brug for at revidere bestemte dele af optagede videoer – måske var et ord udtalt forkert eller manuskriptet ændret efter optagelse. For eksempel i den ikoniske scene fra Titanic (1997), hvor Rose siger, “Jeg vil aldrig slippe dig, Jack,” ville instruktøren måske senere beslutte, at det skulle være “Jeg vil aldrig glemme dig, Jack”.

‘Traditionelt set kræver sådanne ændringer, at hele scenen optages på ny, hvilket er kostbart og tidskrævende. Talesyntese tilbyder en praktisk alternativ ved automatisk at ændre ansigtsbevægelse for at matche den reviderede tale, og eliminerer behovet for genoptagelse.’

Selv om AI-indgreb af denne art kan møde kulturelle eller brancheresistens, kan de også udgøre en ny type funktionalitet i menneskeledede VFX-systemer og værktøjsamlinger. I hvilket som helst tilfælde er udfordringerne for øjeblikket strengt tekniske.

Ud over at udvide et klip gennem yderligere AI-genereret dialog, kan det nye system også ændre eksisterende tale:

Klik for at afspille. Et eksempel på at ændre eksisterende dialog i stedet for at indsætte yderligere dialog. Se venligst kildewebsite for bedre opløsning.

Tilstand af kunsten

Der er for øjeblikket ingen slut-/slut-systemer, der tilbyder denne type syntese-funktion; selv om en voksende mængde af generative AI-platforme som Google’s Veo-serie kan generere audio, og diverse andre rammer kan oprette deepfaked audio, skal man nu oprette en ret kompliceret pipeline af diverse arkitekturer og tricks for at kunne gribe ind i rigtig footage på den måde, som det nye system – titlen FacEDiT – kan opnå.

Systemet bruger Diffusion Transformers (DiT) i kombination med Flow Matching til at oprette ansigtsbevægelser, der er betinget af omgivende (kontekstuelle) bevægelser og taleaudioindhold. Systemet udnytter eksisterende populære pakker, der beskæftiger sig med ansigtsrekonstruktion, herunder LivePortrait (nyligt overtaget af Kling).

Ud over denne metode, da deres tilgang er den første til at integrere disse udfordringer i en enkelt løsning, har forfatterne oprettet en ny benchmark kaldet FacEDiTBench, samt flere helt nye evalueringsskalaer, der er egnet til denne meget specifikke opgave.

Det nye arbejde er titlen FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, og kommer fra fire forskere på Koreas Pohang University of Science and Technology (POSTECH), Korea Advanced Institute of Science & Technology (KAIST) og The University of Texas at Austin.

Metode

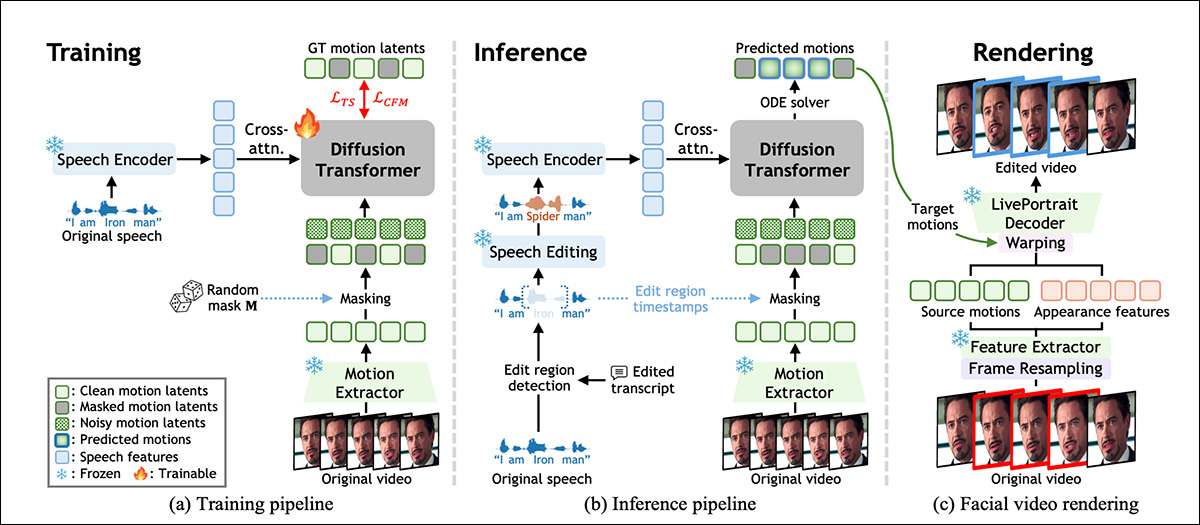

FacEDiT er trænet til at rekonstruere ansigtsbevægelse ved at lære, hvordan man kan udfylde manglende dele af en skuespillers oprindelige præstation, baseret på den omgivende bevægelse og taleaudioen. Som vist i schemaet nedenfor, giver denne proces modellen mulighed for at fungere som en gap-fylder under træning, og forudsiger ansigtsbevægelser, der matcher stemmen, mens den holder sig konsekvent med den oprindelige video:

Oversigt over FacEDiT-systemet, der viser, hvordan ansigtsbevægelse læres gennem selv-supervised infilling under træning, guidet af redigeret tale under slutning, og endelig renderes tilbage til video ved at genbruge udseendet af den oprindelige footage, mens kun den målrettede bevægelse erstattes. Kilde

Ved slutningstidspunktet understøtter den samme arkitektur to forskellige outputs, afhængigt af, hvor meget af videoen der er maskeret: delvise redigeringer, hvor kun en sætning ændres, og resten forbliver urørt; eller fuld-sætningsgenerering, hvor ny bevægelse syntetiseres helt fra scratch.

Modellen er trænet via flow matching, som behandler video-redigeringer som en slags sti mellem to versioner af ansigtsbevægelse.

I stedet for at lære at gætte, hvordan et redigeret ansigt skal se ud fra scratch, lærer flow matching at bevæge sig gradvist og jævnt mellem en støjfyldt placeholder og den korrekte bevægelse. For at facilitere dette repræsenterer systemet ansigtsbevægelse som en kompakt samling af tal, der er udtrukket fra hver ramme ved hjælp af en version af den ovennævnte LivePortrait-system (se schema ovenfor).

Disse bevægelsesvektorer er designede til at beskrive udtryk og hovedstilling uden at binde identitet, så taleændringer kan lokaliseres uden at påvirke personens overordnede udseende.

FacEDiT-Træning

For at træne FacEDiT blev hver videooptagelse delt op i en række af ansigtsbevægelsessnapshots, og hver ramme parret med den tilsvarende del af audioen. Tilfældige dele af bevægelsesdataene blev derefter skjult, og modellen bedt om at gætte, hvordan de manglende bevægelser skulle se ud, ved hjælp af både tale og omgivende umaskerede bevægelse som kontekst.

Fordi de maskerede span og deres positioner varierer fra den ene trænings eksempel til den anden, lærer modellen gradvist, hvordan man kan håndtere både små interne redigeringer og længere huller til fuld-sætningsgenerering, afhængigt af, hvor meget information den får.

Systemets ovennævnte Diffusion Transformer lærer at genskabe maskeret bevægelse ved at forfine støjfyldte inputs over tid. I stedet for at føde tale og bevægelse ind i modellen på én gang, trådes audioen ind i hver behandlingsblok gennem cross-attention, hvilket hjælper systemet med at matche læbebevægelser mere præcist til audio-talen.

For at bevare realisme over redigeringer er opmærksomhed biaset mod nærliggende rammer i stedet for hele tidslinjen, hvilket tvinger modellen til at fokusere på lokal kontinuitet og forhindrer flimren eller bevægelsesspring i kanten af ændrede områder. Positionelle indlejring (der fortæller modellen, hvor hver ramme vises i sekvensen) hjælper yderligere med at opretholde naturlig tidsmæssig flow og kontekst.

Under træning lærer systemet at forudsige manglende ansigtsbevægelse ved at rekonstruere maskerede span baseret på tale og nær omgivende umaskeret bevægelse. Ved slutningstidspunktet genbruges dette samme setup, men med maskerne nu guidet af redigeringer i tale.

Når et ord eller en sætning indsættes, fjernes eller ændres, lokaliserer systemet det berørte område, maskerer det og regenererer bevægelse, der matcher den nye audio. Fuld-sætningsgenerering behandles som en specialtilfælde, hvor hele området maskeres og syntetiseres fra scratch.

Data og tests

Systemets bagben består af 22 lag for Diffusion Transformer, hver med 16 attention heads og feedforward-dimensioner på 1024 og 2024px. Bevægelses- og udseendesfunktioner udtrækkes ved hjælp af frosne LivePortrait-komponenter, og tale kodificeres via WavLM og ændret ved hjælp af VoiceCraft.

En dedikeret projekteringsskikt mapper de 786-dimensionale talefunktioner ind i DiT’s latente rum, med kun DiT og projekteringsskiktet trænet fra scratch.

Træning blev udført under AdamW-optimeringen ved en mål-læringsrate på 1e-4, i en million skridt, på to A6000-GPU’er (hver med 48GB VRAM), ved en samlet batch-størrelse på otte.

FacEDiTBench

FacEDiTBench-datasættet indeholder 250 eksempler, hver med en videooptagelse af den oprindelige og redigerede tale, og transskriptionerne for begge. Videoerne kommer fra tre kilder, med 100 klip fra HDTF, 100 fra Hallo3, og 50 fra CelebV-Dub. Hver af dem blev manuelt kontrolleret for at bekræfte, at både audioen og videoen var tydelige nok til evaluering.

GPT-4o blev brugt til at revidere hver transskription for at oprette grammatisk gyldige redigeringer. Disse reviderede transskriptioner, samt den oprindelige tale, blev sendt til VoiceCraft for at producere ny audio; og på hvert trin blev både transskriptionen og den genererede tale manuelt gennemgået for kvalitet.

Hver prøve blev mærket med redigeringstypen, tidspunktet for ændringen og længden af den ændrede span, og redigeringer klassificeret som indsættelser, sletninger eller erstatninger. Antallet af ord, der blev ændret, varierede fra korte redigeringer på 1-3 ord, medium-redigeringer på 4-6 ord og længere redigeringer på 7-10 ord.

Tre brugerdefinerede målinger blev defineret for at evaluere redigeringens kvalitet. Fotometrisk kontinuitet, for at måle, hvor godt lyset og farven af en redigeret sektion blander sig med den omgivende video, ved at sammenligne pixel-niveau-forskelle ved grænserne; bevægelseskontinuitet, for at vurdere konsistensen af ansigtsbevægelse, ved at måle optisk flow-ændringer over redigerede og uredigerede rammer; og identitetsbevarelse, for at estimere, om subjektets udseende forbliver konsekvent efter redigering, ved at sammenligne ansigts-embedding fra den oprindelige og genererede sekvenser ved hjælp af ArcFace-ansigtsgenkendelsesmodellen.

Tests

Testmodellen blev trænet på materiale fra de tre ovennævnte datasæt, i alt omkring 200 timers videoindhold, herunder vlogs og film, samt højopløsnings-YouTube-videoer.

For at evaluere taleansigtsredigering blev FacEDiTBench brugt, samt HDTF-testsplit, der er blevet en standard for benchmarking for denne samling af opgaver.

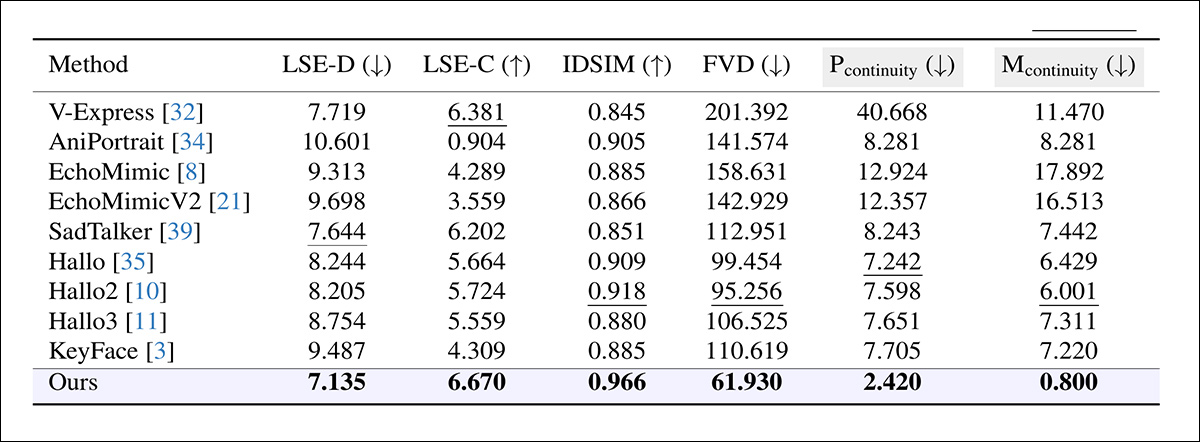

Da der ikke var direkte sammenlignelige systemer, der kunne indkapsle denne type slut-/slut-funktion, valgte forfatterne en række rammer, der reproducerede mindst nogle af den ønskede funktionalitet, og som kunne fungere som baseline; navnlig KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; og SadTalker.

Flere etablerede målinger blev også brugt til at evaluere genererings- og redigeringens kvalitet, med læbestemningsnøjagtighed vurderet gennem SyncNet, rapportering både den absolutte fejl mellem læbebevægelser og audio (LSE-D) og en tillidsvurdering (LSE-C); Fréchet Video Distance (FVD) kvantificerer, hvor realistisk videoen ser ud i det hele taget; og Lærte Perceptuelle Lighedsmål (LPIPS), der måler perceptuel lighed mellem genererede og originale rammer.

For redigering blev alle målinger undtagen LPIPS kun anvendt på den ændrede sektion; for generering blev hele videoen vurderet, med grænsekontinuitet ekskluderet.

Hver model blev bedt om at syntetisere en tilsvarende video-sektion, der derefter blev indsættet i den oprindelige klip (forskerne bemærker, at denne metode ofte introducerede synlige diskontinuiteter, hvor den redigerede sektion mødte den omgivende footage). En anden tilgang blev også testet, hvor hele videoen blev regenereret fra den ændrede audio – men dette overskrev uundgåeligt uredigerede områder og fik ikke bevaret den oprindelige præstation:

Sammenligning af redigeringens præstation over systemer, der oprindeligt er designede til taleansigtsgenerering, med FacEDiT, der overgår alle baseline-målinger over alle målinger, opnår lavere læbestemningsfejl (LSE-D), højere synkroniserings-tillidsvurdering (LSE-C), stærkere identitetsbevarelse (IDSIM), større perceptuel realisme (FVD) og glattere overgange over redigeringsgrænser (Pcontinuity, Mcontinuity). Gråtonede kolonner fremhæver de vigtigste kriterier for vurdering af grænsens kvalitet; fed og understreget værdi indikerer den bedste og andenbedste resultat, respectively