Andersons vinkel

Sletning af objekter og personer fra video med AI

Nej, barnet bliver ikke i billedet, hvis AI har noget at sige.

Fjernelse af personer og objekter fra billeder og video er en populær understrøm af forskning i VFX-centreret AI-litteratur, med en voksende mængde dedikerede datasæt og rammer, der adresserer udfordringen. Den seneste af disse, fra Institute of Big Data ved Kinas Fudan University, er EffectErase, et ‘effekt-bevidst’ videoobjektsfjernelsessystem, som forfatterne hævder, forbedrer mærkbart på den aktuelle tilstand i tests:

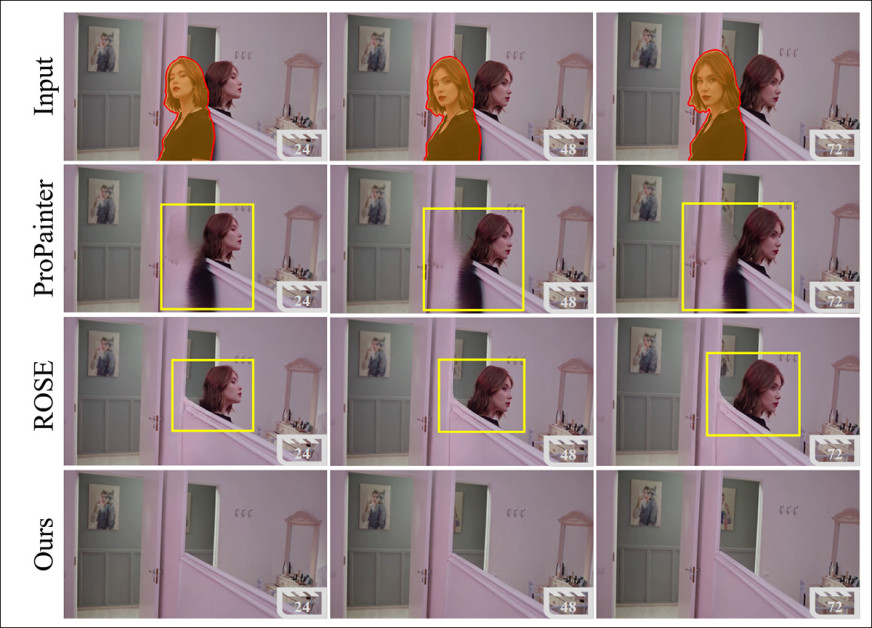

Sammenstillet fra materiale på projektets website, eksempler på EffectErase-metoden (venligst bemærk, at selvom vi tilbyder et link, indeholder kilde-sitet så mange hi-res og ikke-optimerede autoplay-videoer, at det kan påvirke stabiliteten af din webbrowser. Den tilhørende YouTube-video er en lettere og fuldstændigere reference og er indlejret i slutningen af denne artikel). Kilde

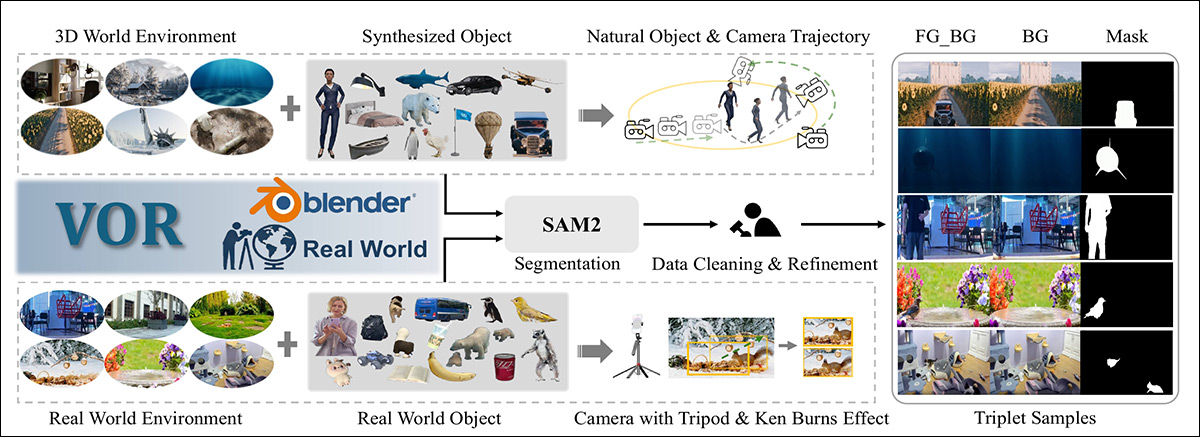

Det nye arbejde involverede oprettelse/kurering af et semi-nyt datasæt, der består af næsten 350 originale virkelige og syntetiske scener (ved hjælp af offentlige repositories*), enten optaget med dedikeret udstyr eller hentet og genbrugt i en arbejdsgang bygget omkring det open source Blender 3D-ramme.

Det hybride Video Object Removal (VOR)-datasæt danner grundlag for EffectErase-applikationen selv, som er bygget over Wan2.1-video-genereringssystemet. Systemet definerer også to nye relaterede benchmarks: VOR Eval og VOR Wild – henholdsvis for prøver med og uden ground truth.

(Selvom artiklen har en tilhørende projekt-side, er det ret overbelastet med multiple hi-res-videoer og svært at indlæse; så venligst henvis til de uddrag, jeg har kurateret i den indlejrede video ovenfor, hvis du finder projekt-siden svær at bruge)

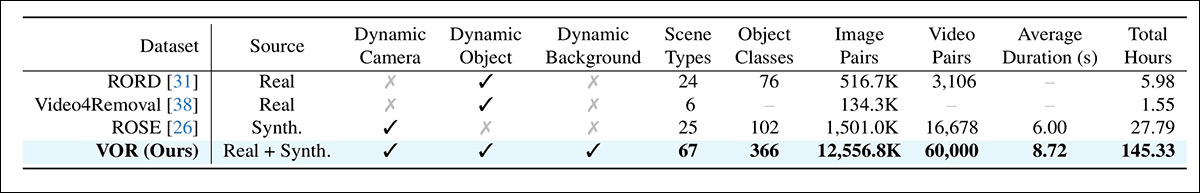

En sammenligning af mængder på tværs af sammenlignelige tidligere datasæt, i forhold til det nye tilbud. Kilde

Forskerne hævder, at deres tilgang giver state-of-the-art-præstation, både i kvantitative metrikker og i kvalitative resultater, som fastslås gennem en menneskestudie.

De bemærker, at tidligere arbejder ikke altid har lykkes i at fjerne bifaldende effekter af et objekt, såsom skygger og reflekser, og at deres datasæt er blevet omhyggeligt oprettet for at rette op på denne mangel:

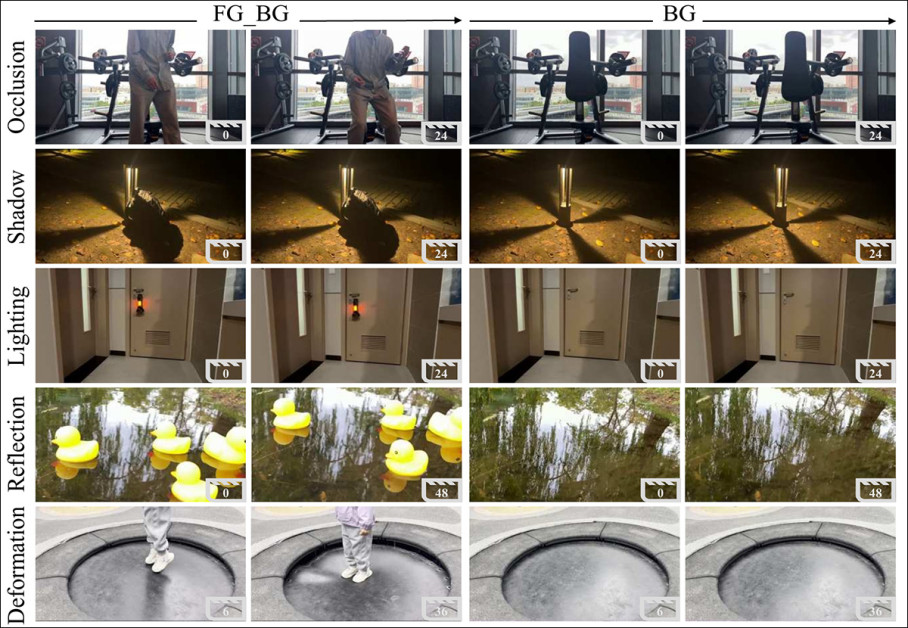

Eksempler på tidligere tilganges fiasko i at se beyond the objekt, der søgeres fjernet, til sekundære indikationer, såsom reflekser og skygger.

Den nye artikel er titlen EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing, og kommer fra fire forskere ved Fudan Universitys College of Computer Science and Artificial Intelligence.

Metode

Det hybride VOR-datasæt var designet til at omfatte en bred nok række scener, så det dækker alle implikationerne af at forsøge at fjerne en person eller et objekt fra en video:

Parrede rammer fra VOR-datasættet illustrerer, hvordan objekt-fjernelse må udvides beyond the synlige emne til dets inducerede effekter, med eksempler, der viser occlusion, skygge, lysændringer, reflekser og fysisk deformation, hver præsenteret som input (objekt til stede) sammen med den tilsvarende rene baggrund efter fjernelse. For yderligere eksempler, se den tilhørende YouTube-video indlejret i slutningen af denne artikel.

De fem repræsentative typer af ‘interferens’, der skal behandles, defineres af forfatterne som occlusion, herunder forskellige typer af glas og røgocclusion; skygger; lys (for eksempel, når et objekt, der skal fjernes, skaber eller ændrer lysvejen); refleksion; og deformation (for eksempel, aftrykket af en bruger på en pude, som ikke skal overleve personens fjernelse).

Datasætskonstruktionspipeline for VOR, der kombinerer Blender-genererede syntetiske scener med virkelige optagelser, hvor syntetisk data er bygget fra kuraterede 3D-miljøer, objekter og kamera-traektorier, og virkeligt footage optaget på tværs af diverse scener, suppleret med Ken Burns-bevægelse. SAM2-segmentering og manuel finjustering producerer derefter alignede forgrunds- og baggrundsvideo-tripletter med tilsvarende masker.

For de virkelige originale data brugte forskerne faste kameraer til at optage ‘med’ og ‘uden’ scener, der dækker en bred vifte af miljøer, tid på dagen og vejrforhold.

For de syntetiske data blev multiple viewpoints renderet, og multi-objekt-scenarier oprettet, der indeholdt bevidst komplekse og udfordrende typer af kamera-bevægelse, som kunne optræde i virkelige optagelser; og forskerne bemærker, at denne tilgang er mere sofistikeret og krævende end den, der blev brugt til det ellers lignende Remove Objects with Side Effects in Videos (ROSE) datasæt.

For at øge bevægelsesdiversitet blev Ken Burns-effekten anvendt på kamera-optagede par, hvilket tilføjede kontrollerede pans, zoom og let håndholdt bevægelse under fjorten foruddefinerede regler, med fem bevægelsesmønstre pr. par, mens croppen blev holdt inden for den originale ramme.

Skala og diversitet blev yderligere udvidet ved at kombinere syntetiske objekter med multiple kamera-opstillinger. Masker blev genereret ved at placere manuelle punkt-prompter på nøgle-rammer, propagere segmentering med Segment Anything 2 (SAM2), rense og finjustere resultaterne og samle validerede forgrunds-, baggrunds- og mask-tripletter til træning.

Den endelige samling omfatter 145 timers video på tværs af 60.000 parrede videoer, virkelige og syntetiske, der dækker 366 objekt-klasser i 443 scener.

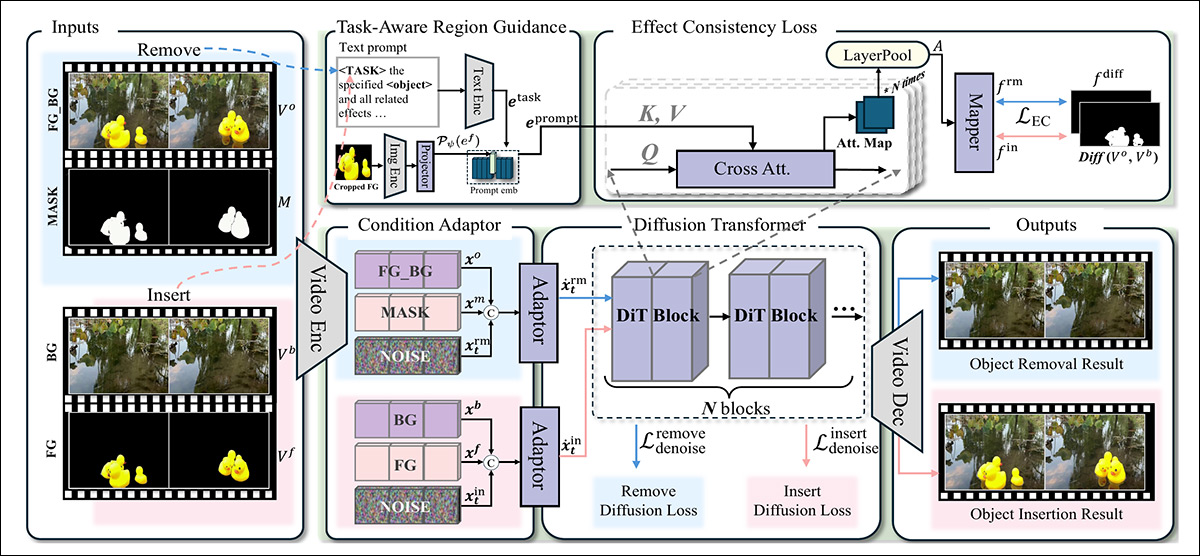

EffectErase-netværket selv indtager materiale via en Variational Auto-Encoder (VAE†), med latent støj-håndtering håndteret af Wan2.1. Over denne ryggrad opererer EffectErase Removal-Insertion Joint Learning, som træner begge opgaver sammen på de samme områder; Task-Aware Region Guidance (TARG), som bruger objekt- og opgave-token med cross-attention til at modellere rumlige og tidsmæssige sammenhænge mellem objekter og deres effekter og tillade opgave-skift; og Effect Consistency Loss, som aligner effekt-områder aligneret på tværs af fjernelse- og indsættelse-opgaver:

Schema for EffectErase-rammen. Under træning bliver parrede videoer kodet til et fælles latent rum, fusioneret med støj og behandlet af en diffusionstransformer guidet af task-aware cross-attention, mens en effekt-konsistens-tab alignerer fjernelse- og indsættelse-områder, så begge opgaver fokuserer på det samme område.

I sig selv er fjernelse- og indsættelse-processerne trænet sammen, ved hjælp af en fælles diffusion-ryggrad, så modellen lærer at fokusere på de samme berørte områder og strukturelle hints.

Videoer med objekter, baggrunds-videoer og masker bliver først kodet til et latent rum; støj bliver derefter tilføjet for diffusionstræning, og modellen lærer at genskabe rene repræsentationer under opgave-specifik guidning. En letvægts-adapter fusionerer derefter de støjende funktioner med fjernelse- eller indsættelse-betingelser, hvilket tillader begge opgaver at dele supervision, mens de forbliver kontrollerbare.

Task-Aware Region Guidance skaber en opgave-specifik signal ved at kombinere sprog-token med visuelle funktioner ekstraheret fra forgrunds-objektet, ved hjælp af CLIP, erstatter en generisk objekt-token med en indlejring afledt fra det faktiske billedindhold. Denne fusede repræsentation injiceres i ryggraden gennem cross-attention, hvilket tillader modellen at spore, hvordan et objekt og dets visuelle effekter udvikler sig over rum og tid, mens det tillader fleksibelt skift mellem fjernelse og indsættelse.

Effect Consistency Loss tvinger fjernelse- og indsættelse-processer til at fokusere på de samme ændrede områder, da begge opgaver handler om det samme objekt og dets visuelle effekter. Attention-kort fra hver gren kombineres til bløde region-kort og aligneres med en forskels-kort beregnet fra objekt- og baggrunds-videoer, så subtile ændringer som lys og skygger bevares. Denne ekstra tab hjælper indsættelse med at guide fjernelse og holder begge opgaver konsistente.

Data og tests

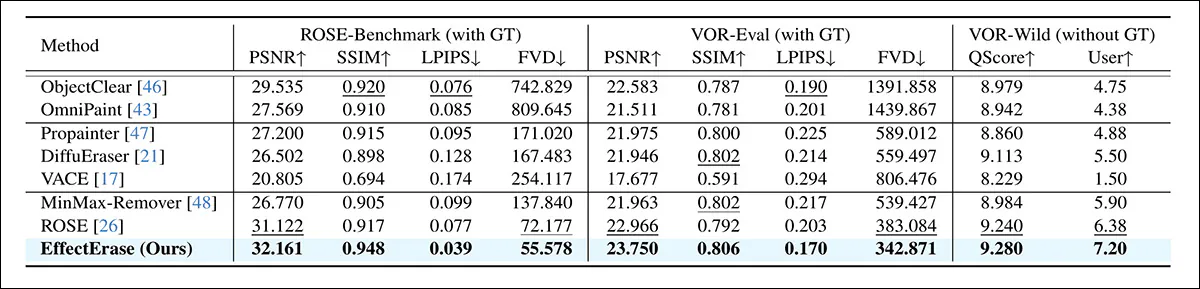

Forskerne testede deres tilgang mod forskellige inpainting-, video-inpainting- og objekt-fjernelse-metoder: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; og MiniMax-Remover.

Wan2.1 blev finjusteret med LoRA†† ved hjælp af VOR-datasættet i en opløsning på 832x480px. 81 på hinanden følgende rammer (den effektive grænse for WAN, ud over hvilken fejl tendrer til at optræde) blev tilfældigt udvalgt til træning, som fandt sted i 129.000 iterationer med en batch-størrelse på 8, på otte H100-GPU’er, hver med 80GB VRAM. Læringsraten blev sat til 1×102, og LoRA-rang til 256.

Den ROSE-Benchmark syntetiske samling var den eneste eksterne datasæt, der blev testet; de to andre var VOR-Eval, VOR-datasættets test split; og VOR-Wild, en test-sæt bestående af 195 virkelige videoer skrabet fra internettet, der viser ‘dynamiske objekter’.

Metrikker, der blev brugt, var Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Learned Perceptual Image Patch Similarity (LPIPS); og Fréchet Video Distance (FVD). En brugerstudie af 195 genererede videoer fra VOR-Wild blev også overvejet, med gennemsnitlige vurderinger fra 20 frivillige taget i betragtning.

Derudover udviklede forfatterne QScore, en metrik, der udnytter Qwen-VL multimodale model, for at evaluere kvaliteten af objekt-fjernet video-udgang, i forhold til resterende artefakter eller manglende miljø-fjernelse, såsom skygger og lys-effekter:

Kvantitativ sammenligning på ROSE og VOR-benchmark, med bedste og næstbedste resultater vist i fed og understreget, henholdsvis.

Med hensyn til disse resultater bemærker forfatterne:

‘[Aktuelle] billed-inpainting-metoder opererer på enkelt-rammer ved hjælp af 2D-modeller uden tidsmæssig modellering, og derfor ikke kan opretholde tidsmæssig konsistens i videoer.

Seneste video-inpainting [metoder] ikke eksplicit modellerer objekt-side-effekter, hvilket resulterer i unaturlige fjernelses-resultater. Eksisterende video-objekt-fjernelse [metoder] mangler rumlige og tidsmæssige korrelations-modellering mellem objektet og dets side-effekter, og producerer derfor ofte artefakter og resterende spor af de fjernede objekter.

‘Samlet set opnår EffectErase state-of-the-art-præstation på tværs af alle datasæt og evaluering-metrikker. Det opnår de bedste score på video-kvalitets-metrikken FVD, hvilket demonstrerer overlegen tidsmæssig glatthed og konsistens af de genererede videoer.

‘Vores metode opnår også den højeste QScore og bruger-tilbagemeldings-vurderinger, hvilket yderligere demonstrerer dets effektivitet i at producere visuelt overbevisende fjernelses-resultater.’

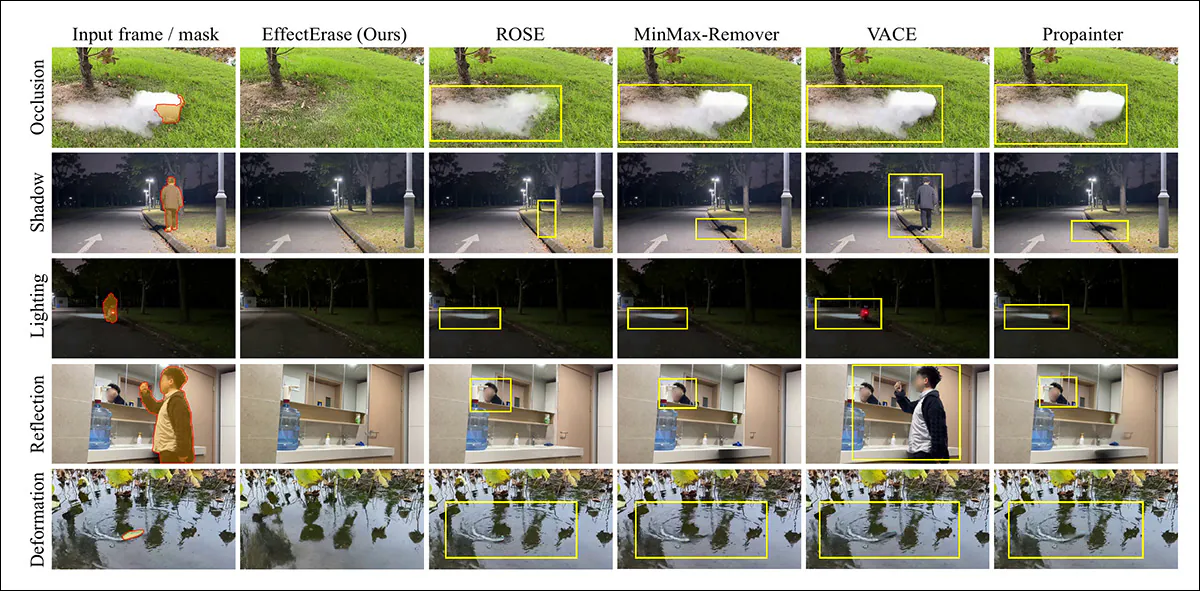

For den kvalitative evaluering tilbydes statiske resultater i artiklen (vist) lige under, samt mobile resultater, der er tilgængelige på projekt-siden og den tilhørende YouTube-video-præsentation:

Kvalitativ sammenligning på VOR-Eval på tværs af occlusion, skygge, lys, refleksion og deformation-tilfælde. Inpainting-metoder kæmper for at fjerne effekter uden for masken, mens fjernelse-modeller ofte efterlader synlige artefakter. EffectErase fjerner både mål-objektet og dets associerede effekter mere renligt. Venligst henvis til kilde-artiklen for bedre opløsning, og til projekt-siden for video-eksempler.

Vi henviser også læseren til diverse relaterede eksempler på projekt-siden, præsenteret nedenfor, samt den officielle YouTube-video indlejret i slutningen af denne artikel:

Klik for at afspille. Et sammenlignings-eksempel fra EffectErase-projekt-siden. Venligst henvis til siden for bedre opløsning (med de nævnte forbehold) og for yderligere eksempler.

Forfatterne bemærker:

‘Video-inpainting [metoder] producerer ofte artefakter i maskerede områder og kan ikke fuldstændigt fjerne side-effekterne, der skyldes de fjernede objekter. Tidligere objekt-fjernelse-tilgange, såsom [ROSE] og [MinMax-Remover], fungerer godt i at fjerne mål-objekter, men kæmper stadig med side-effekter, især i occlusion, skygge, lys, refleksion og deformation-scenarier.

‘Til gengæld fjerner EffectErase både mål-objektet og dets associerede effekter, hvilket resulterer i rene, kohærente og høj-kvalitets-udgang.

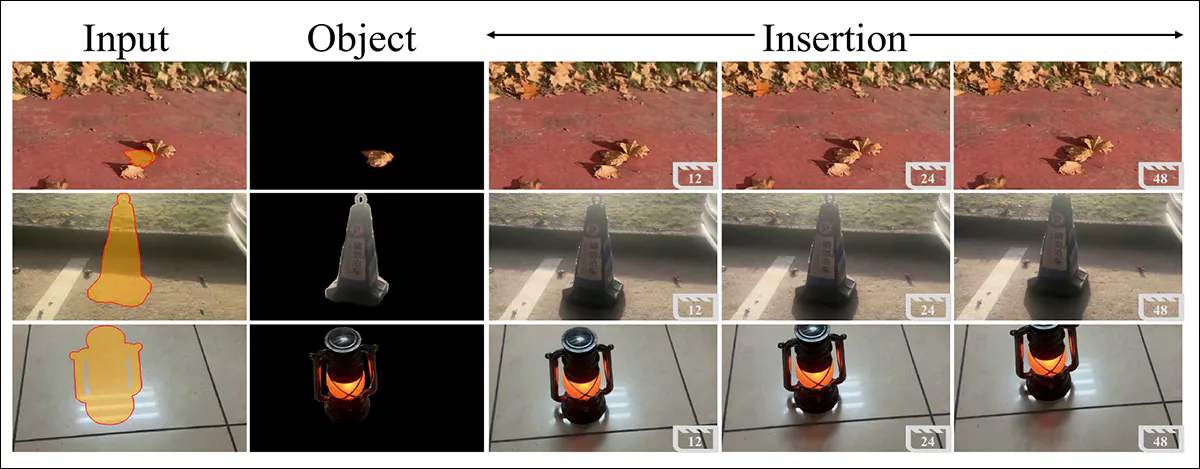

I afslutning bemærker forskerne, at deres metode også kan tilpasses til indsættelse i stedet for fjernelse-opgaver, uden behov for yderligere træning:

Video-objekt-indsættelse-resultater. EffectErase indsætter objekter, mens den bevarede baggrunds-indhold og genererer konsistente objekt-inducerende effekter, såsom skygger og reflekser på tværs af rammer.

Video-resultater for indsættelse-opgaven kan ses i den (tids-specifik) YouTube-video-eksempler (også indlejret uden tids-stempling i slutningen af artiklen).

Konklusion

En gennemgang af lignende projekter i litteraturen afslører, at mange stadig håber, at generelle VFX-modeller vil kunne foldede denne type funktionalitet ind i en generel ‘værktøjs’-model, designet til en række effekter, snarere end kun denne specifikke opgave.

Men på ‘jack of all trades’-princippet synes det rimeligt at antage, at dedikerede systemer som EffectErase vil fortsætte med at fastholde en fordel over mere generelle tilgange; med den betingelse, at forskellen måske vil kontrahere nok til at gøre forskellen ikke værd at bemøde.

* Man ville håbe, med voksende bekymringer omkring IP-proveniens-problemer, at alle sådanne kilder ville blive citeret; men hvis de tilgængelige materialer fra det nye arbejde nævner kilden til 3D-modellerne, kunne jeg ikke finde denne reference.

† Den citerede reference synes at være en generisk forklarende tekst fra 2013, med den specifikke VAE ikke detaljeret.

†† Taget fra artiklen, dette er en semantisk uklar beskrivelse, da finjustering og LoRA er forskellige processer med meget forskellige krav.

Først udgivet lørdag, 21. marts 2026