Andersons vinkel

På jagt efter ‘ugler og øgler’ i en annoncørs publikum

Da det online reklameområde estimeres til at have brugt 740,3 milliarder USD i 2023, er det let at forstå, hvorfor reklamefirmaer investerer betydelige ressourcer i denne bestemte gren af computer vision-forskning.

Selv om branchen er lukket og beskyttet, offentliggør den lejlighedsvis studier, der antyder mere avanceret proprietær arbejde med ansigts- og øjne-gaze-genkendelse – herunder aldersgenkendelse, der er central for demografiske analytiske statistikker:

At estimeren alder i en i-tilfælde-reklamekontekst er af interesse for annoncører, der måske er rettet mod en bestemt demografisk. I dette eksperimentelle eksempel på automatisk ansigtsaldersestimering, spores alderen af performer Bob Dylan over årene. Kilde: https://arxiv.org/pdf/1906.03625

Disse studier, der sjældent optræder i offentlige repositorier som Arxiv, bruger lovligt rekrutterede deltagere som grundlag for AI-dreven analyse, der sigter mod at bestemme, i hvilken udstrækning og på hvilken måde, tilskueren er engageret i en annonce.

Dlibs Histogram of Oriented Gradients (HoG) bruges ofte i ansigtsestimeringssystemer. Kilde: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Dyriske instinkter

I denne henseende er det naturligt, at reklamebranchen er interesseret i at bestemme fejlpositive (tilfælde, hvor et analytisk system misfortolker en persons handlinger), og i at etablere klare kriterier for, når personen, der ser deres reklamer, ikke er fuldt engageret i indholdet.

Så langt som skærm-baseret reklame angår, tenderer studierne til at fokusere på to problemer over to miljøer. Miljøerne er ‘desktop’ eller ‘mobil’, hver af dem har særlige karakteristika, der kræver tilpassede sporingssystemer; og problemernes – fra annoncørens synspunkt – er repræsenteret af ugle-adfærd og øgle-adfærd – tilbøjeligheden hos seere til ikke at give fuld opmærksomhed til en annonce, der er foran dem.

Eksempler på ‘ugle’ og ‘øgle’ adfærd i en deltagers reklameforskningsprojekt. Kilde: https://arxiv.org/pdf/1508.04028

Hvis du ser væk fra den ønskede annonce med hele hovedet, er dette ‘ugle-adfærd’; hvis hovedets pose er statisk, men øjnene vandrer væk fra skærmen, er dette ‘øgle-adfærd’. I forhold til analytik og testning af nye annoncer under kontrollerede betingelser er disse essentielle handlinger for et system til at kunne fange.

En ny artikel fra SmartEyes Affectiva-overtagelse behandler disse problemer og tilbyder en arkitektur, der udnytter flere eksisterende rammer til at give en kombineret og konkateneret funktionssæt over alle de nødvendige betingelser og mulige reaktioner – og til at kunne bestemme, om en seer er ked, engageret eller på en eller anden måde fjern fra indhold, som annoncøren ønsker, at de skal se.

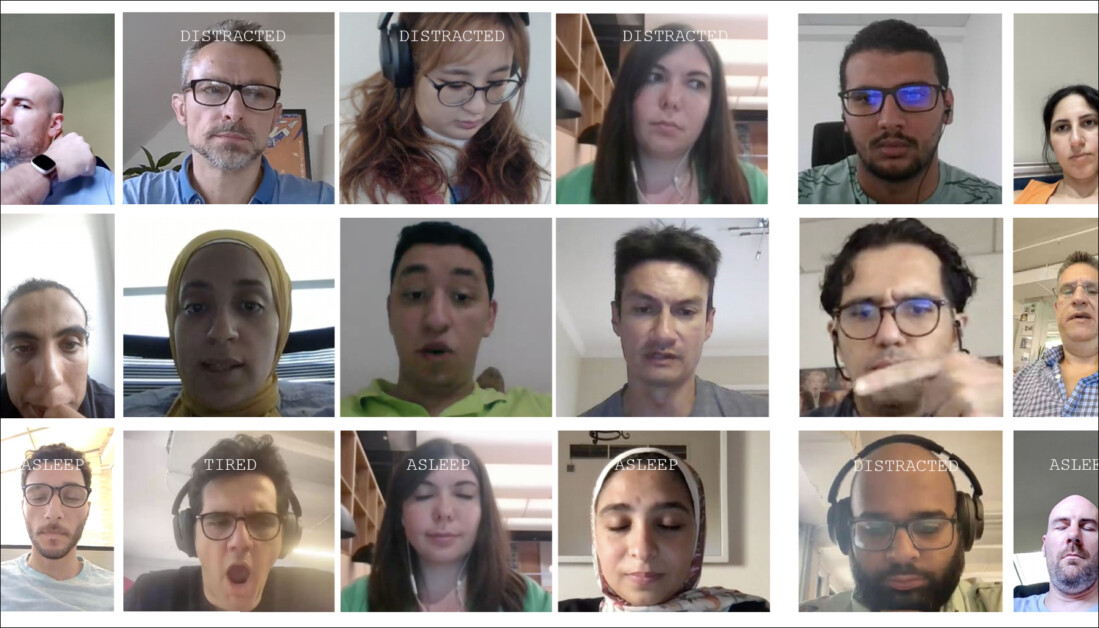

Eksempler på sande og falske positive fund fra det nye opmærksomhedssystem for forskellige distraktionssignaler, vist separat for desktop- og mobileenheder. Kilde: https://arxiv.org/pdf/2504.06237

Forfatterne skriver:

‘Begrænset forskning har dybt studeret overvågning af opmærksomhed under online-annoncer. Mens disse studier fokuserede på at estimerer hovedpose eller gaze-retning for at identificere tilfælde af afledt gaze, ser de bort fra kritiske parametre som enhedstype (desktop eller mobil), kamera-placering i forhold til skærmen og skærmstørrelse. Disse faktorer påvirker betydeligt opmærksomhedsdetektion.

‘I denne artikel foreslår vi en arkitektur for opmærksomhedsdetektion, der omfatter detektering af forskellige distraktorer, herunder både uglen og øglens adfærd med gaze off-screen, tale, træthed (gennem gabning og forlænget øjelukning) og forladte skærme.

‘I modsætning til tidligere tilgange integrerer vores metode enhedsspecifikke funktioner som enhedstype, kamera-placering, skærmstørrelse (for desktops) og kamera-orientering (for mobile enheder) med den rå gaze-estimering for at forbedre opmærksomhedsdetektionens nøjagtighed.’

Det nye arbejde er titlen Overvågning af seernes opmærksomhed under online-annoncer, og kommer fra fire forskere ved Affectiva.

Metode og data

Largely på grund af hemmelighedskræmmeri og lukkede kildesystemer, sammenligner den nye artikel ikke forfatternes tilgang direkte med rivaler, men præsenterer deres resultater eksklusivt som ablationsstudier; heller ikke artikel følger den sædvanlige format for computer vision-litteratur. Derfor vil vi se på forskningen, som den præsenteres.

Forfatterne understreger, at kun et begrænset antal studier har behandlet opmærksomhedsdetektion specifikt i sammenhæng med online-annoncer. I AFFDEX SDK, der tilbyder realtids multi-face-genkendelse, antages opmærksomhed kun fra hovedpose, med deltagere, der er markeret som uopmærksomme, hvis deres hovedvinkel passerer en defineret grænse.

Et eksempel fra AFFDEX SDK, et Affectiva-system, der afhænger af hovedpose som en indikator for opmærksomhed. Kilde: https://www.youtube.com/watch?v=c2CWb5jHmbY

I 2019-samarbejdet Automatisk måling af visuel opmærksomhed til videoindhold ved hjælp af dyb læring, en dataset på omkring 28.000 deltagere blev annoteret for forskellige uopmærksomme adfærder, herunder gaze væk, øjne lukning eller engagement i uafhængige aktiviteter, og en CNN-LSTM-model trænet til at detektere opmærksomhed fra ansigtsudseende over tid.

Fra 2019-artiklen, et eksempel, der illustrerer forventede opmærksomhedsstater for en seer, der ser videoindhold. Kilde: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Men forfatterne observerer, at disse tidligere bestræbelser ikke tog hensyn til enhedsspecifikke faktorer, såsom om deltagere brugte en desktop eller mobil enhed; ej heller tog de hensyn til skærmstørrelse eller kamera-placering. Derudover fokuserer AFFDEX-systemet kun på at identificere gaze-afledning og udelader andre kilder til distraktion, mens 2019-arbejdet forsøger at detektere en bredere sæt af adfærder – men dens brug af en enkelt, lav CNN kan, ifølge artiklen, have været utilstrækkeligt til denne opgave.

Forfatterne observerer, at nogle af de mest populære forskninger på dette område ikke er optimeret til annonce-testning, der har andre behov i forhold til domæner som kørsel eller uddannelse – hvor kamera-placering og kalibrering normalt er faste på forhånd, og i stedet afhænger af ukalibrerede opsætninger og fungerer inden for den begrænsede gaze-rækkevidde af desktop- og mobile enheder.

Derfor har de udviklet en arkitektur for at detektere seernes opmærksomhed under online-annoncer, der udnytter to kommercielle værktøjer: AFFDEX 2.0 og SmartEye SDK.

Eksempler på ansigtsanalyse fra AFFDEX 2.0. Kilde: https://arxiv.org/pdf/2202.12059

Disse tidligere arbejder udtrækker lav-niveaufunktioner, såsom ansigtsudtryk; hovedpose; og gaze-retning – udtrukket gennem ovennævnte AFFDEX 2.0 og SmartEye SDK.

Disse funktioner konverteres derefter til høj-niveaufunktioner, hvor hver distraktor håndteres af en separat binær klassifikator trænet på sin egen dataset for uafhængig optimering og evaluering.

Schema for det foreslåede overvågningsystem.

Gaze-modellen bestemmer, om seeren kigger på eller væk fra skærmen ved hjælp af normaliserede gaze-koordinater, med separat kalibrering for desktop- og mobile enheder. Dette proces understøttes af en lineær Support Vector Machine (SVM), trænet på rumlige og tidsmæssige funktioner, der inkorporerer en hukommelsesvindue for at glatte hurtige gaze-skift.

For at detektere tale uden lyd brugte systemet beskåret mund-region og en 3D-CNN trænet på både konversationelle og ikke-konversationelle video-segmenter. Mærker blev tildelt på grundlag af sessions-type, med tidsmæssig glatning, der reducerer de falske positive, der kan resultere fra korte mundbevægelser.

Gabning blev detekteret ved hjælp af fuld ansigtsbillede-udklip, for at fange bredere ansigtsbevægelser, med en 3D-CNN trænet på manuelt annoterede rammer (selv om opgaven blev kompliceret af gabningens lave frekvens i naturlig visning og dens lighed med andre udtryk).

Skærm-forladelse blev identificeret gennem fraværet af et ansigt eller ekstrem hovedpose, med forudsigelser lavet af en beslutningstræ.

Endelig opmærksomhedsstatus blev bestemt ved hjælp af en fast regel: hvis nogen modul detekterede uopmærksomhed, blev seeren markeret uopmærksom – en tilgang, der prioriterer sensitivitet og justeres separat for desktop- og mobile-kontekster.

Tests

Som nævnt tidligere følger testene en ablativ metode, hvor komponenter fjernes, og effekten på resultatet noteres.

Forskellige kategorier af opfattet uopmærksomhed identificeret i studiet.

Gaze-modellen identificerede off-screen-adfærd gennem tre nøgletrin: normalisering af rå gaze-estimater, finjustering af output og estimering af skærmstørrelse for desktop-enheder.

For at forstå betydningen af hver komponent fjernede forfatterne dem enkeltvis og evaluerede ydelsen på 226 desktop- og 225 mobile-videoer trukket fra to datasets. Resultaterne, målt ved G-mean og F1 scores, vises nedenfor:

Resultater, der viser ydelsen af den fulde gaze-model, sammen med versioner med enkeltvis fjernelse af behandlingstrin.

I alle tilfælde faldt ydelsen, når et trin blev udeladt. Normalisering viste sig at være særligt værdifuld på desktops, hvor kamera-placering varierer mere end på mobile enheder.

Studiet evaluerede også, hvordan visuelle funktioner forudsagde mobile kamera-orientering: ansigtslokation, hovedpose og øjne-gaze-scorede 0,75, 0,74 og 0,60, mens deres kombination nåede 0,91, hvilket, ifølge forfatterne, understreger fordelene ved at integrere multiple signaler.

Tale-modellen, trænet på vertikal læbe-afstand, opnåede en ROC-AUC på 0,97 på det manuelt annoterede test-sæt og 0,96 på det større automatisk annoterede dataset, hvilket indikerer konsekvent ydelse på begge.

Gabning-modellen nåede en ROC-AUC på 96,6 procent ved hjælp af mund-aspekt-forhold alene, hvilket forbedredes til 97,5 procent, da det kombineredes med handlingseenhedsforudsigelser fra AFFDEX 2.0.

Forladt skærm-modellen klassificerede øjeblikke som uopmærksomme, når både AFFDEX 2.0 og SmartEye ikke kunne detektere et ansigt i mere end ét sekund. For at evaluere dette annoterede forfatterne manuelt alle sådanne no-face-hændelser i reel distraktion-datasettet og identificerede den underliggende årsag til hver aktivering. Tvetydige tilfælde (såsom kamera-forstyrrelse eller video-forvrængning) blev ekskluderet fra analysen.

Som vist i resultattabellen nedenfor var kun 27 procent af ‘no-face’-aktiveringer forårsaget af brugere, der fysisk forlod skærmen.

Forskellige årsager, der er fundet til, at et ansigt ikke blev fundet i visse tilfælde.

Artiklen slutter:

‘Trods forladte skærme udgjorde kun 27% af tilfælde, der udløste no-face-signalet, blev det udløst for andre årsager, der tydede på uopmærksomhed, såsom deltagere, der kiggede væk fra skærmen med en ekstrem vinkel, udførte overmåde bevægelser eller skjulte deres ansigt betydeligt med et objekt/hånd.’

I den sidste af de kvantitative tests evaluerede forfatterne, hvordan tilføjelsen af forskellige distraktionssignaler – off-screen gaze (via gaze og hovedpose), træthed, tale og forladte skærme – påvirkede den samlede ydelse af deres opmærksomhedsmodel.

Testningen blev udført på to dataset: reel distraktion-datasettet og et test-underdataset af gaze-datasettet. G-mean og F1-scores blev brugt til at måle ydelsen (selv om træthed og tale blev ekskluderet fra gaze-dataset-analysen på grund af deres begrænsede relevans i denne sammenhæng).

Som vist nedenfor forbedredes opmærksomhedsdetektion konsekvent, da flere distraktionstyper blev tilføjet, med off-screen gaze, den mest almindelige distraktor, der giver den stærkeste baseline.

Effekten af tilføjelse af forskellige distraktionssignaler til arkitekturen.

Af disse resultater skriver artiklen:

‘Fra resultaterne kan vi først konkludere, at integrationen af alle distraktionssignaler bidrager til forbedret opmærksomhedsdetektion.

‘For det andet er forbedringen af opmærksomhedsdetektion konsekvent på tværs af både desktop- og mobile-enheder. For det tredje viser mobile sessions i den reelle dataset betydelige hovedbevægelser, når de kigger væk, hvilket let kan detekteres, og fører til bedre ydelse på mobile enheder i forhold til desktops. For det fjerde har tilføjelsen af trætheds-signalet en relativt lille forbedring i forhold til andre signaler, da det normalt er sjældent.

‘Til sidst har det forladte skærm-signal en relativt større forbedring på mobile enheder i forhold til desktops, da mobile enheder let kan forlades.’

Forfatterne sammenlignede også deres model med AFFDEX 1.0, et tidligere system brugt i annonce-testning – og selv den nuværende models hovedbaserede gaze-detektion overgik AFFDEX 1.0 på tværs af begge enhedstyper:

‘Denne forbedring er et resultat af at inkorporere hovedbevægelser i både yaw- og pitch-retninger, samt normalisering af hovedposen for at tage hensyn til mindre ændringer. De betydelige hovedbevægelser i den reelle mobile dataset har medført, at vores hoved-model har en lignende ydelse som AFFDEX 1.0.’

Forfatterne afslutter artiklen med en (muligvis ret perfunctorisk) kvalitativ testrunde, vist nedenfor.

Eksempler på output fra opmærksomhedsmodellen på tværs af desktop- og mobile-enheder, hvor hver række præsenterer eksempler på sande og falske positive for forskellige distraktionstyper.

Forfatterne skriver:

‘Resultaterne indikerer, at vores model effektivt detekterer forskellige distraktorer i ukontrollerede miljøer. Det kan dog lejlighedsvis producere falske positive i visse ekstreme tilfælde, såsom ekstrem hovedvinkel, mens gaze på skærmen opretholdes, visse mund-ocklusioner, overmåde blærøde øjne eller kraftigt mørke ansigtsbilleder.’

Konklusion

Selv om resultaterne repræsenterer en målt og meningsfuld fremgang i forhold til tidligere arbejde, ligger den dybere værdi af studiet i den glimt, det giver ind i den vedvarende stræben efter at få adgang til seerens interne tilstand. Selv om data blev indsamlet med samtykke, peger metoden mod fremtidige rammer, der kunne udvides beyond strukturerede, markedsføringsmæssige sammenhænge.

Denne ret paranoidiske konklusion understreges kun af den lukkede, begrænsede og beskyttede natur af denne bestemte gren af forskning.

* Min konvertering af forfatternes inline-citationer til hyperlinks.

Først offentliggjort onsdag, 9. april 2025