Andersons vinkel

AI’s jagt på skønhed

Et nyt AI-drevet skønheds vurderingssystem vurderer, hvor tiltrækkende ansigter ser ud, mens det træner hurtigere end typiske dybe læreningsmodeller, og dette kan muligvis gøre storstilet automatiseret skønheds-score mere praktisk.

Ansigtsskønhedsforudsigelse (FBP) er en stor forretning, og en ret stærk tråd i forskningslitteraturen. Selv om det bryder praktisk taget hver eneste princip bag bekæmpelse af bias i AI og maskinelæringspraksis, og selv om det på mange måder støtter objektivering og reduktionisme i algoritmiske perceptioner af kvinder, tiltrækker det alligevel interessen fra flere multi-milliarddollarindustrier, hvoraf de fleste er rettet direkte mod kvinder, såsom kosmetik, kosmetisk ansigtskirurgi, livestreaming og mode, blandt andre:

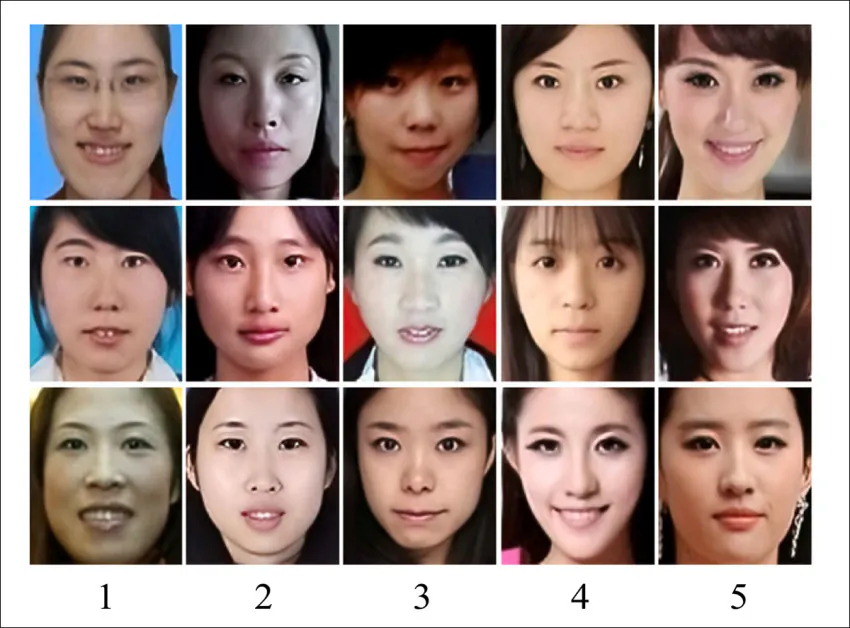

Kvinder vurderet fra 1-5, fra papiret ‘Asian Female Facial Beauty Prediction Using Deep Neural Networks via Transfer Learning and Multi-Channel Feature Fusion’. Kilde

Ud over disse åbenlyse kvindespecifikke forretningsenklaver har reklame og mange andre industrier, herunder underholdning og udgivelse, betydelige gevinster i at forstå, hvad både mænd og kvinder finder ’tiltrækkende’, nødvendigvis på en kultur-specifik basis.

Det faktum, at samlede perceptioner af skønhed varierer på tværs af regioner, betyder, at der ikke kan opnås nogen definitivt globalt anvendeligt dataset, og at nyt forskning enten må blive lokal eller koncentrere sig om ‘højniveau’-metoder, der kan anvendes på tværs af diverse kulturelle data.

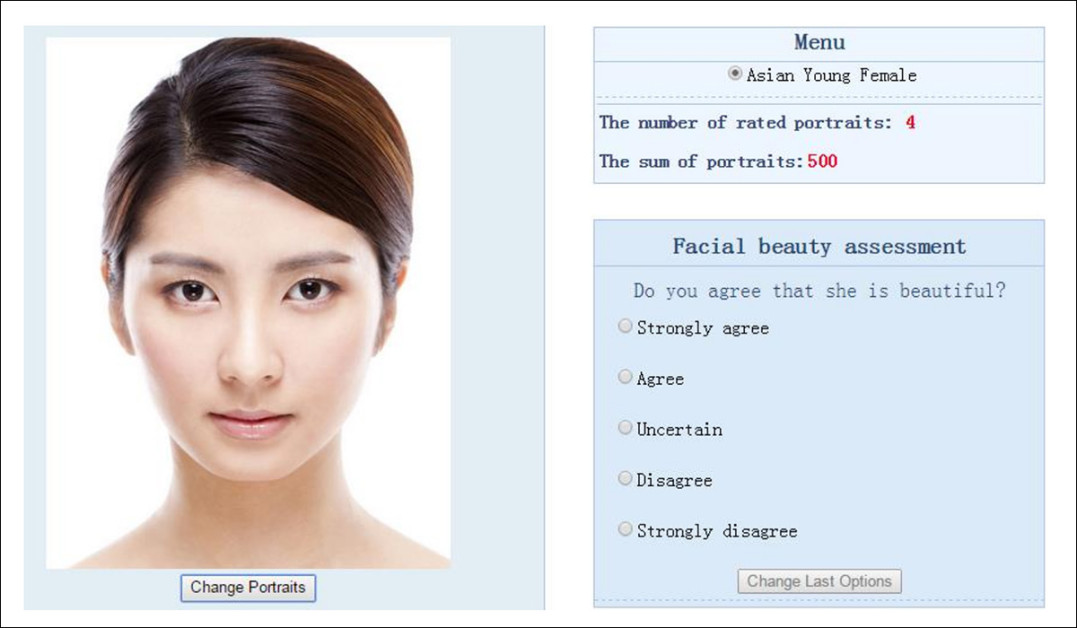

En interface til et ansigtsskønheds vurderingssystem for 2015 SCUT-FBP-projektet. Kilde

Ofte er geografisk placering ikke den eneste begrænsning, da tiltrækningsfokuserede datasamlinger kan have svært ved at give lige stor effektivitet på tværs af køn, eller kan være blevet kurateret med en bestemt anvendelse i mente – og dette kan begrænse samlingens brug i andre domæner.

For eksempel rapporterede jeg i 2025 om udviklingen af en relativt stor (100.000+ identiteter) dataset til at vurderer tiltrækningsværdi i live-streaming, hvis tæt beskårne standarder kan kræve betydelig tilpasning til bredere projekter, på trods af den enorme indsats bag initiativet.

Ansigtsskønhedsrendition

Som kan være tydeligt fra links og billeder ovenfor, opererer asiatiske forskningsinstitutioner ofte ikke under de samme kulturelle begrænsninger som deres vestlige modparter, der ville have svært ved at turde offentliggøre en videnskabelig illustration, der vurderer fem vestlige kvinder fra mindst til mest tiltrækkende, som vi ser i ovennævnte studie.

Det kan argumenteres for, at hvor asiatiske systemer af denne type er bevist effektive i offentligheden, uden frygt for lokal kritik, kan vestlige interesser bruge eller tilpasse sådant forskning til proprietære, private implementeringer. Opgaven med at ‘vurdere kvinder’ i den situation er renditioneret til et sted, hvor det kan forfølges uden kritik.

Uanset om dette er almindeligt eller om mindre offentliggjorte vestlige ækvivalente systemer tendenser til at blive udviklet væk fra åben kilde-samarbejde og fra offentlig skærping, er det rimeligt at antage, at målet er af global interesse, på grund af det store antal professionelle sektorer, der kan eller kunne drage fordel af nøjagtige vurderinger af tiltrækningsværdi.

Overlevelse af den stærkeste

Det kan synes, at massive web-skrapable korpus som Tik Tok, Instagram og YouTube ville være fremragende dommere af skønhed, ved at korrelerer følgere, likes og trafik til tiltrækningsværdi, da dette er en almindelig og rimelig association (om end med nogle undtagelser).

Ligesom eksisterende samlinger – såsom ImageNet og LAION – der indeholder skuespillere og modeller, der er ‘stigen til toppen’ – vil typisk indeholde tiltrækkende individer (om end med for mange datapunkter af for få mennesker), hvilket tillader bredere kulturelle mekanismer at fungere som en proxy for tiltrækningsværdi.

Men dette tager ikke hensyn til skiftende smag i, hvad mennesker finder tiltrækkende over tid (glem ikke geografisk). Derfor er der igen behov for højniveau- og data-agnostiske systemer, ikke individuelle og tvivlsomme samlinger eller kurateringer, der vil svigte i at reflektere skiftende smag.

Kombinationsskønhed

Den seneste akademiske indgang til at tackle disse udfordringer kommer fra Kina, hvor overførselslæring og Broad Learning System (BLS) kombineres for at tackle den langvarige trade-off mellem nøjagtighed og beregningsomkostninger.

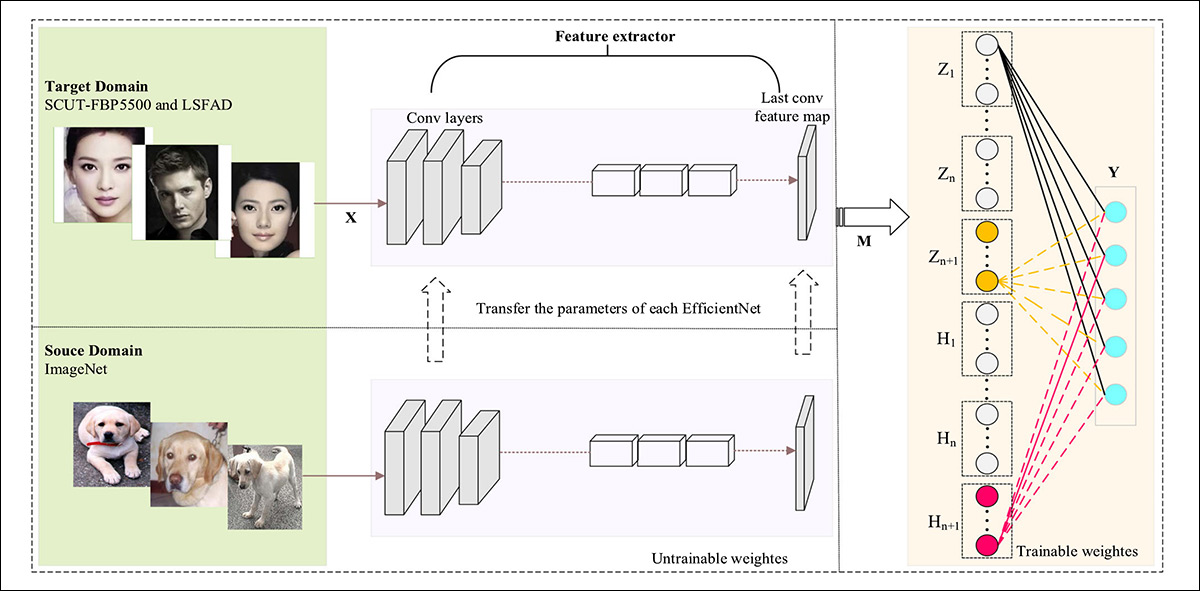

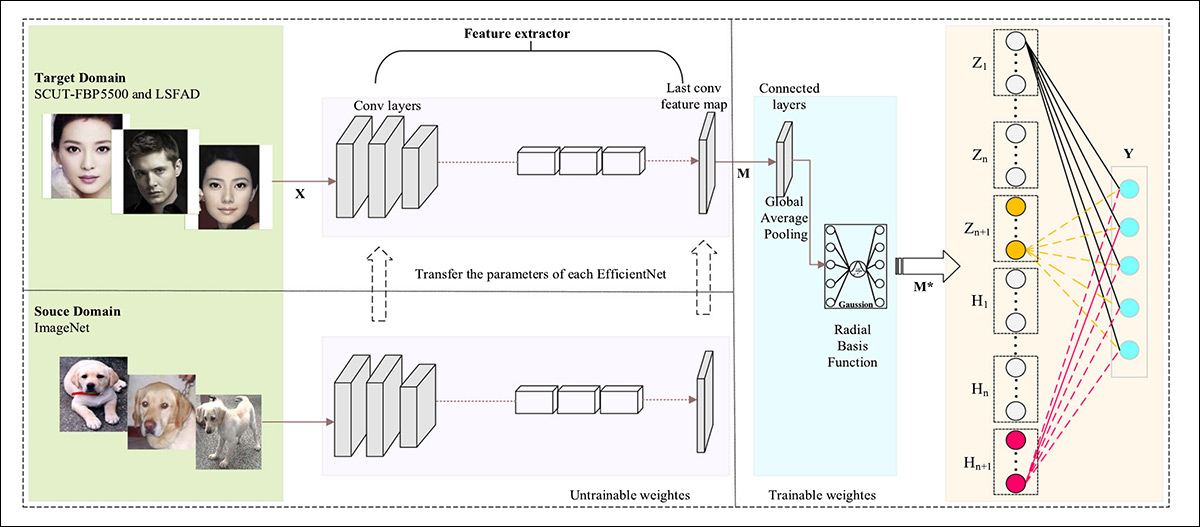

Konventionelle neurale netværk tenderer til at opnå stærke resultater kun med tung træning, mens lettere systemer som BLS træner hurtigt, men kæmper med at fange nok detaljer. Det nye arbejde brokkerer denne kløft ved at bruge et forudtrænet visuelt model til at trække ansigtstræk, der derefter overføres til et hurtigt BLS-baseret system til scoring, hvilket tillader træk at genbruges i stedet for at læres fra scratch, mens træningseffektiviteten opretholdes:

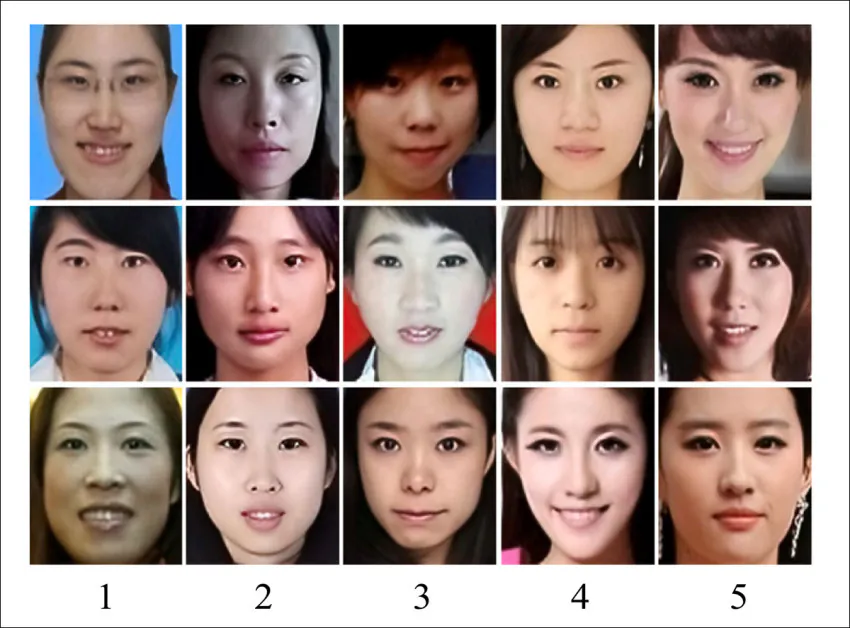

Eksempler på billeder fra LSAFBD-datasættet, der viser kvindelige ansigter grupperet efter menneske-tildelte skønhedsscores fra 1 til 5. Vurderingerne blev opnået fra multiple annotatorer og brugt som overvåget labels til træning og evaluering af ansigtsskønhedsforudsigelsesmodeller på tværs af variationer i pose, belysning og udseende. Kilde

Den første af de to variationer, der blev introduceret i arbejdet (E-BLS, se nedenfor), føder de trukne træk direkte ind i det letvægede system, mens den anden, ER-BLS (se også nedenfor), tilføjer en enkel mellemstep, der standardiserer og forbedrer disse træk, før de anvendes til vurdering, hvilket hjælper med at forbedre konsistensen uden at langsætte processen.

Testene, der blev udført af forfatterne, beviser, de hævder, at deres tilgang er overlegen i forhold til både metoderne i sig selv og andre konkurrerende metoder.

Den nye artikel er titlen Ansigtsskønhedsforudsigelse ved at kombinere overførselslæring og Broad Learning System, og kommer fra seks forskere ved Wuyi University, Jiangmen.

Metode

Den ovennævnte Broad Learning System er et letvægt alternativ til dybe neurale netværk, der springer over at stable multiple lag og i stedet spreder læring over en bred samling af simple forbindelser, hvilket tillader modeller at træne hurtigt – men typisk på bekostning af at gå glip af finere visuelle detaljer.

Den første af de to varianter, E-BLS, kombinerer EfficientNet-baseret overførselslæring med BLS, hvor detaljerede visuelle træk trækkes fra et ansigt, og derefter overføres til BLS, hvilket medfører en endelig vurdering, der undgår behovet for at træne et fuldt dybt neuralt netværk fra scratch:

Arkitektur-schema for E-BLS-modellen.

EfficientNet, forudtrænet på ImageNet-1k, og stort set holdt uændret, konverterer hver input-billede til en kompakt samling af funktionværdier, der beskriver ansigtet på en struktureret måde, mens BLS tager disse værdier og processerer dem gennem et netværk af simple, tilfældigt forbundne knuder, der transformerer og kombinerer informationen, før de producerer den endelige tiltrækningsvurdering.

Fordi BLS ikke afhænger af dybe lagstrukturer, kan E-BLS opdateres ved at tilføje flere knuder i stedet for at gen-træne hele systemet, hvilket holder træning hurtigt og gør det lettere at forbedre modellen, når nye data introduceres.

Den anden af de to varianter, ER-BLS, bygger på E-BLS ved at indsætte en ekstra proces-trin mellem EfficientNet-funktionstrækkeren og BLS, med det formål at forbedre, hvordan de trukne træk forberedes, før de anvendes til vurdering:

Arkitektur af ER-BLS-modellen.

I stedet for at sende de rå EfficientNet-træk direkte ind i BLS, forbedrer ER-BLS dem først gennem en forfiningslag, der standardiserer og omformulerer data, hvilket hjælper med at reducere støj og gør træk mere konsistente på tværs af billeder. Dette trin er designet til at forbedre, hvordan systemet generaliserer, især når ansigter varierer i belysning, pose eller andre visuelle betingelser, der ellers kan introducere ustabilitet i vurderingerne.

De forbedrede træk sendes derefter ind i samme BLS-struktur, der anvendes i E-BLS, hvor funktionknuder og forbedringsknuder transformerer og kombinerer informationen for at producere den endelige tiltrækningsvurdering.

Data og test

For at teste deres tilgang, udnyttede forfatterne SCUT-FBP5500-datasættet, en ansigtsskønhedsforudsigelsessamling fra South China University, der indeholder 5.500 frontale ansigtsbilleder i 350x350px, med diverse racer, køn og aldre:

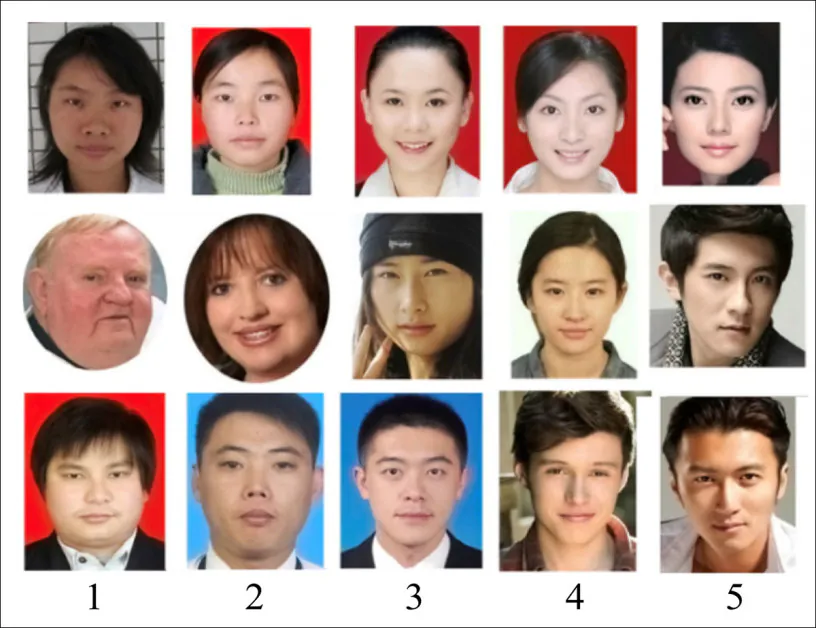

Eksempler på SCUT-FBP5500-datasættets ansigtsbilleder vurderet fra mindst (1) til mest (5) tiltrækkende.

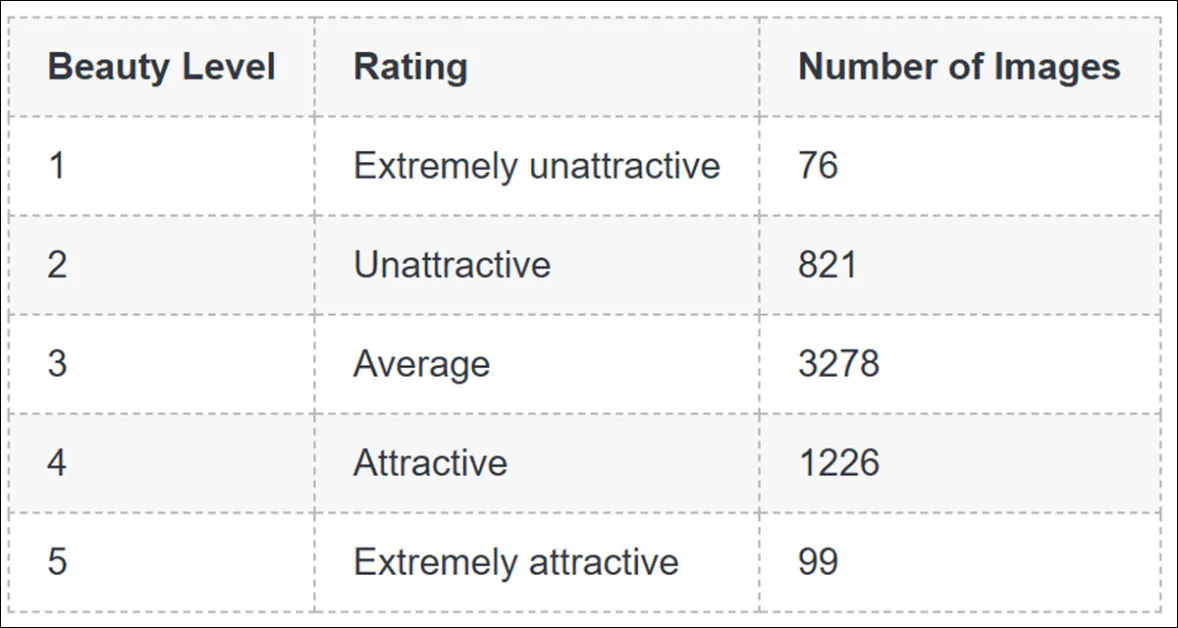

Hvert billede blev vurderet med en skønhedsvurdering af 60 frivillige, på en skala fra 1-5, der strakte sig fra ekstremt utiltrækkende (1) til ekstremt tiltrækkende (5):

Fordelingen af billeders proportioner efter skønhedsvurdering.

Den anden database, der blev brugt, var Large-Scale Asian Female Beauty Dataset (LSAFBD)-samlingen, en datasamling kurateret af forfatterne selv.

Eksempler på LSAFBD-datasættets ansigtsbilleder vurderet fra mindst (1) til mest (5) tiltrækkende.

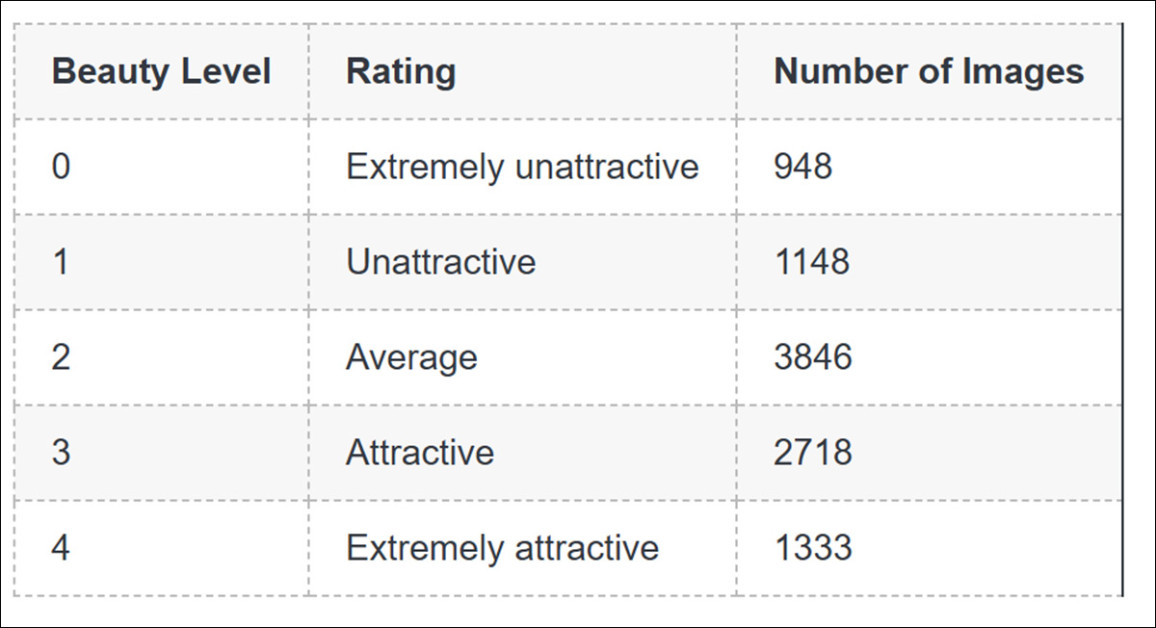

Samlingen består af 80.000 ikke-vurderede billeder i 144x144px opløsning, med variationer i pose og baggrund, såvel som alder. Disse blev vurderet af 75 frivillige for de samme kriterier som det foregående datasæt, denne gang på en skala fra 0-4:

Fordelingen for LSAFBD-datasættet.

Hvert datasæt blev delt i trænings- og testsegmenter i en 8/20-forhold, og krydsvalidering anvendtes for at stabilisere resultaterne på tværs af kørsler. BLS-komponenten blev konfigureret gennem antallet af funktion-vinduer; antallet af knuder per vindue; og antallet af forbedringsknuder, med Hyperopt anvendt til at søge efter effektive kombinationer.

For at etablere en baseline, blev et standard BLS-model trænet under identiske indstillinger, efterfulgt af en række overførselslæringsmodeller, herunder ResNet50, Inception-V3, DenseNet121, InceptionResNetV2, EfficientNetB7, MobileNetV2, NASNet og Xception – alle initialiseret med ImageNet-1k-vægte og trænet med deres sidste lag ufrosset.

Træning anvendte en læringsrate på 0,001 (reduceret, når fremgangen stoppede), og en batch-størrelse på 16, på tværs af 50 epoch, med regularisering og rectified linear aktivering (ReLU) anvendt på tværs af.

Ydelsen blev vurderet ved hjælp af nøjagtighed og Pearson-korrelation, sammen med total træningstid, med resultater gennemsnitligt på tværs af fem kørsler.

Forfatterne rapporterer træningssætningen som en Intel-i7 3,6 GHz CPU og 64 GB RAM på en ‘desktop-computer’:

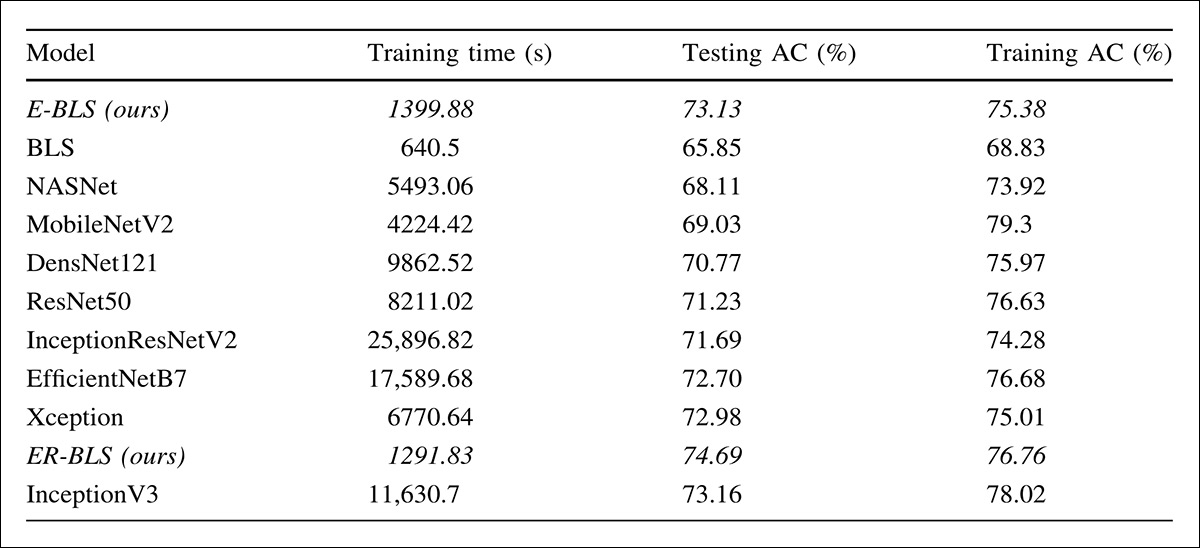

Ydelseskomparation på SCUT-FBP5500, hvor E-BLS og ER-BLS opnår konkurrencedygtig nøjagtighed mod dybe CNN-modeller, herunder ResNet50, EfficientNetB7, InceptionV3 og Xception, mens de kræver væsentligt mindre træningstid – hvilket fremhæver effektivitetsgevinsterne ved at kombinere overførselslæring med et Broad Learning System.

Resultaterne viste, at E-BLS forbedrede nøjagtigheden fra 65,85% til 73,13%, mens ER-BLS nåede 74,69%, og overgik alle sammenlignede modeller. Træningstiden forblev bemærkelsesværdigt lavere end dybe CNN’er, på omkring 1.300 sekunder, i modsætning til flere tusinde til over 25.000 sekunder.

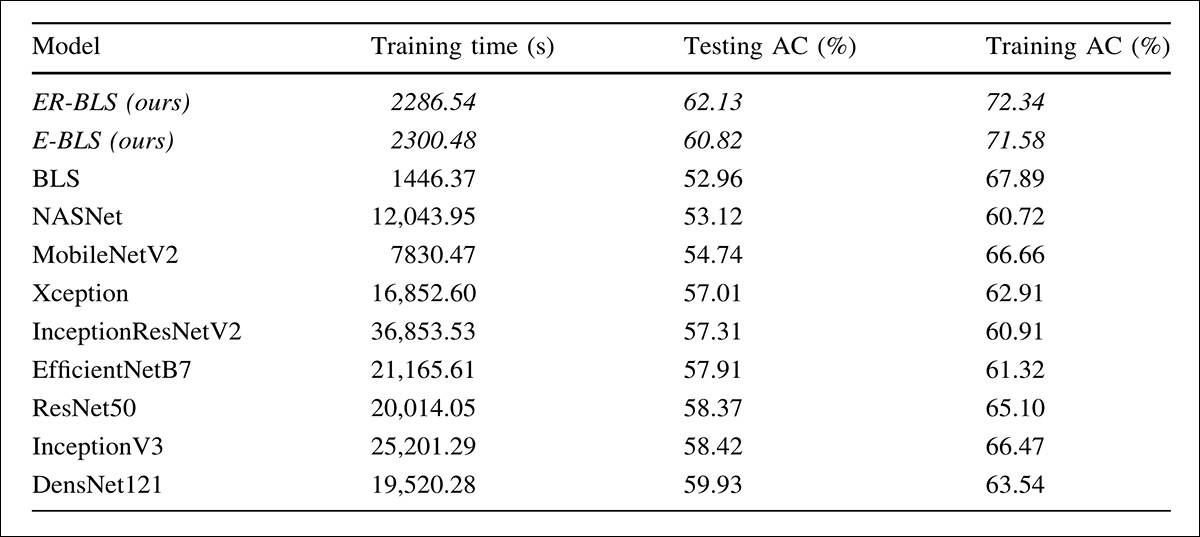

For testene på LSAFBD viste resultaterne, at E-BLS forbedrede nøjagtigheden over for almindelig BLS, mens ER-BLS opnåede den højeste nøjagtighed blandt alle sammenlignede metoder:

Ydelse på LSAFBD, hvor ER-BLS og E-BLS leverer højere nøjagtighed end alle baseline- og overførselslæringsmodeller, mens de kun kræver en brøkdel af deres træningstid, hvilket indikerer en konsekvent fordel i effektivitet uden at ofre prognosekvalitet.

Begge varianter opretholdt væsentligt lavere træningstid end dybe CNN-modeller, hvilket indikerer en mere effektiv balance mellem ydelse og beregningsomkostninger.

Konklusion

Dette er noget af en ‘throwback’-publicering, som bevidnes af dens brug af pre-boom-favoritter som CNN’er, og af den laveste niveau-træningsequipment, jeg har mødt i en ny artikel i mange år.

Alligevel handler det om et overraskende resilientt mål i computer-vision; et, der berører tungt på menneskelig oplevelse og subjektiv fortolkning, og som kræver en skema, der transcenderer den æstetiske trends af øjeblikket, og som kan forsyne en virkelig resilient pipeline til opgaven.

Først publiceret torsdag, 19. marts 2026