Kunstig intelligens

Generering af bedre AI-video fra kun to billeder

Video frame interpolation (VFI) er et åbent problem i generativ video forskning. Udfordringen er at generere mellemlemmer mellem to eksisterende billeder i en video sekvens.

Klik for at afspille. FILM-rammeværket, et samarbejde mellem Google og University of Washington, foreslog en effektiv ramme interpolationsmetode, der stadig er populær i både hobby- og professionelle kredse. Til venstre kan vi se de to separate og distinkte billeder lagt over hinanden; i midten, ‘slutbilledet’; og til højre, den endelige syntese mellem billederne. Kilder: https://film-net.github.io/ og https://arxiv.org/pdf/2202.04901

I bredere forstand har denne teknik rod tilbage over en århundrede og er blevet brugt i traditionel animation siden da. I denne kontekst ville master ‘nøglebilleder’ blive genereret af en principal animationskunstner, mens arbejdet med ‘tweening’ af mellemlemmer ville blive udført af andre medarbejdere som en mere underordnet opgave.

Før opkomsten af generativ AI blev rammeinterpolation brugt i projekter som Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN) og Googles Frame Interpolation for Large Motion (FILM – se ovenfor) til formål som at øge billedfrekvensen i en eksisterende video eller til at aktivere kunstigt genererede slow-motion-effekter. Dette opnås ved at splitte de eksisterende billeder i en klip og generere estimerede mellemlemmer.

VFI bruges også i udviklingen af bedre video-kodecer og mere generelt i optisk flow-baserede systemer (herunder generative systemer), der udnytter forhåndskendskab til kommende nøglebilleder til at optimere og forme det mellemliggende indhold, der forudgår dem.

Slutbilleder i generative videosystemer

Moderne generative systemer som Luma og Kling tillader brugeren at specificere et start- og slutbillede og kan udføre denne opgave ved at analysere nøglepunkter i de to billeder og estimere en trajektori mellem de to billeder.

Som vi kan se i eksemplerne nedenfor, giver det at levere et ‘afsluttende’ nøglebillede generative videosystemet (i dette tilfælde, Kling) mulighed for at fastholde aspekter som identitet, selv om resultaterne ikke er perfekte (især med store bevægelser).

Klik for at afspille. Kling er en af en voksende række af video-genereringsværktøjer, der tillader brugeren at specificere et slutbillede. I de fleste tilfælde vil minimal bevægelse føre til de mest realistiske og mindst fejlbehæftede resultater. Kilde: https://www.youtube.com/watch?v=8oylqODAaH8

I ovennævnt eksempel er personens identitet konsekvent mellem de to brugerdefinerede nøglebilleder, hvilket fører til en relativt konsekvent video-generering.

Hvis kun startbilledet er givet, er generative systemers vindue for opmærksomhed normalt ikke stor nok til at ‘huske’, hvordan personen så ud i starten af videoen. I stedet er det sandsynligt, at identiteten vil skifte lidt med hvert billede, indtil al lighed er tabt. I eksemplet nedenfor blev et startbillede uploadet, og personens bevægelse blev styret af en tekstprompt:

Klik for at afspille. Uden slutbillede har Kling kun en lille gruppe af umiddelbart forudgående billeder til at guide genereringen af de næste billeder. I tilfælde, hvor nogen væsentlig bevægelse er nødvendig, bliver denne atrofi af identitet alvorlig.

Vi kan se, at skuespillerens lighed er ikke robust over for instruktionerne, da generative systemet ikke ved, hvordan han ville se ud, hvis han smilede, og han ikke smiler i sædbilledet (det eneste tilgængelige referenceramme).

De fleste virale generative klip er omhyggeligt kurateret for at nedtone disse svagheder. Men fremgangen for temporal konsekvent generative video-systemer kan afhænge af nye udviklinger fra forskningssektoren i forhold til rammeinterpolation, da den eneste mulige alternative er afhængighed af traditionel CGI som en ‘guide’-video (og selv i dette tilfælde er konsekvens i tekstur og belysning stadig vanskelige at opnå).

Desuden gør den langsomt iterative natur af at udlede et nyt billede fra en lille gruppe af nærliggende billeder det meget svært at opnå store og dristige bevægelser. Dette skyldes, at et objekt, der bevæger sig hurtigt hen over et billede, kan gå fra den ene side til den anden i løbet af et enkelt billede, i modsætning til de mere gradvise bevægelser, som systemet sandsynligvis er blevet trænet på.

Ligesom en betydelig og dristig ændring af holdning kan føre ikke kun til identitetsskift, men også til levende inkongruenser:

Klik for at afspille. I dette eksempel fra Luma, ser den anmodede bevægelse ikke ud til at være godt repræsenteret i træningsdataene.

Framer

Dette bringer os til en interessant ny artikel fra Kina, som hævder at have opnået en ny stat-of-the-art i autentisk udseende rammeinterpolation – og som er den første af sin art til at tilbyde drag-baseret brugerinteraktion.

Framer tillader brugeren at dirigere bevægelse ved hjælp af en intuitiv drag-baseret interface, selv om det også har en ‘automatisk’ tilstand. Kilde: https://www.youtube.com/watch?v=4MPGKgn7jRc

Drag-centrerede ansøgninger er blevet hyppige i den litteratur for nylig, da forskningssektoren kæmper for at give instrumentaliteter for generative systemer, der ikke er baseret på de ret primitive resultater, der opnås ved tekstprompt.

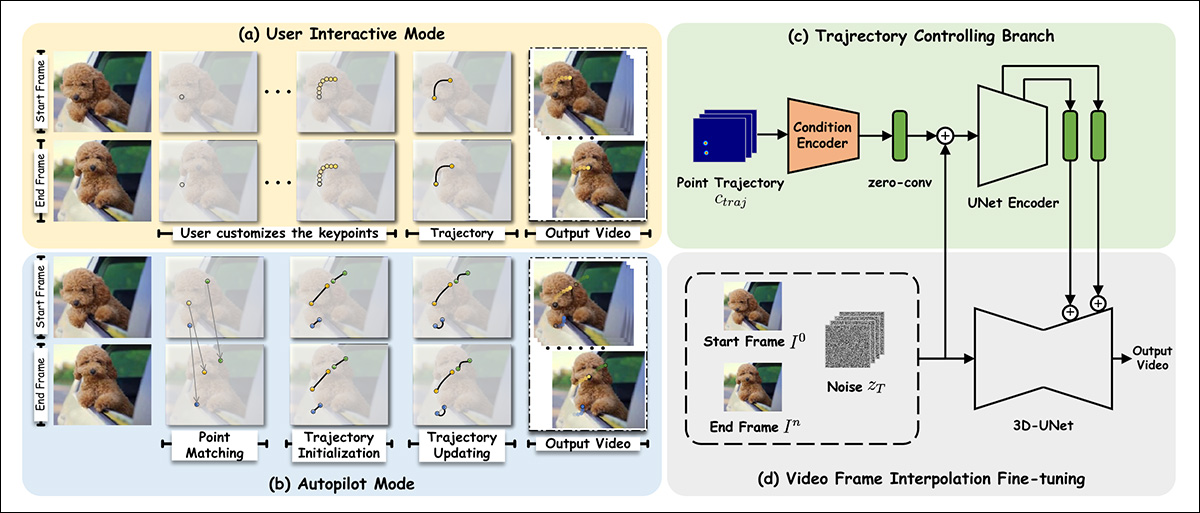

Det nye system, titlen Framer, kan ikke kun følge brugerstyrede drag, men har også en mere konventionel ‘autopilot’-tilstand. Ud over konventionel tweening er systemet i stand til at producere tidsløbs-simulationer samt morfning og nye visninger af inputbilledet.

Mellemlemmer genereret til en tidsløbs-simulation i Framer. Kilde: https://arxiv.org/pdf/2410.18978

I forhold til produktionen af nye visninger, krydser Framer lidt ind i territoriet af Neural Radiance Fields (NeRF) – selv om det kun kræver to billeder, hvor NeRF generelt kræver seks eller flere billedinddata.

I tests var Framer, som er baseret på Stability.ai’s Stable Video Diffusion latent diffusion generative video-model, i stand til at overgå approximerede rivaliserende tilgange i en brugerstudie.

På tidspunktet for skrivningen er koden sat til at blive udgivet på GitHub. Videoeksempler (fra hvilke de ovennævnte billeder er afledt) er tilgængelige på projektets side, og forskerne har også udgivet en YouTube-video.

Den nye artikel er titlen Framer: Interaktiv rammeinterpolation, og kommer fra ni forskere på tværs af Zhejiang University og Alibaba-bakket Ant Group.

Metode

Framer bruger nøglepunktsbaseret interpolation i enten af dens to modaliteter, hvor inputbilledet vurderes for grundlæggende topologi, og ‘flytbare’ punkter tildelt efter behov. I virkeligheden er disse punkter lig med faciale landemærker i ID-baserede systemer, men generaliserer til enhver overflade.

Forskerne finjusterede Stable Video Diffusion (SVD) på OpenVid-1M-datasettet, og tilføjede en ekstra sidste-ramme-syntese-kapacitet. Dette faciliterer en trajektorie-kontrol-mekanisme (øverst til højre i schema-billedet nedenfor), der kan evaluere en vej mod slutbilledet (eller tilbage fra det).

Schema for Framer.

Med hensyn til tilføjelsen af sidste-ramme-betingelse, skriver forfatterne:

‘For at bevare den visuelle prioritet for det forhåndstrænede SVD så meget som muligt, følger vi betingelsesparadigmet for SVD og indsætter slutbillede-betingelser i latent rum og semantisk rum, henholdsvis.

‘Specifikt konkatenerer vi VAE-kodet latent funktion af det første [billede] med den støjende latent af det første billede, som gjort i SVD. Derudover konkatenerer vi latent funktionen af det sidste billede, zn, med den støjende latent af slutbilledet, under henvisning til, at betingelserne og de tilsvarende støjende latente er rumligt aligneret.

‘Derudover udtrækker vi CLIP-billedindlejringen af det første og sidste billeder separat og konkatenerer dem for kryds-attention feature-injektion.’

For drag-baseret funktionalitet udnytter trajektorie-modulen Meta Ai-led CoTracker-rammeværket, som vurderer talrige mulige veje fremad. Disse reduceres til mellem 1-10 mulige trajektorier.

De opnåede punktkoordinater omformes derefter gennem en metode inspireret af DragNUWA og DragAnything-arkitekturerne. Dette opnår en Gaussian heatmap, der individuerer målområderne for bevægelse.

Herefter fødes dataene til betingelsesmekanismerne af ControlNet, et hjælpekonformitetssystem oprindeligt designet til Stable Diffusion, og siden tilpasset andre arkitekturer.

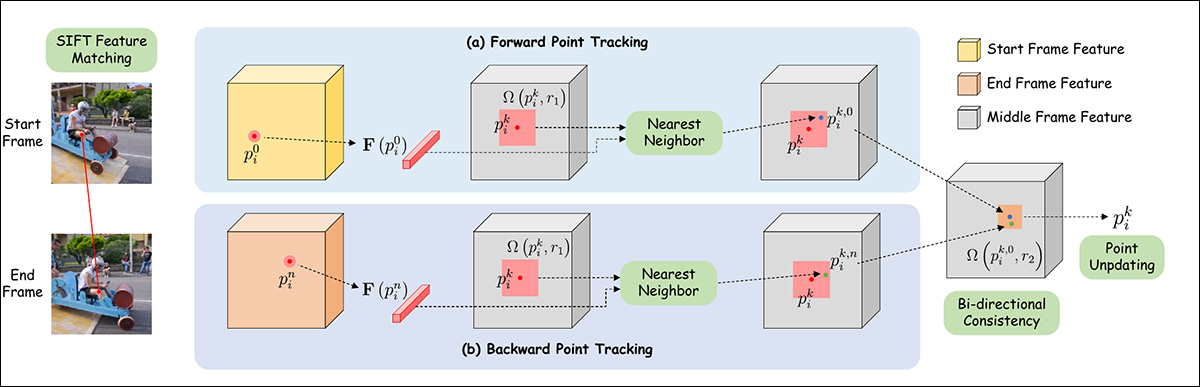

For autopilot-tilstand opnås funktionssammenligning initialt via SIFT, som fortolker en trajektori, der derefter kan overføres til en selvopdateringsmekanisme inspireret af DragGAN og DragDiffusion.

Schema for punkt-trajektorie-estimation i Framer.

Data og tests

For finjusteringen af Framer blev den rumlige opmærksomhed og restblokkene frosset, og kun de temporale opmærksomheds- og restblokkene blev påvirket.

Modellen blev trænet i 10.000 iterationer under AdamW, med en læringsrate på 1e-4 og en batch-størrelse på 16. Træningen fandt sted på tværs af 16 NVIDIA A100 GPU’er.

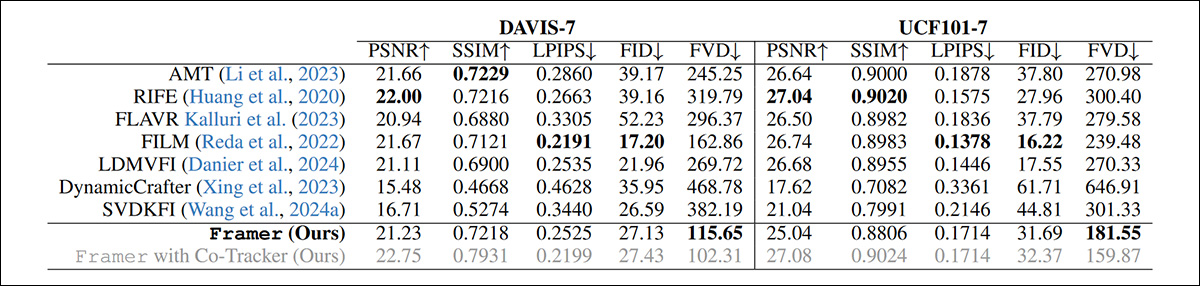

Da tidligere tilgange til problemet ikke tilbyder drag-baseret redigering, valgte forskerne at sammenligne Framer’s autopilot-tilstand med standardfunktionaliteten af ældre tilbud.

Rammeværkerne, der blev testet for kategorien af nuværende diffusion-baserede video-genererings-systemer, var LDMVFI; Dynamic Crafter; og SVDKFI. For ‘traditionelle’ video-systemer var de rivaliserende rammeværker AMT; RIFE; FLAVR; og det ovennævnte FILM.

Ud over brugerstudiet blev tests udført over DAVIS– og UCF101-datasettet.

Kvalitative tests kan kun vurderes af forskningsteams objektive evner og af brugerstudier. Men artiklen bemærker, at traditionelle kvantitative metrikker i store træk er uegnede til forslaget:

‘[Rekonstruktions] metrikker som PSNR, SSIM og LPIPS straffer andre plausibler interpoleringsresultater, der ikke er pixel-aligneret med den originale video.

‘Selv om generation-metrikker som FID tilbyder en vis forbedring, mangler de stadig, da de ikke tager højde for temporal konsistens og vurderer billeder i isolation.’

Trods dette udførte forskerne kvalitative tests med flere populære metrikker:

Kvantitative resultater for Framer vs. rival-systemer.

Forfatterne bemærker, at på trods af at have oddsene imod sig, opnår Framer stadig den bedste FVD-score blandt de testede metoder.

Nedenfor er artiklens eksempler på en kvalitativ sammenligning:

Kvalitativ sammenligning mod tidligere tilgange. Se venligst artiklen for bedre opløsning, samt videoresultater på https://www.youtube.com/watch?v=4MPGKgn7jRc.