Kunstig intelligens

En personlig tilgang til computer vision litteraturtrends i 2024

Jeg har kontinuerligt fulgt computer vision (CV) og image synthesis forskningsscenen på Arxiv og andre steder i omkring fem år, så trends bliver tydelige over tid, og de skifter i nye retninger hvert år.

Derfor, da 2024 nærmer sig afslutningen, syntes jeg det var passende at kaste et blik på nogle nye eller udviklende karakteristika i Arxiv-indlæggene i Computer Vision and Pattern Recognition sektionen. Disse observationer, selvom de er underrettet af hundredvis af timer med at studere scenen, er strengt anecdotalt.

Den fortsatte opstigning af Østasien

Ved udgangen af 2023 havde jeg bemærket, at flertallet af litteraturen i ‘voice synthesis’ kategorien kom fra Kina og andre regioner i Østasien. Ved udgangen af 2024 må jeg konstatere (anekdotisk), at dette nu også gælder for image og video synthesis forskningsscenen.

Dette betyder ikke, at Kina og tilstødende lande nødvendigvis altid producerer det bedste arbejde (i virkeligheden er der nogen beviser på det modsatte); og det tager ikke hensyn til den høje sandsynlighed i Kina (ligesom i Vesten), at nogle af de mest interessante og kraftfulde nye systemer er proprietære og udelukket fra forskningslitteraturen.

Men det antyder, at Østasien slår Vesten i antal, i denne henseende. Hvad det er værd afhænger af, i hvilken udstrækning du tror på troværdigheden af Edison-stil persistence, som normalt viser sig at være ineffektiv i mødet med uovervindelige hindringer.

Der er mange sådanne hindringer i generative AI, og det er ikke let at vide, hvilke der kan løses ved at adresse eksisterende arkitekturer, og hvilke der vil kræve at blive genovervejet fra scratch.

Selvom forskere fra Østasien synes at producere et større antal computer vision-papirer, har jeg bemærket en øgning i hyppigheden af ‘Frankenstein’-lignende projekter – initiativer, der udgør en sammenlægning af tidligere arbejder, samtidig med at de tilføjer begrænset arkitektonisk nytænkning (eller muligvis blot en anden type data).

I år syntes et langt højere antal østasiatiske (primært kinesiske eller kinesisk-sam-arbejdsprojekter) indlæg at være kvote-drevne snarere end merit-drevne, hvilket betydeligt øger signal-til-støj-forholdet i en allerede over-tegnet branche.

På samme tid har et større antal østasiatiske papirer også fanget min opmærksomhed og beundring i 2024. Så hvis dette er et nummerspil, så fejler det ikke – men det er heller ikke billigt.

Øget volumen af indlæg

Volumen af papirer, over alle oprindelseslande, har åbenbart øget i 2024.

Den mest populære publiceringsdag skifter gennem året; lige nu er det tirsdag, hvor antallet af indlæg til Computer Vision and Pattern Recognition-sektionen ofte er omkring 300-350 på en enkelt dag, i ‘peak’-perioderne (maj-august og oktober-december, dvs. konference-sæson og ‘årlig kvote-frist’ sæson, hhv.).

Uden for min egen erfaring rapporterer Arxiv selv en rekordantal af indlæg i oktober 2024, med 6000 nye indlæg i alt, og Computer Vision-sektionen som den næst mest indsendte sektion efter Machine Learning.

Men da Machine Learning-sektionen på Arxiv ofte bruges som en ’tilføjelig’ eller samlet super-kategori, argumenterer dette for, at Computer Vision og Pattern Recognition faktisk er den mest indsendte Arxiv-kategori.

Arxivs eget statistik viser bestemt, at computer science er den klare leder i indlæg:

Computer Science (CS) dominerer indlægsstatistik på Arxiv over de sidste fem år. Kilde: https://info.arxiv.org/about/reports/submission_category_by_year.html

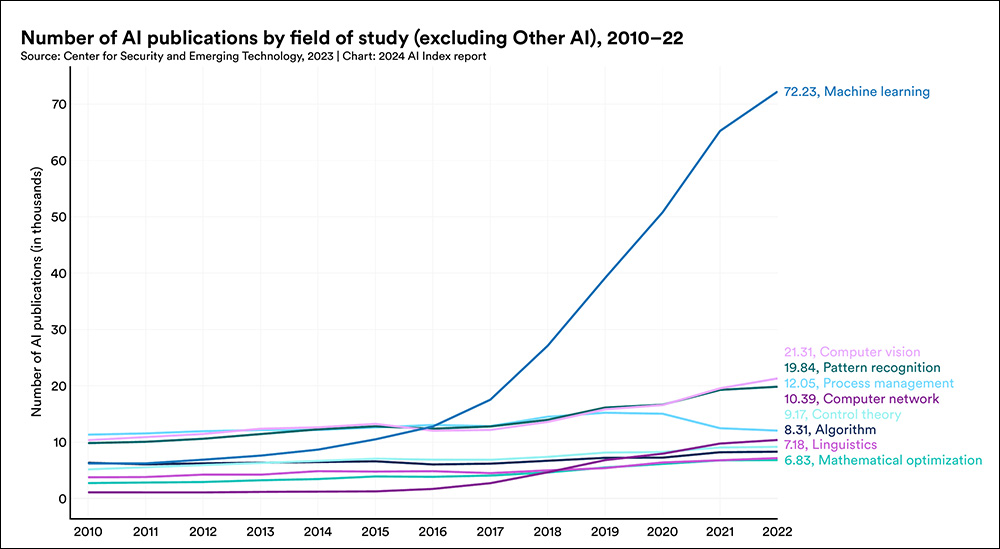

Stanford Universitets 2024 AI Index, selvom det ikke kan rapportere om de seneste statistikker endnu, understreger også den bemærkelsesværdige stigning i indlæg af akademiske papirer omkring machine learning i de seneste år:

Med tal, der ikke er tilgængelige for 2024, viser Stanfords rapport alligevel dramatisk stigningen i indlægs-volumen for machine learning-papirer. Kilde: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Diffusion>Mesh-rammer udbreder sig

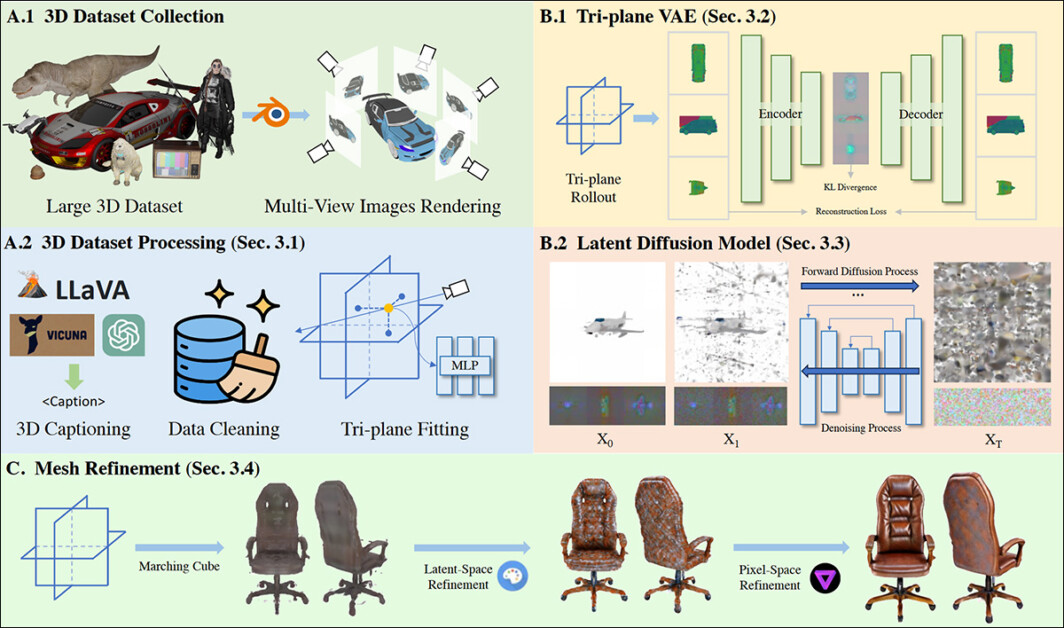

En anden tydelig trend, der opstod for mig, var en stor øgning i papirer, der beskæftiger sig med at udnytte Latent Diffusion Models (LDMs) som generatore af mesh-baserede, ‘traditionelle’ CGI-modeller.

Projekter af denne type inkluderer Tencents InstantMesh3D, 3Dtopia, Diffusion2, V3D, MVEdit, og GIMDiffusion, blandt en mængde andre tilbud.

Mesh-generering og -forbedring via en Diffusion-baseret proces i 3Dtopia. Kilde: https://arxiv.org/pdf/2403.02234

Denne opdykkende forskningsstrang kunne tages som en underforstået indrømmelse af den fortsatte uovervindelighed af generative systemer som diffusion-modeller, som kun to år siden blev fremhævet som en potentiel erstatning for alle de systemer, som diffusion>mesh-modeller nu søger at befolke; og reducerer diffusion til rollen som et værktøj i teknologier og arbejdsgange, der daterer tilbage mere end 30 år.

Stability.ai, oprindeligt udviklerne af det åbne Stable Diffusion-model, har lige udgivet Stable Zero123, som kan, blandt andet, bruge en Neural Radiance Fields (NeRF) fortolkning af en AI-genereret billed som en bro til at skabe en eksplicit, mesh-baseret CGI-model, der kan bruges i CGI-arenaer som Unity, i videospil, augmented reality og på andre platforme, der kræver eksplicitte 3D-koordinater, i modsætning til de implicitte (skjulte) koordinater af kontinuerte funktioner.

Klik for at afspille. Billeder genereret i Stable Diffusion kan konverteres til rationelle CGI-mesh. Her ser vi resultatet af en billed>CGI-arbejdsgang med brug af Stable Zero 123. Kilde: https://www.youtube.com/watch?v=RxsssDD48Xc

3D Semantik

Den generative AI-verden gør en forskel på 2D og 3D systemimplementeringer af vision og generative systemer. For eksempel facial landmarking-rammer, selvom de repræsenterer 3D-objekter (ansigter) i alle tilfælde, behøver de ikke alle nødvendigvis at beregne adressebare 3D-koordinater.

Den populære FANAlign-system, der er bredt anvendt i 2017-æraens deepfake-arkitekturer (blandt andre), kan håndtere begge disse tilgange:

Ovenfor er 2D-landmarks genereret på basis af genkendte ansigtslinjer og -træk. Nedenfor er de rationaliseret til 3D X/Y/Z-rum. Kilde: https://github.com/1adrianb/face-alignment

Sådan som ‘deepfake’ er blevet et tvetydigt og kapret udtryk, er ‘3D’ også blevet et forvirrende udtryk i computer vision-forskning.

For forbrugere har det typisk betydet stereo-aktiveret medie (såsom film, hvor seeren skal bære specielle briller); for visuelle effektkunstnere og -modellører giver det forskellen mellem 2D-kunst (såsom konceptuelle skitser) og mesh-baserede modeller, der kan manipuleres i en ‘3D-program’ som Maya eller Cinema4D.

Men i computer vision betyder det blot, at et Cartesian-koordinatsystem findes et sted i latent-rummet af modellen – ikke, at det nødvendigvis kan addresses eller direkte manipuleres af en bruger; i hvert fald ikke uden tredjepartsfortolkende CGI-baserede systemer som 3DMM eller FLAME.

Derfor er begrebet diffusion>3D ikke præcist; ikke kun kan enhver type billed (herunder et virkeligt foto) bruges som input til at producere en generativ CGI-model, men det mindre tvetydige udtryk ‘mesh’ er mere passende.

Men for at komplicere tvetydigheden er diffusion nødvendig for at fortolke kilde-billedet til en mesh, i de fleste opdykkende projekter. Så et bedre beskrivelse kunne være billed>mesh, mens billed>diffusion>mesh er en endnu mere præcis beskrivelse.

Men det er en hård salgspitch ved en bestyrelsesmøde eller i en pressemeddelelse designet til at engagere investorer.

Bevis på arkitektoniske dødvande

Selv sammenlignet med 2023, viser de sidste 12 måneders afgrøde af papirer en voksende desperation omkring fjernelse af de hårde praktiske begrænsninger for diffusion-baseret generation.

Den centrale hindring forbliver generationen af narrativt og temporalt konsistent video, og opretholdelse af en konsistent fremtoning af karakterer og objekter – ikke kun på tværs af forskellige video-klip, men også på tværs af den korte køretid af en enkelt genereret video-klip.

Den sidste epokale innovation i diffusion-baseret syntese var introduktionen af LoRA i 2022. Mens nyere systemer som Flux har forbedret nogle af de outlier-problemer, såsom Stable Diffusions tidligere manglende evne til at genskabe tekstindhold inde i et genereret billed, og den samlede billedkvalitet er forbedret, var de fleste papirer, jeg studerede i 2024, essentieligt bare flyttede maden rundt på tallerkenen.

Disse dødvande er sket før, med Generative Adversarial Networks (GANs) og Neural Radiance Fields (NeRF), begge hvilke ikke har levet op til deres tilsyneladende initiale potentiale – og begge er mere og mere blevet brugt i mere konventionelle systemer (såsom brugen af NeRF i Stable Zero 123, se ovenfor). Det synes også at ske med diffusion-modeller.

Gaussian Splatting-forskningsskifter

Det syntes at være slutningen af 2023, at rasteriseringsmetoden 3D Gaussian Splatting (3DGS), som debuterede som en medicinsk billedteknik i begyndelsen af 1990’erne, var på vej til pludselig at overgå autoencoder-baserede systemer af menneskesyntese-udfordringer (såsom ansigtssimulering og genskabelse, samt identitets-overføring).

2023 ASH-papiret lovede fuld-legems 3DGS-mennesker, mens Gaussian Avatars tilbød massivt forbedret detaljer (i forhold til autoencoder og andre konkurrerende metoder), sammen med imponerende cross-reenactment.

Dette år har dog været relativt kort på sådanne gennembruds-øjeblikke for 3DGS-menneskesyntese; de fleste af papirerne, der tog sig af problemet, var enten afledt af ovennævnte arbejder eller formåede ikke at overgå deres evner.

I stedet har fokus på 3DGS været på at forbedre dets grundlæggende arkitektoniske gennemførlighed, hvilket har ført til en række papirer, der tilbyder forbedret 3DGS-ydre miljøer. Særlig opmærksomhed er blevet givet til Simultaneous Localization and Mapping (SLAM) 3DGS-tilgange, i projekter som Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, blandt mange andre.

De projekter, der dog forsøgte at fortsætte eller udvide splat-baseret menneskesyntese, inkluderede MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM, og Topo4D. Selvom der er andre end disse, overgik ingen af disse udgaver den initiale impact af papirerne, der opstod i slutningen af 2023.

‘Weinstein-æraen’ for testeksempler er i (langsom) tilbagegang

Forskning fra Sydøstasien generelt (og Kina specifikt) indeholder ofte testeksempler, der er problematiske at genudgive i en gennemgangsartikel, fordi de indeholder materiale, der er lidt ‘spicy’.

Om dette er, fordi forskningsvidenskabsmænd i den del af verden søger at tiltrække opmærksomhed til deres output, er op til debat; men i de sidste 18 måneder er et stigende antal papirer omkring generative AI (billed- og/eller video-) standardiseret til at bruge unge og letklædte kvinder og piger i projekteksampler.

Dette følger den generelle trend i subreddits og andre fællesskaber, der er samlet omkring Latent Diffusion Models (LDMs), hvor Rule 34 stadig er meget til stede.

Celebrity Face-Off

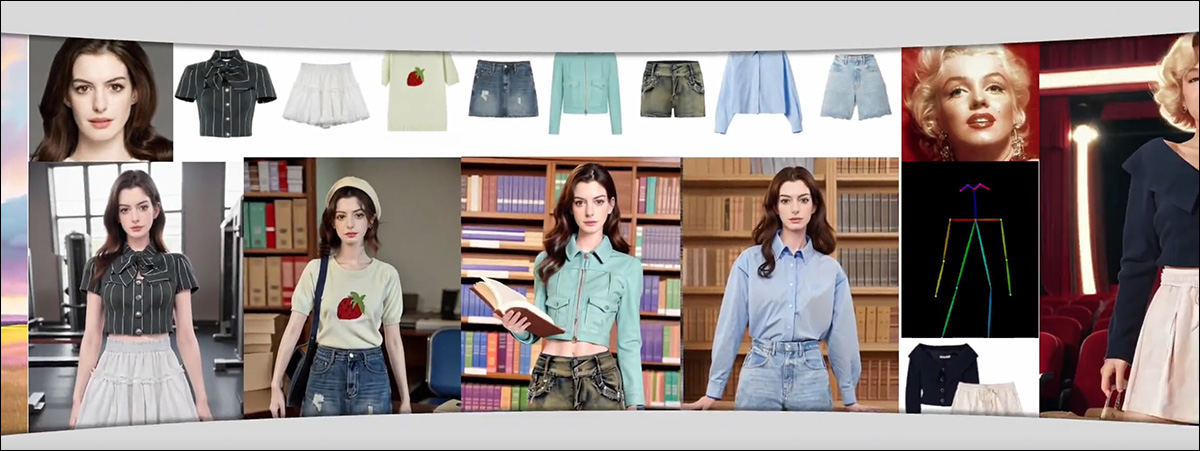

Denne type upassende eksempel overlapper med den voksende erkendelse af, at AI-processer ikke skal arbitrært udnytte berømtheds-lignelser – især i studier, der ukritisk bruger eksempler featuring attraktive berømtheder, ofte kvindelige, og placerer dem i tvivlsomme sammenhænge.

Et eksempel er AnyDressing, som, ud over at indeholde meget unge anime-stil kvindelige karakterer, også frit bruger identiteterne af klassiske berømtheder som Marilyn Monroe, og nuværende som Ann Hathaway (som har fordømt denne type brug meget højlydt).

Arbitrær brug af nuværende og ‘klassiske’ berømtheder er stadig ret almindelig i papirer fra Sydøstasien, selvom praksis er lidt på tilbagegang. Kilde: https://crayon-shinchan.github.io/AnyDressing/

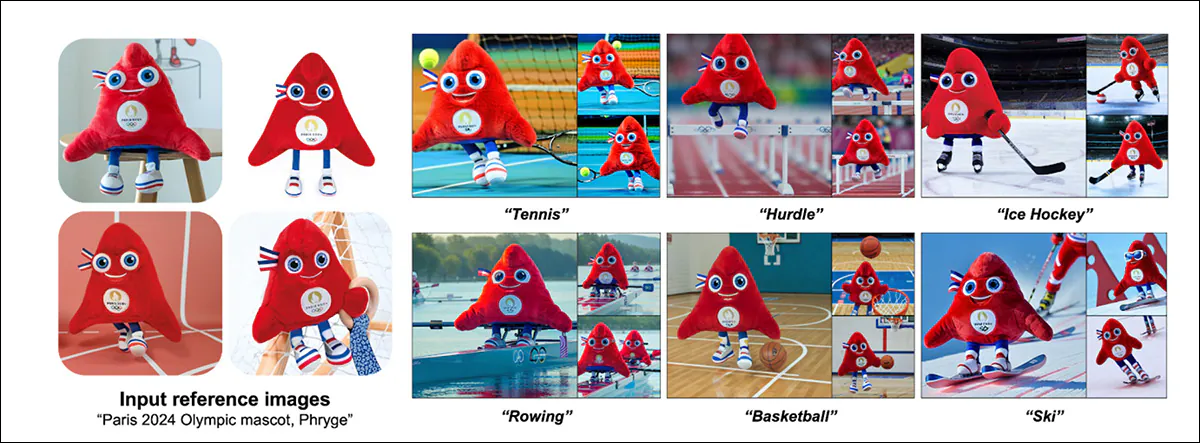

I vestlige papirer er denne specifikke praksis dog bemærkelsesværdigt på tilbagegang gennem 2024, ledt af de større udgivelser fra FAANG og andre store forskningsorganisationer som OpenAI. Kritisk bevidste om den potentielle fremtidige retsforfølgelse, synes disse store virksomheder mere og mere uvillige til at repræsentere selv fiktive fotorealistiske personer.

Selvom systemerne, de skaber (såsom Imagen og Veo2), åbenbart er i stand til sådant output, tendrer eksempler fra vestlige generative AI-projekter nu mod ‘søde’, Disney-fiktionerede og ekstremt ‘sikre’ billeder og videoer.

Trods Imagens kapacitet til at skabe ‘fotorealistisk’ output, er eksemplerne, der fremmes af Google Research, typisk fantastiske, ‘familie’-venlige – fotorealistiske mennesker undgås omhyggeligt, eller kun minimale eksempler leveres. Kilde: https://imagen.research.google/

Face-Washing

I den vestlige CV-litteratur er denne uærlige tilgang særligt tydelig for tilpasnings-systemer – metoder, der kan skabe konsistente lignelser af en bestemt person på tværs af multiple eksempler (dvs. som LoRA og den ældre DreamBooth).

Eksempler inkluderer orthogonal visuel indlejring, LoRA-Composer, Googles InstructBooth, og mange flere.

Googles InstructBooth drejer sødheden op til 11, selvom historien antyder, at brugere er mere interesseret i at skabe fotorealistiske mennesker end pelsklædte eller bløde karakterer. Kilde: https://sites.google.com/view/instructbooth

Den lette måde, hvorpå disse systemer (såsom LoRAs) kan skabes af hjemmebrugere med relativt beskedne hardware, har ført til en eksplosion af frit-downloadbare berømthedsmodeller på civit.ai-domænet og fællesskab. Sådan ulovlig brug forbliver mulig gennem åbenkilden af arkitekturer som Stable Diffusion og Flux.

Selvom det ofte er muligt at bryde igennem sikkerhedsfunktionerne i generative tekst-til-billed (T2I) og tekst-til-video (T2V) systemer for at producere materiale, der er forbudt af en platforms vilkår, lukker gapet mellem de begrænsede funktioner af de bedste systemer (såsom RunwayML og Sora) og de ubegrænsede funktioner af de mere gennemførlige systemer (såsom Stable Video Diffusion, CogVideo og lokale installationer af Hunyuan), ikke rigtigt.

I stedet truer disse proprietære og åbne systemer med at blive lige så ubrugelige: dyre og hyperskala T2V-systemer kan blive excessivt handicappede på grund af frygt for retsforfølgelse, mens manglen på licensierings-infrastruktur og datasæt-overvågning i åbne systemer kan låse dem helt ude af markedet, da strengere reguleringer tager hold.