Andersons vinkel

At bringe visuelle analogier til AI

Nuværende AI-modeller kan ikke genkende ‘relationelle’ billedligheder, såsom hvordan Jordens lag er lignende en fersken, og mangler derfor en nøgleaspekt af, hvordan mennesker opfatter billeder.

Selv om der er mange computer vision-modeller, der kan sammenligne billeder og finde ligheder mellem dem, har den nuværende generation af sammenligningssystemer kun lidt eller ingen fantasifulde evner. Overvej nogle af teksten i den klassiske 1960’er-sang, Windmills of Your Mind:

Som en carussel, der drejer, løber ringe rundt om månen

Som et ur, hvis hænder løber forbi minutterne på dens ansigt

Og verden er som et æble, der hvirvler stille i rummet

Ligheder af denne type repræsenterer et domæne af poetisk henvisning, der er meningsfuld for mennesker på en måde, der går langt ud over kunstnerisk udtryk; snarere er det forbundet med, hvordan vi udvikler vores percipiente systemer; da vi skaber vores ‘objekt’-domæne, udvikler vi en evne til visuel lighed, sådan at – for eksempel – tværsnitsbilleder af en fersken og Jorden, eller fraktale rekursioner såsom kaffespiraler og galaksegrene, registrerer som analoge med os.

På denne måde kan vi slutte forbindelser mellem åbenbart uforbindede objekter og objektyper, og slutte systemer (såsom tyngdekraft, impuls og overfladekohæsion) som kan anvendes på en række domæner i forskellige skalaer.

At se ting

Selv den seneste generation af billedsamlinger AI-systemer, såsom Learned Perceptual Image Patch Similarity (LPIPS) og DINO, der er informeret af menneskelig feedback, udfører kun bogstavelige overflade-sammenligninger.

Deres evne til at finde ansigter, hvor ingen eksisterer – dvs. pareidolia – repræsenterer ikke den type visuelle lighedsmekanismer, som mennesker udvikler, men sker, fordi ansigtssøgende algoritmer anvender lavniveau ansigtstruktur funktioner, der nogen gange er i overensstemmelse med tilfældige objekter:

Eksempler på falske positiver for ansigtsgenkendelse i ‘Faces with Things’-datasettet. Kilde

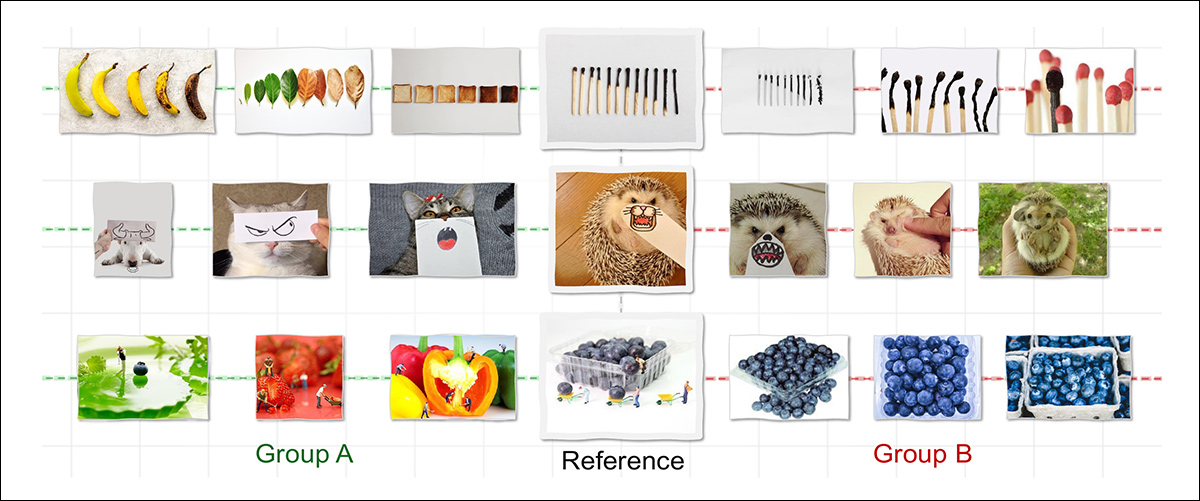

For at afgøre, om maskiner kan udvikle vores fantasifulde kapacitet til at genkende visuel lighed på tværs af domæner, har forskere i USA gennemført en undersøgelse omkring Relationel Visuel Lighed, og har kurateret og trænet en ny dataset, der er designet til at tvinge abstrakte relationer til at danne mellem forskellige objekter, der dog er forbundet af en abstrakt relation:

De fleste AI-modeller genkender kun lighed, når billeder deler overfladetegn såsom form eller farve, hvilket er hvorfor de kun linker Gruppe B (ovenfor) til referencen. Mennesker, til gengæld, ser også Gruppe A som lignende – ikke fordi billederne ligner hinanden, men fordi de følger den samme underliggende logik, såsom at vise en transformation over tid. Det nye arbejde forsøger at genskabe denne type strukturel eller relationel lighed, med det formål at bringe maskinperception nærmere menneskelig tankegang. Kilde: https://arxiv.org/pdf/2512.07833

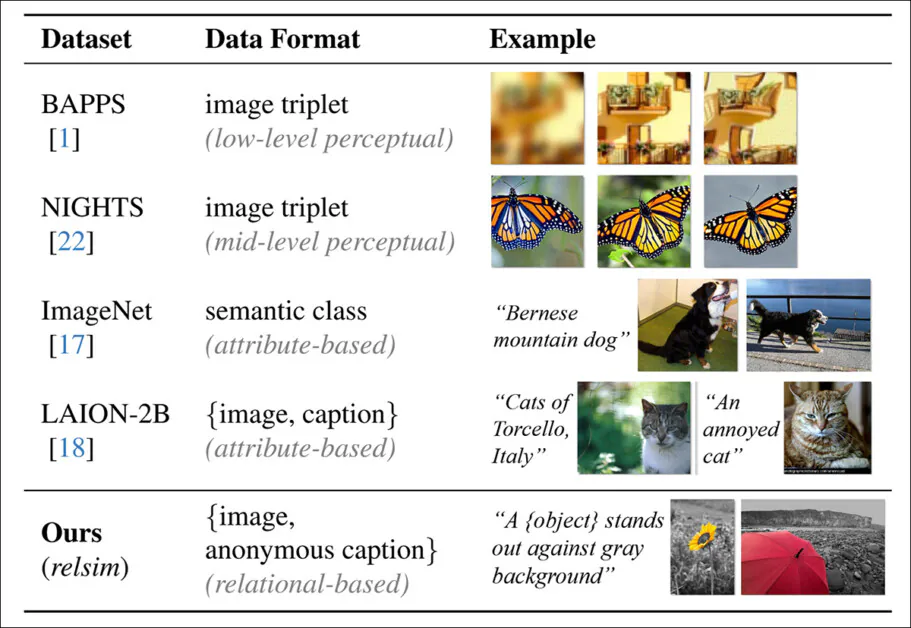

Kaptionsystemet, der er udviklet til datasettet, faciliterer usædvanligt abstrakte annoteringer, designet til at tvinge AI-systemer til at fokusere på basis-karakteristika frem for specifikke lokale detaljer:

De forudsagte ‘anonyme’ kaptions, der bidrager til forfatternes ‘relsim’-målepunkt.

Den kuraterede samling og dens usædvanlige kaptionsstil brænder forfatternes nye foreslåede målepunkt relsim, som forfatterne har finjusteret til en vision-sprog-model (VLM).

En sammenligning mellem kaptionsstilen i typiske dataset, der fokuserer på attributlighed, hvorimod relsim-tilgangen (nederste række) betoner relationel lighed.

Den nye tilgang bygger på metoder fra kognitionsvidenskab, især Dedre Gentners Structure-Mapping-teori (en studie af analogi) og Amos Tverskys definition af relationel lighed og attributlighed.

Fra det associerede projektwebsite, et eksempel på relationel lighed. Kilde