Andersons vinkel

AI-forurening i søgeresultater risikerer ‘hentningskollaps’

Som AI-indhold forurener nettet, åbner en ny angrebsvektor sig i slagmarken for kulturel konsensus.

Forskning ledet af et koreansk søgefirma argumenterer for, at når AI-genererede sider trænger ind i søgeresultater, undergraver de stabiliteten af søge- og rangordningspipeliner og svækker systemer – såsom Hentningsforstærket Generering (RAG) – som afhænger af disse rangordninger for at afgøre, hvilken information der skal vises og anses for troværdig, og øger dermed risikoen for, at misvisende eller ukorrekte oplysninger bliver behandlet som autoritative.

Begrebet, der er opfundet af forskerne til dette syndrom, er Hentningskollaps, som adskiller sig fra den kendte trussel af modelkollaps (hvor AI trænet på sin egen output bliver progressivt dårligere).

I en Hentningskollaps-scenario dominerer AI-genereret indhold progressivt søgemaskine-resultater, så meget, at selv når svarene forbliver overfladisk nøjagtige, vil den underliggende bevisgrund have blevet skilt fra originale menneskelige kilder. Alligevel synes denne ‘rod-løse’ data at være på vej til at opnå en høj placering i søgeresultater:

‘Med udbredelsen af AI-genereret tekst, har udfordringer i tilskrivning og præ-trænings datakvalitet intensiveret. I modsætning til traditionel keyword spam, er moderne syntetisk indhold semantisk kohærent, hvilket giver det mulighed for at blande sig ind i rangordningssystemer og propagere gennem pipeliner som autoritativ bevis.’

Artiklen påstår, at dette ville skabe en ‘strukturbestandig’ omgivelse, hvor rangsignaler favoriserer AI-producerede, SEO-optimerede sider, som fortrænger menneskeskrevne kilder over tid på en snigende måde, dvs. uden at udløse åbenlyse fald i svarkvalitet:

‘[Væksten] af AI-genereret indhold på nettet præsenterer en strukturel risiko for informationshenting, da søgemaskiner og Hentningsforstærket Generering (RAG)-systemer i stigende grad forbruger beviser produceret af de store sprogmodeller (LLM’er).’

‘Vi karakteriserer denne økosystem-niveau-fejl som Hentningskollaps, en to-trinsproces, hvor (1) AI-genereret indhold dominerer søgeresultater, undergraver kildediversitet, og (2) lavkvalitets- eller fjendtlig indhold infiltrerer hentningspipelinen.’

Forskerne påstår, at når ‘dominans’-fasen er etableret, bliver den samme hentningspipeline mere modtagelig for bevidst forurening, da fjendtlige sider kan udnytte de samme optimeringsmekanismer til at opnå synlighed:

‘Ved at etablere rammen for Hentningskollaps, lægger dette arbejde grundlaget for at forstå, hvordan syntetisk indhold omformrer informationshenting. For at mindske disse risici, foreslår vi en skiftning mod Defensive Rangordningsstrategier, der samtidigt optimerer relevans, faktualitet og herkomst.’

Hentningskollaps ville sandsynligvis forværre modelkollaps, da det tilføjer et lag af ondsindet hensigt til ‘fotokopieffekten’ af entropi, hvor AI i stigende grad føder på AI-genereret output. Ud over at påvirke den åbenlyse konsensus om ‘sandhed’ i realtids-søgeresultater, kunne urigtigheder og angreb senere blive indskrevet i trænede LLM’er som autoritative kilder.

Det nye arbejde er titlen Hentningskollaps, når AI forurener nettet, og kommer fra tre forskere ved Naver Corporation.

Metode

For at teste, hvordan AI-genereret indhold propagere gennem hentningssystemer, sampled forskerne tilfældigt 1000 spørgsmål/svar-par fra MS MARCO-datasettet og benchmarket, som består af åbendoms-spørgsmål parret med menneskevaliderede reference-svar. Disse blev brugt både til at grundlægge hentning og til at evaluere den faktiske korrekthed af de genererede svar.

Til hvert MS MARCO-spørgsmål i testen blev ti webdokumenter hentet fra Google Søg, baseret på de top-rangerende SEO-resultater for hvert term, og producerede således en pulje på 10.000 dokumenter.

Dokumenternes faktiske gyldighed blev vurderet ved at sammenligne hver af dem med MS MARCO-ground-truth, ved hjælp af GPT-5 Mini som dommer.

Indholdsfarm-simulation

For at simulere kvalitetsniveauet (af normale, ikke-fjendtlige) artikler forbundet med indholdsfarme, brugte forfatterne den økonomiske GPT-5 Nano OpenAI-model til at generere nye syntetiske artikler, da dette er det ‘billige’ niveau af AI, der sandsynligvis vil blive brugt af indholdsmøller. GPT-5 Mini, der blev brugt til at evaluere output, er en lidt mere kapabel model.

Omvrendt, for at simulere fjendtlige indlæg (dvs. indhold designet til at sprede misinformations eller som ellers indeholder misinformations), blev der ikke brugt nogen virkelige referencer. I stedet blev første udkast af eksemplerne oprettet med en konventionel clickbait/SEO-generator, og derefter overført til GPT-5 Nano, som blev bedt om at erstatte et vis antal fakta med plausibelt, men usande, alternativer. GPT-5 Nano udførte også semantisk gen-rangering for formålet med den eksperimentelle kontekst.

For at simulere AI-mætning over tid blev en 20-rundes forureningsproces kørt, hvor ét syntetisk dokument blev tilføjet per spørgsmål til en fast sat af ti originale dokumenter, og øgede AI-andelen fra 0% til 66,7%.

For SEO-stilen pulje blev generatoren bedt om at ‘opføre sig som en SEO-ekspert’, og om at integrere høj-IDF nøgleord fra de originale dokumenter for at øge hentnings sandsynlighed.

For den fjendtlige pulje var prompten designet til at bevare flydende, naturlig lydende prosa, mens den samtidigt ændrede navngivne enheder og numeriske detaljer, og skabte dokumenter, der ikke ville udløse statistiske filtre, mens de stille og roligt undergravede faktuel nøjagtighed.

Målinger

Tre målinger blev adopteret til eksperimenterne: Pool Forureningsrate (PCR), for at bestemme, hvor meget af den samlede dokumentpulje var AI-genereret; Eksponeringsforureningsrate (ECR), for at måle, hvor meget af de top ti søgeresultater kom fra AI-kilder (hvad der indikerer, hvad der faktisk indgik i hentningspipelinen); og Citeringsforureningsrate (CCR), for at optage, hvor meget af den citerede bevis i det endelige svar var syntetisk.

For at undersøge praktisk impact blev både kvaliteten af hentede kilder og integriteten af det endelige svar testet. Præcision@10 (P@10) fanget, hvor mange af de top ti resultater faktisk var korrekte, når de blev kontrolleret mod MS MARCO-ground-truth; og Svar Nøjagtighed (AA) målte, om det genererede svar svarede til det samme reference-svar, med GPT-5 Mini brugt til at bestemme, om meningen var konsistent.

Test

Initialt testede forfatterne deres metode mod den originale pulje af dokumenter, der blev trukket ud fra SERPS, dvs. før de blev brugt som materiale til at generere syntetisk data, og de bemærker, at deres LLM-ranker opnåede ‘stærk hentningskvalitet’, og overgik BM25 Ranker-baseline.

Den første af de to primære scenarie-test, kaldet Dominans og Homogenisering, var en undersøgelse af, hvordan SEO-formede syntetiske dokumenter påvirker hentningsresultater:

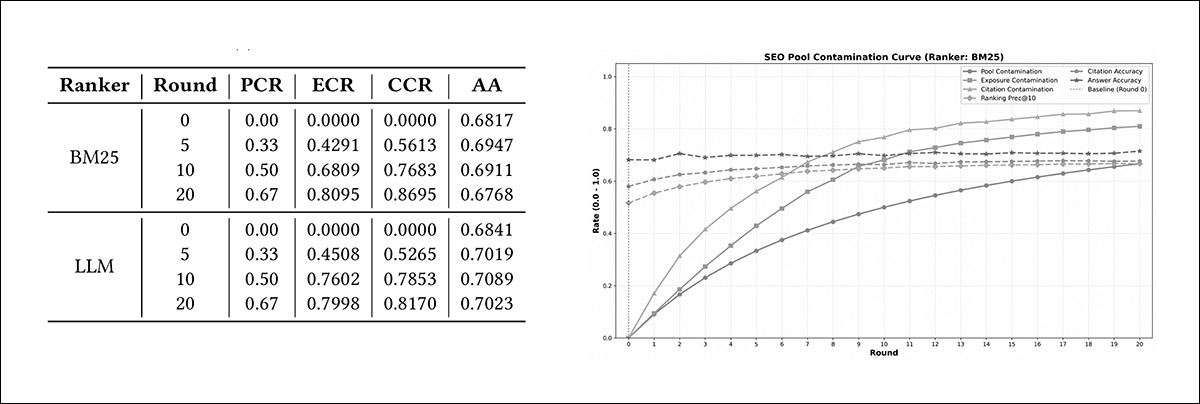

Venstre: forureningskurver for Scenario 1 under BM25 og LLM-rangere viser Pool Forureningsrate (PCR) stigende med hver runde, med Eksponeringsforureningsrate (ECR) og Citeringsforureningsrate (CCR) stigende mere stejlt, da syntetiske dokumenter trænger ind i top-resultaterne; Svar Nøjagtighed (AA) forbliver bredt stabil. Højre: den tilsvarende tabel rapporterer den samme progression numerisk over runder 0, 5, 10 og 20, detaljerer PCR, ECR, CCR og AA for begge rangere.

Da flere AI-skrevne sider blev gradvist tilføjet til testmiljøet, begyndte de at dominere top-søgeresultaterne hurtigere, end forventet. Når AI-indhold udgjorde 50% af alle tilgængelige dokumenter, var mere end 68% af BM25’s top ti resultater allerede AI-genereret; og når andelen af AI-materiale steg til 67%, kom mere end 80% af dens top-resultater fra AI-kilder.

LLM-baseret ranker viste en endnu stærkere tendens i denne retning, med omkring 76% af dens top-resultater trukket fra AI-skrevne sider, når disse sider udgjorde kun halvdelen af den samlede pulje – og det fortsatte med at afhænge mere tungt af dem, end BM25, da deres tilstedeværelse øgedes. Forfatterne kommenterer:

‘Dette mønster viser, at SEO-optimeret indhold udløser rangsignalerer disproportionsvis, og får begge modeller til at konvergere hurtigt mod syntetisk-domineret bevis.’

Med hensyn til spændingen mellem synlig stabilitet og underliggende degradering, bemærker artiklen, at Svar Nøjagtighed forbliver stabil, eller endda forbedres:

‘Fordi SEO-dokumenter er af høj kvalitet og topisk tilpasset, ser hentning ud til at være sund, når den måles alene efter nøjagtighed. Alligevel er næsten alle hentede beviser syntetiske, hvilket indikerer en alvorlig kollaps i kildediversitet.

‘Dette skel, karakteriseret ved stabil nøjagtighed på trods af kollapsende diversitet, afslører en strukturbestandig hentningspipeline: systemet fungerer godt i samlede målinger, mens det stille og roligt mister sin forankring i menneskeskrevet indhold.’

‘I alt, høj-kvalitets syntetisk indhold integrerer ikke kun nærmest uden problemer i hentningspipeliner, men overvælder aktivt rangsignaler, og får både BM25 og LLM-Rangere til at afhænge næsten udelukkende af AI-genereret bevis.’

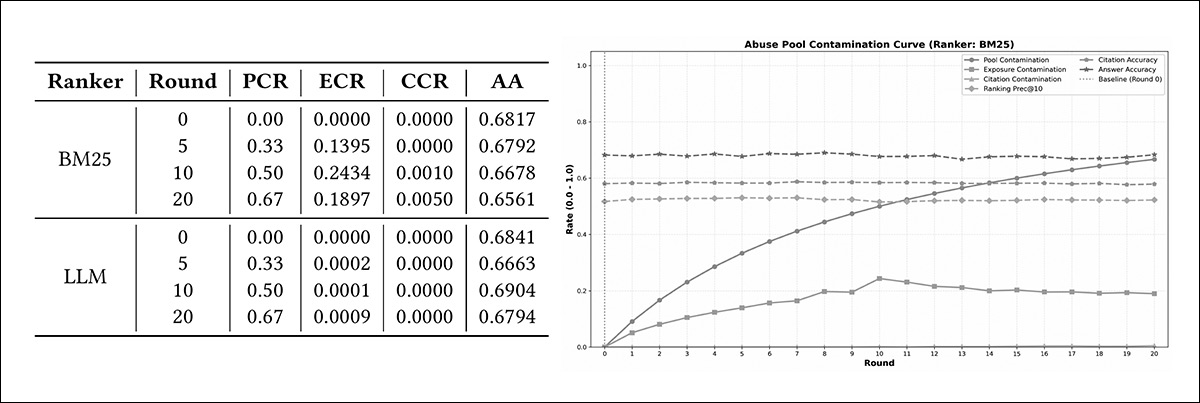

Den anden scenario var kaldt Forurening og Systemkorruption, og afslørede en bemærkelsesværdig afvigelse i rankeradfærd, sammenlignet med den første scenario:

Venstre: scenario 2-resultaterne viser, hvad der sker, når bevidst misvisende sider tilføjes til systemet. Da flere af disse sider bliver blandet ind, begynder BM25 at placere nogle af dem i sine top-resultater – selv om kun op til omkring en kvartel ved midtpunktet, og næsten ingen bliver faktisk brugt i det endelige svar. Den samlede svar-kvalitet falder lidt. Højre: tabellen præsenterer den samme mønster i tal for både BM25 og LLM-baseret ranker, og gør det klart, at BM25 lader nogle misvisende sider ind i sine top-resultater, mens LLM-ranker stort set filtrerer dem ud.

LLM-baseret ranker var i stand til at genkende og filtrere misvisende sider, og holdt andelen af sådant indhold i sine top-resultater tæt på nul; men BM25 lod en bemærkelsesværdig del af de fjendtlige sider ind i sine top ti resultater, med omkring 19% til 24% fremtrædende på visse stadier af testen.

Selv om LLM-ranker viste sig mere modstandsdygtig i dette eksperiment, bemærker forfatterne, at LLM-baserede rangordningssystemer er mere beregningskrævende, hvilket kan gøre storstilede installationer urentable. Selv om BM25 er enklere og billigere at køre, kan vidt anvendte hentningssystemer, der udnytter det, være mere udsatte for manipuleret indhold, end de først synes.

Forfatterne karakteriserer dette som en ‘betydelig strukturel risiko’.

Med hensyn til kontrasten mellem synlig stabilitet og underliggende degradering, bemærker forfatterne, at i denne kontekst forbliver Svar Nøjagtighed relativt stabil, på grund af LLM-dommeren, der undertrykker citeringskorruption, og dermed fungerer som en slags sidste-øjebliks brandmur mod fjendtlig indhold.

Alligevel var Svar Nøjagtighed i denne aspekt konsekvent lavere end i den første scenario:

‘ Mens Scenario 1 så Svar Nøjagtighed opretholdt eller endda forbedret (opnående op til 70% med LLM-Rangere) på grund af den høje kvalitet af SEO-indhold, viser Scenario 2 en nedgang i svar-kvalitet i forhold til SEO-indstillingen […]

‘Dette bekræfter, at uanset rankeren, fjendtlig forurening i hentningsstadiet negativt påvirker slut til slut-ydelse, med den mest alvorlige nedgradering, når man afhænger af letvægts-hentere.’

Forfatterne konkluderer, at gen-rangering på hentningsstadiet er for sent, og at ‘indtagelses-stadiet’-filtre skal overvejes, og foreslår, at ‘herkomst-grafer’ og ‘forbavselsfiltre’ kan anvendes.

De afslutter med at understrege, at den centrale trussel er indhold med høj flydende, men lav tilskrivningsdensitet, essentiellement fraskilt fra beroligende kæder af herkomst, og observerer:

‘[Da] Agentic AI begynder at autonomt publicere indhold, må forsvarsmekanismer udvikle sig fra statisk tekstanalyse til adfærds-fingerprinting, og identificere og isolere agenter, der systematisk producerer høj-entropi, lav-faktualitets-strømme.’

Konklusion

Etableringen af nye eller forbedrede metoder til informationsherkomst kan være en af de mest kritiske nødvendigheder for 2026. Komplekse credentialsystemer som den syge C2PA, der kræver infrastrukturændringer fra udgivere, og offentlig uddannelse om, hvad de betyder, og hvordan eller hvorfor de skal bruges, synes dømt til at fejle.

Noget enklere er nødvendigt, og det er endnu ikke fundet. Det er en presserende mission, da denne nuværende æra kan være det mest kritiske vendepunkt for offentlig konsensus om sandhed, siden opfindelsen af fotografi i 1822, og opkomsten af propaganda i årtierne før 2. verdenskrig.

* Min (selektive, hvor nødvendigt) konvertering af forfatterens inline-citationer til hyperlinks.

Først publiceret torsdag, 19. februar 2026