Kunstig intelligens

Den flygtige definition af ‘Deepfake’

En overbevisende ny studie fra Tyskland kritiserer EU’s AI-acts definition af begrebet ‘deepfake’ som for vag, især i sammenhæng med digital billedmanipulation. Forfatterne argumenterer for, at aktens fokus på indhold, der ligner virkelige personer eller begivenheder – men potentielt kan se falsk ud – mangler klarhed.

De fremhæver også, at aktens undtagelser for ‘standard redigering’ (dvs. angiveligt mindre AI-baserede ændringer af billeder) ikke tager hensyn til både den udbredte indflydelse af AI i forbrugerapplikationer og den subjektive natur af kunstneriske konventioner, der forudgår AI’s opkomst.

Upræcis lovgivning på disse områder giver anledning til to væsentlige risici: en ‘chillende effekt’, hvor lovens brede fortolkningsområde kvæler innovation og tilgangen til nye systemer; og en ‘scofflaw effekt’, hvor loven ignoreres som overgreben eller irrelevant.

I begge tilfælde overfører vag lovgivning effektivt ansvaret for at etablere praktiske juridiske definitioner til fremtidige domstolsafgørelser – en forsigtig og risikofyldt tilgang til lovgivning.

AI-baserede billedmanipulationsteknologier er stadig bemærkelsesværdigt foran lovgivningens evne til at tackle dem, synes det. For eksempel er et bemærkelsesværdigt eksempel på den voksende elasticitet af begrebet AI-drevet ‘automatisk’ efterbehandling, ifølge artiklen, ‘Scene Optimizer’-funktionen i nye Samsung-kameraer, som kan erstatte bruger-taggede billeder af månen (et udfordrende motiv) med et AI-drevet, ‘raffineret’ billede:

Top venstre, et eksempel fra den nye artikel på et virkeligt bruger-tagget billede af månen, til venstre for en Samsung-forbedret version automatisk oprettet med Scene Optimizer; Højre, Samsungs officielle illustration af processen bag dette; nederst venstre, eksempler fra Reddit-brugeren u/ibreakphotos, der viser (venstre) et bevidst uddybet billede af månen og (højre), Samsungs genfortolkning af dette billede – selvom kildebilledet var et billede af en skærm, og ikke den virkelige måne. Kilder (med uret fra top-venstre): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

I nederste venstre del af billedet ovenfor ser vi to billeder af månen. Det til venstre er et billede taget af en Reddit-bruger. Her er billedet bevidst uddybet og formindsket af brugeren.

Til højre ser vi et billede af det samme degraderede billede taget med en Samsung-kamera med AI-drevet efterbehandling aktiveret. Kameraet har automatisk ‘forbedret’ det genkendte ‘måne’-objekt, selvom det ikke var den virkelige måne.

Artiklen retter dybere kritik mod Best Take-funktionen, der er integreret i Googles seneste smartphones – en omstridt AI-funktion, der redigerer sammen de ‘bedste’ dele af et gruppebillede, scannende multiple sekunder af en fotosekvens, så smil kan flyttes frem eller tilbage i tiden efter behov – og ingen er vist i midten af et blunk.

Artiklen påstår, at denne type sammensat proces har potentialet til at misrepræsentere begivenheder:

‘[I] en typisk gruppebillede-sætning ville en gennemsnitlig tilskuere sandsynligvis stadig betragte det resulterende billede som ægte. Smilet, der er indsat, fandtes inden for et par sekunder fra det resterende billede, der blev taget.

‘På den anden side er ti-sekunders tidsrammen for Best Take-funktionen tilstrækkelig til en humørændring. En person kan have stoppet med at smile, mens resten af gruppen ler ad en vittighed på deres bekostning.

‘Som følge heraf antager vi, at sådant et gruppebillede kan udgøre en deep fake.’

Den nye artikel har titlen Hvad udgør en Deep Fake? Den uklare grænse mellem legitimitet og manipulation under EU’s AI-akt og kommer fra to forskere ved Computational Law Lab på University of Tübingen og Saarland University.

Gamle tricks

At manipulere med tid i fotografering er langt ældre end forbruger-niveau AI. Artiklens forfattere bemærker eksistensen af langt ældre teknikker, der kan argumenteres for at være ‘uægte’, såsom sammensætning af multiple sekventielle billeder til et High Dynamic Range (HDR)-billede eller et ‘syet’ panoramabillede.

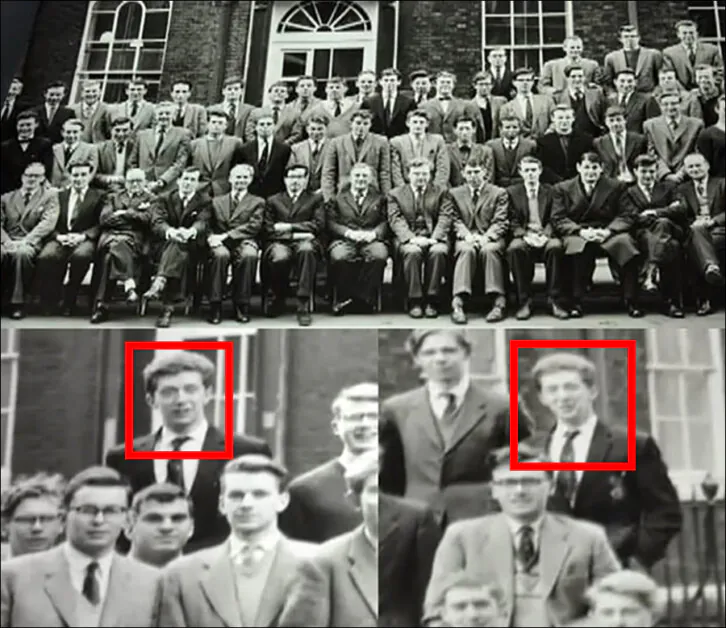

Sandt enough, nogle af de ældste og mest underholdende fotografiske falsknerier blev traditionelt skabt af skolebørn, der løb fra den ene ende af en skolegruppe til den anden, foran trajektorien af de specielle panoramakameraer, der engang blev brugt til sports- og skolegruppefotografering – hvilket gjorde det muligt for eleven at fremstå to gange i samme billede:

Fristelsen til at narre panoramakameraer under gruppefotografering var for stor for mange studerende, der var villige til at risikere en dårlig session i skolens kontor for at ‘klone’ sig selv i skolefotografier. Kilde: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Medmindre du tager et billede i RAW-mode, der grundlæggende dumpes kamera-linsensensor til en meget stor fil uden nogen form for fortolkning, er det sandsynligt, at dine digitale billeder ikke er fuldstændigt ægte. Kamera-systemer anvender rutinemæssigt ‘forbedrings’-algoritmer som billedskærpe og hvidbalance, som standard – og har gjort det siden begyndelsen af forbruger-niveau digital fotografering.

Artiklens forfattere argumenterer for, at selv disse ældre typer af digitalt foto-forbedring ikke repræsenterer ‘virkelighed’, da disse metoder er designet til at gøre billeder mere tilfredsstillende, ikke mere ‘ægte’.

Studiet foreslår, at EU’s AI-akt, selv med senere ændringer som recitals 123–27, placerer alle fotografiske output inden for en bevis-ramme, der ikke er egnet til den kontekst, hvori billeder produceres i disse dage, i modsætning til den (nominelt objektive) natur af sikkerheds-kameraoptagelser eller retsmedicinsk fotografering. De fleste billeder, der er omfattet af AI-akten, er mere sandsynligt at stamme fra kontekster, hvor producenter og online-platforme aktivt fremmer kreativ fotofortolkning, herunder brug af AI.

Forskerne foreslår, at billeder ‘aldrig har været en objektiv fremstilling af virkelighed’. Overvejelser som kameraets placering, valget af dybdeskarphed og lysvalg bidrager alle til at gøre et billede dybt subjektivt.

Artiklen bemærker, at rutinemæssige ‘rydnings’-opgaver – såsom fjernelse af sensordust eller uønskede el-ledninger fra et ellers velkomponeret motiv – kun var semi-automatiseret før opkomsten af AI: brugere måtte manuelt vælge en region eller initiere en proces for at opnå deres ønskede resultat.

I dag udløses disse operationer ofte af en brugers tekstprompt, især i værktøjer som Photoshop. På forbruger-niveau er disse funktioner stadig mere automatiseret uden brugerinput – en udfald, der åbenbart anses for at være ‘åbenbart ønskeligt’ af producenter og platforme.

Den udvandede betydning af ‘Deepfake’

En central udfordring for lovgivning omkring AI-forandret og AI-genereret billedmateriale er den tvetydighed af begrebet ‘deepfake’, der har haft sin betydning udvidet betragteligt over de sidste to år.

Oprindeligt anvendtes begrebet kun til video-output fra autoencoder-baserede systemer som DeepFaceLab og FaceSwap, begge afledt fra anonym kode, der blev offentliggjort på Reddit i slutningen af 2017.

Fra 2022 kom Latent Diffusion Models (LDMs) som Stable Diffusion og Flux, samt tekst-til-video-systemer som Sora, der også tillod identitets-udskiftning og tilpasning, med forbedret opløsning, fleksibilitet og troværdighed. Nu var det muligt at skabe diffusion-baserede modeller, der kunne afbilde berømtheder og politikere. Da begrebet ‘deepfake’ allerede var en overskriftsgenererende skat for medieproducenter, blev det udvidet til at dække disse systemer.

Senere, i både medier og forskningslitteratur, kom begrebet også til at omfatte tekstbaseret efterligning. På dette tidspunkt var den oprindelige betydning af ‘deepfake’ næsten tabt, mens dens udvidede betydning var konstant i udvikling og blev mere og mere udvandet.

Men da ordet var så brændende og galvaniserende, og var ved at blive en kraftfuld politisk og medie-relateret reference, viste det sig umuligt at give op. Det tiltrak læsere til websites, funding til forskere og opmærksomhed til politikere. Denne leksikalske tvetydighed er hovedfokus for den nye forskning.

Som forfatterne bemærker, artikel 3(60) i EU’s AI-akt fastlægger fire betingelser, der definerer en ‘deepfake’.

1: Sand måne

Først og fremmest skal indholdet være genereret eller manipuleret, dvs. enten skabt fra scratch ved hjælp af AI (generering) eller ændret fra eksisterende data (manipulation). Artiklen fremhæver vanskeligheden ved at skelne mellem ‘acceptabel’ billedredigering og manipulerende deepfakes, givet at digitale billeder under alle omstændigheder aldrig er sande repræsentationer af virkelighed.

Artiklen påstår, at en Samsung-genereret måne er sandsynligvis ægte, da månen er usandsynlig at ændre udseende, og da AI-genereret indhold, trænet på virkelige månebilleder, derfor sandsynligvis er nøjagtigt.

Men forfatterne påstår også, at da Samsung-systemet er blevet vist til at generere et ‘forbedret’ billede af månen i et tilfælde, hvor kildebilledet ikke var månen selv, ville dette være betragtet som en ‘deepfake’.

Det ville være uvirkeligt at opstille en omfattende liste over forskellige brugsområder omkring denne type ad hoc-funktion. Derfor synes byrden af definition at gå over til domstolene.

2: TextFakes

Anden, indholdet skal være i form af billede, lyd eller video. Tekstindhold, selvom det er underlagt andre transparensforpligtelser, anses ikke for at være en deepfake under AI-akten. Dette er ikke dækket i detaljer i den nye studie, selvom det kan have en bemærkelsesværdig indvirkning på effektiviteten af visuelle deepfakes (se nedenfor).

3: Virkelige problemer

Tredje, indholdet skal ligne eksisterende personer, objekter, steder, enheder eller begivenheder. Denne betingelse etablerer en forbindelse til den virkelige verden, hvilket betyder, at ren fabrikeret billedmateriale, selvom det er fotorealistisk, ikke ville kvalificere som en deepfake. Recital 134 i EU’s AI-akt understreger ‘lignende’-aspektet ved at tilføje ordet ‘appreciably’ (en åbenbar henvisning til senere retslige afgørelser).

Forfatterne, der citerer tidligere arbejde, overvejer, om et AI-genereret ansigt nødvendigvis skal tilhøre en virkelig person, eller om det kun skal ligne en virkelig person, for at opfylde denne definition.

For eksempel, hvordan kan man afgøre, om en sekvens af fotorealistiske billeder, der afbilder politikeren Donald Trump, har til hensigt at efterligne, hvis billederne (eller tilføjet tekst) ikke specifikt nævner ham? Ansigtsgenkendelse? Brugerundersøgelser? En dommers definition af ‘sund fornuft’?

Vendende tilbage til ‘TextFakes’-spørgsmålet (se ovenfor), udgør ord ofte en betydelig del af handlingen af en visuel deepfake. For eksempel er det muligt at tage et (uændret) billede eller video af ‘person a’ og sige, i en undertekst eller en sociale medie-opslag, at billedet er af ‘person b’ (antagende, at de to personer ligner hinanden).

I sådant tilfælde er der ingen AI nødvendig, og resultatet kan være slående effektivt – men udgør en sådan lavteknologisk tilgang også en ‘deepfake’?

4: Retouch, Remodel

Til sidst skal indholdet se ægte eller sandt ud for en person. Denne betingelse understreger opfattelsen af menneskelige tilskuere. Indhold, der kun kan genkendes som repræsentation af en virkelig person eller objekt af en algoritme, ville ikke være betragtet som en deepfake.

Af alle betingelser i 3(60) er denne den, der mest åbenlyst henviser til den senere dom af en ret, da den ikke tillader nogen fortolkning via tekniske eller mekaniserede midler.

Der er åbenlyst nogle indbyggede vanskeligheder ved at nå til enighed om en så subjektiv bestemmelse. Forfatterne bemærker for eksempel, at forskellige mennesker og forskellige typer mennesker (såsom børn og voksne) kan være forskelligt disponeret til at tro på en bestemt deepfake.

Forfatterne fremhæver yderligere, at de avancerede AI-kapaciteter i værktøjer som Photoshop udfordrer traditionelle definitioner af ‘deepfake.’ Selvom disse systemer kan inkludere grundlæggende sikkerhedsforanstaltninger mod kontroversielt eller forbudt indhold, udvider de dramatisk begrebet ‘retouchering.’ Brugere kan nu tilføje eller fjerne objekter på en overbevisende, fotorealistisk måde, opnå en professionel niveau af ægthed, der gendefinerer grænserne for billedmanipulation.

Forfatterne påstår:

‘Vi argumenterer for, at den nuværende definition af deep fakes i AI-akten og de tilsvarende forpligtelser ikke er tilstrækkeligt specificeret til at tackle udfordringerne, der stilles af deep fakes. Ved at analysere livscyklussen af et digitalt billede fra kamera-sensoren til de digitale redigeringsfunktioner, finder vi, at:

‘(1.) Deep fakes er dårligt defineret i EU’s AI-akt. Definitionen efterlader for megen plads til, hvad en deep fake er.

‘(2.) Det er uklart, hvordan redigeringsfunktioner som Googles “best take”-funktion kan betragtes som en undtagelse til transparensforpligtelser.

‘(3.) Undtagelsen for væsentligt redigeret indhold rejser spørgsmål om, hvad der udgør væsentlig redigering af indhold og om denne redigering nødvendigvis skal være perceptibel for en naturlig person.’

Tag undtagelse

EU’s AI-akt indeholder undtagelser, som forfatterne argumenterer for, kan være meget tilladende. Artikel 50(2), påstår de, tilbyder en undtagelse i tilfælde, hvor størstedelen af det originale kildebillede ikke er ændret. Forfatterne bemærker:

‘Hvad kan betragtes som indhold i forstand med artikel 50(2) i tilfælde af digital lyd, billeder og videoer? For eksempel, i tilfælde af billeder, skal vi overveje pixel-rummet eller det synlige rum, der er perceptibelt for mennesker? Væsentlige manipulationer i pixel-rummet kan ikke ændre menneskelig perception, og på den anden side kan små forstyrrelser i pixel-rummet ændre perception dramatisk.’

Forskerne giver eksemplet på at tilføje en hånd-pistol til et billede af en person, der peger på nogen. Ved at tilføje pistolen ændres kun 5% af billedet; dog er den semantiske betydning af den ændrede del bemærkelsesværdig. Derfor synes denne undtagelse ikke at tage hensyn til nogen ‘sund fornuft’-forståelse af, hvordan en lille detalje kan have en betydelig indvirkning på den overordnede betydning af et billede.

Artikel 50(2) tillader også undtagelser for en ‘assist-funktion til standardredigering’. Da akten ikke definerer, hvad ‘standardredigering’ betyder, synes selv post-procesfunktioner som Googles Best Take at være beskyttet af denne undtagelse, påstår forfatterne.

Konklusion

Den erklærede intention bag det nye arbejde er at opmuntre til tværfaglig studie omkring regulering af deepfakes og at fungere som et udgangspunkt for nye dialoger mellem computerforskere og juridiske eksperter.

Men artiklen selv giver efter for tautologi på flere punkter: den bruger ofte begrebet ‘deepfake’ som om dets betydning var selvindlysende, mens den samtidig kritiserer EU’s AI-akt for ikke at definere, hvad der faktisk udgør en deepfake.

Først udgivet mandag, 16. december 2024