Tankeledere

En Praktisk Playbook for Forsvarelige LLM-Output

Der er en stille antagelse, der løber gennem de fleste virksomheds GenAI-udrulninger: hvis output ser rigtigt ud, er det rigtigt. I lav-risiko-miljøer er det en rimelig genvej. I regulerede brancher, som sundhedsvesen, finans, farmaci og kvalitetssikring, er det en ansvarlig skyld, der venter på at komme til overfladen.

I øjeblikket, hvor en LLM-output påvirker en klinisk beslutning, en finansielle post eller en overholdelsesdokument, stopper flydende med at være en proxy for pålidelighed. Og når en revisor, tilsynsførende eller juridisk hold spørger, hvilke data der blev brugt, hvilke regler der blev anvendt, og hvem godkendte det, er “modellen sagde så” ikke et svar, nogen kan godkende.

Dette er ansvarslønnen, som de fleste GenAI-hold ikke designer for. Her er, hvordan man lukker den.

Hvorfor “Ser Rigtigt Ud” Er Den Forkerte Standard

Traditionel AI-evaluering fokuserer på nøjagtighed, latency og omkostninger. Disse ting betyder noget. Men regulerede miljøer introducerer en fjerde akse, som de andre ikke kan erstatte: gennemskuelighed.

Den EU AI-lov, der nu er i kraft, kræver, at højrisiko-AI-systemer vedligeholder teknisk dokumentation, sporbarhedslæg og bevis for menneskelig tilsyn gennem deres livscyklus. Den FDA’s første udkast til vejledning om AI i lægemiddel- og biologisk udvikling peger i samme retning for life sciences. Disse rammer bedømmer ikke flydende. De kræver systemer, der kan rekonstrueres, inspiceres og forsvares.

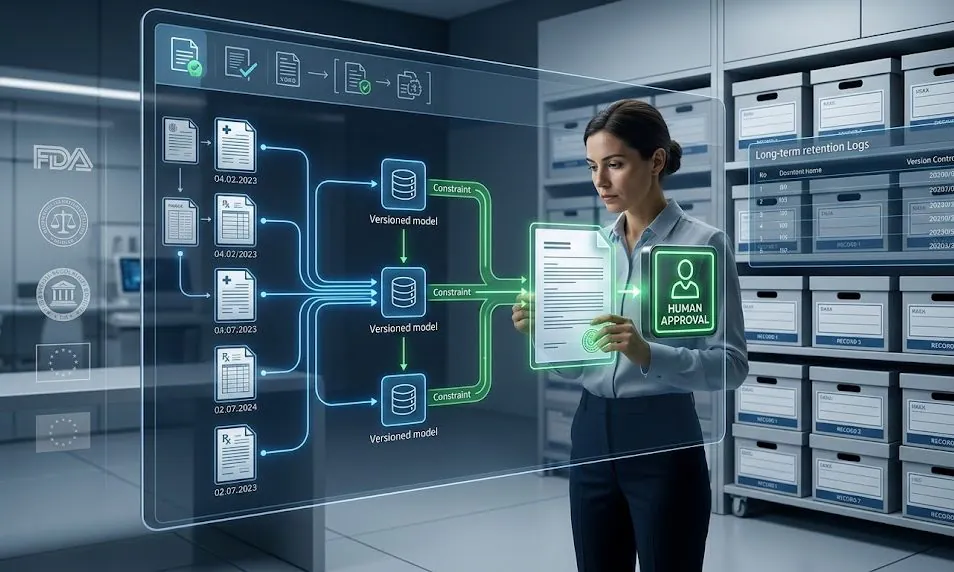

En forsvarlig LLM-output er en, der kan spores tilbage gennem en verificerbar kæde af beviser: hvilke data den trak fra, hvilke begrænsninger formede den, hvem gennemgik den, og hvad der blev fastholdt til fremtidig inspektion. Uden den kæde er selv en korrekt output uforsvarlig.

Dette omdefinerer, hvad “produktionsklar” faktisk betyder for AI i styrede miljøer.

De Fire Søjler for Audit-Klare GenAI

Opbygning af forsvarlige LLM-systemer kommer ned til fire tekniske krav. De er ikke abstrakte principper – de er infrastruktur-beslutninger, der bestemmer, om dit system kan overleve skarpe øjne.

1. Proveniens: Kontroller, Hvor Modellen Får Sin Information

Den mest almindelige fejltype i virksomheds-AI er også den mindst synlige: modeller, der trækker på almindelig viden eller løst definerede datakilder. Når der ikke er en kontrolleret viden-grænse, kan outputs ikke spores tilbage til nogen gennemskuelig kilde, og rekonstruktion bliver umulig.

En praktisk løsning er at etablere en godkendt viden-grænse: versionerede, ejede dokumenter og datasæt, som systemet eksplicit er tilladt at bruge. Hver svar skal medføre en minimums-bevis-pakke: en kilde-identifikator med version og effektiv dato, en hentnings-log, der viser, hvad der blev forespurgt og valgt, og inline-citationer. En nyttig driftsregel: ingen citation, ingen påstand.

Dette konverterer systemet fra hukommelsesbaseret generation til bevisbaseret argumentation. Forskellen bliver kritisk, når nogen skal rekonstruere en specifik output uger eller måneder efter, den blev genereret.

2. Begrænsninger: Erstat Improvisation Med Kontrolleret Adfærd

LLM’er er bygget til at være overbevisende. Uden begrænsninger optimerer de for plausibilitet, og plausibilitet i et reguleret kontekst er, hvor risikoen bor.

Begrænsninger er mekanismen, der omdanner en probabilistisk tekstgenerator til en begrænset eksekutionskomponent. I praksis betyder det:

- Kilde-bunden generation: Hver påstand kræver en godkendt, versioneret kilde. Ingen kilde betyder ingen svar — kun afvisning eller eskalering.

- Struktureret output-skema: Svar følger definerede formater, som maskiner og revisorer kan validere, ikke kun læse.

- Tillids-grænse-gennemføring: Hentet indhold behandles som input, der direkte adresse prompt-injektions-risici, der kan undergrave både sikkerhed og gennemskuelighed.

- Mindst-privilegeret adgang: Modellen interagerer kun med de data og værktøjer, den virkelig behøver, og holder revisions-spor rene.

Begrænsninger er ikke en overholdelses-boks, der skal afkrydses. De er den arkitektoniske beslutning, der bestemmer, om dit system kan gennemskues overhovedet.

3. Gennemgang: Gør Menneskelig Tilsyn Til En Formal Kontrol-Lag

I reguleret AI kan menneskelig gennemgang ikke være ad hoc. Den skal være risiko-stratificeret (højere-risiko-outputs udløser strengere validering) og begivenheds-dreven, aktiverer, når model-tillid er lav, kilder er fraværende, eller anomalier er registreret.

Den EU AI-lov udtrykkeligt kræver, at mennesker kan fortolke, omgøre og standse AI-drevne beslutninger i høj-risiko-brugssager. At opfylde dette krav betyder, at gennemgangs-optegnelser skal fange, hvem godkendte en output, under hvilke betingelser, og med hvilket niveau af gennemgang. “Nogen tjekkede det” er ikke en kontrol. En dokumenteret, tidsstempel-gennemgangs-optegnelse er.

Dette hæver gennemgang fra manuel QA til en formal styre-lag, som er præcis, hvordan tilsynsførende begynder at behandle det.

4. Fastholdelse: Gør Ansvar Durable

Uden logfiler er der ingen revisions-spor. Uden revisions-spor er ansvar teoretisk.

På samme tid skaber fastholdelse af alt sin egen risiko, især hvor følsomme sundheds- eller finansielle data er underlagt minimiserings-krav under rammer som GDPR eller HIPAA.

Den praktiske tilgang er en trin-model. Gem altid model- og versions-metadata, kilde-identifikatorer, politik-beslutninger og tidsstemplede. Gem interaktions-indhold (prompts, outputs og fulde spor) selektivt, baseret på risiko-klassificering, med passende redigering og adgangskontrol. Målet er at muliggøre rekonstruktion af enhver output uden at over-samle data, der skaber downstream-eksponering.

Hvad Dette Ser Ud Som I Praksis

Overvej, hvordan dette anvendes i life sciences, hvor CFR 21 Part 11 kræver, at elektroniske optegnelser er tilskrivelige, læselige, samtidige, originale og nøjagtige. En LLM, der genererer regulerende dokumentation, skal opfylde alle fem kriterier – ikke kun producere læselig tekst.

I denne kontekst er de fire søjler ikke valgfrie forbedringer. De er den minimale barriere for et overholdelses-dygtigt system. Proveniens sikrer, at output er tilskrivelig og original. Begrænsninger sikrer, at den forbliver inden for definerede grænser. Gennemgang sikrer, at den er samtidig med menneskelig tilsyn. Fastholdelse sikrer, at den er læselig og inspekterbar.

Den samme logik gælder i finansielle tjenester, hvor MiFID II kræver optegnelser over beslutninger og den bagvedliggende begrundelse, og i sundhedsvesenet, hvor kliniske beslutnings-støtte-systemer står over for øget skarpe øjne over forklarbarhed og bias.

Den Større Skift

GenAI bevæger sig fra eksperimenter til operationel infrastruktur. Denne overgang hæver standarden for, hvad accepterede systemer ser ud som.

Et nyttigt output er ikke længere nok. Organisationer har brug for outputs, der kan forklares, spores og forsvares under skarpe øjne, fordi AI bedes om at gøre ting, der har reelle konsekvenser.

Holdene, der designer for forsvarighed fra starten, vil være positioneret til at skale AI sikkert og opretholde regulerings-tillid. De, der ikke gør det, vil til sidst stå over for det samme øjeblik: en revision, et direkte spørgsmål om en specifik output, og intet at vise for det.

At bygge audit-klar AI er ikke om at gå langsommere. Det er om at bygge noget, der kan vare ved.