Andersonův úhel

Směřování k úplné kontrole v generaci videa pomocí AI

Základní modely videa, jako je Hunyuan a Wan 2.1, jsou sice výkonné, ale nenabízejí uživatelům takový druh jemné kontroly, jaký vyžaduje filmová a televizní produkce (zejména produkce vizuálních efektů).

V profesionálních studiích vizuálních efektů se tyto open-source modely, spolu s dříve používanými modely založenými na obrazech (místo videa), jako je Stable Diffusion, Kandinsky a Flux, obvykle používají spolu s řadou podpůrných nástrojů, které upravují jejich surový výstup, aby splňovaly konkrétní tvořivé potřeby. Když režisér řekne: “To vypadá skvěle, ale můžeme to udělat trochu více [n]?” nemůžete odpovědět tím, že model není dostatečně přesný, aby zvládl takové požadavky.

Místo toho tým AI VFX použije řadu tradičních CGI a kompozičních technik, spojených s vlastními postupy a pracovními postupy, vyvinutými v průběhu času, aby se pokusil posunout hranice syntézy videa trochu dále.

Takže podobně jako základní model videa je podobný výchozí instalaci webového prohlížeče, jako je Chrome; dělá mnoho věcí automaticky, ale pokud chcete, aby se přizpůsobil vašim potřebám, spíše než naopak, budete potřebovat některé doplňky.

Kontrolní freakové

Ve světě difuzní syntézy obrazů je nejvýznamnější takový třetí stranou systém ControlNet.

ControlNet je technika pro přidání strukturované kontroly do difuzních generativních modelů, která umožňuje uživatelům vést generaci obrazů nebo videa pomocí dalších vstupů, jako jsou hrany map, hloubkové mapy nebo informace o poloze.

Různé metody ControlNetu umožňují hloubku>obraz (horní řádek), segmentaci>obraz (dolní levá) a generaci obrazů lidí a zvířat s pomocí polohy (dolní levá).

Místo toho, aby se spoléhal pouze na textové podněty, ControlNet zavádí samostatné neuronové síťové větve, nebo adaptery, které zpracovávají tyto kondicionální signály, zatímco zachovávají generativní schopnosti základního modelu.

To umožňuje jemně nastavené výstupy, které se více blíží specifikacím uživatelů, což je besonders užitečné v aplikacích, kde je vyžadována přesná kompozice, struktura nebo kontrola pohybu:

S pomocí polohy lze pomocí ControlNetu získat různé typy přesných výstupů. Source: https://arxiv.org/pdf/2302.05543

Nicméně, rámce založené na adaptech tohoto druhu fungují externě na sadě neuronových procesů, které jsou velmi vnitřně zaměřené. Tyto přístupy mají několik nevýhod.

Za prvé, adapty jsou trénovány nezávisle, což vede k konfliktům větví při kombinaci více adaprů, což může vést ke zhoršení kvality generování.

Za druhé, zavedou redundanci parametrů, vyžadující další výpočet a paměť pro každý adaptr, což činí škálování neefektivním.

Za třetí, navzdory jejich flexibilitě, adapty často produkují suboptimální výsledky ve srovnání s modely, které jsou plně upraveny pro multi-kondicionální generaci. Tyto problémy činí metody založené na adaptech méně efektivními pro úkoly, které vyžadují bezproblémovou integraci více kontrolních signálů.

Ideálně by měly být kapacity ControlNetu trénovány nativně do modelu, modulárním způsobem, který by mohl akomodovat pozdější a očekávané inovace, jako je současná generace videa a audio, nebo nativní capabilities lip-sync (pro externí audio).

Jak stojí, každý další kus funkcionality představuje buď úloha post-produkce nebo ne-nativní procedura, která musí navigovat přes těsně vázaná a citlivá váha základního modelu, na kterém funguje.

FullDiT

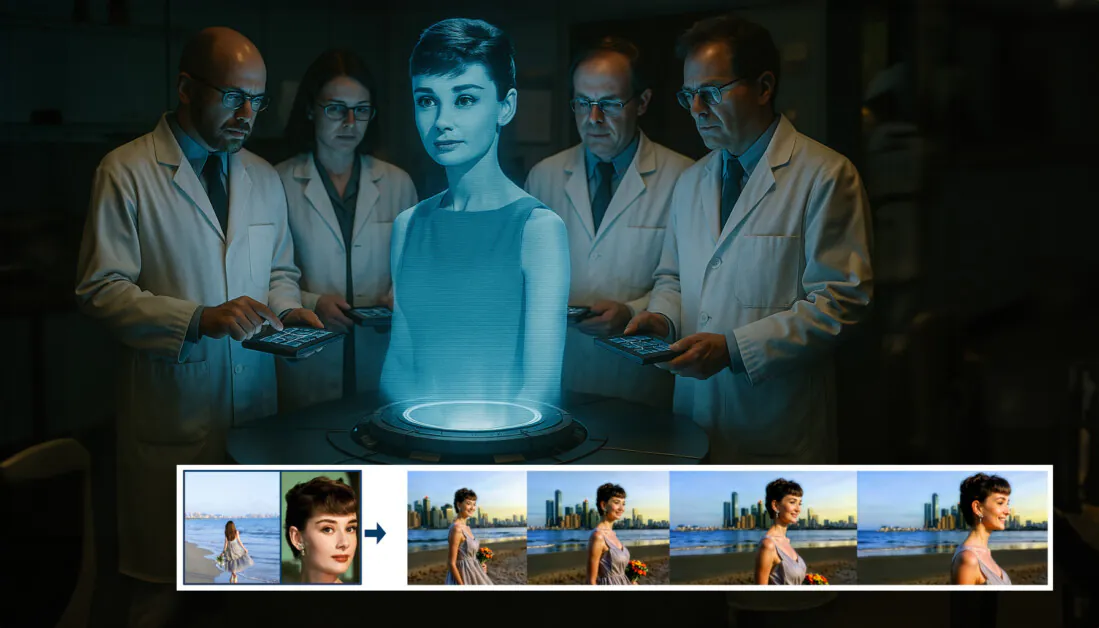

Do tohoto patové situace přichází nová nabídka z Číny, která navrhuje systém, ve kterém jsou opatření ControlNet-style přímo integrována do generativního modelu videa v době trénování, místo aby byly ponechány jako následná myšlenka.

Nová práce: přístup FullDiT může zahrnout uvalení identity, hloubky a pohybu kamery do nativní generace a může vyvolat libovolnou kombinaci těchto prvků najednou. Source: https://arxiv.org/pdf/2503.19907

Nazvaný FullDiT, nový přístup spojuje multi-úkolové podmínky, jako je uvalení identity, mapování hloubky a pohyb kamery, do integrované části trénovaného generativního modelu videa, pro který autoři vytvořili prototyp trénovaného modelu a doprovodné video-klipy na projektové stránce.

V následujícím příkladu vidíme generace, které zahrnují pohyb kamery, informaci o identitě a textovou informaci (tj. řídící uživatelské textové podněty):

Klikněte pro přehrávání. Příklady kontrolních opatření ControlNet-style s pouze nativním trénovaným základním modelem. Source: https://fulldit.github.io/

Mělo by být poznamenáno, že autoři nepředkládají svůj experimentální trénovaný model jako funkční základový model, ale spíše jako důkaz konceptu pro nativní text-to-video (T2V) a image-to-video (I2V) modely, které nabízejí uživatelům více kontroly než pouze obrazový podnět nebo textový podnět.

Protože neexistují žádné podobné modely tohoto druhu, výzkumníci vytvořili novou benchmarckovou sadu nazvanou FullBench, pro hodnocení multi-úkolového videa, a tvrdí, že dosáhli nejlepších výsledků ve srovnání s předchozími přístupy. Nicméně, jelikož FullBench byl navržen autory sami, jeho objektivity je neověřená, a jeho dataset 1 400 případů může být příliš omezený pro širší závěry.

Možná nejzajímavějším aspektem architektury, kterou článek předkládá, je jeho potenciál zahrnout nové typy kontroly. Autoři uvádějí:

‘V této práci prozkoumáváme pouze kontrolní podmínky kamery, identit a hloubky. Nevěnovali jsme se dalším podmínkám a modalitám, jako je audio, řeč, point cloud, objektové rámečky, optický tok atd. Ačkoli design FullDiT může bezproblémově integrovat další modality s minimálními změnami architektury, otázka, jak rychle a efektivně přizpůsobit existující modely novým podmínkám a modalitám, je stále důležitou otázkou, která vyžaduje další prozkoumání.’

Metoda

Autoři tvrdí, že sjednocená pozornost mechanismus FullDiT umožňuje silnější mezi-modální reprezentační učení tím, že zachycuje jak prostorové, tak časové vztahy napříč podmínkami:

Podle nové práce FullDiT integruje několik vstupních podmínek prostřednictvím plné sebe-pozornosti, převádí je do sjednocené sekvence. Naopak, modely založené na adaptech (vlevo) používají samostatné moduly pro každý vstup, což vede k redundanci, konfliktům a slabšímu výkonu.

Na rozdíl od adapťáků, které zpracovávají každý vstupní tok samostatně, tato sdílená pozornost struktura vyhýbá se konfliktům větví a snižuje parametrální režii. Tvrdí také, že architektura může škálovat na nové typy vstupů bez významných změn – a že modelový schéma ukazuje známky generalizace na kombinace podmínek, které nebyly vidět během trénování, jako je propojení pohybu kamery s identitou postavy.

Klikněte pro přehrávání. Příklady generace identity z projektové stránky.

V architektuře FullDiT jsou všechny kondicionální vstupy – jako text, pohyb kamery, identita a hloubka – nejprve převedeny do sjednoceného tokenu formátu. Tyto tokeny jsou poté sloučeny do jediné dlouhé sekvence, která je zpracována prostřednictvím zásobníku transformer vrstev pomocí plné sebe-pozornosti. Tento přístup následuje předchozí práce, jako je Open-Sora Plan a Movie Gen.

Tento design umožňuje modelu učit se časové a prostorové vztahy společně napříč všemi podmínkami. Každá transformer bloková vrstva funguje na celé sekvenci, umožňující dynamické interakce mezi modality bez závislosti na samostatných modulech pro každý vstup – a, jak jsme poznamenali, architektura je navržena tak, aby byla extenzivní, což usnadňuje pozdější inovace, aniž by vyžadovala významné strukturální změny.

Síla tří

FullDiT převádí každý kontrolní signál do standardizovaného tokenu formátu, aby mohly být všechny podmínky zpracovány společně v rámci sjednocené pozornosti. Pro pohyb kamery model kóduje sekvenci vnějších parametrů – jako poloha a orientace – pro každý snímek. Tyto parametry jsou časově označeny a projekty do vektorů, které odrážejí časovou povahu signálu.

Informace o identitě jsou zpracovávány jinak, protože jsou inherentně prostorové spíše než časové. Model používá identifikační mapy, které označují, které postavy jsou přítomny v kterých částech každého snímku. Tyto mapy jsou rozděleny do patchů, s každým patchem projektem do vloženého prostoru, který zachycuje prostorové identifikační signály, umožňující modelu asociovat konkrétní oblasti snímku s konkrétními entitami.

Hloubka je prostorově-časovým signálem a model zpracovává ji rozdělením hloubkových videí do 3D patchů, které pokrývají jak prostor, tak čas. Tyto patche jsou poté vloženy do prostoru, který zachovává jejich strukturu napříč snímky.

Jakmile jsou tyto tokeny vloženy, jsou všechny kondicionální tokeny (kamera, identita a hloubka) sloučeny do jediné dlouhé sekvence, umožňující FullDiT zpracovat je společně pomocí plné sebe-pozornosti. Tento sdílený reprezentační prostor umožňuje modelu učit se interakce napříč modality a časem bez závislosti na izolovaných zpracování toků.

Data a testy

Přístup FullDiT k trénování spoléhal na selektivně anotované datové sady přizpůsobené každé kondicionální typu, místo aby vyžadoval všechny podmínky být přítomny současně.

Pro textové podmínky postup následoval strukturovaný přístup k popisu, jak je popsáno v projektu MiraData.

Video sběrná a anotační pipeline z projektu MiraData. Source: https://arxiv.org/pdf/2407.06358

Pro pohyb kamery byl hlavní zdroj dat RealEstate10K dataset, kvůli jeho vysoce kvalitním anotacím kamerových parametrů.

Nicméně, autoři pozorovali, že trénování výhradně na statických scénách kamerových datasetů, jako je RealEstate10K, tendovalo ke snížení dynamických objektů a pohybů postav v generovaných videích. Aby tomu čelili, provedli další jemné úpravy pomocí interních datasetů, které zahrnovaly více dynamických kamerových pohybů.

Anotace identity byly generovány pomocí pipeline vyvinuté pro projekt ConceptMaster, který umožnil efektivní filtrování a extrakci jemných identifikačních informací.

ConceptMaster framework je navržen pro řešení problémů s identitou a zachováním konceptuální věrnosti v přizpůsobených videích. Source: https://arxiv.org/pdf/2501.04698

Anotace hloubky byly získány z Panda-70M datasetu pomocí Depth Anything.

Optimalizace prostřednictvím data-orderingu

Autoři také implementovali progresivní trénovací harmonogram, zavádějící více náročné podmínky časněji v trénování, aby zajistili, že model získal robustní reprezentace předtím, než byly přidány jednodušší úkoly.

Trénovací pořadí postupovalo od textu k kamerovým podmínkám, poté identitám, a nakonec hloubce, s jednoduššími úkoly obecně zaváděnými později a s méně příklady.

Autoři zdůrazňují hodnotu pořadí pracovní zátěže tímto způsobem:

‘Během pre-trénovací fáze jsme si všimli, že náročnější úkoly vyžadují prodloužené trénovací časy a měly by být zaváděny dříve v procesu učení. Tyto náročné úkoly zahrnují komplexní datové distribuce, které se výrazně liší od výstupního videa, vyžadující, aby model měl dostatečnou kapacitu, aby je přesně zachytil a reprezentoval.’

‘Naopak, zavádění jednodušších úkolů příliš brzy může vést k tomu, že model se bude soustředit na učení těchto úkolů první, protože poskytují okamžitou zpětnou vazbu, což brání konvergenci náročnějších úkolů.’

Ilustrace trénovacího pořadí přijatého výzkumníky, s červenou barvou označující větší objem dat.

Po počáteční pre-trénování následovala konečná fáze jemné úpravy, která dále vylepšila model, aby zlepšil vizuální kvalitu a pohybovou dynamiku. Poté trénování následovalo standardního difuzního rámce*: šum byl přidán k videovým latentním, a model se učil předpovídat a odstraňovat ho, pomocí vložených kondicionálních tokenů jako vedení.

Aby efektivní vyhodnotili FullDiT a zajistili spravedlivé srovnání s předchozími metodami, a vzhledem k tomu, že neexistuje žádná jiná vhodná benchmarcková sada, autoři představili FullBench, kurátorovanou benchmarckovou sadu skládající se z 1 400 distinctních testovacích případů.

Data explorer instance pro novou benchmarckovou sadu FullBench. Source: https://huggingface.co/datasets/KwaiVGI/FullBench

Každý datový bod poskytoval anotace pro různé kondicionální signály, včetně pohybu kamery, identity, a hloubky.

Metriky

Autoři vyhodnotili FullDiT pomocí deseti metrik pokrývajících pět hlavních aspektů výkonu: textové zarovnání, kamerová kontrola, identitní podobnost, hloubková přesnost, a obecná kvalita videa.

Textové zarovnání bylo měřeno pomocí CLIP podobnosti, zatímco kamerová kontrola byla hodnocena prostřednictvím rotační chyby (RotErr), translační chyby (TransErr), a kamerové pohybové konzistence (CamMC), následujícím přístupem CamI2V (v CameraCtrl projektu).

Identitní podobnost byla hodnocena pomocí DINO-I a CLIP-I, a hloubková kontrola přesnost byla kvantifikována pomocí Průměrné absolutní chyby (MAE).

Kvalita videa byla posuzována pomocí tří metrik z MiraData: snímek-úrovňové CLIP podobnosti pro plynulost; optický tok-založené pohybové vzdálenosti pro dynamiku; a LAION-Aesthetic skóre pro vizuální atraktivitu.

Trénování

Autoři trénovali FullDiT pomocí interního (nepublikovaného) text-to-video difuzního modelu obsahujícího přibližně jednu miliardu parametrů. Úmyslně zvolili skromný parametrický rozsah, aby udrželi spravedlivost ve srovnání s předchozími metodami a zajistili reprodukovatelnost.

Jelikož trénovací videa se lišila délkou a rozlišením, autoři standardizovali každou dávku tak, že videa přetvořili a vyplněním na společné rozlišení, vzorkovali 77 snímků z každé sekvence, a používali aplikovanou pozornost a loss masky pro optimalizaci trénovací efektivity.

Adam optimalizátor byl použit s učení rychlostí 1×10−5 napříč clusterem 64 NVIDIA H800 GPU, pro kombinovaný celkový 5 120 GB VRAM (zvažte, že v komunitách nadšenců syntézy je 24 GB na RTX 3090 stále považováno za luxusní standard).

Model byl trénován po dobu přibližně 32 000 kroků, zahrnující až tři identity na video, spolu s 20 snímky kamerových podmínek a 21 snímky hloubkových podmínek, všechny rovnoměrně vzorkované z celkových 77 snímků.

Pro inference, model generoval videa v rozlišení 384×672 pixelů (přibližně pět sekund při 15 snímcích za sekundu) s 50 difuzními inferenčními kroky a klasifikátorem-volným vedení měřítkem pět.

Předchozí metody

Pro kameru-na-video hodnocení, autoři porovnali FullDiT s MotionCtrl, CameraCtrl, a CamI2V, se všemi modely trénovanými pomocí RealEstate10k datasetu, aby zajistili konzistenci a spravedlivost.

V identitě-kondicionované generaci, jelikož neexistovaly žádné srovnatelné open-source multi-identitní modely, model byl benchmarkován proti 1B-parametrickému modelu ConceptMaster, pomocí stejných trénovacích dat a architektury.

Pro hloubku-na-video úkoly, porovnávání byla provedena s Ctrl-Adapter a ControlVideo.

Kvantitativní výsledky pro single-úkolovou video generaci. FullDiT byl porovnán s MotionCtrl, CameraCtrl, a CamI2V pro kameru-na-video generaci; ConceptMaster (1B parametrická verze) pro identitu-na-video; a Ctrl-Adapter a ControlVideo pro hloubku-na-video.

Výsledky ukazují, že FullDiT, navzdory zpracování více kondicionálních signálů současně, dosáhl nejlepších výsledků v metrikách souvisejících s textem, kamerovým pohybem, identitou a hloubkovou kontrolou.

V celkových kvalitativních metrikách, systém obecně překonal ostatní metody, i když jeho plynulost byla mírně nižší než ConceptMaster. Zde autoři komentují:

‘Plynulost FullDiT je mírně nižší než u ConceptMaster, protože výpočet plynulosti je založen na CLIP podobnosti mezi sousedními snímky. Jak FullDiT vykazuje výrazně větší dynamiku ve srovnání s ConceptMaster, metrika plynulosti je ovlivněna velkými variacemi mezi sousedními snímky.

‘Pro estetické skóre, jelikož ratingový model upřednostňuje obrazy v malířském stylu a ControlVideo typicky generuje videa v tomto stylu, dosahuje vysoké skóre v estetice.’

Ohledně kvalitativního srovnání, může být lepší se obrátit na ukázková videa na FullDiT projektové stránce, protože PDF příklady jsou nevyhnutelně statické (a také příliš velké, aby se zde zcela reprodukovaly).

První část kvalitativních výsledků v PDF. Prosím, odkážete se na zdroj článku pro další příklady.

Autoři komentují:

‘FullDiT prokazuje lepší uchování identity a generuje videa s lepší dynamikou a vizuální kvalitou ve srovnání s [ConceptMaster]. Jelikož ConceptMaster a FullDiT jsou trénovány na stejném základu, to zdůrazňuje účinnost kondicionální injekce s plnou pozorností.

‘…Další výsledky prokazují lepší řiditelnost a generativní kvalitu FullDiT ve srovnání s existujícími hloubkou-na-video a kamerou-na-video metodami.’

Část příkladů výstupu FullDiT s více signály. Prosím, odkážete se na zdroj článku a projektovou stránku pro další příklady.

Závěr

Ačkoli FullDiT je zajímavým pokusem o více funkční typ video základního modelu, je třeba se divit, zda poptávka po kontrolních opatřeních ControlNet-style někdy ospravedlní implementaci těchto funkcí v plném rozsahu, alespoň pro FOSS projekty, které by se potýkaly s získáním obrovského množství GPU zpracování, bez komerční podpory.

Hlavní výzvou je, že použití systémů, jako je Depth a Pose, obecně vyžaduje nezanedbatelnou familiaritu s relativně složitými uživatelskými rozhraními, jako je ComfyUI. Proto se zdá, že funkční FOSS model tohoto druhu je nejpravděpodobněji vyvinut kádrem menších VFX společností, které postrádají peníze (nebo vůli, vzhledem k tomu, že tyto systémy jsou rychle učiněny zastaralými modelovými aktualizacemi) na kurátorství a trénování takového modelu za zavřenými dveřmi.

Na druhou stranu, API-řízené ‘rent-an-AI’ systémy mohou být dobře motivovány vyvinout jednodušší a uživatelsky přívětivější interpretativní metody pro modely, do kterých byly přímo trénovány pomocné kontrolní systémy.

Klikněte pro přehrávání. Hloubka+Text kontrola uvalená na video generaci pomocí FullDiT.

* Autoři nespecifikují žádný známý základový model (tj. SDXL, atd.)

Poprvé publikováno čtvrtek, 27. března 2025