Andersonův úhel

Budoucnost RAG-augmentované generace obrázků

Generativní difuzní modely, jako je Stable Diffusion, Flux a video modely, jako je Hunyuan, spoléhají na znalosti získané během jediné, zdrojově náročné trénovací seance pomocí pevné datové sady. Jakékoli koncepty zavedené po tomto tréninku – označované jako knowledge cut-off – chybí v modelu, pokud nejsou doplněny pomocí fine-tuning nebo externích adaptivačních technik, jako je Low Rank Adaptation (LoRA).

Bylo by tedy ideální, kdyby generativní systém, který vyrábí obrázky nebo videa, mohl vyhledávat online zdroje a zahrnout je do generativního procesu podle potřeby. Tímto způsobem by například difuzní model, který nic neví o nejnovějším vydání Apple nebo Tesla, mohl stále produkovat obrázky obsahující tyto nové produkty.

Pokud jde o jazykové modely, většina z nás je obeznámena se systémy, jako je Perplexity, Notebook LM a ChatGPT-4o, které mohou zahrnout nové externí informace do Retrieval Augmented Generation (RAG) modelu.

RAG procesy dělají odpovědi ChatGPT 4o více relevantní. Source: https://chatgpt.com/

Nicméně, tato funkce je neobvyklá, pokud jde o generování obrázků, a ChatGPT přizná své vlastní omezení v tomto ohledu:

ChatGPT 4o udělal dobrý odhad vizualizace zcela nového vydání hodinek, založeného na obecném směru a na popisech, které interpretoval; ale nemůže ‘absorbovat’ a integrovat nové obrázky do DALL-E-založené generace.

Zahrnutí externě získaných dat do vygenerovaného obrázku je obtížné, protože přicházející obrázek musí být nejprve rozložen na tokeny a embeddings, které jsou poté mapovány na nejbližší trénovací znalosti modelu o tématu.

Zatímco tento proces funguje účinně pro post-tréninkové nástroje, jako je ControlNet, takové manipulace zůstávají převážně povrchní,基本ně protlačující získaný obrázek prostřednictvím renderovacího potrubí, ale bez hluboké integrace do vnitřní reprezentace modelu.

V důsledku toho model postrádá schopnost generovat nové perspektivy způsobem, jakým to mohou dělat neuronové renderovací systémy, jako je NeRF, které konstruují scény se skutečným prostorovým a strukturálním pochopením.

Zralá logika

Podobné omezení platí pro RAG-založené dotazy v Large Language Modelech (LLM), jako je Perplexity. Když model tohoto typu zpracovává externě získaná data, funguje podobně jako dospělý, který čerpá z celoživotních znalostí, aby odhadl pravděpodobnosti o tématu.

Nicméně, stejně jako člověk nemůže retroaktivně integrovat nové informace do kognitivního rámce, který formoval jeho základní světový názor – když jeho předsudky a předsudky byly ještě formovány – LLM nemůže bezproblémově slít nové znalosti do své předtrénované struktury.

Místo toho může pouze ‘ovlivnit’ nebo konfrontovat nová data se svými stávajícími internalizovanými znalostmi, pomocí naučených principů k analýze a konjekturám, spíše než k syntéze na základní úrovni.

Tento nedostatek ekvivalence mezi juxtaposed a internalized generací je pravděpodobně více patrný v generovaném obrázku než v jazykové generaci: hlubší síťové spojení a zvýšená kreativita ‘rodné’ (rather než RAG-založené) generace byla stanovena v různých studiích.

Skrytá rizika RAG-schopné generace obrázků

I kdyby bylo technicky možné bezproblémově integrovat získané internetové obrázky do nově syntetizovaných v RAG-stylu, bezpečnostní omezení by představovala další výzvu.

Mnohé datové sady používané pro trénování generativních modelů byly kurátorsky vybrány, aby minimalizovaly přítomnost explicitního, rasistického nebo násilného obsahu, mezi jinými citlivými kategoriemi. Nicméně, tento proces je nedokonalý, a reziduální asociace mohou přetrvávat. Aby se tomuto zabránilo, systémy, jako je DALL·E a Adobe Firefly, spoléhají na sekundární filtrační mechanismy, které proškolují vstupní podněty a generované výstupy pro zakázaný obsah.

V důsledku toho by jednoduchý NSFW filtr – který primárně blokuje otevřeně explicitní obsah – byl nedostatečný pro hodnocení přijatelnosti získaných RAG-založených dat. Takový obsah by mohl být stále urážlivý nebo škodlivý způsoby, které spadají mimo modelovy předdefinované moderátorské parametry, potenciálně zavádějící materiál, který AI postrádá kontextuální povědomí, aby jej správně vyhodnotil.

Objevení nedávné zranitelnosti v CCP-produkovaném DeepSeek, navrženého pro potlačení diskusí o zakázaném politickém obsahu, zdůraznilo, jak alternativní vstupní cesty mohou být využity k obcházení modelových etických zábran; zřejmě, toto platí také pro libovolná nová data získaná z internetu, když se má integrovat do nové generace obrázku.

RAG pro generaci obrázků

Navzdory těmto výzvám a trnitým politickým aspektům, řada projektů se objevila, které se snaží použít RAG-založené metody k začlenění nových dat do vizuálních generací.

ReDi

2023 Retrieval-based Diffusion (ReDi) projekt je framework bez učení, který urychluje difuzní model inference tím, že získá podobné trajectories z předem vypočítané znalostní báze.

Hodnoty z datové sady mohou být ‘půjčeny’ pro novou generaci v ReDi. Source: https://arxiv.org/pdf/2302.02285

V kontextu difuzních modelů je trajektorie krok za krokem cesta, kterou model bere k vygenerování obrázku z čistého šumu. Obvykle tento proces probíhá postupně po mnoha krocích, s každým krokem, který upravuje obrázek trochu více.

ReDi urychluje tento proces tím, že přeskočí spoustu těchto kroků. Místo toho, aby vypočítával každý jednotlivý krok, získá podobnou minulou trajektorii z databáze a přeskočí na pozdější bod v procesu. Tím se snižuje počet potřebných výpočtů, což činí difuzní generaci obrázků mnohem rychlejší, zatímco stále udržuje kvalitu.

ReDi nemění váhy difuzního modelu, ale místo toho používá znalostní bázi k přeskočení mezilehlých kroků, a tím snižuje počet funkcí, které je třeba odhadnout pro výběr.

RDM

Další ranou snahou o RAG-augmentovanou generaci obrázků je Retrieval-Augmented Diffusion Models (RDM), který představuje semi-parametrický přístup k generativní syntéze obrázků. Zatímco tradiční difuzní modely ukládají veškeré získané vizuální znalosti uvnitř svých neuronových sítí, RDM spoléhá na externí image databázi:

Získané nejbližší sousedé v ilustrativním pseudo-dotazu v RDM*.

Během trénování model získá nejbližší sousedy (vizuálně nebo sémanticky podobné obrázky) z externí databáze, aby vedl generativní proces. To umožňuje modelu podmínit své výstupy na reálných vizuálních instancích.

Získávání je poháněno CLIP embeddings, které jsou navrženy tak, aby donutily získané obrázky sdílet významné podobnosti s dotazem, a také aby poskytly nové informace pro zlepšení generace.

Tento přístup snižuje závislost na parametrech, usnadňuje menší modely, které dosahují konkurenceschopných výsledků bez potřeby rozsáhlých trénovacích dat.

ReMoDiffuse

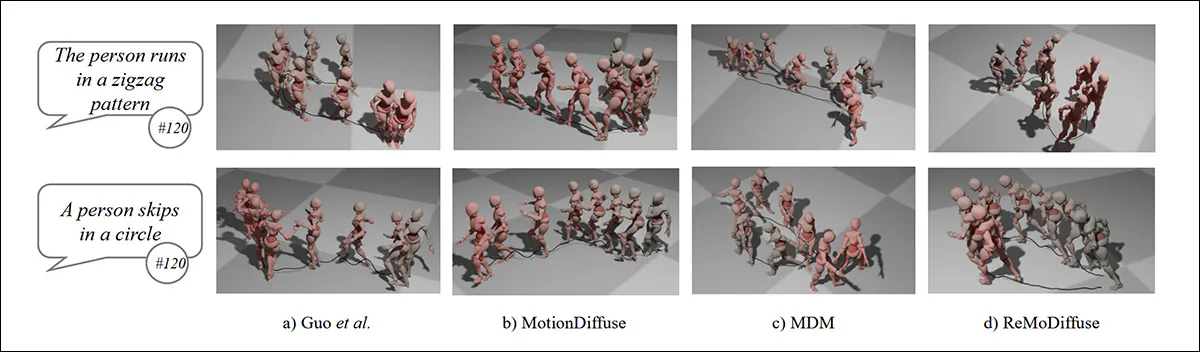

ReMoDiffuse je RAG-augmentovaný motion difuzní model navržený pro 3D generaci lidského pohybu. Na rozdíl od tradičních motion generativních modelů, které se spoléhají čistě na naučené reprezentace, ReMoDiffuse získá relevantní motion vzorky z velké motion datové sady a integruje je do denoisovacího procesu, v schématu podobném RDM (viz výše).

Srovnání RAG-augmentovaného ReMoDiffuse (pravý) s předchozími metodami. Source: https://arxiv.org/pdf/2304.01116

Tento model umožňuje generovat pohybové sekvence, které jsou navrženy tak, aby byly více přirozené a rozmanité, a také sémanticky věrné uživatelovým textovým podnětům.

ReMoDiffuse používá inovativní hybridní získávání, které vybírá pohybové sekvence na základě obou sémantických a kinematických podobností, s cílem zajistit, aby získané pohyby byly nejen tematicky relevantní, ale také fyzicky proveditelné, když se integrují do nové generace.

RA-CM3

Stanfordova 2023 práce Retrieval-Augmented Multimodal Language Modeling (RA-CM3) umožňuje systému přístup k reálným informacím v době inference:

Stanfordův Retrieval-Augmented Multimodal Language Modeling (RA-CM3) model používá internet-získané obrázky k augmentaci generativního procesu, ale zůstává prototypem bez veřejného přístupu. Source: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integruje získané texty a obrázky do generativního potrubí, zlepšuje jak text-to-image, tak image-to-text syntézu. Používá CLIP pro získávání a Transformer jako generátor, model se odvolává na příslušné multimodální dokumenty před kompozicí výstupu.

RealRAG

Nový release z Číny, a ten, který vyvolal tento pohled na RAG-augmentované generativní image systémy, se nazývá Retrieval-Augmented Realistic Image Generation (RealRAG).

Externí obrázky získané v RealRAG (dolní prostřední). Source: https://arxiv.o7rg/pdf/2502.00848

RealRAG získá skutečné obrázky relevantních objektů z databáze kurátorské z veřejně dostupných datových sad, jako je ImageNet, Stanford Cars, Stanford Dogs, a Oxford Flowers. Poté integruje získané obrázky do generativního procesu, aby řešil znalostní mezery v modelu.

Závěr

Tento přehled je reprezentativní, spíše než vyčerpávající, přehled image-retrieving multimodálních generativních systémů. Některé systémy tohoto typu používají získávání pouze pro zlepšení pochopení vidění nebo kurátorské datové sady, mezi jinými různými motivy, spíše než snažící se generovat obrázky. Jedním z příkladů je Internet Explorer.

Mnohé z ostatních RAG-integrovaných projektů v literatuře zůstávají nevydané. Prototypy, s pouze publikovaným výzkumem, zahrnují Re-Imagen, který – navzdory svému původu z Google – může pouze přístup k obrázkům z místní vlastní databáze.

Také, v listopadu 2024, Baidu ohlásil Image-Based Retrieval-Augmented Generation (iRAG), novou platformu, která používá získané obrázky ‘z databáze’. Ačkoli iRAG je údajně dostupný na platformě Ernie, zdá se, že nejsou žádné další podrobnosti o tomto získávání, které vypadá, že spoléhá na místní databázi (tj. místní pro službu a ne přímo přístupné uživateli).

Další, 2024 práce Unified Text-to-Image Generation and Retrieval nabízí další RAG-založenou metodu pro použití externích obrázků k augmentaci výsledků v době generace – opět, z místní databáze spíše než z ad hoc internetových zdrojů.

Zájem o RAG-založenou augmentaci v generaci obrázků se pravděpodobně zaměří na systémy, které mohou zahrnout internet-zdrojové nebo uživatelsky nahrávané obrázky přímo do generativního procesu, a které umožňují uživatelům účastnit se výběru nebo zdrojů obrázků.

Nicméně, toto je významná výzva pro alespoň dvě důvody; poprvé, protože účinnost takových systémů obvykle závisí na hluboce integrovaných vztazích vytvořených během zdrojově náročného trénovacího procesu; a podruhé, protože obavy nad bezpečností, právními a autorskými omezeními, jak je uvedeno dříve, činí tuto funkci nepravděpodobnou pro API-driven webovou službu a pro komerční nasazení obecně.

* Source: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Poprvé zveřejněno v úterý, 4. února 2025