Andersonův úhel

Budoucnost RAG-Augmented Image Generation

Modely generativního šíření, jako je Stable Diffusion, Flux, a video modely, jako je Hunyuan, spoléhají na znalosti získané během jediného školení náročného na zdroje s použitím pevné datové sady. Jakékoli koncepty představené po tomto školení – označované jako přerušení znalostí – chybí v modelu, pokud nejsou doplněny doladění nebo externí adaptační techniky jako Přizpůsobení nízké hodnosti (LoRA).

Bylo by proto ideální, kdyby to uměl generativní systém, který vydává obrázky nebo videa oslovit online zdroje a podle potřeby je začlenit do procesu generování. Tímto způsobem by například difúzní model, který neví nic o nejnovější verzi Apple nebo Tesla, mohl stále vytvářet obrázky obsahující tyto nové produkty.

Pokud jde o jazykové modely, většina z nás zná systémy jako Perplexity, Notebook LM a ChatGPT-4o, které mohou začlenit nové externí informace do Retrieval Augmented Generation (RAG) model.

Díky RAG procesům jsou odpovědi ChatGPT 4o relevantnější. Zdroj: https://chatgpt.com/

Toto je však neobvyklé zařízení, pokud jde o generování obrázků, a ChatGPT přizná svá vlastní omezení v tomto ohledu:

ChatGPT 4o udělal dobrý odhad o vizualizaci vydání zcela nových hodinek na základě obecné linie a popisů, které interpretoval; ale nedokáže „absorbovat“ a integrovat nové obrázky do generace založené na DALL-E.

Začlenění externě získaných dat do generovaného obrazu je náročné, protože příchozí obraz musí být nejprve rozdělen na tokeny a vložení, které jsou pak mapovány na nejbližší trénovanou doménu modelu daného předmětu.

Zatímco tento proces funguje efektivně pro nástroje po školení, jako je ControlNet, takové manipulace zůstávají do značné míry povrchní, v podstatě vedou načtený obrázek přes renderovací kanál, ale bez jeho hluboké integrace do vnitřní reprezentace modelu.

Výsledkem je, že model postrádá schopnost generovat nové perspektivy způsobem, který mají neuronové renderovací systémy rády NeRF can, který konstruuje scény s opravdovým prostorovým a strukturálním porozuměním.

Zralá logika

Podobné omezení platí pro dotazy založené na RAG ve velkých jazykových modelech (LLM), jako je Perplexity. Když model tohoto typu zpracovává externě získaná data, funguje podobně jako dospělý, který čerpá z celoživotních znalostí, aby odvodil pravděpodobnosti o tématu.

Avšak stejně jako člověk nemůže zpětně integrovat nové informace do kognitivního rámce, který formoval jeho základní světonázor – když se jeho předsudky a předsudky ještě utvářely – LLM nemůže plynule začlenit nové znalosti do své předem vyškolené struktury.

Místo toho může nová data pouze „ovlivňovat“ nebo je postavit vedle sebe se svými stávajícími internalizovanými znalostmi a používat naučené principy k analýze a domněnkám spíše než k syntéze na základní úrovni.

Tento nedostatek v ekvivalenci mezi vedle sebe si internalizované generace bude pravděpodobně více patrná v generovaném obrazu než v generaci založené na jazyce: hlubší síťové propojení a zvýšená kreativita „nativní“ (spíše než založené na RAG) generace byla vytvořena v roce různých studií.

Skrytá rizika generování obrázků s podporou RAG

I kdyby bylo technicky proveditelné bezproblémově integrovat načtené internetové obrázky do nově syntetizovaných ve stylu RAG, bezpečnostní omezení by představovala další výzvu.

Mnoho datových souborů používaných pro trénink generativních modelů bylo upraveno tak, aby se minimalizovala přítomnost explicitního, rasistického nebo násilného obsahu mezi jinými citlivými kategoriemi. Tento proces je však nedokonalý a zbytkové asociace mohou přetrvávat. Aby se to zmírnilo, systémy jako DALL·E a Adobe Firefly spoléhají na sekundární mechanismy filtrování, které prověřují jak vstupní výzvy, tak generované výstupy pro zakázaný obsah.

V důsledku toho by jednoduchý filtr NSFW – ten, který primárně blokuje zjevně explicitní obsah – nestačil pro vyhodnocení přijatelnosti získaných dat založených na RAG. Takový obsah může být stále urážlivý nebo škodlivý způsobem, který se vymyká předem definovaným parametrům moderování modelu, což může představovat materiál, který AI postrádá kontextové povědomí ke správnému posouzení.

Objev nedávná zranitelnost v DeepSeek vytvořeném ČKS, který má potlačit diskuse o zakázaném politickém obsahu, zdůraznil, jak lze využít alternativní vstupní cesty k obcházení etických záruk modelu; pravděpodobně to platí také pro libovolná nová data získaná z internetu, pokud mají být začleněna do nové generace obrázků.

RAG pro generování obrázků

Navzdory těmto výzvám a ožehavým politickým aspektům se objevila řada projektů, které se pokoušejí použít metody založené na RAG k začlenění nových dat do vizuálních generací.

ReDi

2023 Difúze založená na získávání Projekt (ReDi) je rámec bez učení, který urychluje odvození modelu difúze načítáním podobných trajektorií z předem vypočítané znalostní báze.

Hodnoty z datové sady si lze „vypůjčit“ pro novou generaci v ReDi. Zdroj: https://arxiv.org/pdf/2302.02285

V kontextu difúzních modelů je trajektorie cesta krok za krokem, kterou model absolvuje, aby vytvořil obrázek. čistý hluk. Normálně tento proces probíhá postupně v mnoha krocích, přičemž každý krok zpřesňuje obraz o něco více.

ReDi to urychluje přeskočením řady těchto kroků. Namísto výpočtu každého jednotlivého kroku získá podobnou minulou trajektorii z databáze a skočí vpřed do pozdějšího bodu procesu. Tím se snižuje počet potřebných výpočtů, díky čemuž je generování obrazu založeného na difúzi mnohem rychlejší, přičemž kvalita zůstává stále vysoká.

ReDi nemodifikuje difúzní model závaží, ale místo toho používá znalostní bázi k přeskočení mezikroků, čímž se snižuje počet odhadů funkcí potřebných pro vzorkování.

Samozřejmě to není totéž jako začlenění konkrétních obrázků podle libosti do požadavku na generování; ale týká se to podobných typů generací.

Vydáno v roce 2022, v roce modelování latentní difúze zachytil ReDi se zdá být jedním z prvních přístupů založených na šíření, který se opíral o metodologii RAG.

I když je třeba zmínit, že v roce 2021 vyšel Facebook Research Instance-Conditioned GAN, který se snažil podmínit GAN obrázky na nových obrazových vstupech, tento druh projekce do latentního prostoru je v literatuře extrémně běžný, a to jak pro GAN, tak pro modely difúze; výzvou je vytvořit takový proces bez školení a funkční v reálném čase, jako jsou metody RAG zaměřené na LLM.

RDM

Dalším raným vpádem do generování obrazu rozšířeného RAG je Difúzní modely s rozšířeným vyhledáváním (RDM), která zavádí polo-parametrický přístup ke generativní syntéze obrazu. Zatímco tradiční difúzní modely ukládají všechny naučené vizuální znalosti v rámci svých parametrů neuronové sítě, RDM se spoléhá na externí obrazovou databázi:

Načteno nejbližší sousedy v ilustrativním pseudodotazu v RDM*.

Během tréninku model aportuje nejbližší sousedé (vizuálně nebo sémanticky podobné obrázky) z externí databáze, aby vedl proces generování. To umožňuje modelu přizpůsobit své výstupy reálným vizuálním instancím.

Proces získávání je poháněn CLIP embeddings, navržený tak, aby přinutil načtené obrázky sdílet smysluplné podobnosti s dotazem, a také poskytnout nové informace pro zlepšení generování.

To snižuje závislost na parametrech a umožňuje menší modely, které dosahují konkurenceschopných výsledků bez potřeby rozsáhlých trénovacích datových sad.

Přístup RDM podporuje post-hoc modifikace: výzkumníci mohou vyměňovat databázi v době odvození, což umožňuje přizpůsobení se nulovému záběru novým stylům, doménám nebo dokonce úplně jiným úkolům, jako je stylizace nebo syntéza podmíněná třídou.

Ve spodních řadách vidíme nejbližší sousedy vtažené do difúzního procesu v RDM*.

Klíčovou výhodou RDM je jeho schopnost zlepšit generování obrazu bez přetrénování modelu. Pouhou změnou vyhledávací databáze může model zobecnit na nové koncepty, na které nebyl nikdy výslovně trénován. To je užitečné zejména pro aplikace, kde doménové posuny dojít, jako je generování lékařských snímků na základě vyvíjejících se datových sad nebo přizpůsobení modelů text-obrázek pro kreativní aplikace.

Záporně metody založené na vyhledávání tohoto druhu závisejí na kvalitě a relevanci externí databáze, díky čemuž je zpracování dat důležitým faktorem pro dosažení vysoce kvalitních generací; a tento přístup má daleko k ekvivalentu obrazové syntézy typu interakcí založených na RAG typických v komerčních LLM.

ReMoDiffuse

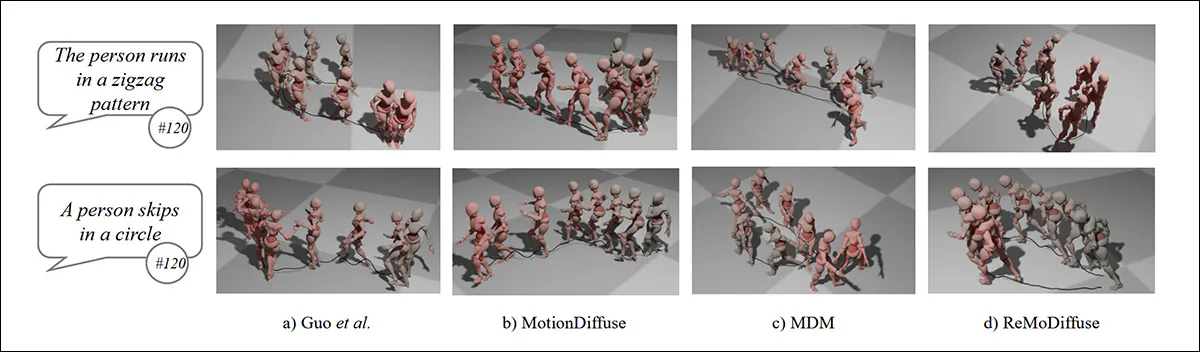

ReMoDiffuse je model difúze pohybu s rozšířeným vyhledáváním určený pro 3D generování lidského pohybu. Na rozdíl od tradiční modely generování pohybu které se spoléhají čistě na naučené reprezentace, ReMoDiffuse získává relevantní vzorky pohybu z velkého souboru pohybových dat a integruje je do procesu odstraňování šumu ve schématu podobném RDM (viz výše).

Porovnání RAG-augmentovaného ReMoDiffuse (vpravo) s předchozími metodami. Zdroj: https://arxiv.org/pdf/2304.01116

To umožňuje modelu generovat pohybové sekvence navržené tak, aby byly přirozenější a rozmanitější, a také sémanticky věrné textovým výzvám uživatele.

ReMoDiffuse využívá inovativní hybridní vyhledávací mechanismus, která vybírá pohybové sekvence na základě sémantických i kinematických podobností se záměrem zajistit, aby načtené pohyby nebyly pouze tematicky relevantní, ale také fyzicky věrohodné, když jsou integrovány do nové generace.

Model pak tyto získané vzorky zpřesní pomocí a Sémanticky modulovaný transformátor, která selektivně začleňuje poznatky z načtených pohybů při zachování charakteristických kvalit generované sekvence:

Schéma pro potrubí ReMoDiffuse.

Projekt je Směs podmínek Tato technika zlepšuje schopnost modelu zobecňovat různé výzvy a podmínky načítání, vyrovnává získané vzorky pohybu s textovými výzvami během generování a upravuje váhu každého zdroje v každém kroku.

To může pomoci zabránit nerealistickým nebo opakovaným výstupům, a to i u vzácných výzev. Řeší také problém citlivosti měřítka která často vzniká v vedení bez klasifikátoru techniky běžně používané v difúzních modelech.

RA-CM3

Stanfordův rok 2023 Paper Retrieval-Augmented Multimodal Language Modeling (RA-CM3) umožňuje systému přistupovat k informacím ze skutečného světa v době odvození:

Stanfordův model Retrieval-Augmented Multimodal Language Modeling (RA-CM3) využívá obrázky získané z internetu k rozšíření procesu generování, ale zůstává prototypem bez veřejného přístupu. Zdroj: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integruje načtený text a obrázky do generovacího kanálu, čímž vylepšuje syntézu textu na obrázek i obrázku na text. Použití CLIP pro vyhledání a a transformátor jako generátor odkazuje model na příslušné multimodální dokumenty před sestavením výstupu.

Benchmarky na MS-COCO ukazují pozoruhodná zlepšení oproti DALL-E a podobným systémům a dosahují 12 bodů Fréchet počáteční vzdálenost (FID) snížení s mnohem nižšími výpočetními náklady.

Nicméně, stejně jako u jiných přístupů rozšířených o vyhledávání, RA-CM3 své získané znalosti bezproblémově internalizuje. Spíše překrývá nová data se svou předem trénovanou sítí, podobně jako LLM rozšiřující odpovědi s výsledky vyhledávání. I když tato metoda může zlepšit faktickou přesnost, nenahrazuje potřebu aktualizací školení v doménách, kde je vyžadována hluboká syntéza.

Navíc se nezdá, že by byla vydána praktická implementace tohoto systému, a to ani na platformě založené na API.

RealRAG

A nové vydání z Číny a ten, který podnítil tento pohled na generativní obrazové systémy rozšířené RAG, se nazývá Retrieval-Augmented Realistic Image Generation (RealRAG).

Externí obrázky nakreslené do RealRAG (dolní střední). Zdroj: https://arxiv.o7rg/pdf/2502.00848

RealRAG získává aktuální obrázky relevantních objektů z databáze kurátorované z veřejně dostupných datových sad, jako jsou např IMAGEnet, Stanford Cars, Stanfordští psi, a Oxford květiny. Poté integruje získané obrázky do procesu generování a řeší mezery ve znalostech v modelu.

Klíčovou součástí RealRAG je sebereflektivní kontrastivní učení, který trénuje vyhledávací model, aby našel informativní referenční obrázky, spíše než jen vybíral vizuálně podobné ty.

Autoři uvádějí:

„Naším klíčovým postřehem je vycvičit retrívra, který získává obrázky, které zůstávají mimo generační prostor generátoru, a přitom se blíží reprezentaci textových výzev.

„Za tímto účelem nejprve vygenerujeme obrázky z daných textových výzev a poté vygenerované obrázky použijeme jako dotazy k získání nejrelevantnějších obrázků v databázi založené na skutečných objektech. Tyto nejrelevantnější obrázky se používají jako reflexní negativy.“

Tento přístup zajišťuje, že načtené obrázky přispívají chybějící znalosti k procesu generování, spíše než k posilování stávajících předsudků v modelu.

Zcela vlevo, získaný referenční obrázek; střed, bez RAG; zcela vpravo, s použitím načteného obrázku.

Spolehlivost na kvalitu vyhledávání a pokrytí databáze však znamená, že její účinnost se může lišit v závislosti na dostupnosti vysoce kvalitních referencí. Pokud relevantní obrázek v datové sadě neexistuje, model může stále zápasit s neznámými koncepty.

RealRAG je velmi modulární architektura, která nabízí kompatibilitu s mnoha dalšími generativními architekturami, včetně modelů založených na U-Net, DiT a autoregresivních modelů.

Obecně získávání a zpracování externích obrázků zvyšuje výpočetní režii a výkon systému závisí na tom, jak dobře je mechanismus získávání zobecňuje napříč různými úkoly a datovými sadami.

Proč investovat do čističky vzduchu?

Toto je spíše reprezentativní než vyčerpávající přehled multimodálních generativních systémů pro získávání obrazu. Některé systémy tohoto typu využívají vyhledávání pouze ke zlepšení porozumění vidění nebo správě datových souborů, kromě jiných různých motivů, spíše než ke snaze generovat obrázky. Jedním z příkladů je Internet Explorer.

Mnoho dalších projektů integrovaných do RAG v literatuře zůstává nezveřejněno. Prototypy s pouze publikovaným výzkumem zahrnují Re-Imagen, který – navzdory původu od Googlu – má přístup pouze k obrázkům z místní vlastní databáze.

Také v listopadu 2024, Baidu oznámila, Image-Based Retrieval-Augmented Generation (iRAG), nová platforma, která využívá načtené obrázky „z databáze“. Ačkoli je iRAG údajně k dispozici na platformě Ernie, zdá se, že neexistují žádné další podrobnosti o tomto procesu vyhledávání, který se opírá o místní databáze (tj. lokální pro službu a není přímo přístupná uživateli).

Dále rok 2024 papír Jednotné generování a načítání textu na obrázek nabízí další metodu založenou na RAG použití externích obrázků k rozšíření výsledků v době generování – opět z místní databáze spíše než z ad hoc internetové zdroje.

Vzrušení kolem augmentace založené na RAG při generování obrázků se pravděpodobně zaměří na systémy, které mohou přímo do generativního procesu začlenit obrázky získané z internetu nebo nahrané uživateli a které umožňují uživatelům účastnit se výběru nebo zdrojů obrázků.

To je však významná výzva přinejmenším ze dvou důvodů; za prvé proto, že účinnost takových systémů obvykle závisí na hluboce integrovaných vztazích vytvořených během tréninkového procesu náročného na zdroje; a za druhé, protože obavy o bezpečnost, zákonnost a omezení autorských práv, jak bylo uvedeno výše, činí z této funkce nepravděpodobnou funkci pro webovou službu řízenou API a pro komerční nasazení obecně.

* Source: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Poprvé zveřejněno v úterý 4. února 2025