Andersonův úhel

Hledání ‘sov a ještěrek’ v publikační audienci inzerentů

Vzhledem k tomu, že se odhaduje, že online reklamní sektor utratil 740,3 miliardy USD v roce 2023, je snadno pochopitelné, proč reklamní společnosti investují značné prostředky do tohoto konkrétního směru počítačového vidění.

Ačkoli je tato oblast uzavřená a chráněná, občas publikuje studie, které naznačují pokročilejší proprietární práci v oblasti rozpoznávání obličeje a pohledu – včetně rozpoznávání věku, které je centrální pro demografickou analytiku:

Odhad věku v reklamním kontextu je zajímavý pro inzerenty, kteří mohou cílit na konkrétní věkovou skupinu. V tomto experimentálním příkladu automatického odhadu věku je sledován věk zpěváka Boba Dylana po letech. Zdroj: https://arxiv.org/pdf/1906.03625

Tyto studie, které se zřídka objevují v veřejných repozitářích, jako je Arxiv, používají legitimně získané účastníky jako základ pro analýzu řízenou umělou inteligencí, která má za cíl určit, do jaké míry a jakým způsobem se divák zapojuje do reklamy.

Dlib’s Histogram of Oriented Gradients (HoG) je často používán v systémech pro odhad obličeje. Zdroj: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Animal Instinct

V tomto ohledu je přirozeně reklamní průmysl intéressován tím, aby určoval falešné pozitivy (případy, kdy analytický systém mylně interpretuje jednání subjektu) a stanovil jasná kritéria pro to, kdy osoba sledující reklamy není plně zapojena do obsahu.

Pokud se jedná o reklamní reklamu na obrazovce, studie se obvykle zaměřují na dva problémy ve dvou prostředích. Prostředí jsou ‘desktop’ nebo ‘mobile’, každé z nich má své specifické charakteristiky, které vyžadují přizpůsobené řešení; a problémy – z pohledu inzerentů – jsou reprezentovány chováním sov a ještěrek – tendencí diváků nevěnovat plnou pozornost reklamě, která je před nimi.

Příklady chování ‘sovy’ a ‘ještěrky’ v rámci výzkumného projektu reklamy. Zdroj: https://arxiv.org/pdf/1508.04028

Pokud se díváte od reklamy s celou hlavou, jedná se o ‘chování sovy’; pokud je vaše hlava statická, ale vaše oči bloudí od obrazovky, jedná se o ‘chování ještěrky’. Z hlediska analytiky a testování nových reklam v kontrolovaných podmínkách jsou tyto akce pro systém nezbytné.

Nová práce od SmartEye’s Affectiva acquisition se zabývá těmito problémy a nabízí architekturu, která využívá několik stávajících rámců k poskytnutí kombinovaného a konkatenuovaného souboru funkcí napříč všemi požadovanými podmínkami a možnými reakcemi – a k určení, zda je divák nudný, zapojený nebo nějakým způsobem vzdálený od obsahu, který inzerent chce, aby jej sledoval.

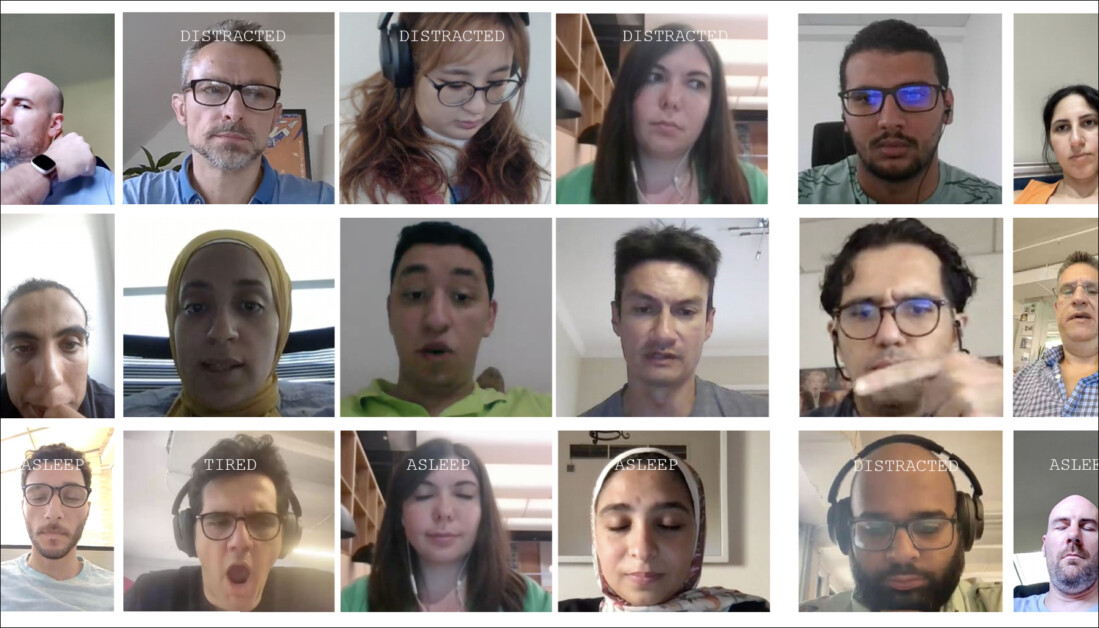

Příklady skutečných a falešných pozitiv detekovaných novým systémem pro různé signály rozptýlení, zobrazené samostatně pro desktop a mobilní zařízení. Zdroj: https://arxiv.org/pdf/2504.06237

Autoři uvádějí*:

‘Omezený výzkum se zabýval monitorováním pozornosti během online reklam. Zatímco tyto studie se zaměřily na odhad hlavy nebo směru pohledu k identifikaci případů rozptýleného pohledu, nezohledňují kritické parametry, jako je typ zařízení (desktop nebo mobilní), umístění kamery vzhledem k obrazovce a velikost obrazovky. Tyto faktory významně ovlivňují detekci pozornosti.

‘V tomto článku navrhujeme architekturu pro detekci pozornosti, která zahrnuje detekci různých rozptýlení, včetně chování sov a ještěrek, mluvení, spánku (prostřednictvím zívání a prodlouženého zavření očí) a opuštění obrazovky.

‘Na rozdíl od předchozích přístupů naše metoda integruje zařízeníspecifické funkce, jako je typ zařízení, umístění kamery, velikost obrazovky (pro desktopy) a orientace kamery (pro mobilní zařízení) s hrubým odhadem pohledu, aby se zlepšila přesnost detekce pozornosti.’

Nová práce se nazývá Monitorování pozornosti diváka během online reklam a pochází od čtyř výzkumníků z Affectiva.

Metoda a data

Z velké části kvůli utajení a uzavřené povaze těchto systémů nová práce nesrovnává přístup autorů přímo s konkurenty, ale spíše prezentuje své výsledky výhradně jako ablační studie; ani práce nevyhovuje obecně obvyklému formátu literatury počítačového vidění. Proto se podíváme na výzkum, jak je prezentován.

Autoři zdůrazňují, že pouze omezený počet studií se zabýval detekcí pozornosti specificky v kontextu online reklam. V AFFDEX SDK, který nabízí reálný čas multi-obličejové rozpoznávání, je pozornost odvozena pouze z hlavy, s účastníky označenými jako nezapojení, pokud jejich hlava překročí definovaný práh.

Příklad z AFFDEX SDK, systému Affectiva, který se spoléhá na hlavu jako indikátor pozornosti. Zdroj: https://www.youtube.com/watch?v=c2CWb5jHmbY

V 2019 spolupráci Automatické měření vizuální pozornosti na videoobsah pomocí hlubokého učení, dataset asi 28 000 účastníků byl annotován pro různé nezapojené chování, včetně odvrácení pohledu, zavření očí nebo zapojení do nesouvisejících aktivit, a model CNN-LSTM byl vyškolován k detekci pozornosti z obličejového vzhledu v čase.

Z 2019 článku, příklad ilustrující předpovězené stavy pozornosti pro diváka sledujícího videoobsah. Zdroj: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Avšak autoři pozorují, že tyto předchozí snahy nezohledňovaly zařízeníspecifické faktory, jako je typ zařízení nebo velikost obrazovky; ani nezohledňovaly umístění kamery. Kromě toho se systém AFFDEX zaměřuje pouze na identifikaci rozptýlení pohledu a opomíjí jiné zdroje rozptýlení, zatímco práce z roku 2019 se snaží detekovat širší sadu chování – ale jeho použití jediného mělkého CNN může, podle článku, být nedostatečné pro tuto úlohu.

Autoři pozorují, že některé z nejpopulárnějších výzkumů v této oblasti nejsou optimalizovány pro testování reklam, které má odlišné potřeby ve srovnání s doménami, jako je řízení nebo vzdělávání – kde je umístění kamery a kalibrace obvykle pevně stanoveny předem, spoléhající se místo toho na nekalirované nastavení a fungující v omezeném rozsahu pohledu desktopových a mobilních zařízení.

Proto autoři vytvořili architekturu pro detekci pozornosti diváka během online reklam, využívající dvě komerční toolkity: AFFDEX 2.0 a SmartEye SDK.

Příklady obličejové analýzy z AFFDEX 2.0. Zdroj: https://arxiv.org/pdf/2202.12059

Tyto předchozí práce extrahují nízkoúrovňové funkce jako obličejové výrazy, hlavu a směr pohledu. Tyto funkce jsou pak zpracovány k produkci vyšších indikátorů, včetně pozice pohledu na obrazovce; zívání; a mluvení.

Systém identifikuje čtyři typy rozptýlení: odvrácení pohledu; spánek,; mluvení; a opuštění obrazovky. Systém také upravuje analýzu pohledu podle toho, zda je divák na desktopu nebo mobilním zařízení.

Datasets: Pohled

Autoři použili čtyři datasets k napájení a vyhodnocení systému detekce pozornosti: tři se zaměřovaly individuálně na chování pohledu, mluvení a zívání; a čtvrtý byl získán z reálných testovacích relací s reklamami, obsahujících směs různých typů rozptýlení.

Due to the specific requirements of the work, custom datasets were created for each of these categories. All the datasets curated were sourced from a proprietary repository featuring millions of recorded sessions of participants watching ads in home or workplace environments, using a web-based setup, with informed consent – and due to the limitations of those consent agreements, the authors state that the datasets for the new work cannot be made publicly available.

To construct the pohled dataset, participants were asked to follow a moving dot across various points on the screen, including its edges, and then to look away from the screen in four directions (up, down, left, and right) with the sequence repeated three times. In this way, the relationship between capture and coverage was established:

Snímky obrazovky zobrazující video stimul pro pohled na (a) desktop a (b) mobilních zařízeních. První a třetí snímky zobrazují instrukce pro sledování pohyblivého bodu, zatímco druhý a čtvrtý snímky vyzývají účastníky, aby se podívali pryč od obrazovky.

The moving-dot segments were labeled as pozorný, and the off-screen segments as nepozorný, producing a labeled dataset of both positive and negative examples.

Každé video trvalo přibližně 160 sekund, s oddělenými verzemi vytvořenými pro desktop a mobilní platformy, každou s rozlišením 1920×1080 a 608×1080, resp.

Celkem bylo shromážděno 609 videí, z nichž 322 bylo z desktopu a 287 z mobilních zařízení. Labels byly aplikovány automaticky na základě obsahu videa, a dataset split do 158 trénovacích vzorků a 451 pro testování.

Datasets: Mluvení

V tomto kontextu je jedním z kritérií definujících ‘nepozornost’ případ, kdy osoba mluví déle než jeden sekundu (což může být okamžité komentáře, nebo dokonce kašel).

Since the controlled environment does not record or analyze audio, speech is inferred by observing inner movement of estimated facial landmarks. Therefore to detect mluvení without audio, the authors created a dataset based entirely on visual input, drawn from their internal repository, and divided into two parts: the first of these contained approximately 5,500 videos, each manually labeled by three annotators as either speaking or not speaking (of these, 4,400 were used for training and validation, and 1,100 for testing).

The second comprised 16,000 sessions automatically labeled based on session type: 10,500 feature participants silently watching ads, and 5,500 show participants expressing opinions about brands.

Datasets: Zívání

While some ‘zívání’ datasets exist, including YawDD and Driver Fatigue, the authors assert that none are suitable for ad-testing scenarios, since they either feature simulované zívání or else contain facial contortions that could be confused with strach, or other, non-zívající actions.

Therefore the authors used 735 videos from their internal collection, choosing sessions likely to contain a jaw drop lasting more than one second. Each video was manually labeled by three annotators as either showing aktivní or neaktivní zívání. Only 2.6 percent of frames contained active yawns, underscoring the class imbalance, and the dataset was split into 670 training videos and 65 for testing.

Datasets: Rozptýlení

The rozptýlení dataset was also drawn from the authors’ ad-testing repository, where participants had viewed actual advertisements with no assigned tasks. A total of 520 sessions (193 on mobile and 327 on desktop environments) were randomly selected and manually labeled by three annotators as either pozorný or nepozorný.

Inattentive behavior included odvrácení pohledu, mluvení, spánek, and opuštění obrazovky. The sessions span diverse regions across the world, with desktop recordings more common, due to flexible webcam placement.

Modely pozornosti

The proposed attention model processes low-level visual features, namely facial expressions; head pose; and gaze direction – extracted through the aforementioned AFFDEX 2.0 and SmartEye SDK.

These are then converted into high-level indicators, with each distractor handled by a separate binary classifier trained on its own dataset for independent optimization and evaluation.

Schéma pro navrhovaný monitoringový systém.

The pohled model determines whether the viewer is looking at or away from the screen using normalized gaze coordinates, with separate calibration for desktop and mobile devices. Aiding this process is a linear Support Vector Machine (SVM), trained on spatial and temporal features, which incorporates a memory window to smooth rapid gaze shifts.

To detect mluvení without audio, the system used cropped mouth regions and a 3D-CNN trained on both conversational and non-conversational video segments. Labels were assigned based on session type, with temporal smoothing reducing the false positives that can result from brief mouth movements.

Zívání was detected using full-face image crops, to capture broader facial motion, with a 3D-CNN trained on manually labeled frames (though the task was complicated by zívání’s low frequency in natural viewing, and by its similarity to other expressions).

Opouštění obrazovky was identified through the absence of a face or extreme head pose, with predictions made by a decision tree.

Konečný stav pozornosti was determined using a fixed rule: if any module detected inattention, the viewer was marked nepozorný – an approach prioritizing sensitivity, and tuned separately for desktop and mobile contexts.

Testy

As mentioned earlier, the tests follow an ablative method, where components are removed and the effect on the outcome noted.

Různé kategorie vnímané nepozornosti identifikované ve studii.

The gaze model identified off-screen behavior through three key steps: normalizing raw gaze estimates, fine-tuning the output, and estimating screen size for desktop devices.

To understand the importance of each component, the authors removed them individually and evaluated performance on 226 desktop and 225 mobile videos drawn from two datasets. Results, measured by G-mean and F1 scores, are shown below:

Výsledky ukazující výkon plného modelu pohledu, spolu s verzemi s jednotlivými procesními kroky odstraněnými.

In every case, performance declined when a step was omitted. Normalization proved especially valuable on desktops, where camera placement varies more than on mobile devices.

The study also assessed how visual features predicted mobile camera orientation: face location, head pose, and eye gaze scored 0.75, 0.74, and 0.60, while their combination reached 0.91, highlighting – the authors state – the advantage of integrating multiple cues.

The mluvení model, trained on vertical lip distance, achieved a ROC-AUC of 0.97 on the manually labeled test set, and 0.96 on the larger automatically labeled dataset, indicating consistent performance across both.

The zívání model reached a ROC-AUC of 96.6 percent using mouth aspect ratio alone, which improved to 97.5 percent when combined with action unit predictions from AFFDEX 2.0.

The unattended-screen model classified moments as nepozorný when both AFFDEX 2.0 and SmartEye failed to detect a face for more than one second. To assess the validity of this, the authors manually annotated all such no-face events in the real distraction dataset, identifying the underlying cause of each activation. Ambiguous cases (such as camera obstruction or video distortion) were excluded from the analysis.

As shown in the results table below, only 27 percent of ‘no-face’ activations were due to users physically leaving the screen.

Různé získané důvody, proč nebyla nalezena tvář, v určitých případech.

The paper states:

‘Despite unattended screens constituted only 27% of the instances triggering the no-face signal, it was activated for other reasons indicative of inattention, such as participants gazing off-screen with an extreme angle, doing excessive movement, or occluding their face significantly with an object/hand.’

In the last of the quantitative tests, the authors evaluated how progressively adding different distraction signals – off-screen gaze (via gaze and head pose), drowsiness, speaking, and unattended screens – affected the overall performance of their attention model.

Testing was carried out on two datasets: the real distraction dataset and a test subset of the pohled dataset. G-mean and F1 scores were used to measure performance (although drowsiness and speaking were excluded from the gaze dataset analysis, due to their limited relevance in this context)s.

As shown below, attention detection improved consistently as more distraction types were added, with odvrácení pohledu, the most common distractor, providing the strongest baseline.

Účinek přidání různých signálů rozptýlení do architektury.

Of these results, the paper states:

‘From the results, we can first conclude that the integration of all distraction signals contributes to enhanced attention detection.

‘Second, the improvement in attention detection is consistent across both desktop and mobile devices. Third, the mobile sessions in the real dataset show significant head movements when gazing away, which are easily detected, leading to higher performance for mobile devices compared to desktops. Fourth, adding the drowsiness signal has relatively slight improvement compared to other signals, as it’s usually rare to happen.

‘Finally, the unattended-screen signal has relatively larger improvement on mobile devices compared to desktops, as mobile devices can be easily left unattended.’

The authors also compared their model to AFFDEX 1.0, a prior system used in ad testing – and even the current model’s head-based gaze detection outperformed AFFDEX 1.0 across both device types:

‘This improvement is a result of incorporating head movements in both the yaw and pitch directions, as well as normalizing the head pose to account for minor changes. The pronounced head movements in the real mobile dataset have caused our head model to perform similarly to AFFDEX 1.0.’

The authors close the paper with a (perhaps rather perfunctory) qualitative test round, shown below.

Ukázky výstupů z modelu pozornosti napříč desktopovými a mobilními zařízeními, s každým řádkem prezentujícím příklady skutečných a falešných pozitiv pro různé typy rozptýlení.

The authors state:

‘The results indicate that our model effectively detects various distractors in uncontrolled settings. However, it may occasionally produce false positives in certain edge cases, such as severe head tilting while maintaining gaze on the screen, some mouth occlusions, excessively blurry eyes, or heavily darkened facial images. ‘

Závěr

While the results represent a measured but meaningful advance over prior work, the deeper value of the study lies in the glimpse it offers into the persistent drive to access the viewer’s internal state. Although the data was gathered with consent, the methodology points toward future frameworks that could extend beyond structured, market-research settings.

This rather paranoid conclusion is only bolstered by the cloistered, constrained, and jealously protected nature of this particular strand of research.

* My conversion of the authors’ inline citations into hyperlinks.

First published Wednesday, April 9, 2025