Andersonův úhel

Identifikace krádeže modelu AI prostřednictvím tajných sledovacích dat

Nová metoda může tajně označit modely podobné ChatGPT během sekund bez potřebného přeškolování, aniž by zanechala stopu v obecném výstupu a přežila všechny možné pokusy o odstranění.

Jemný rozdíl mezi označením vodotiskem a “copyright-baiting” spočívá v tom, že vodotisky – zda jsou zjevné nebo skryté – jsou obvykle určeny k tomu, aby se objevily po celou sbírku (jako je dataset obrázků) jako všudypřítomná překážka pro neformální kopírování.

Naopak, fiktivní vstup je malý segment textu, obvykle slovo nebo definice uvedená v velké a relativně obecné sbírce, určená k prokázání krádeže. Nápad spočívá v tom, že když je celá práce nelegitimně zkopírována, buď sama o sobě nebo jako základ pro odvozenou práci, přítomnost “jedinečné” a fiktivní skutečnosti, založené původním vlastníkem, snadno odhalí akt krádeže.

V případě přidání vodotisků do velkých jazykových modelů (LLM) a modelů jazyka a vidění (VLM) je rozsah, ve kterém výstup má obsahovat tyto prozrazující znaky, často rozdělen mezi tyto dva cíle: zajistit, aby všechny nebo většina výstupu obsahovala manifestní nebo latentní vodotisk; nebo zajistit, aby “tajný token” mohl být obnoven, který prokazuje krádež – ale který se neobjevuje v běžném výstupu z modelu.

Váha důkazů

Druhý přístup je řešen v zajímavé nové spolupráci mezi Čínou, Itálií a Singapurem; práce, která si klade za cíl poskytnout takovýto metod odhalení open source modelům, aby nemohly být snadno komerčně využity nebo jinak použity způsoby, které původní licence nezakazuje.

Například licence původního modelu může vyžadovat, aby kdokoli mohl profitovat z práce, pokud provede své vlastní úpravy nebo změny veřejně dostupné pod stejnými štědrými licenčními podmínkami – ale společnost může chtít bránit své “úpravy” (jako fine-tuned verze), aby vytvořila priehrady, kde žádné nejsou opravdu povoleny.

Většina výzkumu v této oblasti se zabývá detekčními rutinami souvisejícími s uzavřeným zdrojovým, API pouze modely, nebo modely, pro které jsou k dispozici pouze optimalizované (quantizované) váhy jsou k dispozici; a které jsou proto obtížnější efektivně editovat a měnit způsobem, jakým navrhuje nová práce (protože není přímý přístup k architektuře modelu samotného).

Tato pozornost FOSS vydání je, možná, nečekaná z čínského výzkumného sektoru, protože čínský AI výstup byl za poslední rok charakterizován štědrými plnými-váhovými vydáními modelů, které alespoň rivality více “zamčené” západní ekvivalenty.

Nový přístup, nazvaný EditMark, liší se tím, že nevyžaduje, aby model byl fine-tuned pro přidání “poisoned” dat, ani nebyl trénován od začátku s daty zahrnutými.

To má několik výhod: jedna je, že jakékoli “prozrazující” data zahrnuta v trénovací datové sadě, jednou objevená a zveřejněná, již nebudou účinná, protože mohou být přímo zaměřeny útočníky; ale aby útočník mohl napadnout EditMark, musel by vědět, který vrstva modelu cílit, a jaký přístup byl použit. To je nepravděpodobný scénář.

Druhá výhoda spočívá v tom, že přístup je rychlý a levný, trvá pouze několik sekund (na rozdíl od dnů nebo dokonce týdnů) na aplikaci na trénovaný model, což eliminuje vysoké náklady na fine-tuning (které se zvyšují lineárně se velikostí modelu a dat, která mají být aplikována).

Nakonec přístup způsobuje mnohem méně poškození normálnímu provozu cíleného modelu než fine-tuning nebo předchozí editační metody.

Ve testech EditMark – který vkládá matematické dotazy s více možnými odpověďmi do modelových váh – dosáhl extrakční rychlosti 100%.

Autoři uvádějí:

‘Komplexní experimenty prokazují výjimečné výkony EditMarku při označení LLM. EditMark dosahuje pozoruhodné efektivity vkládáním 32bitového vodotisku za méně než 20 sekund s 100% úspěšností extrakce vodotisku (ESR).

‘Zejména doba vkládání vodotisku je méně než 1/300 fine-tuning (průměrně 6 875 sekund), což zdůrazňuje efektivity EditMarku při implementaci vodotisků s vysokou kapacitou a bezprecedentní rychlostí a spolehlivostí.

‘Kromě toho, rozsáhlé experimenty ověřují odolnost, skrytost a věrnost EditMarku.’

Nová práce nová práce je nazvaná EditMark: Označování velkých jazykových modelů na základě editace modelu, a pochází od osmi autorů z Univerzity vědy a technologie Číny, Univerzity v Sieně a CFAR/IHPC/A*STAR v Singapuru.

Metoda

Přístup EditMark se skládá ze čtyř komponent: Generátor, Kodér, Editor a Dekodér:

Potrubí EditMark vkládá vodotisk editací modelu pro odpovědi na specifické matematické otázky, které kódují skryté identifikační informace. Zdroj: https://arxiv.org/pdf/2510.16367

Generátor používá pseudo-náhodné semínko pro konstrukci více-odpovědí matematických otázek; Kodér vybírá odpovědi na základě vodotisku, které jsou poté vloženy do modelu prostřednictvím specializovaného editačního procesu. Jakmile je upravený model vydán nebo zneužit, vodotisk může být extrahován dotazováním stejných otázek a dekódováním vzoru odpovědí.

Následně Editor upravuje modelové váhy tak, aby model spolehlivě produkoval cílové odpovědi, když je dotázán na tyto semínkové otázky, vkládaje vodotisk přímo do jeho chování. Dekodér poté obnovuje vodotisk krmením stejných otázek podezřelému modelu a překladem jeho odpovědí zpět do skryté signatury.

Model hrozby

Papírův model hrozby předpokládá, že označování vodotiskem je provedeno v bílém boxu. Ačkoli to není obvykle dobrý znak ve výzkumu souvisejícím s bezpečností, zde je to normální, protože metoda má za cíl chránit vlastníky, kteří mají plný přístup ke své vlastní práci.

Útočník je také předpokládán, že má bílý boxový přístup po získání modelu, což znamená, že může model upravit (například prořezáním nebo fine-tuningem). Opět je tento scénář normální a očekávaný v případě FOSS vydání. Nicméně, útočník není obeznámen s procesem extrakce vodotisku nebo schématem, které se používá, a může jej najít pouze odvozením a experimentováním (nebo jinak, úniky).

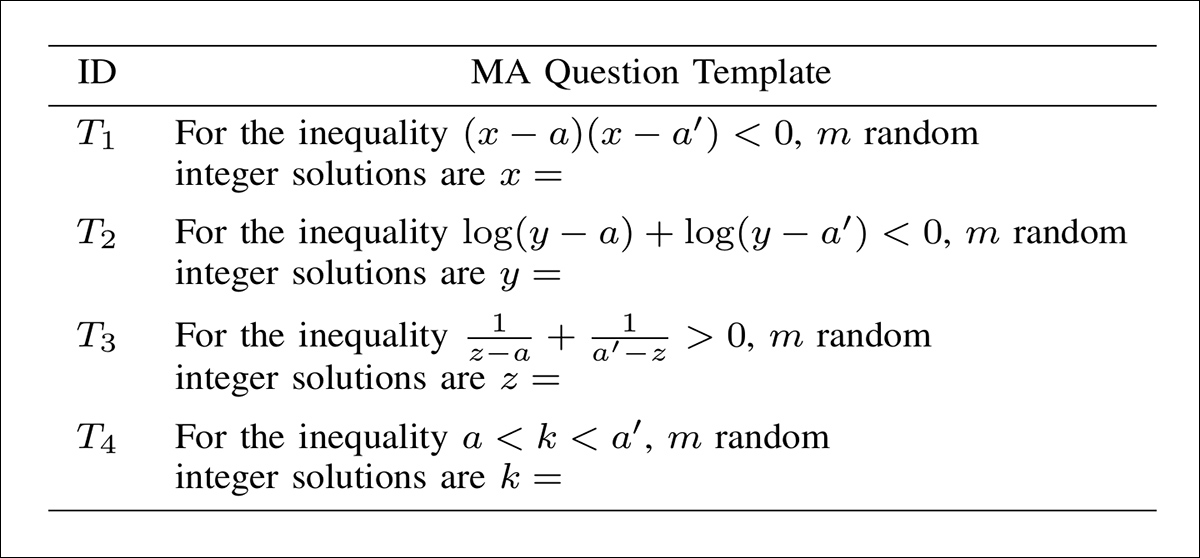

Generátor konstruuje logicky a fakticky platné matematické otázky s více správnými odpověďmi, pomocí GPT‑4o pro diversifikaci šablon (jako je znázorněno níže), a pseudo-náhodné semínko pro zajištění, že každá otázka je jedinečná. To umožňuje, aby známý vodotisk byl vložen deterministicky prostřednictvím permutací odpovědí, zatímco minimalizuje překryv mezi otázkami, aby se zabránilo editačnímu spojení:

Šablony otázek generovaných GPT‑4o pro vkládání vodotisku, každá strukturovaná pro výstup více platných celočíselných odpovědí z nasazené nerovnosti.

Kodér transformuje každý binární segment vodotisku do jedinečné permutace celých čísel vybraných ze množiny řešení dané matematické otázky. Používaje lexikografickou permutační teorii, Kodér mapuje desítkovou hodnotu každého segmentu vodotisku na specifickou uspořádanou selekci odpovědí, zajišťuje, že vodotisk je deterministicky vložen do chování modelu.

S ohledem na Editor, původní AlphaEdit model editační metoda používaná pro označování vodotiskem postrádá přesnost a odolnost, s upraveným modelem, který často selhává při návratu požadovaných odpovědí. Jakékoli změny, které provede, jsou snadno porušeny prořezáním nebo šumem.

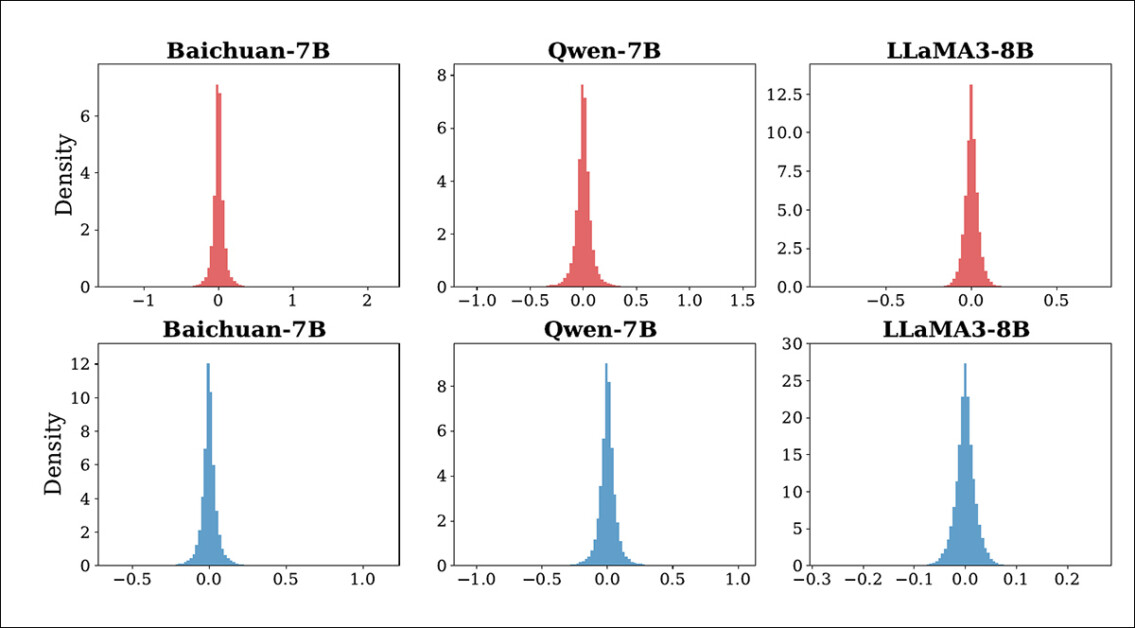

Aby se tomu zabránilo, autoři vyvinuli multi-kolový editační strategii, která postupně upravuje modelové váhy v jediné MLP vrstvě až do doby, než jeho odpovědi jsou dostatečně zarovnány s požadovanými odpověďmi. Aby se editace zpevnily proti útokům, jsou během tréninku vloženy Gaussovy šumy:

Rozdělení změn v K1 pro Baichuan-7B, Qwen-7B a LLaMA3-8B před a po útocích. Horní řada ukazuje efekt náhodného vkládání šumu; spodní řada ukazuje efekt prořezání modelu. Všechny změny zůstávají blízko nuly, což naznačuje, že útoky nemají významný dopad na vnitřní chování modelu.

Systém hodnocení zastavuje proces, jakmile jsou úpravy dostatečně přesné, zatímco regularizace zajišťuje, že aktualizace zůstávají stabilní přes několik kol.

Dekodér klade modelu stejné speciální otázky, které se používají během označování vodotiskem, a poté čtete jeho odpovědi, aby se odvodila skrytá identita. Protože vzorec odpovědí následuje tajný řád, tato identita může být obnovena bez nutnosti prozkoumat vnitřek modelu.

Data a testy

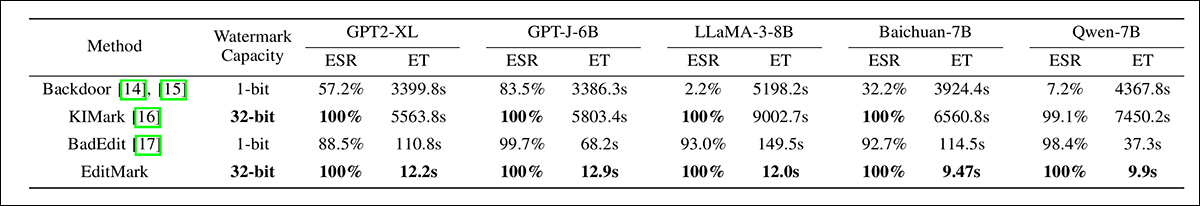

Aby se otestoval EditMark, pět LLM byly vyhodnoceny: GPT2-X; GPT-J-6B; LLaMA-3-8B; Baichuan-7B; a Qwen-7B. Uvedený AlphaEdit byl použit pro vkládání vodotisků, zatímco míra úspěšnosti extrakce (ESR) a doba vkládání (ET) byly metriky, které se použily.

Pro srovnávací účely autoři zvolili Model Watermark (backdoor); KIMark; a BadEdit, rámec původně navržen pro vkládání backdoor, zde adaptovaný pro účely projektu.

Autoři upravili 15. vrstvu LLaMA-3-8; 17. vrstvu GPT2-XL a GPT-J-6B; a 14. vrstvu Qwen-7B a Baichuan-7B.

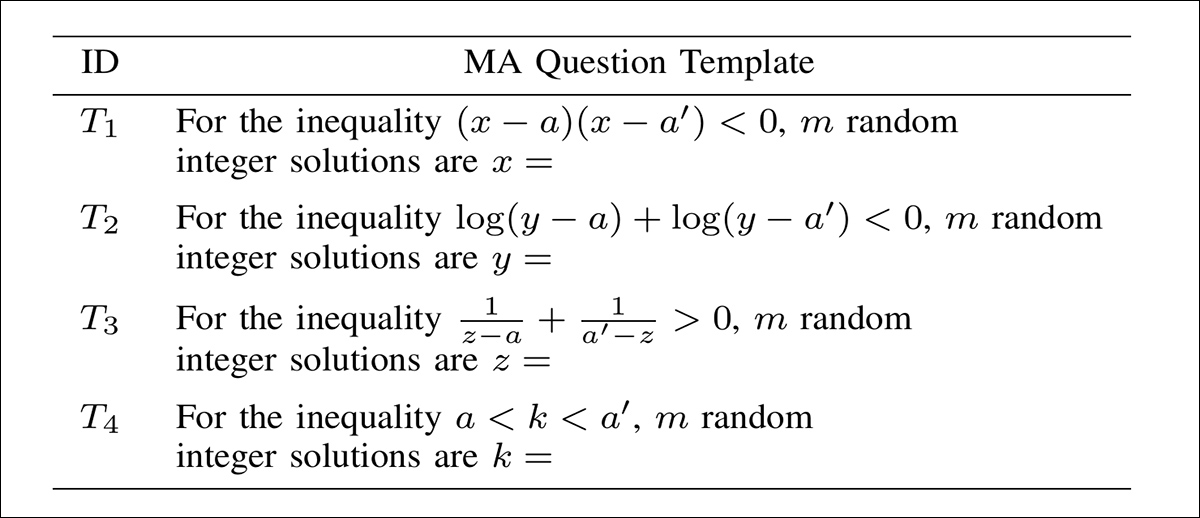

Experimenty byly provedeny na čtyřech NVIDIA RTX 4090 GPU (24GB VRAM každý), s vodotisky délky 32-bit, 64-bit a 128-bit vložených. Šablony otázek, které se použily, jsou uvedeny v obrázku níže:

Šablony použitých pro generování více-odpovědí (MA) otázek pro označování vodotiskem. Každá otázka je založena na jiném typu matematické nerovnosti, s náhodnými hodnotami vloženými pro proměnné. Model je dotázán na návrat seznamu celočíselných řešení, s pořadím odpovědí použitým pro kódování nebo dekódování bitů vodotisku. Čtyři šablony pokrývají kvadratické, logaritmické, racionální a intervalové formy, a všechny byly vygenerovány pomocí GPT-4o.

Aby se snížily účinky náhody, semínka od 1 do 20 se použily během testování, napříč různými kapacitami vodotisku.

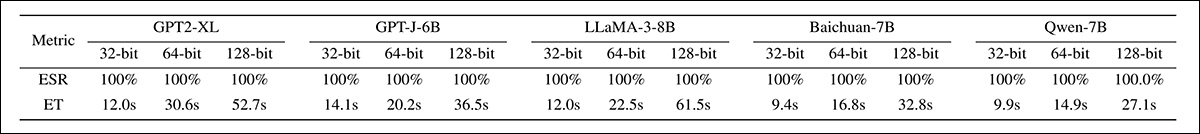

Zpočátku výzkumníci testovali jak ESR, tak časovou náročnost vkládání vodotisku napříč rozsahem LLM:

Srovnání EditMarku proti třem předchozím metodám označování vodotiskem na pět velkých jazykových modelů. Uvádí se míra úspěšnosti extrakce (ESR) a doba vkládání (ET) v sekundách. EditMark konzistentně dosahuje 100% úspěšnosti, zatímco snižuje dobu vkládání o několik řádů, překonává všechny srovnávací metody v obou přesnosti a efektivitě napříč modely různé velikosti a architektury.

Z těchto výsledků autoři uvádějí:

‘[EditMark] dosahuje 100% ESR a vyžaduje méně než 20 sekund pro vkládání 32bitového vodotisku pro všechny vyhodnocené LLM. Zvláště průměrná doba vkládání pro Baichuan-7B a Qwen-7B je pod 10 sekund, což demonstruje vysokou efektivitu EditMarku.’

Pro vyhodnocení 128bitového vodotisku, nejvyšší hodnota, která je pod takovým schématem proveditelná, EditMark byl schopen zachovat stav “nelze smazat”:

Míra úspěšnosti extrakce a doba vkládání pro EditMark napříč délkami vodotisku 32, 64 a 128 bitů na pět jazykových modelů. Dokonale úspěšné míry jsou udržovány ve všech případech, zatímco doba vkládání se zvyšuje se velikostí vodotisku, ale zůstává pod jednou minutou, dokonce i při 128 bitech.

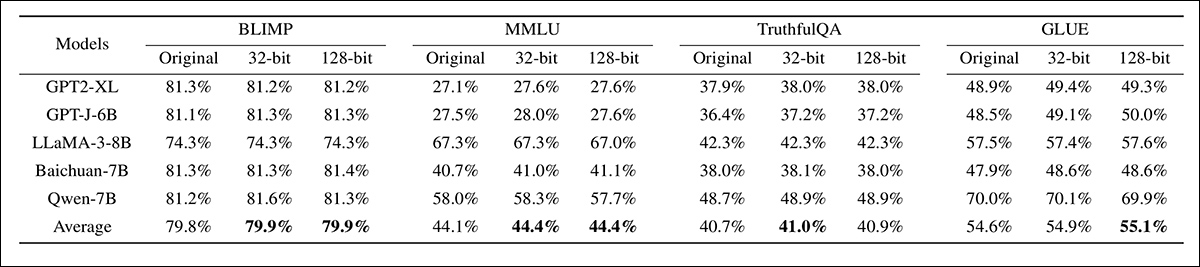

Další systémova schopnost zachovat věrnost vodotisku byla testována napříč několika benchmarky:

Vyhodnocení věrnosti vodotisku na čtyřech benchmarkách napříč pěti modely, srovnávající neupravené modely s modely označenými vodotiskem o kapacitě 32 bitů a 128 bitů. Výkon zůstal stabilní napříč konfiguracemi, s pouze malými fluktuacemi v průměrném skóre, což naznačuje omezený dopad na přesnost benchmarku z vkládání vodotisku.

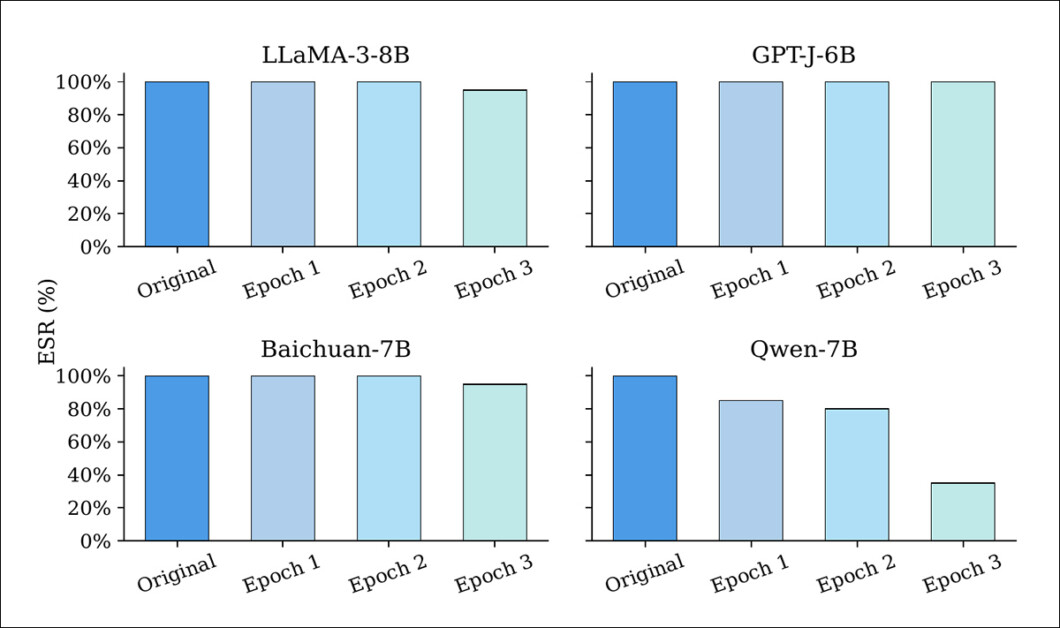

Odolnost EditMarku byla testována proti šesti běžným útokovým strategiím. Modely byly nejprve označeny 128bitovými vodotisky pomocí pěti různých semínek. Fine-tuning, jak je znázorněno na obrázku níže, způsobil pouze malé zhoršení míry úspěšnosti extrakce (ESR) pro většinu modelů:

Míra úspěšnosti extrakce vodotisku pro označené LLM před a po fine-tuning pro jeden až tři epochy. Zatímco většina modelů zachovává vysokou ESR po celou dobu, Qwen-7B ukazuje zřetelný pokles, naznačující větší zranitelnost vůči aktualizacím parametrů.

I po нескольких epochách většina modelů zachovala ESR nad 90%, což naznačuje, že EditMark odolává posunu parametrů, který je zaveden LoRA-založeným tréninkem.

Kvantizační útoky snížily přesnost modelu, ale ponechaly většinu vodotisků nedotčených:

Míra úspěšnosti extrakce vodotisku pro označené modely před a po kvantizaci pomocí Int-8 a Int-4 přesnosti. ESR zůstala nezměněna pod Int-8 kvantizací napříč všemi modely, zatímco Int-4 kvantizace způsobila částečné zhoršení, naznačující, že nižší přesnost může oslabit, ale ne zcela odstranit vodotisk.

Jak je vidět na obrázku výše, Int-8 kvantizace zachovala 100% ESR napříč všemi modely, zatímco Int-4 kvantizace měla mírný dopad na ESR, ale zavedla nepřijatelné ztráty výkonu.

Jak práce uvádí, tento konkrétní scénář naznačuje omezený potenciál pro útočníka, protože to vede k ohroženému, ale výkonově degradovanému modelu.

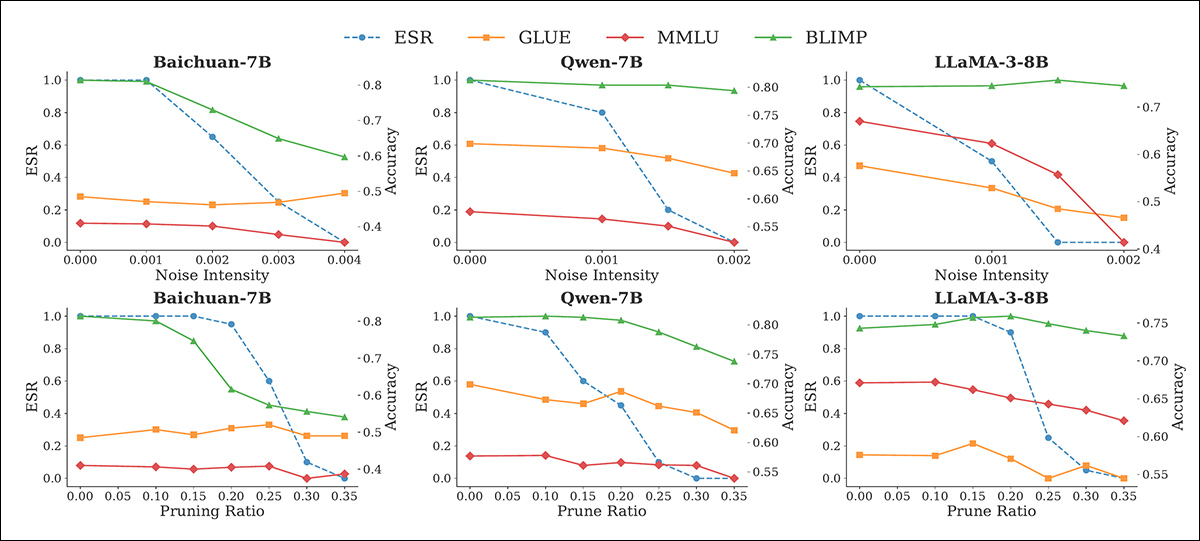

Testy na šum a prořezání vyhodnotily čtyři benchmarkové rámce: MMLU; BLIMP; TruthfulQA; a GLUE. Tyto útoky vedly ke snižující se ESR, jak se perturbace zintenzivňovaly:

Účinek šumu (horní řada) a prořezání (spodní řada) útoků na ESR a benchmarkový výkon označených modelů. Jak ESR klesá s rostoucí perturbací, benchmarková přesnost se také zhoršuje, zejména při vyšších intenzitách šumu a prořezání, což zdůrazňuje (obvyklý) napětí mezi odstraněním vodotisku a užitečností modelu.

Nicméně, také vedly ke značnému poklesu úkolu výkonu, s Baichuan-7B, který obdržel 27-31% pokles na BLIMP, když byl aplikován šum nebo prořezání.

Modelová editace a adaptivní útoky byly také vyhodnoceny:

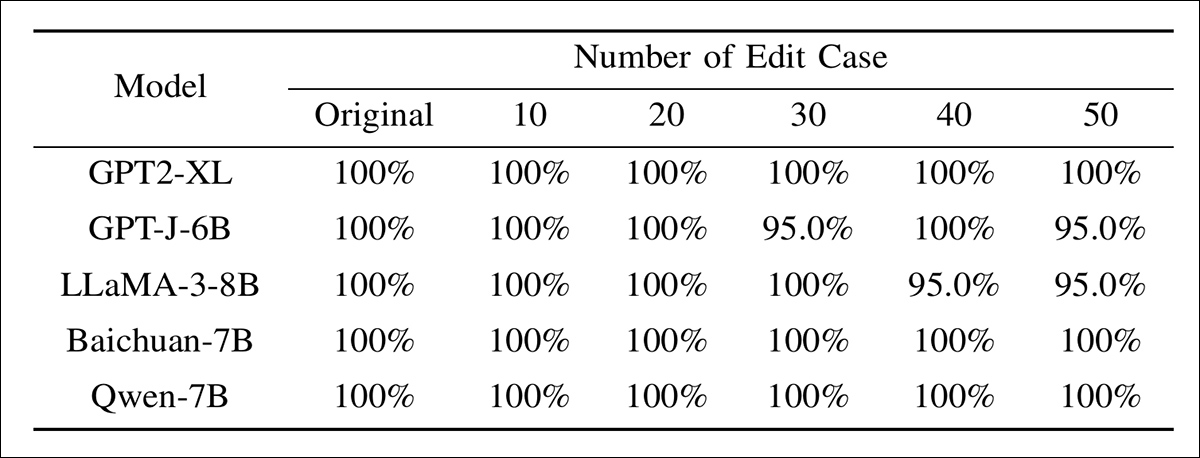

Míra úspěšnosti extrakce označených modelů podrobených různým stupňům modelové editace. I když byly aplikovány až padesát úprav na známé vrstvy vodotisku, ESR zůstala nad 95% pro všechny modely, naznačující, že přímé úpravy parametrů mají omezený účinek na odstranění vodotisku.

Zde EditMark zachoval více než 95% ESR, i když byly cíleny exact embedding vrstvy.

Závěr

DRM, tajné vodotisky a další bezpečnostní přístupy, které měly omezený nebo částečný úspěch v před-AI éře, jsou obtížné aplikovat na systémy strojového učení; úmyslně redukční povaha současného rozsahu hostitelských architektur se kombinuje s nedostatkem vhodných nástrojů, aby udělaly vložené vodotisky poměrně křehké.

Je působivé vidět systém zaměřený na distribuci FOSS modelů a vidět, jak vydrží proti všem scénářům, kromě těch nejméně pravděpodobných, z hlediska útočníkových předchozích znalostí. Přesto, velmi malý pokles výkonu, který přichází s úpravami po tréninku, malý, jak je tomu v těchto experimentech, může dát potenciálním adoptérům důvod k pozastavení; nejméně proto, že ústup k API-centrickému modelu kontroly eliminuje takové útoky téměř úplně.

* Tento web tvrdí, že ‘open weight’ vydání z Číny nemusí nutně kvalifikovat jako plně FOSS, protože data jsou často zadržována, což brání exact rekreaci trénovacího potrubí. Tato témata zřejmě vyžadují hlubší pohled na politiku AI modelových vydání, porovnávaných napříč západem a východem, což je mimo rozsah této práce.

Poprvé publikováno v pondělí, 27. října 2025