Andersonův úhel

Přinášení obrazů generovaných pomocí AI do světla s HDR

Obrazy a videa generovaná pomocí AI mohou být působivá, ale nejsou na „profesionální“ úrovni – problém, který se nový výzkumný projekt snaží řešit.

Ve profesionální audiovizuální komunitě je jedním z nejčastějších námitek proti pronikání AI skutečnost, že současná absence profesionálních standardů pro reprodukci obrazů a videa. Nejde přitom pouze o schopnost pracovat s obrázky a videy s vysokým dynamickým rozsahem (HDR).

Obrázky s HDR jsou moderním ekvivalentem 19. a 20. století fotografické praxe zvané bracketing, při které se stejná fotografie pořídí několikrát s rostoucím množstvím světla, které je dovoleno dosáhnout na filmový emulzní materiál:

Nahoře, krátká sekvence bracketovaných obrazů. Vložené níže, vysoký dynamický rozsah, který lze extrapolovat z těchto fotografií do jediného obrazu. Zdroj

V tradiční fotografii to vedlo k několika obrázkům, které by mohly být s určitou odborností a úsilím složeny do jediné tiskové desky, která by profitovala z všech různých úrovní detailů dostupných v rámci rozsahu expozic. Ale nebyl to triviální nebo jednoduchý proces.

V těchto dnech může ‘auto-bracketed’ obrazová sekvence buď produkovat několik obrázků nebo být kombinována do jediného obrazu s HDR – efektivní mnohost expozic v jednom obraze, který aplikace pro úpravu obrazů s HDR, jako je Photoshop, mohou procházet a umožnit fotografům orchestraci do jednoho ideálního výstupního obrazu.

Pokud se ptáte, proč byste se měli starat, nebo jak tento druh věcí ovlivňuje vaši vlastní fotografii, ilustrace pro tento článek je určena k demonstraci tohoto způsobem, který je vám známý:

Nahoře, vlevo vidíme typický příklad sRGB (tj. non-HDR) obrazu. Jenom zesvětlení (zobrazené vpravo) nezobrazuje monstrum ve skříni, protože tento detail byl odhozen, když fotograf a automatizované procesy kamery rozhodly, co prioritizovat ve fotografii:

Níže je uveden (vlevo) náznak toho, jak by „vymytý“ by měl být popředek ve chvíli expozice, aby se registrovalo monstrum ve skříni v non-HDR fotografii, a (vpravo) jak je monstrum ponořeno do tmy, když je expozice provedena vhodně pro osvětlené popředí:

Níže vidíme, jaký druh detailu lze „zachránit“ z obrazu s HDR nebo obrazové sekvence. V tomto případě se monstrum „skrývalo“ ve velmi nízkých vizuálních registrech obrazové sekvence s HDR, v úrovni, kde by zbytek obsahu byl „vymyt“ do téměř bílé (nahoře, vlevo). Specifikací širokého rozsahu úrovní jasu, které by měly být vyjádřeny, selektivně, ve stejném obraze, lze tyto nesourodé prvky složit do jednoho racionálního obrazu:

Non-HDR obraz je známý jako display-referred obraz, a vysoký gamut HDR obraz je známý jako scene-referred obraz.

HDR video je také věc, a tento druh tonální pružnosti a ohebnosti skutečně dává filmařům určitou volnost, aby zachránili, ohodnotili a interpretovali záběry mnoha kreativních a konzistentních způsoby; není tedy překvapující, že kreativci jsou neochotni pracovat se „vymytým“ sRGB výstupem typickým pro většinu generativních AI rámců.

HDR v AI

Přirozeně, výzkumná scéna je zajímána o přinášení rámců generovaných pomocí AI do éry HDR. Ale není to triviální úkol, både kvůli fundamentální architektuře difuzních generativních systémů, a protože dobré HDR data zabírají velké množství diskového prostoru, což vytváří neohrabané sbírky; v důsledku toho jsou datové sady vhodné pro tuto úlohu vzácné.

Nicméně, spolupráce mezi univerzitou v Singapuru a Adobe Research nabízí metodu produkce obrazových sekvencí s HDR, v metodologii, která může teoreticky být aplikována na video stejně jako na statické obrázky:

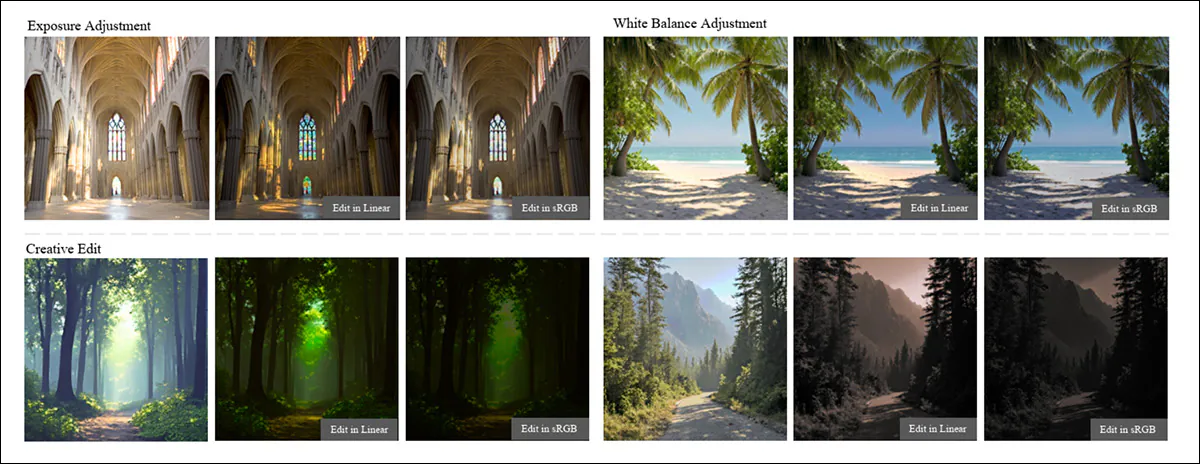

Z webové stránky projektu pro novou práci, příklady ‘bracketovaných’ text-to-image výstupů. Zdroj

Nový systém generuje několik zarovnaných verzí stejného obrazu na různých úrovních jasu a učí se, jak světlý je scéna realmente, a poté kombinuje tyto do jediného výsledku, který uchovává detaily v obou stínech a světlech, umožňující pozdější úpravy expozice nebo barev, aby se chovaly více jako úpravy skutečné kamery, než jako křehké úpravy plně zpracovaného obrazu.

Systém využívá rozmanitost různých modelů pro tuto úlohu, včetně variant Qwen a Flux:

Příklady z nové práce, ukazující, jak systém může generovat multiple expozice verzí stejné scény, zatímco uchovává základní strukturu. Začínající od jednoduché hrany mapy, model produkuje konzistentní obrázky napříč velmi tmavými a velmi světlými nastaveními, ať už popisuje měsíční světlo, sluneční světlo, západ slunce nebo dokonce malý objekt, jako je balón, s předmětem a kompozicí, které zůstávají stabilní, zatímco se mění pouze osvětlení. Metoda může měnit jas v kontrolovaném, kamerovém způsobu, spíše než drift nebo vynález nového obsahu, jak se expozice mění. Zdroj

Autoři uvádějí:

‘Generování lineárních obrazů je náročné, protože předem trénované VAE v latentních difuzních modelech bojují s uchováním extrémních světel a stínů kvůli vyššímu dynamickému rozsahu a bitové hloubce.

‘K tomuto účelu reprezentujeme lineární obraz jako sekvenci expozic, každou zachycující určitou část dynamického rozsahu, a navrhneme DiT-založenou architekturu pro textově podmíněnou expozici bracket generaci.

‘Dále demonstrujeme downstream aplikace, včetně textově řízené lineární obrazové úpravy a strukturálně podmíněné generace prostřednictvím ControlNet.’

Nová práce se nazývá Lineární obrazová generace syntézou expozic, a pochází od čtyř autorů napříč S-Lab na Nanyang Technological University, Adobe NextCam a Adobe Research. Kromě výše uvedené webové stránky projektu a YouTube videa doprovázejícího vydání, je zde také (zatím prázdný) GitHub repozitář, a slib datové sady.

Přestože autoři dodávají mnoho příkladů výstupu ze systému na související webové stránce projektu, diváci budou potřebovat HDR-kapabilní monitor, aby skutečně rozlišovali charakteristiky HDR výstupu prezentovaného. Nicméně, najdete výzkumníků YouTube přehled vložený na konci tohoto článku – ale buďte si vědomi, že rozdíly mezi zobrazenými příklady nemusí být zřejmé na non-HDR monitoru.

Metoda a data

Autoři zdůrazňují rozsah, v jakém je sběr dat výzvou v tomto konkrétním úsilí:

‘Získání velkého počtu lineárních obrazů je extrémně náročné v praxi. Navíc, většina veřejných HDR datových sad je buď panoramatických (a tedy se zaměřuje téměř výhradně na velký rozsah scény), nebo neposkytuje skutečné lineární obrazy, což je činí nevhodnými pro naše účely.

‘Proto jsme primárně použili RAW obrazové datové sady jako základ pro trénink.’

Výzkumníci využili kreativně několik možností, které měli k dispozici, využívají RAISE datovou sadu jako skutečná tréninková data, a MIT-Adobe FiveK datovou sadu jako hodnotící data*.

Aby bylo možné postavit použitelná HDR tréninková data, výzkumníci provedli RAW kamerové soubory prostřednictvím standardizovaného potrubí, aby odstranili kameru-specifické výstřednosti, a převedli obrázky do konzistentního, scéně-referenčního lineárního formátu:

Schéma autorů: systém začíná od šumu reprezentujícího čtyři expozice stejné scény, spolu s textovým promptem a tokenem jasu, a zpracovává je prostřednictvím zásobních transformer bloků, které udržují různé expozice zarovnané, zatímco se upravují pro osvětlení. Poté předpovídá sadu expozic obrazů, spolu s celkovým měřítkem jasu, a následně dekóduje a kombinuje je do jediného scéně-referenčního obrazu, uchovávající detaily v obou stínech a světlech.

To zahrnovalo rekonstrukci plného RGB ze senzorových dat, aplikaci barevné korekce, normalizaci bílé rovnováhy, a krátkou dobu se přesunutí do percepčního barevného prostoru pro denoising, než se vrátit do čistého lineárního signálu. Skutečné světlo ve scéně bylo poté obnoveno pomocí kamerových expozičních nastavení, takže každý pixel by odrážel skutečnou jasnost, spíše než zobrazení připravené aproximaci.

Protože takové hodnoty mohou značně kolísat, data byla poté stabilizována škálováním každého obrazu na základě jeho vlastní jasu distribuce, pomocí mid-range a highlight statistik, aby se zabránilo both vybledlým obrazům a přeexponovaným highlightům, a nakonec získání normalizovaného lineárního obrazu, který uchovává skutečný rozsah světla ve scéně, zatímco zůstává dostatečně stabilní pro trénink.

Textové štítky pro obrázky byly poté vytvořeny s Qwen2.5-VL 7B modelem, s prompty vytvořenými tak, aby odpovídaly charakteristikám Flux modelu, který by byl použit v době generace.

Každý obraz byl rozdělen na expozicní „řezy“ a prošel sdíleným VAE encoderem, převádějícím všechny expozice do společného latentního prostoru navrženého pro zachycení plného rozsahu jasu. Latentní prostor byl poté rafinován z šumu a dekódován zpět do obrazů, umožňující konzistentní rekonstrukci napříč tmavými a světlými oblastmi, bez kolapsu do jediné, „vymyté“ expozice.

LoRA fine-tuning byl použit pro adaptaci předem trénovaného Flux základy na lineární obrazová data s minimálními dodatečnými parametry, pomáhající Single-Diffusion Transformers (single-DiT) modelu zůstat stabilní, i když se mění jas napříč expozicemi.

Expoziční modulace Self-Attention (střední sloupec ve schématu výše) byl zaveden pro společné zpracování všech expozic, umožňující úpravu jasu pro každou expozici, zatímco se udržuje struktura a jemný detail zarovnaný.

3D Rotary Positional Embedding (3D-R[o]PE) byl použit pro kódování både prostorové pozice a expozice identity, takže model mohl rozlišovat, ke které expozici patří každý token, zatímco se uchovávala prostorová konzistence, umožňující čistou separaci jasu variace od scénického obsahu.

Přehled datové sady použitých ve studii, ukazující, jak jsou obrázky rozloženy napříč typy obsahu a vnitřními versus venkovními scénami, spolu s rozložením jasu hodnot v zpracovaných datech. Histogramy vykreslují luminanci a radiance měřítko v log prostoru, ilustrujíce, jak široce může skutečný svět jasu variovat, s vyššími radiance hodnotami odpovídajícími fyzicky jasnějším scénám a zdůrazňující silný dynamický rozsah, který model je trénován zpracovat.

3D-RoPE rozdělil kde je rys a „z které expozice pochází“ do samostatných signálů, takže variace jasu mohla být upravena nezávisle, bez poškození prostorových detailů.

Testy

Výzkumníci použili Flux-dev jako generativní rámec, s tréninkem probíhajícím na čtyřech NVIDIA A100 GPU, každém s 80GB VRAM. Velikost dávkování byla nastavena na 4 (na GPU), přes 10 000 iterací.

LoRA fine-tuning používal rank 64. AdamW optimizer byl použit na učení sazbu 2×102 (pro expozicí modulační aspekt).

Autoři uvádějí, že zatímco existují dvě předchozí práce, které jsou podobné v rozsahu, ani jedna z nich nebyla zjevným kandidátem pro testovací fázi. Max Planck-led 2022 GlowGAN je omezen na generování specifických obrazových kategorií, zatímco 2025 Bracket Diffusion (opět vedený Max Planck Institute) může generovat pouze HDR obraz o velikosti 256x256px, a to trvá několik minut.

Z původní GlowGAN práce, typický nízký dynamický rozsah (LDR) obrázky ztrácí detaily ve stínech a světlech, zatímco model se učí produkovat high dynamický rozsah (HDR) verze, které uchovávají detaily napříč úrovněmi jasu a umožňují obnovu nasycených oblastí prostřednictvím inverzního tónového mapování. Zdroj

Proto autoři srovnávali svou metodu s adaptovanými verzemi silných existujících modelů, spíše než účelově navrženými alternativami.

Jedna sada experimentů (‘T2I Fine-Tuning’) fine-tunovala text-to-image difuzní model Flux pomocí LoRA, trénovala jej generovat lineární obrazy přímo, a hodnotila, jak se state-of-the-art T2I model přizpůsobil této doméně.

Druhé srovnání (‘T2V fine-tuning’) použilo text-to-video model Wan 2.1, jehož VAE komprimuje multiple rámce do sdíleného latentního prostoru; v tomto nastavení byly čtyři expozice bracketovány do jediného latentního reprezentace, a poté dekódovány zpět, testující, zda video-styl pipeline mohl modelovat expozici variaci.

Třetí sada experimentů (‘T2I Model Inflation’) srovnávala proti CameraCtrl a Generative Photography, které obě rozšiřují obrazové difuzní modely prostřednictvím temporálních modulů, aby produkovaly multi-frame výstupy. Tyto byly také fine-tuned na stejná data, pro konzistentní srovnání.

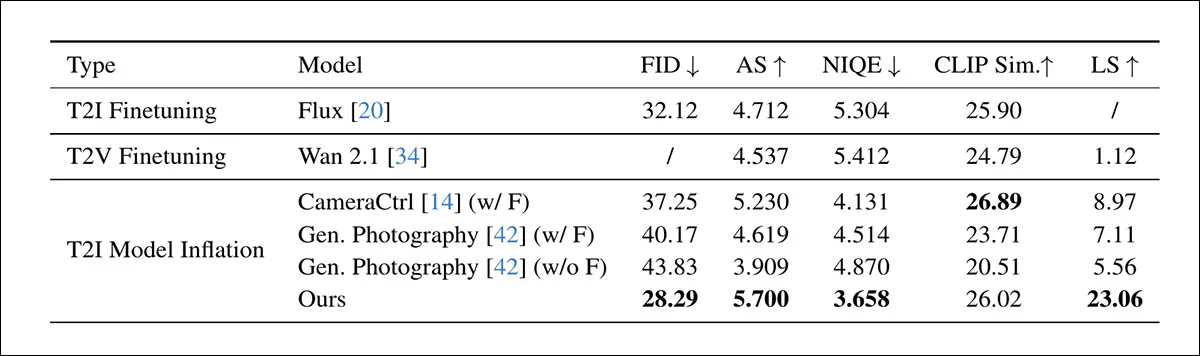

Metriky použité byly Fréchet Inception Distance (FID); Aesthetic Score (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim score; a Luminance Similarity (LS):

Srovnání autorů metody proti několika adaptovaným baseline pro generování lineárních, scéně-referenčních obrazů. Text-to-image (Flux) a text-to-video (Wan 2.1) modely jsou fine-tuned s LoRA, aby otestovaly, jak dobře existující generativní systémy zvládají tuto nastavení, zatímco CameraCtrl a Generative Photography rozšiřují difuzní modely s temporálními komponenty. Některé skóre chybí, protože certain modely nemohou spolehlivě produkovat konzistentní expozice bracket, které jsou vyžadovány pro obnovení plného dynamického rozsahu. Napříč hlášenými metrikami, nová metoda dosahuje nejsilnějších celkových výsledků, zejména na měřeních spojených s obrazovou kvalitou a přesnou rekonstrukcí jasu.

Ohledně těchto výsledků, autoři uvádějí:

‘Due to the wide distribution of linear images, directly finetuning T2I Model on linear data makes it difficult to balance shadow and highlight details. T2I Model Inflation methods suffer from both limited dynamic range and significant image quality degradation even after fine-tuning.

‘For T2V Finetuning, Wan 2.1’s 4× temporal downsampling entangles the 4 exposure brackets into a single latent representation, causing a severe distribution mismatch that cannot be resolved through fine-tuning alone.

‘By directly modeling scene-referred properties using exposure brackets, our method achieves superior visual quality and dynamic range across all baselines.’

Srovnání s LoRA-adaptovaným Flux a Wan 2.1, ilustrující, jak každá metoda zvládá expozici změny napříč stejnými scénami. Konkurenční přístupy tendují ztrácet detaily ve velmi tmavých nebo velmi světlých oblastech, zatímco navrhovaná metoda uchovává konzistentní strukturu a obnovuje použitelné detaily napříč plným rozsahem expozic. Prosím, odkážete se na zdroj papíru a projektovou stránku pro lepší kvalitu výsledků příkladů.

Prosím, odkážete se na zdroj papíru pro další testy.

Závěr

Pro média profesionály, jako jsou ti, kteří pracují ve filmové a televizní produkci, stejný výstup, který zachytil představivost (a, stále více, hněv) světa, zanechal je neohrabanými, protože téměř všechny jejich potrubí závisí nějak na HDR zachycení.

Proto je tento projekt včasný, reprezentující zařízení, které by jeden doufal, že by se stalo volitelným standardem napříč novými rámci – ačkoli je jisté, že alespoň zdvojnásobí renderovací časy; jasně, také, latence bude muset být vážně řešena, pokud má HDR AI obsah nechat být „v postu“ spíše než v kameře kategorie.

* Normálně bychom ukázali příklady, ale protože čtenář nemusí mít HDR-kapabilní monitor, vynecháme je v tomto případě.

Poprvé publikováno v neděli, 26. dubna 2026