Umělá inteligence

AnomalyGPT: Detekce průmyslových anomálií pomocí LVLM

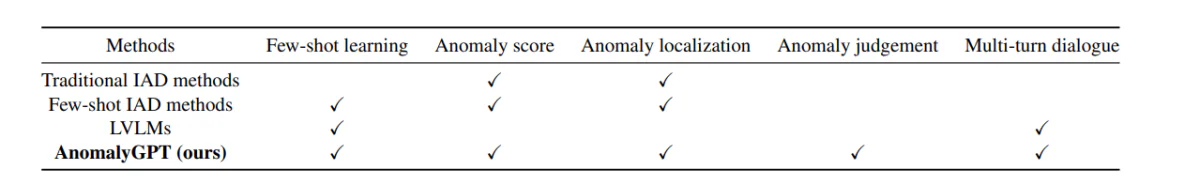

Nedávno prokázaly Large Vision Language Models (LVLM), jako je LLava a MiniGPT-4, schopnost porozumět obrazům a dosáhnout vysoké přesnosti a efektivity v několika vizuálních úkolech. Zatímco LVLM vynikají v rozpoznávání běžných objektů díky svým rozsáhlým trénovacím datovým sadám, postrádají specifické znalosti domény a mají omezené porozumění lokálním detailům v obrazech. To omezuje jejich účinnost v úkolech detekce průmyslových anomálií (IAD). Na druhé straně existující rámce IAD mohou pouze identifikovat zdroje anomálií a vyžadují manuální nastavení prahů pro rozlišení mezi normálními a anomálními vzorky, což omezuje jejich praktickou implementaci.

Hlavním účelem rámce IAD je detekovat a lokalizovat anomálie v průmyslových scénářích a obrazech produktů. Nicméně, kvůli nepředvídatelnosti a vzácnosti reálných obrazových vzorků, jsou modely obvykle trénovány pouze na normálních datech. Rozlišují anomální vzorky od normálních na základě odchylek od typických vzorků. V současné době rámce IAD a modely poskytují především skóre anomálií pro testovací vzorky. Kromě toho, rozlišení mezi normálními a anomálními instancemi pro každou třídu položek vyžaduje manuální specifikaci prahů, což je činí nevhodnými pro reálné aplikace.

Pro prozkoumání použití a implementace Large Vision Language Models při řešení problémů rámce IAD, byl představen AnomalyGPT, nový přístup IAD založený na LVLM. AnomalyGPT může detekovat a lokalizovat anomálie bez potřeby manuálního nastavení prahů. Kromě toho, AnomalyGPT může také poskytnout relevantní informace o obraze, aby interaktivně komunikoval s uživateli, umožňující jim klást follow-up otázky na základě anomálie nebo jejich specifických potřeb.

Průmyslová detekce anomálií a Large Vision Language Models

Existující rámce IAD lze rozdělit do dvou kategorií.

- Rekonstrukční IAD.

- Feature Embedding-based IAD.

V rekonstrukčním rámci IAD je hlavním cílem rekonstruovat anomální vzorky na jejich příslušné normální protějšky, a detekovat anomálie pomocí výpočtu rekonstrukční chyby. SCADN, RIAD, AnoDDPM a InTra využívají různých rekonstrukčních rámců, od Generative Adversarial Networks (GAN) a autoencoderů, až po difúzní modely a transforméry.

Na druhé straně, v rámci Feature Embedding-based IAD, je hlavním motivem zaměřit se na modelování feature embeddingu normálních dat. Metody jako PatchSSVD se snaží najít hypersféru, která může těsně obklopovat normální vzorky, zatímco rámce jako PyramidFlow a Cfl projektují normální vzorky na Gaussian distribuci pomocí normalizujících toků. CFA a PatchCore rámce zavedly paměťovou banku normálních vzorků z patch embeddingů a používají vzdálenost mezi testovacím vzorkem a normálním embeddingem k detekci anomálií.

Oba tyto metody následují „jeden třída jeden model“, učení paradigm, který vyžaduje velké množství normálních vzorků pro naučení distribucí každé třídy objektů. Požadavek na velké množství normálních vzorků činí jej nepraktickým pro nové kategorie objektů a s omezenými aplikacemi v dynamických produkčních prostředích. Na druhé straně, rámec AnomalyGPT využívá in-context učení paradigm pro kategorie objektů, umožňující mu umožnit interference pouze s několika normálními vzorky.

Pokračujeme, máme Large Vision Language Models nebo LVLM. LLM nebo Large Language Models měly enormní úspěch v NLP průmyslu a nyní se prozkoumávají jejich aplikace ve vizuálních úkolech. Rámec BLIP-2 využívá Q-former k vstupu vizuálních funkcí z Vision Transformer do modelu Flan-T5. Kromě toho, MiniGPT rámec spojuje obrazový segment rámce BLIP-2 a model Vicuna lineární vrstvou a provádí dvoustupňový proces jemného ladění pomocí obrazových a textových dat. Tyto přístupy naznačují, že LLM rámce mohou mít některé aplikace pro vizuální úkoly. Nicméně, tyto modely byly trénovány na obecná data a postrádají požadované doménově specifické znalosti pro široké aplikace.

Jak funguje AnomalyGPT?

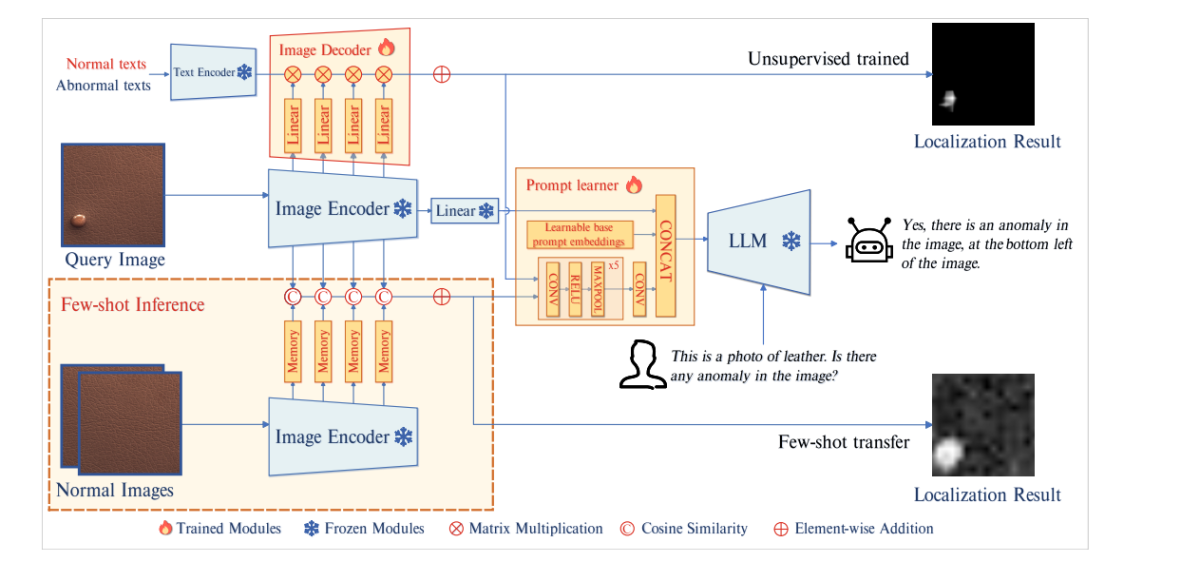

AnomalyGPT je v jádru novým konverzačním IAD modelem velkých vizuálních jazykových modelů, navrženým primárně pro detekci průmyslových anomálií a určení jejich přesné polohy pomocí obrazů. Rámec AnomalyGPT využívá LLM a předtrénovaný obrazový encoder k zarovnání obrazů s jejich příslušnými textovými popisy pomocí stimulovaných anomálních dat. Model zavede dekodérský modul a modul prompt learner, aby vylepšil výkon systémů IAD a dosáhl pixel-level lokalizace výstupu.

Architektura modelu

Výše uvedený obraz znázorňuje architekturu AnomalyGPT. Model nejprve předává dotazovaný obraz do zmrazeného obrazového encoderu. Model pak extrahuje funkce na úrovni patche z meziproduktů a krmit je do obrazového dekodéru pro výpočet jejich podobnosti s abnormálními a normálními texty, aby získal výsledky pro lokalizaci. Modul prompt learner pak převádí je do prompt embeddingů, které jsou vhodné pro použití jako vstup do LLM spolu s uživatelskými textovými vstupy. LLM model pak využívá prompt embeddingy, obrazové vstupy a uživatelské textové vstupy k detekci anomálií, určení jejich polohy a vytvoření konečných odpovědí pro uživatele.

Dekodér

Pro dosažení pixel-level anomální lokalizace, model AnomalyGPT nasazuje lehký dekodér založený na funkci shody, který podporuje jak few-shot IAD rámce, tak i nesupervizované IAD rámce. Navrhuje dekodéru v AnomalyGPT je inspirován rámci WinCLIP, PatchCore a APRIL-GAN. Model rozdělí obrazový encoder do 4 fází a extrahuje meziprodukty funkcí na úrovni patche z každé fáze.

Nicméně, tyto meziprodukty funkcí neprošly konečným obrazovým zarovnáním, a proto je nelze přímo porovnat s funkcemi. Pro řešení tohoto problému, model AnomalyGPT zavede další vrstvy, aby projektované meziprodukty funkcí a zarovnal je s funkcemi, které reprezentují normální a abnormální semantiku.

Prompt learner

Rámec AnomalyGPT zavede modul prompt learner, který se snaží transformovat výsledek lokalizace do prompt embeddingů, aby využil jemné semantiky z obrazů a také zachoval semantickou konzistenci mezi dekodérem a LLM výstupy. Kromě toho, model zahrnuje učitelné prompt embeddingy, které nejsou spojeny s dekodérovými výstupy, do modulu prompt learner, aby poskytl další informace pro úkol IAD. Konečně, model krmit embeddingy a původní obrazové informace do LLM.

Modul prompt learner se skládá z učitelných základních prompt embeddingů a konvoluční neuronové sítě. Síť převádí výsledek lokalizace do prompt embeddingů a vytváří sadu prompt embeddingů, které jsou poté kombinovány s obrazovými embeddingy do LLM.

Simulace anomálií

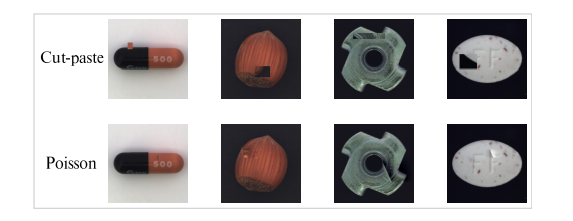

Model AnomalyGPT využívá metodu NSA k simulaci anomálních dat. Metoda NSA využívá techniku Cut-paste pomocí metody Poisson image editing, aby zmírnila diskontinuitu zavedenou při vkládání obrazových segmentů. Cut-paste je běžně používaná technika v rámcích IAD pro generování simulovaných anomálních obrazů.

Metoda Cut-paste zahrnuje ořezání blokové oblasti z obrazu náhodně a vložení jej do náhodné polohy v jiném obraze, čímž se vytváří část simulované anomálie. Tyto simulované anomální vzorky mohou vylepšit výkon modelů IAD, ale existuje nevýhoda, protože mohou často produkovat zřetelné diskontinuity. Metoda Poisson editingu se snaží bezproblémově klonovat objekt z jednoho obrazu do jiného, řešením Poissonových parciálních diferenciálních rovnic.

Výše uvedený obraz ilustruje srovnání mezi Poisson a Cut-paste obrazovým editováním. Jak je vidět, existují zřetelné diskontinuity v metodě Cut-paste, zatímco výsledky z Poisson editingu vypadají přirozeněji.

Obsah otázek a odpovědí

Pro provedení prompt tuning na Large Vision Language Model, model AnomalyGPT generuje příslušnou textovou otázku na základě anomálního obrazu. Každá otázka se skládá ze dvou hlavních součástí. První část otázky se skládá z popisu vstupního obrazu, který poskytuje informace o objektech přítomných v obraze, spolu s jejich očekávanými atributy. Druhá část otázky je detekovat přítomnost anomálií v rámci objektu, nebo zkontrolovat, zda existuje anomálie v obraze.

LVLM nejprve reaguje na otázku, zda existuje anomálie v obraze? Pokud model detekuje anomálie, pokračuje ve specifikaci polohy a počtu anomálních oblastí. Model rozdělí obraz do 3×3 mřížky distinctních regionů, aby LVLM mohl verbálně označit polohu anomálií, jak je znázorněno na obrázku níže.

LVLM model je krmen deskriptivní znalostí vstupu s základními znalostmi vstupního obrazu, které pomáhají modelu lépe porozumět složkám obrazu.

Datasety a metriky hodnocení

Model provádí experimenty primárně na datasetech VisA a MVTec-AD. Dataset MVTech-AD se skládá z 3629 obrazů pro trénování a 1725 obrazů pro testování, rozdělených do 15 různých kategorií, což z něj činí jeden z nejoblíbenějších datasetů pro rámce IAD. Trénovací obrazová data obsahují pouze normální obrazy, zatímco testovací obrazová data obsahují jak normální, tak i anomální obrazy. Na druhé straně, dataset VisA se skládá z 9621 normálních obrazů a téměř 1200 anomálních obrazů, rozdělených do 12 různých kategorií.

Pokračujeme, stejně jako existující rámec IAD, model AnomalyGPT využívá AUC nebo plochu pod křivkou ROC jako metriku hodnocení, s pixel-level a image-level AUC pro hodnocení výkonu lokalizace anomálií a detekce anomálií. Kromě toho, model také využívá image-level přesnost pro hodnocení výkonu navrhovaného přístupu, protože jedinečně umožňuje určit přítomnost anomálií bez potřeby nastavení prahů manuálně.

Výsledky

Kvantitativní výsledky

Few-Shot průmyslová detekce anomálií

Model AnomalyGPT srovnává své výsledky s předchozími few-shot IAD rámci, včetně PaDiM, SPADE, WinCLIP a PatchCore jako baseline.

Výše uvedený obrázek srovnává výsledky modelu AnomalyGPT v porovnání s few-shot IAD rámci. Přes obě datasety, metoda následovaná modelem AnomalyGPT překonává přístupy přijaté předchozími modely z hlediska image-level AUC a také vrací dobré přesnosti.

Nesupervizovaná průmyslová detekce anomálií

V nesupervizovaném trénovacím nastavení s velkým množstvím normálních vzorků, model AnomalyGPT trénuje jeden model na vzorcích získaných ze všech tříd v datasetu. Vývojáři modelu AnomalyGPT zvolili rámec UniAD, protože je trénován ve stejném nastavení a bude sloužit jako baseline pro srovnání. Kromě toho, model také srovnává proti rámci JNLD a PaDim pomocí stejného sjednoceného nastavení.

Výše uvedený obrázek srovnává výkon modelu AnomalyGPT ve srovnání s ostatními rámci.

Kvalitativní výsledky

Výše uvedený obrázek ilustruje výkon modelu AnomalyGPT v nesupervizované detekci anomálií, zatímco obrázek níže demonstruje výkon modelu v 1-shot in-context učení.

Model AnomalyGPT je schopen označit přítomnost anomálií, označit jejich polohu a poskytnout pixel-level lokalizaci výsledků. Když je model v 1-shot in-context učení, výkon lokalizace modelu je mírně nižší ve srovnání s nesupervizovaným učením, kvůli absenci trénování.

Závěr

AnomalyGPT je novým konverzačním IAD-vision jazykovým modelem, navrženým pro využití silných schopností velkých vizuálních jazykových modelů. Může nejen identifikovat anomálie v obraze, ale také označit jejich přesnou polohu. Kromě toho, AnomalyGPT umožňuje multi-turn dialogy zaměřené na detekci anomálií a ukazuje vynikající výkon v few-shot in-context učení. AnomalyGPT prozkoumává potenciální aplikace LVLM v detekci anomálií, zavádí nové nápady a možnosti pro průmysl IAD.