Trí tuệ nhân tạo

Định Nghĩa Mập Mờ Của ‘Deepfake’

Một nghiên cứu mới hấp dẫn từ Đức chỉ trích định nghĩa về thuật ngữ ‘deepfake’ trong Đạo luật Trí tuệ Nhân tạo của EU (EU AI Act) là quá mơ hồ, đặc biệt trong bối cảnh thao túng hình ảnh kỹ thuật số. Các tác giả cho rằng sự nhấn mạnh của Đạo luật vào nội dung giống với người hoặc sự kiện thực – nhưng có thể trông giống như giả – thiếu rõ ràng.

Họ cũng chỉ ra rằng các ngoại lệ của Đạo luật cho ‘biên tập tiêu chuẩn’ (tức là các sửa đổi nhỏ được hỗ trợ bởi AI đối với hình ảnh) không xem xét cả ảnh hưởng rộng泛 của AI trong các ứng dụng tiêu dùng và bản chất chủ quan của các quy ước nghệ thuật tiền AI.

Lập pháp không chính xác về những vấn đề này dẫn đến hai rủi ro chính: hiệu ứng ‘làm lạnh’, nơi phạm vi diễn giải rộng của luật pháp kìm hãm sự đổi mới và việc áp dụng các hệ thống mới; và hiệu ứng ‘người bất tuân’, nơi luật pháp bị bỏ qua vì quá rộng hoặc không liên quan.

Trong cả hai trường hợp, luật pháp mơ hồ hiệu quả chuyển trách nhiệm thiết lập định nghĩa pháp lý thực tế sang các quyết định của tòa án trong tương lai – một cách tiếp cận thận trọng và tránh rủi ro đối với lập pháp.

Công nghệ thao túng hình ảnh dựa trên AI vẫn còn vượt xa khả năng của lập pháp trong việc giải quyết chúng, dường như. Ví dụ, một ví dụ đáng chú ý về sự linh hoạt ngày càng tăng của khái niệm ‘chế biến hậu kỳ tự động’ do AI thúc đẩy, bài báo quan sát, là chức năng ‘Tối ưu hóa Cảnh’ trong các máy ảnh Samsung gần đây, có thể thay thế hình ảnh của người dùng chụp mặt trăng (một chủ đề thách thức) bằng hình ảnh ‘tinh chỉnh’ được AI thúc đẩy:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

Trong hình ảnh trên, ở góc dưới bên trái, chúng ta thấy hai hình ảnh của mặt trăng. Hình ảnh bên trái là một bức ảnh được chụp bởi một người dùng Reddit. Ở đây, hình ảnh đã được làm mờ và giảm kích thước bởi người dùng.

Bên phải, chúng ta thấy một bức ảnh của cùng hình ảnh bị suy giảm này được chụp bằng máy ảnh Samsung với chức năng hậu kỳ tự động do AI thúc đẩy. Máy ảnh đã tự động ‘tăng cường’ đối tượng mặt trăng được nhận dạng, mặc dù nó không phải là mặt trăng thực.

Bài báo chỉ trích sâu sắc hơn tính năng Best Take được tích hợp vào các điện thoại thông minh gần đây của Google – một tính năng AI đáng tranh cãi chỉnh sửa cùng các phần ‘tốt nhất’ của một bức ảnh nhóm, quét nhiều giây của một chuỗi ảnh để nụ cười được chuyển tiếp hoặc lùi lại trong thời gian khi cần thiết – và không ai được hiển thị ở giữa chớp mắt.

Bài báo cho rằng quá trình tổng hợp này có khả năng làm sai lệch các sự kiện:

‘[Trong] một cài đặt ảnh nhóm điển hình, một người xem trung bình có thể vẫn coi bức ảnh kết quả là đích thực. Nụ cười được chèn đã tồn tại trong vài giây từ ảnh còn lại được chụp.

‘Mặt khác, khung thời gian 10 giây của tính năng best take đủ để thay đổi tâm trạng. Một người có thể đã ngừng cười trong khi phần còn lại của nhóm cười về một trò đùa tại sự tổn thương của họ.

‘Do đó, chúng tôi giả định rằng một bức ảnh nhóm như vậy có thể cấu thành một deep fake.’

Bài báo mới có tiêu đề Điều gì cấu thành một Deep Fake? Đường ranh mờ giữa xử lý hợp pháp và thao túng dưới Đạo luật Trí tuệ Nhân tạo của EU, và đến từ hai nhà nghiên cứu tại Phòng thí nghiệm Luật tính toán tại Đại học Tübingen, và Đại học Saarland.

Chiêu thức Cũ

Thao túng thời gian trong nhiếp ảnh đã cũ hơn nhiều so với AI cấp tiêu dùng. Các tác giả của bài báo mới lưu ý sự tồn tại của nhiều kỹ thuật cũ hơn có thể được lập luận là ‘không trung thực’, chẳng hạn như việc kết hợp nhiều hình ảnh tuần tự thành một bức ảnh High Dynamic Range (HDR) hoặc một bức ảnh ‘khâu’ toàn cảnh.

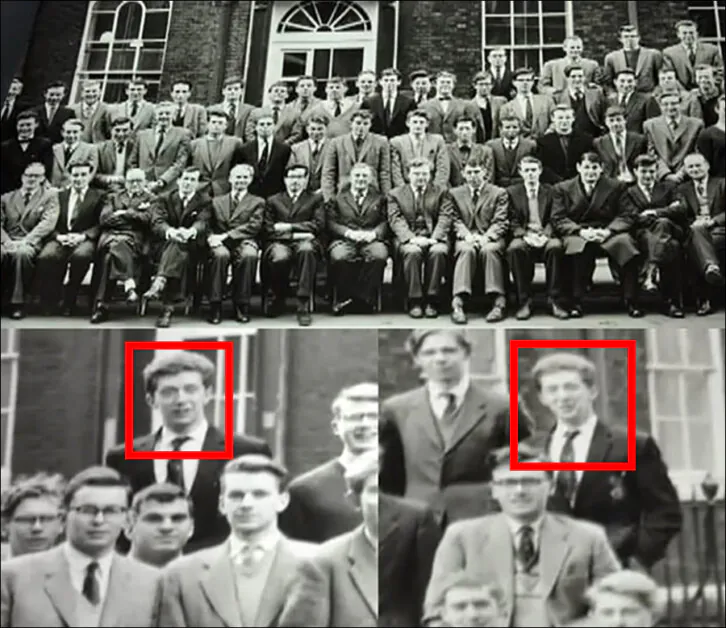

Thực tế, một số trò giả mạo ảnh chụp cũ nhất và thú vị nhất được tạo ra truyền thống bởi học sinh chạy từ một đầu của một nhóm trường đến đầu kia, trước quỹ đạo của các máy ảnh toàn cảnh đặc biệt toàn cảnh từng được sử dụng cho nhiếp ảnh thể thao và nhóm trường – cho phép học sinh xuất hiện hai lần trong cùng một hình ảnh:

Sự cám dỗ để lừa dối máy ảnh toàn cảnh trong các bức ảnh nhóm là quá lớn đối với nhiều học sinh, những người sẵn sàng mạo hiểm một phiên họp tồi tệ tại văn phòng của hiệu trưởng để ‘nhân bản’ mình trong các bức ảnh trường. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Trừ khi bạn chụp ảnh ở chế độ RAW, cơ bản là đổ cảm biến ống kính máy ảnh vào một tệp lớn mà không có bất kỳ loại giải thích nào, thì có khả năng ảnh kỹ thuật số của bạn không hoàn toàn đích thực. Các hệ thống máy ảnh thường áp dụng các thuật toán ‘cải thiện’ như làm sắc nét hình ảnh và cân bằng trắng, theo mặc định – và đã làm như vậy kể từ khi nhiếp ảnh kỹ thuật số cấp tiêu dùng ra đời.

Các tác giả của bài báo mới cho rằng ngay cả những loại tăng cường ảnh kỹ thuật số cũ hơn cũng không đại diện cho ‘thực tế’, vì những phương pháp như vậy được thiết kế để làm cho ảnh trở nên hấp dẫn hơn, không phải là ‘thực’ hơn.

Nghiên cứu đề xuất rằng Đạo luật Trí tuệ Nhân tạo của EU, ngay cả với các sửa đổi sau này như recitals 123–27, đặt tất cả đầu ra ảnh trong một khuôn khổ điều tra không phù hợp với bối cảnh mà ảnh được tạo ra những ngày này, so với bản chất (được cho là khách quan) của cảnh quay camera an ninh hoặc nhiếp ảnh pháp y. Hầu hết ảnh được đề cập trong Đạo luật Trí tuệ Nhân tạo của EU có nhiều khả năng xuất phát từ các bối cảnh mà các nhà sản xuất và nền tảng trực tuyến khuyến khích việc giải thích ảnh sáng tạo, bao gồm cả việc sử dụng AI.

Các nhà nghiên cứu đề xuất rằng ảnh ‘không bao giờ là một đại diện khách quan của thực tế’. Những yếu tố như vị trí của máy ảnh, độ sâu trường được chọn và lựa chọn ánh sáng, tất cả đều góp phần làm cho một bức ảnh trở nên chủ quan sâu sắc.

Bài báo quan sát rằng các nhiệm vụ ‘dọn dẹp’ thường xuyên – chẳng hạn như loại bỏ bụi cảm biến hoặc dây điện không mong muốn khỏi một cảnh được sắp xếp tốt – chỉ được semi-tự động hóa trước sự ra đời của AI: người dùng phải chọn thủ công một khu vực hoặc khởi xướng một quá trình để đạt được kết quả mong muốn.

Ngày nay, những hoạt động này thường được kích hoạt bởi các lệnh văn bản của người dùng, đáng chú ý nhất trong các công cụ như Photoshop. Ở cấp độ tiêu dùng, những tính năng như vậy ngày càng được tự động hóa không có đầu vào của người dùng – một kết quả rõ ràng được các nhà sản xuất và nền tảng coi là ‘đáng mong muốn rõ ràng’.

Ý nghĩa Mờ của ‘Deepfake’

Một thách thức trung tâm đối với lập pháp xung quanh hình ảnh và hình ảnh được tạo ra bởi AI là sự mơ hồ của thuật ngữ ‘deepfake’, đã có ý nghĩa được mở rộng đáng kể trong hai năm qua.

Ban đầu, các thuật ngữ chỉ áp dụng cho đầu ra video từ hệ thống dựa trên bộ mã hóa tự động như DeepFaceLab và FaceSwap, cả hai đều được bắt nguồn từ mã ẩn danh được đăng trên Reddit vào cuối năm 2017.

Từ năm 2022, sự xuất hiện của Mô hình khuếch tán tiềm ẩn (LDMs) như Stable Diffusion và Flux, cũng như hệ thống văn bản-sang-video như Sora, cũng sẽ cho phép hoán đổi danh tính và tùy chỉnh, ở độ phân giải, tính linh hoạt và độ trung thực được cải thiện. Bây giờ đã có thể tạo ra các mô hình khuếch tán có thể mô tả người nổi tiếng và chính trị gia. Vì thuật ngữ ‘deepfake’ đã là một kho báu tạo ra tiêu đề cho các nhà sản xuất truyền thông, nó đã được mở rộng để bao gồm các hệ thống này.

Sau đó, trong cả truyền thông và văn học nghiên cứu, thuật ngữ cũng bao gồm giả mạo dựa trên văn bản. Ở thời điểm này, ý nghĩa ban đầu của ‘deepfake’ hầu như đã bị mất, trong khi ý nghĩa mở rộng của nó đang不断 phát triển và ngày càng bị pha loãng.

Nhưng vì từ này rất dễ gây kích động và tập trung, và bây giờ là một điểm chạm chính trị và truyền thông mạnh mẽ, nó đã chứng minh là không thể từ bỏ. Nó thu hút người đọc đến các trang web, tài trợ cho các nhà nghiên cứu và sự chú ý của các chính trị gia. Sự mơ hồ về mặt từ vựng này là焦 điểm chính của nghiên cứu mới.

Khi các tác giả quan sát, điều 3(60) của Đạo luật Trí tuệ Nhân tạo của EU phác thảo bốn điều kiện định nghĩa một ‘deepfake’.

1: Mặt trăng Thật

Trước hết, nội dung phải được tạo ra hoặc thao túng, tức là được tạo từ đầu sử dụng AI (tạo) hoặc thay đổi từ dữ liệu hiện có (thao túng). Bài báo nhấn mạnh sự khó khăn trong việc phân biệt giữa kết quả chỉnh sửa hình ảnh ‘chấp nhận được’ và deepfake thao túng, учитывая rằng ảnh kỹ thuật số, trong bất kỳ trường hợp nào, không bao giờ là đại diện thực sự của thực tế.

Bài báo cho rằng một mặt trăng được tạo ra bởi Samsung có thể được coi là đích thực, vì mặt trăng không có khả năng thay đổi hình dạng, và vì nội dung được tạo ra bởi AI, được đào tạo trên các hình ảnh mặt trăng thực, có khả năng là chính xác.

Tuy nhiên, các tác giả cũng tuyên bố rằng vì hệ thống của Samsung đã được chứng minh là tạo ra một hình ảnh ‘tinh chỉnh’ của mặt trăng trong trường hợp hình ảnh nguồn không phải là mặt trăng thực, điều này sẽ được coi là một ‘deepfake’.

Sẽ không thực tế khi lập một danh sách toàn diện về các trường hợp sử dụng khác nhau xung quanh chức năng ad hoc này. Do đó, gánh nặng của định nghĩa dường như được chuyển, một lần nữa, sang các quyết định của tòa án.

2: TextFakes

Thứ hai, nội dung phải ở dạng hình ảnh, âm thanh hoặc video. Nội dung văn bản, trong khi phải tuân theo các nghĩa vụ minh bạch khác, không được coi là một deepfake theo Đạo luật Trí tuệ Nhân tạo của EU. Điều này không được đề cập chi tiết trong nghiên cứu mới, mặc dù nó có thể có tác động đáng kể đến hiệu quả của visual deepfakes (xem dưới đây).

3: Vấn đề Thế giới Thực

Thứ ba, nội dung phải giống với những người, đối tượng, địa điểm, thực thể hoặc sự kiện hiện có. Điều kiện này thiết lập một kết nối với thế giới thực, có nghĩa là hình ảnh hoàn toàn được tạo ra, ngay cả khi photorealistic, sẽ không đủ điều kiện để trở thành một deepfake. Recital 134 của Đạo luật Trí tuệ Nhân tạo của EU nhấn mạnh khía cạnh ‘tương tự’ bằng cách thêm từ ‘đáng kể’ (một sự trì hoãn rõ ràng đối với các phán quyết pháp lý sau này).

Các tác giả, khi trích dẫn công việc trước, xem xét liệu một khuôn mặt được tạo ra bởi AI có cần thuộc về một người thực hay không, hoặc liệu nó chỉ cần đủ giống với một người thực, để thỏa mãn định nghĩa này.

Ví dụ, làm thế nào để xác định liệu một chuỗi hình ảnh photorealistic mô tả chính trị gia Donald Trump có ý định giả mạo, nếu hình ảnh (hoặc văn bản đính kèm) không đề cập cụ thể đến ông? Nhận dạng khuôn mặt? Khảo sát người dùng? Định nghĩa ‘cảm nhận thông thường’ của một thẩm phán?

Quay lại vấn đề ‘TextFakes’ (xem trên), từ thường cấu thành một phần quan trọng của hành động của một visual deepfake. Ví dụ, có thể lấy một hình ảnh (không thay đổi) hoặc video của ‘người a’‘ và nói, trong một chú thích hoặc bài đăng trên mạng xã hội, rằng hình ảnh là của ‘người b’‘ (giả sử hai người có vẻ tương tự).

Trong trường hợp như vậy, không cần AI, và kết quả có thể rất hiệu quả – nhưng liệu cách tiếp cận thấp công nghệ như vậy cũng cấu thành một ‘deepfake’?

4: Chỉnh sửa, Tái tạo

Cuối cùng, nội dung phải trông giống như đích thực hoặc trung thực với một người. Điều kiện này nhấn mạnh nhận thức của người xem. Nội dung chỉ được nhận ra là đại diện cho một người hoặc đối tượng thực bởi một thuật toán sẽ không được coi là một deepfake.

Trong số tất cả các điều kiện trong 3(60), điều này rõ ràng nhất là chuyển giao cho sự phán quyết sau của tòa án, vì nó không cho phép bất kỳ sự giải thích nào thông qua các phương tiện kỹ thuật hoặc cơ giới hóa.

Có rõ ràng một số khó khăn vốn có trong việc đạt được sự đồng thuận về một quy định chủ quan như vậy. Các tác giả quan sát, ví dụ, rằng những người khác nhau, và các loại người khác nhau (chẳng hạn như trẻ em và người lớn), có thể được sắp xếp khác nhau để tin vào một deepfake cụ thể.

Các tác giả lưu ý thêm rằng các khả năng AI tiên tiến của các công cụ như Photoshop thách thức các định nghĩa truyền thống của ‘deepfake.’ Mặc dù những hệ thống này có thể bao gồm các biện pháp bảo vệ cơ bản chống lại nội dung gây tranh cãi hoặc bị cấm, chúng mở rộng đáng kể khái niệm ‘chỉnh sửa.’ Người dùng có thể thêm hoặc xóa các đối tượng trong một cách rất thuyết phục và photorealistic, đạt được một mức độ chuyên nghiệp về tính xác thực mà tái định nghĩa ranh giới của thao túng hình ảnh.

Các tác giả tuyên bố:

‘Chúng tôi cho rằng định nghĩa hiện tại của deep fakes trong Đạo luật Trí tuệ Nhân tạo và các nghĩa vụ tương ứng không được chỉ định đủ để giải quyết các thách thức do deep fakes đặt ra. Bằng cách phân tích chu kỳ sống của một bức ảnh kỹ thuật số từ cảm biến máy ảnh đến các tính năng chỉnh sửa kỹ thuật số, chúng tôi tìm thấy rằng:

‘(1.) Deep fakes bị định nghĩa không rõ ràng trong Đạo luật Trí tuệ Nhân tạo của EU. Định nghĩa để lại quá nhiều phạm vi cho việc một deep fake là gì.

‘(2.) Không rõ làm thế nào các chức năng chỉnh sửa như tính năng “best take” của Google có thể được coi là một ngoại lệ cho các nghĩa vụ minh bạch.

‘(3.) Ngoại lệ cho hình ảnh được chỉnh sửa đáng kể đặt ra câu hỏi về việc chỉnh sửa nội dung đáng kể là gì và liệu việc chỉnh sửa này phải được nhận biết bởi một người tự nhiên.’

Lấy Ngoại lệ

Đạo luật Trí tuệ Nhân tạo của EU chứa các ngoại lệ mà, các tác giả cho rằng, có thể rất rộng. Điều 50(2), họ tuyên bố, cung cấp một ngoại lệ trong các trường hợp mà phần lớn hình ảnh nguồn gốc không bị thay đổi. Các tác giả lưu ý:

‘Điều gì có thể được coi là nội dung theo nghĩa của Điều 50(2) trong trường hợp âm thanh, hình ảnh và video kỹ thuật số? Ví dụ, trong trường hợp hình ảnh, chúng ta cần xem xét không gian pixel hay không gian nhìn thấy được bởi con người? Thao túng đáng kể trong không gian pixel có thể không thay đổi nhận thức của con người, và mặt khác, các nhiễu loạn nhỏ trong không gian pixel có thể thay đổi nhận thức một cách đáng kể.’

Các nhà nghiên cứu cung cấp ví dụ về việc thêm một khẩu súng vào ảnh của một người đang chỉ vào ai đó. Bằng cách thêm khẩu súng, bạn đang thay đổi ít nhất 5% hình ảnh; tuy nhiên, ý nghĩa ngữ nghĩa của phần thay đổi là đáng kể. Do đó, dường như ngoại lệ này không tính đến bất kỳ ‘hiểu biết thông thường’ nào về ảnh hưởng mà một chi tiết nhỏ có thể có đối với ý nghĩa tổng thể của một hình ảnh.

Điều 50(2) cũng cho phép ngoại lệ cho một ‘chức năng hỗ trợ cho chỉnh sửa tiêu chuẩn’. Vì Đạo luật không định nghĩa ‘chỉnh sửa tiêu chuẩn’ là gì, ngay cả các tính năng hậu kỳ cực đoan như Best Take của Google dường như được bảo vệ bởi ngoại lệ này, các tác giả quan sát.

Kết luận

Mục đích được tuyên bố của công việc mới là khuyến khích nghiên cứu liên ngành xung quanh việc quy định deepfakes, và để hoạt động như một điểm khởi đầu cho các cuộc đối thoại mới giữa các nhà khoa học máy tính và các học giả pháp lý.

Tuy nhiên, chính bài báo này đã sa vào tautology tại một số điểm: nó thường sử dụng thuật ngữ ‘deepfake’ như thể ý nghĩa của nó là rõ ràng, trong khi chỉ trích Đạo luật Trí tuệ Nhân tạo của EU vì không định nghĩa được điều gì thực sự cấu thành một deepfake.

Được xuất bản lần đầu vào thứ hai, ngày 16 tháng 12 năm 2024