Lãnh đạo tư tưởng

Sổ Tay Thực Tiễn Cho Đầu Ra LLM Có Thể Bảo Vệ

Có một giả định im lặng chạy qua hầu hết các triển khai GenAI của doanh nghiệp: nếu đầu ra trông đúng, thì nó đúng. Trong môi trường có mức độ rủi ro thấp, đó là một cách tiếp cận hợp lý. Trong các ngành công nghiệp được quản lý, như chăm sóc sức khỏe, tài chính, dược phẩm và đảm bảo chất lượng, đó là một trách nhiệm pháp lý chờ được lộ diện.

Khi đầu ra LLM ảnh hưởng đến quyết định lâm sàng, hồ sơ tài chính hoặc tài liệu tuân thủ, sự lưu loát không còn là đại diện cho độ tin cậy. Và khi một kiểm toán viên, nhà quản lý hoặc nhóm pháp lý hỏi về dữ liệu được sử dụng, quy tắc áp dụng và ai đã phê duyệt, “mô hình nói như vậy” không phải là câu trả lời mà bất kỳ ai có thể đồng ý.

Đây là khoảng cách trách nhiệm mà hầu hết các nhóm GenAI không thiết kế. Dưới đây là cách để đóng khoảng cách đó.

Tại Sao “Trông Đúng” Là Tiêu Chuẩn Sai

Đánh giá truyền thống của AI tập trung vào độ chính xác, độ trễ và chi phí. Những yếu tố này quan trọng. Nhưng môi trường được quản lý giới thiệu một trục thứ tư mà các yếu tố khác không thể thay thế: khả năng kiểm toán.

Đạo Luật AI Của EU, hiện đã có hiệu lực, yêu cầu các hệ thống AI có rủi ro cao phải duy trì tài liệu kỹ thuật, nhật ký theo dõi và bằng chứng về sự giám sát của con người trong suốt vòng đời của chúng. Hướng Dẫn Đầu Tiên Của FDA Về AI Trong Phát Triển Thuốc Và Sản Phẩm Sinh Học cũng chỉ ra hướng tương tự cho lĩnh vực khoa học sự sống. Những khuôn khổ này không đánh giá dựa trên sự lưu loát. Chúng yêu cầu các hệ thống có thể được tái tạo, kiểm tra và bảo vệ.

Đầu ra LLM có thể bảo vệ là đầu ra có thể được truy vết trở lại thông qua một chuỗi bằng chứng có thể xác minh: dữ liệu nó rút ra, các ràng buộc định hình nó, ai đã xem xét nó và những gì được giữ lại cho kiểm tra trong tương lai. Không có chuỗi đó, thậm chí đầu ra chính xác cũng không thể bảo vệ.

Điều này định lại ý nghĩa của “sẵn sàng sản xuất” đối với AI trong môi trường được quản lý.

Bốn Cột Trụ Của GenAI Sẵn Sàng Kiểm Toán

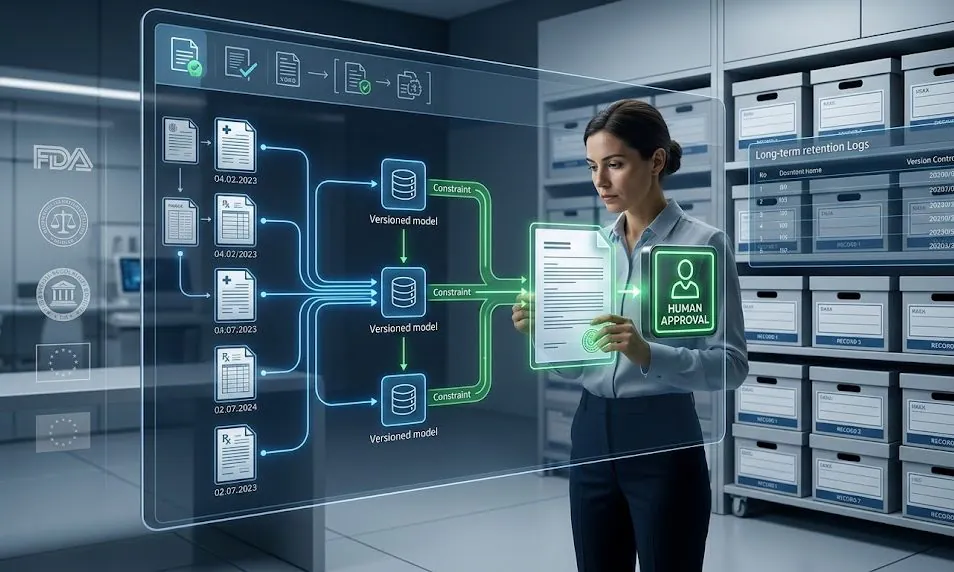

Xây dựng hệ thống LLM có thể bảo vệ đòi hỏi bốn yêu cầu kỹ thuật. Chúng không phải là những nguyên tắc trừu tượng – chúng là quyết định về cơ sở hạ tầng quyết định liệu hệ thống của bạn có thể sống sót sau sự kiểm tra hay không.

1. Nguồn Gốc: Kiểm Soát Nơi Mô Hình Nhận Thông Tin

Chế độ thất bại phổ biến nhất trong AI doanh nghiệp cũng là chế độ ít可 thấy nhất: mô hình rút ra từ kiến thức chung hoặc nguồn dữ liệu định nghĩa lỏng lẻo. Khi không có ranh giới kiến thức được kiểm soát, đầu ra không thể được truy vết đến bất kỳ nguồn kiểm toán nào và việc tái tạo trở nên không thể.

Một giải pháp thực tế là thiết lập ranh giới kiến thức được phê duyệt: tài liệu và tập dữ liệu phiên bản được hệ thống được phép sử dụng một cách rõ ràng. Mỗi câu trả lời nên mang theo một gói bằng chứng tối thiểu: một mã nguồn nhận dạng với phiên bản và ngày hiệu lực, một nhật ký truy xuất hiển thị những gì được truy vấn và chọn, và trích dẫn trực tuyến. Một quy tắc hoạt động hữu ích: không trích dẫn, không tuyên bố.

Điều này chuyển đổi hệ thống từ tạo ra dựa trên bộ nhớ sang lập luận dựa trên bằng chứng. Sự khác biệt trở nên quan trọng khi ai đó cần tái tạo một đầu ra cụ thể vài tuần hoặc vài tháng sau khi nó được tạo ra.

2. Ràng Buộc: Thay Thế Tự Phát Minh Bằng Hành Vi Kiểm Soát

LLM được xây dựng để thuyết phục. Không có ràng buộc, chúng tối ưu hóa cho tính hợp lý và tính hợp lý trong môi trường được quản lý là nơi rủi ro tồn tại.

Ràng buộc là cơ chế chuyển đổi một trình tạo văn bản xác suất thành một thành phần thực thi có giới hạn. Trong thực tế, điều này có nghĩa là:

- Tạo ra nguồn có ràng buộc: Mỗi tuyên bố yêu cầu một nguồn được phê duyệt, phiên bản. Không có nguồn nào có nghĩa là không có câu trả lời — chỉ từ chối hoặc nâng cấp.

- Sơ đồ đầu ra có cấu trúc: Câu trả lời tuân theo định dạng được xác định mà máy và kiểm toán viên có thể xác thực, không chỉ đọc.

- Áp dụng ranh giới tin cậy: Nội dung được truy xuất được xử lý như đầu vào, giải quyết trực tiếp các rủi ro tiêm lệnh.prompt có thể làm suy yếu cả bảo mật và khả năng kiểm toán.

- Truy cập với đặc quyền tối thiểu: Mô hình chỉ tương tác với dữ liệu và công cụ mà nó thực sự cần, giữ cho nhật ký kiểm toán sạch sẽ.

Ràng buộc không phải là một hộp kiểm toán. Chúng là quyết định kiến trúc quyết định liệu hệ thống của bạn có thể được kiểm toán hay không.

3. Xem Xét: Làm Cho Giám Sát Của Con Người Trở Thành Một LAYER Kiểm Soát Hình Thức

Trong AI được quản lý, xem xét của con người không thể là ad hoc. Nó cần được phân loại theo rủi ro (đầu ra có rủi ro cao hơn kích hoạt xác thực nghiêm ngặt hơn) và được kích hoạt khi sự tự tin của mô hình thấp, nguồn không có hoặc khi phát hiện thấy bất thường.

Đạo Luật AI Của EU yêu cầu rõ ràng rằng con người phải có thể giải thích, ghi đè và dừng các quyết định được thúc đẩy bởi AI trong các trường hợp sử dụng có rủi ro cao. Để đáp ứng yêu cầu này, hồ sơ xem xét cần ghi lại ai đã phê duyệt đầu ra, dưới những điều kiện nào và với mức độ kiểm tra nào. “Ai đó đã kiểm tra nó” không phải là một điều khiển. Một hồ sơ xem xét được ghi lại, có dấu thời gian là.

Điều này nâng cao xem xét từ kiểm soát chất lượng thủ công lên một lớp quản trị hình thức, chính xác là cách các nhà quản lý đang bắt đầu đối xử với nó.

4. Lưu Giữ: Làm Cho Trách Nhiệm Pháp Lý Durable

Không có nhật ký, không có đường dẫn kiểm toán. Không có đường dẫn kiểm toán, trách nhiệm pháp lý là lý thuyết.

Đồng thời, việc lưu giữ mọi thứ tạo ra rủi ro của riêng nó, đặc biệt là khi dữ liệu sức khỏe hoặc tài chính nhạy cảm phải tuân theo các yêu cầu tối thiểu hóa theo khuôn khổ như GDPR hoặc HIPAA.

Cách tiếp cận thực tế là mô hình phân cấp. Luôn lưu trữ siêu dữ liệu mô hình và phiên bản, mã nguồn nhận dạng, quyết định chính sách và dấu thời gian. Lưu trữ nội dung tương tác (lời nhắc, đầu ra và dấu vết đầy đủ) một cách có chọn lọc, dựa trên phân loại rủi ro, với kiểm soát truy cập và xóa dữ liệu phù hợp. Mục tiêu là cho phép tái tạo bất kỳ đầu ra nào mà không thu thập quá nhiều dữ liệu tạo ra rủi ro sau này.

Điều Này Trông Như Thế Nào Trong Thực Tiễn

Hãy xem xét cách nó áp dụng trong lĩnh vực khoa học sự sống, nơi CFR 21 Phần 11 yêu cầu hồ sơ điện tử phải có thể quy cho một người, có thể đọc được, đồng thời, ban đầu và chính xác. Một LLM tạo ra tài liệu quy định phải đáp ứng tất cả năm tiêu chí – không chỉ tạo ra văn bản có thể đọc được.

Trong bối cảnh này, bốn cột trụ không phải là những tính năng nâng cao tùy chọn. Chúng là tiêu chuẩn tối thiểu cho một hệ thống tuân thủ. Nguồn gốc đảm bảo đầu ra có thể quy cho một người và ban đầu. Ràng buộc đảm bảo nó ở trong ranh giới được định nghĩa. Xem xét đảm bảo nó đồng thời với sự giám sát của con người. Lưu giữ đảm bảo nó có thể đọc được và kiểm tra được.

Luận lý tương tự áp dụng trong dịch vụ tài chính, nơi MiFID II yêu cầu hồ sơ về quyết định và lý do đằng sau chúng, và trong chăm sóc sức khỏe, nơi hệ thống hỗ trợ quyết định lâm sàng phải đối mặt với sự kiểm tra ngày càng tăng về khả năng giải thích và thiên vị.

Sự Thay Đổi Lớn Hơn

GenAI đang chuyển từ thí nghiệm sang cơ sở hạ tầng hoạt động. Chuyển đổi này nâng cao tiêu chuẩn cho những hệ thống chấp nhận được.

Một đầu ra hữu ích không còn đủ. Tổ chức cần đầu ra có thể được giải thích, truy vết và bảo vệ dưới sự kiểm tra, vì AI đang được yêu cầu làm những việc có hậu quả thực sự.

Những đội thiết kế cho khả năng bảo vệ từ đầu sẽ được vị trí để mở rộng AI một cách an toàn và duy trì niềm tin quản lý. Những đội không làm như vậy sẽ cuối cùng phải đối mặt với khoảnh khắc tương tự: một cuộc kiểm toán, một câu hỏi thẳng về một đầu ra cụ thể và không có gì để hiển thị.

Xây dựng AI sẵn sàng kiểm toán không phải là về việc làm chậm lại. Đó là về xây dựng một thứ gì đó có thể tồn tại.