Yapay Zekâ

Azınlık Sesleri Google Doğal Dil İşleme Modellerinden ‘Filtreleniyor’

Yeni bir araştırmaya göre, mevcut en büyük Doğal Dil İşleme (NLP) veri setlerinden biri, siyahi ve Hispanik yazarları, ayrıca eşcinsel ve lezbiyen kimliklerle ilgili materyalleri ve diğer birçok marjinal veya azınlık kimlikleriyle ilgili kaynak verilerini çıkarmak için kapsamlı bir şekilde ‘filtrelenmiştir’.

Veri seti, Google’ın Switch Transformer ve T5 modeli için eğitilmiş ve Google AI tarafından kendisi tarafından oluşturulmuştur.

Raporda, 156 milyar tokeni içeren ve 365 milyondan fazla internet alanından alınan Colossal Clean Crawled Corpus (‘C4’) veri setinin, büyük Common Crawl kazılmış veritabanının bir alt kümesi olduğu ve ‘kaba’ ve ‘zehirli’ içeriği çıkarmak için kapsamlı bir şekilde (algoritmik olarak) filtrelenmiştir. Ayrıca, C4’ü oluşturan filtrelerin, azınlık gruplarından içerik ve tartışmaları hedef aldığını belirtmiştir.

Raporda şöyle denilmektedir:

‘Çıkartılan verilerin incelenmesi, Siyah ve Hispanik yazarlarla ilgili belgelerin ve cinsel yönelimlerden bahseden belgelerin, C4.EN’in blocklist filtrelemesi tarafından önemli ölçüde daha fazla çıkarılma olasılığına sahip olduğunu ve çıkarılan birçok belgenin saldırıya yönelik olmayan veya cinsel olmayan içerik (örneğin, eşcinsel evlilik hakkında yasama tartışmaları, bilimsel ve tıbbi içerik) içerdiğini gösteriyor.’

Çalışma, bulguların NLP sektöründe mevcut dil temelli ırksal eşitsizliği artırabileceğini ve LGBTQ+ kimliklerini damgalayabileceğini belirtmektedir. Ayrıca şöyle devam etmektedir:

‘Dil modellerini eğitmek için kullanılan veri setlerinden böyle bir metni çıkarmasının doğrudan bir sonucu, modellerin azınlık kimliklerine sahip kişilerden ve hakkında olan metinlere uygulandığında kötü performans göstereceği ve böylece onları makine çevirisi veya arama gibi teknolojilerin faydalarından etkili bir şekilde çıkaracağıdır.’

Common Crawl’i Düzenleme

Rapor, Colossal Clean Crawled Corpus: Bir Vaka Çalışması adlı bir çalışmadır ve Allen Institute for Artificial Intelligence, Washington Üniversitesi’ndeki Paul G. Allen School of Computer Science & Engineering, Hugging Face ve Queer in AI araştırmacıları arasında bir işbirliğidir.

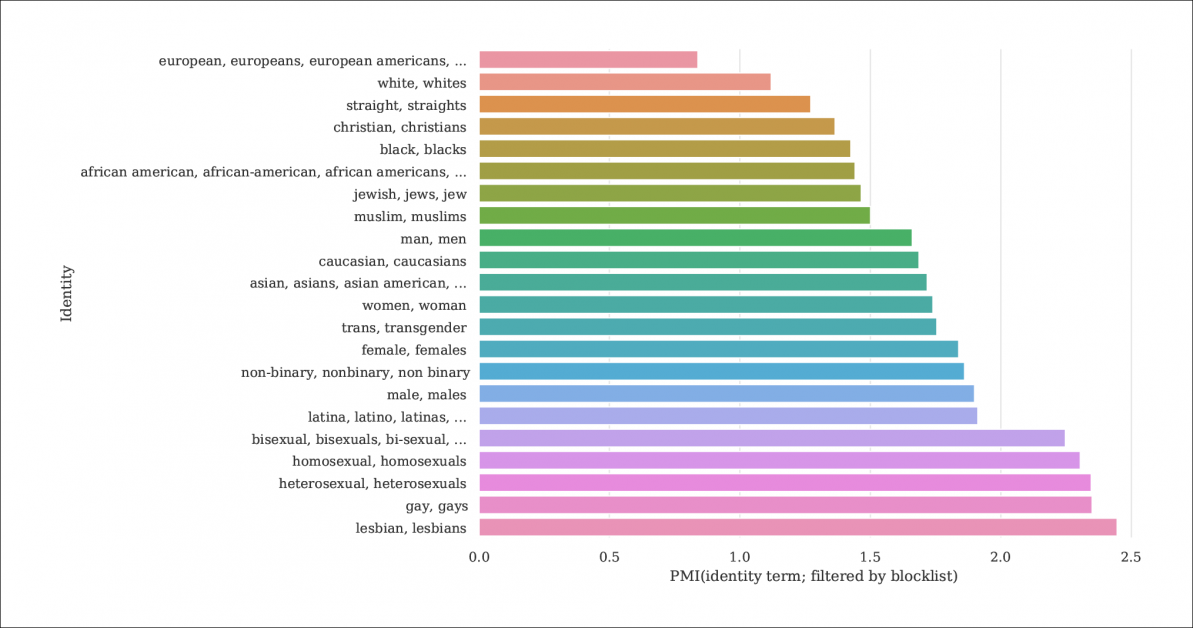

Rapordan, C4’ü daha büyük Common Crawl veritabanından çıkaran blocklist’lerin kimliklere ve belgelerine filtreleme olasılığını gösteren bir indeks. Grafik, kimlikler için Pointwise Mutual Information (PMI) indeksini temsil etmektedir ve eşcinsel ve lezbiyen kimliklerin en yüksek filtreleme olasılığına sahiptir. Kaynak: https://homes.cs.washington.edu/~msap/pdfs/dodge2021documentingC4.pdf

C4 modeli, NLP araştırmacıları için temel bir kaynak olarak kullanılan büyük Common Crawl web korpusunun bir alt kümesidir. Common Crawl, internetten metin verilerini daha keyfi bir şekilde kazıyarak, C4 gibi veri setleri için bir temel oluşturur.

… (translation continues)