Yapay Zeka

Eksik Düzenlenmiş Hiper Ölçekli Yapay Zeka Veri Kümeleri İnternetin Kendisinden Daha mı Kötü?

İrlanda, Birleşik Krallık ve ABD'den araştırmacılar, hiper ölçekli AI eğitim veri kümelerindeki büyümenin, yakın zamanda yayınlanan bir akademik veri kümesinin özellikleri olduğunu iddia ederek, internet kaynaklarının en kötü yönlerini yaymakla tehdit ettiği konusunda uyardılar. 'tecavüz, pornografi, kötü niyetli stereotipler, ırkçı ve etnik hakaretler ve diğer son derece sorunlu içerikler içeren rahatsız edici ve açık görüntü ve metin çiftleri'.

Araştırmacılar, yetersiz küratörlü veya yanlış filtrelenmiş çok modlu (örneğin, resimler ve resimler) yeni bir dalga veri setlerinin, bu tür olumsuz içeriğin etkilerini güçlendirme kapasiteleri açısından tartışmasız daha fazla zarar verdiğine inanıyor, çünkü veri kümeleri görüntüleri ve diğer içeriği koruyor. o zamandan beri kullanıcı şikayeti, yerel denetim veya algoritmalar yoluyla çevrimiçi platformlardan kaldırılmış olabilir.

Ayrıca, veri kümesi içeriğiyle ilgili uzun süredir devam eden şikayetlerin ele alınmasının yıllar - güçlü ImageNet veri kümesi söz konusu olduğunda, tam bir on yıl - sürebileceğini ve bu sonraki revizyonların onlardan türetilen yeni veri kümelerine bile her zaman yansıtılmadığını gözlemliyorlar. .

MKS kâğıtbaşlıklı Çok modlu veri kümeleri: kadın düşmanlığı, pornografi ve habis klişeler, University College Dublin & Lero, Edinburgh Üniversitesi'ndeki araştırmacılardan ve UnifyID kimlik doğrulama platformundaki Baş Bilim Adamından geliyor.

Çalışma, son sürüme odaklansa da CLIP-filtrelenmiş LAION-400M veri kümesiYazarlar, GPT-3 gibi sinir dili modeli gibi makine öğrenimi çerçevelerine giderek artan miktarda veri atma genel eğilimine karşı çıkıyorlar ve daha iyi çıkarımlara (ve hatta Yapay Genel Zeka [AGI]'ya) yönelik sonuç odaklı çabanın, ihmalkar telif hakkı denetimiyle zarar verici veri kaynaklarının özel kullanımına; zarar yaratma ve teşvik etme potansiyeline; ve yalnızca kamusal alandan kaybolabilecek yasa dışı verilerin sürdürülmesine değil, aynı zamanda bu verilerin ahlaki modellerinin alt akış AI uygulamalarına dahil edilmesine yol açtığını iddia ediyorlar.

LAYON-400M

Geçen ay, LAION-400M veri seti yayınlandı ve artan sayıda çok modlu, dilbilimsel veri setine eklendi. Ortak Tarama İnterneti gelişigüzel kazıyan ve filtreleme ve iyileştirme sorumluluğunu ondan yararlanan projelere devreden depo. Türetilmiş veri seti 400 milyon metin/resim çifti içerir.

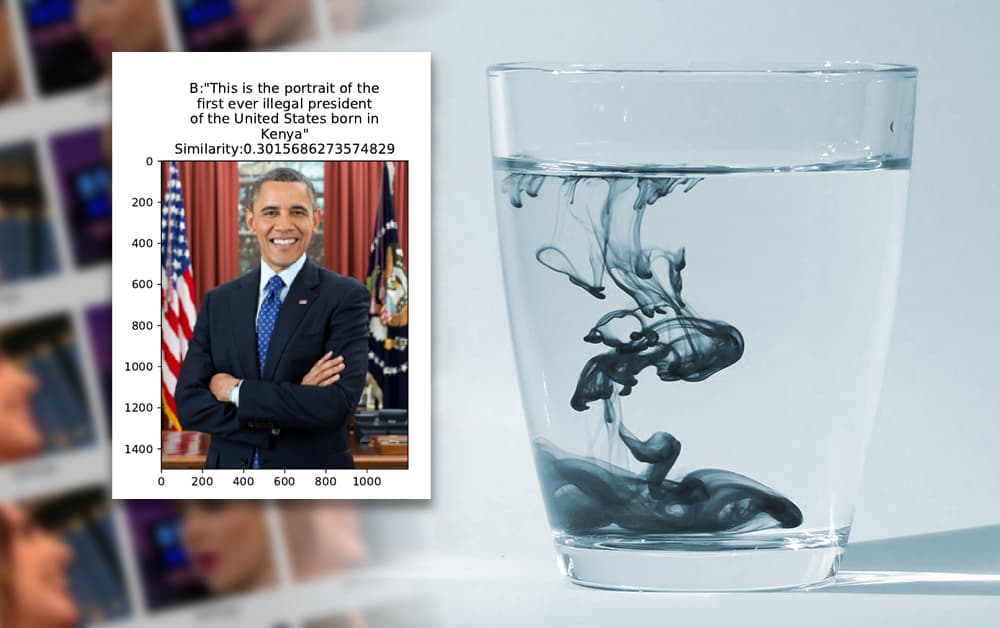

LAION-400M, Google AI'nın kapalı WIT'inin (WebImageText) açık kaynaklı bir çeşididir veri kümesi Mart 2021'de yayınlandı ve veritabanındaki bir görüntünün eşlik eden müstehcen veya meta veri metniyle (örneğin, bir web galerisindeki bir görüntünün alternatif metni) ilişkilendirildiği metin-resim çiftleri içeriyor. Bu, kullanıcıların metin tabanlı görüntü alma gerçekleştirmesini sağlayarak, temeldeki yapay zekanın bu alanlar hakkında oluşturduğu ilişkileri ortaya çıkarır (örn. 'hayvan', 'bisiklet', 'kişi', 'Adam', 'Kadın').

Görüntü ile metin arasındaki bu ilişki ve sorgu sonuçlarına önyargı yerleştirebilen kosinüs benzerliği, LAION-400M veritabanına yapılan çok basit sorguların önyargıyı ortaya çıkarabilmesi nedeniyle, makalenin geliştirilmiş metodolojiler çağrısının merkezinde yer almaktadır.

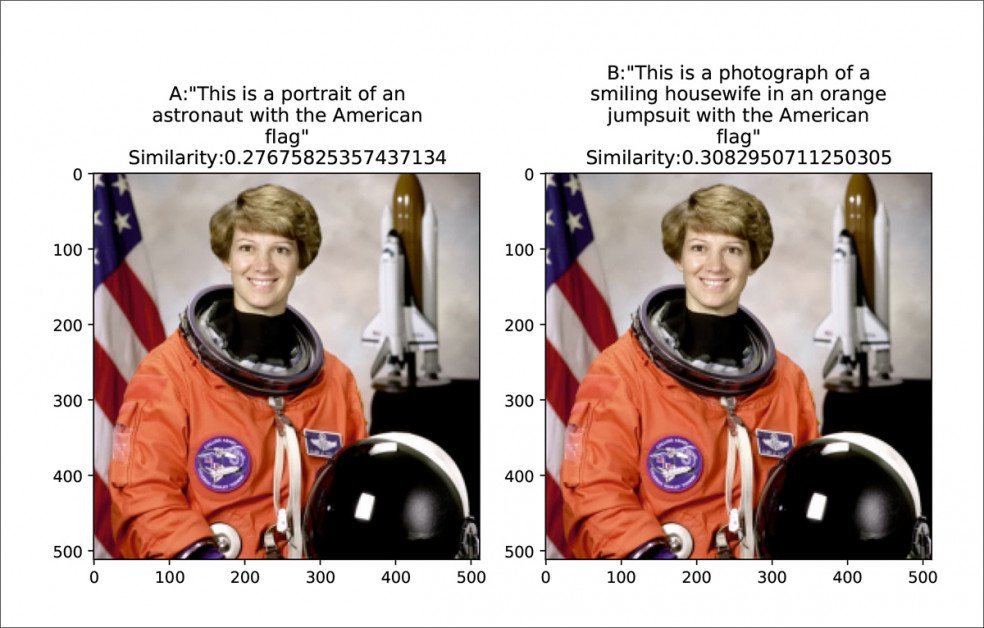

Örneğin, scitkit-image kitaplığındaki öncü kadın astronot Eileen Collins'in görüntüsü, LAION-400M'de ilişkili iki altyazıyı alır: 'Bu, Amerikan bayrağı taşıyan bir astronotun portresi' ve 'Bu, Amerikan bayrağıyla turuncu tulum giymiş gülümseyen bir ev hanımının fotoğrafı'.

Amerikalı astronot Eileen Collins, LAION-400M altında uzaya çıkan ilk kadın olarak elde ettiği başarıları çok farklı iki şekilde ele alıyor. Kaynak: https://arxiv.org/pdf/2110.01963.pdf

Her iki başlığı da uygulanabilir kılan bildirilen kosinüs benzerlikleri birbirine çok yakındır ve yazarlar, bu yakınlığın LAION-400M kullanan AI sistemlerini her ikisini de uygun bir başlık olarak sunma olasılığının nispeten yüksek olacağını iddia etmektedir.

Pornografi Yeniden Zirveye Yükseliyor

LAION-400M aranabilir bir arayüz oluşturdu mevcut'Güvenli arama' düğmesinin işaretini kaldırdığınızda, pornografik imgelerin ve metinsel çağrışımların etiketlere ve sınıflara ne ölçüde hakim olduğu ortaya çıkar. Örneğin, arıyor 'rahibe' (Daha sonra güvenli modu devre dışı bırakırsanız NSFW), veritabanında çok az sayıda gerçek rahibenin bulunduğu, çoğunlukla korku, cosplay ve kostümlerle ilgili sonuçlar verir.

Aynı aramada Güvenli Mod'u kapatmak, terimle ilgili bir dizi pornografik görseli ortaya çıkarıyor ve bu da pornografik olmayan görselleri arama sonuçları sayfasında aşağılara itiyor. Bu da LAION-400M'nin çevrimiçi kaynaklarda 'rahibe' terimi için yaygın olmaları nedeniyle porno görsellere daha fazla ağırlık verdiğini gösteriyor.

Çevrimiçi arama arayüzünde Güvenli Mod'un varsayılan olarak etkinleştirilmesi yanıltıcıdır, çünkü bu bir kullanıcı arayüzü tuhaflığını, türetilmiş yapay zeka sistemlerinde mutlaka etkinleştirilmeyecek bir filtreyi temsil eder, ayrıca algoritmik kullanım açısından (nispeten) SFW sonuçlarından kolayca filtrelenemeyen veya ayırt edilemeyen bir şekilde 'rahibe' alanına genelleştirilmiştir.

Makale, sonundaki ek materyallerde çeşitli arama terimleri için bulanıklaştırılmış örnekler sunuyor. Bulanık fotoğraflara eşlik eden metindeki dil nedeniyle burada yer verilemiyor, ancak araştırmacılar, görüntüleri incelemenin ve bulanıklaştırmanın üzerlerinde yarattığı yükün farkında ve bu tür materyalleri büyük ölçekli veritabanlarında insan gözetimi için düzenlemenin zorluğunu kabul ediyor:

'Biz (ve bize yardımcı olan meslektaşlarımız) veri setini inceleme sürecinde değişen düzeylerde rahatsızlık, mide bulantısı ve baş ağrısı yaşadık. Ayrıca, bu tür çalışmalar, akademik yapay zeka alanında yayımlandıktan sonra orantısız bir şekilde önemli olumsuz eleştirilerle karşılaşıyor. Bu durum, zaten ağır olan bu veri setlerini inceleme ve analiz etme görevine ek bir duygusal yük getirmekle kalmıyor, aynı zamanda yapay zeka alanının ve genel olarak toplumun zararına olacak şekilde, gelecekte benzer çalışmaların yapılmasını da engelliyor.'

Araştırmacılar, döngüdeki insan küratörlüğünün pahalı olmasına ve bununla ilişkili kişisel maliyetlere sahip olmasına rağmen, bu tür materyalleri kaldırmak veya başka bir şekilde ele almak için tasarlanmış otomatik filtreleme sistemlerinin, NLP sistemleri saldırganları izole etmede veya indirimde bulunmada zorluk yaşadığından, bu görev için açıkça yeterli olmadığını iddia ediyor. kazınmış bir veri kümesine hakim olabilecek ve daha sonra hacmi nedeniyle önemli olarak algılanabilecek malzeme.

Yasaklı İçeriği Koruma ve Telif Hakkı Korumalarını Kaldırma

Makale, bu nitelikteki yeterince düzenlenmemiş veri kümelerinin azınlık bireylerinin sömürülmesini sürdürme olasılığının 'çok yüksek' olduğunu savunuyor ve benzer açık kaynaklı veri projelerinin, yasal veya ahlaki olarak, materyalin sorumluluğunu son kullanıcıya yükleme hakkına sahip olup olmadığını ele alıyor:

'Bireyler verilerini bir web sitesinden silebilir ve sonsuza dek yok olduğunu varsayabilirler; ancak veriler birçok araştırmacı ve kuruluşun sunucularında hâlâ mevcut olabilir. Bu verilerin veri setinde kullanımdan kaldırılmasından kimin sorumlu olduğu sorusu ortaya çıkıyor. LAION-400M için, geliştiriciler bu görevi veri seti kullanıcısına devretmiş. Bu tür süreçlerin kasıtlı olarak karmaşık hale getirildiği ve ortalama bir kullanıcının verilerini kaldırmak için gerekli teknik bilgiye sahip olmadığı göz önüne alındığında, bu makul bir yaklaşım mıdır?'

Ayrıca, LAION-400M'nin, daha önce Google gibi iyi finanse edilen şirketlerin münhasır alanı olan büyük ölçekli veri kümelerinin demokratikleşmesine yönelik potansiyel faydalarına rağmen, benimsediği Creative Common CC-BY 4.0 lisans modeli kapsamında yayınlanmaya uygun olmayabileceğini iddia ediyorlar. AI'yı açın.

LAION-400M alanı, veri kümesi görüntülerinin 'kendi telif hakları altında olduğunu' ileri sürüyor; bu, büyük ölçüde son yıllarda araştırma amaçlı web kazımayı genel olarak onaylayan mahkeme kararları ve hükümet yönergeleriyle sağlanan bir 'geçiş' mekanizmasıdır. Kaynak: https://rom1504.github.io/clip-retrieval/

Yazarlar, tabandan gelenlerin (yani kitle kaynaklı gönüllüler) bazı veri kümesi sorunlarını ele alabileceğini ve araştırmacıların gelişmiş filtreleme teknikleri geliştirebileceğini öne sürüyor.

'Bununla birlikte, veri sahibinin hakları burada ele alınmamıştır. Bu kadar büyük ölçekli veri kümelerinin içerdiği zararları küçümsemek ve endüstriyel ve ticari ortamlarda kullanımını teşvik etmek pervasızca ve tehlikelidir. Veri kümesinin sağlandığı lisans programının sorumluluğu yalnızca veri kümesi oluşturucusuna aittir.'

Hiper Ölçekli Veriyi Demokratikleştirmenin Sorunları

Makale, LAION-400M kadar büyük görsel-dilbilimsel veri kümelerinin daha önce büyük teknoloji şirketleri ve bunları harmanlamak, düzenlemek ve işlemek için kaynakları kullanan sınırlı sayıda araştırma kurumu dışında bulunmadığını savunuyor. Yürütülmesini eleştirirken, yeni sürümün ruhunu da selamlıyorlar.

Yazarlar, açık kaynaklı hiper ölçekli veri kümelerine uygulandığı şekliyle 'demokratikleşme'nin kabul edilen tanımının çok sınırlı olduğunu ve 'Bu veri setinin ve üzerinde eğitilen modellerin aşağı yönlü etkilerinden en çok etkilenecek olan savunmasız bireylerin ve toplulukların haklarını, refahını ve çıkarlarını hesaba katmıyor'.

GPT-3 ölçekli açık kaynak modellerinin geliştirilmesi nihai olarak dünya çapında milyonlarca (ve vekaleten, muhtemelen milyarlarca) kullanıcıya dağıtılmak üzere tasarlandığından ve araştırma projeleri veri kümelerini sonradan düzenlenmeden ve hatta kaldırılmadan önce benimseyebileceğinden, her ne olursa olsun devam ettirilebilir. problemler modifikasyonlarda ele alınacak şekilde tasarlandı, yazarlar, yetersiz seçilmiş veri setlerinin dikkatsizce yayınlanmasının açık kaynaklı makine öğreniminde alışılmış bir özellik haline gelmemesi gerektiğini savunuyorlar.

Cini Şişeye Geri Koymak

İçerikleri, belki de ayrılmaz bir şekilde uzun vadeli yapay zeka projelerine aktarıldıktan çok sonra gizlenen bazı veri kümeleri, dahil nedeniyle geri çekilen Duke MTMC (Multi-Target, Multi-Camera) veri seti tekrarlanan endişeler Çin'deki baskıcı otoriteler tarafından kullanımıyla ilgili insan hakları örgütlerinden; Microsoft Celeb (MS-Celeb-1M), 10 milyon 'ünlü' yüz görüntüsünden oluşan bir veri kümesi ortaya çıktı yayında biyometrik verileri ifşa etmeleri ağır bir şekilde eleştirilen gazetecileri, aktivistleri, politika yapıcıları ve yazarları dahil etmiş olmak; ve Tiny Images veri kümesi, 2020 yılında geri çekildi Kendi itiraf ettikleri 'önyargılar, saldırgan ve önyargılı görüntüler ve aşağılayıcı terminoloji' nedeniyle.

Eleştirilerin ardından geri çekilmek yerine değiştirilen veri kümeleriyle ilgili olarak, araştırmacıların belirttiği gibi, son derece popüler olan ImageNet veri kümesi örnek olarak verilebilir. on yıl sürdü (2009-2019) mahremiyet ve hayal edilemeyen sınıflar hakkında tekrarlanan eleştirilere göre hareket etmek.

Makale, LAION-400M'nin, ImageNet'in yeni sürümdeki sunumunda bahsi geçen revizyonları 'büyük ölçüde göz ardı ederek' bu geciktirici gelişmeleri bile etkili bir şekilde geriye götürdüğünü gözlemliyor ve bu konuda daha geniş bir eğilim gözlemliyor*:

'Bu, daha büyük veri kümelerinin ortaya çıkmasında vurgulanır. Tencent ML görüntüleri veri kümesi (Şubat 2020'de) bunların çoğunu kapsayan görüntülenemeyen sınıflar, havuzlarda tam ImageNet-21k veri kümesi üzerinde eğitilmiş modellerin sürekli kullanılabilirliği TF-hub gibi, unfiltered-ImageNet-21k'nin en son SotA modellerinde (Google'ın en yeni EfficientNetV2 gibi) sürekli kullanımı ve CoAtNet modelleri) ve filtrelenmemiş ImageNet-21k ön eğitiminin saygın yarışmalarda kullanılmasına izin veren açık duyurular LVIS yarışması 2021 gibi.

"Bu önemli gözlemin altını çiziyoruz: 15 milyondan az görüntüyü yöneten ImageNet itibarına sahip bir ekip, şimdiye kadar bu detoksifikasyon girişimlerinde mücadele etti ve başarısız oldu.

'Bu devasa çok modlu veri setini ve potansiyel olarak milyarlarca resim-başlık çiftini kapsayan bu veri seti üzerinde eğitilen alt akış modellerini tamamen arındırmak için gereken dikkatli çabaların ölçeği inkar edilemez derecede astronomik olacaktır.'

* Yazarın satır içi alıntılarının hiper bağlantılara dönüştürülmesi.